一篇文章搞懂AI大模型的神经网络--万能近似定理

神经网络是人工智能的核心技术之一,其理论基础是连接主义,旨在通过模拟大脑神经元的结构来实现智能功能。万能近似定理证明了神经网络能够通过调整内部参数拟合任何函数,这为深度学习和人工智能的发展提供了数学依据。近年来,AI大模型迅速崛起,如Alpha-Go和大语言模型,展示了神经网络的强大能力。随着AI领域的快速发展,相关人才需求激增,学习AI大模型成为进入新兴行业的重要途径。尽管学习过程复杂,但丰富的

理解神经网络–万能近似定理

理解神经网络是理解人工智能的基础。人工智能起源于三大流派,符号主义(逻辑主义)、连接主义和行为主义。在这之中,连接主义以仿生学为出发点,旨在模拟人类大脑的神经元相互连接的结构。其核心思想是,通过构建和大脑神经元相似的连接结构,进而期望达成与之相同的功能。

这种思想非常朴素和自然。朴素到在其它领域我们也经常见到,如下所示:

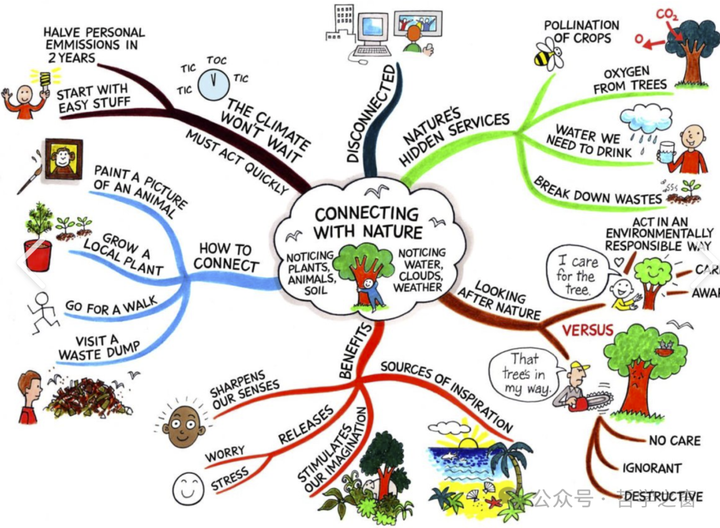

1. 思维导图

最近两年,大家都可以看到AI的发展有多快,我国超10亿参数的大模型,在短短一年之内,已经超过了100个,现在还在不断的发掘中,时代在瞬息万变,我们又为何不给自己多一个选择,多一个出路,多一个可能呢?

与其在传统行业里停滞不前,不如尝试一下新兴行业,而AI大模型恰恰是这两年的大风口,整体AI领域2025年预计缺口1000万人,其中算法、工程应用类人才需求最为紧迫!

学习AI大模型是一项系统工程,需要时间和持续的努力。但随着技术的发展和在线资源的丰富,零基础的小白也有很好的机会逐步学习和掌握。【点击蓝字获取】

【2025最新】AI大模型全套学习籽料(可白嫖):LLM面试题+AI大模型学习路线+大模型PDF书籍+640套AI大模型报告等等,从入门到进阶再到精通,超全面存下吧!

2. 双链接笔记

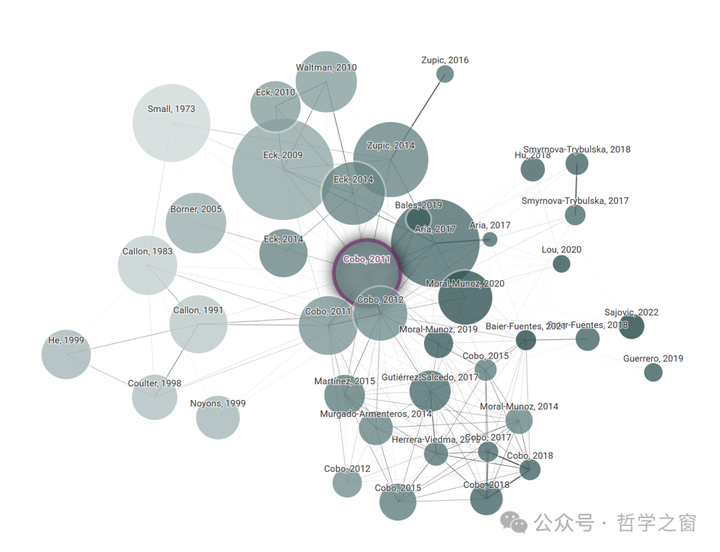

3. 文献引用图谱

以上的例子可能还有很多。虽然连接主义的思想在以上领域有所应用,但是真正令人震惊、且有突破性发展的还是在人工智能领域。

人工智能中的连接主义

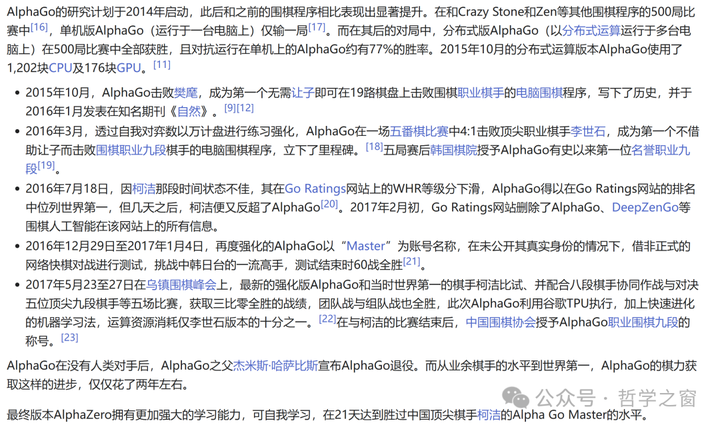

1. Alpha-Go

2016年,Alpha-Go击败世界围棋冠军李世石,震惊世界。而Alpha-Go所采用的技术是深度强化学习。深度神经网络描述的是神经网络的层数,而强化学习是结合行为主义思想让人工智能网络在实战中自我进化。

2. 大模型

大模型(Large Language Models)是deepseek等聊天机器人的技术基础,大模型的意思是神经元的数量巨大。其中的细节,这里不详细介绍。

涌现哲学

为什么数量巨大的神经网络会涌现出智能,我们在前面文章《数值实验》提到过涌现理论。

1972年8月,菲利普·安德森(Philip Anderson,1923-2020)的文章《多者异也》(More is different)在Science杂志发表。在该文中,他明确了涌现(emergence)的概念,并且认为“物理系统在每一个复杂度上都会出现全新的性质”——也就是说,尽管化学受制于物理定律,但我们无法从我们的物理知识中推断出化学领域的结果。

涌现的哲学理论虽然能解释一部分原因,但是这种解释是定性。而解释神经网络定量化的工具是数学。

万能近似原理

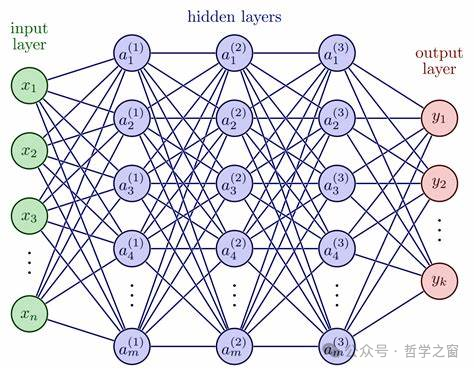

从数学角度看,神经网络是包含输入和输出的一个函数。比如进行图像识别时,我们①首先将输入的图像进行编码形转换为输入参数,②然后通过神经网络得输出参数,③输出参数再进行解码,判断图片是什么内容。

神经网络

单个神经元

万能近似定理也称为通用近似定理,是深经网络的理论基础。万能近似定理证明,神经网络是一个函数,通过学习改变函数内部的参数。内部参数调整好以后,就能够拟合任何函数。

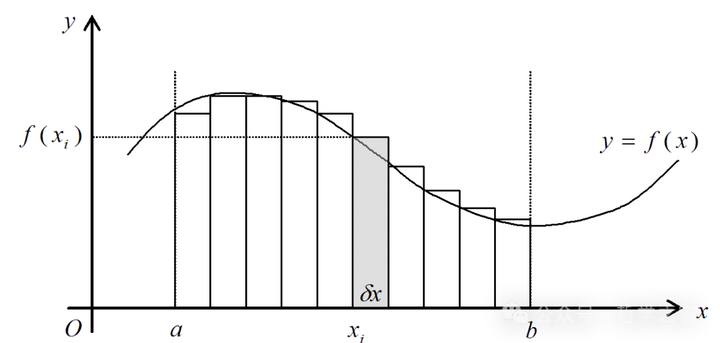

以下进行一个简单的证明:

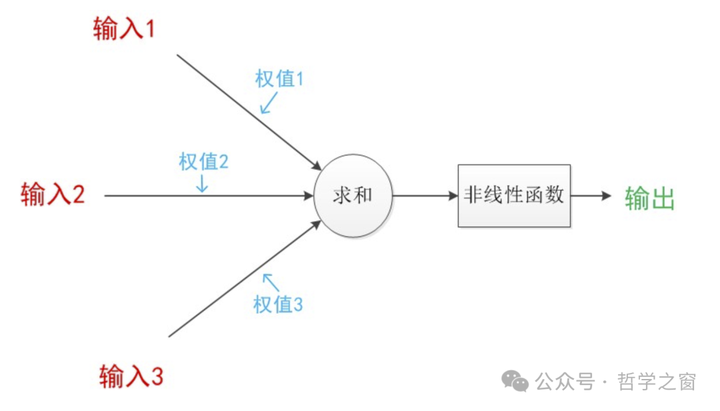

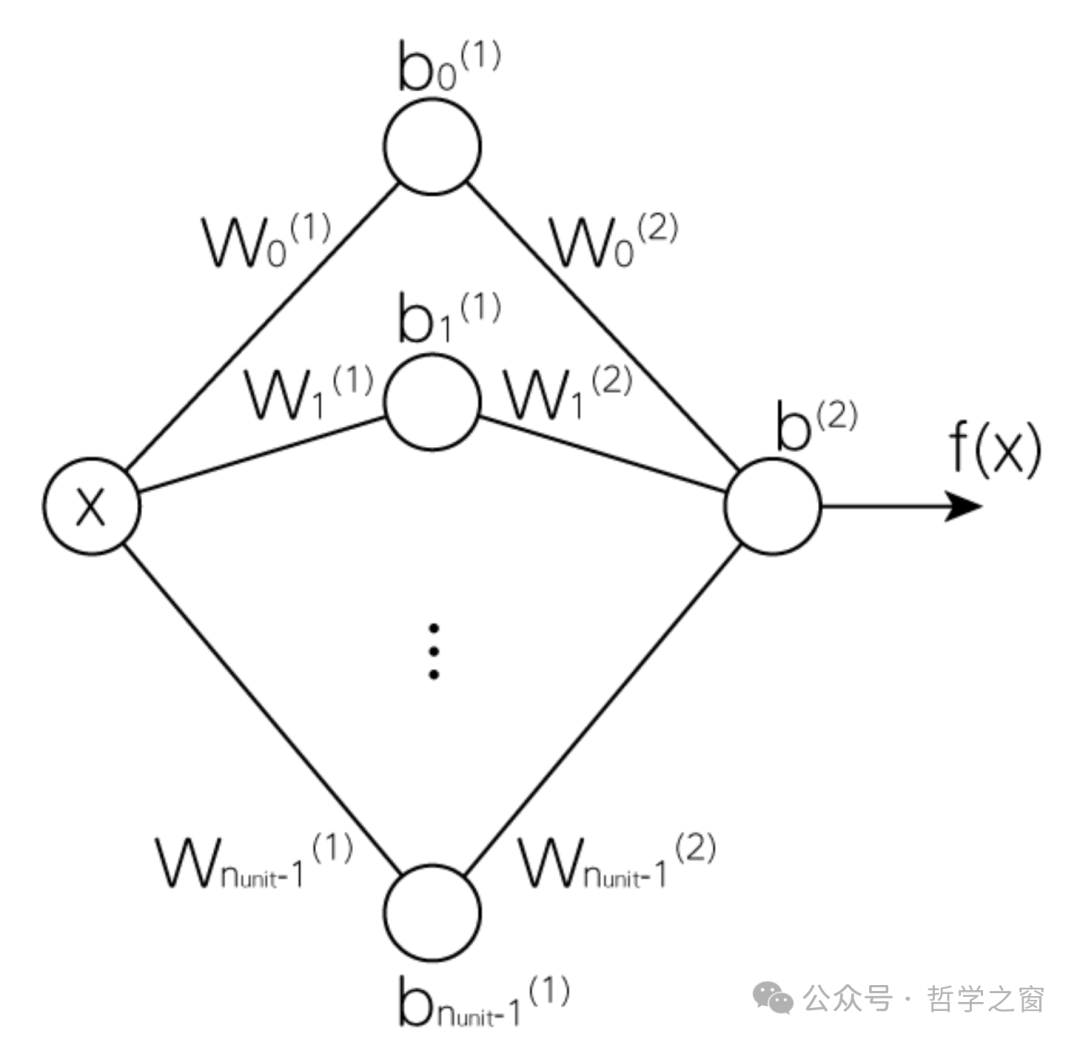

上图是一个神经单元的基本结构,包括输入、加权、求和以及非线性函数,最后是输出。我们构建一个输入的单层神经网络,如下图

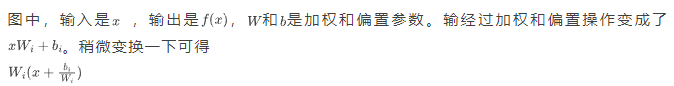

我们可以看到,这步骤操作是对自变量进行了平移操作和缩放操作。如下图,以台阶函数作为神经元的非线性激活函数。第一层的加权偏置相当于左右平移了台阶的位置,而第二层的加权相当于缩放了台阶的高度。

那么将足够数量的神经元叠加在一起,那么就相当于将很多 台阶函数相加。

只要台阶的数量足够多(大模型),网格划分的足够细,那么就能够模拟任何函数。

这就是神经网络为什么能通用的原因。我们看到,其背后的真正原理仍旧是数学。

最近两年,大家都可以看到AI的发展有多快,我国超10亿参数的大模型,在短短一年之内,已经超过了100个,现在还在不断的发掘中,时代在瞬息万变,我们又为何不给自己多一个选择,多一个出路,多一个可能呢?

与其在传统行业里停滞不前,不如尝试一下新兴行业,而AI大模型恰恰是这两年的大风口,整体AI领域2025年预计缺口1000万人,其中算法、工程应用类人才需求最为紧迫!

学习AI大模型是一项系统工程,需要时间和持续的努力。但随着技术的发展和在线资源的丰富,零基础的小白也有很好的机会逐步学习和掌握。【点击蓝字获取】

【2025最新】AI大模型全套学习籽料(可白嫖):LLM面试题+AI大模型学习路线+大模型PDF书籍+640套AI大模型报告等等,从入门到进阶再到精通,超全面存下吧!

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)