【AI大模型】终于!有人总结了大语言模型(LLM)学习路线,超详细!

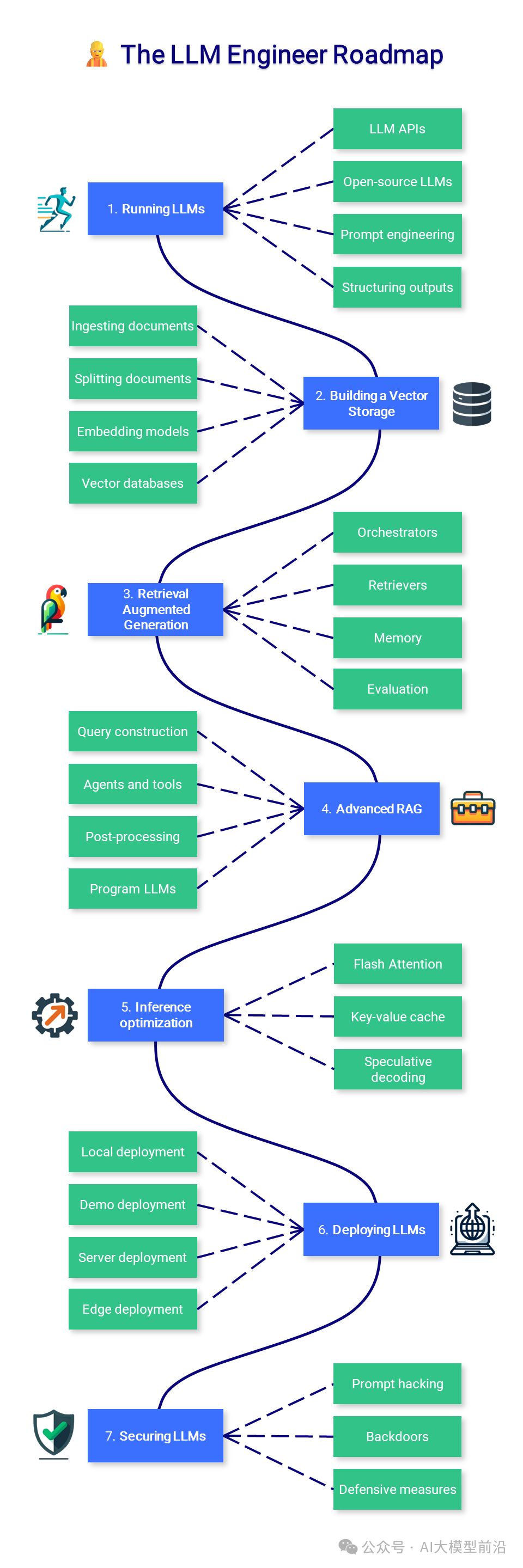

这篇指南提供了学习大型语言模型(LLM)的完整路线图。内容分为LLM基础知识和科学家进阶两大部分:基础知识涵盖机器学习数学原理、Python编程、神经网络和NLP核心概念;进阶部分深入讲解Transformer架构、注意力机制、模型预训练和微调技术(LoRA/QLoRA等)。文章推荐了大量优质学习资源,包括视频教程、开源项目和论文解析,适合不同阶段的学习者系统掌握LLM开发与应用技能。

前言

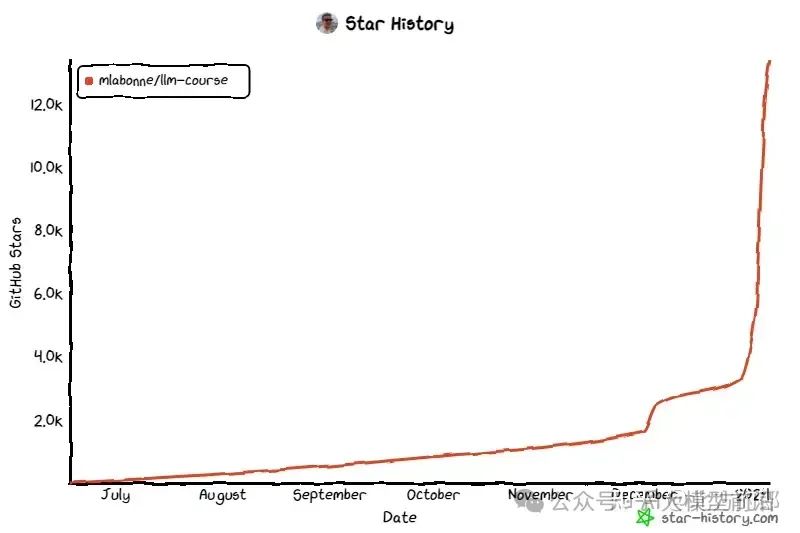

大家好,小编我发现了一个大模型学习的神库,包含大量LLM教材和资料,并绘制了学习路线图。可以帮助快速掌握大模型的应用和开发技巧。

GitHub地址:https://github.com/mlabonne/llm-course

LLM 基础知识

1. 机器学习之数学基石

在踏足机器学习的殿堂之前,深入理解其背后的数学原理至关重要。

- *线性代数*:它如同桥梁,连接着算法与数据世界。向量、矩阵、行列式、特征值与特征向量、向量空间及线性变换等概念,均为深度学习中的算法提供坚实的支撑。

- *微积分*:在连续函数的优化旅程中,导数、积分、极限与级数如同灯塔,指引我们前行。同时,多变量微积分与梯度的概念亦不可忽视。

- *概率与统计*:它们让模型从数据中汲取智慧,预见未来。概率论、随机变量、概率分布、期望、方差、协方差、相关性、假设检验、置信区间、最大似然估计及贝叶斯推理,这些概念如同星辰,点亮了我们的预测之路。

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

📚 *资源推荐*:

- 3Blue1Brown - 线性代数的本质:几何视角下,线性代数的真谛尽收眼底。

- StatQuest 与 Josh Starmer - 统计基础知识:简单明了,统计学的奥秘触手可及。

- Aerin 女士的 AP 统计直觉:深入浅出,概率分布背后的逻辑跃然纸上。

- 沉浸式线性代数:视觉盛宴,线性代数的另一种解读方式。

- Khan Academy - 线性代数:直观易懂,初学者的首选。

- 可汗学院 - 微积分:深入浅出,微积分的基础知识一网打尽。

- 可汗学院 - 概率与统计:清晰易懂,概率与统计的知识轻松掌握。

2. Python:机器学习的得力助手

Python,这门强大而灵活的编程语言,因其在数据科学领域的卓越表现,成为机器学习的得力助手。

- *Python基础*:从基本语法、数据类型、错误处理到面向对象编程,每一步都是通往数据科学殿堂的必经之路。

- *数据科学库*:NumPy助你一臂之力,实现高效的数值运算;Pandas让你轻松驾驭数据的海洋;Matplotlib与Seaborn则为你绘制出数据的美丽图景。

- *数据预处理*:特征缩放、标准化、缺失数据处理、异常值检测、分类数据编码以及数据集的拆分,每一步都为模型的训练与测试打下坚实基础。

- *机器学习库*:Scikit-learn是你手中的利剑,监督学习、非监督学习,多种算法任你挑选。从线性回归、逻辑回归、决策树、随机森林到K最近邻、K均值聚类,每一个算法都蕴含着数据背后的智慧。降维技术如PCA和t-SNE则助你一臂之力,将高维数据可视化,洞察其本质。

📚 *资源推荐*:

- Real Python:Python学习的宝藏之地,从基础到进阶,应有尽有。### 1. 深度学习启程 - Python语言

踏入freeCodeCamp - 学习 Python的长廊,一部详尽的视频将引领您逐步揭开Python核心概念的神秘面纱。而Python 数据科学手册,则如同一本珍贵的数字宝典,让您轻松掌握pandas、NumPy、Matplotlib和Seaborn的奥秘。

2. 机器学习之旅

对于机器学习的初学者,freeCodeCamp - 适合所有人的机器学习为您打开了一扇窗,让您一窥不同机器学习算法的风采。而Udacity - 机器学习简介则是一门免费的课程,深入浅出地为您解析PCA等关键概念。

3. 神经网络的深邃世界

神经网络,作为众多机器学习模型的核心,尤其在深度学习中扮演着重要的角色。为了驾驭这一利器,我们需全面了解其设计与运作机制。

- 基础知识:洞悉神经网络的结构,包括层、权重、偏差以及激活函数(sigmoid、tanh、ReLU等)。

- 训练与优化:熟悉反向传播和各类损失函数,如均方误差(MSE)和交叉熵,掌握梯度下降、随机梯度下降、RMSprop和Adam等优化算法。

- 抵御过度拟合:了解过度拟合的实质,学会应用dropout、L1/L2正则化、提前停止和数据增强等技术,为模型筑起坚固的防线。

- 实战多层感知器(MLP):运用PyTorch构建MLP,也称全连接网络,让您亲手体验神经网络的力量。

📚 资源宝库:

- 3Blue1Brown - 但什么是神经网络?:这部视频为您直观呈现神经网络的内部工作原理,让您一目了然。

- freeCodeCamp - 深度学习速成课程:快速概览深度学习的核心概念,让您在知识的海洋中畅游。

- Fast.ai - 实用深度学习:专为具备编程基础的深度学习爱好者打造,让您轻松入门。

- Patrick Loeber - PyTorch 教程:系列视频助您轻松掌握PyTorch的奥秘,开启深度学习之旅。

4. 自然语言处理的魔法

自然语言处理(NLP),人工智能的璀璨分支,它致力于弥合人类语言与机器理解之间的鸿沟。从简单的文本处理到深入的语言细微差别理解,NLP在翻译、情感分析、聊天机器人等领域展现出巨大的潜力。

- 文本预处理:掌握分词、词干提取、词形还原、停用词删除等关键技术,为NLP应用打下坚实基础。

- 特征提取技术:熟悉词袋(BoW)、词频-逆文档频率(TF-IDF)和n-gram等方法,将文本数据转化为机器学习算法可识别的格式。## 词嵌入的艺术

词嵌入,作为一种独特的词表示形式,赋予了具有相近内涵的词汇相似的形态,使它们在语义空间中彼此亲近。在众多杰出方法中,Word2Vec、GloVe 和 FastText 无疑是其中的佼佼者。

递归神经网络的魅力

递归神经网络(RNN)不仅揭示了其独特的工作原理,更展现了它处理序列数据的卓越能力。在LSTM和GRU这两种RNN的杰出变体中,我们看到了模型学习长期依赖关系的强大能力。

📚 *精选资源推荐*

- RealPython - NLP与spaCy在Python中的探索:spaCy库在Python中NLP任务的详尽指南,助您轻松驾驭自然语言处理。

- Kaggle - NLP学习指南:用Python实践NLP的宝贵笔记本和资源库。

- Jay Alammar - Word2Vec图解:深入了解Word2Vec架构的绝佳参考。

- Jake Tae - 从零开始的PyTorch RNN:PyTorch中RNN、LSTM和GRU模型的实用与简洁实现。

- colah的博客 - LSTM网络的理解:关于LSTM网络的深度理论剖析。

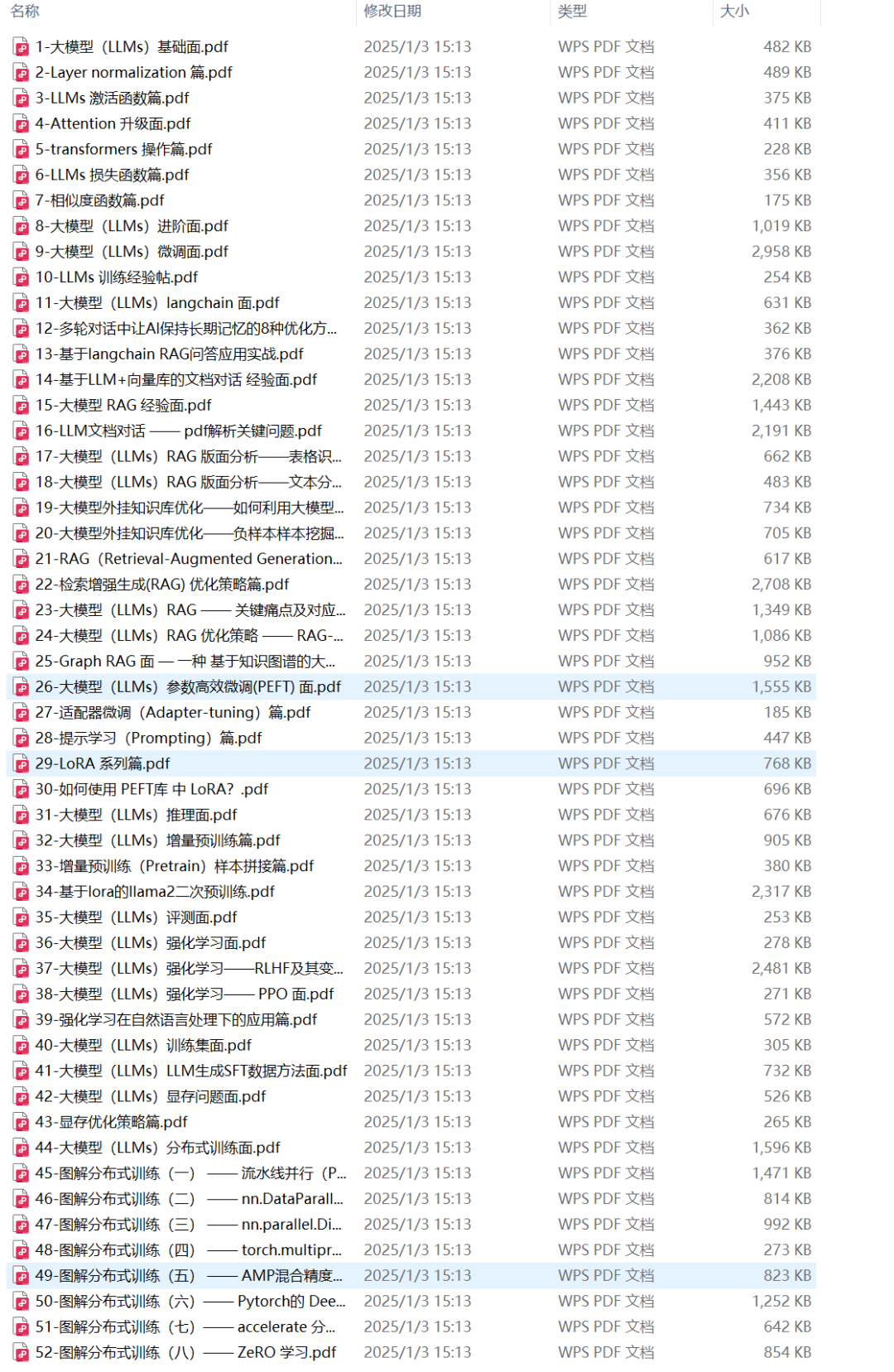

LLM科学家之旅

1. 深入LLM架构

尽管Transformer架构的细节不必一一掌握,但了解其输入(令牌)和输出(logits)却至关重要。普通的注意力机制作为其核心组件,更是我们学习的关键,其改进版本也将随后揭晓。

- *高级视角*:让我们重新审视编码器-解码器Transformer架构,特别是GPT架构,这一仅含解码器的架构已在现代LLM中广泛应用。

- *标记化*:将原始文本数据转化为模型能理解的格式,是了解如何将文本拆分为标记(通常是单词或子词)的关键。

- *注意力机制*:深入探索注意力机制背后的理论,如自注意力和缩放点积注意力,它们使模型在生成输出时能够聚焦于输入的不同部分。

- *文本生成*:探索模型生成输出序列的多种策略,包括贪婪解码、波束搜索、top-k采样和核采样等。

📚 *参考资料*

- Jay Alammar的Transformer图解:直观理解Transformer模型的绝佳资源。

- Jay Alammar的GPT-2图解:专注于GPT架构,与Llama有着异曲同工之妙。

- Brendan Bycroft的LLM可视化:以惊人的3D可视化方式,展示LLM内部的运作奥秘。这个链接可能存在安全风险,为了保护您的设备和数据安全,请避免访问此链接。这个链接可能存在安全风险,为了保护您的设备和数据安全,请避免访问此链接。### 怀旧学者揭秘Chinchilla的深邃寓意

- 怀旧学者对Chinchilla的疯狂暗示:深入剖析缩放定律,并探讨它们对LLM(大型语言模型)领域的普遍影响。

探索BigScience的BLOOM奥秘

- BigScience的BLOOM:这里是一份详尽的概念页面,详细描述了BLOOM模型的构建过程,包括工程细节与所遇挑战,为您提供丰富的技术洞察。

Meta的OPT-175:从日志中窥见智慧

- Meta的OPT-175日志:这份研究日志详细记录了模型开发中的问题和解决方案。对于有志于预训练大型语言模型(如本例中的175B参数模型)的研究者而言,它是一份极具价值的参考资料。

LLM 360:开源框架引领创新

- LLM 360:这是一个开源的LLM框架,汇聚了培训、数据准备、评估指标和模型资源。无论您是研究者还是开发者,都能在此找到所需的工具和灵感。

4. 监督微调:模型个性化的艺术

预训练模型往往专注于基础的下一个标记预测任务,因此难以直接应用于实际场景。而SFT(监督微调)技术,则允许您根据特定需求调整模型,使其能够响应复杂的指令。更重要的是,您可以基于私有数据或GPT-4无法触及的数据集来微调模型,无需支付高昂的API费用。

- *全微调*:这是一种涉及所有参数的微调方法,尽管效率有限,但往往能获得较为理想的结果。

- *LoRA*:这是一种高效的参数高效技术(PEFT),通过仅训练低阶适配器而非整个模型,实现了更快速、更经济的微调过程。

- *QLoRA*:作为LoRA的进阶版本,它不仅基于低阶适配器进行微调,还将模型权重量化为4位,并结合分页优化器以管理内存峰值。配合Unsloth使用,您甚至可以在免费的Colab笔记本上轻松运行。

- *Axolotl*:这是一个用户友好的微调工具,支持多种最先进的开源模型,为您的模型调整工作提供强大支持。

- *DeepSpeed*:专为多GPU和多节点设置设计的LLM预训练和微调框架,在Axolotl等项目中得到了成功应用。

📚****参考资料****:

- Alpin的新手LLM培训指南:为初学者提供了微调LLM时所需的基本概念、参数设置和实用技巧。

- Sebastian Raschka的LoRA见解:为您深入解读LoRA技术,并提供选择最佳参数的实用建议。### 🔍 精细调整Llama 2模型,探索语言模型的无限潜能

- 自定义Llama 2模型之旅:借助Hugging Face库,走进微调Llama 2模型的奇妙世界。

- 解密大型语言模型填充之道:Benjamin Marie为我们揭示了因果LLM填充训练样本的精湛技巧。

- LLM 微调新手指南:Axolotl如何助您微调CodeLlama模型,轻松开启LLM之旅。

5. 强化学习:倾听人类之声,塑造智慧模型

在监督微调之后,RLHF如同一道桥梁,将LLM的答案与人类的期望紧密相连。它借助人类的反馈学习偏好,旨在消除偏见、优化模型,使它们更加符合人类的期望。尽管比SFT更为复杂,但RLHF的效用使其成为不可或缺的选项。

- *偏好数据集*:这些数据集如同珍贵的宝石,蕴含了人类对不同答案的偏好排序,为模型提供了独特的视角。

- *近端策略优化*:此算法凭借奖励模型,洞察文本在人类心中的价值。它据此优化SFT模型,通过KL散度进行巧妙调整。

- *直接偏好优化*:DPO将复杂的优化过程简化为分类问题。它无需奖励模型训练,仅通过一个超参数即可实现高效稳定的模型优化。

📚 *参考宝库*:

- RLHF引导LLM培训之道:Ayush Thakur的指引,揭示了RLHF在减少LLM偏见、提升性能方面的独特魅力。

- Hugging Face的RLHF视觉盛宴:RLHF的深入解读,包括奖励模型训练和强化学习微调,为您揭开RLHF的神秘面纱。

- StackLLaMA教程:Hugging Face团队携手Transformer库,引领您高效地将LLaMA模型与RLHF完美融合。

- LLM培训探索:RLHF与替代方案:Sebastian Rashcka博士带您领略RLHF流程及RLAIF等替代方案的魅力。- 运用DPO对Mistral-7b进行微调:深入探索DPO微调技术在Mistral-7b模型中的应用,并精准再现NeuralHermes-2.5的精彩教程。

六、评价之艺

在LLM的广阔天地中,评价扮演着被低估却至关重要的角色。它既复杂又细致,需要针对下游任务精准选择评价内容。然而,请铭记古德哈特定律的警示:“一旦某项指标成为目标,其本身的可靠性便值得商榷。”

- 传统评价:虽然困惑度和BLEU分数等指标曾在过去盛行,但它们在今日的实际应用中显露出许多局限性。然而,了解它们以及它们适用的场合仍然是我们不可或缺的知识储备。

- 通用基准:在语言模型评估工具的支持下,开放LLM排行榜为通用LLM(如ChatGPT)提供了主要的评价标杆。同时,也有其他备受瞩目的基准测试,如BigBench和MT-Bench等。

- 任务特定基准:在摘要、翻译、问答等细分任务领域,有着各自专用的评价基准、指标和子领域(如医学、金融等)的特定要求,例如PubMedQA,为生物医学问答领域提供了精准的评价工具。

- 真实用户评价:最终,最真实、最可靠的评价来源于用户的反馈和直接的使用体验。如果你想知道一个模型是否表现出色,最简单也最有效的方法就是亲自试用它。

📚****参考资料****:

- Hugging Face对固定长度模型困惑度的深度解析:深入了解使用Transformer库实现困惑度计算的代码细节。

- BLEU的利弊考量:Rachael Tatman为我们带来了BLEU分数的全面解析,让我们更清晰地了解其优点与不足。

- Chang等人对LLM评估的深入调查:这篇论文全面探讨了LLM评估的内容、方法及其重要性。

- lmsys的Chatbot Arena排行榜:基于人类真实评价的通用LLM Elo评级,为我们提供了宝贵的参考。

7. 量化之路

量化,即通过降低模型权重(和激活)的精度来减少计算和内存成本的技术,正变得越来越重要。例如,原本使用16位存储的权重,现在可以被进一步压缩至4位表示。这一技术为我们优化LLM的性能和效率提供了新的方向。

- 基础技术概览:了解不同级别的精度(如FP32、FP16、INT8等)以及如何利用absmax和零点技术实现简单的量化过程。这个链接可能存在安全风险,为了保护您的设备和数据安全,请避免访问此链接。- 位置编码:深入探索 Transformer 中的位置编码机制,特别是那些引人注目的方案,如RoPE、ALiBi和YaRN,这些不仅增强了模型的理解能力,还赋予了处理更广泛上下文窗口的能力。(虽然它与直接的推理优化无直接联系,但无疑为模型提供了更广阔的视野。)

📚参考资料:

-

GPU Inference by Hugging Face:详细阐述了如何在GPU上实现高效的推理过程。

-

Optimizing LLMs for Speed and Memory by Hugging Face:详细解读了三种关键技术——量化、Flash Attention和架构创新,它们如何助力我们优化大型语言模型的速度和内存使用。

-

Assisted Generation by Hugging Face:这是一篇极具洞察力的博客,HF版本的推测解码技术在此得到了详尽的解读,其背后的实现逻辑令人着迷。

-

Extending the RoPE by EleutherAI:一篇综述性文章,对不同的位置编码技术进行了全面的梳理和总结。

-

扩展上下文很难……但并非不可能,作者:kaiokendev:在这篇博文中,作者深入探讨了SuperHOT技术,并为我们带来了关于相关工作的精彩解读,为读者呈现了一个宏大的视角。

好啦,以上就是本期**「大模型高能玩法」的全部内容!想获取更多大模型的独家深度资料?🔥 快关注 我**,一键解锁前沿技术解析、实战案例和进阶秘籍📚!

从零入门大模型:最全学习路线、实战案例与资源汇总(2025最新版)

人工智能大模型(如ChatGPT、DeepSeek等)正驱动着技术变革,掌握相关技术已成为提升竞争力的关键。然而,大模型技术涉及领域广泛,学习曲线陡峭。为了帮助大家系统性地学习和掌握大模型技术,我们整理了一份资源包,旨在提供从理论基础到实践应用的全面支持。

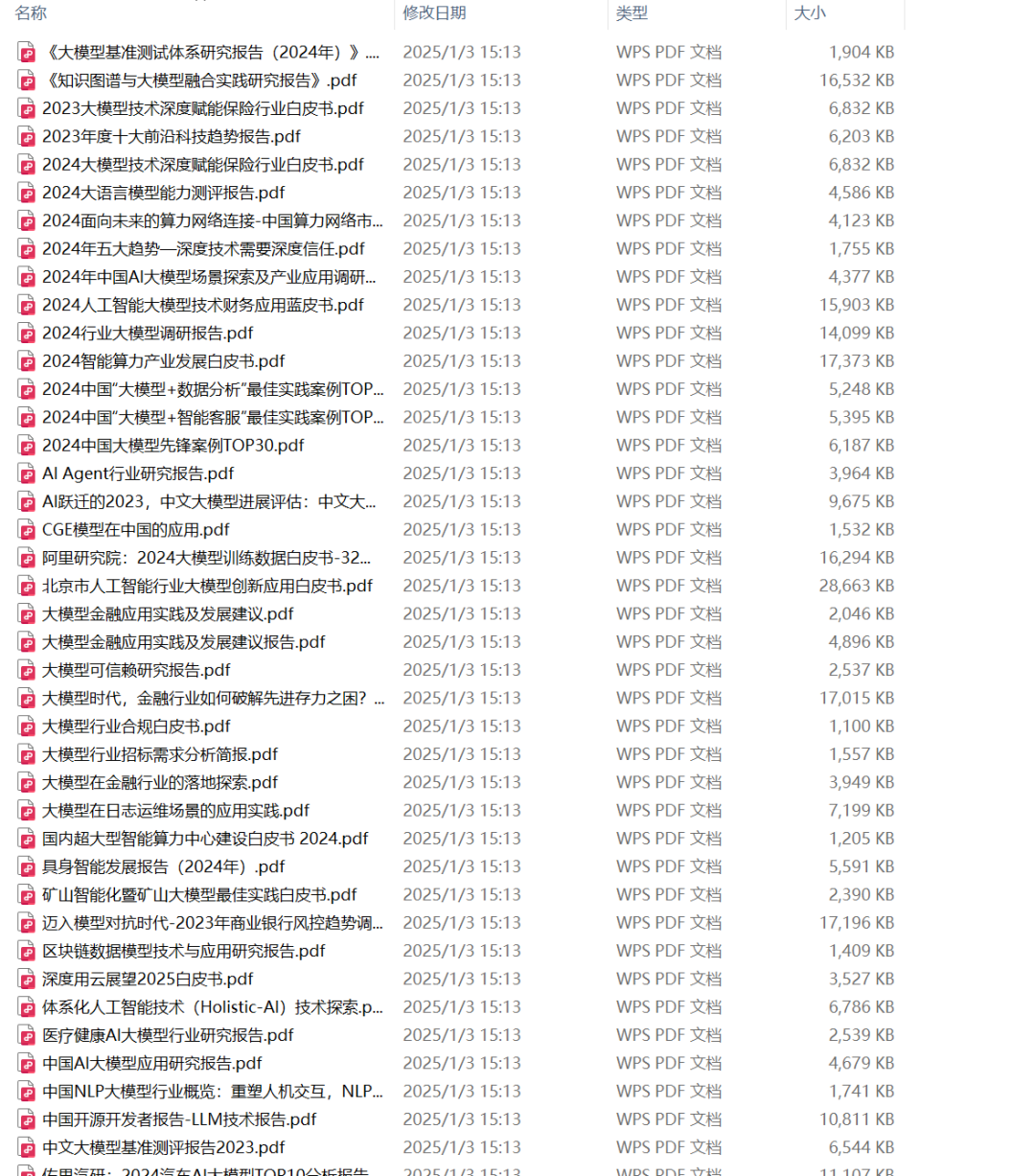

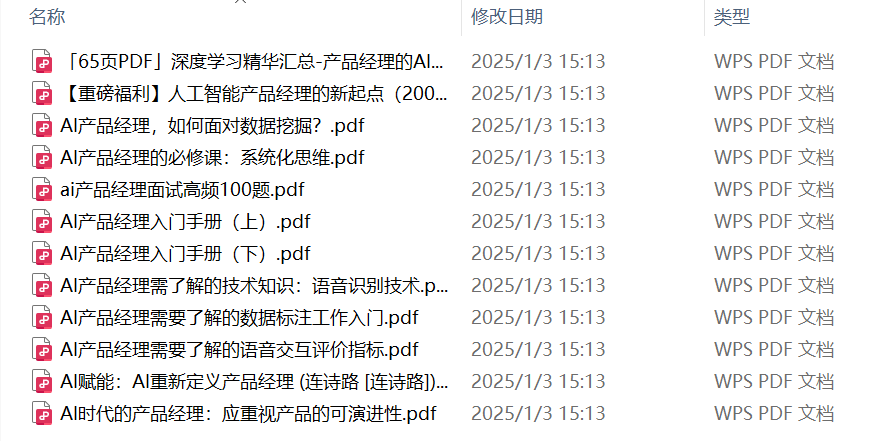

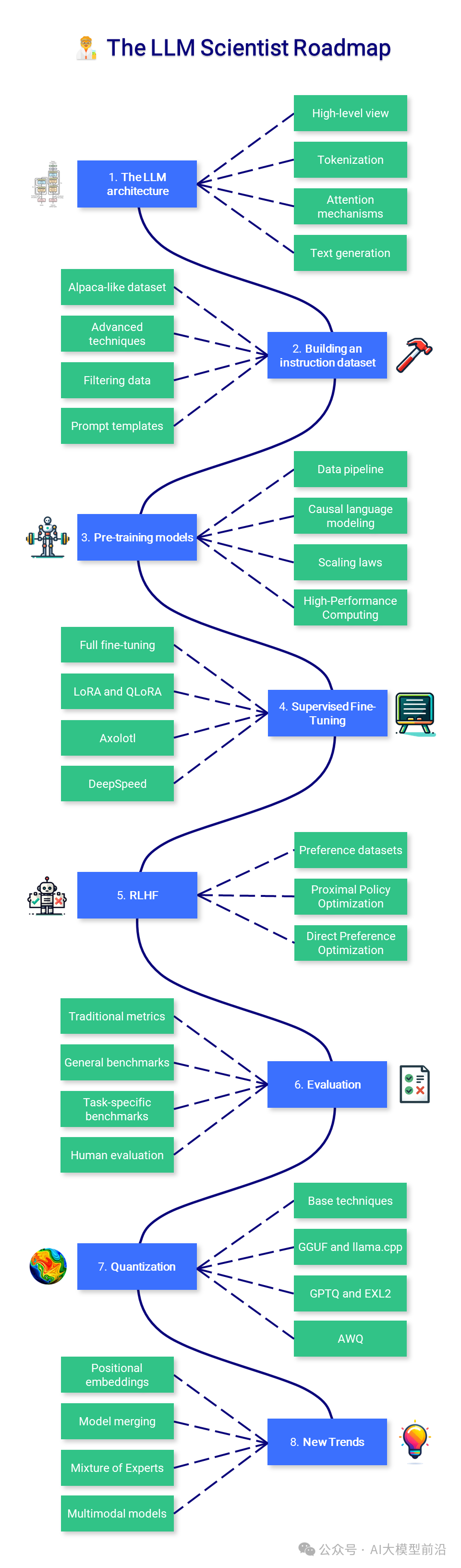

这份资源包包含以下内容:

大模型学习路线与阶段规划: 提供清晰的学习路径,帮助学习者了解不同阶段的学习目标和所需技能。

人工智能论文PDF合集: 收录了重要的大模型相关论文,涵盖Transformer架构、预训练模型、微调技术等关键领域,方便深入研究。

52个大模型落地案例合集: 汇集了不同行业的大模型应用案例,展示了如何将大模型技术应用于实际问题,并提供参考实现思路。

100+本数据科学必读经典书: 涵盖机器学习、深度学习、自然语言处理等领域的基础理论和算法,为理解大模型技术奠定基础。

600+套大模型行业研究报告: 提供市场分析、技术趋势、竞争格局等信息,帮助了解大模型技术的行业应用和发展前景。

这份资源包对于想要系统学习大模型技术的人来说,无疑是一份极具价值的指南。首先,要充分利用其中的“大模型学习路线与阶段规划”,这相当于你的学习地图,这份指南出自于我们体系教程《NLP大模型人才培养计划》。

务必仔细研读,了解每个阶段的目标、所需技能和学习内容,并根据自身情况进行调整,制定个性化的学习计划。可以将大的学习路线分解为更小的、可实现的目标,并设定完成时间,这有助于保持学习动力和跟踪进度。

添加👇方联系方式领取【保证100%免费】

咨询大模型人才培养计划 &免费领取本文资源

大模型学习路线与阶段规划

本路线旨在帮助学员掌握大模型相关技术栈,以及大模型在行业场景中的应用,包含企业级大模型项目实战。

各阶段详细学习内容:

阶段一:自然语言处理(NLP)与AI基础

-

目标: 掌握NLP与深度学习AI的基础知识,为后续大模型学习打下坚实基础。

-

学习内容:

-

- 自注意力机制(self-attention)

- 如何让模型学习到文本中不同语段的上下文联系?

- 巧用位置编码,传递语句前后顺序关系

- 核心计算流程:编码(Encoder)和解码(Decoder)

- 实践任务一: 使用Pytorch手撸Transformer

- 实践任务二: 全能的Transformer,解决时序预测问题

-

- 循环神经网络结构拆解

- 如何解决长序列的知识遗忘问题?—长短期记忆神经网络

- 基于PyTorch实现RNN代码架构

- 如何赋予模型双向学习能力?

- 在不同任务中的RNN的用法区别:分类、序列标注等

- 实践任务: 基于RNN的分词任务实战

-

- 卷积神经网络结构拆解

- 基于PyTorch实现CNN代码架构

- 卷积网络中的经典层(Layer)及其实现方法

- 卷积网络中的经典模块(Module)及其实现方法

- 使用卷积网络建模的经典模型介绍

- 实践任务: 使用CNN搭建文本分类模型

-

- 实践任务二: 深度学习开发环境搭建

-

- 实践任务一: 从0实现逻辑回归模型

-

- 人工智能的发展路径

- 机器学习优化方法和应用

- 深度学习的发展和应用范式的演变

- 卷积神经网络(CNN)

- 循环神经网络(RNN)

- Transformer架构

阶段二:自然语言处理实战

-

目标: 结合实际场景,掌握NLP技术栈中的任务分类及相关技术。

-

学习内容:

-

- BERT的模型结构解析

- BERT预训练方法

- Mask掩码机制:让模型自己做「完形填空」

- 长段落上下文信息增强,预测下一句(NSP训练策略)

-

- 数据准备: 准备训练数据、基础文本预处理

- 最简单的编码方法:One-Hot

- 词袋表示(N-Grams词袋)

- 基于词频统计的表示方法(TF-IDF)

- 词嵌入(Word2vec、Glove、FastText)

- 可视化词向量

- 实践任务: 手写Word2vec

-

- 问题定义

- 数据获取方法

- 数据探索(EDA)&数据整理(Wrangling)&预处理(Initial Preprocessing)

- 如何将数据转化成机器可识别的语言?— 特征工程

- 算法的高级艺术:抽象方法和建模策略

- 如何衡量算法模型的好坏?—评估方法及其重要性

- 将自然语言处理算法部署成应用能力

- 实践任务: 数据分析和预处理实战

-

- 第一个自然语言处理流程

- 文本表示方法

- 预训练模型 - BERT

阶段三:多模态大模型与知识图谱自动化构建

-

目标: 掌握多模态大模型架构,以及如何利用大模型自动化构建知识图谱。

-

学习内容:

-

- 知识图谱Schema建设方案

- 基于大模型的实体识别和关系构建方法

- 基于大模型的输入存储和图谱查询方法

- 自动化迭代策略

- 实践内容:

-

- 学习如何使用大模型根据行业数据特点帮助简历并完善知识图谱schema

- 学习如何在Prompt中通过ICL增强大模型对任务的理解

- 学习如何通过微调大模型,优化实体识别和关系关系构建效果

- 学习如何让大模型理解知识图谱的总体架构,从而让大模型能够根据用户输入去自动生成数据存储和查询知识图谱的指令

- 如何驱动大模型周期性得评估知识图谱结构的优劣,自动生成优化方案

-

- 学习如何构建指令模板

- 学习如何微调训练多模态大模型

- 搭建图像要素自动识别和多模态问答demo系统

-

- 多模态大模型

- 基于大模型的知识图谱自动化构建项目实战

阶段四:企业级大模型应用落地方案 - RAG实战

-

目标: 从0-1搭建通用性RAG应用框架,并应用于多个行业场景。

-

学习内容:

-

- 企业级应用框架设计与实现

- 三个标准流程的抽象与搭建方法(RAG.Chain)

- 灵活的功能组件实现策略(RAG.Module)

- 自定义文档加载器:PDF图文信息增强识别

- 自定义开发文档分割组件:中文段落切分优化方案

- 依赖服务的接入方法:向量数据库、大模型推理服务、embedding、重排序模型

- RAG评估流程搭建

- 基于LangSmith和langfuse搭建RAG流程监控系统

- RAG场景化进阶:基于知识图谱的增强策略(接入现有图谱数据、GraphRAG)

-

- RAG任务介绍 & 技术发展历程

- RAG依赖哪些组件和能力?(向量数据库、大模型推理服务)

- 模块化RAG系统架构设计 — 从理论到实战

- 主流的(开源)RAG应用开发框架

- RAG生态工具和能力

- 实践内容:

阶段五:Agent项目实战

-

目标: 掌握Agent技术,应对系统状态变化不可控的复杂场景。

-

学习内容:

-

- 学习如何通过Prompt引导Agent进行推理

- 学习Agent推理和验证流程的实现方法

- 学习如何让Agent在合适任务上调用外部能力来增强效果

- 学习如何搭建多Agent系统

- 学习如何解决多跳问题:ReAct的实现方法

- 「人人都是AI开发专家」实践一:基于ModelScope Agent搭建一个应用开发助手

- 「人人都是AI开发专家」实践二:基于Coze搭建一个知识问答机器人

-

- Agent通用架构介绍

- Agent中的规划(Planning)和推理(Reasoning)能力

- Agent的文本输出和工具调用

- 经典AI Agent案例分析

- ModelScope-Agent项目拆解

- 实践内容:

阶段六:大模型应用算法工程师面试辅导

-

目标: 提升面试技巧,成功斩获大模型应用算法工程师职位。

-

学习内容:

-

- 在企业中的发展路径

- 职业规划:如何快速升职加薪

- 技术层面如何持续性的自我提升

-

- 优秀简历模板讲解

- 典型简历抽样点评

- 大模型面试知识点整理和分享(八股文)

- 一线互联网大厂的面试流程及侧重点

- 面试技巧分享

- 面试时的几大忌讳

-

- 面试攻略及指导

- 大模型应用算法工程师的职业规划

人工智能论文PDF合集

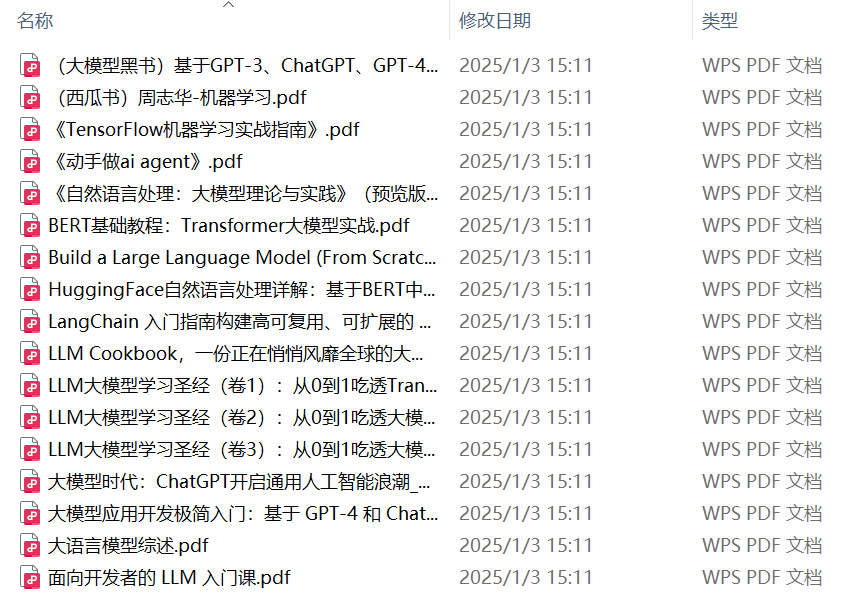

切忌贪多嚼不烂。建议从综述性论文入手,了解特定领域的整体情况和关键研究方向。同时,关注奠定大模型基础的经典论文,例如 Transformer 架构的论文。阅读时,精读与泛读结合,对于重要的论文仔细阅读并理解细节,对于其他论文则快速浏览以了解主要思想。务必做好笔记,记录论文的关键信息、创新点和实验结果,方便以后回顾。

52个大模型落地案例合集

52个大模型落地案例合集”是理论联系实际的绝佳素材。通过案例分析,了解大模型是如何应用于实际问题的,并思考这些案例是否可以应用于你感兴趣的领域。学习案例中的成功经验和遇到的挑战,并尝试复现一些简单的案例,加深理解。

100+本数据科学必读经典书

“100+本数据科学必读经典书”是夯实基础的基石。将书籍按照主题进行分类,例如机器学习、深度学习、自然语言处理、统计学、编程等,并根据自身背景和学习目标,选择合适的书籍。

从入门书籍开始,逐步深入。阅读时,参考其他读者的评论和推荐,选择高质量的书籍,并避免贪多嚼不烂,一次只读几本书,确保理解并掌握内容。

600+套大模型行研报告

“600+套大模型行研报告”是了解行业趋势的重要窗口。通过阅读行研报告,了解大模型技术的最新发展趋

部分资源内容展示

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)