《全景洞察:构建分层监控体系与智能根因定位框架》

│ 决策层 │◀─AI预测性维护│ 分析层 │─智能根因定位─┐│ 执行层 │─自动修复─────┘。

在云原生与分布式系统主导的今天,系统复杂度指数级增长,故障影响面急剧扩大。传统的点状监控与人工排障模式已难以应对挑战。构建全景式分层监控体系与智能根因定位框架,成为保障系统韧性、提升运维效率的核心支柱。

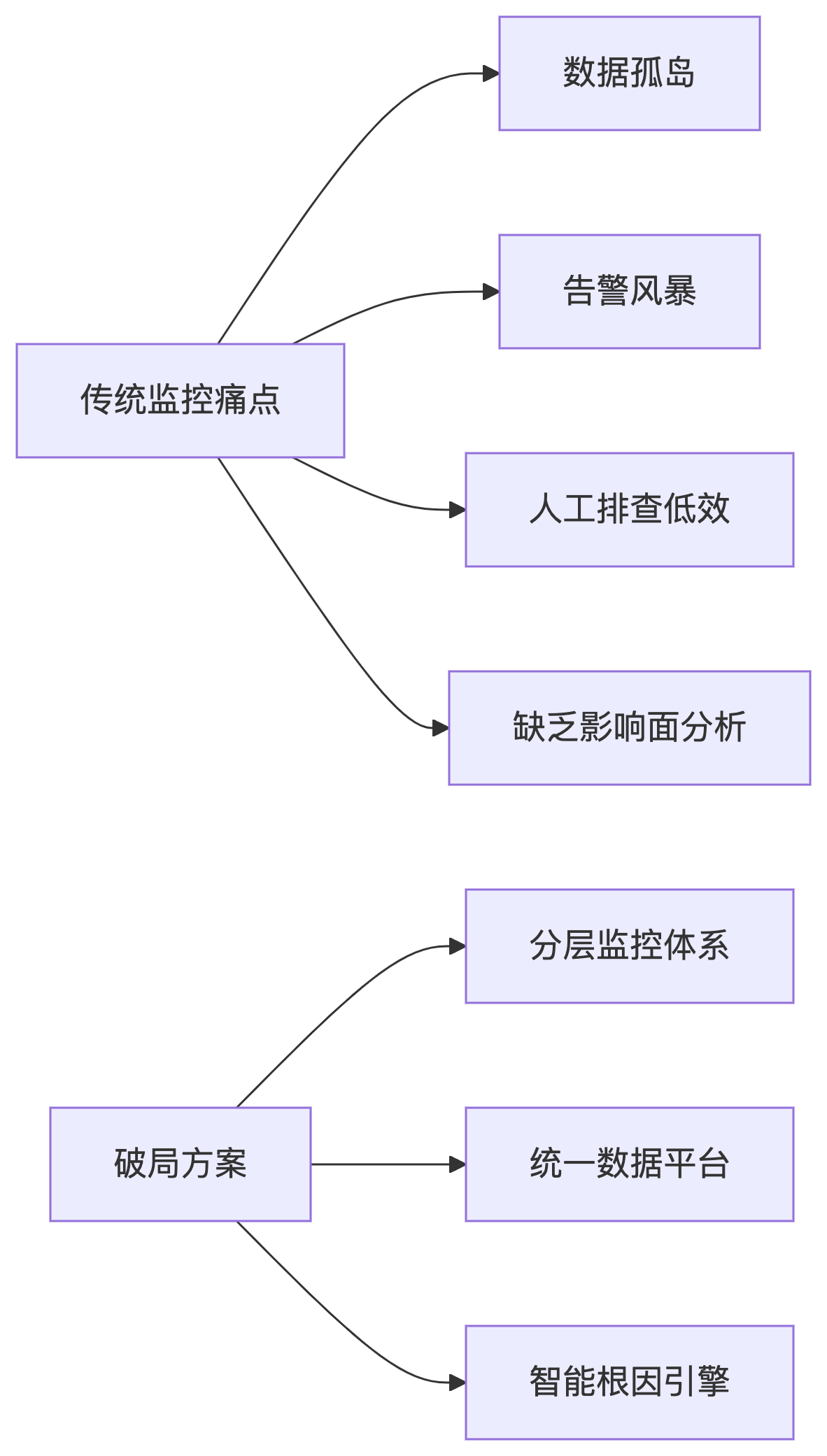

一、 传统监控困局与破局思路

- 数据孤岛: 基础设施、应用、日志、链路、用户体验数据分散,无法关联分析。

- 告警风暴: 低价值告警泛滥,淹没核心故障信号,运维人员“疲于救火”。

- 定位低效: 依赖专家经验逐层排查,故障恢复时间(MTTR)居高不下。

- 缺乏全景: 无法快速回答“故障影响范围有多大?”、“根因是什么?”。

二、 分层监控体系设计

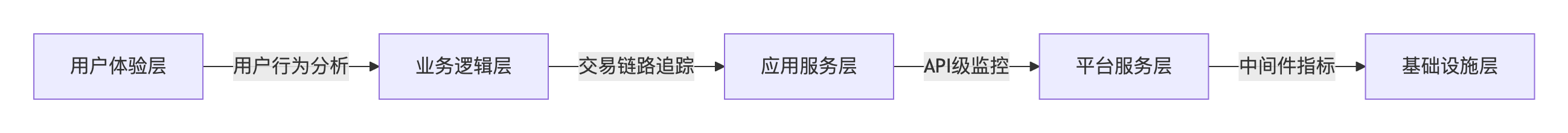

2.1 五层监控模型

2.2 架构实现

+-------------------+ +-------------------+

| 数据采集层 | | 智能分析层 |

| - OTel Agent |====>| - 动态拓扑引擎 |

| - Prometheus | | - 规则引擎 |

| - eBPF探针 | | - AI模型服务 |

+-------------------+ +-------------------+

||

\/

+-------------------+ +-------------------+

| 统一存储层 | | 可视化层 |

| - 时序数据库 |====>| - 拓扑地图 |

| - 日志索引 | | - 根因报告 |

| - 追踪仓库 | | - 业务仪表盘 |

+-------------------+ +-------------------+2.3 关键层设计原则

核心思想:自底向上,逐层抽象,覆盖完整技术栈。

|

层级 |

监控目标 |

核心指标 |

关键工具/数据源 |

|

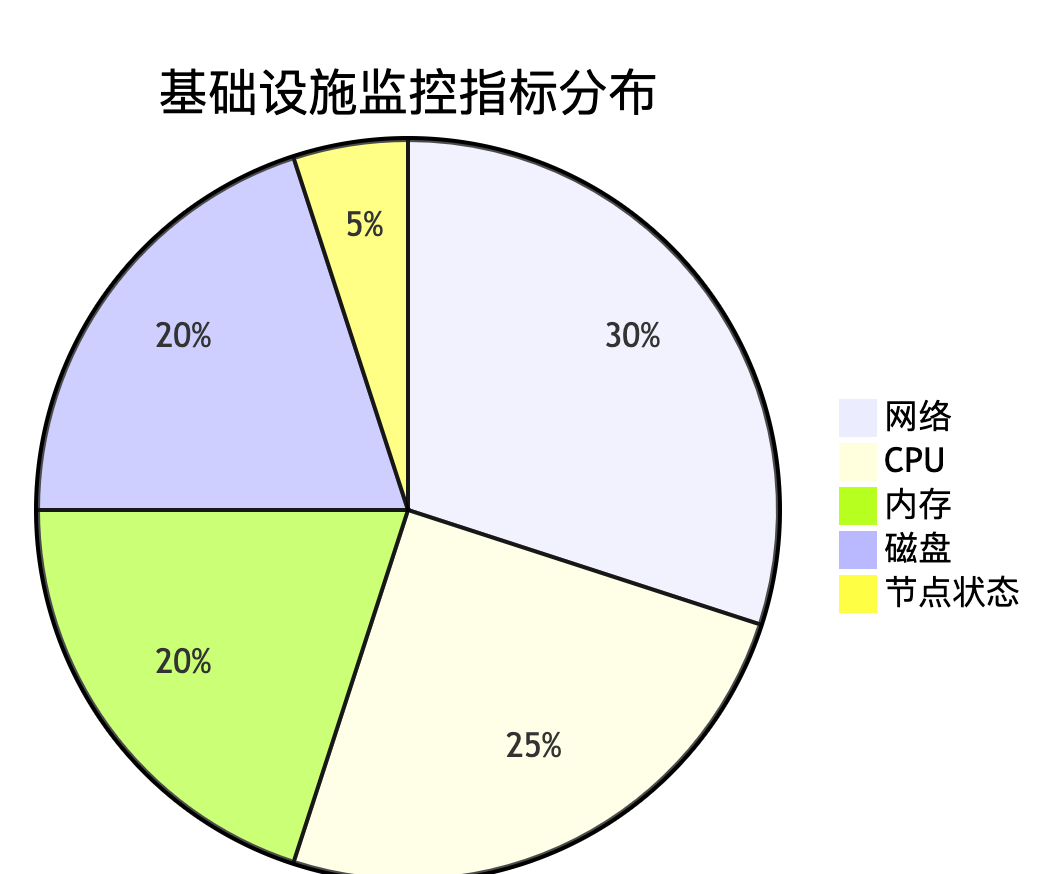

基础设施层 |

服务器、网络、存储、云资源 |

CPU/Mem/Disk/网络IO、云服务配额/状态 |

Prometheus, Zabbix, 云厂商监控 (CloudWatch) |

|

应用运行层 |

应用进程、中间件、数据库 |

JVM GC、线程池、连接池、慢查询、错误率 |

Micrometer, JMX, 应用日志 (ELK, Loki) |

|

服务层 |

微服务、API、消息队列 |

吞吐量、延迟、错误率、饱和度 (RED/SLA)、消息积压 |

分布式追踪 (Jaeger, Zipkin), 服务网格指标 |

|

用户体验层 |

终端用户感知 |

页面加载时间 (TTFB, FCP)、事务成功率、Apdex |

RUM (Real User Monitoring), 合成监控 (Synthetic) |

|

业务层 |

核心业务流程、KPI |

订单成功率、支付转化率、DAU/MAU |

业务埋点、数据仓库、BI工具 |

1. 基础设施层(基石层)

监控目标:物理/虚拟资源健康状态

核心指标采集:

技术实现方案:

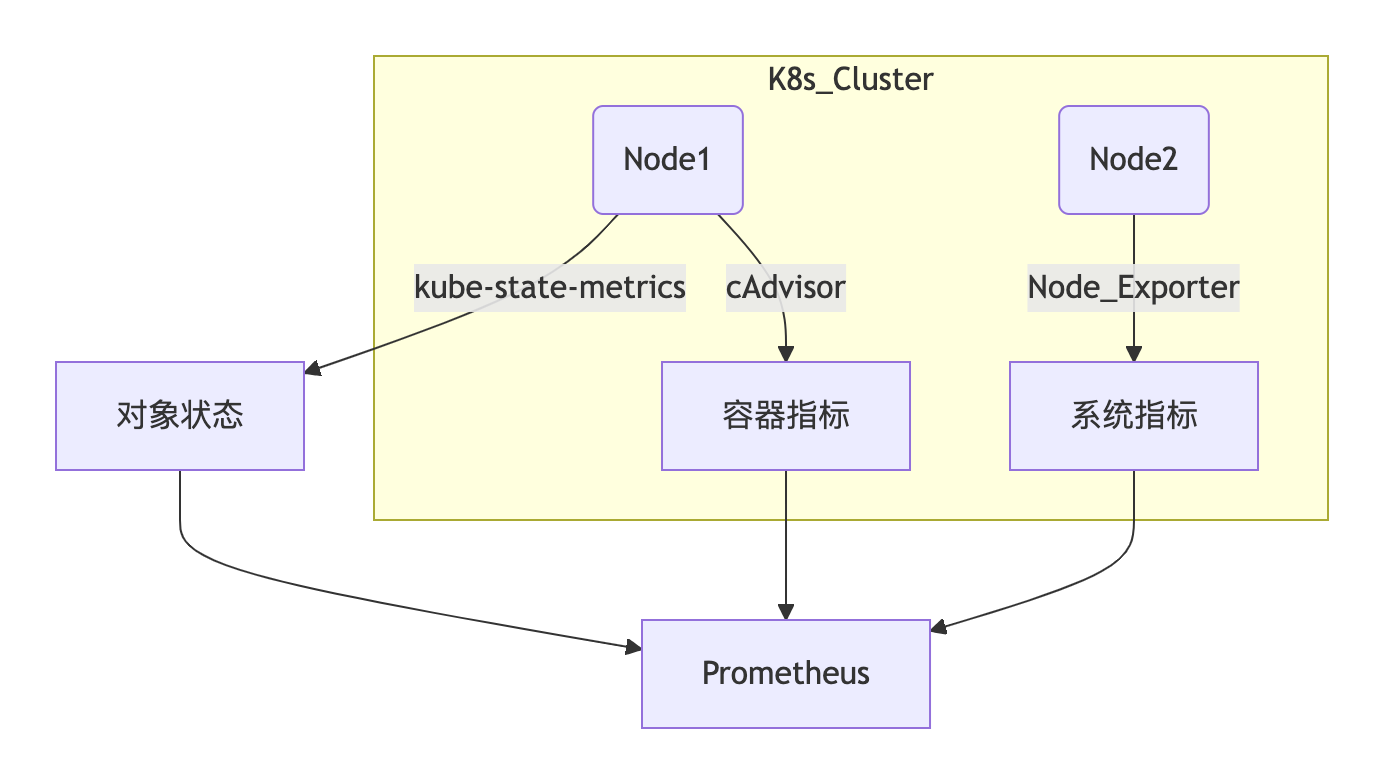

▲ 图2:Kubernetes环境监控数据采集架构

关键创新点:

- 标签注入:自动附加

cluster=prod,az=cn-east-1a等上下文标签 - 智能基线:基于时间序列预测自动调整告警阈值(如夜间低负载期)

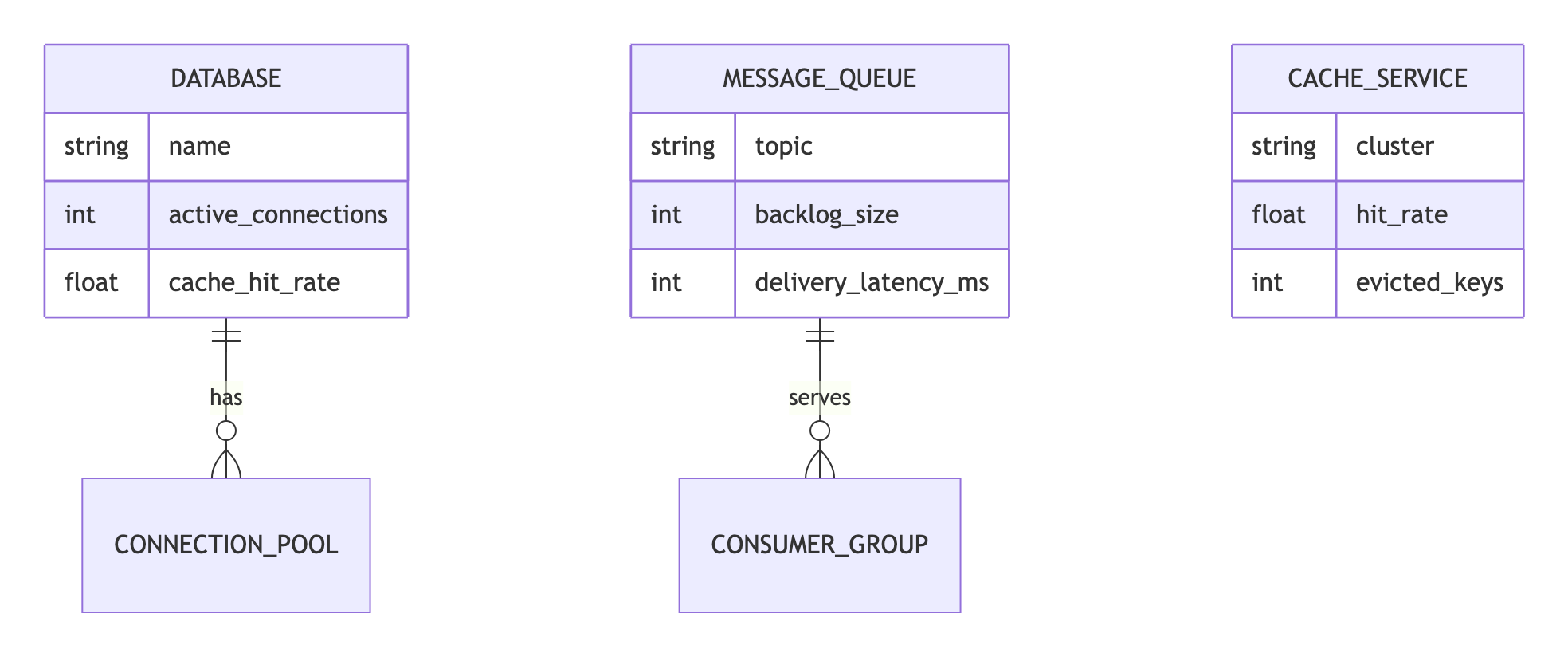

2. 平台服务层(支撑层)

监控矩阵设计:

典型配置示例(Redis监控):

# Redis Exporter配置

metrics:

- name: redis_memory_used_bytes

help: 'Total memory used by Redis'

key: 'memory.used'

type: gauge

- name: redis_command_calls

help: 'Total commands processed'

key: 'stats.command_processed'

type: counter

labels:

- env: production

role: cache3. 应用服务层(核心层)

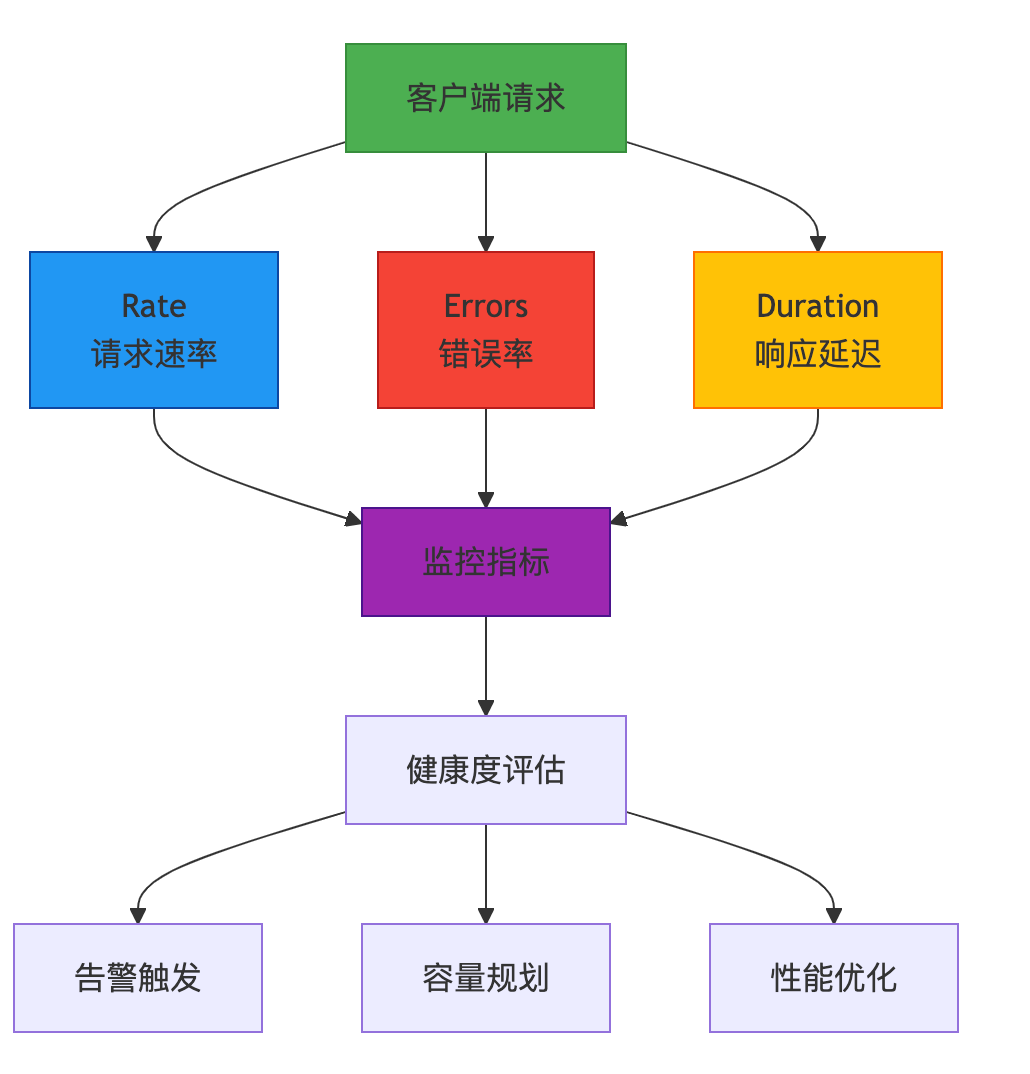

微服务监控黄金法则:RED指标体系

OpenTelemetry自动埋点示例:

// Golang服务埋点

func handleRequest(w http.ResponseWriter, r *http.Request) {

ctx, span := otel.Tracer("order-service").Start(r.Context(), "ProcessOrder")

defer span.End()

// 添加业务属性

span.SetAttributes(attribute.String("order.type", "express"))

// DB调用自动捕获

dbCall(ctx)

// 错误记录

if err := validateOrder(); err != nil {

span.RecordError(err)

span.SetStatus(codes.Error, "validation failed")

}

}4. 业务逻辑层(价值层)

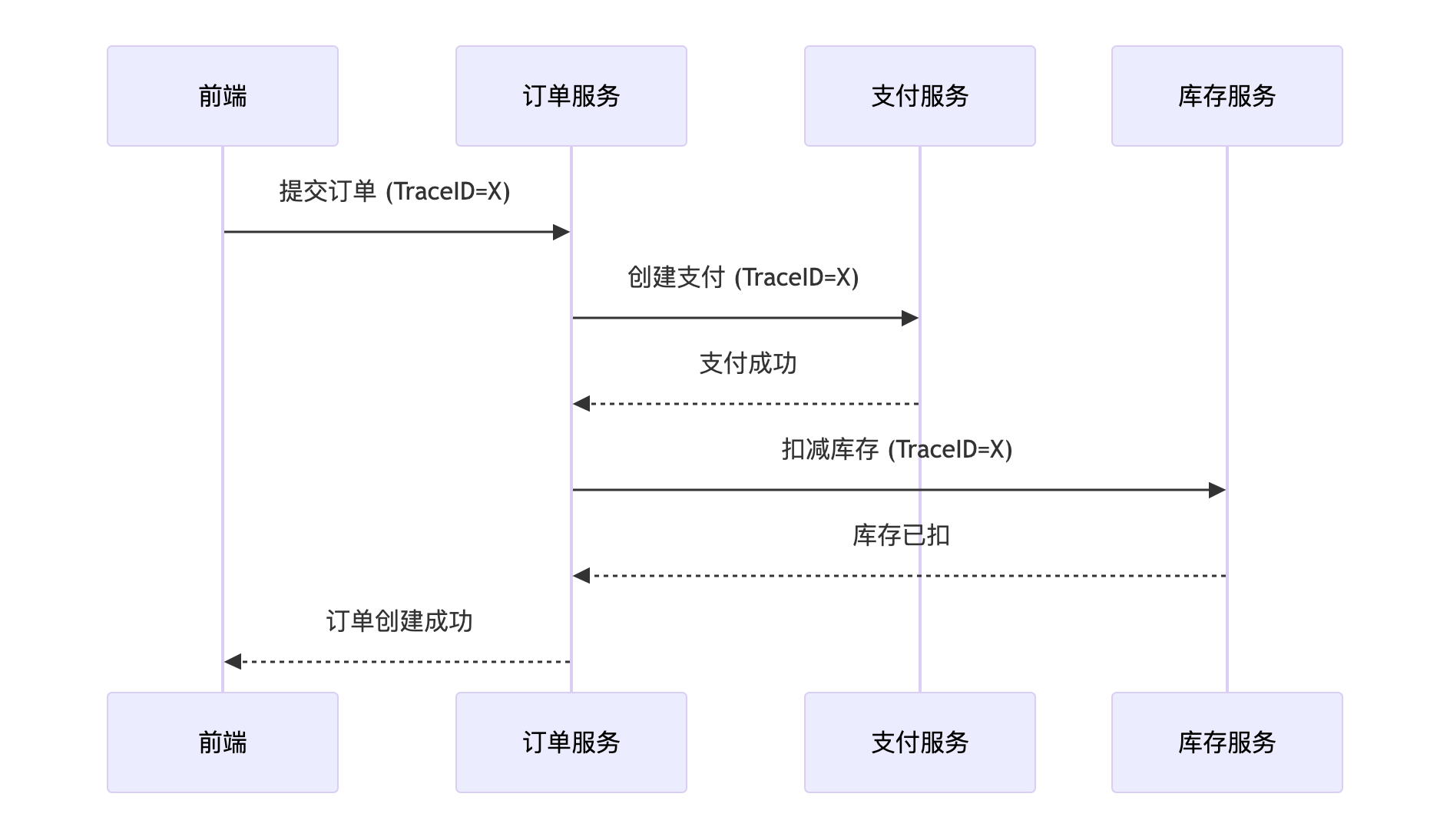

交易链路追踪实现:

业务SLO定义模板:

| 业务域 | 关键事务 | SLI公式 | SLO目标 |

|---------------|---------------|-----------------------------------|-----------|

| 电商交易 | 支付成功率 | success_count / total_count | ≥99.95% |

| 用户增长 | 注册转化率 | registered / visit_count | ≥8% |

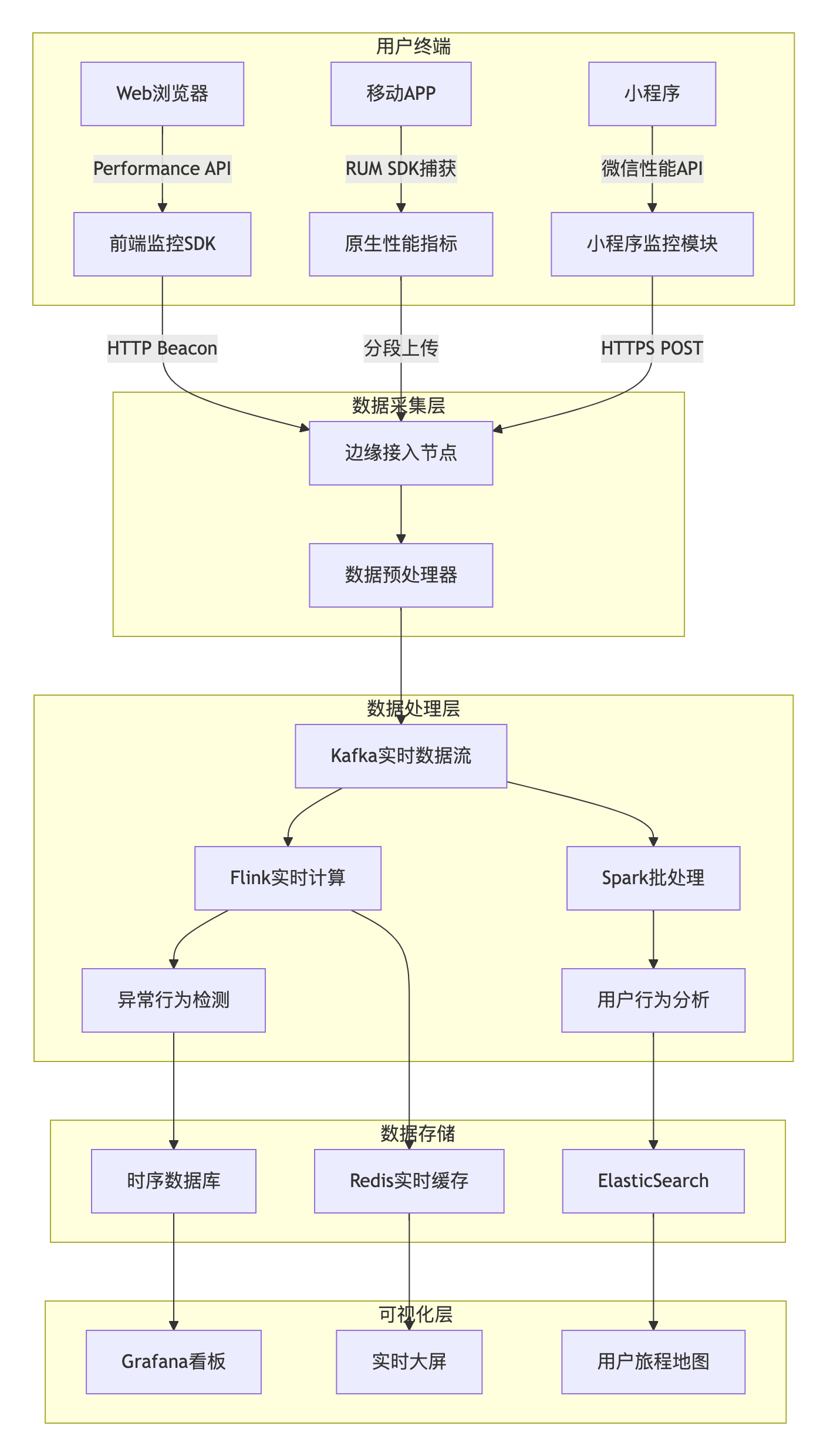

| 内容平台 | 视频加载延迟 | p95(video_load_time) < 1200ms | 达标率99% |5. 用户体验层(感知层)

数据采集

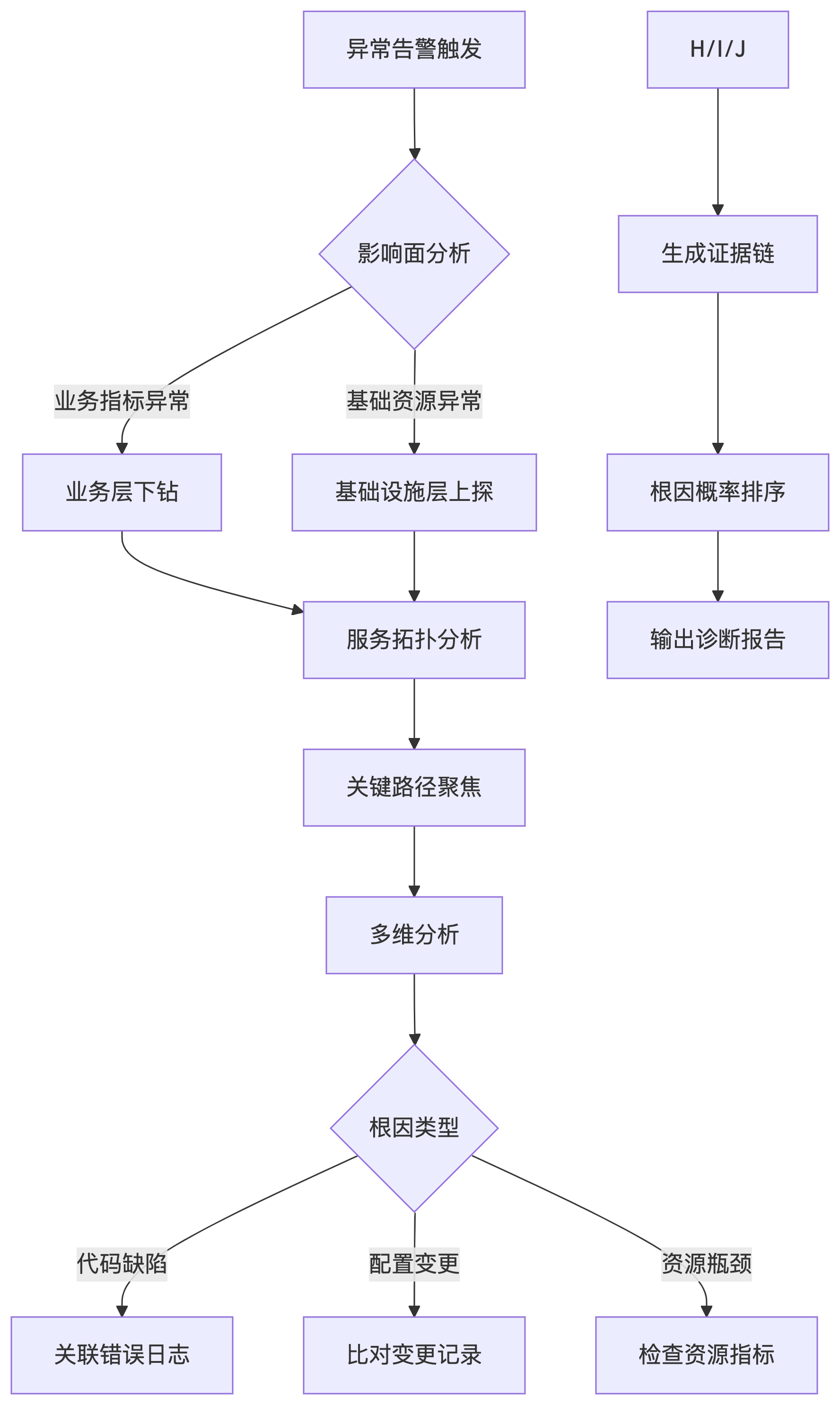

三、 智能根因定位框架

3.1 四大核心技术

a. 动态拓扑构建

-

- 自动生成服务依赖地图(示例图)

[Frontend] → [Order-Svc] → [Payment-Svc]

↓ ↓

[Inventory-Svc] → [MySQL]

↑

[Redis Cluster]b. 指标下钻分析

-

- 业务KPI → 服务SLA → 容器指标 → 主机指标 穿透分析

c. 故障传播追踪

-

- 基于Trace的故障扩散建模(示例)

t0: MySQL慢查询 ↑300%

t1: Inventory-Svc线程池耗尽

t2: Order-Svc调用超时率 ↑45%

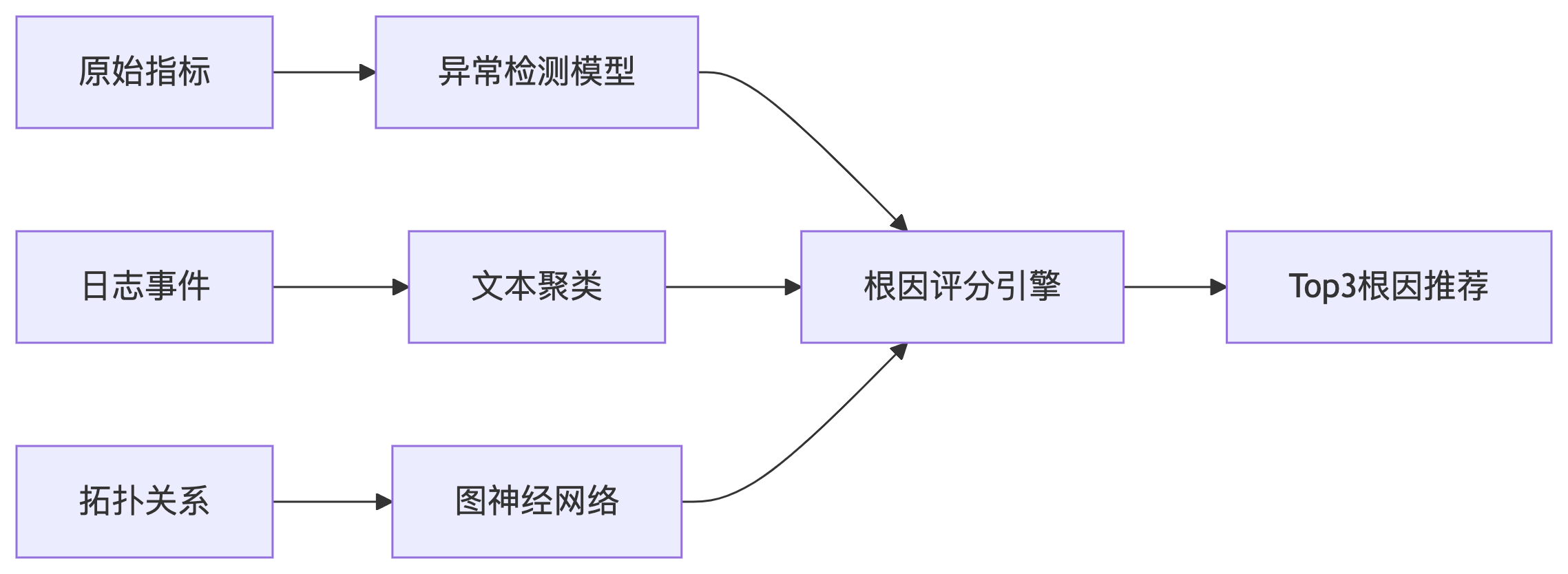

t3: 支付成功率 ↓至78%d. AI根因引擎

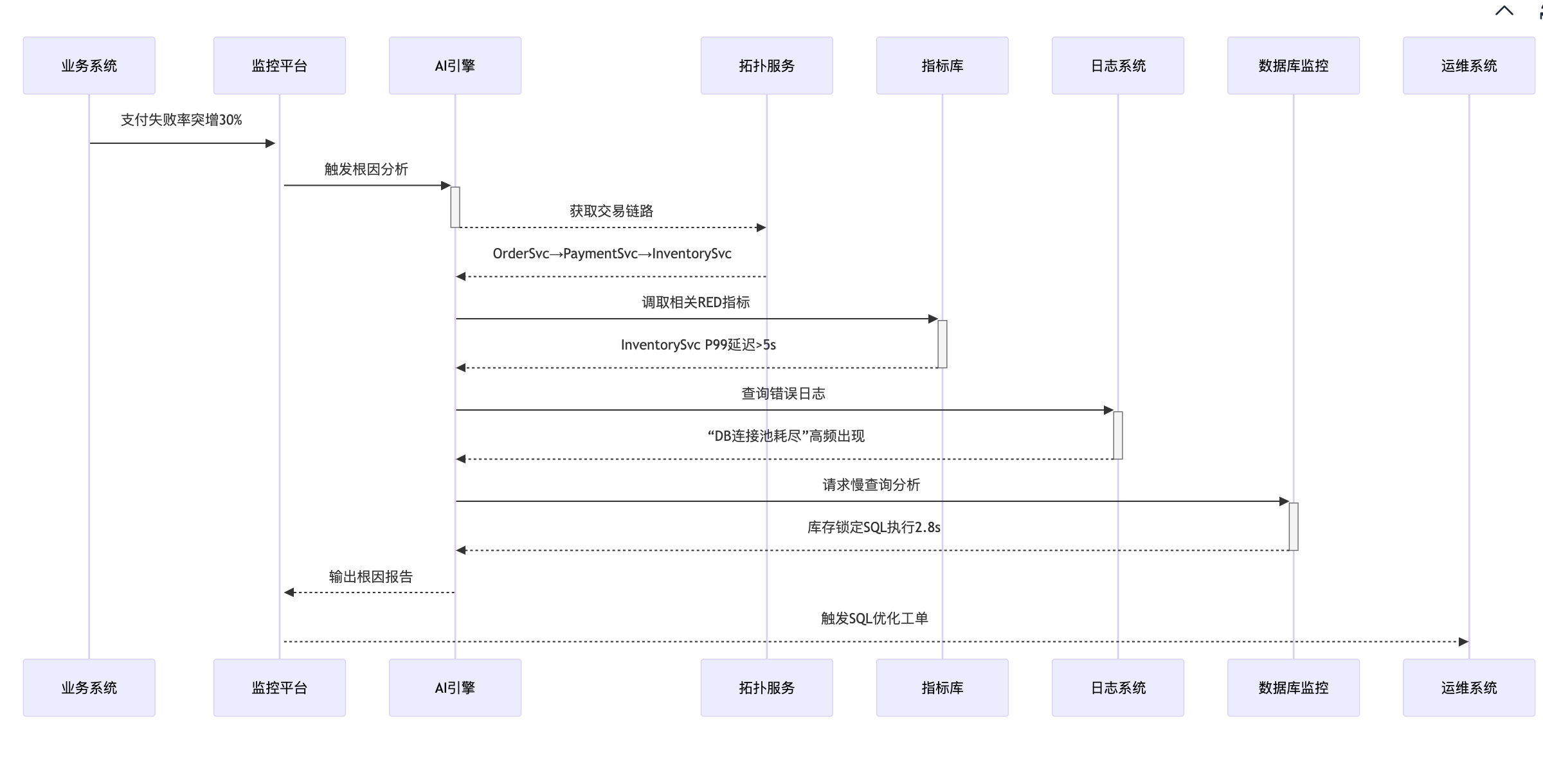

四、 电商故障诊断全流程(案例演示)

根因报告摘要:

根本原因: inventory_db 未优化SQL导致连接池耗尽

证据链:

1. 数据库慢查询突增(QPS: 1200→4500)

2. InventorySvc日志报错“Cannot acquire JDBC connection”

3. 线程池监控显示活跃线程持续100%

4. 变更记录显示近期新增促销活动

建议方案:

- 紧急: 增加连接池容量

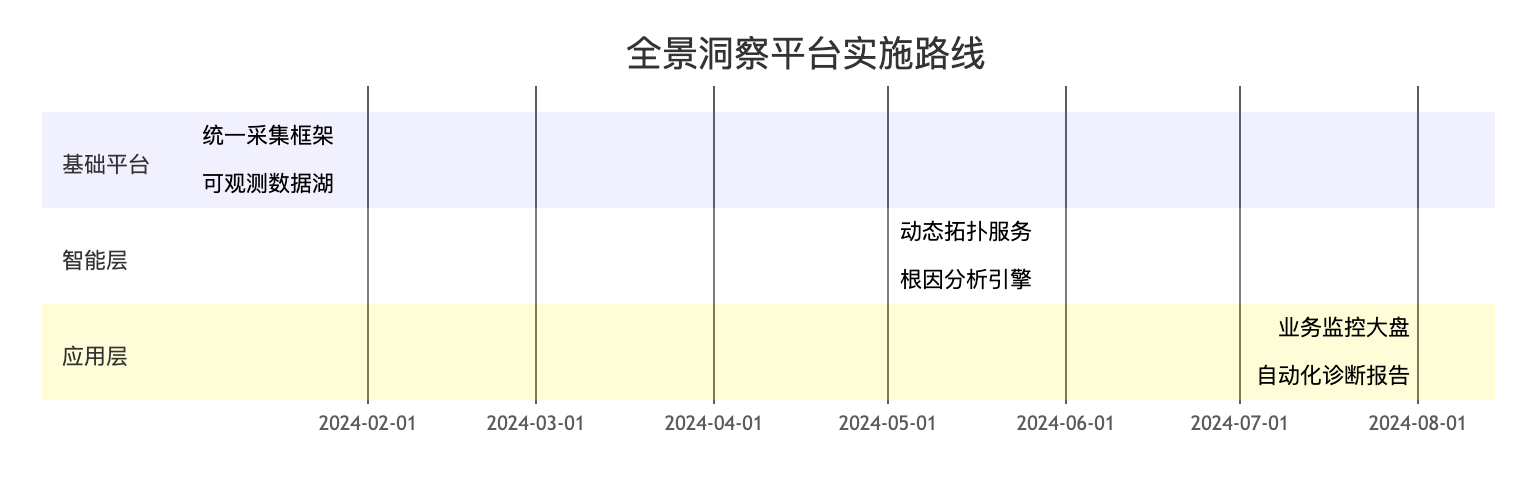

- 长期: 优化SQL索引(idx_activity_id)五、 关键实施路径

六、 总结:技术演进方向

1. 三层融合架构

┌───────────────┐

│ 决策层 │◀─AI预测性维护

├───────────────┤

│ 分析层 │─智能根因定位─┐

├───────────────┤ │

│ 执行层 │─自动修复─────┘

└───────────────┘2. 关键技术演进

-

- 实时拓扑发现 → 故障扩散预测

- 单次根因分析 → 故障模式挖掘

- 被动告警处置 → 主动风险拦截

构建分层监控体系与智能根因定位框架,绝非简单的工具堆砌,而是以业务价值为导向、数据为驱动、智能为核心的体系化工程。

- 分层是基础: 提供覆盖全栈的可观测性数据。

- 关联是关键: 打破数据孤岛,建立指标、日志、链路、拓扑的强关联。

- 智能是方向: 利用规则与算法,将专家经验沉淀为平台能力,显著降低 MTTR。

- 闭环是保障: 持续验证、优化、迭代,让系统越用越智能。

全景洞察能力的构建,将彻底改变“被动响应”的运维模式,迈向“主动预防、快速自愈”的运维智能化新时代,成为企业数字化转型和业务连续性的坚实后盾。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)