从经典论文看大模型的技术演进

过去十年间,人工智能领域的大模型取得了飞跃式的发展。从最初的词向量表示,到能够Few-Shot(少样本)学习的千亿参数模型,再到多模态、可调用工具的最新模型,每一阶段的技术创新都推动着AI能力的里程碑式提升。本文将以通俗易懂的方式,通过研究25篇经典论文,沿时间顺序梳理大模型技术演进的关键节点,总结每个阶段具有代表性的经典工作及其里程碑意义。在深度学习兴起之前,计算机对单词的表示通常是“独热编码”

过去十年间,人工智能领域的大模型取得了飞跃式的发展。从最初的词向量表示,到能够Few-Shot(少样本)学习的千亿参数模型,再到多模态、可调用工具的最新模型,每一阶段的技术创新都推动着AI能力的里程碑式提升。本文将以通俗易懂的方式,通过研究25篇经典论文,沿时间顺序梳理大模型技术演进的关键节点,总结每个阶段具有代表性的经典工作及其里程碑意义。

1. 词向量表示的革命(2013)

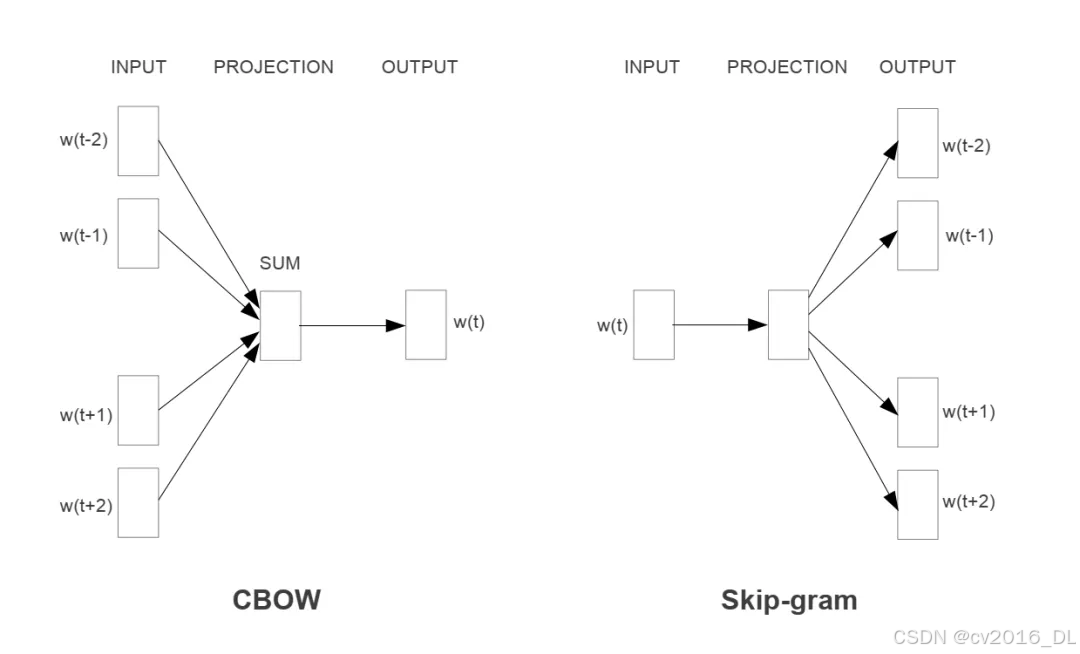

在深度学习兴起之前,计算机对单词的表示通常是“独热编码”(one-hot)形式,即用一个高维稀疏向量表示单词,无法体现词汇间的语义关系。2013年,Mikolov等人在论文“Efficient Estimation of Word Representations in Vector Space”[1] 提出了Word2Vec模型,通过CBOW(连续词袋模型,通过上下文词向量预测中心词)和Skip-gram(连续跳字模型,通过中心词向量预测上下文词)学习得到词向量表示。这个方法将每个词映射为一个低维稠密向量,使得语义相近的词在向量空间中距离也接近。例如,Word2Vec训练得到的向量可以方便地计算出“King - Man + Woman ≈ Queen”这样的类比关系。这项工作极大地提升了计算机对文本语义的理解能力,被视为NLP(Natural Language Processing,自然语言处理)领域的革命性突破。词向量表示的引入不仅提高了模型对词语语义和句法关系的捕捉能力,也为后续更复杂的序列建模奠定了基础。

图1:CBOW是通过上下文词向量预测中心词,Skip-gram是通过中心词向量预测上下文词[1]

2. 序列到序列学习的突破(2014)

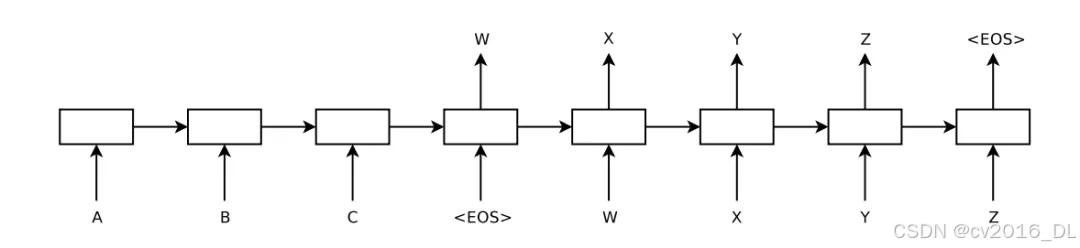

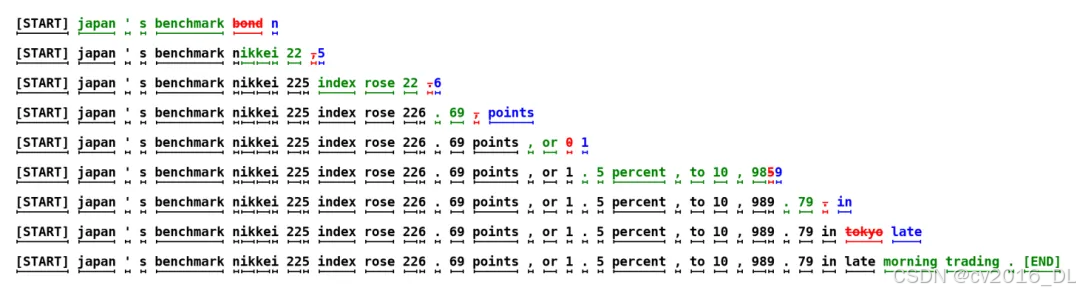

有了词向量,研究者开始探索如何让神经网络更好地处理和生成整句甚至整段文本。2014年,Sutskever等人在论文“Sequence to Sequence Learning with Neural Networks”[2] 中提出了序列到序列(Seq2Seq)学习框架,通过编码器-解码器结构实现了将一个序列转换为另一个序列。具体而言,他们使用多层长短期记忆网络(LSTM)作为编码器,将输入句子编码成一个固定长度的向量表示;再用另一套LSTM作为解码器,从该向量生成目标序列。这一端到端的序列转换方法几乎不需要人为设计特征,就在机器翻译等任务上取得了显著效果。在英法翻译实验中,Seq2Seq模型在WMT’14数据集上达到34.8的BLEU分数,超过了当时传统统计机器翻译系统的表现。更令人惊喜的是,该模型在处理长句子时也并未显著退化。Seq2Seq框架的提出标志着神经网络首次能够端到端地学习序列映射问题,为机器翻译、语音识别等应用带来了全新的范式,成为后来各种文本生成任务的基本模型架构。

图2:Seq2Seq使用LSTM作为编码器和解码器,上图中输入是“ABC”,输出是“WXYZ”[2]

3. 大规模分布式训练与模型压缩(2012–2015)

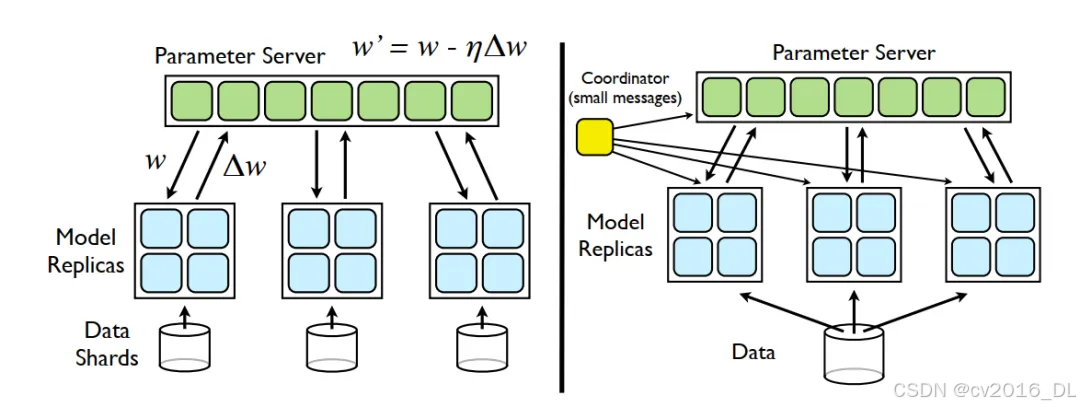

随着模型规模和数据规模的增长,如何利用分布式计算资源来训练更大的深度网络成为关键挑战。Google团队于2012年开发了名为DistBelief的分布式深度学习框架,并在论文“Large Scale Distributed Deep Networks”[3] 中详细介绍了相关技术。DistBelief采用参数服务器架构,可利用成千上万台机器共同训练一个模型。他们提出了Downpour SGD(异步随机梯度下降)和Sandblaster L-BFGS两种分布式优化算法来有效利用多机资源。借助该框架,Google团队成功训练出了当时规模最大(参数数量比以往模型大30倍)的深度神经网络,并在包含1600万张图像、2.1万类别的ImageNet任务上达到了当时的最佳水平。这表明,通过大规模分布式训练,可以显著提升模型性能,解锁更大的模型容量。此外,这套系统还大幅加速了模型训练,在商业级语音识别服务中也取得了显著效果。DistBelief和后续的开源框架(如TensorFlow、PyTorch的分布式模块)为之后训练数十亿甚至上千亿参数的模型提供了基础支撑,其里程碑意义在于证明了扩展规模(Scale)可以提升模型性能,为“大模型”时代的到来埋下了伏笔。

图3:左边是Downpour SGD,模型副本异步获取参数w,并将梯度∆w推送至参数服务器;右边是Sandblaster L - BFGS,单个“协调器”向模型副本和参数服务器发送small messages,以协调批量优化过程[3]

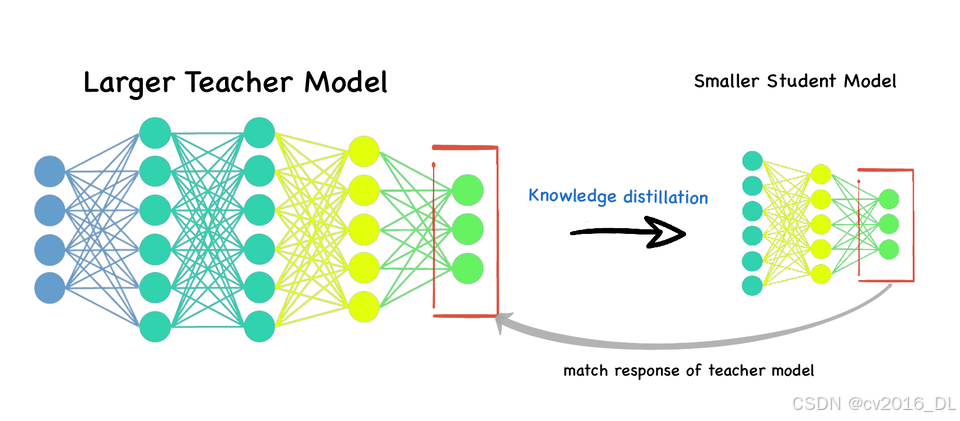

随着模型越做越大,一个现实问题是如何将庞大的模型应用到计算资源受限的场景。2015年,Hinton等人在论文“Distilling the Knowledge in a Neural Network”[4] 中提出了知识蒸馏(Knowledge Distillation)技术,为模型压缩提供了优雅的解决方案。其核心思想是:先训练一个性能很高但复杂庞大的“教师”模型,然后用它对训练样本的预测分布来“教”一个较小的“学生”模型(这里的“预测分布”指“软概率”,软概率是指教师模型对每个类别的预测概率分布,通常通过在softmax函数中引入温度参数T来获得。当T=1 时,softmax 输出为标准的概率分布;当T>1时,输出的概率分布更加平滑,非目标类别的概率值相对提高,从而揭示了类别之间的相似性和模型的不确定性)。学生模型通过拟合教师模型的软概率输出来学习,从而在参数量大幅减少的情况下接近教师模型的性能。知识蒸馏的效果令人惊讶——在Hinton等人的实验中,用这种方法训练出的轻量级模型在MNIST手写字识别等任务上几乎达到了原先大型模型的准确率。他们还将此技术应用于工业级的语音识别系统,通过将一个模型集成的知识压缩到单一模型中,在不牺牲准确率的前提下显著提升了部署效率。知识蒸馏的里程碑意义在于,它打通了“大模型”研究与实际应用之间的壁垒,让复杂模型的知识以更小的载体传播,为移动设备上的AI应用、高性能推理服务等铺平了道路。

图4:知识蒸馏的核心思想是——先训练一个复杂庞大的“教师”模型,然后用它对训练样本的预测分布(软概率,就是上图中红框框住的部分)来“教”一个较小的“学生”模型,“学生”模型要使得自己对训练样本的预测分布匹配“教师”模型对训练样本的预测分布

4. Transformer架构的革命(2017)

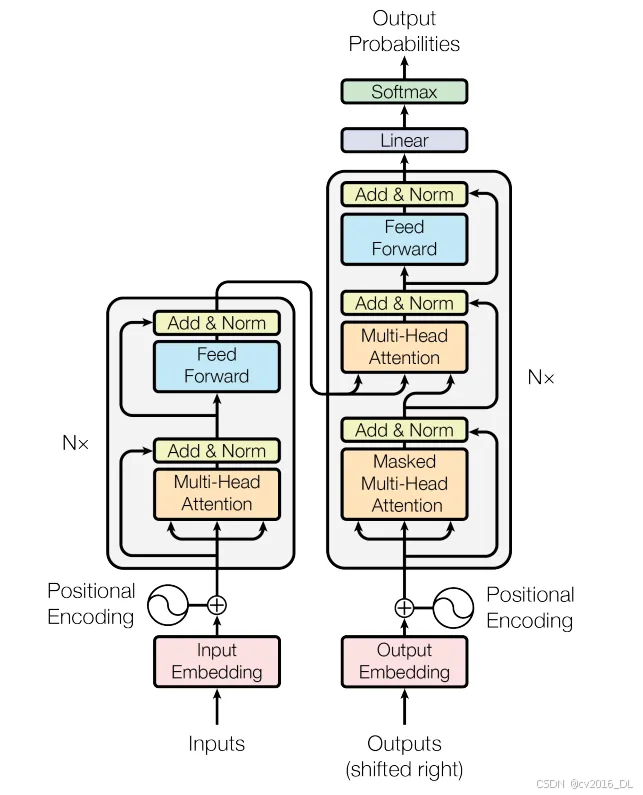

在Seq2Seq框架中,研究者很快发现对于长序列,单纯依赖编码器最后一个隐状态的固定向量瓶颈会限制模型能力,即Seq2Seq难以处理长句,随着输入句子长度增加,Seq2Seq的性能会迅速下降。2014年Bahdanau等人在论文“Neural Machine Translation by Jointly Learning to Align and Translate”[5] 引入了“注意力机制”,使解码器在生成每个词时都能动态查阅输入序列的不同部分。Bahdanau等人在上述论文[5] 中提出的“注意力机制”一开始叫“RNNsearch”,但“RNNsearch”不够直观,后由Yoshua Bengio建议改为“注意力机制(Attention)”,以更贴近其核心概念——模型自主选择关注输入序列的关键部分。2017年,Vaswani等人在论文“Attention Is All You Need”[6] 中干脆大胆提出:“仅用注意力机制即可”(Attention Is All You Need)。他们设计了全新的Transformer架构,完全摒弃了循环神经网络(RNN)和卷积网络,用自注意力机制在编码器和解码器中建模序列内部和序列之间的依赖关系。这种架构的一个巨大优势是并行度高——相比RNN按序列逐步处理,多头自注意力可以同时并行处理序列中的所有位置,这大大提高了训练速度和效率。在英德翻译等任务上,一个有2.13亿参数的Transformer模型在指标上超过了当时最好的RNN模型,而且训练只用了3.5天、8块GPU。Transformer不仅训练速度快、效果好,而且证明了序列建模不一定需要循环结构。这篇论文的影响极其深远——Transformer架构很快取代RNN,成为NLP领域的新标准,并启发了之后的各种改进模型。可以说,2017年的这场“注意力革命”直接催生了后来的大规模预训练模型浪潮,被誉为现代AI繁荣的基石之一。

图5:Transformer架构图[6]

图5:Transformer架构图[6]

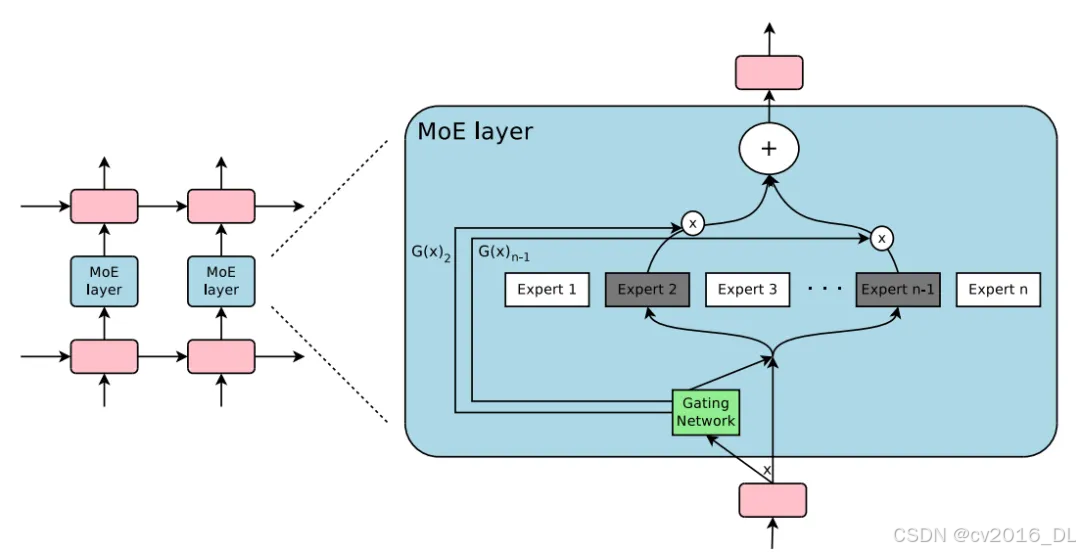

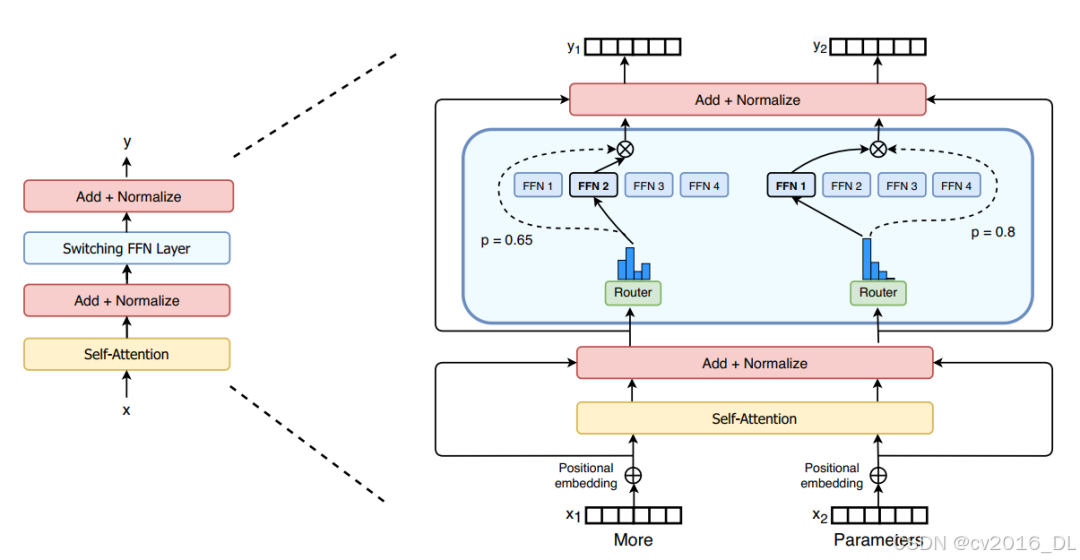

在Transformer论文发表的同一年,Google Brain团队的Shazeer等人在论文“Outrageously Large Neural Networks: The Sparsely-Gated Mixture-of-Experts Layer”[7] 中提出了另一种拓展模型容量的新思路:稀疏门控混合专家Mixture-of-Experts(MoE)。传统模型要提升容量通常需要增加层数或宽度,计算开销随之线性增长。而MoE架构引入了一组“专家”(子模型),通过一个门控网络为每个输入选择其中少数几个专家激活。这意味着即使有上千个专家(总参数量可达上千亿),每次推理实际上只用到其中一小部分,计算成本大幅降低。Shazeer等人在实验中训练了一系列最大规模至1370亿参数的MoE模型,在机器翻译等任务上取得了比同等计算资源下更优的效果。稀疏化的理念表明,增加参数总量不一定要按比例增加计算量,大模型可以通过“择优利用”部分参数来兼顾容量和效率。这项工作的里程碑意义在于提出了迈向“超大模型”的一条可行路径:利用稀疏激活机制,将模型规模提升一个数量级(甚至多个数量级)。后来的Switch Transformer等都是这一思想的延续。值得注意的是,如此庞大的模型训练和推理对计算基础设施提出了更高要求,促使AI硬件和框架不断演进。

图6:MoE用于循环神经网络(LSTM)的示意图,上图中MoE嵌入在堆叠的 LSTM层之间(即两个堆叠的LSTM层,中间有一个 MoE层)[7]

图6:MoE用于循环神经网络(LSTM)的示意图,上图中MoE嵌入在堆叠的 LSTM层之间(即两个堆叠的LSTM层,中间有一个 MoE层)[7] 图7:MoE用于Switch Transformer的示意图,这里MoE替换了Transformer架构中的前馈神经网络FFN

图7:MoE用于Switch Transformer的示意图,这里MoE替换了Transformer架构中的前馈神经网络FFN

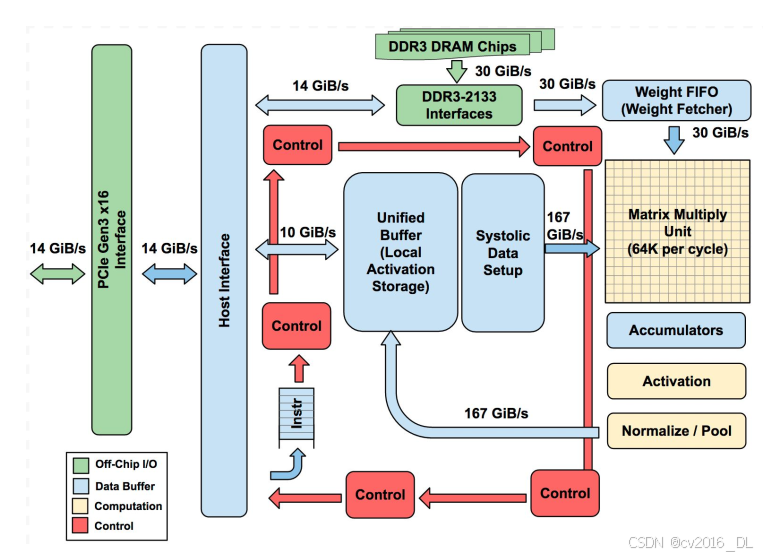

同年,Google在论文“In-Datacenter Performance Analysis of a Tensor Processing Unit”[8] 中发布了对其第一代张量处理器(TPU)的详细性能分析。TPU是一种专门为深度学习加速而设计的ASIC芯片,早在2015年就已部署用于提升Google翻译等服务的效率。这篇发表于2017年的论文披露:TPU 在实际数据中心工作负载的推理任务中,相比CPU具有15 - 30 倍的加速比,在每秒执行的运算量(TOPS)和每瓦性能(TOPS/Watt)上都大幅领先于当时的通用处理器。具体而言,TPU的推理吞吐率相比CPU提升15 - 30倍,且功耗更低(如TPU的TDP为75W,显著低于对比的Haswell CPU的145W),从而有力支撑起Google大规模神经网络模型在生产环境中的部署。TPU的成功展示了专用AI硬件对于大模型时代的重要价值:它大幅降低了运行深度神经网络的成本,并推动业界进入“算力即瓶颈”的新阶段。如果没有TPU等硬件的加持,像BERT、GPT-3这样规模的模型很难在合理时间内训练完成。2017年的TPU分析报告标志着AI基础设施的一个里程碑——从此,深度学习专用芯片成为科技巨头竞相研发的焦点,大模型的发展有了坚实的算力后盾。

图8:TPU的逻辑架构图,主要计算部分为右上角的黄色矩阵乘法单元,其输入为蓝色的权重先进先出缓冲区(Weight FIFO)和蓝色的统一缓冲区(UB),输出为蓝色的累加器(Acc);黄色的激活单元对累加器中的数据执行非线性函数处理,并将结果存入统一缓冲区;暗红色的是TPU的控制单元,与CPU或GPU相比,TPU的控制单元规模小得多(设计难度也低得多)[8]

5. 预训练范式与BERT的出现(2018)

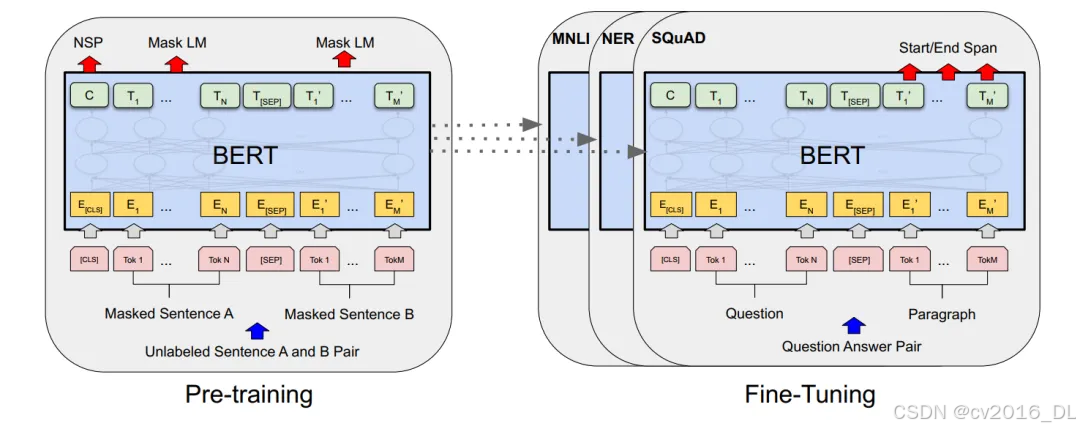

2018年前后,NLP领域迎来了预训练范式的兴起。其思路是:先在海量通用语料上训练一个语言模型(无需人工标注),再将其微调到下游具体任务。Devlin等人在2018年发布的BERT模型是这一范式的里程碑之作。Devlin等人在2019年的论文“BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding”[9] 中指出,BERT采用Transformer编码器架构,但与以往单向语言模型不同,它通过遮盖语言模型(Masked LM)实现对句子左右文同时建模,从而训练出深度的双向语言表示。具体来说,BERT在Wiki百科+图书语料上训练,随机遮盖掉句子中的一些词,让模型根据上下文预测这些被遮盖的词。此外还加入了下一句预测任务以促进模型理解句间关系。经过预训练的BERT模型只需在输出层添加一个简单双层感知机,就能针对诸如问答、情感分析等具体任务进行微调,并取得远超以往的性能。BERT问世后,在GLUE自然语言理解基准上将总分提高到了80.5(相对先前最好模型提升7.7点),在SQuAD阅读理解数据集上也刷新了当时的最佳成绩。BERT的影响是革命性的——它证明了预训练+微调可以在几乎所有NLP任务上取得巨大收益。一时间,各种基于BERT的模型如雨后春笋般涌现,NLP领域进入了“预训练模型时代”。BERT作为里程碑,意味着模型可以通过事先学习海量知识,再通过少量监督数据快速适应新任务,这一范式(基模+微调)后来被广泛使用,基本上已经成为如今大模型应用的标准做法。

图9:BERT的整体预训练和微调流程示意图:除输出层外,预训练和微调阶段采用相同的架构;不同下游任务的模型均通过相同的预训练模型参数进行初始化,且在微调过程中所有参数都会被优化调整 [9]

图9:BERT的整体预训练和微调流程示意图:除输出层外,预训练和微调阶段采用相同的架构;不同下游任务的模型均通过相同的预训练模型参数进行初始化,且在微调过程中所有参数都会被优化调整 [9]

6. 大规模模型的涌现能力与通用化(2020)

经过BERT时代的洗礼,AI模型的参数规模和训练数据持续增长。那么,模型变大变深到底能带来多大收益?OpenAI的Kaplan等人在2020年的论文“Scaling Laws for Neural Language Models”[10] 中系统地探索了语言模型的缩放定律(Scaling Laws)。他们通过大量实验发现,模型在非嵌入参数数量(N,排除词嵌入和位置嵌入参数)、训练数据量(D,以 token 计数)和优化后计算量(Cmin,衡量最小计算成本)三个方面与性能之间存在严格的幂律关系。简单来说,随着模型参数、数据量或计算量按指数级增加,模型的预测损失将按照固定幂指数规律下降。例如,在数据充足时,提升参数规模会让损失 呈现

![]() 的下降曲线;增大训练数据量

的下降曲线;增大训练数据量 或优化后计算量

则分别遵循

![]() 和

和 ![]() 的幂律趋势。更有意义的是,他们提出了在给定计算预算下的资源最优分配问题:过小的模型会导致数据利用不充分,而长时间训练小模型的计算效率远低于将资源用于增大模型规模。论文指出,当时许多模型实际上处于“计算分配低效”状态 —— 即本可以通过增大模型规模(而非延长训练时间或重复使用数据)来更高效地利用可用算力。具体而言,最优策略是将大部分计算预算用于增大模型参数(占比约73%),仅少量用于扩大批大小(24%)和训练步骤(3%),并在损失下降到距收敛约10%时提前停止训练,而非训练小模型至收敛。Scaling Laws工作的里程碑意义在于提供了定量化的资源分配指南,帮助研究者规划训练策略:在预算允许下,按亚线性比例匹配数据与模型规模(

的幂律趋势。更有意义的是,他们提出了在给定计算预算下的资源最优分配问题:过小的模型会导致数据利用不充分,而长时间训练小模型的计算效率远低于将资源用于增大模型规模。论文指出,当时许多模型实际上处于“计算分配低效”状态 —— 即本可以通过增大模型规模(而非延长训练时间或重复使用数据)来更高效地利用可用算力。具体而言,最优策略是将大部分计算预算用于增大模型参数(占比约73%),仅少量用于扩大批大小(24%)和训练步骤(3%),并在损失下降到距收敛约10%时提前停止训练,而非训练小模型至收敛。Scaling Laws工作的里程碑意义在于提供了定量化的资源分配指南,帮助研究者规划训练策略:在预算允许下,按亚线性比例匹配数据与模型规模(![]() ),优先扩大模型参数,更大的模型配合更多的训练数据将持续带来性能提升。这一结论为后来千亿级参数模型的诞生提供了理论支持——在观测范围内(超7个数量级),只要数据和算力按幂律关系协同增长,模型效果会随参数规模扩大而 “水涨船高”,且未出现性能饱和迹象。

),优先扩大模型参数,更大的模型配合更多的训练数据将持续带来性能提升。这一结论为后来千亿级参数模型的诞生提供了理论支持——在观测范围内(超7个数量级),只要数据和算力按幂律关系协同增长,模型效果会随参数规模扩大而 “水涨船高”,且未出现性能饱和迹象。

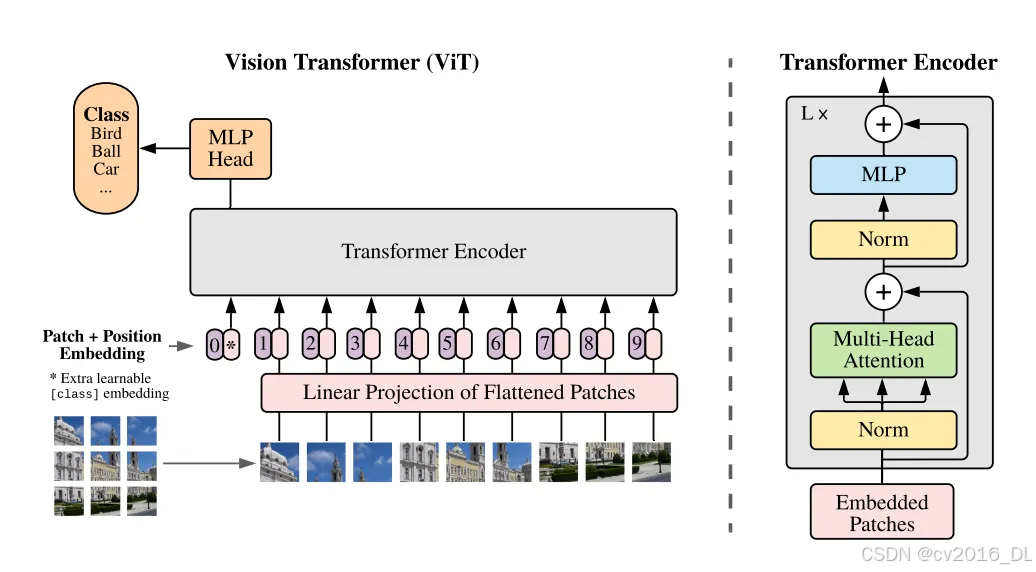

Transformer在NLP大放异彩的同时,计算机视觉领域仍由卷积神经网络(CNN)主导。那么,Transformer能否同样统一视觉任务?2020年,Google提出了Vision Transformer (ViT)模型,用纯Transformer结构在图像分类上取得了突破。Google在2020年的论文“An Image is Worth 16x16 Words: Transformers for Image Recognition at Scale”[11] 中指出,ViT首先将输入图像划分为固定大小(如16×16像素)的图块,每个图块展平并映射为一个向量,这些向量序列类似于文本中的“单词”嵌入。然后,ViT直接将这些图像块序列输入标准Transformer编码器进行处理。实验表明,如果在足够大量的图像数据上预训练,然后微调,ViT在多项图像识别基准上达到与最先进CNN不相上下的性能,同时所需计算资源更少。例如,预训练后的ViT在ImageNet、CIFAR-100等数据集上取得了优秀结果,训练所需计算量却低于同等精度的ResNet。ViT的成功证明了Transformer不仅适用于文本,同样可以成为通用视觉架构。这一里程碑工作预示着跨模态的模型架构统一成为可能:后续的Transformer变种被应用到图像、视频、语音等领域,甚至产生了融合多种模态的模型架构方向(如同时处理图像和文本的多模态Transformer)。ViT标志着“大模型”理念从NLP扩展到了CV领域,为多模态大型模型的诞生埋下了伏笔。

图10:ViT模型概述——将图像分割为固定尺寸的图像块,对每个图像块进行线性嵌入,添加位置嵌入,然后将得到的向量序列输入标准Transformer编码器;为了进行分类,ViT在序列中添加了一个额外可学习的“分类令牌”[11]

如果说BERT证明了预训练的威力,那么OpenAI的GPT-3进一步展示了扩大模型规模(参数量)所带来的惊人能力跃迁。GPT-3是一个具有1750亿参数的自回归语言模型,相比上一代GPT-2(最大15亿参数)提升了两个数量级。在2020年的论文“Language Models are Few-Shot Learners”[12] 中,Brown等人发现GPT-3这样一个超大模型在无需任务特定微调的情况下,能够通过Prompt(提示)实现极强的Few-Shot学习能力。具体而言,只需在模型输入中提供几条示例(例如几对英文句子及其法语翻译),GPT-3就能继续生成其它句子的正确翻译结果。在问答、摘要、逻辑推理等众多NLP任务上,GPT-3以少样本的形式达到了接近甚至超过以往有监督微调模型的水平。令人瞩目的是,这些测试中GPT-3没有更新任何参数——它完全依赖于Prompt提示引导模型内部已学到的知识。我认为这种现象就是后来被称为“涌现能力”的一种体现:当模型规模(参数量)足够大时,会出现一些小模型不具备的新能力。GPT-3的横空出世在业界产生巨大反响:它让人看到了训练一个通用的大型语言模型,然后通过自然语言指令完成各种任务的可能性。这一成果的里程碑意义在于证明了模型大小本身即是一种能力,通过纯粹的规模扩展,模型能够掌握广泛的知识和技能,成为通用语言智能的雏形。GPT-3也引发了后续对大模型潜在风险的关注,例如可能生成不真实或有偏见的内容,但不可否认的是,它将NLP推进到了一个靠Prompt编程的新范式,并直接催生了后续一系列更大更强的模型(如GPT-3.5、GPT-4等)。

7. 模型对齐与指令微调(2021–2023)

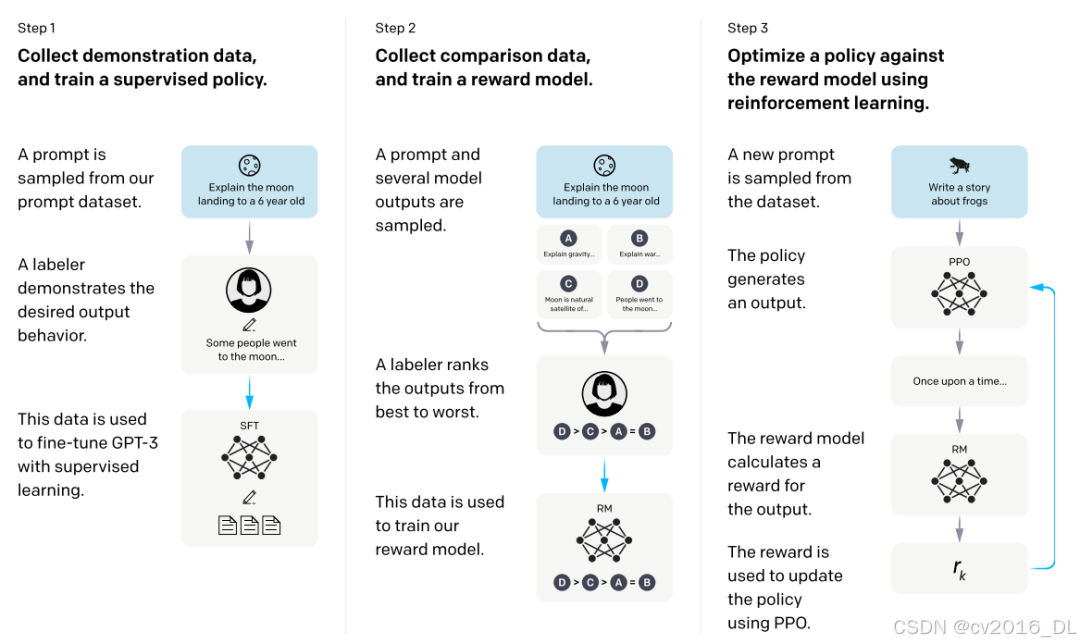

虽然GPT-3具备强大的Few-Shot能力,但并不总是按照用户意图行事:它可能输出不恰当内容,或对明确指令无动于衷。为解决大模型的对齐(Alignment)问题,OpenAI的Ouyang等人在2022年的论文“Training Language Models to Follow Instructions with Human Feedback”[13] 中提出了InstructGPT方法,通过人类反馈强化学习(RLHF)来微调GPT-3,使其更好地遵循指令。具体做法包括两个阶段:首先,收集人类标注者撰写的范例来进行有监督微调,让模型学习到理想输出的方式;接着,让模型生成多个响应并由人类进行偏好排序,根据这一偏好训练一个奖励模型,然后使用该奖励模型对GPT-3进行策略优化(基于强化学习,使用近端策略优化PPO)。经过这样微调的InstructGPT在各种用户提示下表现出了更符合人类期望的行为。在人工评估中,仅13亿参数的InstructGPT模型生成的回答质量竟然优于原始1750亿参数的GPT-3模型。同时,InstructGPT在事实准确性上有所提升,产生有害内容的倾向也明显下降。这一结果十分具有里程碑意义:它表明“更大不一定更好”,通过引入人类反馈信号,较小的模型也能胜过未对齐的大型模型。InstructGPT证明了让模型学会“听话”和“做好事”是可行的,也将RLHF这种技术推向业界标配。后来的GPT-4、Claude等模型无不在训练中融入了人类反馈来加强安全性和有用性。这一系列工作将大模型从“可用”提升到“好用”,使其真正成为人类的帮手而非危险玩具。

图11:InstructGPT方法的三个步骤:(1)监督微调(SFT),(2)奖励模型(RM)训练,以及(3)通过近端策略优化(PPO)在该奖励模型上进行强化学习 [13]

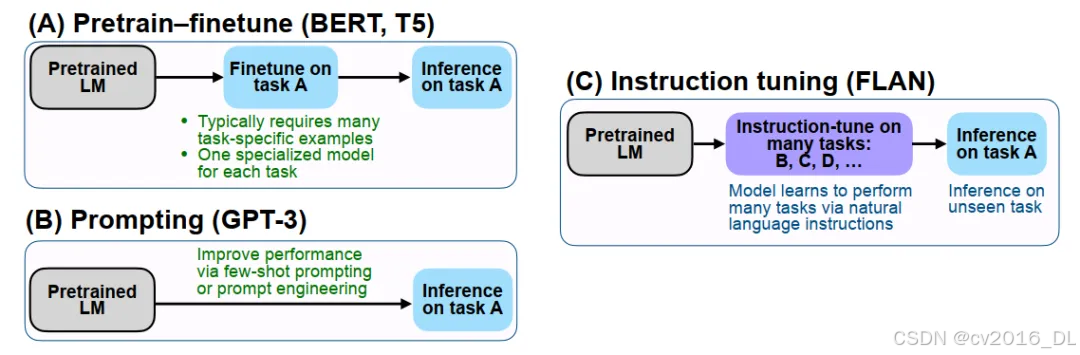

在RLHF之外,学术界也探索了指令微调(Instruction Tuning)的通用方法。Google Brain的Wei等人在2021年的论文“Finetuned Language Models Are Zero-Shot Learners”[14] 和2023年的论文“The Flan Collection: Designing Data and Methods for Effective Instruction Tuning”[15] 中指出,将预训练语言模型在多任务指令数据集上进行统一微调,可以让指令微调后的模型(该模型被称为FLAN,即Finetuned Language Net的缩写)在零样本设置下对未见过的新任务表现更出色。他们构建了大规模的指令数据集合(即Flan Collection),包含数百种NLP任务的指令及对应示例,通过这种多任务训练来让模型学会“听从指令”地输出答案。这种方法显著提高了T5等模型在未训练任务上的泛化性能,相比未经指令微调的模型提升幅度巨大。简单来说,指令微调使模型更擅长理解“人话”,哪怕是它没见过的问题类型,往往也能依据任务描述给出合理的回答。这项工作的意义在于:证明了通过多任务、多指令的统一指令微调,模型的通用实用性可以大幅增强。如今,主流大型语言模型训练流程往往都会包括一个指令微调阶段(例如OpenAI的“后训练”步骤),这实际上与FLAN的研究理念一脉相承。

图12:FLAN和BERT、GPT-3的区别,FLAN的核心思想是通过自然语言指令模板将多样化任务统一为“理解指令-执行任务”的通用框架;SFT是通用监督微调,数据形式不限;Instruction tuning是指令导向的SFT,强制使用“指令-响应”格式,目标是教会模型“理解并执行人类指令” [14]

8. 推理能力的挖掘:链式思维 (2022)

随着模型规模的提升,研究者开始关注如何发掘模型的推理潜能。Google Brain的Wei等人在2022年的论文“Chain-of-Thought Prompting Elicits Reasoning in Large Language Models”[16] 中提出,通过在提示中加入“思维链”示例,可以大幅提升大模型解决复杂推理题的能力。所谓思维链,即让模型在给出最终答案前,先生成一系列逐步的推理过程。例如,对于一道数学题,要求模型先写出解题步骤(列方程、计算中间结果等),最后再给答案。在Few-Shot提示时,人为提供几例这种“逐步推理”的示范,模型随即学会了这种格式,从而在新的问题上自行展开多步推理。这个策略在算术推理、常识推理、符号推理等多类任务上效果显著:使用Chain-of-Thought提示后,PaLM 540B、GPT-3等大模型在需要多步推理的题目上的准确率远远胜过以前直接让模型给出答案的表现。例如,在数学挑战数据集GSM8K上,GPT-3 175B模型在标准提示下准确率为15.6%,而通过思维链提示后准确率提升至46.9%。思维链提示的里程碑意义在于:揭示了大模型中蕴含的逐步推理能力是模型涌现能力的一种体现,这种能力需要通过适当的方式才能“召唤”出来。大模型本身并非不会推理,而是需要我们用好的方法去激活。此发现催生了后续一系列增强大模型推理能力的技术,如自我一致性(Self-Consistency)等,这进一步强化了大模型在复杂推理任务上的水平。可以说,Chain-of-Thought让通用大模型向“会思考”的方向又迈进了一步。

9. 开源基础模型与工具使用(2023)

一直以来,开源大模型的性能始终无法跟顶尖的闭源大模型相提并论。2023年,Meta AI发布了LLaMA模型,打破了这一局面。Meta AI在2023年的论文“LLaMA: Open and Efficient Foundation Language Models”[17] 中指出,LLaMA是一系列7B至65B参数不等的基础语言模型,在1.4万亿token的超大语料上训练而成;LLaMA-13B模型在多数基准上性能优于175B参数的GPT-3,而最大的LLaMA-65B则可与当时最先进的模型相媲美。这表明通过高质量的数据和高效的训练策略,中等规模的模型也能发挥巨大的威力。更重要的是,Meta将LLaMA模型权重提供给研究者社区开放使用(虽非完全开源但可申请获得),这立即掀起了开源大模型的热潮。基于LLaMA,各种衍生模型如雨后春笋般出现:斯坦福大学的Alpaca利用自举的指令数据对LLaMA进行了微调,实现了类似InstructGPT的指令跟随能力;社区开发者进一步扩展了LLaMA的对话能力、编程能力等。LLaMA的里程碑意义在于将原本封闭的大模型研究推向了开放,使得“人人可用大模型”成为可能。它证明了开源社区有能力复现和改进顶尖的AI模型,加速了创新迭代。可以预见,未来开源基础模型将在教育、科研、中小企业创新中将扮演愈发重要的角色。

尽管语言模型已经掌握了大量知识,但在算术计算、最新事实检索等方面,大模型有时不如专用工具精确。2023年,Meta在论文“Toolformer: Language Models Can Teach Themselves to Use Tools”[18] 中提出了Toolformer框架,展示了语言模型可以学习调用外部工具来提升自己。Toolformer的方法是:给模型提供一些可以调用的简单API接口(例如计算器、检索问答系统、搜索引擎等),以及每种工具的少量使用示例。模型通过在海量未标注文本中尝试插入API调用并观察返回结果,自我监督地学会了在合适的情况下调用恰当的工具(通过损失函数对比,仅保留能显著降低后续token预测损失的API调用结果)。最终得到的Toolformer模型能够在生成文本时自主决定何时调用哪个API,以及如何利用工具返回的信息来完善输出(在包含有效API调用的增强数据集上微调模型,使其学会自主决定工具使用)。实验显示,接入工具后,模型在数学计算、事实问答等任务上的零样本性能大幅提升,在一些任务上甚至接近于参数规模大许多的模型。更难能可贵的是,使用工具并未削弱模型原有的语言能力。Toolformer的出现具有开创意义——它表明未来的通用AI代理可以是“内置大脑+外接工具”的组合体:模型一方面拥有强大的内部知识和推理能力,另一方面懂得灵活地借助外部工具来弥补自身短板。这为进一步提升模型准确性、实时性提供了一条新思路,后续的许多研究开始探索让大模型与计算器、数据库、代码执行器甚至其他机器学习模型互动,以实现更强的综合AI系统。

10. 推理加速与新型硬件(2023)

大模型的强大往往以高昂的计算成本为代价——尤其在推理阶段,逐字生成长文本非常耗时。2023年Google在论文“Fast Inference from Transformers via Speculative Decoding”[19] 中提出了推测解码(Speculative Decoding)技术,成功将Transformer模型的推理速度提升数倍。其核心思路是在保持输出分布与原模型完全一致的前提下,用小模型加速大模型:首先由一个小型“草稿”模型自回归生成后续若干个词的候选,然后让大型模型并行验证这些候选的概率分布是否符合其自身分布。如果草稿模型的大部分预测被大模型接受,大模型可通过一次并行计算处理多个候选,从而减少对目标模型的串行调用次数,实现加速。实验证明,在确保输出分布与直接用大模型推理完全一致的情况下(部分确定性采样场景下生成文本也完全相同),Speculative Decoding可以带来 2–3倍的加速效果。这一方法的意义在于,它提供了一个不需修改模型结构即可提升推理吞吐的通用框架,兼容现有的任何自回归Transformer模型。随着大模型在实际应用中承担越来越复杂的生成任务,推理效率变得至关重要。Speculative Decoding的出现标志着在算法层面优化大模型推理迈出了重要一步。配合量化(如8比特、4比特量化)、裁剪等模型压缩技术,以及高并行的部署架构,现在业界已经能以较低延迟提供大模型驱动的AI服务。这使得如ChatGPT这般复杂的模型服务能够大规模地服务千家万户,真正实现了科研成果到产品应用的跨越。

图13:Speculative Decoding的示例——上图中每行代表Speculative Decoding算法的一次迭代:绿色token是小模型生成并被目标模型接受的预测;红色和蓝色token分别为被目标模型拒绝的预测及其修正结果。例如,第一行中目标模型仅运行一次就生成了5个token [19]

图13:Speculative Decoding的示例——上图中每行代表Speculative Decoding算法的一次迭代:绿色token是小模型生成并被目标模型接受的预测;红色和蓝色token分别为被目标模型拒绝的预测及其修正结果。例如,第一行中目标模型仅运行一次就生成了5个token [19]

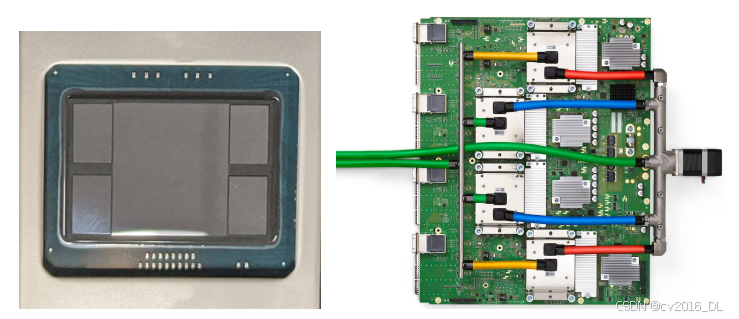

为了支撑大模型训练和推理的算力需求,硬件工程也在不断创新。Google在2023年的论文“TPU v4: An Optically Reconfigurable Supercomputer for Machine Learning with Hardware Support for Embeddings”[20] 中指出,其第五代Tensor Processing Unit(TPU v4,TPU v4 是Google第五代专用架构,前四代分别为TPU v1/v2/v3及未单独命名的初代)中引入了光学可重构互连技术,将4096颗TPU芯片组成的集群通过高速光纤交换矩阵灵活连接,打造出一个针对机器学习工作负载优化的“光子超级计算机”。TPU v4不仅在矩阵乘法等深度学习核心计算上进一步提速,还专门为超大规模模型中的嵌入查找等操作提供了硬件级支持,使得推荐系统这类需要处理海量嵌入表的模型训练效率大大提高。通过光学交换技术,TPU集群的网络拓扑可以根据任务需要实时调整,极大提升了多机分布式训练的通信效率。这意味着训练万亿参数规模的模型成为可能,而且硬件资源可以在不同任务间更有效地复用。TPU v4所代表的专用硬件进步具有里程碑意义:它展示了计算架构和通信架构协同设计在AI时代的重要性——不仅算术运算要快,数据移动也要快也要灵活。未来的超大模型(如需要数万个GPU/TPU协同训练的模型)将愈发依赖这类光互连、高带宽的创新硬件平台。可以说,每一次AI硬件的升级,都为大模型的下一个跨越奠定了基础;反过来,大模型的新需求也不断牵引着计算机体系结构的演进。

图14:TPU v4长这样——中央为ASIC芯片,外加4个高带宽内存HBM,搭载4个液冷package [20]

11. 最新前沿:GPT-4、Gemini、DeepSeek与未来展望(2023–至今)

从2023年开始,大模型领域的竞赛进一步升温,陆续出现了更加先进和多元化的模型:

GPT-4:2023年,OpenAI发布了GPT-4,使通用大语言模型的能力又上了一个台阶。OpenAI在2023年的论文“GPT-4 Technical Report”[21] 中指出,GPT-4是一个多模态模型,可以接受图像和文本输入,生成文本输出。在各种专业考试和学术基准上,GPT-4已经能达到人类顶尖10%水平,例如模拟律师资格考试中排名前10%。GPT-4在事实准确性和遵循指令方面也较前代有所改善,这部分归功于更完善的训练策略和对齐过程。作为目前最强大的通用对话模型之一,GPT-4展示了大模型在专业推理、编程、创造性写作等方面惊人的实用性。在GPT-4的启发下,业界开始探索更大上下文窗口(处理更长输入)、工具使用能力、多模态融合等新方向。

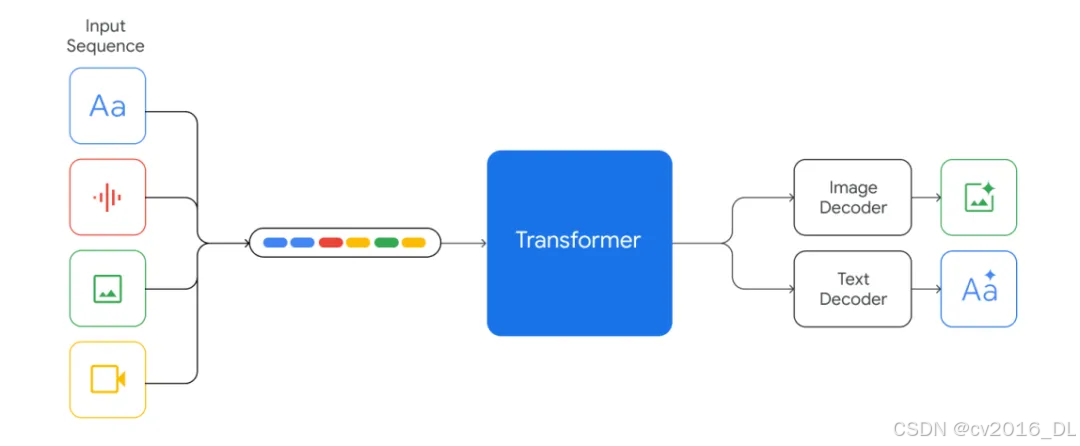

Gemini:2023年,Google发布了Gemini,Gemini是多模态大模型,支持图像、音频、视频和文本等多种模态理解。Gemini包括Ultra、Pro和Nano三个规模,分别面向复杂推理任务和资源受限设备等场景。Google在2023年的论文“Gemini: A Family of Highly Capable Multimodal Models”[22] 中指出,在广泛基准上,最大模型Gemini Ultra在32个测试中有30个刷新了现有最佳结果;尤其是在MMLU综合考试基准上率先达到人类专家水平,同时在全部20项多模态任务上全面超越此前最优模型。这体现了其出色的跨模态推理和语言理解能力,为通用AI应用奠定了新的里程碑。

图15:Gemini支持将文本、图像、音频和视频作为交错序列输入(上图输入序列中以不同颜色的标记表示),并能输出图像与文本交错的回应[22]

Gemini 1.5:2024年,Google发布了Gemini 1.5。Gemini1.5是Gemini家族的新一代多模态模型,强调超长上下文理解和计算效率。该版本引入了更新的Gemini 1.5 Pro和轻量化的Gemini 1.5 Flash模型,在保证质量的同时进一步提升推理效率。Google在2024年的论文“Gemini 1.5: Unlocking multimodal understanding across millions of tokens of context”[23] 中指出,Gemini 1.5能够从数百万Token的长上下文中精确检索细节并进行推理,在长文问答、长视频问答、长语音识别等任务上取得了新的SOTA性能,并可匹敌甚至超越上一代Gemini Ultra在各项基准上的成绩。其机制在上下文长度达到千万级Token时仍保持>99%的近乎完美检索率,大幅领先当前已知模型(如Claude 3.0的20万和GPT-4 Turbo的12.8万Token)。在实际应用中,Gemini 1.5可辅助专业人员完成复杂任务,实现26%至75%的时间节省,并展现出前所未见的新能力:例如仅通过一份语法手册就学会将英文翻译成仅有不到200名使用者的小语种Kalamang,达到相当于人类从同样资料中学习的水平。

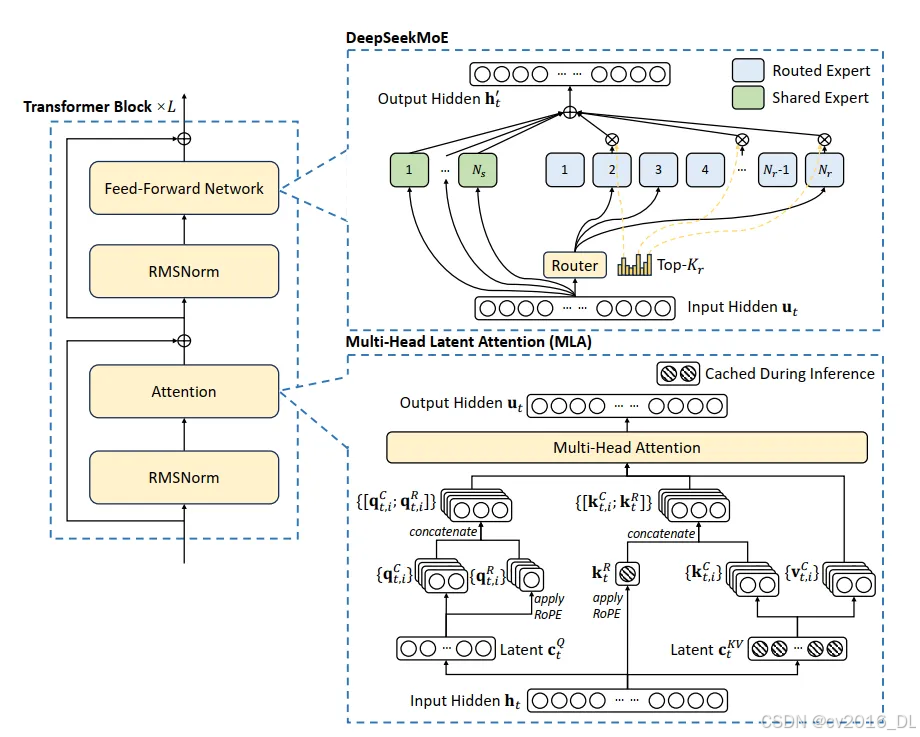

DeepSeek-V3:2024年,DeepSeek发布了DeepSeek-V3。DeepSeek-V3是DeepSeek推出的一款6710亿参数(每个Token仅激活约370亿)的开源大型MoE(Mixture-of-Experts)语言模型。DeepSeek在2024年的论文“DeepSeek-V3 Technical Report”[24] 中指出,为提升推理效率并降低训练成本,该模型采用多头潜在注意力(MLA)机制和DeepSeekMoE架构(已在V2中验证),并首创了无需辅助损失的专家负载均衡策略,同时引入多Token并行预测的训练目标以增强性能。DeepSeek-V3在14.8T高质量token上完成预训练,随后经过监督微调和强化学习阶段对齐人类偏好,全面发挥其能力。评测结果显示,其表现超越了其他开源模型,并接近当时最先进的封闭模型水平。尽管规模巨大,DeepSeek-V3的完整训练仅耗费约2.788M H800 GPU小时,且训练过程极为稳定,没有出现损失爆炸或回滚。这一成果证明通过创新架构和训练策略,开源模型也能以相对低成本的达到顶尖性能。

图16:DeepSeek-V3的架构图,从上图中可以看到,DeepSeek-V3采用 MLA(多头潜在注意力)和 DeepSeekMoE(DeepSeek混合专家)架构以实现高效推理和经济高效的训练 [24]

图16:DeepSeek-V3的架构图,从上图中可以看到,DeepSeek-V3采用 MLA(多头潜在注意力)和 DeepSeekMoE(DeepSeek混合专家)架构以实现高效推理和经济高效的训练 [24]

DeepSeek-R1:2025年,DeepSeek发布了DeepSeek-R1。DeepSeek在2025年的论文“DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning”[25] 中指出,DeepSeek-R1聚焦于提升大模型的推理能力。首先,DeepSeek团队训练了仅通过大规模强化学习(RL)且未经过监督微调(SFT)的预备模型DeepSeek-R1-Zero,它已展现出令人瞩目的推理行为。在纯RL奖励的引导下,DeepSeek-R1-Zero自然涌现出多种强大的推理技巧,但回答的可读性较差且存在语言混杂的问题。为解决这些缺陷并进一步加强推理表现,DeepSeek团队采用多阶段训练并加入“冷启动”预训练数据,在RL前融入适度的监督信号,推出了改进模型DeepSeek-R1。DeepSeek-R1在推理类任务上的表现已可媲美OpenAI当时最新的大模型o1。此外,DeepSeek团队开源了DeepSeek-R1的完整权重,以及基于DeepSeek-R1蒸馏出的六个密集模型(参数规模1.5B至70B,基于Qwen和Llama),供社区使用和研究。该工作表明,通过精心设计的RL奖励可以激发大模型潜在的推理步骤与能力,为增强AI系统的逻辑推理提供了新的范式。

可以观察到的趋势是——大模型技术依然在快速演进。模型规模或许还将继续增长,但更重要的是质量和效率的提升——包括更好的训练数据、更高效的模型架构、更先进的对齐手段,以及人机协作的新模式。此外,多模态融合趋势将使模型更全面地感知世界;模型作为平台调用插件和工具的能力也将赋予其执行各种复杂操作的能力。可以预见的是,下一个里程碑也许是出现拥有数万亿参数、经过良好训练和对齐的通用人工智能(AGI)雏形,其在各种领域表现出接近人类专家的水平,并能够可靠、安全地为人类所用。站在今天这个时点回望,大模型技术的每一步演进都为下一阶段的发展奠定了坚实基础。未来已至,我们正迈向一个由这些强大模型驱动的智能时代。

参考文献

1.Mikolov, Tomas, et al. "Efficient estimation of word representations in vector space." arXiv preprint arXiv:1301.3781 (2013).

2.Sutskever, Ilya, Oriol Vinyals, and Quoc V. Le. "Sequence to sequence learning with neural networks." Advances in neural information processing systems 27 (2014).

3.Dean, Jeffrey, et al. "Large scale distributed deep networks." Advances in neural information processing systems 25 (2012).

4.Hinton, Geoffrey, Oriol Vinyals, and Jeff Dean. "Distilling the knowledge in a neural network." arXiv preprint arXiv:1503.02531 (2015).

5.Bahdanau, Dzmitry, Kyunghyun Cho, and Yoshua Bengio. "Neural machine translation by jointly learning to align and translate." arXiv preprint arXiv:1409.0473 (2014).

6.Vaswani, Ashish, et al. "Attention is all you need." Advances in neural information processing systems 30 (2017).

7.Shazeer, Noam, et al. "Outrageously large neural networks: The sparsely-gated mixture-of-experts layer." arXiv preprint arXiv:1701.06538 (2017).

8.Jouppi, Norman P., et al. "In-datacenter performance analysis of a tensor processing unit." Proceedings of the 44th annual international symposium on computer architecture. 2017.

9.Devlin, Jacob, et al. "Bert: Pre-training of deep bidirectional transformers for language understanding." Proceedings of the 2019 conference of the North American chapter of the association for computational linguistics: human language technologies, volume 1 (long and short papers). 2019.

10.Kaplan, Jared, et al. "Scaling laws for neural language models." arXiv preprint arXiv:2001.08361 (2020).

11.Dosovitskiy, Alexey, et al. "An image is worth 16x16 words: Transformers for image recognition at scale." arXiv preprint arXiv:2010.11929 (2020).

12.Brown, Tom, et al. "Language models are few-shot learners." Advances in neural information processing systems 33 (2020): 1877-1901.

13.Ouyang, Long, et al. "Training language models to follow instructions with human feedback." Advances in neural information processing systems 35 (2022): 27730-27744.

14.Wei, Jason, et al. "Finetuned language models are zero-shot learners." arXiv preprint arXiv:2109.01652 (2021).

15.Longpre, Shayne, et al. "The flan collection: Designing data and methods for effective instruction tuning." International Conference on Machine Learning. PMLR, 2023.

16.Wei, Jason, et al. "Chain-of-thought prompting elicits reasoning in large language models." Advances in neural information processing systems 35 (2022): 24824-24837.

17.Touvron, Hugo, et al. "Llama: Open and efficient foundation language models." arXiv preprint arXiv:2302.13971 (2023).

18.Schick, Timo, et al. "Toolformer: Language models can teach themselves to use tools." Advances in Neural Information Processing Systems 36 (2023): 68539-68551.

19.Leviathan, Yaniv, Matan Kalman, and Yossi Matias. "Fast inference from transformers via speculative decoding." International Conference on Machine Learning. PMLR, 2023.

20.Jouppi, Norm, et al. "Tpu v4: An optically reconfigurable supercomputer for machine learning with hardware support for embeddings." Proceedings of the 50th annual international symposium on computer architecture. 2023.

21.Achiam, Josh, et al. "Gpt-4 technical report." arXiv preprint arXiv:2303.08774 (2023).

22.Team, Gemini, et al. "Gemini: a family of highly capable multimodal models." arXiv preprint arXiv:2312.11805 (2023).

23.Team, Gemini, et al. "Gemini 1.5: Unlocking multimodal understanding across millions of tokens of context." arXiv preprint arXiv:2403.05530 (2024).

24.Liu, Aixin, et al. "Deepseek-v3 technical report." arXiv preprint arXiv:2412.19437 (2024).

25.Guo, Daya, et al. "Deepseek-r1: Incentivizing reasoning capability in llms via reinforcement learning." arXiv preprint arXiv:2501.12948 (2025).

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)