国产算力调度与推理实践,智能产业趋势、异构算力整合及多场景落地案例解析

在人工智能与大模型技术蓬勃发展的当下,算力作为智能产业的核心驱动力,其调度效率与国产化进程成为行业关注的焦点。本文聚焦国产算力调度及推理领域的技术挑战与实践创新,深入剖析智能算力产业五大发展趋势,结合品高股份在政务、智能边缘、高端装备等场景的典型案例,揭示异构算力整合、算力精细化调度、算子优化等关键技术路径,展现国产算力从 “可用” 向 “好用” 突破的探索历程,为行业智能化转型提供可参考的思路与

在人工智能与大模型技术蓬勃发展的当下,算力作为智能产业的核心驱动力,其调度效率与国产化进程成为行业关注的焦点。本文聚焦国产算力调度及推理领域的技术挑战与实践创新,深入剖析智能算力产业五大发展趋势,结合品高股份在政务、智能边缘、高端装备等场景的典型案例,揭示异构算力整合、算力精细化调度、算子优化等关键技术路径,展现国产算力从 “可用” 向 “好用” 突破的探索历程,为行业智能化转型提供可参考的思路与经验。

01

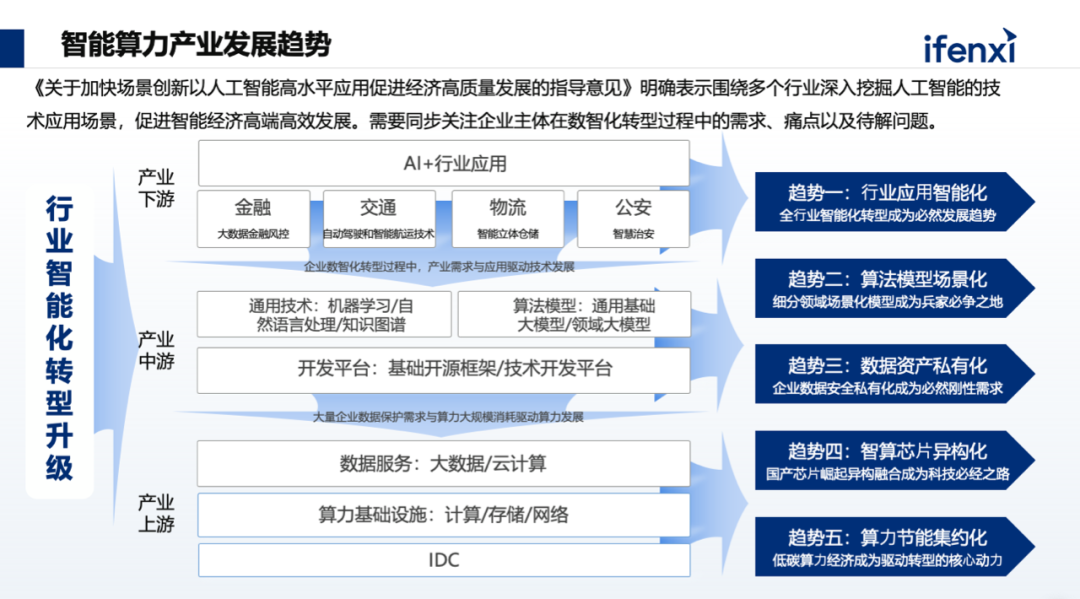

智能算力产业发展趋势

首先,大模型及AIGC技术的发展将推动全行业向智能化方向演进,这是不可逆转的科技趋势。其次,全行业智能化发展将催生丰富的大模型场景化需求,细分领域专用大模型将成为重要发展方向。此外,随着大模型技术的应用,数据资产价值变现能力显著提升,企业对数据资产私有化保护及变现能力的需求将成为刚需。

第四个趋势是基于当前中美关系我国芯片产业崛起的战略决心,国产芯片(尤其是异构国产芯片)的发展将成为科技领域的必然路径。从产业经济角度看,当前算力推理成本仍然较高,未来人工智能推理的计算成本,如Token价格及集约化成本将逐步降低。

在上述五大发展趋势下,企业在AI领域的核心投入方向聚焦于提升AI资产利用率,即通过高效赋能优质IT资源降低成本。第二个核心诉求是国产化率要求。部分客户提出需实现75%的国产算力占比,因此异构国产算力的统一纳管及能力整合成为亟待解决的问题。第三个诉求涉及数据资产的鲜活度与安全性:大模型需基于实时数据提供服务,数据资产需持续积累沉淀;同时,大模型安全已成为重要议题,提升数据安全性至关重要。综上,用户对人工智能或算力的核心诉求可归纳为两方面:

-

除了解决智能化推理问题,还要实现数据与IT信息资源管理;

-

人工智能对基础设施要求较高,需提供系统优化及系统集成经验的一站式解决方案,确保用户在最短时间内实现回报效率最大化。

02

DeepSeek应用案例

在人工智能领域的拓展中,品高近年积累了多个涉及深度学习及国产算力的案例,以下为典型项目介绍:

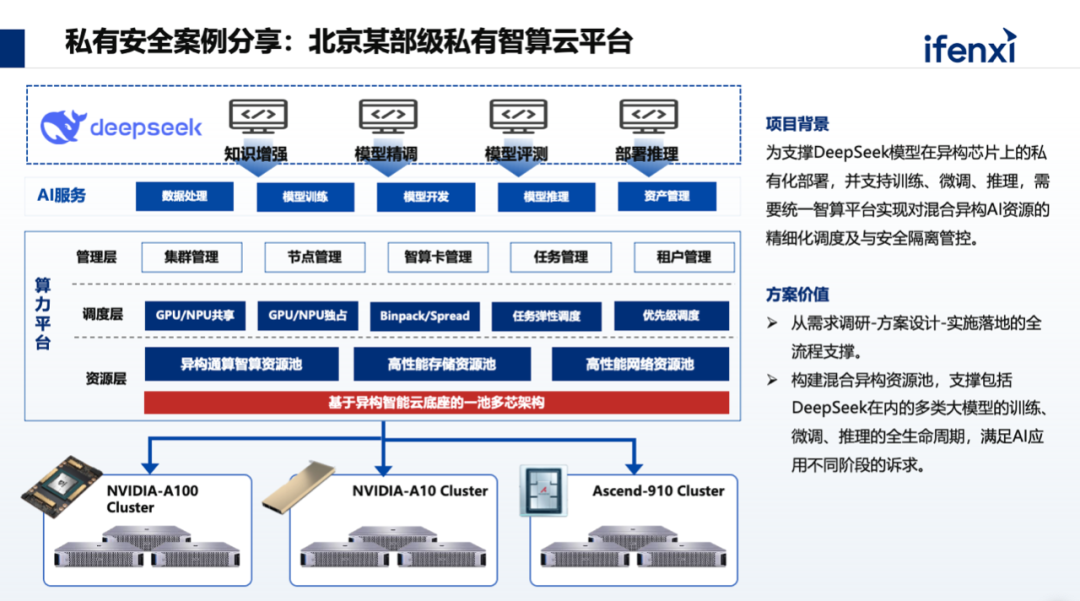

案例一:北京某部级单位私有智算平台项目

其核心特点是:

-

高安全性与保密性要求。数据严格限制在域内,禁止任何数据流出;

-

混合异构算力集群。在保留原有A10算力的基础上,新增A100算力,并采购华为910设备以满足国产化需求,形成混合异构资源池;

-

多团队安全隔离。用户单位内部不同团队因安全级别差异,需实现相互隔离。

-

算力使用呈现碎片化与临时性特征。例如,团队完成数据训练或推理精度预测后,需立即释放资源供下一个团队使用。

在此场景下,上层多元化应用与下层多元化算力对中间平台的整体兼容性及调度能力形成双重考验。由于项目需完成多类型测试及不同规格模式的运行,品高最终提供以下解决方案:

-

异构算力集群统一管理:实现异构算力在单一集群内协同运行,无需人工切换,支持网络与存储资源共享;

-

算力虚拟化池化:通过虚拟化切割形成算力资源池,细化资源交付颗粒度,扩展应用场景灵活性;

-

一站式模型微调开发服务:提供全流程模型微调工具包,用户无需关注底层异构架构复杂性,可快速开展业务。

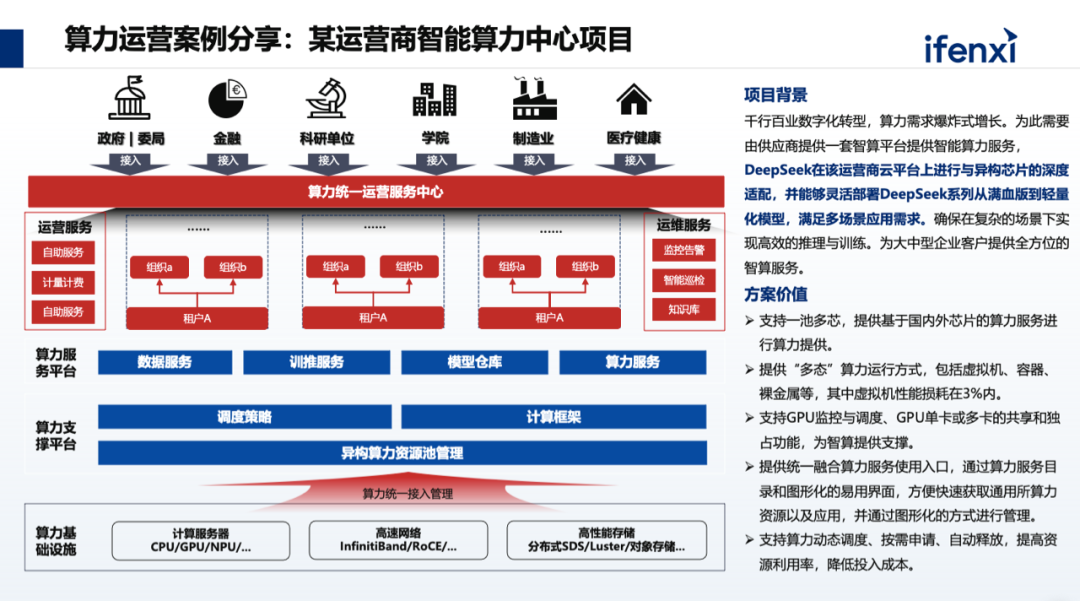

案例二:与某运营商合作的算力项目

该项目面向政府单位提供类公有云租赁式服务,其核心特点包括:

-

大规模混合算力集群:部署近500台H800机器,并集成利旧设备及国产算力;

-

高资源利用率需求:作为租赁服务模式,需通过最大化硬件资源利用率实现租赁差价收益。

在该盈利模式下,如何最大化GPU算力利用率并实现理想性能是团队需攻克的核心问题。解决方案包括:

-

构建一池多芯算力池:实现多种算力资源的统一管理与调度;

-

提供多形态算力服务:支持裸金属服务器、容器、虚拟机等多样化部署方式,满足数据库增强查询等非AI场景需求;

-

算力计量计费体系:建立算力计量标准与定价模式,集成至系统运营平台;

-

统一门户与申请流程:搭建标准化入口,实现算力资源的高效申请与管理。该算力平台目前已投入运营。

案例三:某车载VLM智能边缘云平台

另一个较新颖的案例是将DeepSeek部署于地铁列车内。如图所示,计算单元采用基于NVIDIA Jetson AGX的嵌入式板卡,可支持运行1.5B至3B参数的小型模型。

在列车场景中部署视觉模型的需求源于以下智能化应用:

-

车厢内乘客数量统计;

-

消防设备合规性检查,如是否放置于指定位置;

-

关键设备状态监测,如受电弓设备是否存在碰撞或火花。

传统方案采用多目标跟踪与图像识别技术,但因不同列车场景差异,需针对每列车重新进行数据调整和模型校正,导致实施周期延长,且难以覆盖训练场景外的未知问题。

过去采用YOLO模式,迁移学习能力较弱。而VLM最大的特点是具备极强的迁移学习能力,在单次训练过程中,能够对多种场景进行延伸扩展。这不仅大幅缩短了现场实施周期,还为模型优化提供了更明确的方向指引,具有重要意义。

案例四:某水利发电站场景下的高端装备智能化应用

水电站涡轮设备体积庞大,价值高昂,其内部因高速、高磁、高压环境无法部署传感器,需要在周边部署5000余个传感器采集数据以推测设备运行状态。

传统方案将数据传输至电站中央平台统一计算,存在着延迟高、数据存储压力大及实时计算能力不足等问题,易导致数据丢失和故障判断滞后。本次改进将计算能力下沉至涡轮周边,重点解决算力与大模型结合的数据推理及预测问题。基于历史标注数据对模型进行微调,同时运用数据拟合与融合技术,大模型在此过程中发挥辅助作用。该平台已在多个水电站装备上线,形成高端装备与人工智能结合的典型应用场景。

03

国产推理算力及关键技术

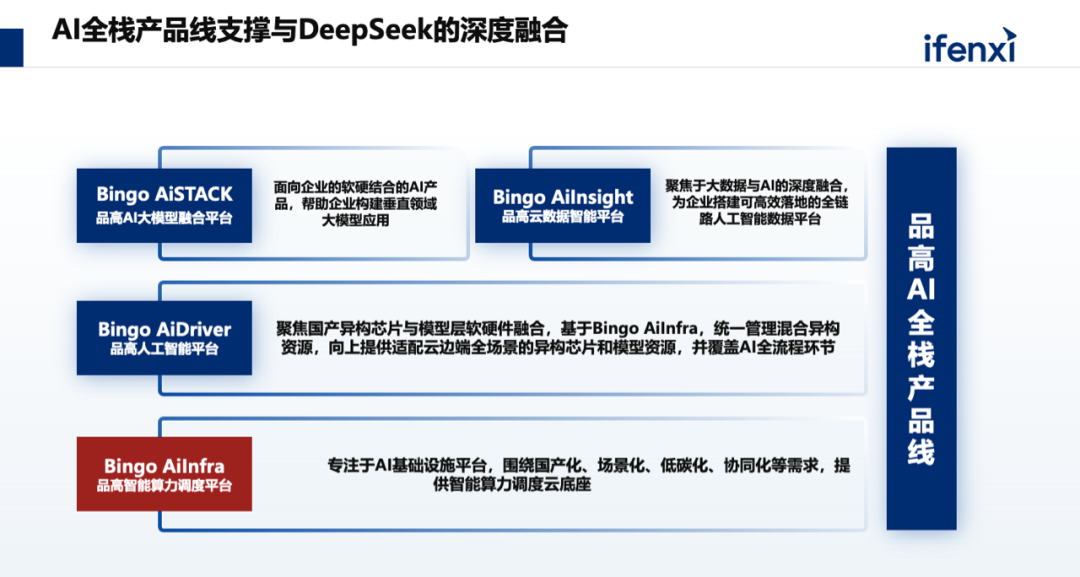

下图为品高全栈式产品体系,以智算调度平台为底层核心,向上构建统一异构芯片资源整合的驱动系统,再搭载推训一体机,形成层次清晰的技术架构,复杂技术细节集成于各模块内部。通过该体系架构图可直观呈现平台技术逻辑。

智算平台覆盖云边端全场景包括“云”、“边”、“端”:

-

“云”指大型数据中心云平台,即运营中心;

-

“边”为推理一体机,典型规模为三台服务器;

-

“端”为嵌入式推理终端,如小型盒子;

通过统一平台与架构,实现对云边端设施的资源调度与管理,为分布式云计算基础设施提供技术支撑。平台技术堆栈包含虚拟化与云原生组件,尽管AI应用多基于容器部署,但考虑到如Manus技术中大型模型需在虚拟机运行的场景需求,保留传统虚拟机组件以满足多样化技术需求。虚拟机可封装人工智能所需工具,相当于为AI提供独立计算环境,因此混合算力在人工智能发展中具有必要性。平台通过构建资源池,将算力资源抽象为API形式,实现如水电般灵活交付,满足用户对不同形态资源的快速获取需求。针对国产算力的复杂性问题,平台形成高效资源调度能力,最终为千行百业用户提供核心解决方案、咨询及运维服务,构成人工智能平台的基础架构体系。

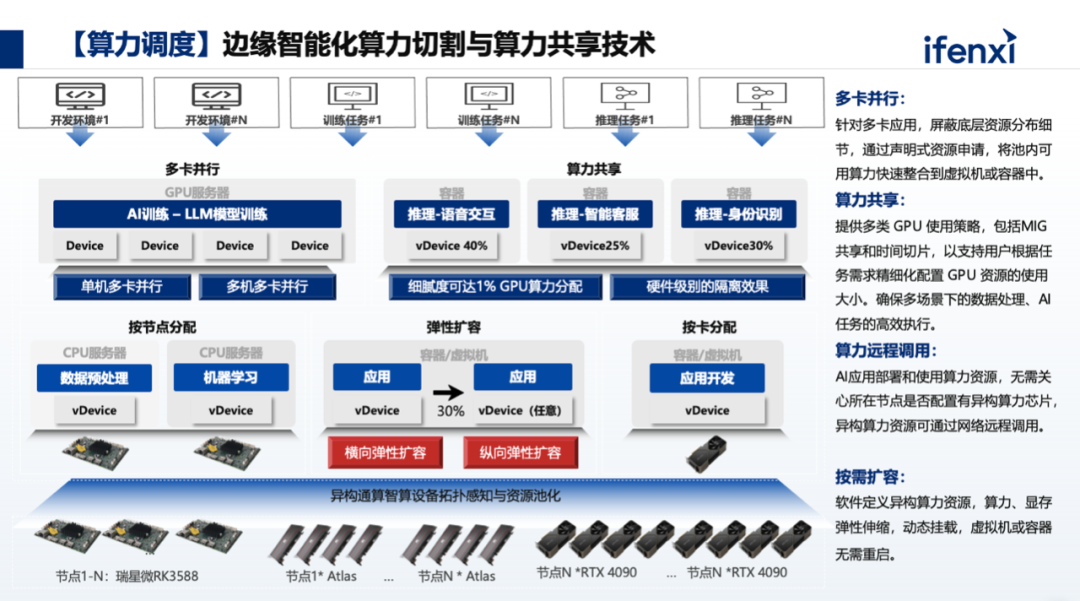

在探讨如何实现算力高效利用时,首要任务是对算力资源进行合理切割。业界常见多卡并行或多机并行的大规模集群部署模式,即一次性分配大量算力资源。但在实际行业应用中,企业往往缺乏充足算力资源,更倾向于集约化利用方式,如按计算节点或单卡进行资源分配。然而,此类分配方式仍非效率最优解。

近年来出现的小型模型存在算力占用不足的情况,且在执行Rag向量处理、OCR等轻量级任务时仅需少量零碎算力。为此,平台需实现细粒度算力分配,最小可支持1%的GPU算力及1MB显存颗粒度的资源调度。这种精细化分配模式如同以最小容器填充水池,可最大限度提升算力资源利用率。

弹性算力管理包括横向弹性与纵向弹性:横向弹性支持动态扩展计算节点数量;纵向弹性可实现算力资源的动态调整,最小可分配至1%的GPU算力,最大可扩展至100%,并在资源利用率较低时自动回收,形成灵活的算力分配机制。用户仅需设置调度策略,系统将通过智能调度最大化算力利用率,为企业创造显著经济效益。

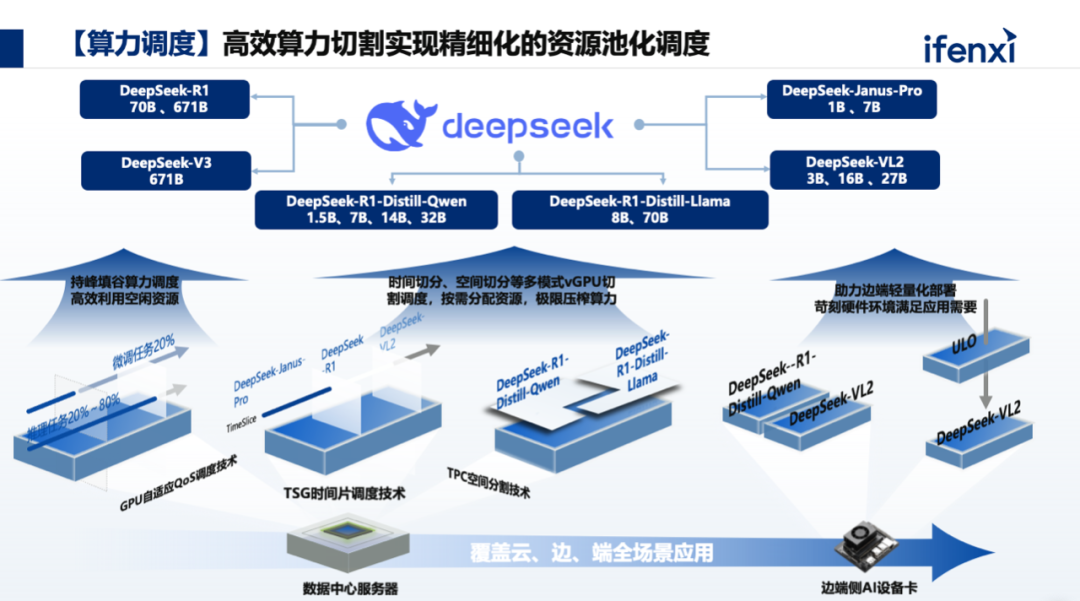

传统GPU虚拟化切割采用API调用限流方式,导致算力分配呈锯齿状波动,易引发运营服务违约风险。为解决此问题,品高在GPU驱动层实现深度优化:

-

TSG时间片分割:针对NVIDIA GPU的TSG控制器,将算力资源切割为最小精度的时间片单元,如100片中分配30片即对应30%算力,实现无飘动的精准分配。

-

TPC物理核心分割:针对AMD GPU的TPC架构,实现单TPC粒度的物理资源分割。

通过软硬件协同优化,突破传统虚拟化技术瓶颈,确保算力分配误差控制在极小范围内,满足企业级用户对资源确定性的严格要求。

当前国产算力在TPC级物理分割技术上存在瓶颈,品高与国内多数GPU厂商的合作主要聚焦于TSG分时切割模式。仅在投资的GPU企业中开展TPC级联合研发。通过上述算力分割技术,平台的弹性调度能力得以强化。

此外,该技术已延伸至边缘计算领域:边缘设备采用内存显存一体化架构,边缘逻辑与中心端存在差异,但在核心业务场景驱动下,算力分割技术已成功适配边缘终端。

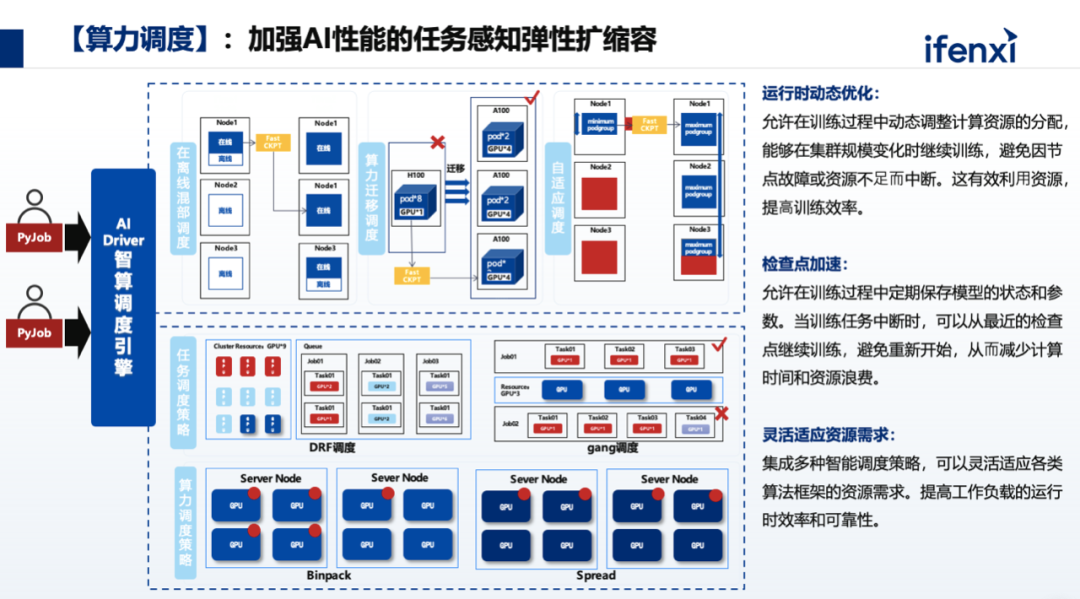

在实现零碎化算力资源调度后,任务调度成为复杂核心问题。任务调度需深度结合场景且研究成本较高,目前梳理出三种层级调度:

-

Binpack与Spreadpack策略:前者为满负荷利用算力资源的紧凑分配策略,后者为空闲资源利用的稀疏分配策略,属于基础层级调度逻辑。

-

第二层调度涉及大模型与业务系统的差异化处理:大模型采用并行调度逻辑,业务系统则遵循队列式调度。系统可自动识别任务类型并分配对应资源。

-

第三层为场景化调度,典型如在离线混合部署场景:企业在数据积累后需进行模型微调,但算力资源有限。通过内置Check Point能力,系统可在工作日优先保障推理业务,晚间切换至训练任务。在此过程中,需严格控制训练并行度,确保模型稳定性,从而实现资源的最大化利用。

第二个场景为算力迁移,在人工智能系统构建中,设备型号具有多样性且需定期更新,如模型需从H100迁移至A10。品高可协助用户完成模型业务在不同型号设备间的迁移适配。在不同架构及型号的算力设备间进行迁移时,目前暂不支持国产跨品牌算力迁移,仅可实现同品牌不同算力规格的迁移。

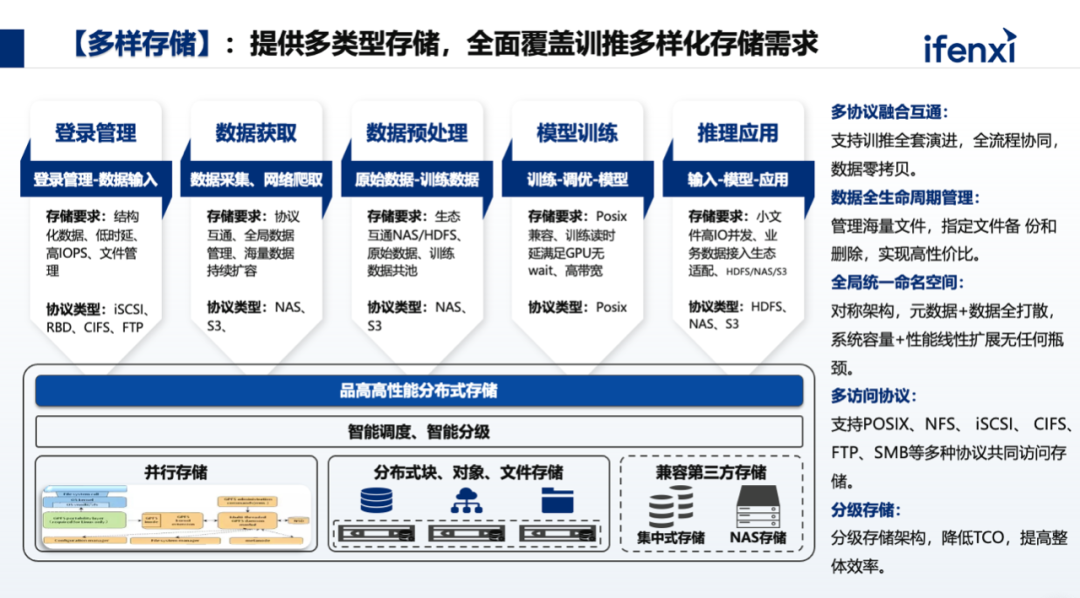

在大模型应用中,存储的多样性得到进一步发展:

-

数据类型差异化存储。管理流数据、采集数据、预处理数据、训练数据及推理数据对存储性能的需求各异。

-

存储介质分层部署中,低延迟场景采用传统数据库。大容量、低成本场景,如数据获取与存储采用NAS或S3协议存储。

在大模型处理流程中,不同阶段对存储类型的需求存在差异:

预测阶段:主要采用并行文件系统;训练阶段:较多使用Posix类型存储;推理阶段:存储需求更为多元,涉及HDFS数据存储、S3协议存储,以及向量数据的块存储。

在大模型应用中,需扩展底层存储能力的丰富性以适配多元需求。品高通过与生态供应商合作,在存储适配方面取得良好效果。针对企业初期存储设备投入有限的问题,平台利用推理服务器标配的高性能NVMe硬盘,构建本地化热点缓存系统:通过本地文件系统实现数据预加载至节点本地NVMe硬盘,可替代部分分布式存储需求,使整体成本降低30%-40%。

在小规模场景尤其是项目初期,该存储方案具有显著优势,也是当前推理一体机主推的部署模式。

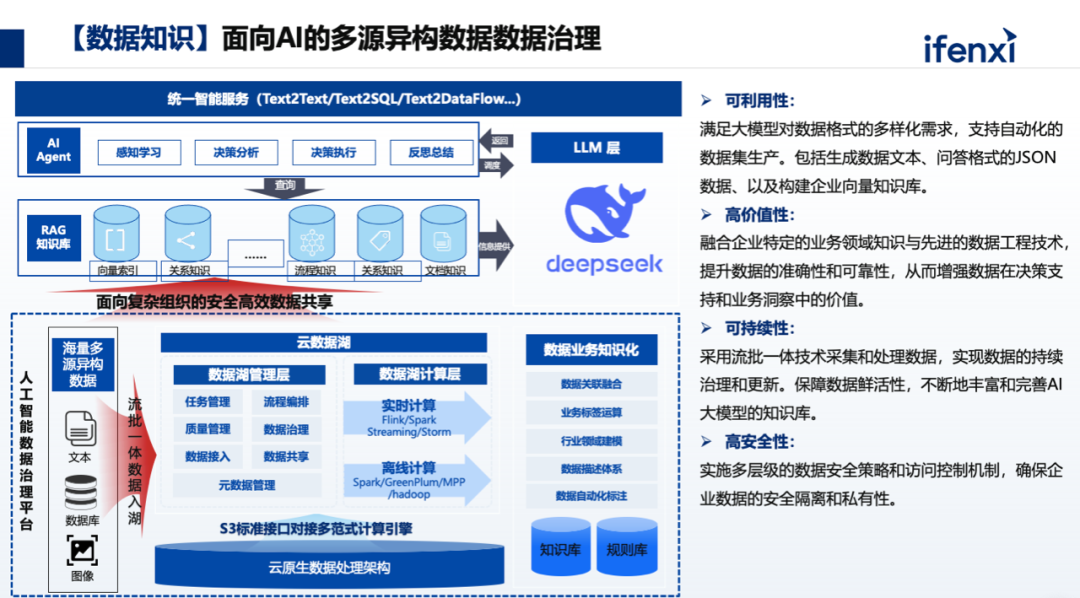

谈及数据存储,必然涉及数据应用逻辑:仅为企业部署通用大模型如DeepSeek缺乏实际价值,大模型需与企业自有知识体系深度融合才能创造价值。因此,企业对数据的核心诉求集中体现在以下四方面:

企业对数据的核心诉求集中体现在四个方面:

-

数据可利用性:现有大模型应用多解决非结构化数据(如PDF、图片)的利用问题,但企业大量存在的结构化数据需解决关联关系构建难题,避免数据仅以单体形式存在而难以发挥价值。

-

数据高价值性:数据治理需围绕用户最迫切的业务目标展开,实现高价值数据的定向治理与应用。

-

数据可持续性:建立长效机制确保数据持续产生价值,推动数据向知识沉淀的可持续转化。

-

数据高安全性:防范大模型对数据的潜在窃取风险,保障模型运行空间安全,并对高附加值数据集合实施有效保护。

品高提出的数据湖解决方案,通过自动化接入企业多元数据至对象存储,提供多范式存储服务,支持实时流式处理、离线处理等不同计算引擎按业务目标组合,实现数据关联融合、业务标签、行业建模、描述及自动化标注,形成知识库与规则库,为数据治理提供底层支撑。

基于数据治理构建的知识库与规则库,可支撑Agent、 Rag研发:通过模型实现精准知识召回,形成高效的知识检索能力,辅助企业理解数据、驱动决策并达成业务目标。在此基础上,可搭建工作流、MCP等业务组件,最终通过数据治理质量的提升优化用户业务体验。

此外品高提供训推一体服务,聚焦训练服务而非标准化产品。鉴于数据训练的综合性技术特性,平台以工具流为基础,结合专业知识与技能,协助用户完成特定业务目标的数据训练过程。尽管当前尚未形成行业标准,未来将随着技术发展及与用户的数据业务深度整合,推动训练流程的标准化建设。

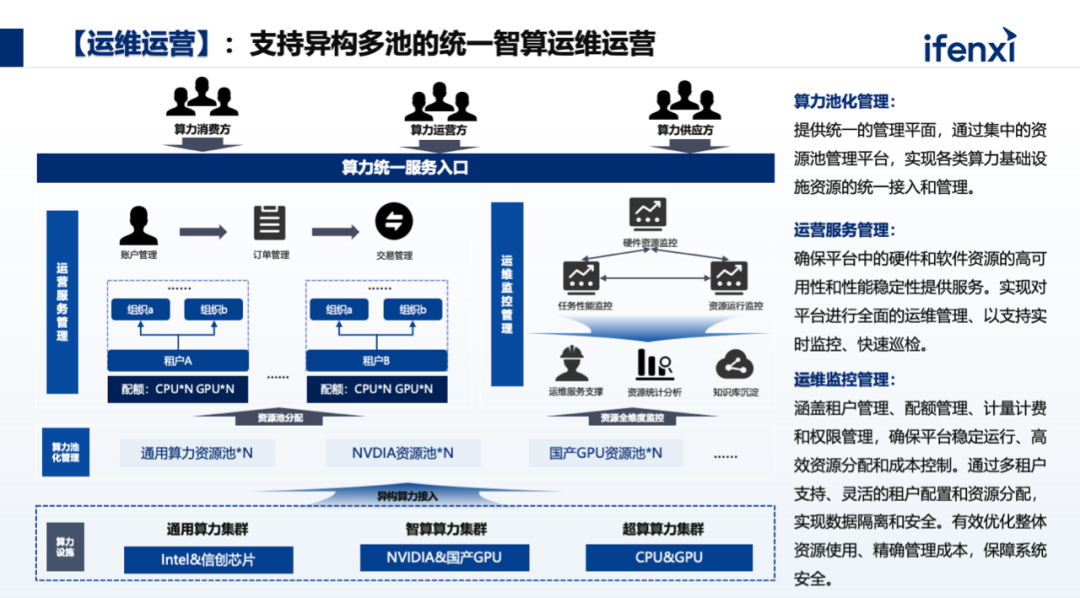

当前算力中心规模化后普遍呈现分布式部署特点,在此背景下,统一运维平台成为关键:其核心功能包括实时追踪算力资源分布状态,并将多节点监控数据整合至统一管理界面,助力用户结合业务需求实现算力资源的全局可视化管理。

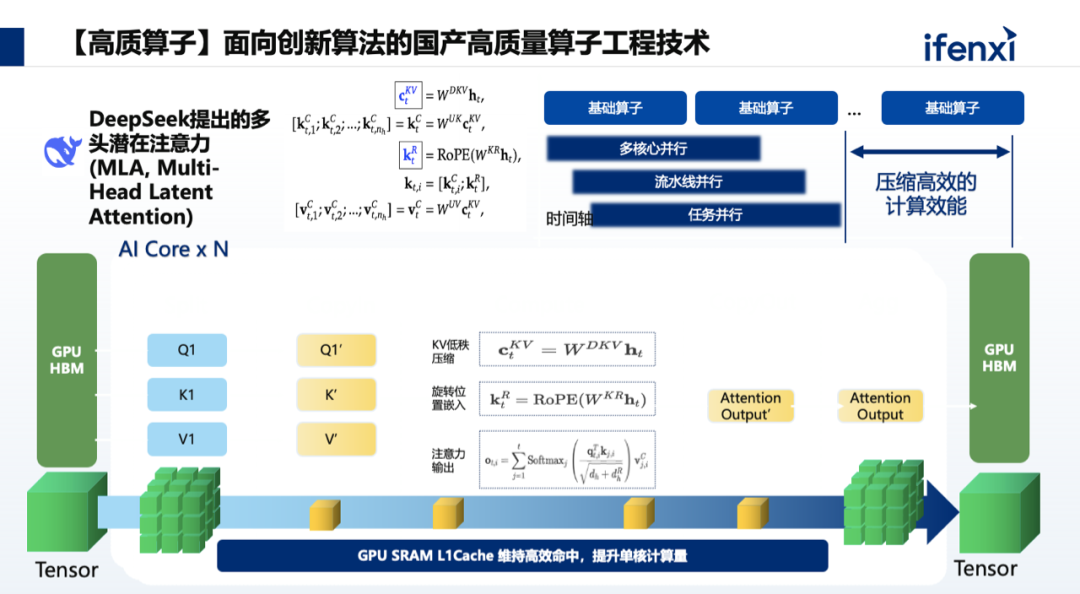

国产算力发展面临显著瓶颈,核心问题之一为算子优化。当前国产芯片的核心瓶颈集中在通讯性能,AI芯片显存与计算单元间的通讯带宽仅为英伟达产品的1/5-1/6;服务器内两GPU卡间通讯带宽约为英伟达产品的1/10;跨计算节点通讯带宽约为英伟达产品的1/3。

国产算力面临的另一关键瓶颈是算力密度问题。英伟达H100 GPU约含192个SM核心,而国产GPU核心数普遍仅8-30余个。尽管国产芯片单核计算能力较强,但核心数量显著少于国际主流产品。在此差距下,直接复用适配英伟达架构的算子将导致性能严重下降,无法满足实际应用需求。

针对国产算力特性,需对算子进行针对性优化。核心在于结合国产芯片单核计算能力强但核心数少的特点,通过技术手段突破算力瓶颈,发挥硬件优势。具体涉及几个关键技术点:

-

融合算子开发:基于国产芯片单核算力强的特性,在计算单元内开发融合算子,提升单次计算的算力密度。

-

Tensor形状切割与并行策略:针对不同形状的Tensor实施差异化切割,优化流水线并行、多核并行及任务并行策略,通过降低数据搬运带宽需求提升计算效率。

通过算子融合技术,逐步缩小国产算力与国际主流产品的计算效能差距,是当前重要目标。

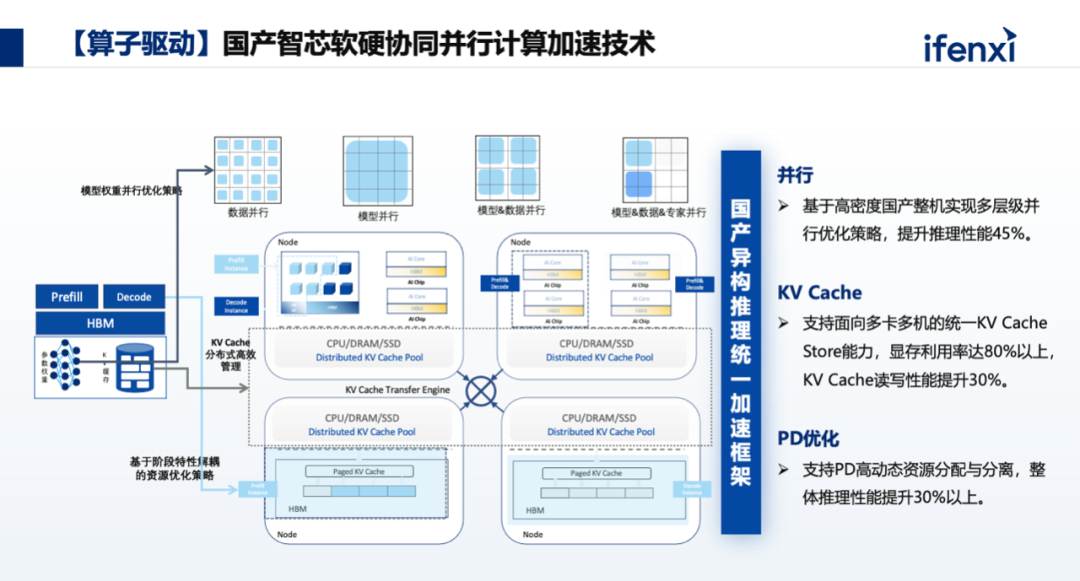

在并行计算领域,英伟达因芯片通讯能力强且设备规格高度统一,较少面临分布式并行挑战。而国产算力环境中,服务器与交换机品牌多样且适配程度不足,导致基础设施存在显著异构性。

以搭载八张GPU卡的服务器为例,其通过PCle Switch实现两两分组,组内四张卡的通讯效率较高,但跨组通讯效率显著下降。为此需制定针对性并行策略,确保模型优先在通讯高效区域运行。

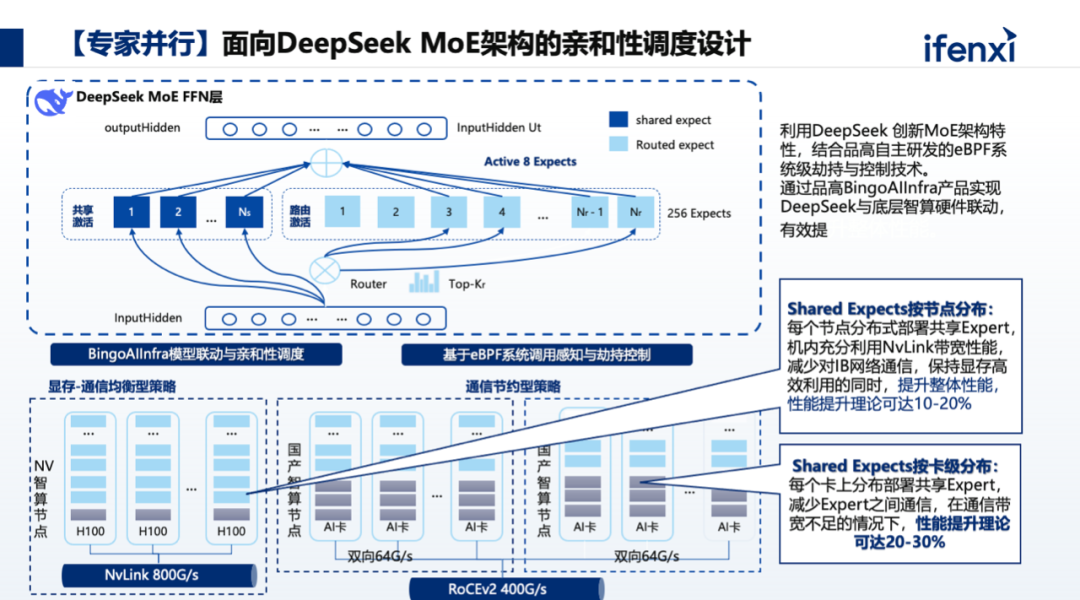

当前主流并行策略包括数据并行、TP(张量并行)、模型并行及MoE(混合专家模型)专家并行。以DeepSpeek框架的MoE专家并行优化为例,需重点关注国产KV Cache机制与显存资源特性——国产芯片显存容量已具备显著优势,可通过“以空间换时间”策略提升计算效率。

近期提出的PD分离模式可有效提升算力利用率,该模式此前主要应用于规模化场景,而国产算力集约化场景下的TT分流技术形态,是当前重点研究并已取得突破的技术方向。

以MoE架构为例(如前置反馈层由256个专家组成、每次激活8个专家的典型结构),激活的专家需通过All Gather操作完成数据汇聚:输入数据经预处理层分发给8个专家节点,计算结果通过聚合层完成汇总。这一过程对底层基础设施的通讯能力提出极高要求。

由于All Reduce操作对通讯带宽要求极高,需通过优化MoE架构的亲和性布局降低跨设备通讯需求:每次激活的8个专家中,若部分专家需固定激活,则将其均匀分布至各GPU卡,确保提前计算;同时使剩余可选专家尽可能集中在单卡上,从而将All Reduce/All Gather操作限定在单卡内完成,避免跨卡或跨节点的高延迟通讯。能够通过两项关键优 化:

-

节点级专家分布,实现10%-20%的推理性能提升;

-

单卡级专家分布,理论性能提升可达20%-30%,且通讯能力越弱的硬件环境中,性能提升越显著。

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献277条内容

已为社区贡献277条内容

所有评论(0)