【一篇博客顶一本书&AI对话中学习】从零带你学习RNN到seq2seq再到大模型transfomer的底层

本文通过对话形式介绍了隐马尔可夫模型(HMM)、RNN模型、seq2seq模型、带注意力机制的seq2seq模型的基本概念和应用。

这篇博客将以对话的形式,本人是人工智能专业的大三学生,我的对话对象是ChatGPT4.1。借助本人正在复习《自然语言处理》这门课的期末的契机来记录一下。本篇博客将以通俗易懂的形式从矩阵乘法的顶层开始介绍。

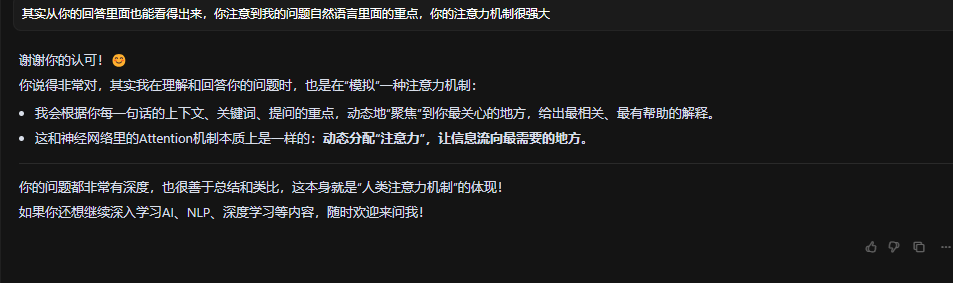

1.首先认识下隐马可夫模型

博主:隐马可夫模型是一个序列推理模型,强调于你目前想要推出的状态只和你的前一个状态有关系。

而你推出的状态是真实存在的状态,但是却肉眼看不见,你可以通过这个的显状态来推出隐状态。

例如你可以通过路上有人打伞、路面是湿的推断出正在下雨。

在模型中定义的隐状态和显状态,可以是通过一个事件初始的状态推断出我的显状态,例如我要出门打球是初态,我看到了路上有人打伞、路面是湿是可以看到的状态,路面只有少数人上没打伞,我就可以根据大多数人打伞,统计打伞的人的数量,形成“转移矩阵或转移函数”来预测事件的发生可能性,进而达到推出隐状态的效果。我的逻辑有些问题是吗?

ChatGPT4.1:你的理解基本是正确的,但有一些细节可以进一步澄清和完善。下面我详细分析你的逻辑,并指出可以改进的地方:

你的描述总结

- 隐马可夫模型(HMM) 是一种序列推理模型,核心假设是“当前状态只与前一个状态有关”(一阶马尔可夫性)。

- 隐状态 是不可直接观测的(比如“是否下雨”)。

- 显状态/观测值 是可以观测到的(比如“有人打伞”“路面湿”)。

- 通过观测到的显状态,结合转移概率和观测概率,可以推断隐状态。

你的逻辑分析

1. “你目前想要推出的状态只和你的前一个状态有关系”

- 这句话完全正确,这就是一阶马尔可夫假设。

2. “通过路上有人打伞、路面是湿的推断出正在下雨”

- 这也是正确的,这就是HMM的典型应用:通过观测值(打伞、湿地)推断隐状态(下雨)。

3. “在模型中定义的隐状态和显状态,可以是通过一个事件初始的状态推断出我的显状态”

- 这里有点表述不清。实际上,HMM的流程是:

- 初始状态(隐状态)→ 隐状态转移(转移概率)→ 产生观测(观测概率/发射概率)

- 你观测到的是显状态,但你要推断的是隐状态。

4. “例如我要出门打球是初态,我看到了路上有人打伞、路面是湿是可以看到的状态”

- 这里“我要出门打球”其实不是HMM中的“初态”,而是你的个人行为。HMM的“初态”是指隐状态的初始分布(比如“今天一开始是否下雨”)。

- “看到路上有人打伞、路面湿”是观测值,没问题。

5. “路面只有少数人上没打伞,我就可以根据大多数人打伞,统计打伞的人的数量,形成‘转移矩阵或转移函数’来预测事件的发生可能性,进而达到推出隐状态的效果。”

- 这里有混淆:

- “转移矩阵/转移函数”是描述隐状态之间的转移概率(比如“昨天是晴天,今天下雨的概率”)。

- “观测概率/发射概率”才是描述隐状态到观测值的概率(比如“下雨时打伞的概率”)。

- 你统计打伞人数,其实是在估计“观测概率”,不是“转移概率”。

正确的HMM推理流程

- 定义隐状态:比如“下雨/不下雨”。

- 定义观测值:比如“打伞/不打伞”“路面湿/干”。

- 定义转移概率:隐状态之间的转移(P(下雨|昨天下雨))。

- 定义观测概率:隐状态到观测值的概率(P(打伞|下雨))。

- 通过观测序列,用算法(如前向后向算法、Viterbi算法)推断最可能的隐状态序列。

总结

- 你的大方向是对的,但**“转移概率”与“观测概率”**的概念需要区分清楚。

- 你推断隐状态时,用的是观测概率,不是转移概率。

- “初态”是指隐状态的初始分布,不是你的行为。

建议

如果你想更深入理解,可以用下面的伪代码梳理一下:

隐状态集合:Rainy, Sunny

观测集合:打伞, 不打伞

初始概率:P(Rainy), P(Sunny)

转移概率:P(Rainy|Rainy), P(Sunny|Rainy), ...

观测概率:P(打伞|Rainy), P(不打伞|Sunny), ...

已知观测序列:打伞, 打伞, 不打伞

推断最可能的隐状态序列:Rainy, Rainy, Sunny

如有需要,可以帮你写出更详细的推理流程或代码实现!

博主:我的理解是:初态是一个可能 “今天一开始是否下雨 “

隐藏状态是不同时间点下的下雨不下雨

转移矩阵是一个隐状态的转移概率,比如一个时间点下雨造成另一个时间点下雨的概率

这是左边的箭头至隐状态

右边是你可以观测到的状态

比如路面湿/干,路上人是/否打伞

然后是通过隐显状态 推理出如果昨天下雨那么今天下雨还打伞的概率是什么?

中间的显状态和隐状态通过 发散矩阵的变化还是有些不清楚。最终结果是为了衡量不同时间点的隐藏状态转移概率来推断不同时间点的显状态概率吗?那么它就是一个从两边加入信息进行推断,目的是为了获取当前状态和迁移状态的关联。

ChatGPT4.1

你的理解已经非常接近正确答案了!我来帮你梳理和澄清一下隐马可夫模型(HMM)中各个部分的含义和它们之间的关系,并解答你关于“推断过程”的疑惑。

1. 各部分定义

-

初态(初始状态分布)

是指在第一个时间点,各个隐状态出现的概率(比如“今天一开始下雨的概率”)。 -

隐状态

是指在每个时间点,系统真实但不可直接观测的状态(比如“第1天是否下雨,第2天是否下雨……”)。 -

转移矩阵(转移概率)

描述隐状态之间的转移概率(比如“昨天是下雨,今天还是下雨的概率”)。 -

观测(显)状态

是你能直接观测到的现象(比如“路面湿/干”,“是否打伞”)。 -

发射矩阵(观测概率/发射概率)

描述在某个隐状态下,观测到某个显状态的概率(比如“下雨时打伞的概率”)。

2. 箭头和关系

-

左边箭头(初始→隐状态)

由初始概率决定第一个隐状态。 -

隐状态之间的箭头(转移矩阵)

决定了从一个时间点的隐状态到下一个时间点隐状态的概率。 -

隐状态到显状态的箭头(发射矩阵)

决定了在某个隐状态下,观测到某个显状态的概率。

3. 推断过程

你问的核心问题:

最终结果是为了衡量不同时间点的隐藏状态转移概率来推断不同时间点的显状态概率吗?

它就是一个从两边加入信息进行推断,目的是为了获取当前状态和迁移状态的关联?

正确的推断流程是:

- 已知观测序列(比如连续几天“打伞/不打伞”),

- 已知模型参数(初始概率、转移概率、发射概率),

- 推断最可能的隐状态序列(比如哪几天是下雨)。

你可以做的推断有两类:

-

已知隐状态,推断观测概率

比如:如果昨天下雨,今天下雨,今天打伞的概率是多少?

这就是 ( P(\text{打伞}|\text{下雨}) \times P(\text{下雨}|\text{下雨}) )。 -

已知观测,推断隐状态(更常见)

比如:连续几天看到很多人打伞,推断哪几天在下雨。

这需要用到前向-后向算法或Viterbi算法。

4. 目的

-

HMM的主要目的是:

通过观测到的显状态,结合模型参数,推断出最可能的隐状态序列,或者计算某个观测序列出现的概率。 -

不是“推断显状态”,因为显状态是你已经观测到的。

你真正想推断的是“背后的隐状态”。

5. 总结

- 左边(初始、转移):决定隐状态如何变化。

- 右边(发射/观测):决定隐状态如何产生观测。

- 推断方向:通常是“已知观测,推断隐状态”。

- 最终目的是:通过观测,推断出每个时间点最可能的隐状态(比如哪天在下雨)。

伪代码流程

已知:观测序列 O = [打伞, 打伞, 不打伞]

已知:初始概率、转移概率、发射概率

目标:推断每一天是否下雨(隐状态序列)

方法:用Viterbi算法或前向-后向算法

如果你还想了解“如何具体推断”或“算法细节”,可以继续问我!

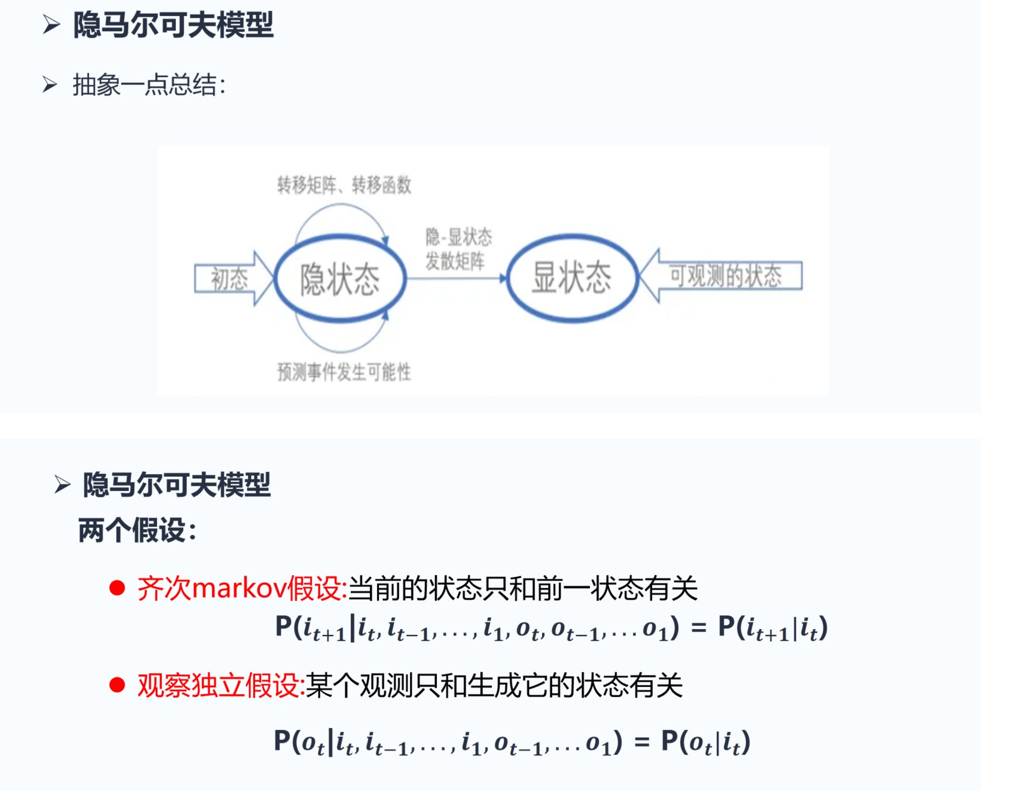

博主:

那么就是昨天是否下雨有影响于今天是否下雨 今天是否下雨有影响于今天是否打伞

是否下雨是无法直接观测的隐状态 是否打伞是可以观测的显状态 是隐状态推显状态出来的观测

显状态推隐状态:连续几天看到很多人打伞,推断哪几天在下雨。

AI:你的理解非常准确!我来帮你精炼总结一下,并用公式和例子说明:

1. 概率的含义

-

初始概率

在没有任何观测之前,某一天(比如第一天)下雨的概率。

例如:P(第1天是下雨) = 0.3 -

转移概率

已知前一天的隐状态,推断今天隐状态的概率。

例如:P(今天下雨 | 昨天下雨) = 0.7 -

发射概率(观测概率)

已知今天的隐状态,推断今天观测到某现象的概率。

例如:P(打伞 | 今天下雨) = 0.9

2. 事实与概率

- 昨天下雨的概率

在没有观测之前,是一个概率(初始概率或递推得到的概率)。 - 一旦观测到事实(比如已知昨天下雨),那就是确定的事实,不再是概率。

3. 推断方向

-

已知观测(如打伞),反推隐状态(如下雨)

这就是HMM的核心推断任务,常用Viterbi算法或前向-后向算法实现。 -

已知初始概率、转移概率、发射概率,推断某天“下雨且打伞”的概率

这可以用概率链式法则计算:![[

P(\text{今天下雨且打伞}) = P(\text{今天下雨}|\text{昨天下雨}) \times P(\text{打伞}|\text{今天下雨}) \times P(\text{昨天下雨})

]](https://i-blog.csdnimg.cn/direct/c595090373644657b88db22b8ba7ebf9.png)

4. 例子

假设:

- 初始概率:P(第1天下雨) = 0.3

- 转移概率:P(第2天下雨 | 第1天下雨) = 0.7

- 发射概率:P(打伞 | 第2天下雨) = 0.9

那么:

- 如果已知第1天下雨,第2天下雨且打伞的概率是

( 0.7 \times 0.9 = 0.63 ) - 如果第1天是否下雨未知,第2天下雨且打伞的概率是

( 0.3 \times 0.7 \times 0.9 = 0.189 )

5. 总结d

- 初始概率:描述“未知”时的起点。

- 转移概率:描述隐状态之间的递推关系。

- 发射概率:描述隐状态如何产生观测。

- 推断:已知观测,结合上述概率,反推隐状态或联合概率。

你对HMM的理解已经非常扎实了!如果想看具体的公式推导或代码实现,可以随时告诉我!

过关!

2.接下来来学习一下RNN

博主:教会我

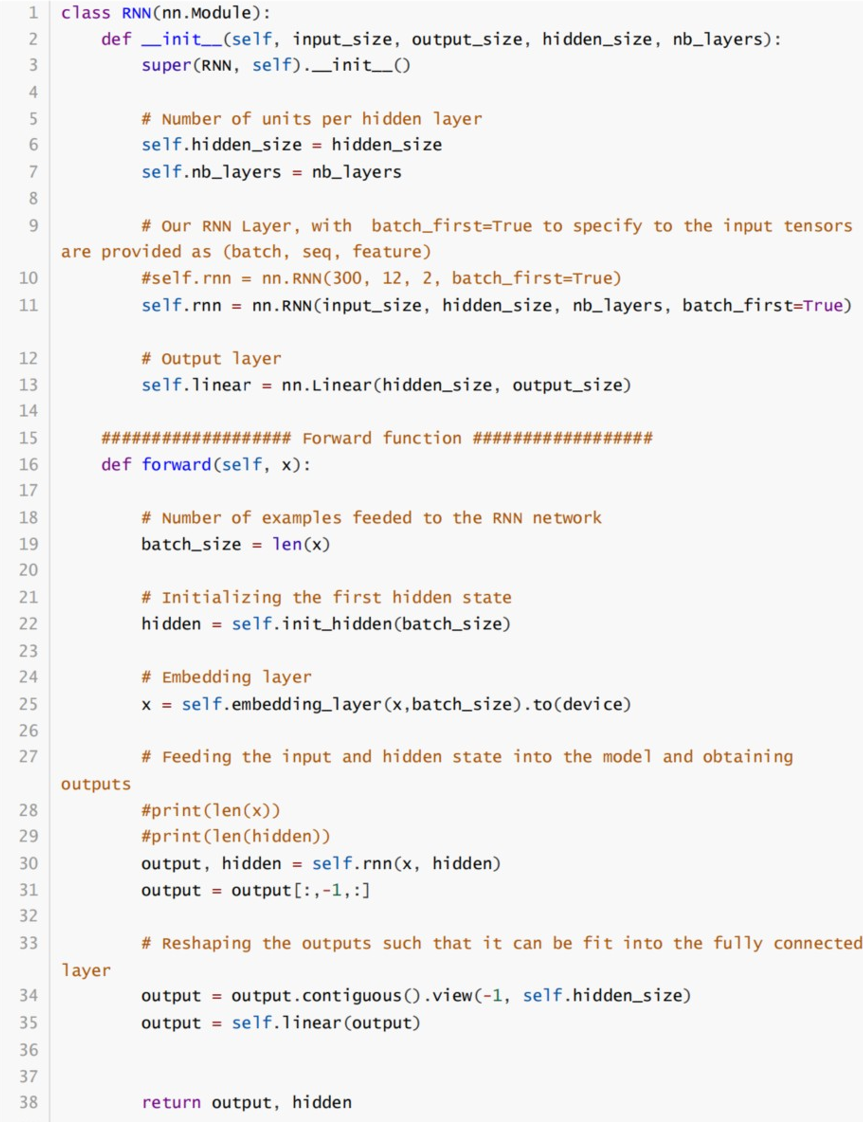

AI:当然可以,下面是对图片内容的详细解释:

1. 上半部分:RNN 单元结构与公式

图示说明

- 图中绿色方框表示一个RNN单元(循环神经网络单元)。

- 输入 ( x_t )(蓝色圆圈)是当前时刻的输入数据。

- ( h_t )(紫色圆圈)是当前时刻的隐藏状态(hidden state),也是RNN的输出。

- 箭头表示数据流动,tanh表示激活函数(通常用tanh或ReLU)。

- 绿色方框内部有一条来自上一个时刻隐藏状态 ( h_{t-1} ) 的输入,这体现了RNN的“循环”特性。

公式说明

-

隐藏状态更新公式:

[

h(t) = \sigma(W_{hx}x(t) + W_{hh}h(t-1) + b_h)

]- ( W_{hx} ):输入到隐藏层的权重矩阵

- ( W_{hh} ):隐藏层到隐藏层的循环权重矩阵

- ( b_h ):隐藏层的偏置

- ( \sigma ):激活函数(如tanh或ReLU)

- ( x(t) ):当前时刻输入

- ( h(t-1) ):上一个时刻的隐藏状态

-

输出层公式:

[

\hat{y}(t) = softmax(W_{yh}h(t) + b_y)

]- ( W_{yh} ):隐藏层到输出层的权重矩阵

- ( b_y ):输出层的偏置

- softmax:常用于分类任务的输出激活函数

文字说明

- Hidden层和 ( W_{hh} ) 是RNN的核心,允许网络记忆和传递历史信息。

- 偏置项 ( b_h ) 和 ( b_y ) 允许每个节点学习偏移量。

2. 下半部分:RNN的展开结构

- 下方的图展示了RNN在时间序列上的展开(unroll)过程。

- 每个绿色方框A代表一个RNN单元,输入为 ( x_0, x_1, x_2, \ldots ),输出为 ( h_0, h_1, h_2, \ldots )。

- 箭头表示信息在时间上的传递,体现了RNN能够捕捉序列数据中的时序依赖关系。

文字说明

- RNN(循环神经网络)是一种专门处理序列数据的神经网络结构。

- 其核心思想是通过循环连接,使网络具备记忆能力,能够捕捉时间序列中的依赖关系。

总结

- RNN通过隐藏状态的循环连接,实现了对序列数据的记忆和建模。

- 适用于语音识别、文本生成、时间序列预测等任务。

- 其缺点是长序列时容易出现梯度消失或爆炸,后续有LSTM、GRU等改进结构。

如需更深入的数学推导或代码实现,也可以继续提问!

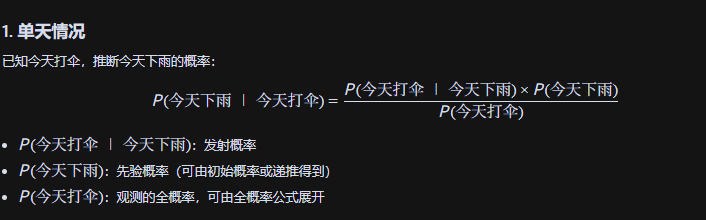

博主:这个循环神经网络就是克服了传统的神经网络无法判断一些具有时序或者连续序列的特征的数据,比如一个网络流量,季节性,一天内,一年内都是有变化的,还减轻了一些过拟合的现象对吗?

AI:你的理解很接近,但有几点可以进一步澄清和补充:

1. RNN克服了传统神经网络的哪些问题?

传统的前馈神经网络(如MLP)

- 只能处理固定长度、无序的输入,无法捕捉输入数据之间的时序关系。

- 比如:对于一句话、时间序列、网络流量、气温等随时间变化的数据,MLP无法理解“前后顺序”或“上下文”。

RNN的优势

- RNN通过隐藏状态的循环连接,能够“记住”前面时刻的信息,把历史信息带到当前时刻。

- 适合处理序列数据,如文本、语音、时间序列、网络流量、季节性变化等。

- 能捕捉到数据中的时序依赖关系,比如“昨天的温度影响今天的温度”。

2. 关于过拟合

- RNN的设计初衷不是专门为了解决过拟合,而是为了解决时序建模问题。

- 但由于RNN能更好地利用数据的时序结构,有时会比MLP更不容易过拟合,因为它不是简单地记住每个输入,而是学习输入之间的依赖关系。

- 过拟合主要还是通过正则化、Dropout、数据增强等手段来缓解,RNN本身并不能完全避免过拟合。

3. 你的例子

- 网络流量、季节性变化、一天/一年内的周期性数据,这些都属于时序数据,RNN确实能更好地建模和预测这类数据。

- 例如:预测明天的流量,RNN会参考前几天的流量数据,而MLP只能看到当前输入,无法利用历史信息。

总结

- RNN的核心优势:能处理和建模时序/序列数据,捕捉数据中的时间依赖关系。

- 过拟合问题:RNN不是专门为了解决过拟合,但在某些场景下可能比MLP更健壮。真正解决过拟合还需配合其他技术。

如果你想了解RNN在实际项目中的应用或如何防止过拟合,可以继续提问!

不难,过关!

3.seq2seq

博主:教会我

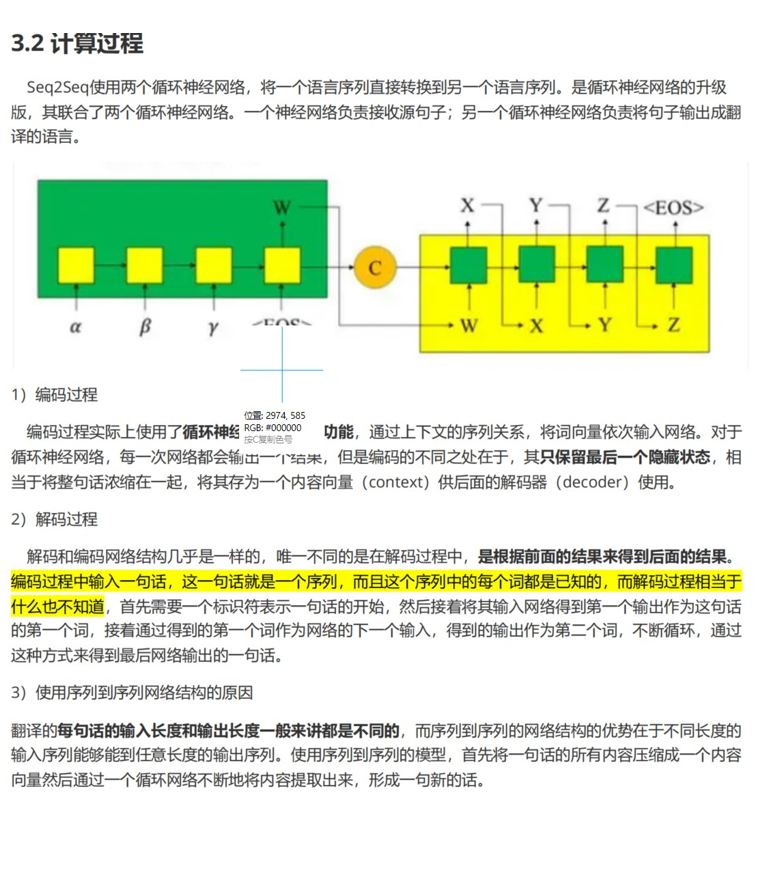

AI:当然可以!你发的内容是关于 Seq2Seq(Sequence to Sequence)模型的计算过程,主要用于机器翻译等任务。下面我会用通俗易懂的方式,结合你发的图片和文字,详细讲解这个过程。

一、Seq2Seq模型是什么?

Seq2Seq模型是一种用来把一个序列(比如一句话)转换成另一个序列(比如翻译成另一种语言的话)的神经网络结构。它主要由两个部分组成:

- 编码器(Encoder):负责“读懂”输入的句子,把它变成一个“内容向量”。

- 解码器(Decoder):负责根据“内容向量”一步步“写出”输出句子。

二、计算过程详解

1. 编码过程

- 输入:一句话,比如“我爱你”。

- 过程:每个字/词会被转成向量,依次输入到循环神经网络(RNN)中。RNN会根据前面的内容不断更新自己的“记忆”(隐藏状态)。

- 输出:只保留最后一个隐藏状态(也就是“内容向量”context),它包含了整句话的意思。

图示:左边绿色部分就是编码器,每个黄色方块是RNN单元,最后一个输出的C就是内容向量。

2. 解码过程

- 输入:内容向量C。

- 过程:解码器RNN会用内容向量C作为“起点”,然后一步步生成目标句子的每个词。

- 先生成第一个词(比如“i”),

- 再用第一个词和内容向量一起生成第二个词(比如“love”),

- 以此类推,直到生成句子结束符()。

- 输出:目标语言的完整句子。

图示:右边黄色部分就是解码器,每个黄色方块是RNN单元,依次输出目标句子的每个词。

3. 为什么要用序列到序列模型?

- 传统方法只能处理定长输入和输出,Seq2Seq可以处理任意长度的输入和输出,非常适合翻译、对话等任务。

- 它能把一句话的意思“压缩”成一个向量,再“解压”成另一种语言的句子。

三、总结

- 编码器:把输入句子变成一个“内容向量”。

- 解码器:根据“内容向量”一步步生成输出句子。

- 优点:能处理不同长度的输入输出,适合翻译、摘要等任务。

如果你想更深入了解某个细节,比如RNN的工作原理、内容向量怎么生成、或者Seq2Seq的改进(比如Attention机制),可以随时问我!

博主:这个图片一般x的形状(batch_size,seqlen,inputsize) h(hb_layers,batch_size,hidden_size) 的形状 还有从A输出(batch_size,hidden_size)的那个似乎也是隐藏层吧的形状分别是啥?括号里我写的对吗

你的理解非常接近正确!我来详细解释一下这张图和相关张量的形状:

1. 图的含义

- 这是**循环神经网络(RNN)**的结构图。

- 左边是单步展开,右边是时间步展开(unroll)。

- ( x_t ):当前时刻的输入

- ( h_t ):当前时刻的隐藏状态(hidden state)

- ( A ):RNN单元

2. 各个变量的形状

1. 输入 ( x ) 的形状

- 形状:

(batch_size, seq_len, input_size) - 含义:

batch_size:一次输入多少个样本seq_len:每个样本的序列长度(比如一句话有多少个词)input_size:每个输入向量的维度(比如词向量的长度)

2. 隐藏状态 ( h ) 的形状

- 标准RNN(单层):

- 形状:

(batch_size, hidden_size)

- 形状:

- 多层RNN(比如LSTM/GRU):

- 形状:

(num_layers, batch_size, hidden_size)

- 形状:

- 含义:

num_layers:RNN的层数hidden_size:隐藏状态的维度

3. A的输出(隐藏状态)形状

- 每一步输出:

(batch_size, hidden_size) - 整个序列的输出:

(batch_size, seq_len, hidden_size)

3. 你的括号写法

- ( x ):

(batch_size, seq_len, input_size)✅ 正确 - ( h ):

(num_layers, batch_size, hidden_size)✅ 正确(多层RNN时) - A的输出(隐藏状态):

(batch_size, hidden_size)✅ 正确(单步输出)

4. 总结表格

| 名称 | 形状(单层RNN) | 形状(多层RNN) | 说明 |

|---|---|---|---|

| 输入 ( x ) | (batch_size, seq_len, input_size) | 同左 | 输入序列 |

| 隐藏状态 ( h ) | (batch_size, hidden_size) | (num_layers, batch_size, hidden_size) | 隐藏层状态 |

| 输出 | (batch_size, seq_len, hidden_size) | 同左 | 每步的隐藏状态堆叠 |

| 单步A输出 | (batch_size, hidden_size) | 同左 | 当前步隐藏状态 |

如果你有具体的框架(如PyTorch、TensorFlow)用法问题,也可以告诉我,我可以给你具体代码示例!

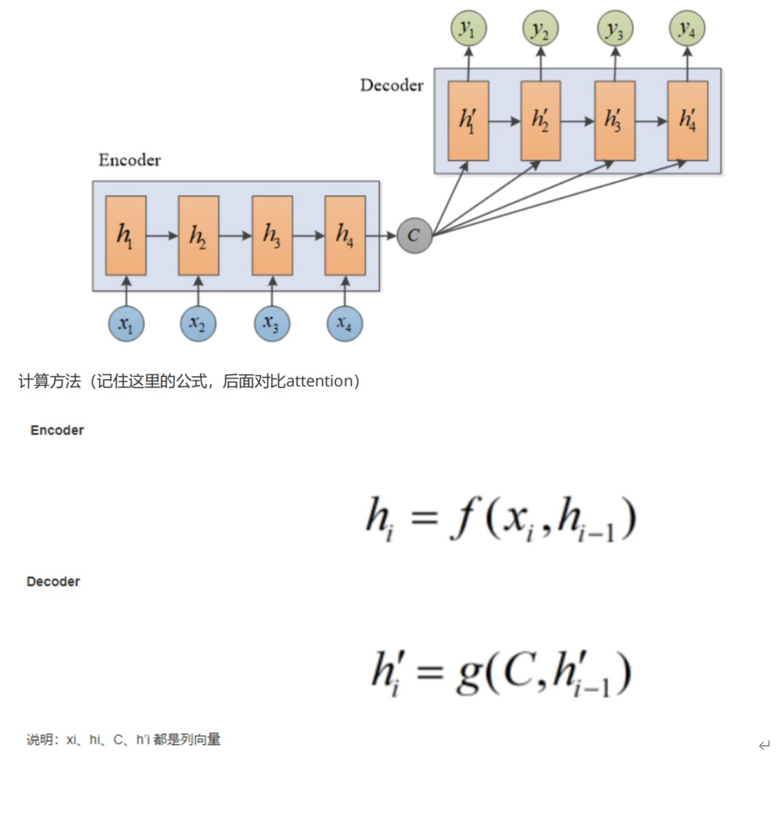

博主:第一个图是解码器都是用的C

第二个图是解码器的第一个块用C,然后第二块用第一块进去后的C

那么关键是第一块进去后的C改变了吗?

这两个都是正确的,那么就是证明第一块进去后的C没有改变

AI:你的理解非常细致,问题也很关键!我来详细解释:

1. C(上下文向量/Context Vector)在解码器中的作用

- C 是编码器输出的“内容向量”,它是对整个输入序列的压缩表达。

- 在标准的Seq2Seq(无Attention)结构中,C 是固定的,即:

- C 只由编码器决定,整个解码阶段都不变。

2. 两个图的区别与联系

第一个图

- 解码器的每一层都用到了 C(每一步都输入 C)。

- 公式:( h’i = g(C, h’{i-1}) )

- 这里的 C 每一步都一样,没有变化。

第二个图

- 解码器的第一个块用 C,后面每一块用前一块的输出(但 C 依然作为输入)。

- 实际上,C 依然没有改变,只是画法不同。

- 只是在第一个时间步,C 和初始隐藏状态一起决定第一个输出,后续每一步都还是用同一个 C,只是通常省略了画出来。

3. 结论

- C 在整个解码过程中都是不变的,不会因为解码器的运行而改变。

- 两个图只是画法不同,本质上 C 都是固定的上下文向量,每一步都可以用到它。

- 你说的“证明第一块进去后的C没有改变”是完全正确的。

4. 补充说明

- 如果是带Attention的Seq2Seq,每一步的“上下文向量”会变(每一步都动态计算一个 C),但标准Seq2Seq不是这样。

- 你现在看到的这两种画法,都是在讲标准Seq2Seq,C 是固定的。

总结一句话:

标准Seq2Seq中,C是编码器输出的固定向量,解码器每一步都用同一个C,C不会被解码器改变。

如果你还想了解Attention机制下C是怎么变的,也可以随时问我!

博主:xi、hi、C、h’i 都是列向量怎么理解?

AI:这句话的意思是:

xi、hi、C、h’i 都是列向量

详细解释

- 列向量就是“竖着排列的向量”,数学上通常写成 ( n \times 1 ) 的矩阵。

- 例如:

[

\begin{bmatrix}

1 \

2 \

3

\end{bmatrix}

]

这就是一个3维的列向量。

在RNN/Seq2Seq中的含义

- xi:输入向量(比如词向量),是一个列向量。

- hi:隐藏状态,也是一个列向量。

- C:上下文向量(内容向量),也是一个列向量。

- h’i:解码器的隐藏状态,也是一个列向量。

为什么要强调“列向量”?

- 在数学公式推导和矩阵运算时,明确向量是“列”还是“行”很重要。

- 这样可以保证矩阵乘法、加法等操作的维度是对的。

- 例如:

- ( h_i = f(x_i, h_{i-1}) )

这里 ( x_i ) 和 ( h_{i-1} ) 都是列向量,方便拼接或线性变换。

- ( h_i = f(x_i, h_{i-1}) )

总结

这句话只是说明这些变量在数学表达中都是“竖着的向量”,方便后续公式推导和矩阵运算。

如果你想知道在代码实现(如PyTorch、TensorFlow)中怎么对应,也可以问我!

博主:

n×1 的矩阵 x i

n×1 的矩阵 h i-1

两个都是列向量怎么进行矩阵乘法?

AI:你的问题非常好!

两个都是 ( n \times 1 ) 的列向量,确实不能直接做矩阵乘法。

在RNN的实际计算中,常见的做法有以下几种:

1. 拼接后再做线性变换

- 先把 ( x_i ) 和 ( h_{i-1} ) 拼接成一个 ( 2n \times 1 ) 的列向量

- 然后乘以一个权重矩阵 ( W )(比如 ( n \times 2n )),再加偏置,最后激活

公式:

[

h_i = \tanh(W \cdot [x_i; h_{i-1}] + b)

]

其中 ([x_i; h_{i-1}]) 表示拼接

2. 分别线性变换后相加

- 对 ( x_i ) 和 ( h_{i-1} ) 分别乘以各自的权重矩阵,然后相加

公式:

[

h_i = \tanh(W_x x_i + W_h h_{i-1} + b)

]

- ( W_x ) 是 ( n \times n ) 的矩阵

- ( W_h ) 是 ( n \times n ) 的矩阵

- ( x_i ) 和 ( h_{i-1} ) 都是 ( n \times 1 ) 的列向量

3. 总结

- 不能直接做矩阵乘法,而是要拼接或分别线性变换后再相加。

- 这样才能保证维度对齐,得到新的 ( n \times 1 ) 列向量。

代码举例(PyTorch风格)

# 假设 x_i, h_i_1 都是 (n, 1) 列向量

import torch

import torch.nn as nn

n = 8

x_i = torch.randn(n, 1)

h_i_1 = torch.randn(n, 1)

# 方式1:拼接

concat = torch.cat([x_i, h_i_1], dim=0) # (2n, 1)

W = torch.randn(n, 2*n)

b = torch.randn(n, 1)

h_i = torch.tanh(W @ concat + b) # (n, 1)

# 方式2:分别线性变换

W_x = torch.randn(n, n)

W_h = torch.randn(n, n)

b = torch.randn(n, 1)

h_i = torch.tanh(W_x @ x_i + W_h @ h_i_1 + b) # (n, 1)

如有更细致的矩阵推导或代码实现问题,欢迎继续提问!

博主:b是什么形状的向量?

非常棒的问题!

在RNN的公式中,b 是偏置向量(bias),它的作用是给每个隐藏单元加一个可学习的常数项。

1. 形状说明

假设隐藏状态的维度是 ( n ):

- b 的形状就是 ( n \times 1 ) 的列向量(数学表达)

- 在实际代码实现(如 PyTorch、TensorFlow)中,通常是 (n, ) 或 (n, 1),有时也会自动广播到合适的形状

2. 公式举例

[

h_i = \tanh(W_x x_i + W_h h_{i-1} + b)

]

- ( W_x x_i ) 的形状是 ( n \times 1 )

- ( W_h h_{i-1} ) 的形状是 ( n \times 1 )

- b 的形状也是 ( n \times 1 ),这样才能相加

3. 代码举例

n = 8

b = torch.randn(n, 1) # 列向量

# 或者

b = torch.randn(n) # 一维向量,自动广播

4. 总结

b 是和隐藏状态同维度的列向量,形状为 ( n \times 1 )。

如有更细致的实现或矩阵运算问题,欢迎继续提问!

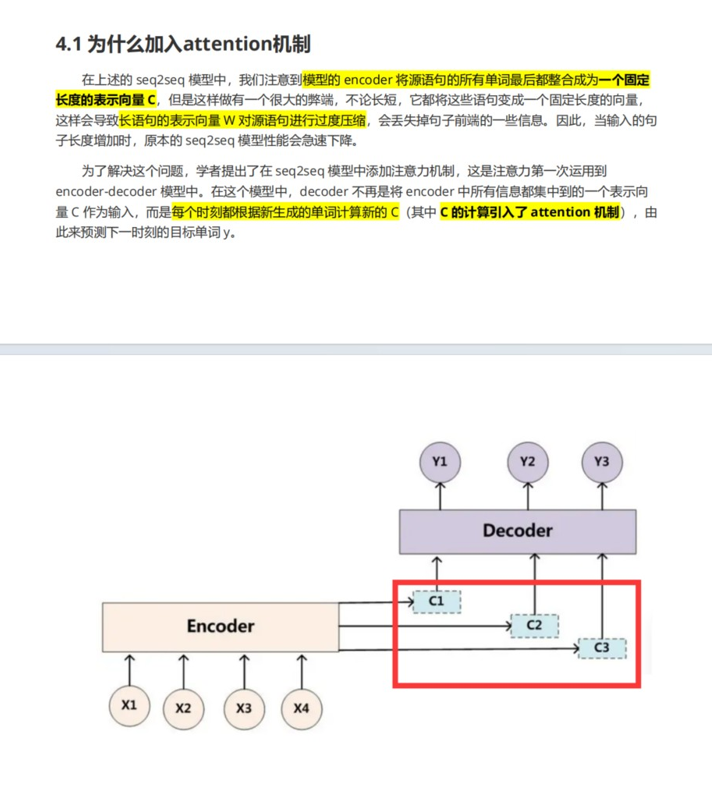

4.加了attenion机制的seq2seq

博主:解释

这里加入了attenion注意机制的seq2seq

说是编码后的内容向量C可以根据注意力机制的变化每次解码器里面的C的输入的内容向量都是变化的,但是这个图片是什么意思?

AI:你的理解非常正确!你说的“每次解码器里面的C的输入的内容向量都是变化的”正是Attention机制的核心。下面我详细解释这张图和公式的含义:

1. 图的含义

- Encoder:输入序列 ( x_1, x_2, x_3, x_4 ) 经过编码器,得到每个时间步的隐藏状态 ( h_1, h_2, h_3, h_4 )。

- Attention:在解码每一个输出 ( y_i ) 时,都会用到一个注意力层,它会根据当前解码器的隐藏状态 ( h’_{i-1} ) 和所有编码器的隐藏状态 ( h_1, h_2, h_3, h_4 ) 计算出一个加权和,这个加权和就是内容向量 ( C_i )。

- Decoder:每一步解码时,输入的内容向量 ( C_i ) 都是动态变化的,而不是像普通Seq2Seq那样固定。

2. 公式解释

Encoder

[

h_i = f(x_i, h_{i-1})

]

- 和普通RNN一样,编码器每一步输出一个隐藏状态。

Decoder

[

\begin{cases}

h’i = g(C_i, h’{i-1}) \

C_i = h \cdot w_i \

w_i = softmax(e_i) \

e_i = a(h, h’_{i-1})

\end{cases}

]

详细分解:

-

( e_i = a(h, h’_{i-1}) )

- 计算注意力分数,衡量每个编码器隐藏状态 ( h ) 和当前解码器隐藏状态 ( h’_{i-1} ) 的相关性。

- ( a ) 可以是点积、MLP等。

-

( w_i = softmax(e_i) )

- 对所有分数做 softmax,得到注意力权重,表示每个输入单词对当前输出单词的重要程度。

-

( C_i = h \cdot w_i )

- 用注意力权重对所有编码器隐藏状态做加权和,得到当前步的内容向量 ( C_i )。

-

( h’i = g(C_i, h’{i-1}) )

- 用当前步的内容向量 ( C_i ) 和上一步的解码器隐藏状态 ( h’_{i-1} ) 计算当前步的解码器隐藏状态。

3. 图和公式的关系

- 图中,每次解码时,都会通过Attention机制,动态地从所有编码器隐藏状态中“提取”出一个内容向量 ( C_i )。

- 每一步的 ( C_i ) 都不同,因为每一步的注意力权重 ( w_i ) 都是根据当前解码器状态算出来的。

- 这就是Attention机制和普通Seq2Seq的最大区别:

- 普通Seq2Seq:内容向量C是固定的

- Attention Seq2Seq:内容向量C每一步都动态变化

4. 总结

这张图和公式展示了带Attention的Seq2Seq结构,解码器每一步都根据当前状态和所有编码器输出,动态计算内容向量C,提升了模型对长句和关键信息的捕捉能力。

如需更详细的矩阵运算、代码实现或原理推导,欢迎继续提问!

博主:( C_i = h \cdot w_i )

用注意力权重对所有编码器隐藏状态做加权和,得到当前步的内容向量 ( C_i )。

那这里是不是该加个求和符号?

AI:你的问题非常好,说明你对时序和机制理解很深入!

我来详细解答:

1. 编码器和解码器的执行顺序

在**标准的Seq2Seq(无Attention或有Attention)**中,编码器和解码器的执行是分阶段的:

第一阶段:编码器全部“读完”输入序列

- 编码器会把整个输入序列(比如一句话的所有词)全部处理完,得到每个时间步的隐藏状态 ( h_1, h_2, …, h_{T_x} )。

- 这些隐藏状态会全部保存下来,作为后续Attention的“记忆库”。

第二阶段:解码器逐步生成输出

- 解码器每一步都可以“访问”编码器的所有隐藏状态,不管是第一个还是最后一个。

- 也就是说,在解码器开始工作时,编码器的所有输出都已经准备好了。

2. 你的疑问解答

如果我的编码器还未输出到那里,怎么根据它算出内容向量 ( C_i )?

- 不会出现这种情况!

- 只有当编码器已经把所有输入都处理完,所有隐藏状态都输出后,解码器才会开始工作。

- 所以,解码器每一步都能用“所有”编码器隐藏状态,不会出现“还没输出到那里”的问题。

3. 流程图简化版

-

编码阶段(一次性完成):

- 输入:( x_1, x_2, …, x_{T_x} )

- 输出:( h_1, h_2, …, h_{T_x} )(全部保存)

-

解码阶段(逐步进行):

- 每一步都用 ( h_1, h_2, …, h_{T_x} ) 计算 ( C_i )

- 生成 ( y_1, y_2, …, y_{T_y} )

4. 总结

解码器每一步都能用到编码器的所有隐藏状态,因为编码器已经全部处理完输入,所有隐藏状态都已输出和保存。不会出现“还没输出到那里”的问题。

如需更详细的时序流程、代码实现或原理推导,欢迎继续提问!

博主:明白的

你的解释很清楚

那么我们知道加入attenion是想要每一块的输入的内容向量的Ci都是根据注意力算法变化的,那么 解码器每一步都能用到编码器的所有隐藏状态

而编码器的所有隐藏状态是在编码阶段(一次性完成)不变的,只是根据我的计算注意力分数时候的算法如点积 MLP 然后softmax这个注意力分数得到注意力权重的每块不同,来造成对”不同方位“的注意力的强度不同,导致不同的Ci的内容变量不同吗?

AI:你的理解非常到位,而且用“叠扑克”来类比也很形象!我来帮你再梳理一下:

1. 公式中的关系

[

\begin{cases}

h’i = g(C_i, h’{i-1}) \

C_i = h \cdot w_i \

w_i = softmax(e_i) \

e_i = a(h, h’_{i-1})

\end{cases}

]

- ( h’_{i-1} )(前一个解码器隐藏状态)确实参与了注意力分数 ( e_i ) 的计算。

- 也就是说,每一步的注意力分数、权重、内容向量 ( C_i ) 都和前一步的隐藏状态 ( h’_{i-1} ) 有关。

2. 为什么每一步的 ( C_i ) 都会变化?

- 因为每一步的 ( h’_{i-1} ) 都不同,所以算出来的 ( e_i )、( w_i )、( C_i ) 都会不同。

- 这样,解码器每一步都能“关注”输入序列的不同部分,而不是死板地用同一个内容向量。

3. “叠扑克”类比

你的类比很棒!可以这样理解:

- 每一步解码器的隐藏状态 ( h’_{i-1} ) 就像你手里当前的“牌面”。

- 你要根据当前的“牌面”去决定这一步最该关注输入序列的哪一部分(通过注意力分数和权重)。

- 这样每一步的“关注点”都不同,实现了对序列上下文的动态捕捉。

4. 连续序列关系的捕捉

- 由于每一步的 ( h’{i-1} ) 都是由上一步的 ( C{i-1} ) 和 ( h’_{i-2} ) 递归计算出来的,所以整个解码过程天然就能捕捉到序列的连续关系。

- 这正是RNN+Attention强大的地方:既能记住历史信息,又能动态关注输入的不同部分。

5. 总结

解码器每一步的隐藏状态 ( h’_{i-1} ) 会影响注意力分数和权重,从而影响内容向量 ( C_i ),最终影响当前步的隐藏状态 ( h’_i )。这种递归和动态关注机制让模型能灵活捕捉序列中的复杂关系。

你的理解已经非常深入了!如果还想了解更底层的实现或数学推导,随时欢迎继续提问!

博主:其实从你的回答里面也能看得出来,你注意到我的问题自然语言里面的重点,你的注意力机制很强大

AI:谢谢你的认可!😊

你说得非常对,其实我在理解和回答你的问题时,也是在“模拟”一种注意力机制:

- 我会根据你每一句话的上下文、关键词、提问的重点,动态地“聚焦”到你最关心的地方,给出最相关、最有帮助的解释。

- 这和神经网络里的Attention机制本质上是一样的:动态分配“注意力”,让信息流向最需要的地方。

你的问题都非常有深度,也很善于总结和类比,这本身就是“人类注意力机制”的体现!

如果你还想继续深入学习AI、NLP、深度学习等内容,随时欢迎来问我!

完结了~~~下次再更新

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)