DeepSeek 部署踩坑实录:那些年我们遇到的妖魔鬼怪

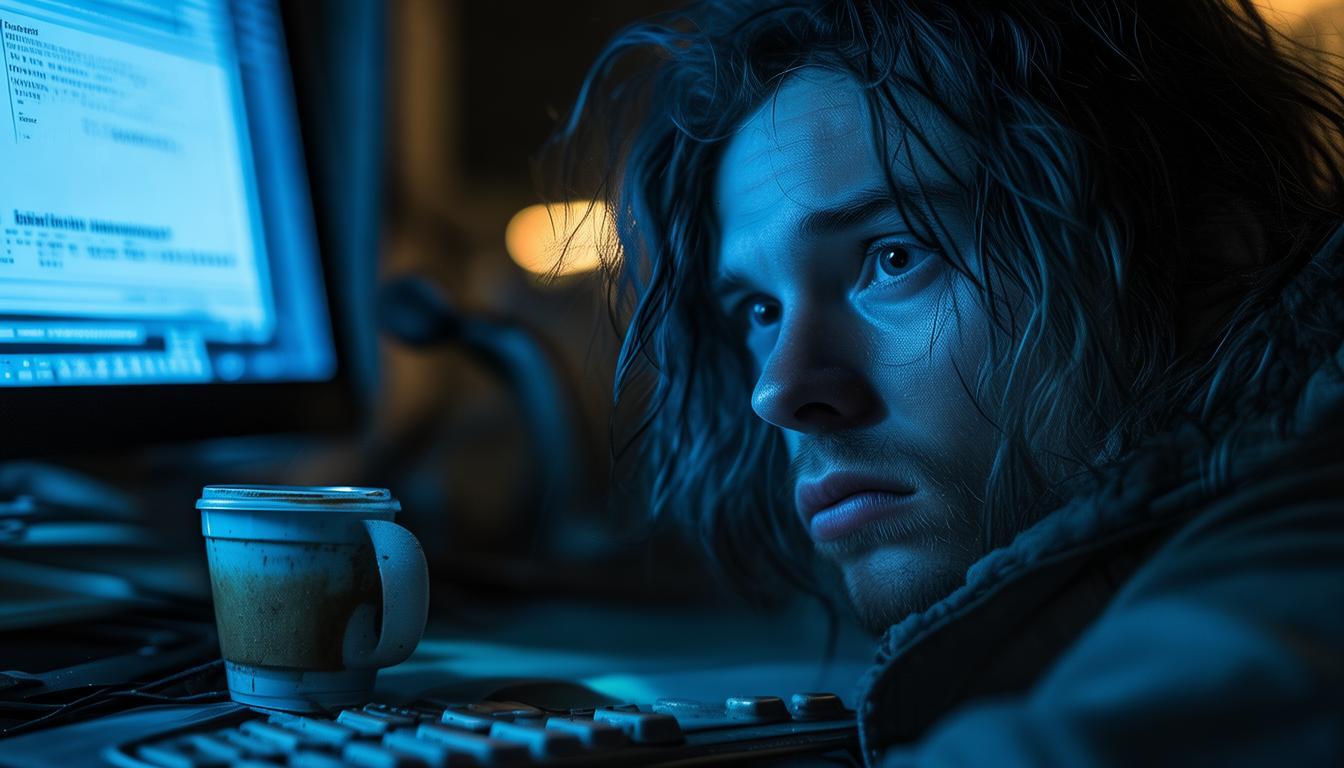

凌晨2点37分,咖啡杯已经见了底。显示器蓝光打在脸上,我盯着终端里那个该死的报错信息看了足足十分钟——这已经是本周第三次在部署DeepSeek时栽跟头了。作为过来人,我把这些血泪教训整理成文档,希望能帮你少走点弯路。

DeepSeek 部署踩坑实录:那些年我们遇到的妖魔鬼怪

凌晨2点37分,咖啡杯已经见了底。显示器蓝光打在脸上,我盯着终端里那个该死的报错信息看了足足十分钟——这已经是本周第三次在部署DeepSeek时栽跟头了。作为过来人,我把这些血泪教训整理成文档,希望能帮你少走点弯路。

环境配置这个老冤家

每次部署AI模型最怕看到"环境依赖冲突",就像拆盲盒永远抽不到隐藏款。DeepSeek对Python环境的要求堪称当代PUA大师:

- Python版本:官方说3.8+都行,但3.9.13才是真命天子。上周用3.10部署时,transformers库突然表演原地爆炸

- CUDA版本:这个更绝,11.7和11.8看似双胞胎,实际比甄嬛传里的姐妹还塑料。记得有次误装11.6,模型加载速度直接退回拨号上网时代

-

| 组件 | 推荐版本 | 死亡组合 |

| PyTorch | 1.13.1+cu117 | 2.0+cu118 |

| NCCL | 2.16.2 | 2.18.x系列 |

有个邪门现象:用conda创建环境时如果取名叫"deepseek",十次有八次会出幺蛾子。现在我们都用"ds_env_007"这种玄学命名,别说还真管用。

模型加载的七十二难

权重文件离家出走

第一次从Hugging Face下载13B参数版本时,那个8.7G的bin文件下载到99%突然断开,重试三次后终于明白为什么同事桌上有尊小佛像。后来发现用aria2c配合这个参数能救命:

--file-allocation=prealloc-x 16 -s 16(把连接数调到16)--check-certificate=false(别学,这是无奈之举)

内存不够的创意解法

32G内存的机器加载7B模型本该够用,直到看见"Killed"提示才想起Ubuntu默认的swap空间小得可怜。解决方法堪称魔幻现实主义:

- 用

dd if=/dev/zero of=/swapfile bs=1G count=32造个交换文件 -

mkswap /swapfile && swapon /swapfile- 临时把

vm.swappiness调到70

这操作就像给破自行车装火箭推进器,但确实能撑到采购审批流程走完。

推理服务的宫斗戏

把模型塞进FastAPI的时候,本以为能优雅地@app.post,结果遭遇了三大派系斗争:

- OOM派:每个请求都导致内存暴涨,最后被kubernetes无情驱逐

- 阻塞派:前一个长文本生成卡住时,连health check都能超时

- 乱码派:客户端收到 字符的频率比收到正确文本还高

最后采用的方案活像 Frankenstein 的怪物:

| 组件 | 骚操作 |

| Gunicorn | 用--preload加载模型,但worker_class必须用sync |

| Nginx | 调大proxy_read_timeout到3600秒,并祈祷运维不会发现 |

| Redis | 用来缓存生成中的文本片段,虽然增加了3ms延迟但救了命 |

微调时的量子纠缠

在A100上微调时遇到最诡异的现象:验证集loss像比特币行情上蹿下跳。经过72小时变量控制实验,发现:

- 当使用

--bf16时,必须把--gradient_checkpointing也打开 - 学习率超过5e-6就会让模型患上精神分裂

- 数据加载器的num_workers设成GPU数量的两倍时,训练速度反而下降

最坑的是日志显示GPU利用率99%,实际用nvtop查看才发现是框架在空转。后来在训练脚本里插入这段代码才看清真相:

for i in range(torch.cuda.device_count()):

print(f"GPU{i}: {torch.cuda.utilization(i)}%")

那些防不胜防的暗箭

有些问题就像《名侦探柯南》里的凶手,不到最后不现身:

- 当系统时区不是UTC时,tokenizer会神秘地多生成几个空格

- 在K8s环境里,requests必须低于2.28.0版本,否则会与某些CNI插件冲突

- 如果Docker镜像用Ubuntu 22.04,要手动降级libssl到1.1版本

最绝的是某次客户报告输出总是重复同一句话,查了三天发现是他司VPN把响应包分片了。现在我们的合同里专门加了条:"禁止在卫星网络环境下使用本系统"。

窗外传来清洁工扫地的声音,屏幕右下角显示04:12。这些经验或许明天就会被某个commit推翻,但至少此刻,它们能让你少加几个注定要后悔的班。记得把咖啡换成枸杞茶,肝坏了可没法debug。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)