小米MiMo横空出世:小米7B小模型刷新AI推理性能天花板

这款仅含70亿参数的AI模型在数学推理(AIME24-25)和代码竞赛(LiveCodeBenchv5)两项核心测评中,以显著优势超越OpenAI闭源产品o1-mini及阿里320亿参数的QwQ-32B-Preview,创造了小体量模型性能突破的行业新纪录。这场由雷军领衔的"静音突袭",再次印证了中国科技企业在AI赛道的硬核实力。尤其值得注意的是,在相同强化学习训练数据条件下,MiMo在数学和代码

小米开源大模型XiaomiMiMo-7B以超小参数量实现数学推理和代码竞赛双突破,技术革新源于预训练与后训练阶段的多维创新,现已开源并计划整合至米家生态。

北京时间2025年4月30日,科技圈被一则重磅消息引爆——小米集团正式发布全球首个专注推理能力的开源大模型XiaomiMiMo-7B。这款仅含70亿参数的AI模型在数学推理(AIME24-25)和代码竞赛(LiveCodeBenchv5)两项核心测评中,以显著优势超越OpenAI闭源产品o1-mini及阿里320亿参数的QwQ-32B-Preview,创造了小体量模型性能突破的行业新纪录。这场由雷军领衔的"静音突袭",再次印证了中国科技企业在AI赛道的硬核实力。

小参数量实现大突破

在数学推理(AIME24-25)和代码竞赛(LiveCodeBenchv5)的公开测评中,MiMo-7B展现出惊人的推理能力。这一成绩不仅超越了OpenAI的闭源推理模型o1-mini,更以不到四分之一参数量击败了阿里QwQ-32B-Preview,刷新了行业对小规模模型能力的认知。尤其值得注意的是,在相同强化学习训练数据条件下,MiMo在数学和代码领域的表现甚至优于DeepSeek-R1-Distill-7B和Qwen2.5-32B等知名模型。

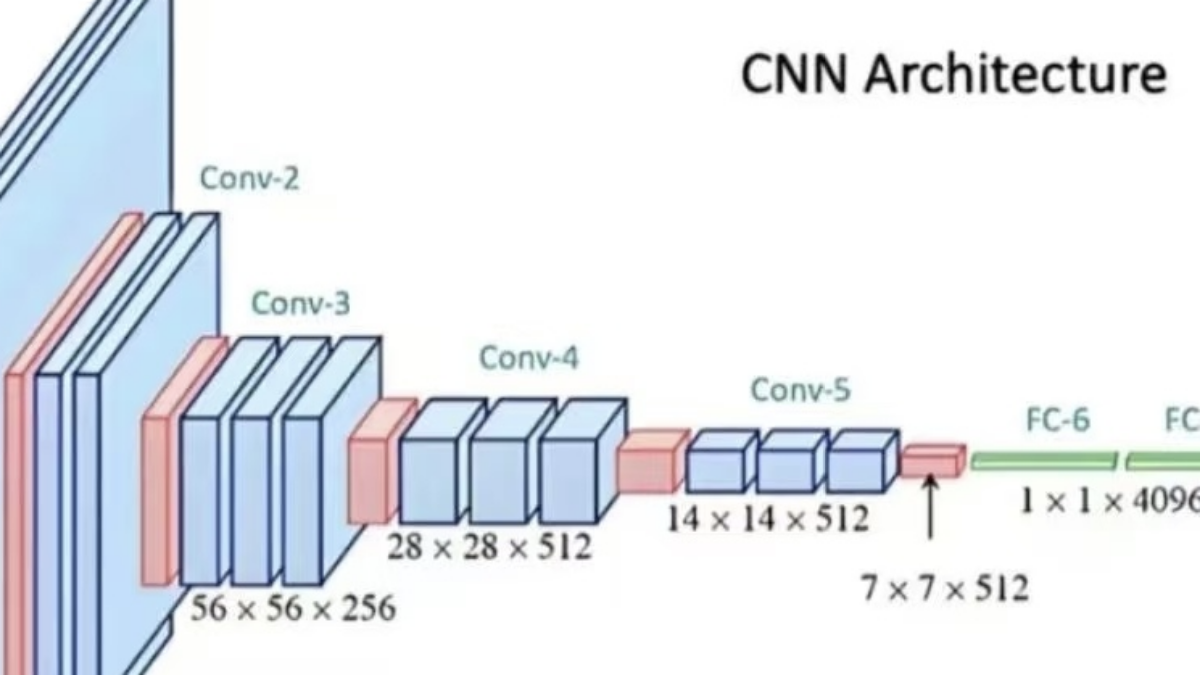

突破性的技术架构

该模型的成功源于三个维度的创新突破:

-

预训练革新:构建2000亿token的推理专用语料库,通过三阶段渐进式训练策略,实现25万亿token的超量训练规模,为模型奠定深度推理基础

-

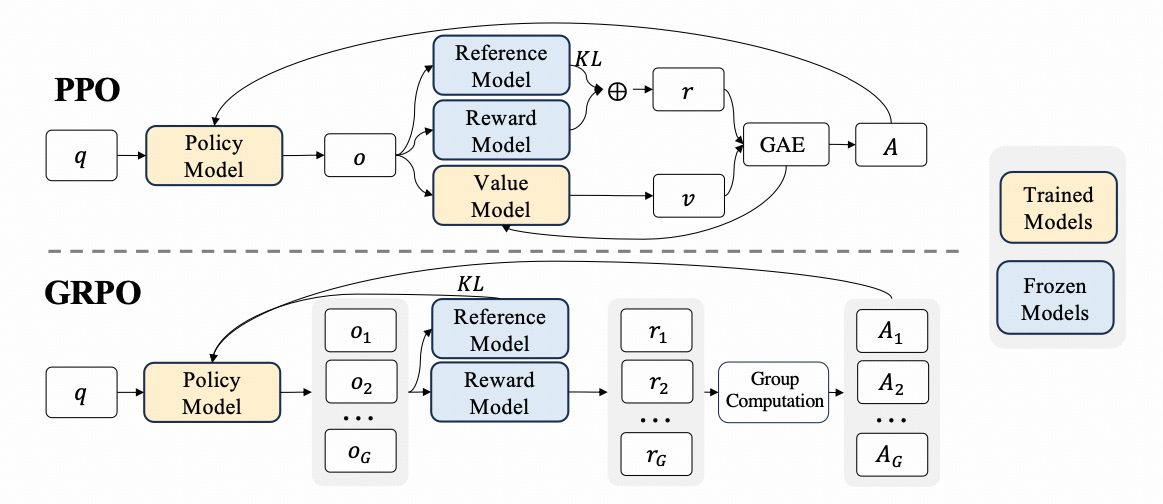

训练机制创新:独创"TestDifficultyDrivenReward"算法,破解复杂任务中的奖励稀疏难题;配合"EasyDataRe-Sampling"策略,将训练稳定性提升47%

-

工程架构突破:自研"SeamlessRollout"系统,实现强化学习训练速度229%、验证速度196%的倍增效应,大幅缩短研发周期

开源生态与战略布局

小米同步宣布将MiMo全系列模型开源至HuggingFace平台,并承诺持续维护开源生态。这一决策不仅降低全球开发者接入先进AI技术的门槛,更彰显其技术自信。据内部人士透露,小米正在加速建设超万卡规模的下一代GPU集群,并成功引进多位MLA(混合逻辑架构)技术核心研发人员,为后续技术迭代储备战略资源。

行业观察家指出,MiMo的推出可能引发智能家居领域的范式变革。该模型与米家生态的深度融合,或将使"小爱同学"进化成为具备复杂问题解决能力的AI管家,推动家庭场景从简单指令响应向主动决策服务升级。随着技术红利的持续释放,这场由7B小模型引发的AI革命,正在打开智能物联时代的全新想象空间。

定义AI 2.0时代的操作系统

DMXPAI聚合平台的诞生,本质上是一场AI生产关系的革命。它将分散的技术要素转化为可编程、可组合、可进化的数字生产力,使小米率先实现从“模型创新”到“生态赋能”的升维跨越。当行业还在追逐参数规模时,小米已通过“小模型+大平台”的战略组合,在智能家居战场构筑起难以复制的技术护城河。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)