【AI大模型】MCP 实践:基于 MCP 架构实现知识库答疑系统

业界推测 2025 年是 AI Agent 的元年,从目前的技术发展速度看确实是有这个趋势。从年初 DeepSeek 的爆火开始,目前开源大模型的能力基本与商业大模型拉齐甚至是超越,完全开放的开源策略让大模型的使用彻底平权。这个可以说在某种程度上改变了 AI 应用的商业模式,基于自训练的闭源模型的优势被显著削弱,商业竞争从模型性能转向对应用场景的创新。

前言

业界推测 2025 年是 AI Agent 的元年,从目前的技术发展速度看确实是有这个趋势。从年初 DeepSeek 的爆火开始,目前开源大模型的能力基本与商业大模型拉齐甚至是超越,完全开放的开源策略让大模型的使用彻底平权。这个可以说在某种程度上改变了 AI 应用的商业模式,基于自训练的闭源模型的优势被显著削弱,商业竞争从模型性能转向对应用场景的创新。

AI 应用的形态不断演进,从早期的 Chat 到 RAG,再到现在的 Agent。参考 Web 2.0 和移动互联网时代的技术发展,当某种新形态的应用开发需求爆发式增长,会催生新的开发框架和新的标准的建立,AI 应用正在经历这个过程。

目前开发框架还处于百花齐放的状态,Python 是否会成为主流开发语言,哪个开发框架会成为主流,这些都还未知,有待观望。但是近期比较火热的 MCP(Model Context Protocol)看起来已成事实标准,特别是近期 OpenAI 也官宣了对 MCP 的支持。

关于 MCP 的介绍不在本文赘述,本着学习的目的,动手做了一个实践,主要为了体验如何基于 MCP 开发一个 Agent 应用。本次实践会实现一个目前最常见的一类 AI 应用即答疑系统,支持基于私有知识库的问答,会对知识库构建和 RAG 做一些优化。

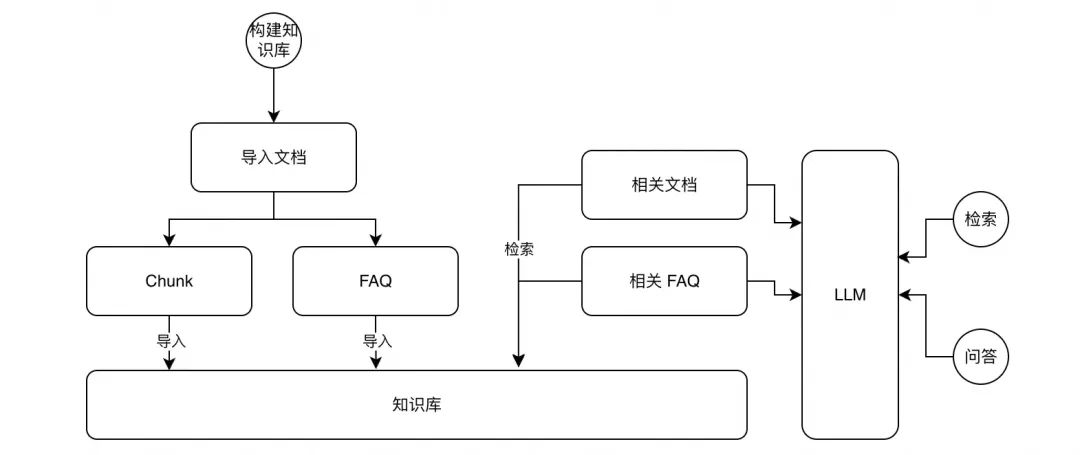

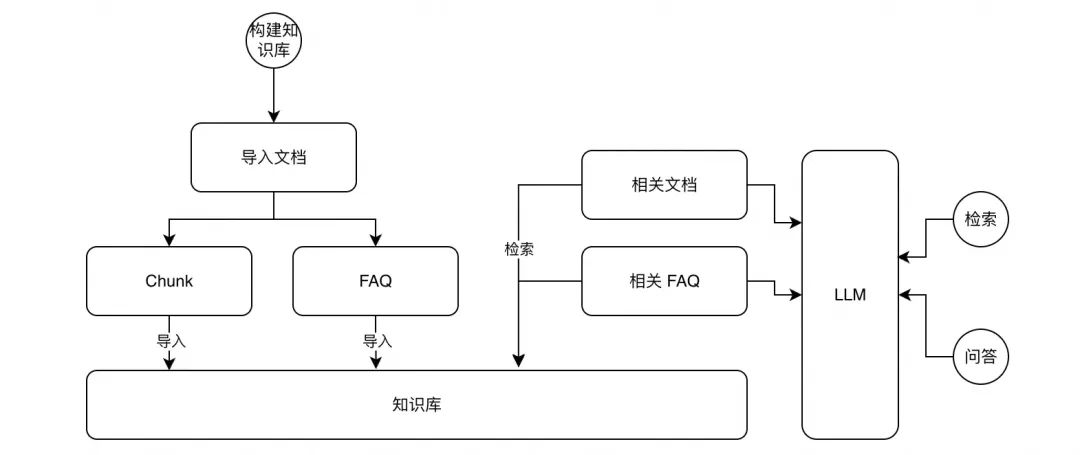

整体流程设计

主要分为两部分:知识库构建和检索。

1.知识库构建

a.文本切段:对文本进行切段,切段后的内容需要保证文本完整性以及语义完整性。

b.提取 FAQ:根据文本内容提取 FAQ,作为知识库检索的一个补充,以提升检索效果。

c.导入知识库:将文本和 FAQ 导入知识库,并进行 Embedding 后导入向量。

2.知识检索(RAG)

a.问题拆解:对输入问题进行拆解和重写,拆解为更原子的子问题。

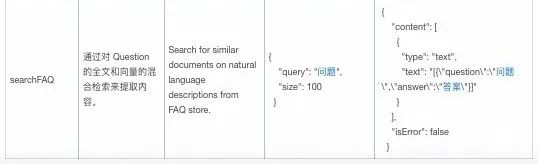

b.检索:针对每个子问题分别检索相关文本和 FAQ,针对文本采取向量检索,针对 FAQ 采取全文和向量混合检索。

c.知识库内容筛选:针对检索出来的内容进行筛选,保留与问题最相关的内容进行参考回答。

相比传统的 Naive RAG,在知识库构建和检索分别做了一些常见的优化,包括 Chunk 切分优化、提取 FAQ、Query Rewrite、混合检索等。

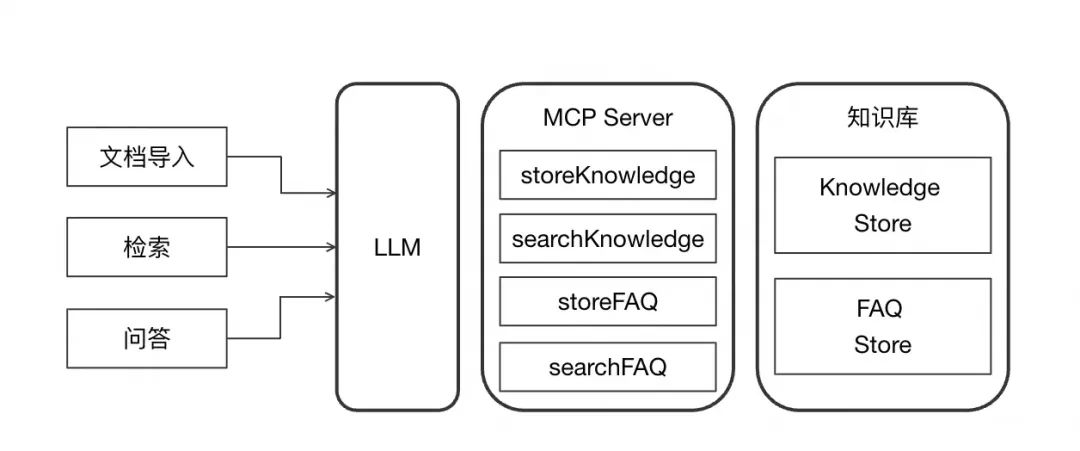

Agent 架构

整体架构分为三个部分:

1.知识库:内部包含 Knowledge Store 和 FAQ Store,分别存储文本内容和 FAQ 内容,支持向量和全文的混合检索。

2.MCP Server:提供对 Knowledge Store 和 FAQ Store 的读写操作,总共提供 4 个 Tools。

3.功能实现部分:完全通过 Prompt + LLM 来实现对知识库的导入、检索和问答这几个功能。

具体实现

所有代码开源在这里,分为两部分:

1.Python 实现的 Client 端:实现了与大模型进行交互,通过 MCP Client 获取 Tools,根据大模型的反馈调用 Tools 等基本能力。通过 Prompt 实现了知识库构建、检索和问答三个主要功能。

2.Java 实现的 Server 端:基于 Spring AI 框架实现 MCP Server,由于底层存储用的是 Tablestore,所以主体框架是基于这篇文章的代码进行改造。

知识库存储

知识库存储选择 Tablestore(向量检索功能介绍),主要原因为:

1.简单易用:仅一个创建实例步骤后即可开始使用,Serverless 模式无需管理容量和后续运维。

2.低成本:完全按量计费,自动根据存储规模水平扩展,最大可扩展至 PB 级。当然如果采用本地知识库肯定是零成本,但这里实现的是一个企业级、可通过云共享的知识库。

3.功能完备:支持全文、向量和标量等检索功能,支持混合检索。

MCP Server

实现了 4 个 Tools(具体注册代码可参考 TablestoreMcp),相关描述如下:

知识库构建

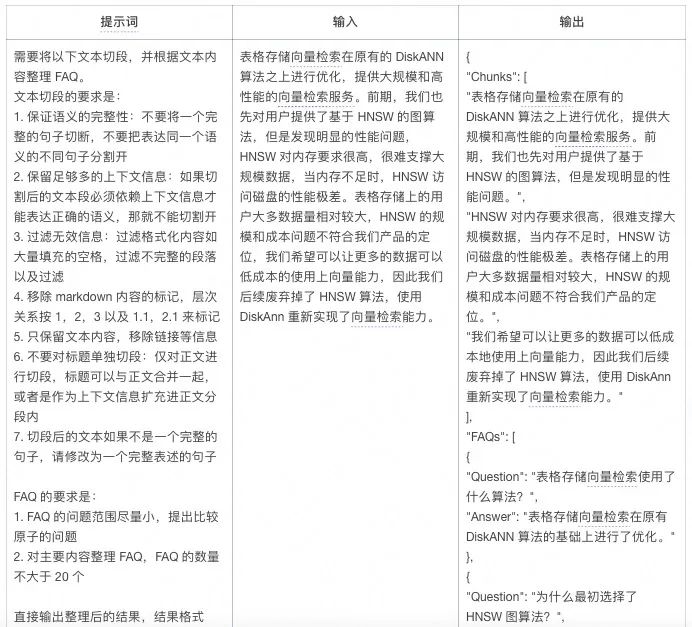

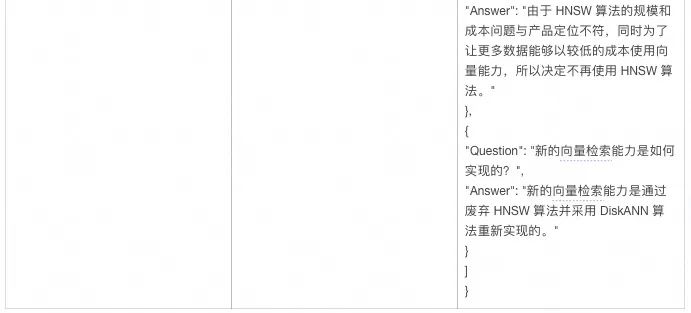

1、对文本进行切段并提取 FAQ

完全通过提示词来完成,可根据自己的要求进行调优。

以上是一个示例,可以看到通过大模型能比较准确的对文本进行切段并提取 FAQ。这种方式的优势是切段的文本能保证完整性以及语义一致性,能够比较灵活的对格式做一些处理。提取的 FAQ 很全面,对于简单问题的问答通过直接搜索 FAQ 是最准确直接的。最大的缺点就是执行比较慢并且成本较高,一次会消耗大量的 Token,不过好在是一次性的投入。

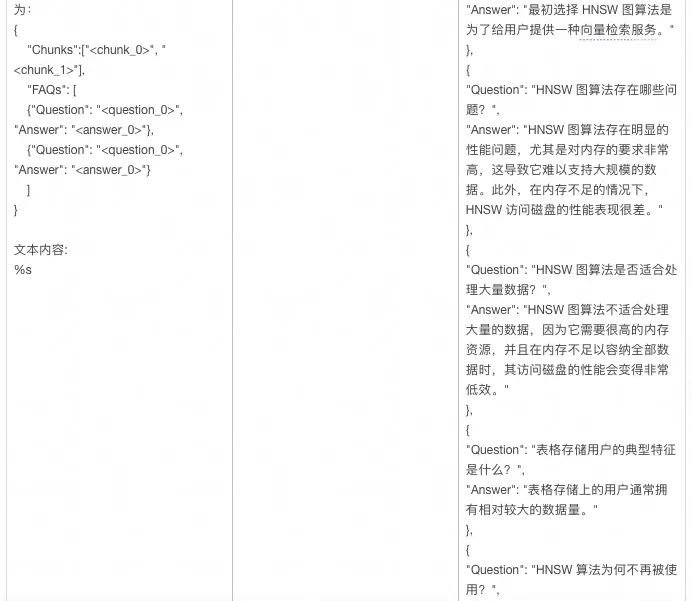

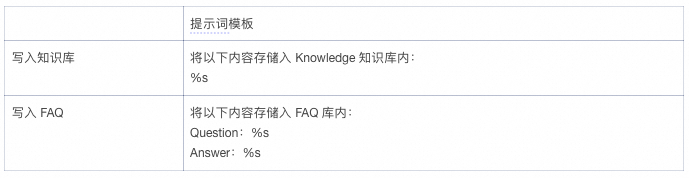

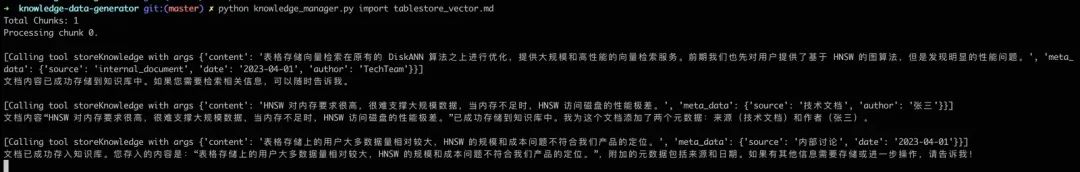

2、写入知识库和 FAQ 库

这一步也是通过提示词来完成,基于 MCP 架构可以非常简单的实现,样例如下:

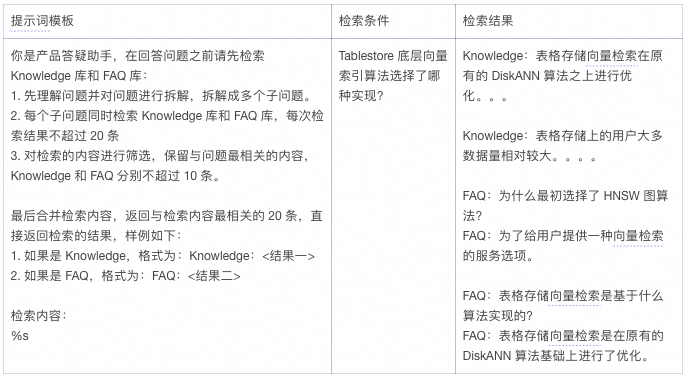

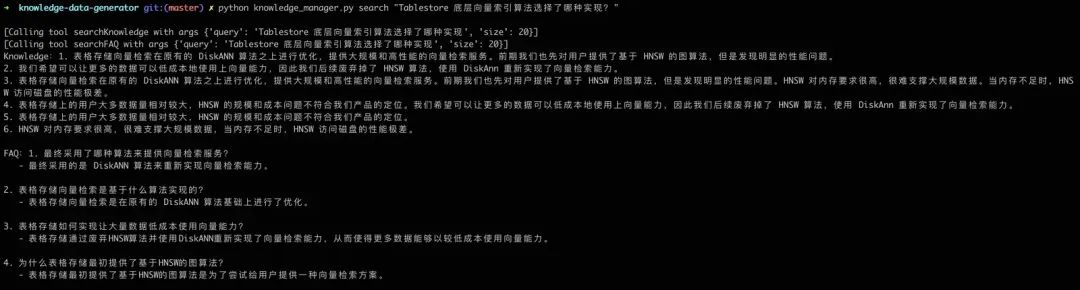

知识库检索

同样这一步也是通过提示词加 MCP 来实现,非常的简单,样例如下:

通过提示词描述实现了一个稍微复杂点的检索:

1.先对问题进行拆解,拆解为更原子的子问题。

2.每个子问题分别检索知识库和 FAQ,检索结果汇总后筛选留下与问题最相关的内容。

3.按照格式返回结果。

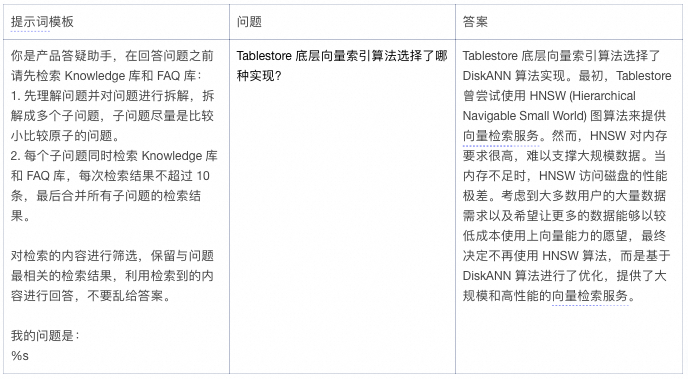

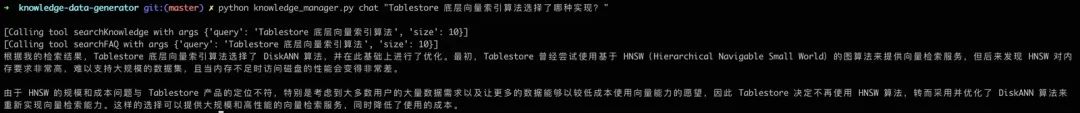

知识库问答

直接看下提示词和效果

从 MCP Server 的 Log 内可以看到自动调用了知识库和 FAQ 的检索工具,并能根据之前导入的内容进行回答。

演示

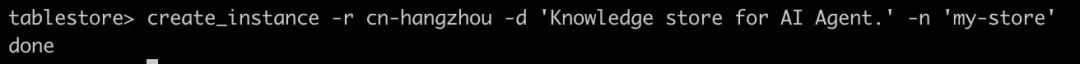

1、创建知识库存储实例

可通过命令行工具(下载地址)来创建 Tablestore 实例,参考这个文档先进行配置。

配置成功后执行以下命令进行实例创建,实例名自行选择,需要保证 Region 内唯一。

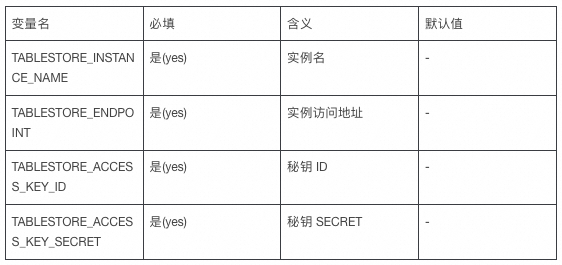

2、启动 MCP Server

启动前需要在环境变量内配置如下几个参数:

可参考代码库 README 内的步骤进行启动,也可将项目导入 IDE 后直接运行 App 这个类,启动后会自动初始化表和索引。

3、导入知识库

这一步需要执行代码库内的 knowledge_manager.py 工具,执行前需要先配置访问大模型的 API-KEY,默认采用 qwen-max。

export LLM_API_KEY=sk-xxxxxx

请自行准备知识库文档,使用 markdown 格式,执行如下:

4、检索知识库

执行如下:

5、基于知识库进行问答

最后

对应前言部分的观点,这一轮技术革命可以参考 Web 2.0 和移动互联网时代的技术发展,当某种新形态的应用开发需求爆发式增长,一定会催生新的开发框架和新的标准的建立。AI 应用的技术是能够完全构建在当前的技术框架之上,所以发展迭代的速度非常之快,很期待未来的发展。

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献62条内容

已为社区贡献62条内容

所有评论(0)