本地使用OLLAMA搭建大模型教程(DeepSeek)

本地使用OLLAMA搭建大模型教程(DeepSeek)

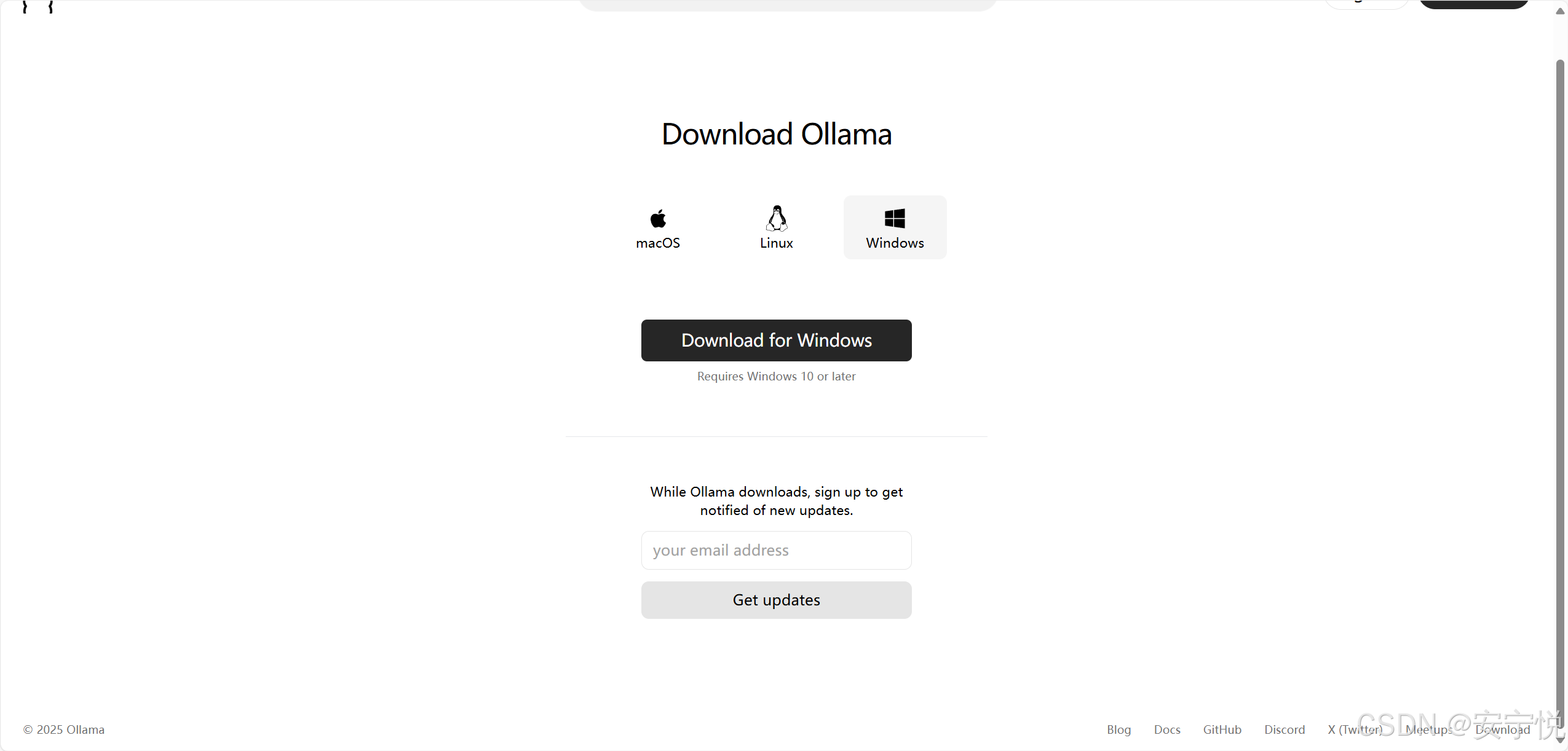

1.安装OLLAMA

进入ollama官网:Download Ollama on Windows,点击Download for Windows按钮即可下载(如果觉得下载慢可以看之前的文章三种快速下载OLLAMA的方法(任何版本都适用)-CSDN博客)

下载完之后,点击Install安装

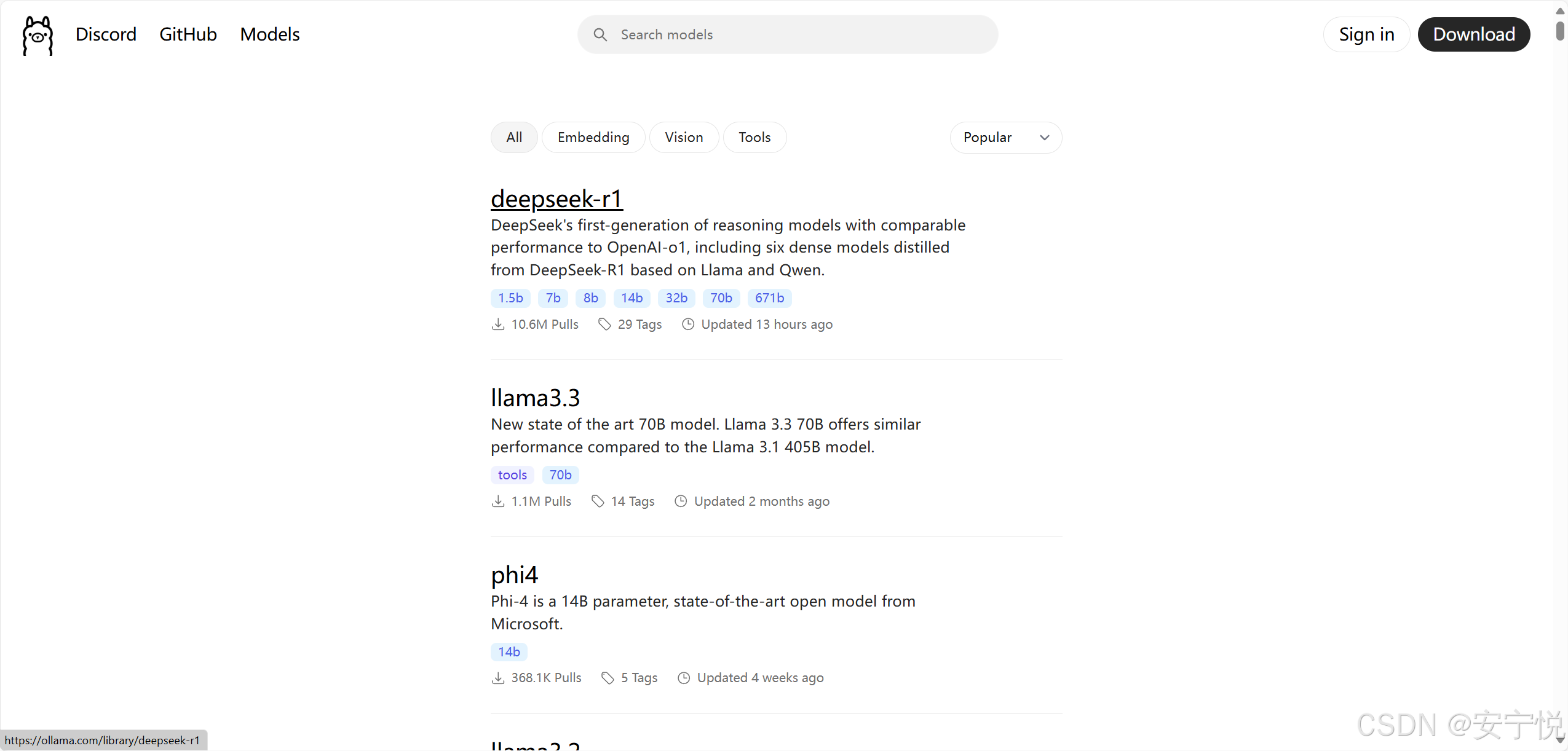

2.下载模型

进入ollama官网下载模型:Ollama模型库,下载 deepseek-r1 模型(演示下载的为7b版本,即下面蓝色字体中的 7b ,根据个人的电脑配置选择,初始可以选择下载1.5b版本的)

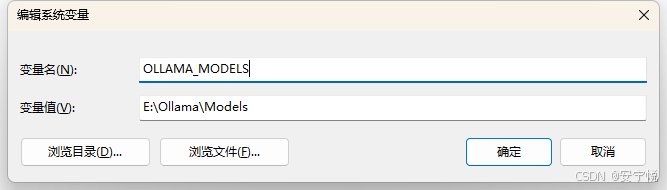

3.配置环境变量

增加一个环境变量名为OLLAMA_MODELS,路径选择自己放模型的目录(该环境变量的作用是告诉ollama存放模型文件的地址)

4.运行ollama

一般安装之后任务栏中就会出现ollama软件的图标,如果没有的话就找到ollama点击运行即可

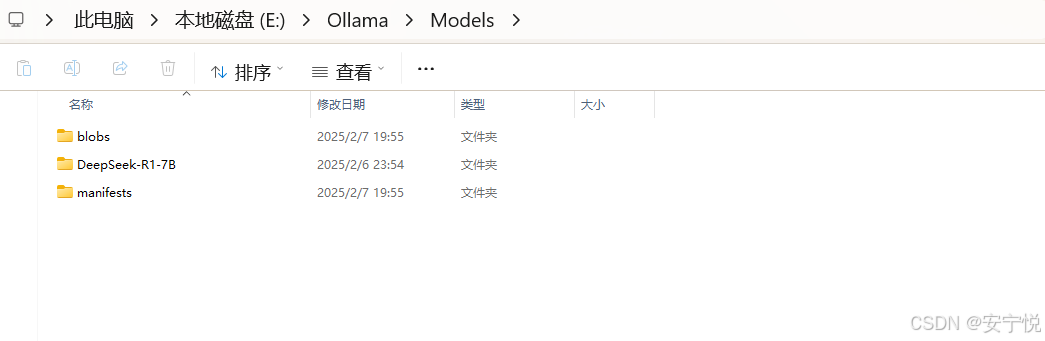

5.配置模型

进入存放模型的目录,将之前下载的模型放在了DeepSeek-R1-7B中

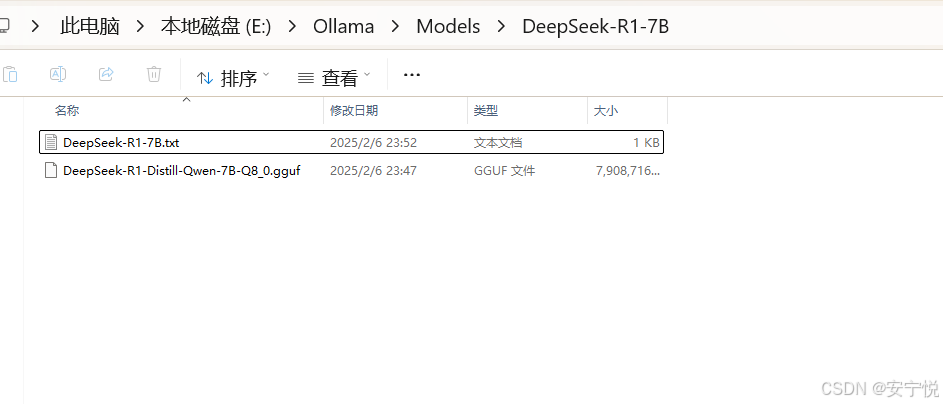

该目录下面只存放两个文件一个是模型的配置文件,一个是下载的模型

重点的是DeepSeek-R1-7B.txt中的配置,该配置除了FROM后面的路径,其余基本通用,想要更适合自己电脑的话也可以自己调整

# 设置模型路径

FROM ./DeepSeek-R1-Distill-Qwen-7B-Q8_0.gguf

# 设置模型配置参数

PARAMETER temperature 0.7

PARAMETER top_p 0.95

PARAMETER top_k 40

PARAMETER repeat_penalty 1.1

PARAMETER min_p 0.05

PARAMETER num_ctx 1024

PARAMETER num_thread 4

PARAMETER num_gpu 8

# 设置对话终止符

PARAMETER stop "<|begin▁of▁sentence|>"

PARAMETER stop "<|end▁of▁sentence|>"

PARAMETER stop "<|User|>"

PARAMETER stop "<|Assistant|>"

SYSTEM """

"""

TEMPLATE """{

{- if .System }}{

{ .System }}{

{ end }}

{

{- range $i, $_ := .Messages }}

{

{- $last := eq (len (slice $.Messages $i)) 1}}

{

{- if eq .Role "user" }}<|User|>{

{ .Content }}

{

{- else if eq .Role "assistant" }}<|Assistant|>{

{ .Content }}{

{- if not $last }}<|end▁of▁sentence|>{

{- end }}

{

{- end }}

{

{- if and $last (ne .Role "assistant") }}<|Assistant|>{

{- end }}

{

{- end }}"""6.启动模型

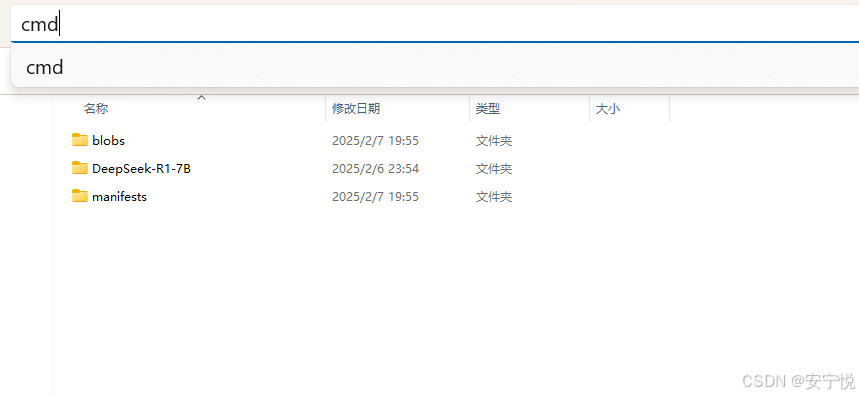

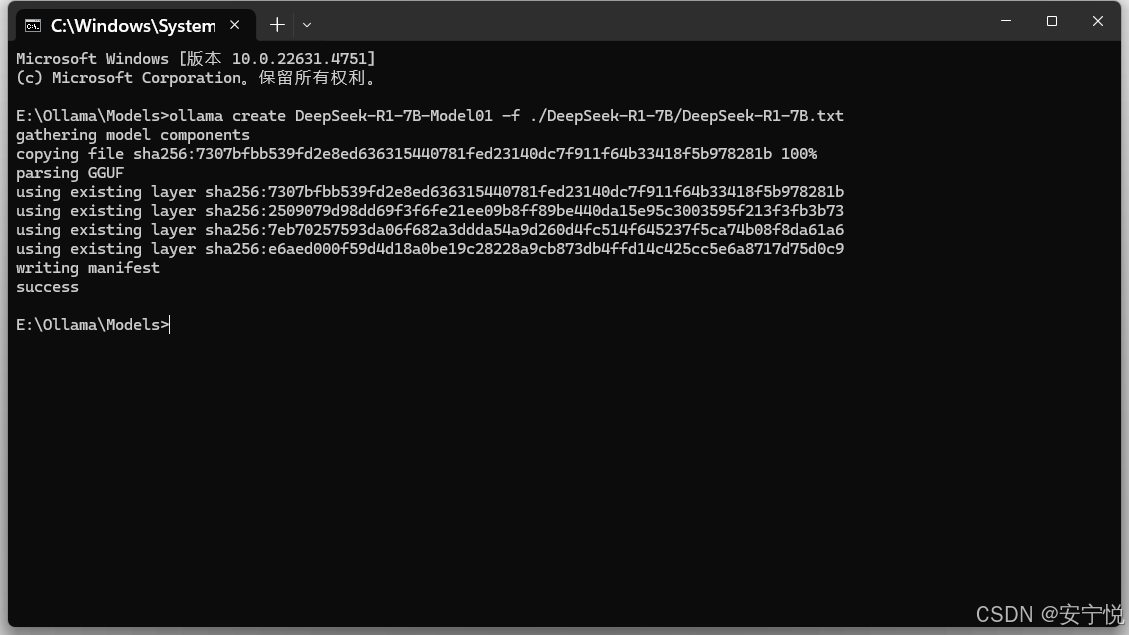

在环境变量设置的目录进入cmd

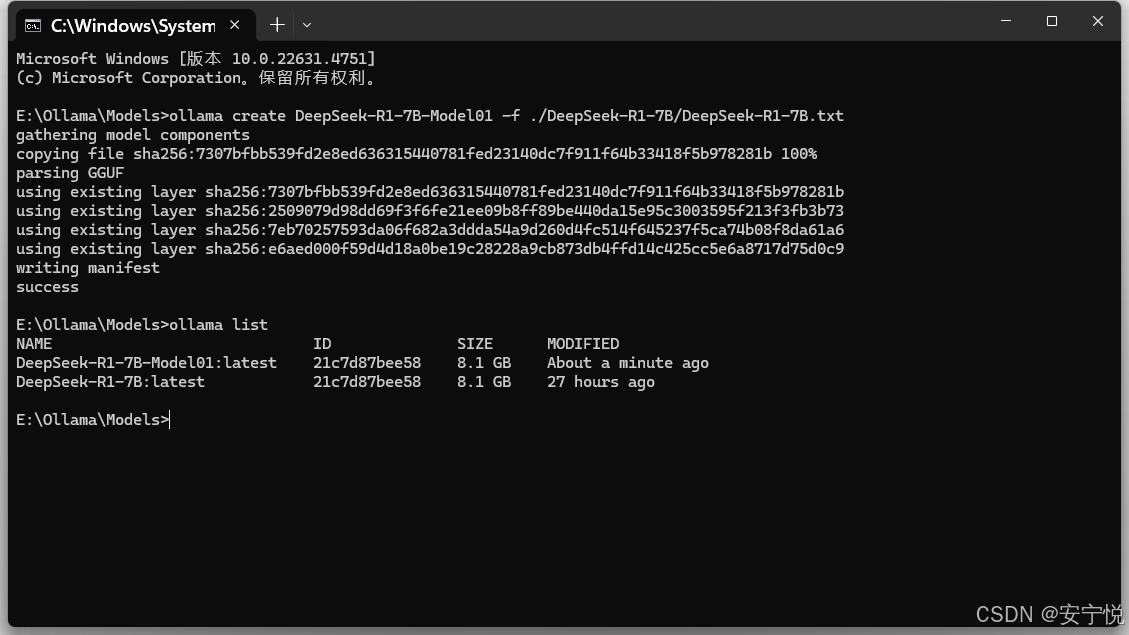

使用ollama create {yourModelName} -f {yourModelFile}命令创建模型(ollama create DeepSeek-R1-7B -f ./DeepSeek-R1-7B/DeepSeek-R1-7B.txt),出现success就代表创建成功了

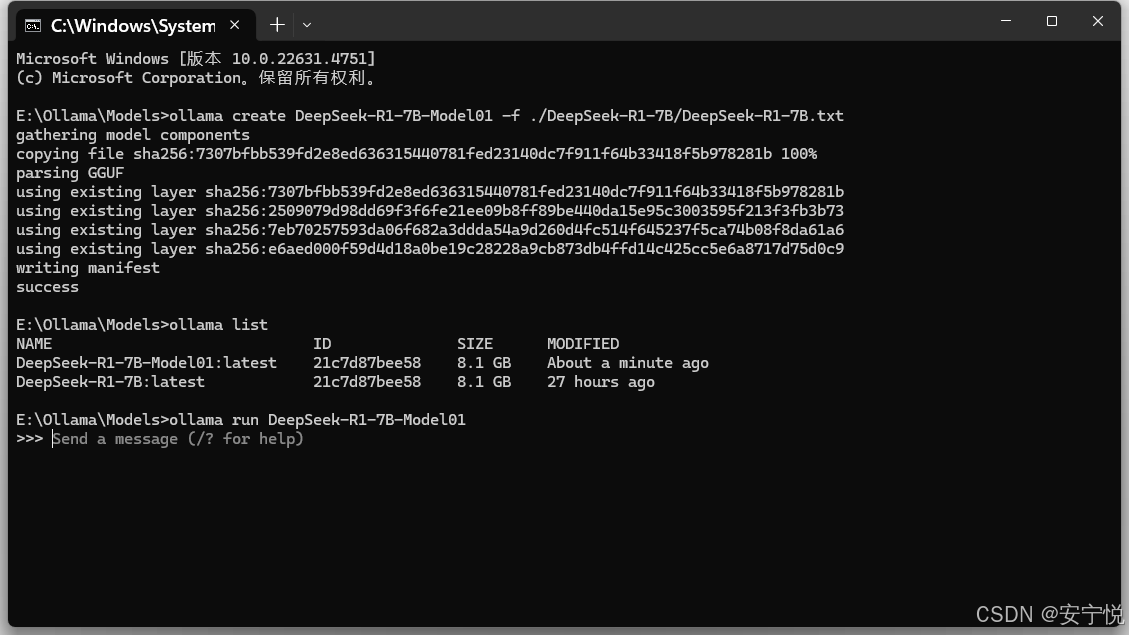

这时使用ollama list命令查看创建的模型,会出现刚刚命令中写的ModelName

接下来使用ollama run {yourModelName}(ollama run DeepSeek-R1-7B-Model01),就会出现一个对话框,接下来就可以开始对话使用了

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)