用 DeepSeek R1 卡顿?三种方案帮你来解决!(含本地部署)学会20天赚一万五

春节前,DeepSeek 发布了V3 和深度思考 R1版本,火出了圈。线上服务受到大规模恶意攻击,攻击手段复杂多样,包括暴力破解攻击和分布式拒绝服务攻击。整个过年期间,好多朋友在使用DS的官方App和网页的时候,多次遇到“服务器繁忙,请稍后重试”的错误提示。虽然这两天情况有所好转,但是我们有没有办法用上流畅的DS呢?既然 DeepSeek 系列大模型都是开源的,那不如换个思路,用算力资源部署的DS

春节前,DeepSeek 发布了V3 和深度思考 R1版本,火出了圈。线上服务受到大规模恶意攻击,攻击手段复杂多样,包括暴力破解攻击和分布式拒绝服务攻击。

整个过年期间,好多朋友在使用DS的官方App和网页的时候,多次遇到“服务器繁忙,请稍后重试”的错误提示。

虽然这两天情况有所好转,但是我们有没有办法用上流畅的DS呢?

既然 DeepSeek 系列大模型都是开源的,那不如换个思路,用算力资源部署的DS的大模型就可以了。介绍三种方案如何部署自己的DS:

一、使用国内云厂家计算资源快速部署;

二、使用本地资源手动部署;

三、直接使用大模型云服务平台提供的服务。

01

—

腾讯云快速部署

微软、英伟达、亚马逊云科技等在1月底就已接入 DeepSeek。国内的大厂腾讯云、百度智能云、阿里云也在春节假期为深度求索公司加班,先后接入DeepSeek相关大模型。

云平台限时免费开放了 DeepSeek 模型的在线体验,支持 DeepSeek-R1 和 DeepSeek-R1-Distill-Qwen-1.5B 两款模型。

想白嫖的,可以开通一个腾讯云账号,在这个页面免费流畅的跟DS R1大模型对话。

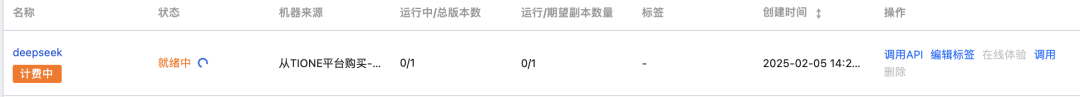

点击“新建在线服务”,机器来源选择“从 TIONE 平台购买-按量计费”,模型默认是一个小模型,可以选“R1-671B”,算力规格选择的最低:12C44G A10*1。

计费模式选择按量计费,这样的配置为11.17元/小时,启动服务会先冻结2个小时的费用。

更多细节和规则可以参考官方的帮助文档:

https://cloud.tencent.com/document/product/851/115962?from=25520

启动服务后,跳转至在线服务列表页面,最右边的“调用”可以查看大模型服务被调用的数据情况。

服务创建好之后,可以使用第三方应用开发工具来调用DS的API接口了。

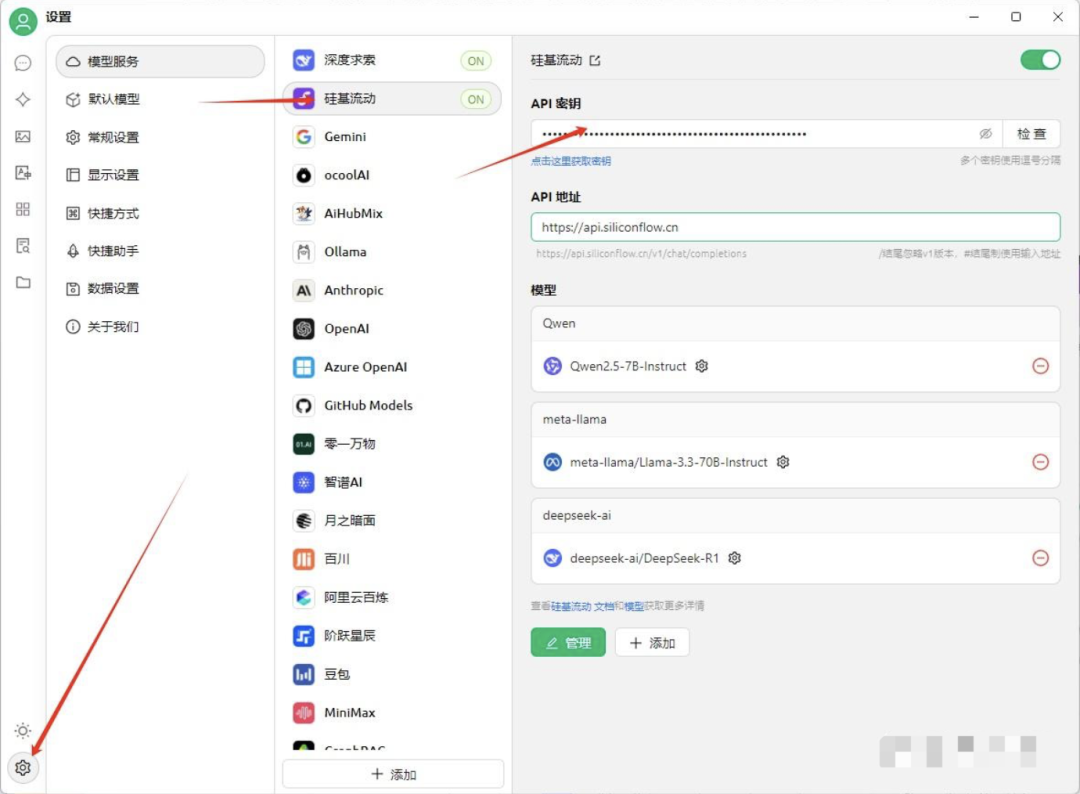

云计算的文档推荐了 Cherry Studio,它是一个支持多模型服务的开源桌面客户端,可以将多服务集成至桌面 AI 对话应用中。

下载地址:

https://github.com/CherryHQ/cherry-studio/releases

配置教程:https://cloud.tencent.com/document/product/851/115962?from=25520

02

—

本地部署

有朋友说淘宝上有本地部署的教程在卖,一份卖 25 元,已经售出 600 多份,大概有 15000 元。而从官方发布大模型在1月20日,到现在也就是20多天。

Ollama 是一款在本地环境中运行和管理大型语言模型(LLMs)的开源工具。它为开发者、研究人员和爱好者提供了一个高效、易用的平台,能够快速实验、管理和部署最新的大语言模型。

官网:https://ollama.com/download/mac

之前写了一篇部署LLama3的帖子,有兴趣的朋友可以看看Ollama的下载和安装:普通电脑也能跑大模型,三步搞定私人AI助手 | LLaMA-3本地部署小白攻略

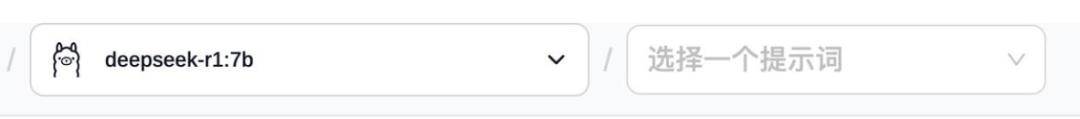

Ollama 已经支持 deepseek 的全尺寸版本,比如说 1.5b、7b、8b、14b 等,本地建议安装 7b 版本。MAC的m1芯片可以带得动。

下载安装完成后,在控制台输入

ollama run deepseek-r1:7b回车运行,就会开始自动拉取模型。耐心等一下,模型拉取完成后,就可以开始使用了。

03

—

硅基流动

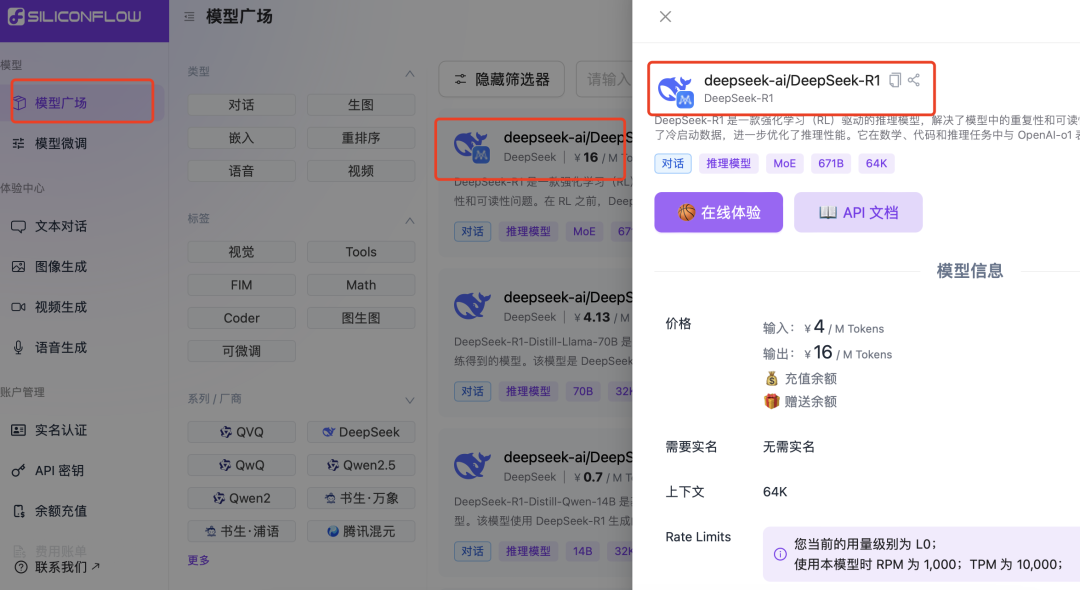

硅基流动(Siliconflow)是专门提供开源模型 API 云服务的平台。

新用户注册即得14元免费额度(相当于2千万Qwen1.5-14B tokens)。

https://cloud.siliconflow.cn/i/CMCLjBtg,朋友们可以直接用我的邀请链接注册。

注册登录进去后,可以看到第一个模型就是DS。

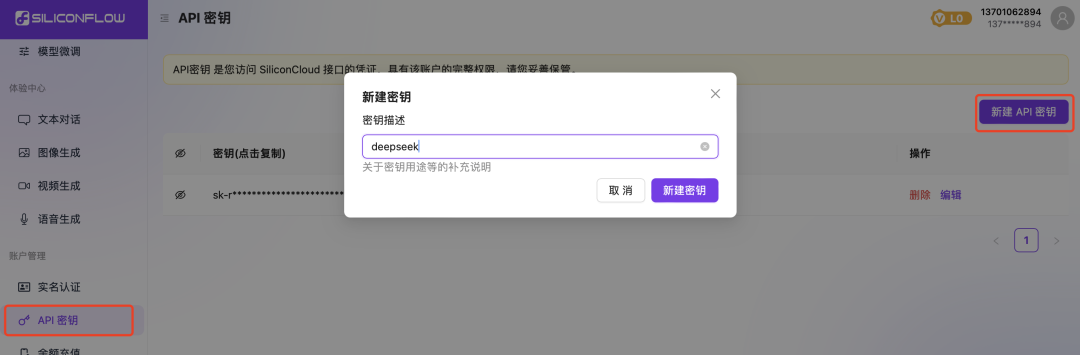

点击右侧的“账户管理”,“API密钥”,创建好自己的API密钥,描述随便写。

后面就是使用前面提到的Cherry Studio配置密钥。

配置完成后,选择大模型为DS即可。

几种方案的对比总结:

一、官方

优点:功能齐全、操作简单(深度思考/联网搜索)

缺点:高峰期易崩溃。

二、三方平台+大模型Chat软件(腾讯云、硅基流动等)

优点:规避官方崩溃风险,国产GPU加速或白嫖算力

缺点:对小白不友好,需要一定的配置能力,对话记录不保留等。

三、本地部署

优点:隐私性强、永久离线,定制化模型选择

缺点:依赖硬件性能(需高配电脑),技术门槛较高,部署的是蒸馏版本。

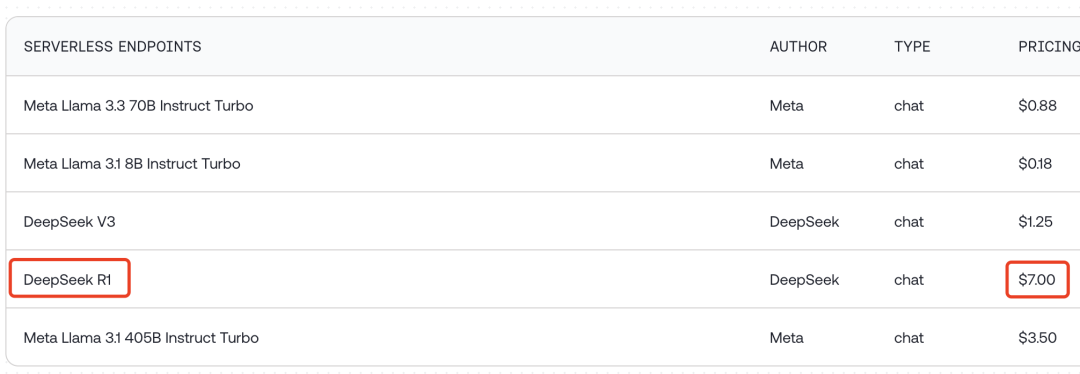

最后,送一个海外的大模型集合平台:Together AI,实测响应速度比官网还快。羊毛已经被薅得从开始的注册送5美元现在改成只送1美元了。

官网:https://www.together.ai/

(完)

如果觉得不错,就来个点个赞、在看、转发三连。谢谢你看我的文章。

往期热门文章推荐:

DeepSeek真的有那么强?|特朗普执政对中美关系以及中国经济的影响

一场关于DeepSeek的高质量闭门会:比技术更重要的是愿景

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)