项目实训(一)——部署deepseek-r1

本地成功部署 deepseek-r1 记录

在进行项目实训的过程中,我需要开发一个团队代码管理器,为了实现一些功能需求,今天成功在本地部署了 deepseek-r1 模型。以下是详细的部署步骤和相关记录,希望能对有同样需求的小伙伴有所帮助。

一、ROCm 环境配置

ROCm 环境是部署 deepseek-r1 模型的重要基础,以下是具体的配置步骤:

-

参考文档:

-

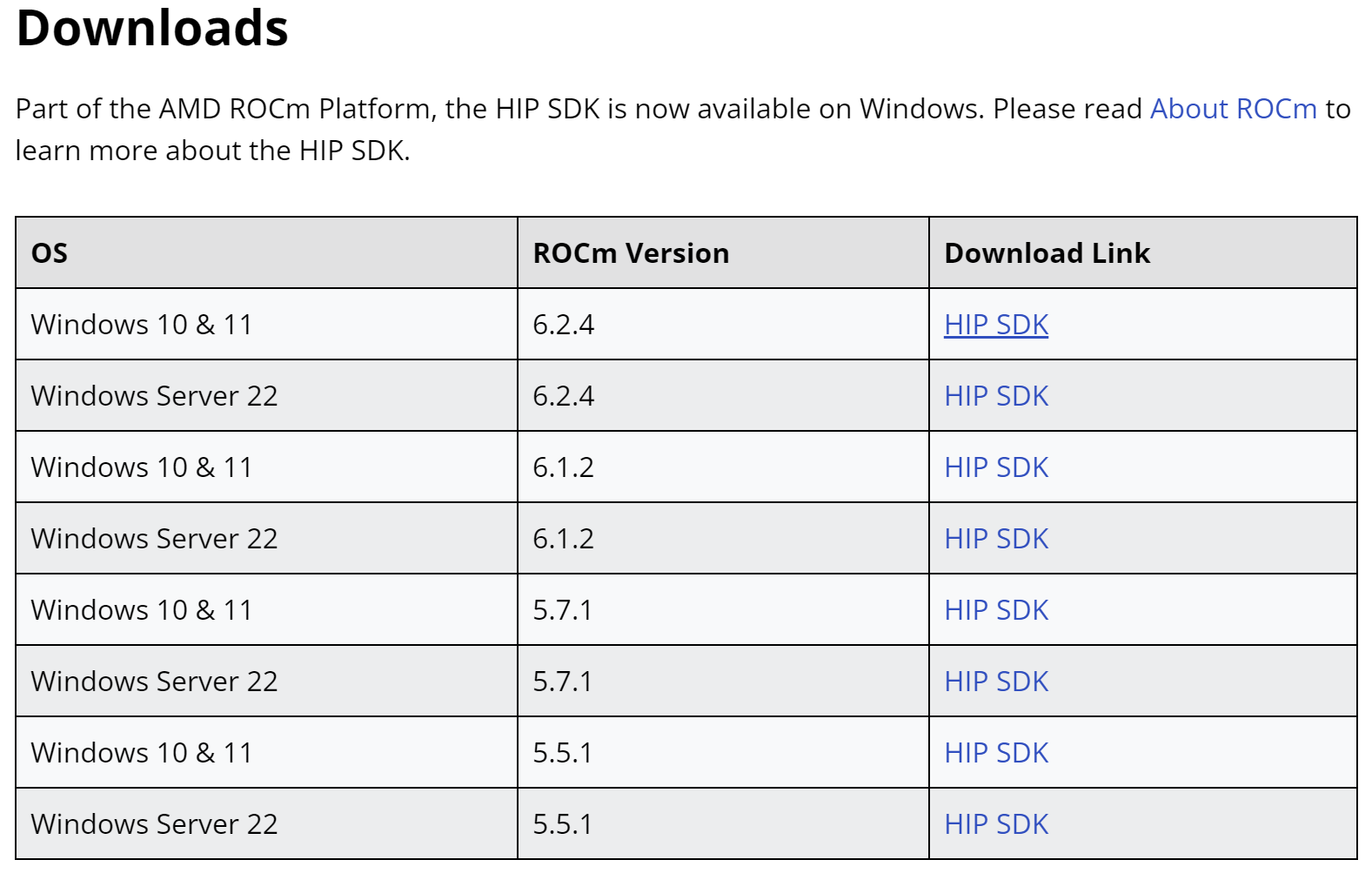

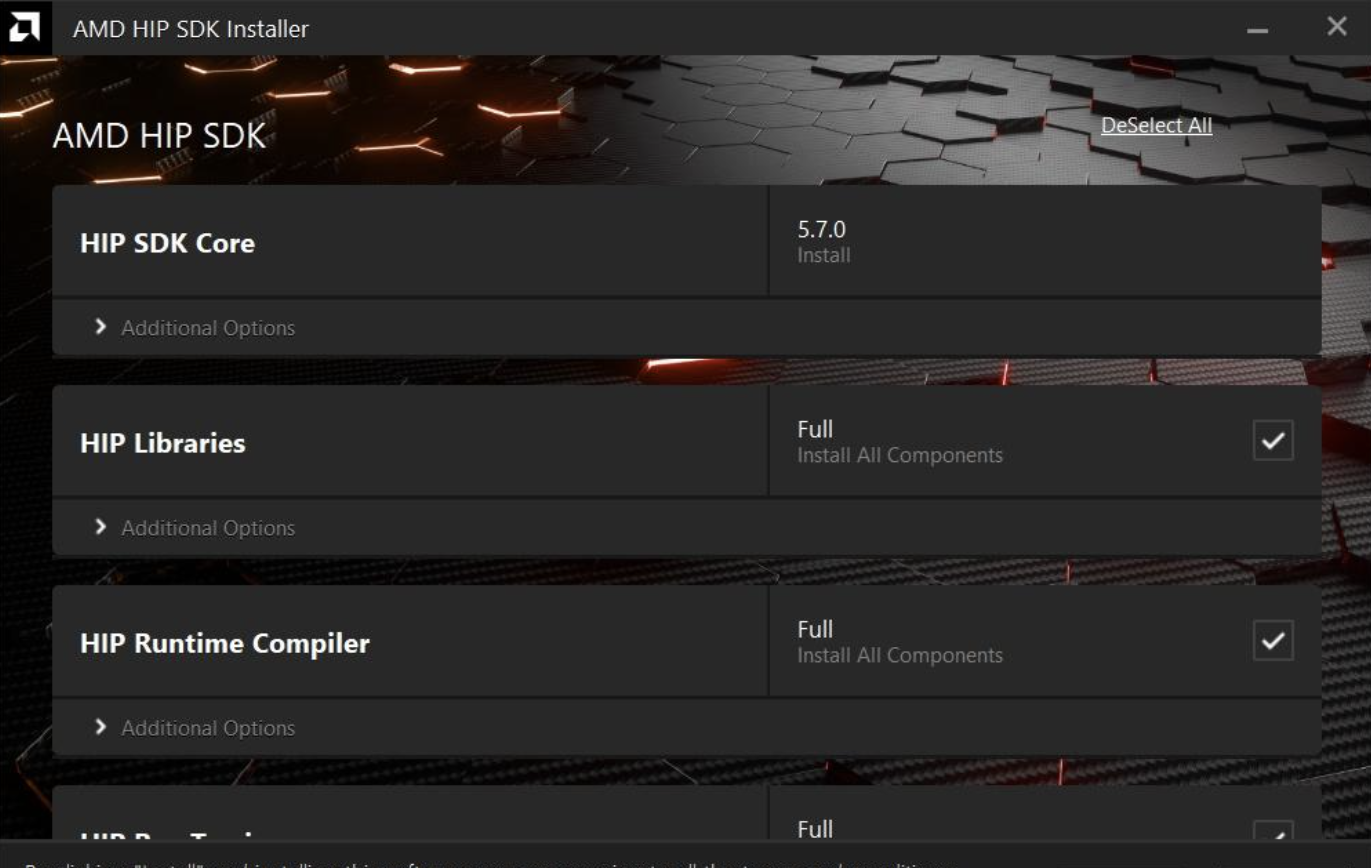

下载 HIP SDK:

- 前往https://www.amd.com/en/developer/resources/rocm-hub/hip-sdk.html,选择 6.2.4 版本进行下载。按照文档中的指引完成 HIP SDK 的安装,确保安装过程中没有出现错误提示。

- 前往https://www.amd.com/en/developer/resources/rocm-hub/hip-sdk.html,选择 6.2.4 版本进行下载。按照文档中的指引完成 HIP SDK 的安装,确保安装过程中没有出现错误提示。

二、ollama 安装和配置

-

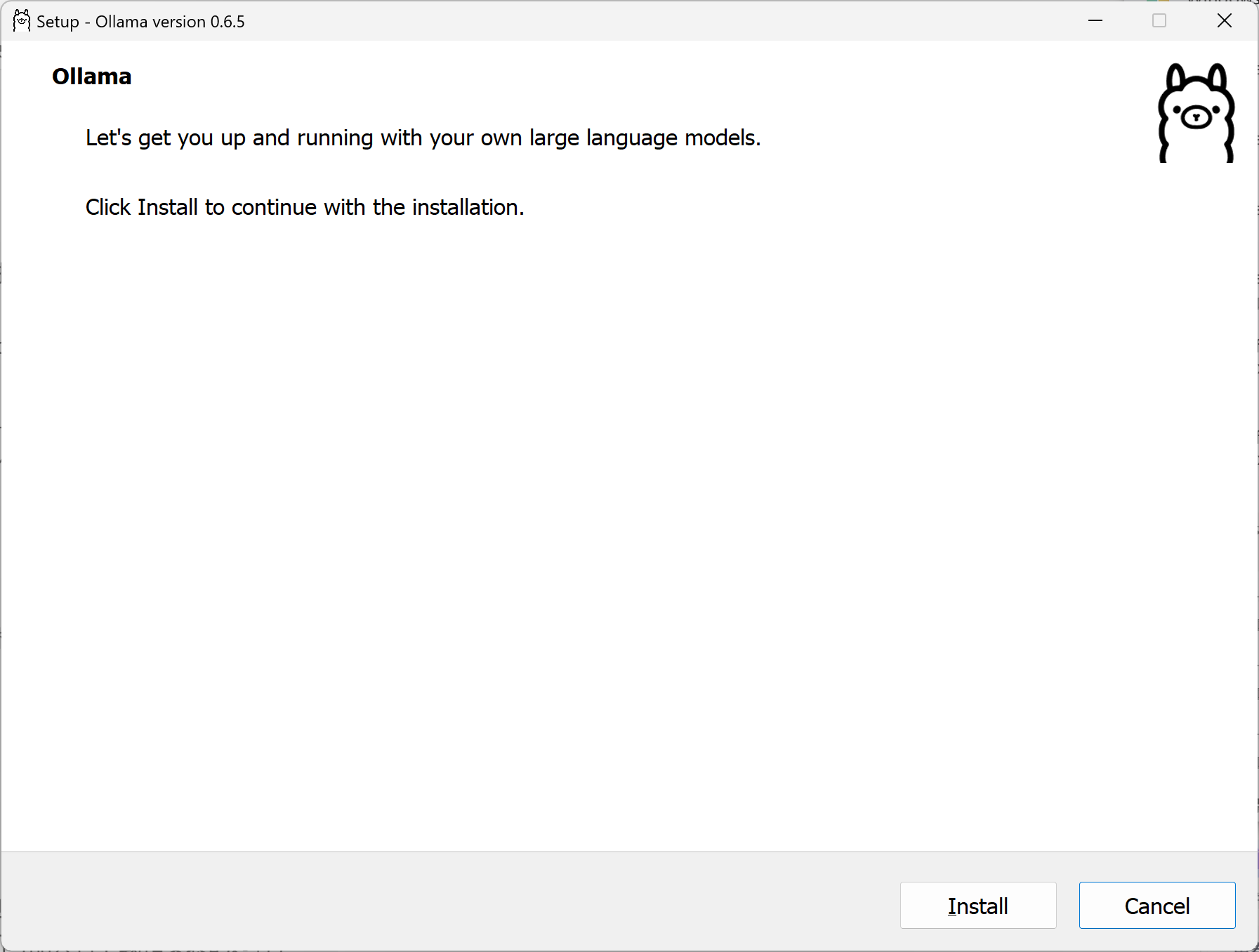

下载和安装 ollama:

首先下载 ollama 软件,然后按照安装向导的提示完成安装过程。安装过程中注意选择合适的安装路径和相关配置选项。

官网安装网址:https://ollama.com/download

(Ollama 是一个开源框架,专为在本地机器上便捷部署和运行大型语言模型(LLM)而设计。Ollama本身没有前端,所以安装之后点击图标无法显示出一个应用界面是正常的)

-

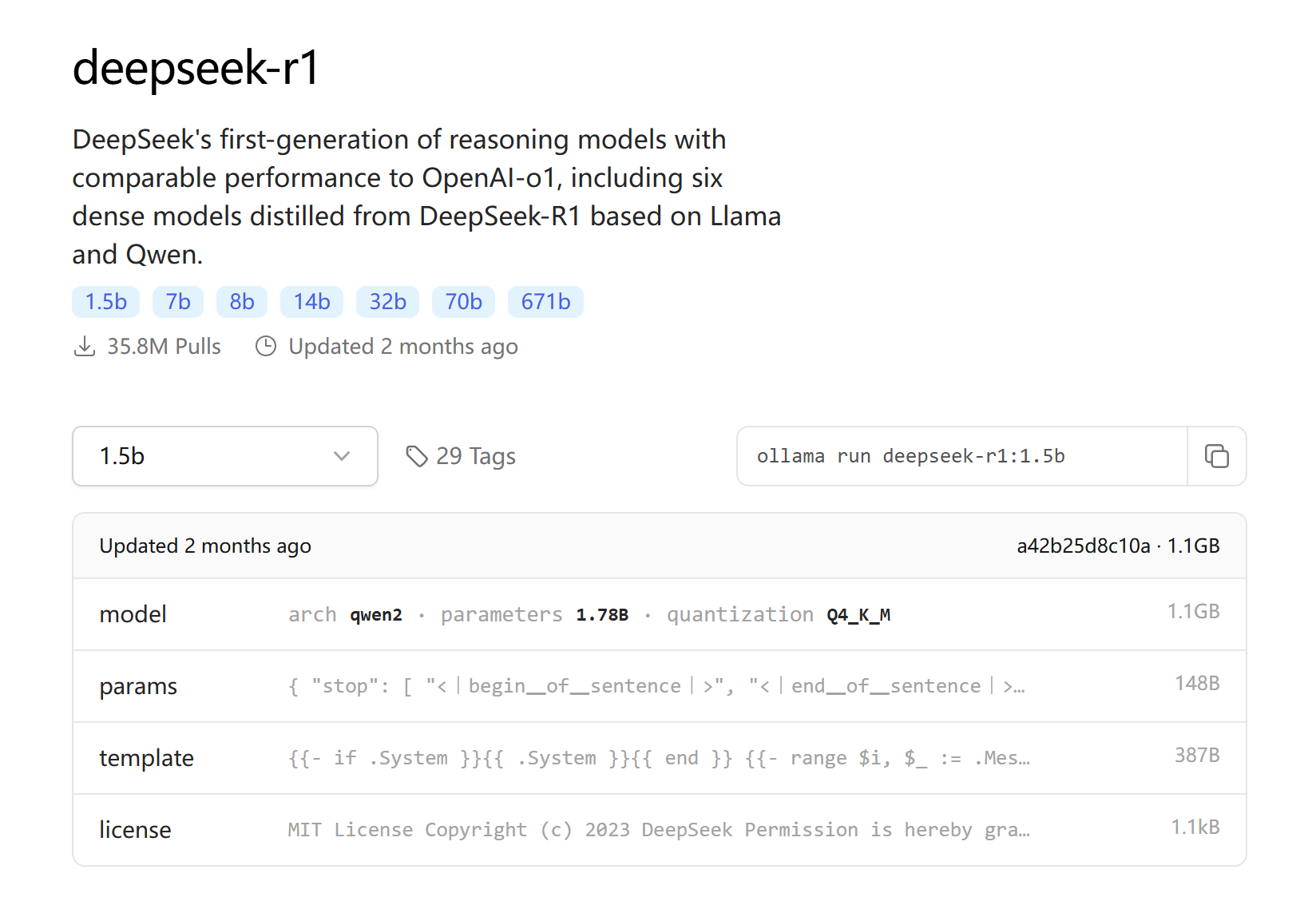

模型下载:

打开 ollama 软件后(https://ollama.com/library/deepseek-r1),点击“models”选项,在模型列表中选择 deepseek-R1 模型。由于我们先进行测试,所以选择最小的 1.5b 模型。复制该模型的安装命令,以便后续使用。

三、本地部署运行

- 打开 cmd 执行命令:

打开命令提示符(cmd)窗口,粘贴之前复制的 deepseek-R1 模型 1.5b 的安装命令,然后执行。等待命令执行完成,期间可能会有下载和安装的过程,耐心等待。安装完成后,执行 run 命令启动模型。

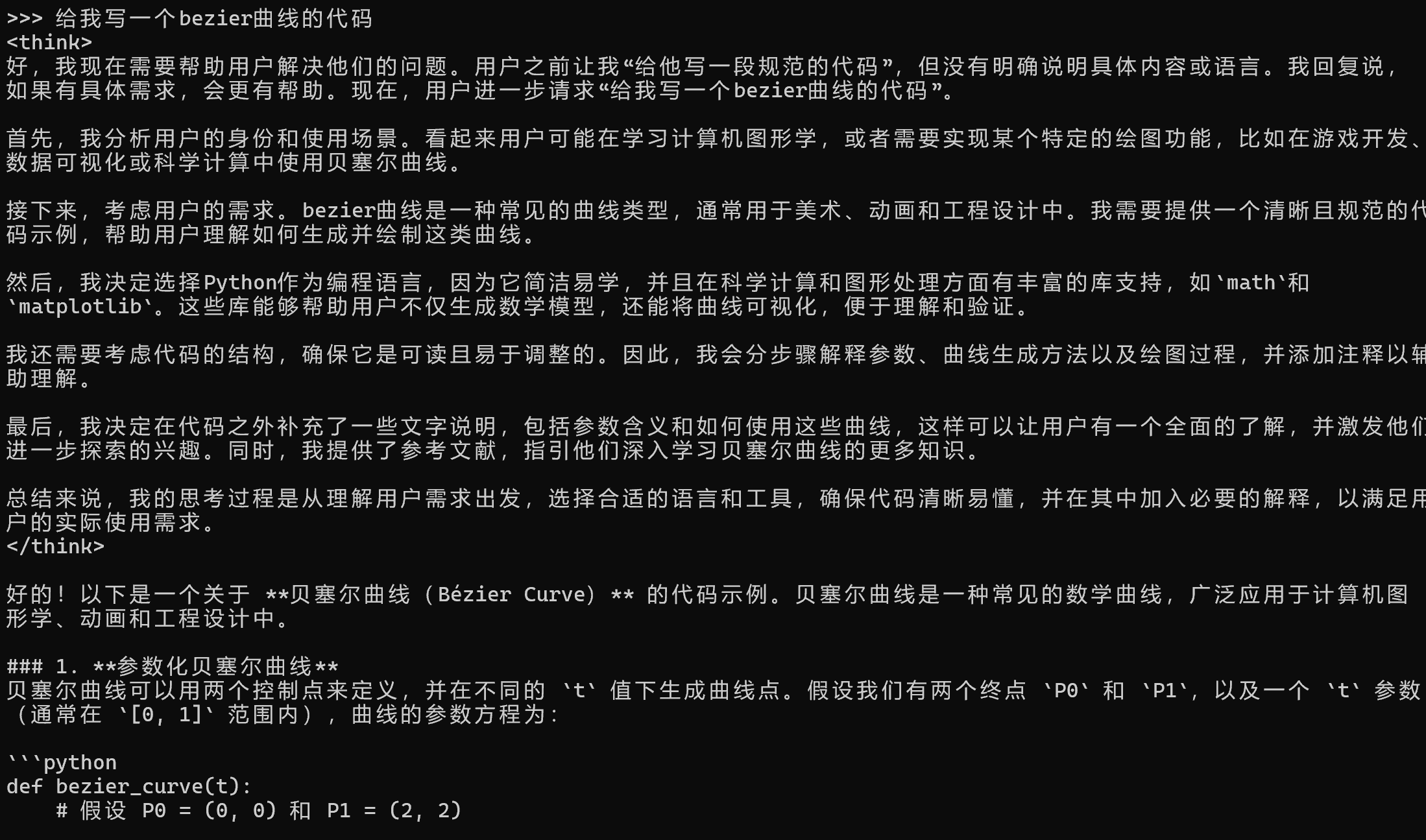

四、本地使用验证

使用 1.5b 的模型进行测试,验证模型是否能够正常运行和响应。可以输入一些简单的指令或问题,观察模型的输出结果是否符合预期。如果出现错误,根据错误提示信息进行排查和解决。

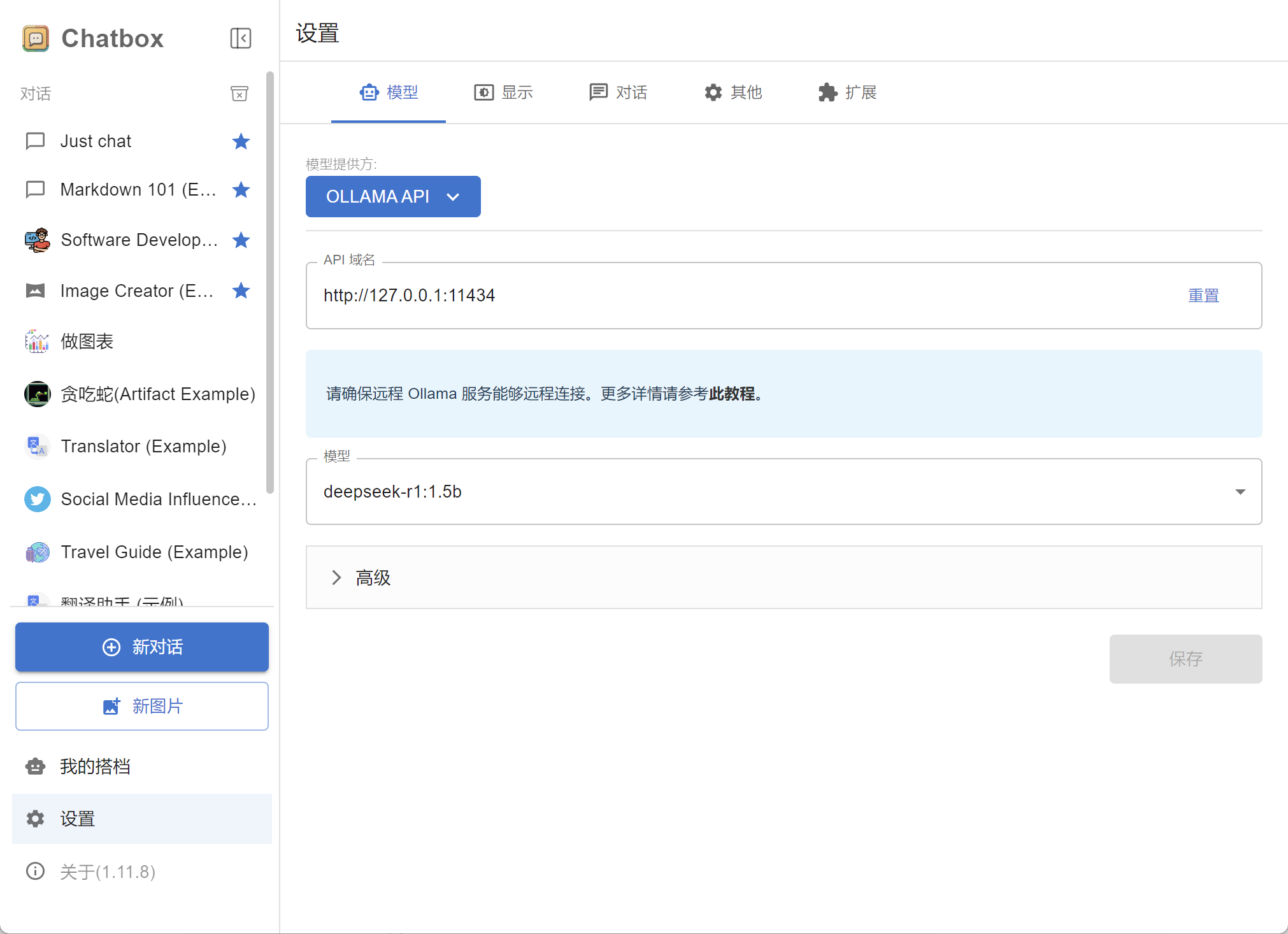

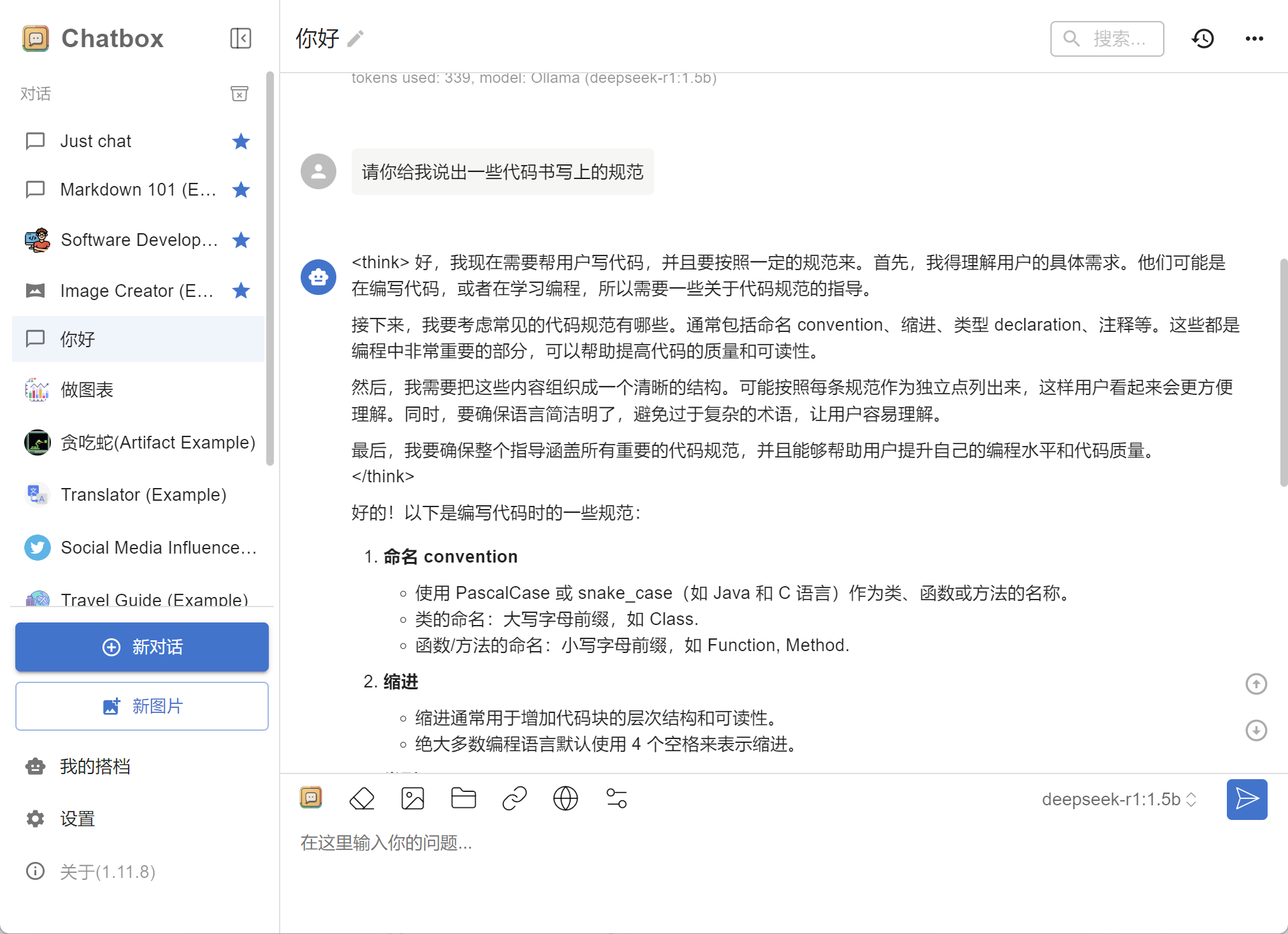

五、客户端配置

为了更方便地使用模型,我们可以选择一个有 UI 的客户端。这里推荐使用https://chatboxai.app/zh。

-

下载安装客户端:

前往上述链接,下载客户端软件并按照安装向导进行安装。 -

配置模型:

安装完成后,打开客户端软件,找到模型配置选项,选择我们之前安装的 deepseek-R1 1.5b 模型。配置完成后,就可以通过客户端方便地与模型进行交互了。

(注意:这里选择的是OLLAMA API,而不是Deepseek API)

通过以上步骤,我成功在本地部署了 deepseek-r1 模型,并进行了初步的使用验证和客户端配置。在部署过程中,可能会遇到各种问题,需要耐心地根据文档和错误提示进行排查和解决。希望这篇记录能对大家有所帮助,后续我还会继续探索该模型在团队代码管理器项目中的应用。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)