Windows+deepseek+ollama本地部署

DeepSeek是一家专注于大语言模型的研究和开发的公司,他们提供了多种AI工具,包括Ollama,这是一个开源的LLM框架。DeepSeek可能提供了一些基于Ollama的服务或解决方案,帮助用户在本地部署这些模型。

Windows+deepseek+ollama本地部署

- 下载安装Ollama客户端,支持Windows/Linux/macOS

- 通过命令行拉取模型(如ollama run deepseek-r1:8b)

参考博客

注意事项

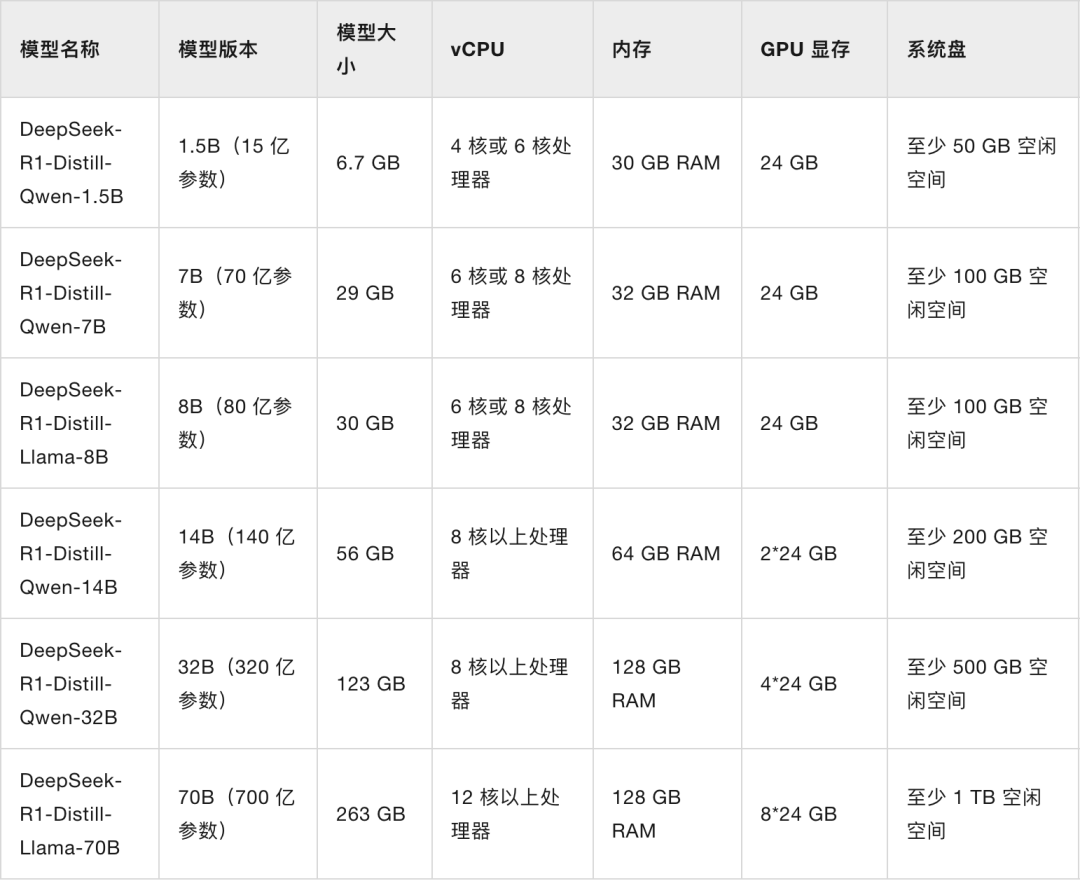

1.需要的环境Windows10+,内存16g以上

1.ollma

1.0 介绍

DeepSeek是一家专注于大语言模型的研究和开发的公司,他们提供了多种AI工具,包括Ollama,这是一个开源的LLM框架。

DeepSeek可能提供了一些基于Ollama的服务或解决方案,帮助用户在本地部署这些模型。

1.1 ollama快速下载地址

https://lestore.lenovo.com/

1.2 安装流程

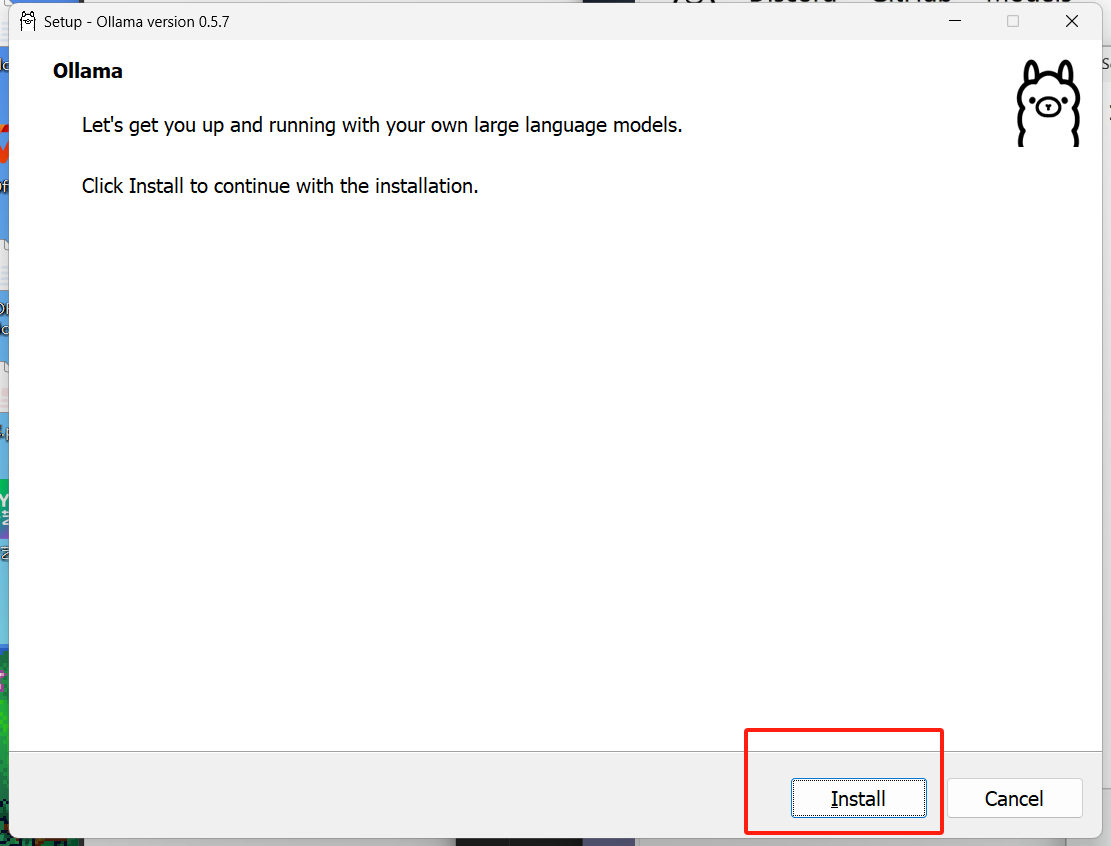

上一步下载好exe文件

点击install安装,默认是c盘目录

C:\Users\Administrator\AppData\Local\Programs\Ollama

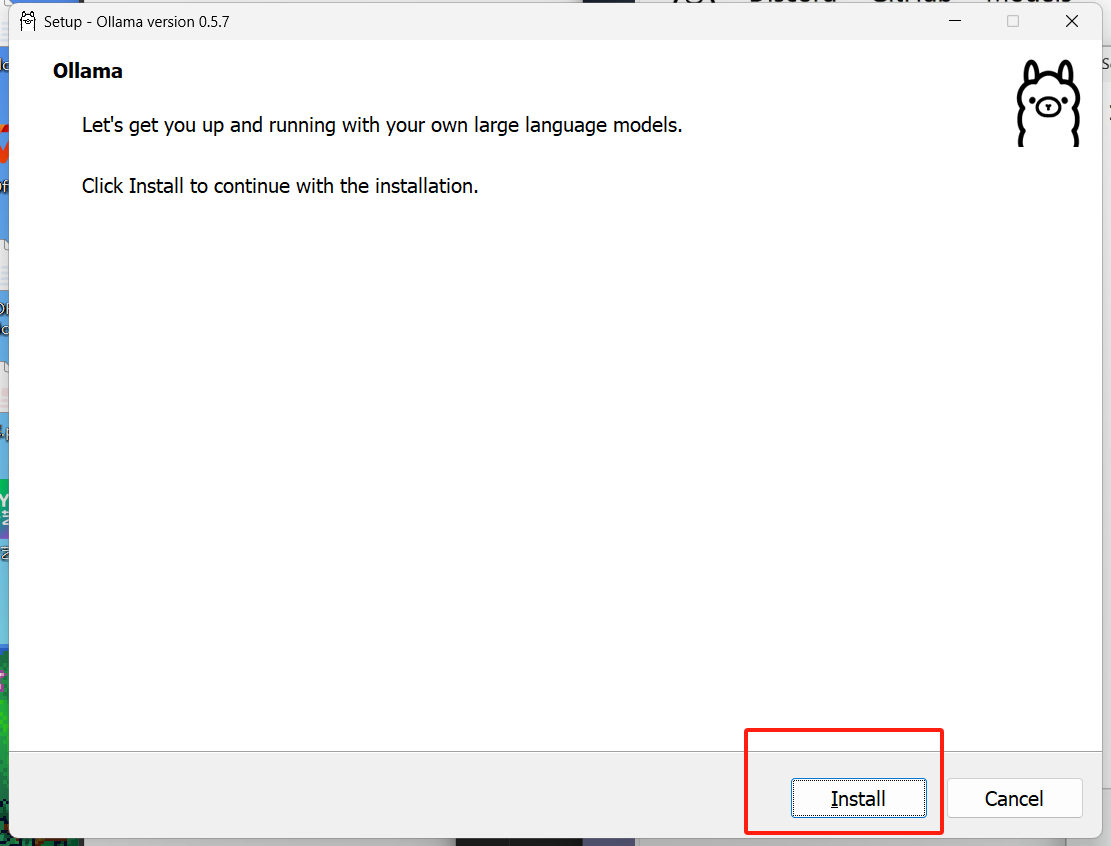

安装成功看一下效果

命令行查看一下ollama

ollama -v

PS C:\Users\Administrator> ollama -v

ollama version is 0.6.3

2.部署模型

接下来我们进行部署DeepSeek R1模型的操作

打开ollama官网,https://ollama.com/

点击左侧上方的Models,找到deepseek-r1,复制命令

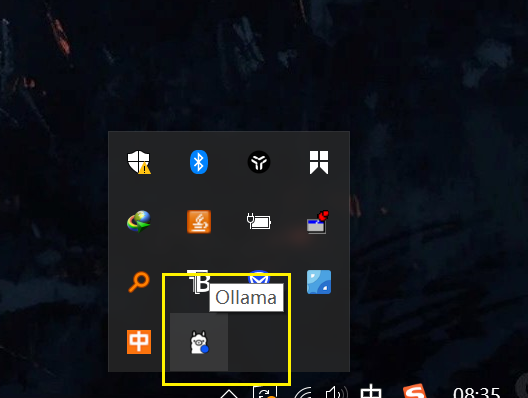

ollama run deepseek-r1

在Windows系统,打开cmd,复制刚才的命令

如果你的下载速度很慢的话,你可以CTRL+C先退出这个命令,然后再输入命令重新进行下载,还是会从上次的下载进度继续下载的,我这里重新下载了,可以发现速度快了些了。

如果最后一行出现success,表示部署成功

那么我们就可以直接进行对话了,如果想退出对话的话,我们可以输入/bye来退出对话。

但是我们现在想重新进入到对话的话,我们可以输入命令ollama list重新查看我们已经下载好了的模型,那么我们可以发现这里的R1 7B是我们刚刚下载好的模型

PS C:\Users\Administrator> ollama list

NAME ID SIZE MODIFIED

deepseek-r1:latest 0a8c26691023 4.7 GB 10 hours ago

下次复制这个名称,deepseek-r1:latest,运行 ollama run deepseek-r1:latest

PS C:\Users\Administrator> ollama run deepseek-r1:latest

>>>Send a message (/? for help)

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)