AI算法与图像处理 | DeepSeek接入本地知识库!

无论大模型能力有多强,在回答人类提问时或多或少都会存在胡说八道的情况,也就是我们所说的幻觉(Hallucination)。这段时间爆火的DeepSeek当然也会存在这类问题。

本文来源公众号“AI算法与图像处理”,仅用于学术分享,侵权删,干货满满。

原文链接:DeepSeek接入本地知识库!

无论大模型能力有多强,在回答人类提问时或多或少都会存在胡说八道的情况,也就是我们所说的幻觉(Hallucination)。这段时间爆火的DeepSeek当然也会存在这类问题。

特别是垂直领域的大模型应用,对于模型回答的准确率要求非常高,因为存在幻觉问题,单纯依靠大模型难以满足使用需求,所以我们一般会通过检索增强生成(Retrieval-Augmented Generation, RAG)技术来缓解大模型幻觉,提高检索的召回率。

RAG是一种结合了信息检索和大模型(LLM)的技术,用于构建更强大和准确的问答或生成系统。RAG通过将大模型与外部知识库相结合,可以动态检索相关信息并利用生成模型对查询进行更准确的回答。关于如何构建RAG可参考机器学习实验室 | 制作个人的第一个RAG demo!_快速搭建一个rag demo-CSDN博客

那么如何将DeepSeek与本地的个人知识库链接在一起呢?其实也不难,我们可以借助RAGFlow这样的开源工具来搭建自己的本地知识库并给使用大模型进行有效检索。

RAGFlow是一个基于深度文档理解的开源RAG引擎。它能为任何规模的企业提供简化的RAG工作流程,并结合LLM提供真实的问题解答功能,并从各种复杂格式的数据中获得有理有据的引文支持。

RAGFlow本地部署方式也非常简单,以windows环境为例,我们可以借助于docker来直接部署。首先clone一下RAGFlow仓库,然后进入到目录:

$ git clone https://github.com/infiniflow/ragflow.git$ cd ragflow

到docker官网(https://www.docker.com/)下载docker桌面版,然后安装:

安装完成后可以在cmd验证一下当前的安装版本(满足24.0.0及以上版本即可):

然后利用ragflow预先构建的docker镜像启动ragflow服务并在启动成功后查看服务状态:

$ docker compose -f docker/docker-compose.yml up -d$ docker logs -f ragflow-server

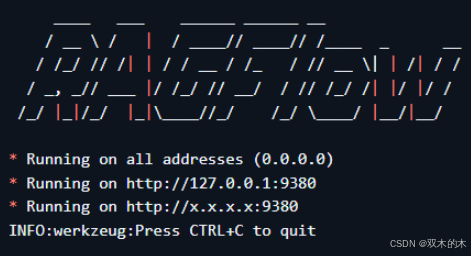

服务启动成功后会有如下输出显示:

然后在浏览器上输入自己的本机ip地址(在cmd输入ipconfig,找到IPv4地址即可),即可打开RAGFlow的网页端界面:

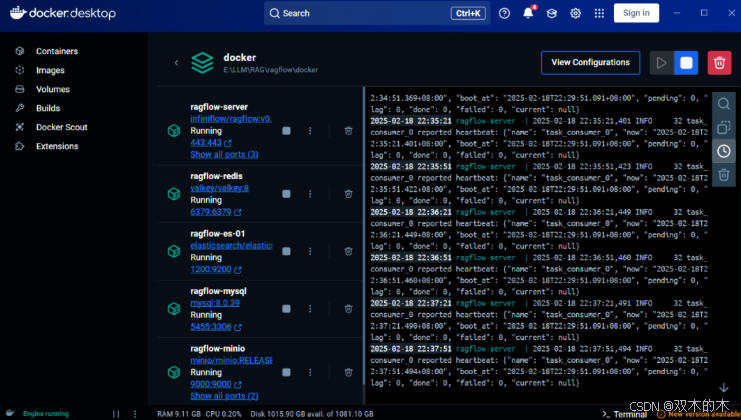

同时docker也会显示相关操作的日志信息:

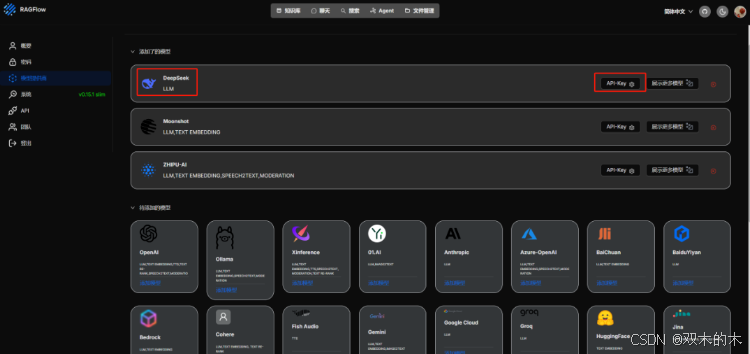

在打开的RAGFlow网页端注册并登录,直接在左侧菜单栏进入到模型供应商页面,找到deepseek并添加(需要deepseek api,到deepseek官网获取,新用户用免费额度可以使用)作为你的LLM模型。

另外RAG还需要一个embedding模型对本地知识库文档以及用户查询做嵌入。候选模型中带有TEXT EMBEDDING的都可以选用,比如笔者这里选择了智谱的embedding模型。

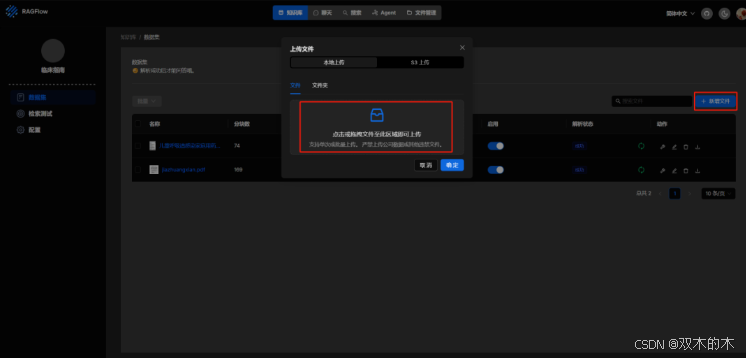

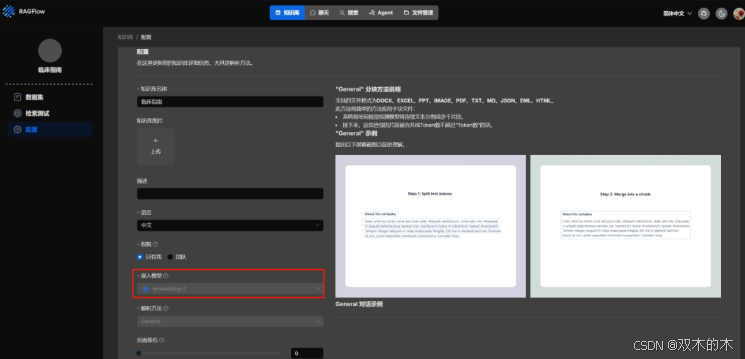

模型设置好后,在页面顶端找到知识库,进入后上传自己的本地文档,比如笔者所在的医疗场景,专业问答非常依赖于一些临床指南和专家共识,所以笔者新建了一个叫做临床指南的知识库,专门存放各种疾病的临床指南文件。

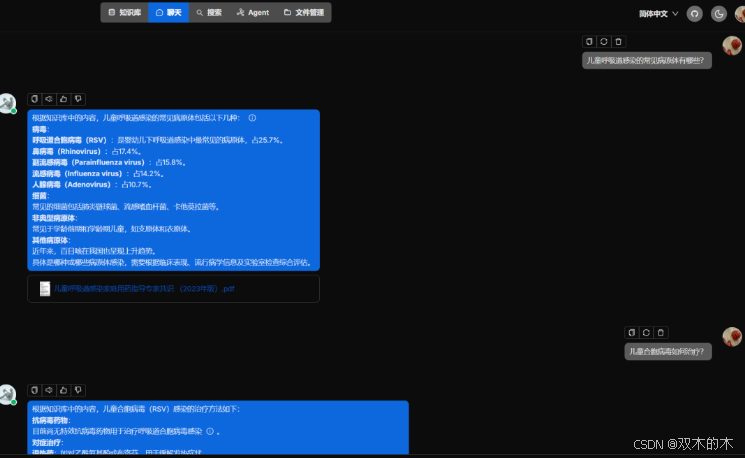

知识库建好后,我们就可以基于设置好的LLM和知识库进行问答对话了。页面顶端切换到聊天页面,在下方直接进行提问,LLM会优先对知识库进行检索回答:

这样,我们就完成了基于RAGFlow+DeepSeek的本地知识库问答系统的构建。当然,本文只是使用DeepSeek作为LLM示例,我们也可以尝试使用其他任何LLM进行检索问答。

THE END !

文章结束,感谢阅读。您的点赞,收藏,评论是我继续更新的动力。大家有推荐的公众号可以评论区留言,共同学习,一起进步。

更多推荐

已为社区贡献37条内容

已为社区贡献37条内容

所有评论(0)