deepseek部署加调用

deepseek本地部署

- 安装ollama

1、什么是Ollama?

Ollama 是一个开源的本地化大型语言模型(LLM)运行框架,旨在简化用户在本地计算机上部署、管理和运行大模型的过程。它通过整合模型权重、配置和运行环境,提供了一站式的解决方案,尤其适合开发者和研究人员在本地环境中快速体验和应用 AI 模型。Ollama 支持在本地运行大型语言模型(如 Llama 3、Qwen、DeepSeek 等),无需依赖云端服务,所有数据处理均在本地完成,保障用户隐私311。Windous安装。

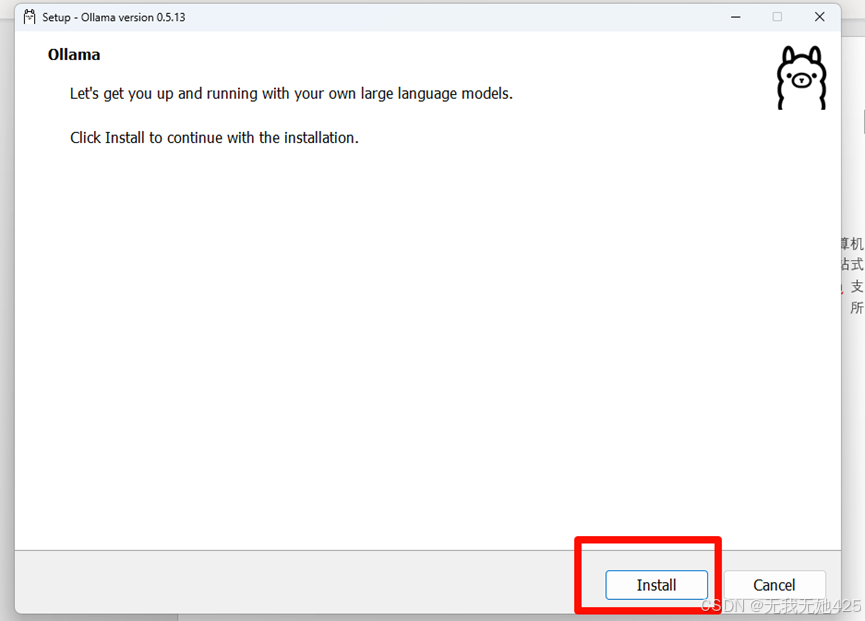

2、安裝

双击安装包,直接点击install,如下图

Cmd执行ollama -v,如下安装成功

Cmd执行ollama -v,如下安装成功

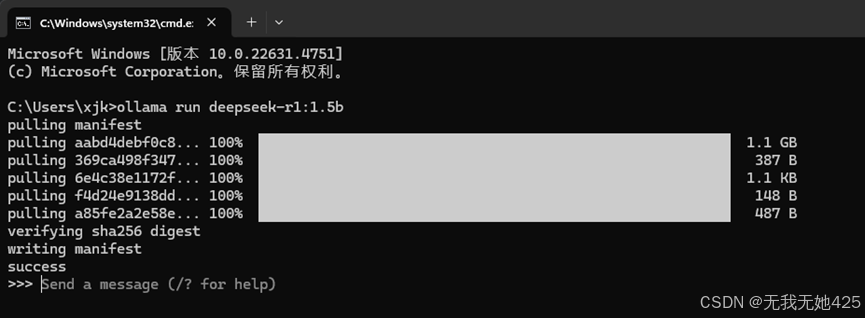

- 安装deekseep模型

Cmd执行下面的命令下载模型

ollama run <模型名称>

deepseek如下:ollama run deepseek-r1:1.5b

成功如下图:

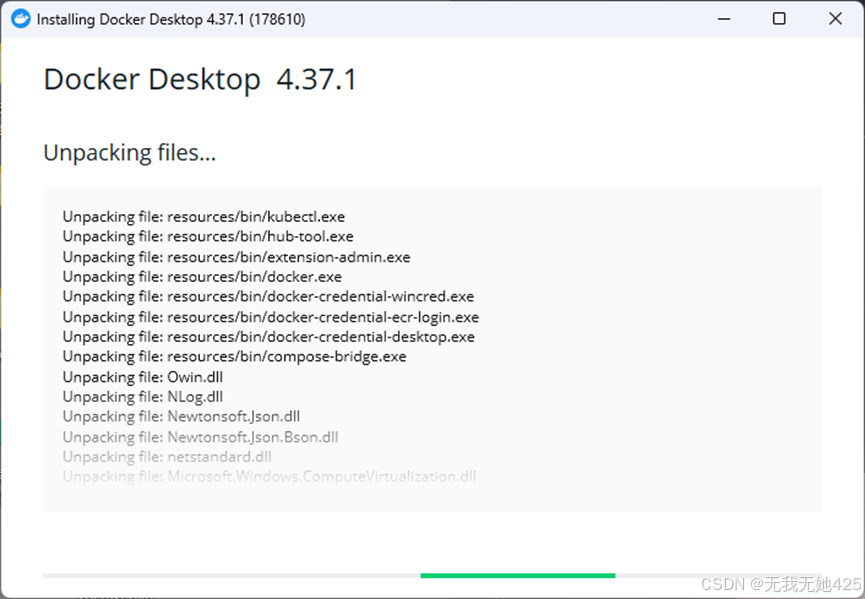

- Windous桌面安装docker

双击安装包

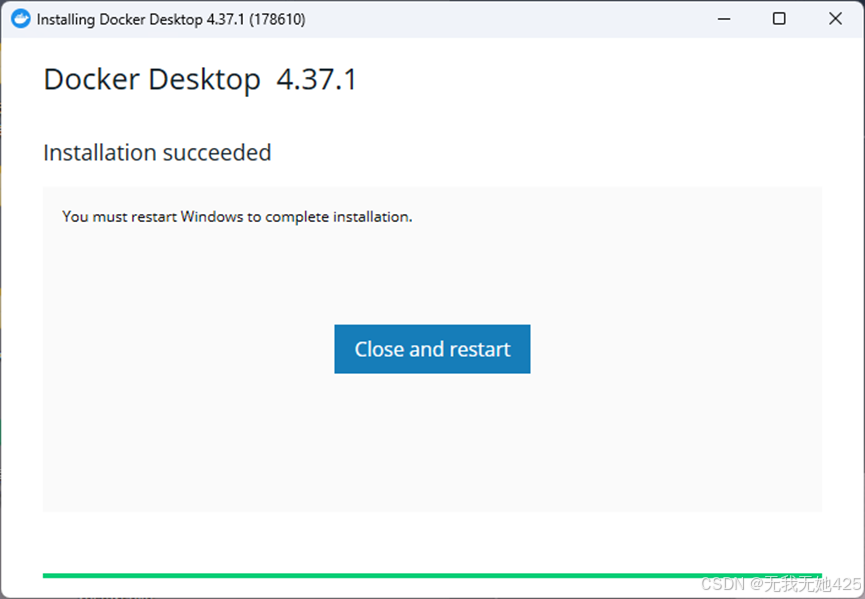

下面就是装成功,重启

- 安装diy

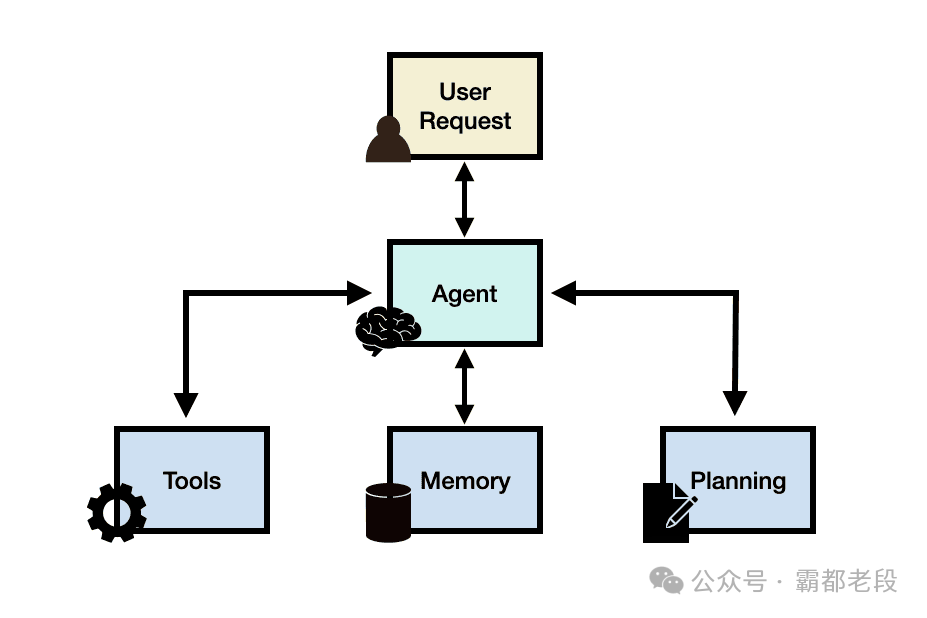

- Dify调用模型

- 调用deekseep

- api调用

调用分为流式和非流式

参考

curl https://api.deepseek.com/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer <DeepSeek API Key>" \

-d '{

"model": "deepseek-chat",

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hello!"}

],

"stream": false

}'

- 网页调用

搭建web网页Dify

在网页中直接配置提示词和知识库等,再通过api调用

通过界面配置后的调用方法

参考:

curl -X POST 'http://127.0.0.1/v1/chat-messages' \

--header 'Authorization: Bearer {api_key}' \

--header 'Content-Type: application/json' \

--data-raw '{

"inputs": {},

"query": "What are the specs of the iPhone 13 Pro Max?",

"response_mode": "streaming",

"conversation_id": "",

"user": "abc-123",

"files": [

{

"type": "image",

"transfer_method": "remote_url",

"url": "https://cloud.dify.ai/logo/logo-site.png"

}

]

}'

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)