三、【AI】如何在Windows部署DeepSeek模型

·

这里写自定义目录标题

1、简介

Windows系统上部署深度学习模型时,常见的挑战包括环境配置、依赖库兼容性和硬件加速问题。本文将通过Ollama来简化这些步骤,并结合Dify知识库来提升模型的应用效率。

2、什么是Ollama

官网:Ollama

Ollama是一个用于简化AI模型创建、管理和部署的工具,提供了灵活的环境来快速将模型部署为服务。它使得AI模型部署过程变得更加简便,尤其是对于Windows系统的用户。

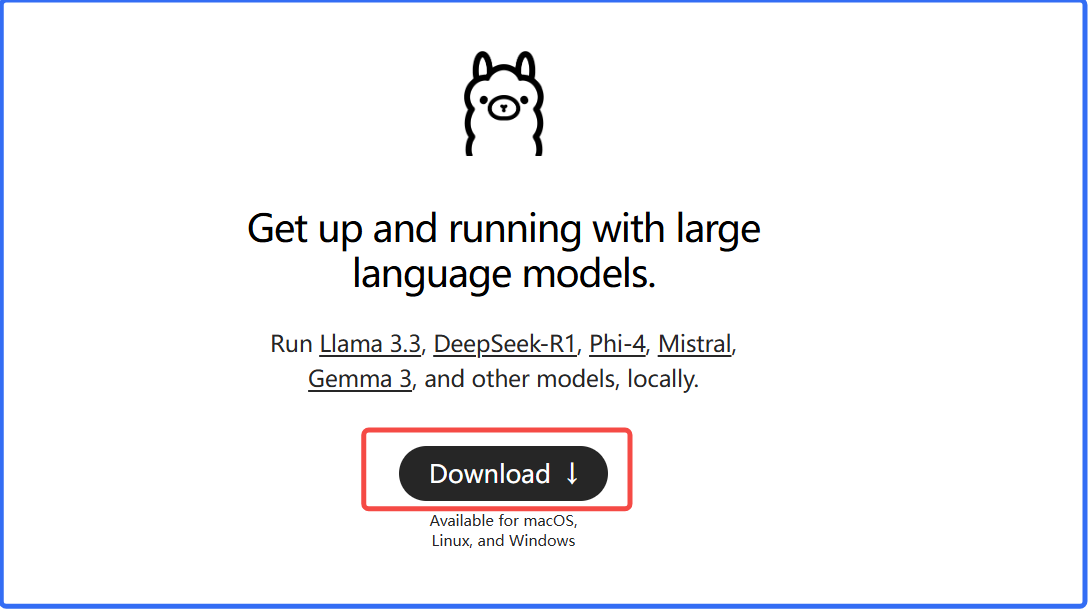

2、下载Ollama,并安装

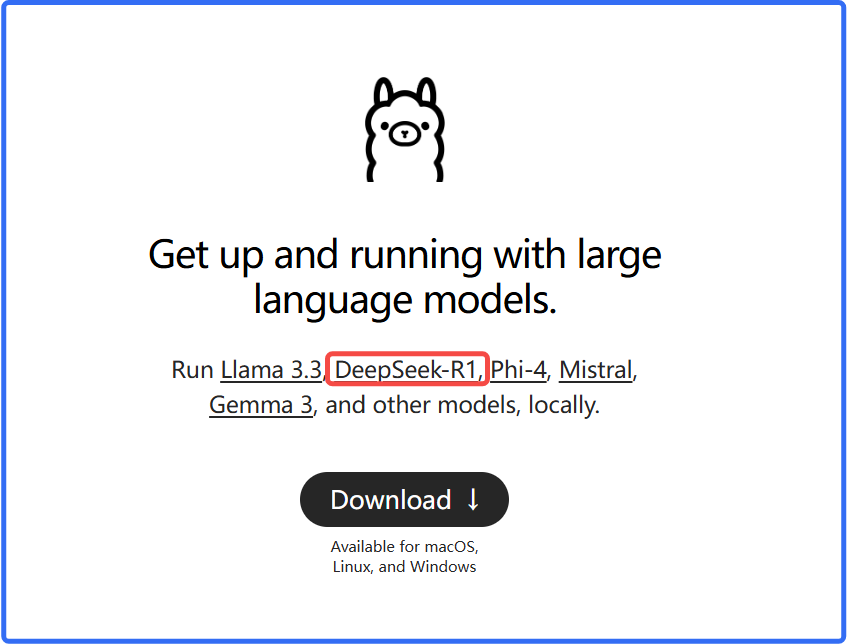

2、选择模型

根据自己的电脑配置,选择合适的配置模型,你可以把下面语句提供给DeepSeek提问:

我现在正在使用ollama部署deepseek-r1模型,

但是模型分为1.5b,71b,8b,14b,32b,70b, 671b等,

我不知道该怎么选择适合我电脑配置模型了,我现在把我电脑的配置信息告诉你,你帮我选则一下吧。

下面是我的电脑配置:

操作系统制造商 Microsoft Corporation

系统类型 基于 x64 的电脑

处理器 13th Gen Intel(R) Core(TM) i7-13700H,2400 Mhz,14 个内核,20 个逻辑处理器

已安装的物理内存(RAM) 16.0 GB

总的物理内存 15.7 GB

可用物理内存 3.90 GB

总的虚拟内存 44.7 GB

可用虚拟内存 25.0 GB

页面文件空间 29.0 GB

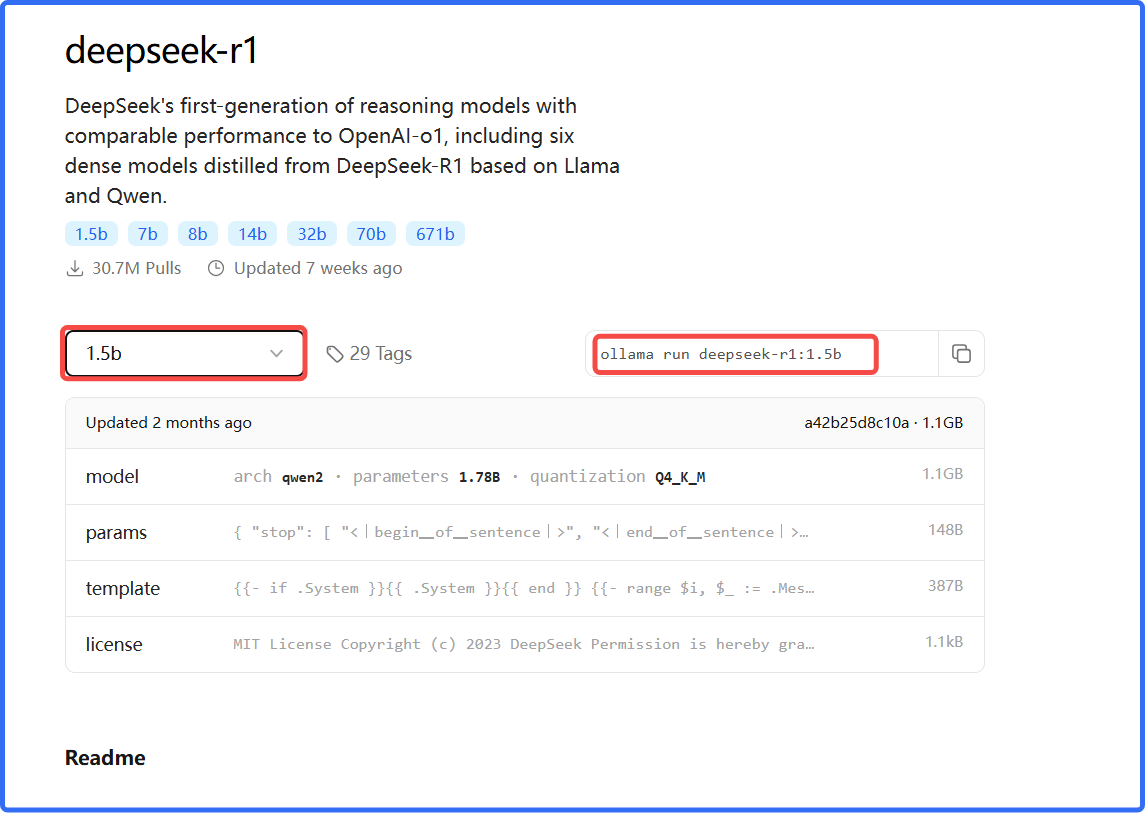

这里我们选1.5b参数模型,复制命令在控制台输入:

ollama run deepseek-r1:1.5b

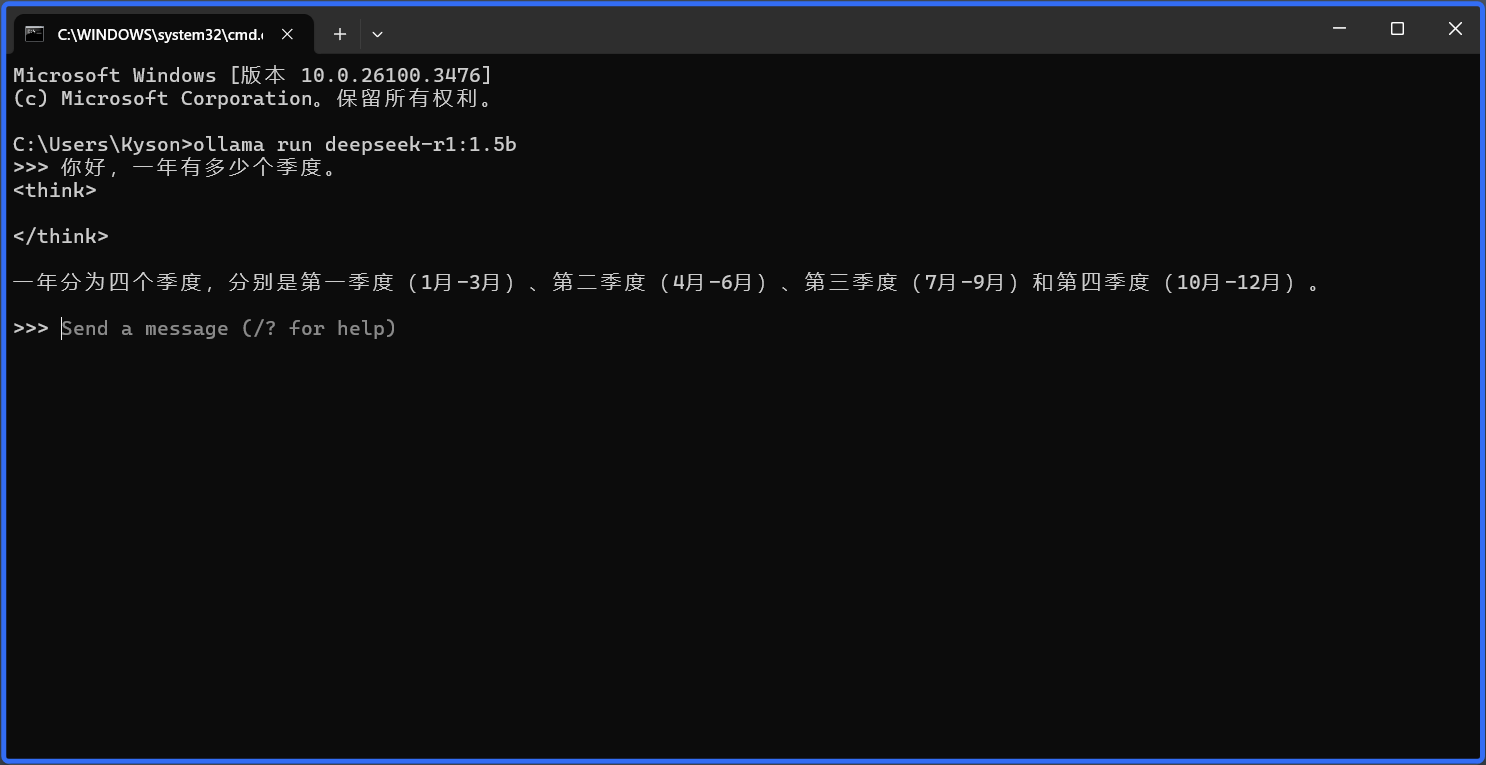

3、提问

安装成功后就可以进行提问了。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)