Dify+Ollama方案中集成DeepSeek模型

A: 检查Ollama日志或通过Dify Playground提问模型相关问题(如"你的训练数据截止时间是什么时候?Dify本身是应用开发平台,Ollama是本地模型运行工具,而DeepSeek是实际运行的LLM模型。通过以上步骤,您已经明确地将DeepSeek模型集成到了Dify+Ollama的本地知识库方案中。如何在Dify+Ollama方案中集成DeepSeek模型,并给出完整的配置流程。如

如何在Dify+Ollama方案中集成DeepSeek模型,并给出完整的配置流程。

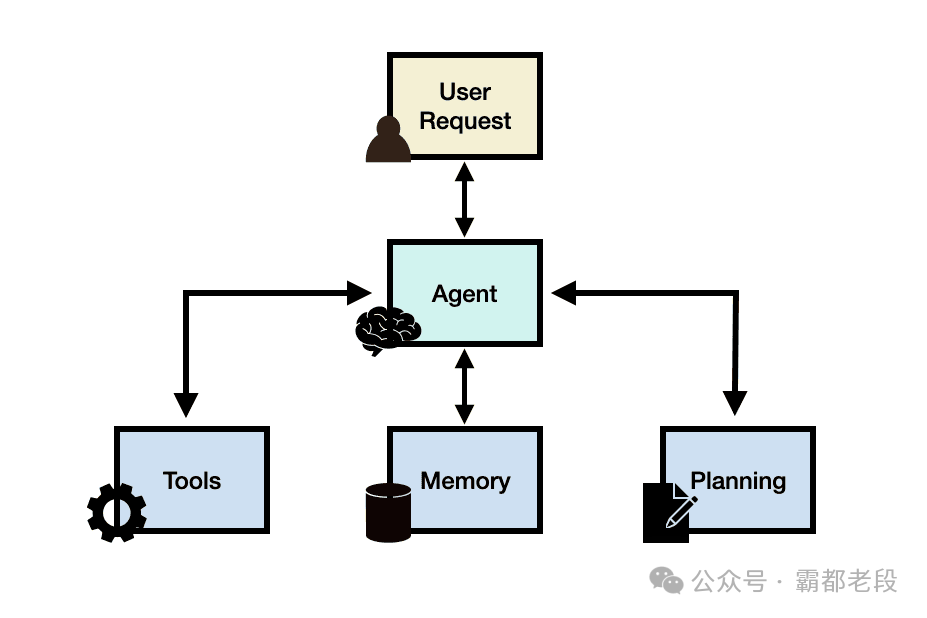

一、DeepSeek在架构中的位置

Dify本身是应用开发平台,Ollama是本地模型运行工具,而DeepSeek是实际运行的LLM模型。关系如下:

Dify (应用层)

↓ 调用API

Ollama (模型服务层)

↓ 加载模型

DeepSeek (实际的大语言模型)

二、明确使用DeepSeek的关键步骤

1. 通过Ollama加载DeepSeek模型

这是最关键的步骤——Ollama需要加载DeepSeek模型才能实际使用它。

# 拉取DeepSeek模型(以7B版本为例)

ollama pull deepseek/deepseek-llm:7b

# 查看已安装模型(确认DeepSeek是否在列表中)

ollama list

2. 在Dify中配置DeepSeek模型

在Dify后台设置中,需要将模型供应商指向Ollama,并选择DeepSeek模型:

- 登录Dify控制台(

http://localhost:3000) - 进入 “模型供应商” > “Ollama”

- 填写配置:

- 模型名称:

deepseek-llm:7b(或其他你下载的版本) - API基础URL:

http://localhost:11434(Ollama默认端口)

- 模型名称:

- 保存配置

3. 创建应用时选择DeepSeek模型

当在Dify中创建知识库应用时:

- 在 “模型设置” 中选择 Ollama 作为供应商

- 选择

deepseek-llm:7b作为推理模型

三、验证DeepSeek是否被实际使用

方法1:查看Ollama日志

当通过Dify发起查询时,观察Ollama的日志输出:

# 查看Ollama的实时日志

ollama serve

如果看到类似以下输出,说明DeepSeek正在被调用:

[Ollama] Generating response using model 'deepseek-llm:7b'...

方法2:在Dify中测试模型

在Dify的 “Playground” 标签页中:

- 输入测试问题(例如:“你是谁?”)

- 查看回答中是否包含DeepSeek的标识性描述

方法3:直接调用Ollama API验证

curl http://localhost:11434/api/generate -d '{

"model": "deepseek-llm:7b",

"prompt": "请介绍一下你自己",

"stream": false

}'

如果返回的回答包含"DeepSeek"相关信息,说明模型加载正确。

四、完整配置流程(含DeepSeek)

步骤1:启动Ollama并加载DeepSeek

# 启动Ollama服务(如果尚未运行)

ollama serve

# 在另一个终端窗口拉取DeepSeek模型

ollama pull deepseek/deepseek-llm:7b

步骤2:配置Dify使用DeepSeek

-

在Dify的 “设置” > “模型供应商” 中:

- 添加Ollama作为自定义供应商

- 模型名称填写:

deepseek-llm:7b - API URL填写:

http://localhost:11434

-

创建知识库应用时:

- 选择 Ollama 作为模型供应商

- 选择

deepseek-llm:7b作为推理模型

步骤3:测试集成效果

# 使用前文的API代码测试

response = query_knowledge_base("DeepSeek模型的特点是什么?")

print(response["answer"])

预期输出应包含DeepSeek模型的特定描述(如支持长上下文、开源等)。

五、常见问题解决

Q1: 如何确认Dify是否真的在使用DeepSeek?

A: 检查Ollama日志或通过Dify Playground提问模型相关问题(如"你的训练数据截止时间是什么时候?"),DeepSeek会返回其特定信息。

Q2: 能否同时使用多个模型?

A: 可以!在Ollama中下载其他模型(如llama3),然后在Dify的不同应用中配置不同模型。

Q3: 如何优化DeepSeek在本地运行的性能?

# 运行时指定GPU数量(如果有NVIDIA GPU)

OLLAMA_NUM_GPU=2 ollama serve

# 量化版本(如果显存不足)

ollama pull deepseek/deepseek-llm:7b-q4_0

通过以上步骤,您已经明确地将DeepSeek模型集成到了Dify+Ollama的本地知识库方案中。关键在于:

- 通过Ollama加载正确的DeepSeek模型

- 在Dify中正确配置模型名称和API端点

- 在应用创建时选择DeepSeek作为推理模型

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)