Dify+ollama+deepseek构建本地知识库

创建Modelfile。

·

通过Dify + Ollama + DeepSeek构建本地知识库指南

概述

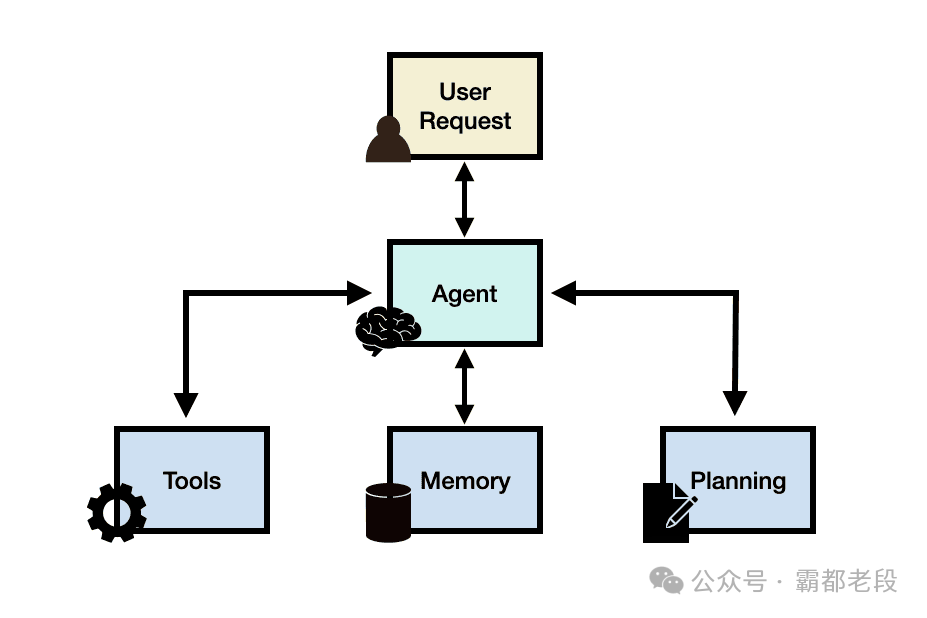

Dify是一个开源的LLM应用开发平台,Ollama是一个本地运行大型语言模型的工具,DeepSeek是强大的开源大模型。结合这三者可以构建一个完全本地的知识库系统。

准备工作

-

确保你的设备满足以下要求:

- 至少16GB RAM(推荐32GB以上)

- 足够的存储空间(至少50GB可用空间)

- 支持CUDA的NVIDIA GPU(推荐)

-

安装必要的软件:

- Docker

- Python 3.8+

- Git

安装步骤

1. 安装Ollama

# Linux/macOS安装

curl -fsSL https://ollama.com/install.sh | sh

# Windows可通过官网下载安装包

2. 下载DeepSeek模型

ollama pull deepseek/deepseek-llm:7b # 7B版本,根据硬件选择

3. 安装Dify

# 克隆Dify仓库

git clone https://github.com/langgenius/dify.git

cd dify

# 使用Docker Compose启动

docker-compose up -d

配置知识库

1. 配置Dify连接Ollama

- 访问Dify Web界面(通常为

http://localhost:3000) - 进入"设置" > “模型供应商”

- 添加Ollama作为自定义供应商:

- API基础URL:

http://localhost:11434 - 选择DeepSeek模型

- API基础URL:

2. 创建知识库

- 在Dify中创建新应用

- 选择"知识库"功能

- 上传文档(支持PDF、Word、Excel、TXT等格式)

- 配置索引参数(分块大小、重叠等)

高级配置

优化Ollama性能

# 运行Ollama时指定参数

OLLAMA_NUM_GPU=2 ollama serve # 使用2个GPU

自定义DeepSeek模型参数

创建Modelfile:

FROM deepseek/deepseek-llm:7b

PARAMETER temperature 0.7

PARAMETER num_ctx 4096

然后构建自定义模型:

ollama create my-deepseek -f Modelfile

使用知识库

- 在Dify中创建对话应用

- 连接你的知识库

- 通过API或Web界面查询知识库

常见问题解决

- 内存不足:尝试使用更小的模型版本(如deepseek-llm:7b)

- 响应慢:调整Ollama的

num_gpu参数或减少上下文长度 - 知识库索引失败:检查文档格式,尝试重新上传

后续优化

- 定期更新知识库文档

- 监控系统性能,根据需要调整资源配置

- 考虑使用更高效的嵌入模型处理知识库

这个方案提供了完全本地的解决方案,适合对数据隐私要求高的场景,同时利用DeepSeek的强大能力提供高质量的问答体验。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)