NVIDIA Dynamo开源,DeepSeek推理性能提升超2倍

近期,NVIDIA GTC25上推出的开源推理软件 NVIDIA Dynamo,凭借其卓越的性能和创新的技术架构,为 AI 推理性能的提升带来了全新的解决方案。Dynamo 不仅能够显著提升推理性能,还能通过优化资源利用大幅降低成本,为企业在 AI 时代的竞争提供了强大的助力。

官方测试显示,在 NVIDIA H100 平台上运行 Llama、DeepSeek 等大模型时,吞吐量提升超过 2 倍;在 NVIDIA GB200 NVL72 大型集群上服务 DeepSeek-R1 671B 模型时,吞吐量提升了 30 倍。

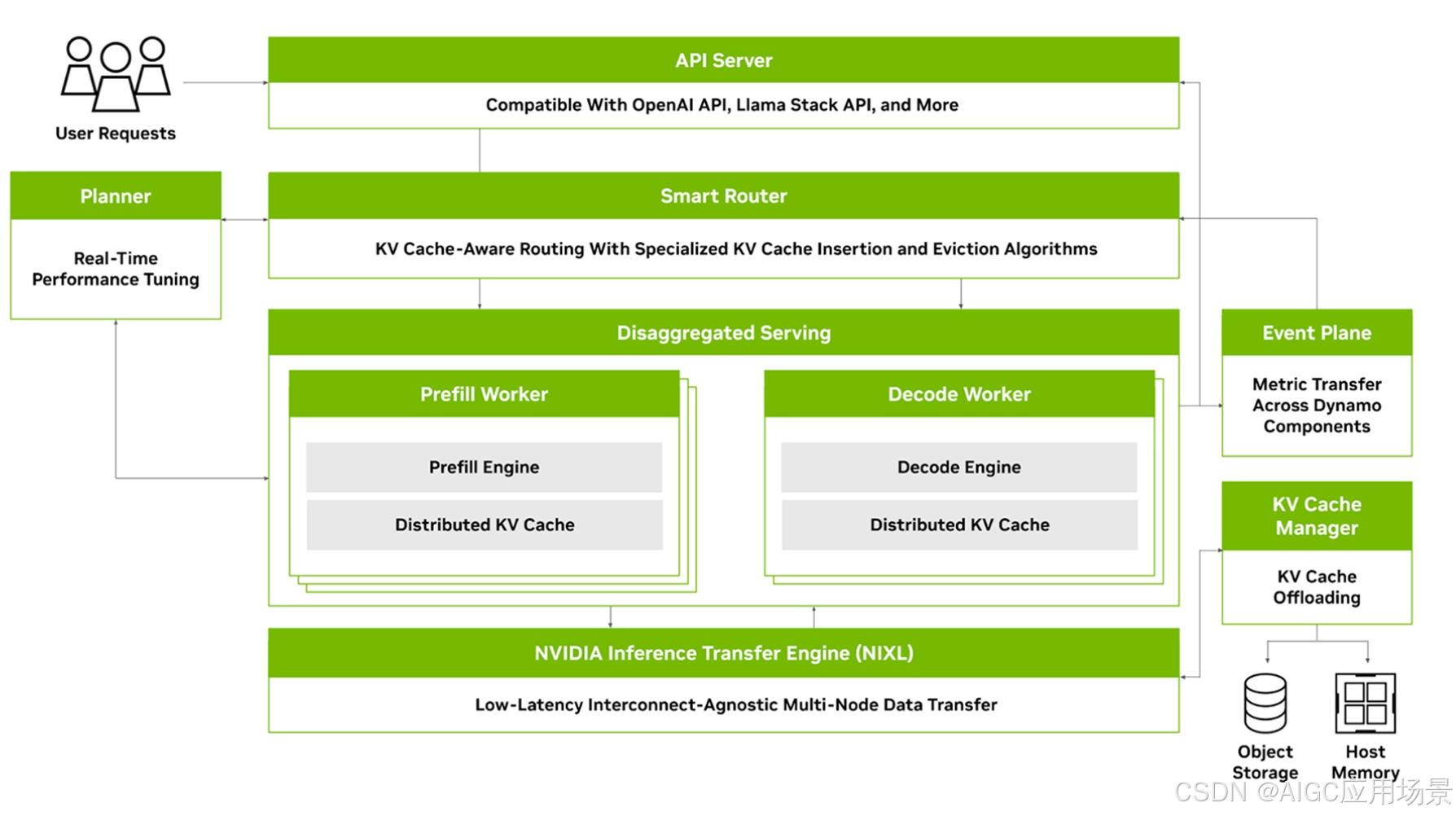

核心技术原理

- GPU 规划器:动态调整 GPU 资源分配,根据用户需求实时优化资源配置,避免配置过度或不足。

- 智能路由器:具备大语言模型感知能力,能够高效引导请求流向,减少重复计算,释放 GPU 资源以响应新的请求。

- 低延迟通信库:加速 GPU 间通信,简化异构设备间的数据交换,显著降低推理响应时间。

- 显存管理器:智能卸载和重新加载推理数据,充分利用低成本显存和存储设备,降低推理成本。

英智落地方案

NVIDIA Dynamo 的推出,为企业在 AI 推理领域的降本增效提供了强大的技术支持。然而,对于许多企业来说,尤其是那些缺乏大规模 GPU 集群资源的企业,如何高效利用这些先进的推理技术仍是一个挑战。

英智在高性能 H100 集群上,结合了 NVIDIA Dynamo 的高性能推理优化技术,优化了自有的英智大模型API私有部署托管服务、英智大模型API公有云服务,进一步提升企业的 AI 推理效率,为企业提供稳定、高效的大模型 API 服务;同时,针对英智大模型推理一体机,可根据企业用户的需求,搭配 NVIDIA Dynamo 分布式推理框架。

1. 英智大模型API私有部署托管服务

私有化部署托管是一种高效、低成本的大模型部署方案。企业可以通过与英智合作,租赁一台或多台高性能GPU服务器,在这些服务器上部署DeepSeek R1模型。部署完成后,这些服务器将成为企业的专属计算资源,仅为企业内部使用,确保数据安全和使用独占性。

在DeepSeek模型的部署和API平台的搭建过程中,英智将为客户提供全程技术支持,直接协助客户完成模型和平台的搭建。客户只需打通与企业内部网络的连接,即可快速投入使用,免去繁琐的配置和调试过程。

此外,英智还将定期为客户进行模型的升级和系统维护,确保平台始终保持在最佳性能状态,帮助企业在模型效果和响应速度上保持行业领先。

如果您对此感兴趣,请访问:https://api.gpubook.cn/privateDeployment

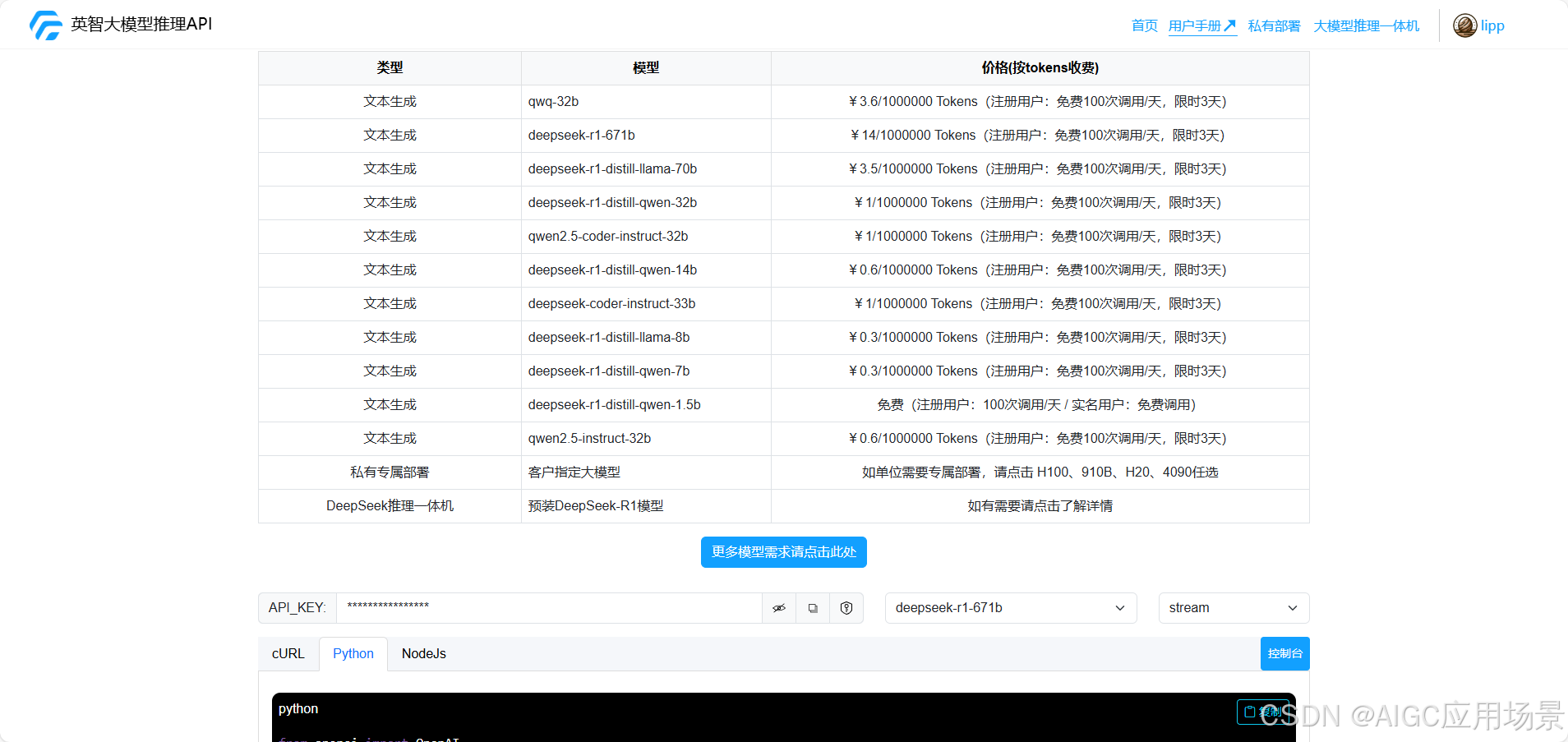

2. 英智大模型API公有云服务

英智大模型API公有云服务,面向大模型应用开发者及AI初创企业,提供基于DeepSeek等顶尖大模型的一站式智能云服务解决方案。通过开放兼容的API接口与弹性算力支持,助力客户快速构建生产级人工智能应用。

如果您对此感兴趣,请访问:https://api.gpubook.cn

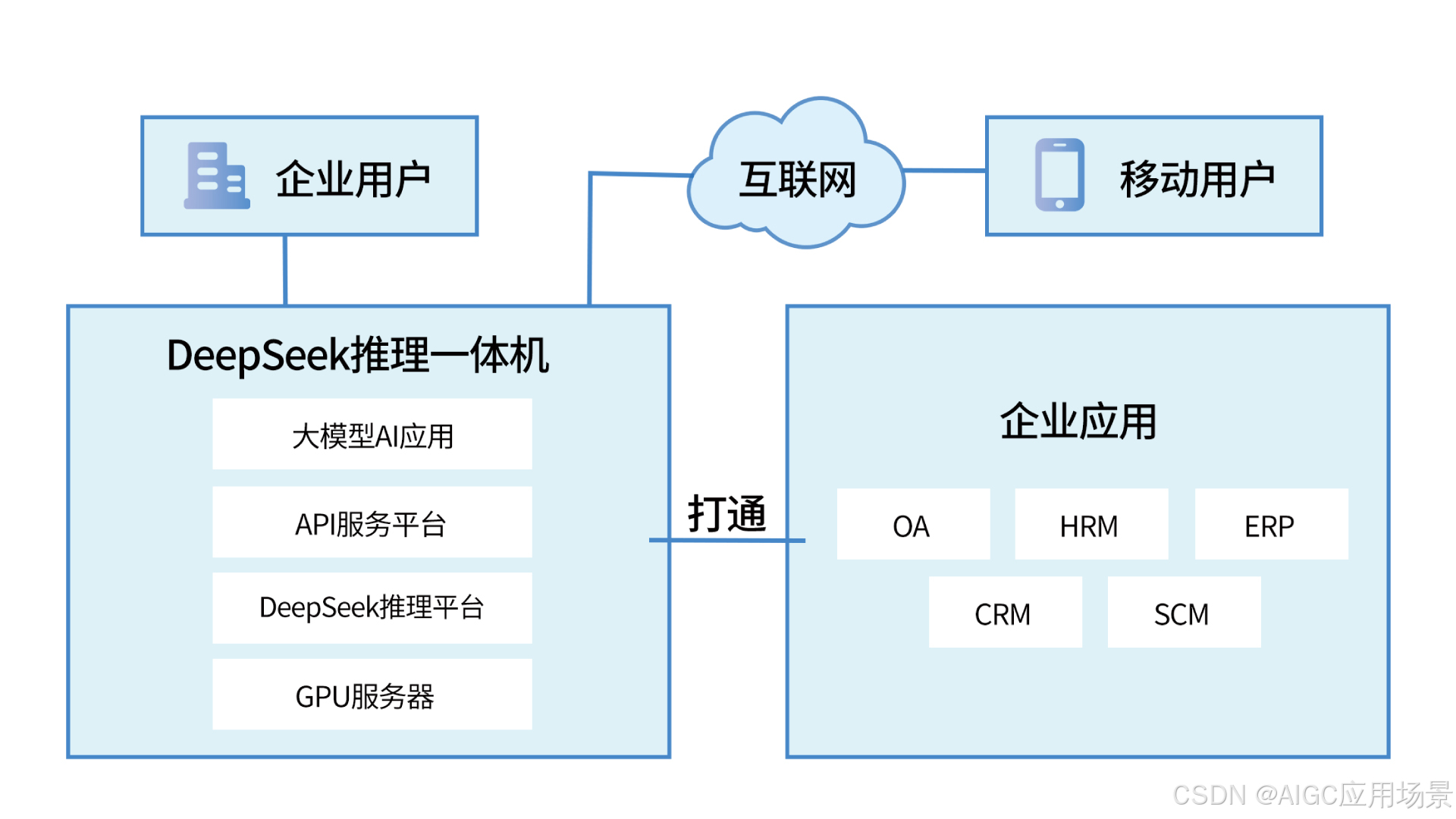

3. 英智大模型推理一体机

英智DeepSeek推理一体机以“硬件 + 软件 + 服务”三位一体架构为核心优势,构建企业级AI推理解决方案。其顶级硬件配置包括NVIDIA H100/H20/L40/4090等旗舰级GPU,搭配Intel多核处理器与高速内存系统,可实现千亿参数模型的快速响应,从容应对多任务并发处理与复杂推理场景。

系统预装深度优化的DeepSeek-R1模型,通过Transformer架构增强与行业场景适配,具备业内领先的自然语言理解与生成能力。该模型原生支持多模态交互、跨领域任务处理等核心功能,用户无需复杂配置即可实现文本生成、智能问答、代码开发等场景的即开即用。

英智为所有一体机产品提供定期的模型免费升级,确保模型性能和效果始终保持在行业领先水平。同时,提供长达3年的软硬件一体化服务,涵盖设备维护、软件更新和技术支持,助力企业在 AI 应用中保持稳定运行和持续创新。

如果您对此感兴趣,请访问:https://aio.gpubook.cn

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)