想要提升deepseek回复质量,会这一招就够了

想要提升deepseek回复质量,会这一招就够了

什么是反事实推理?

Counterfactual Reasoning,它是一种通过构建与事实相反的假设性情景,探索因果关系和潜在结果的逻辑推理方法。

举个例子:

如果我是帅哥,短视频流量会怎样?

我是帅哥吗?不是,这个假设有违事实。

但基于这个假设,会怎么样呢?

探索一下其中的因果关系与潜在结果。

为什么说反事实推理对deepseek帮助极大呢?

其一,能突破数据量上限。

传统的大模型,比拼的都是数据量与参数量,需要大量的互联网数据。但互联网数据毕竟是有限的,最多把全网的数据都拿来训练,对吧?

有没有办法突破全网数据量上限呢?

有的,虚构数据,反事实推理模拟各种场景,来增强训练样本。

其二,助力因果发现,加强结果的解释性,关联性,因果性。

会有人问,虚构训练数据,那回复的置信度会打折扣吧?

与之相反,反事实推理有着严密的数学模型,因果推断三层次模型,它由美国计算机科学家Pearl提出,是因果推理理论的核心框架。

因果推断有哪三层次?

第一层:关联,Association。这一层关注条件概率P(Y|X),是传统统计学和机器学习的主要关注点。

这一层能回答:是否具备相关性。

但无法回答:是否具备因果性。

举例,通过观察事实发现:

P(肺癌|吸烟) > P(肺癌|不吸烟)

推理得出:肺癌与吸烟相关

但无法推出:吸烟导致肺癌

第二层:干预,Aintervention。这一层关注P(Y|do(X)),即主动干预某一变量,观察对结果的影响。

这一层能够回答:如果怎么样(施加了干预),会怎么样。

举例,强制所有人抽烟,然后继续观察事实发现:

P(肺癌|do(吸烟=100%)) > P(肺癌)

P(肺癌|do(吸烟=100%)) != 100%

推理得出:

1. 吸烟会使肺癌概率上升;

2. 但吸烟不是导致肺癌的原因;

第三层:反事实,Counterfactuals。这一层研究假设性问题,关注xxoo(公式不会输入)。

这一层关注:如果采取了不同的行动,结果会如何。这里面会用到结构因果建模SCM,反事实计算,可识别性分析等知识,不详细展开。

画外音:楼主没研究透,所以打马虎眼一笔带过(这一句发布时删除)。

举例:如果某吸烟者当初未吸烟,肺癌的概率会如何变化。

反事实推理在责任判定(例如:医疗事故归因),个性化决策(如果xx怎么样,如果xx怎样),人工智能因果解释性上有大量应用。

总之,通过反事实推理,deepseek能够更好地揭示变量间的因果链。

其三:避免单一输出,加强分析维度。

这一点用过deepseek的童鞋感受上应该都比较直观。

你看,deepseek的回答丰富度极高:

1. 构造假设,尝试多方案;

2. 多方案进行数据对比;

3. 差异归因;

4. 给出结论与建议;

总的来说,deepseek在提示词优化引擎,因果推理模块,解释性增强模块,结论输出模块… 等算法、策略、工程架构中都深度结合了反事实推理,其对deepseek的崛起功不可没。

反事实推理,对我们写提示词,获取更佳的回答质量有什么启示呢?

答:参考反事实推理优化提示词,能极大提升AI输出质量。

更具体的,可以使用CREATE提示词框架:

Contrast:要求多方案比较

Risk-aware:要求评估潜在风险

Experimental:要求假设性推演

Alternative:要求备选方案

Trade-off:要求分析优缺点

Explain:要求说明决策逻辑

比较抽象,举个例子。

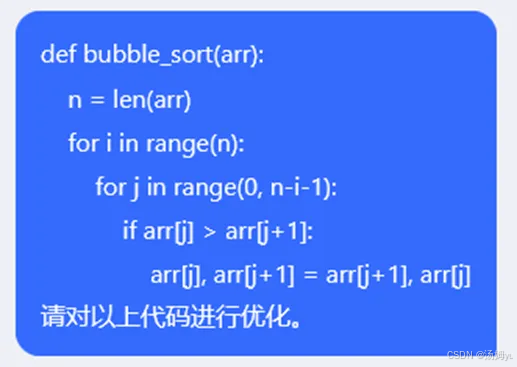

想优化冒泡排序,提示词我是这么写的。

非常直白。

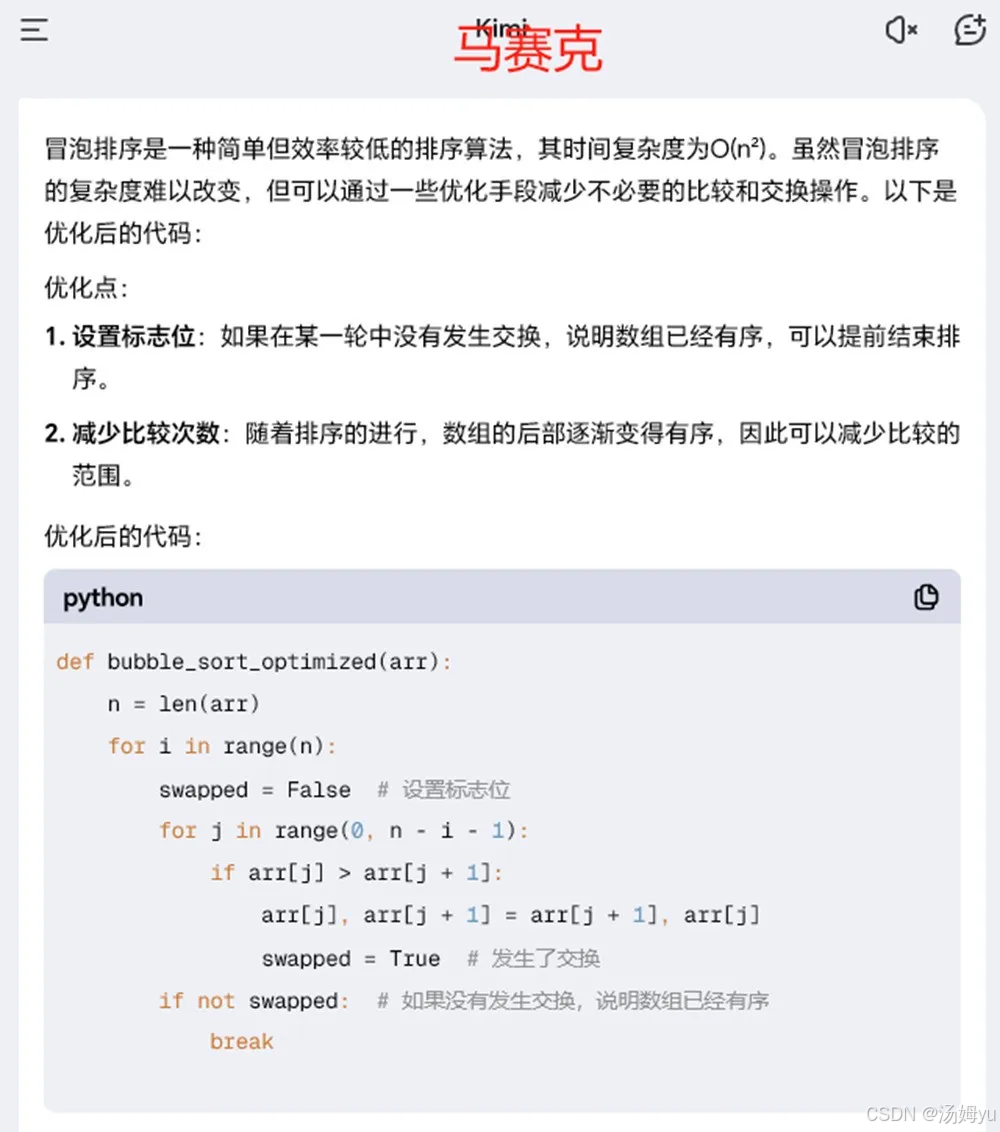

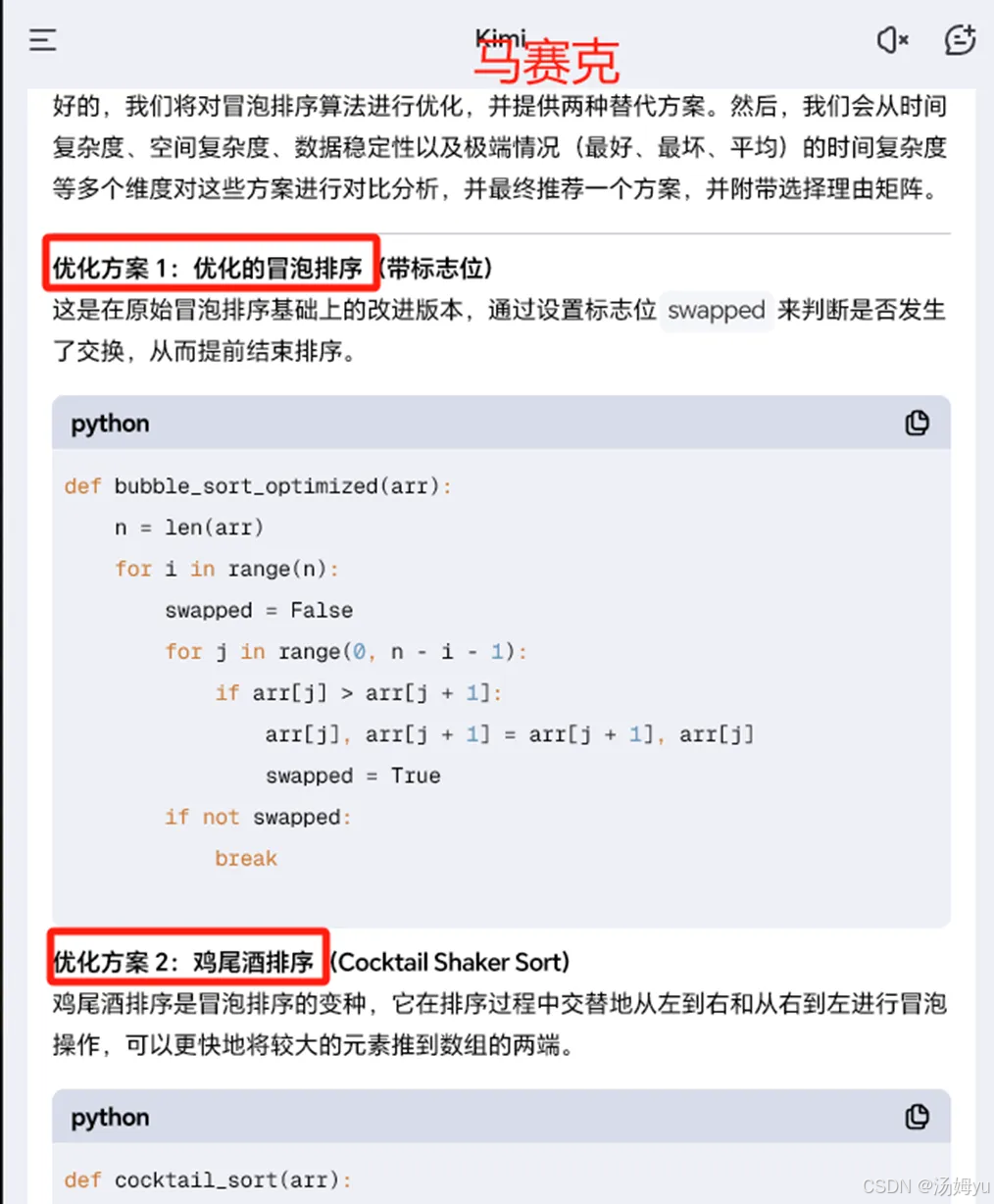

AI的输出如上。

画外音:为了说明CREATE对提示词进行优化的效果,选择了其他AI产品,已打码。

你说AI的输出效果差吗?也不是,非常直接的给出了优化建议,但总觉得差那么点意思,回复的内容不够丰富。

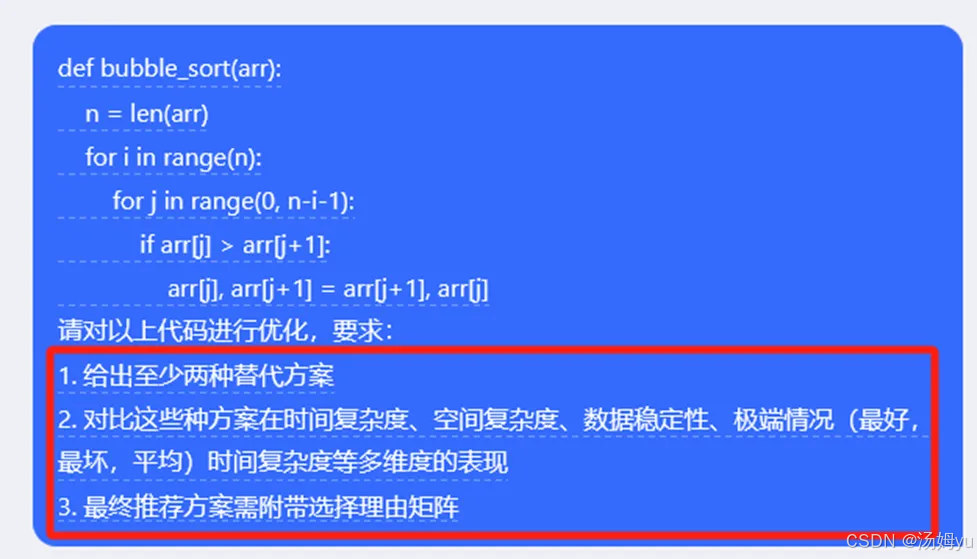

参考了CREATE提示词框架进行了简单的优化。

1. 要求给出至少2种方案;

2. 两种方案要进行对比;

3. 说明推简理由;

优化之后,回复的丰富度极大地提升了。

首先,给出了多种方案。

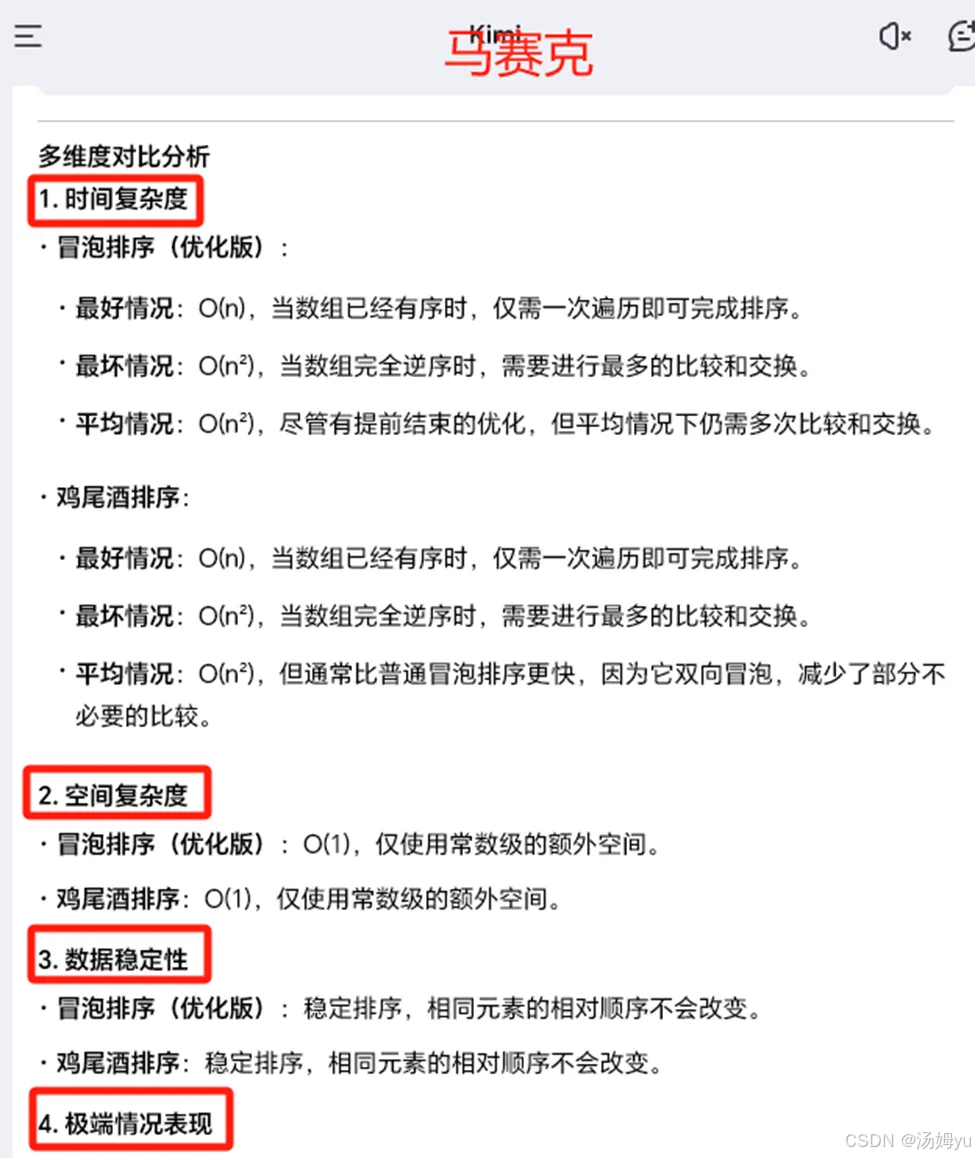

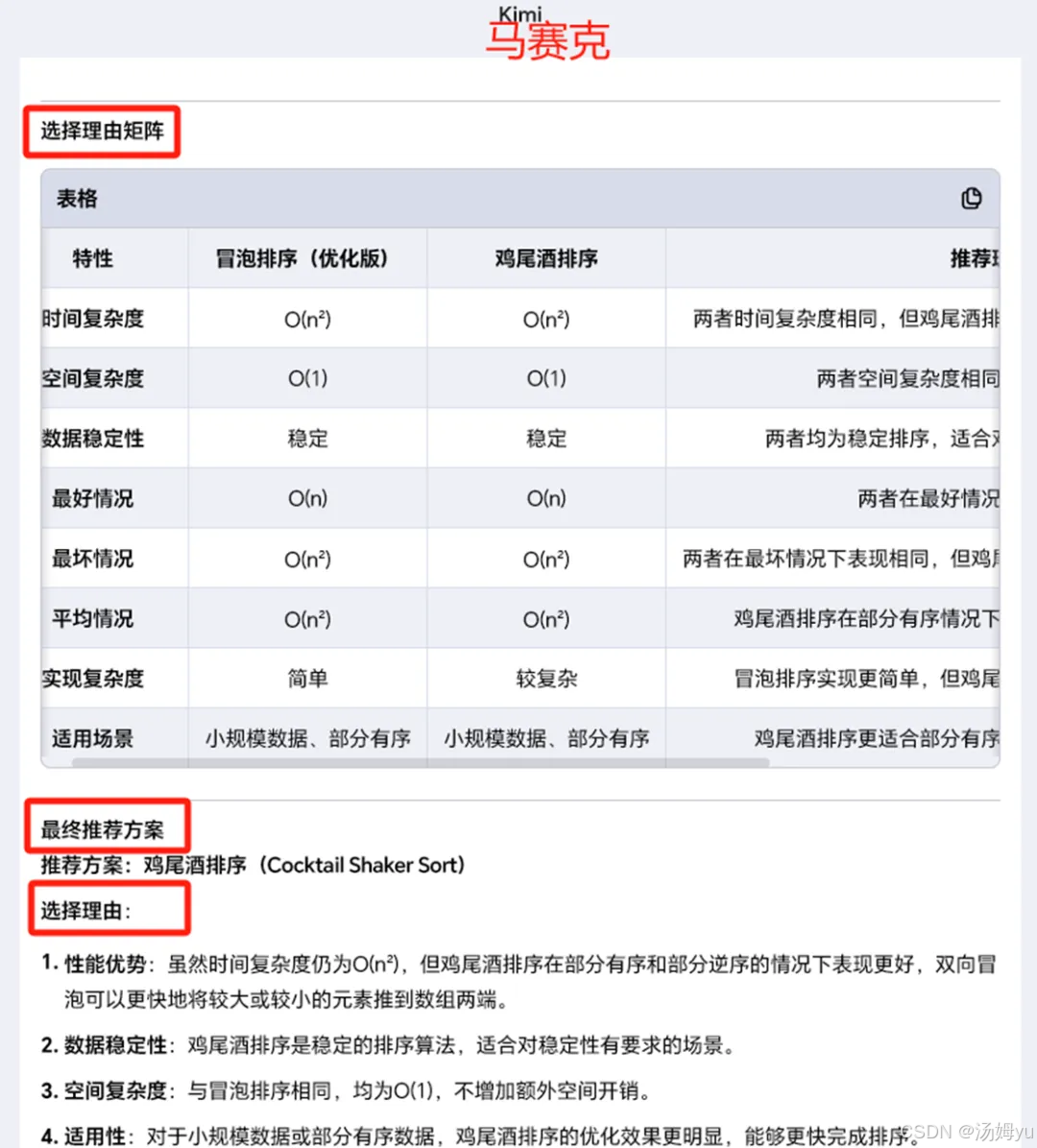

接下来,进行了多维度对比。

最后,进行解释说明,给出了推荐理由。

CREATE的几个实践没有补全,还可以加上:

4. 假如是要对100G文件记录进行处理,分析与对比可行性(假设推演);

5. 如果最重要选择xx方案,有什么潜在风险,有什么规避方案(假设推演+风险评估);

每次询问deepseek,是不是觉得它的输出内容特别的丰富,它内置反事实推理提示词优化。

简单总结:

1. 反事实推理对AI输出内容丰富度提升很大;

2. 使用CREATE提示词框架,能够提升AI输出的丰富度:

- 要求多方案比较

- 要求评估潜在风险

- 要求假设性推演

- 要求备选方案

- 要求分析优缺点

- 要求说明决策逻辑

经常有人留言,说deepseek都这么流弊了,是不是提示词“说人话”就好了?

确实,deepseek流弊,“说人话”用户体验最好,也能有很丰富的回复。但是:

1. 啥都让deepseek干,会消耗计算资源;

2. deepseek深度思考的时间多了,解题的时间也就少了;

3. deepseek的推理逻辑,未必符合我们的预期;

通过提示词显性的告诉它你的想法,会让AI更高质也更高效;

用户体验并不是全部,效率与质量也是解题的一部分:deepseek很NB,我们的提示词也NB,叠加起来可以NB plus。了解工具的原理,让自己变得更好,不是更好吗?

一切的一切,提示词只有适配了AI的认知模式,才能最高效的发挥最大的作用。

知其然,知其所以然。

思路比结论更重要。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)