将deepseek部署到自己本地的电脑上,直接无视“服务器繁忙”

本地部署/个人使用/秒级响应/无视网络将deepseek搭建到自己的电脑上面,做到即问即答,直接没有了“服务器繁忙”的焦虑。

最近deepseek的爆火,意味着人工智能领域另一项新的突破。但是由于访问人数的过多/过载,系统处理的速度和反应能力还是有些堵塞。下面我将带领大家,将deepseek搭建到自己的电脑上面,做到即问即答,直接没有了“服务器繁忙”的焦虑。甚至在没有网络的情况下,也可以正常使用 不影响体验感。

搭建自己的deepseek需要使用下面两个平台:

一个是Ollama,网址:Ollama

另一个是Cherry Studio,网站:Cherry Studio 官方网站 - 全能的AI助手

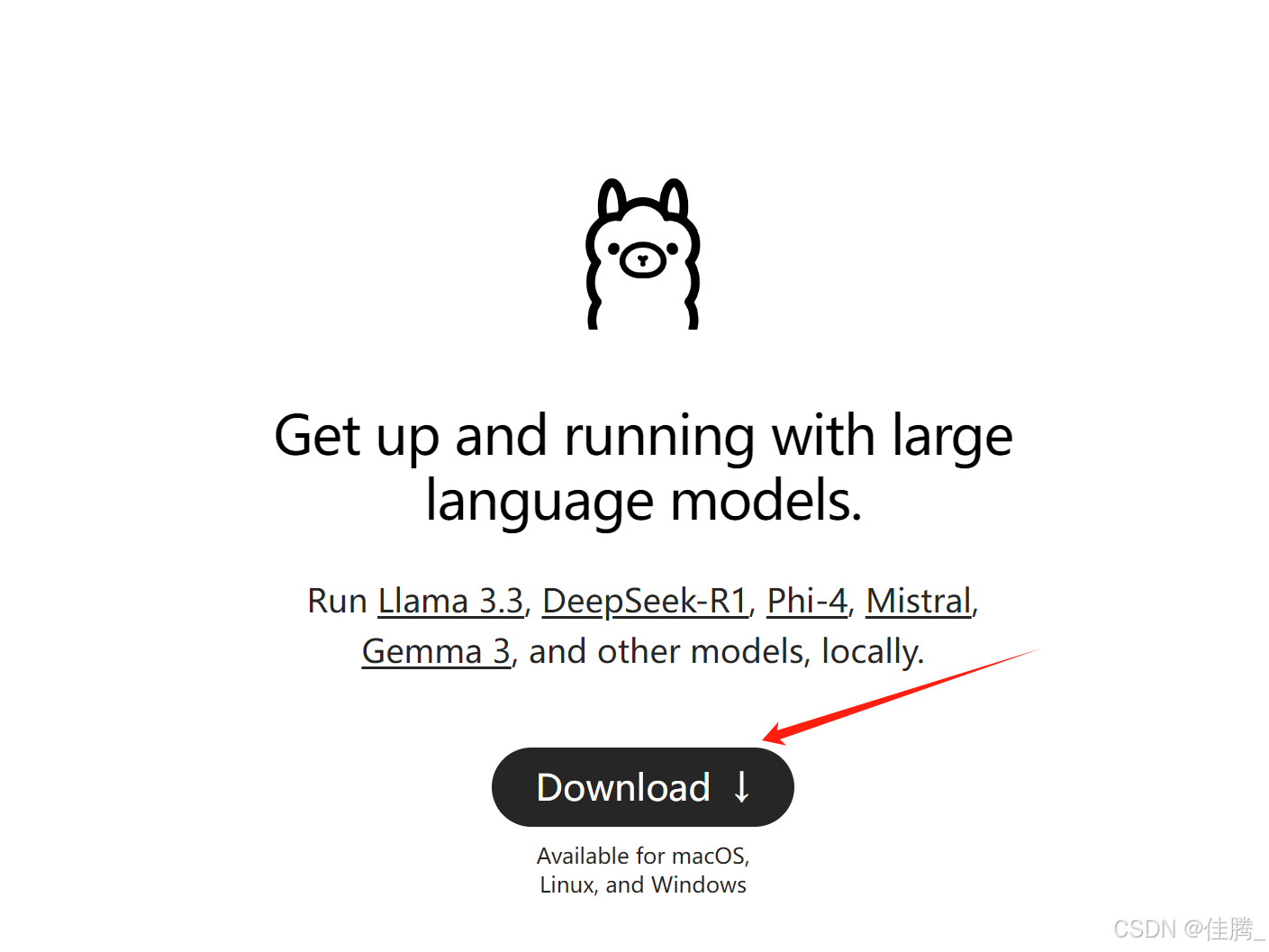

第一步:先进入Ollama的官方网站:Ollama,点击Download 进入页面。

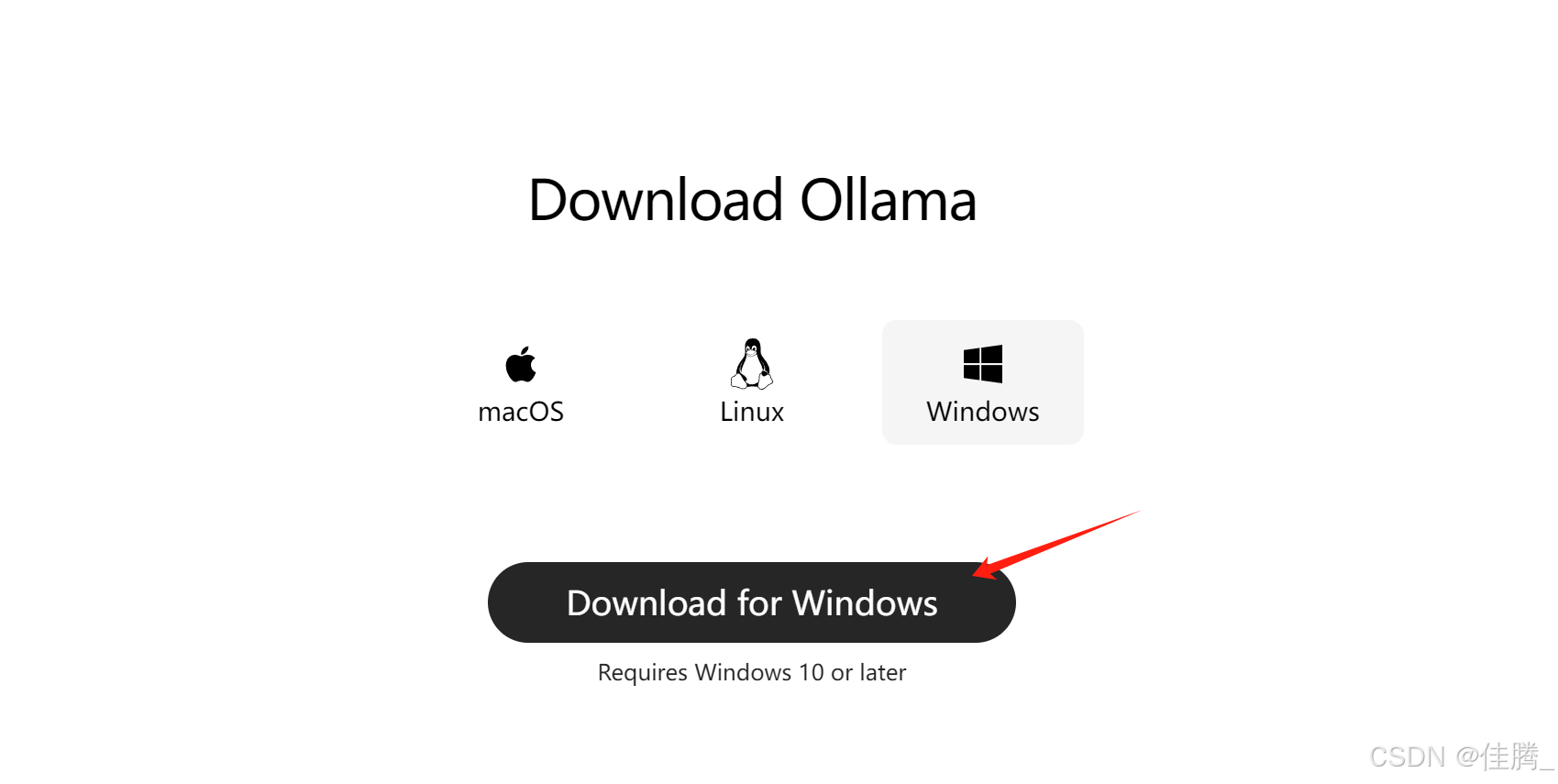

第二步:可以根据自己的需要,选择要下载的系统。这边小编使用的是windows版的演示方式。点击下面的Download for windows进行下载就可以。

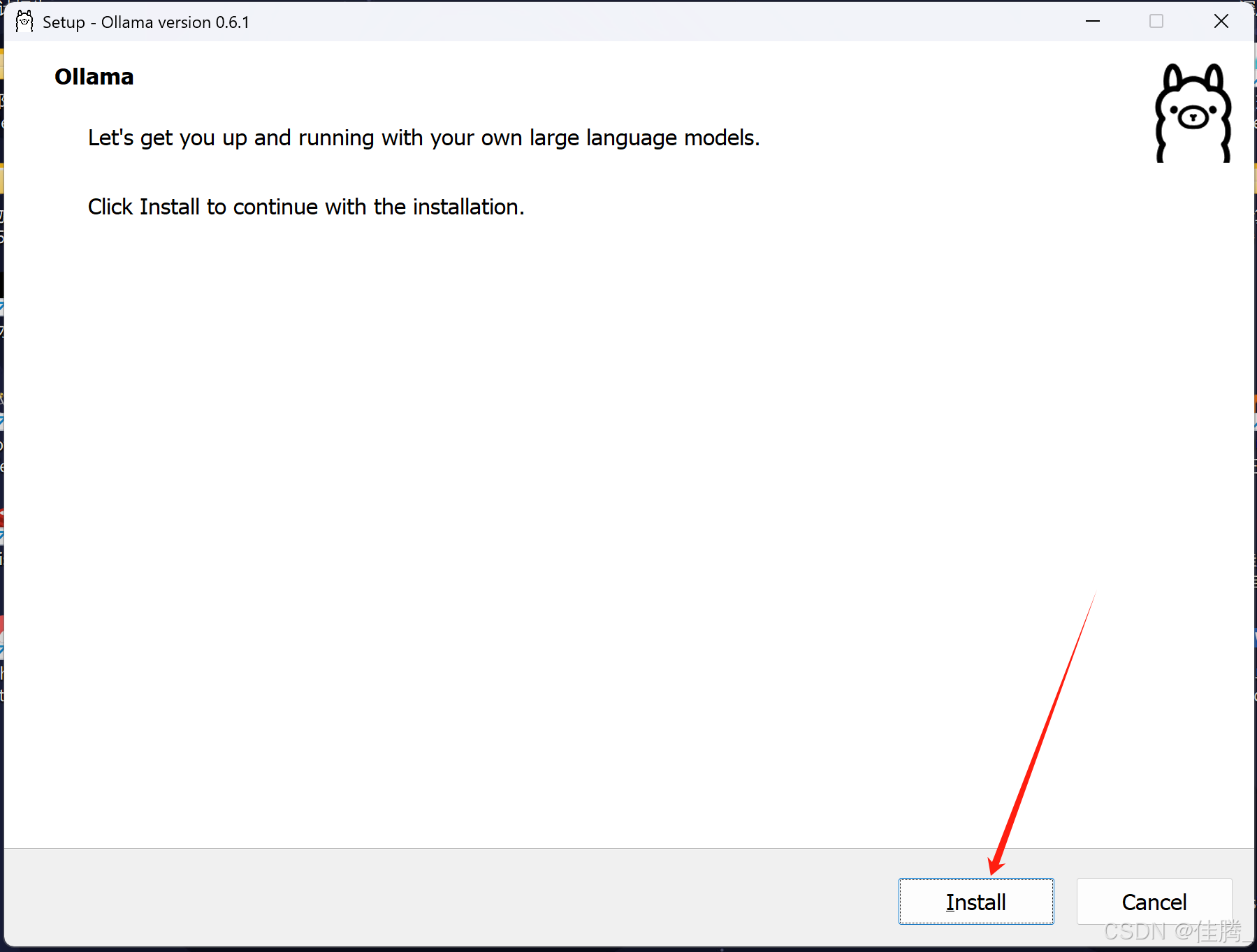

第三步:下载完成后,“傻瓜式”操作,直接安装就行。

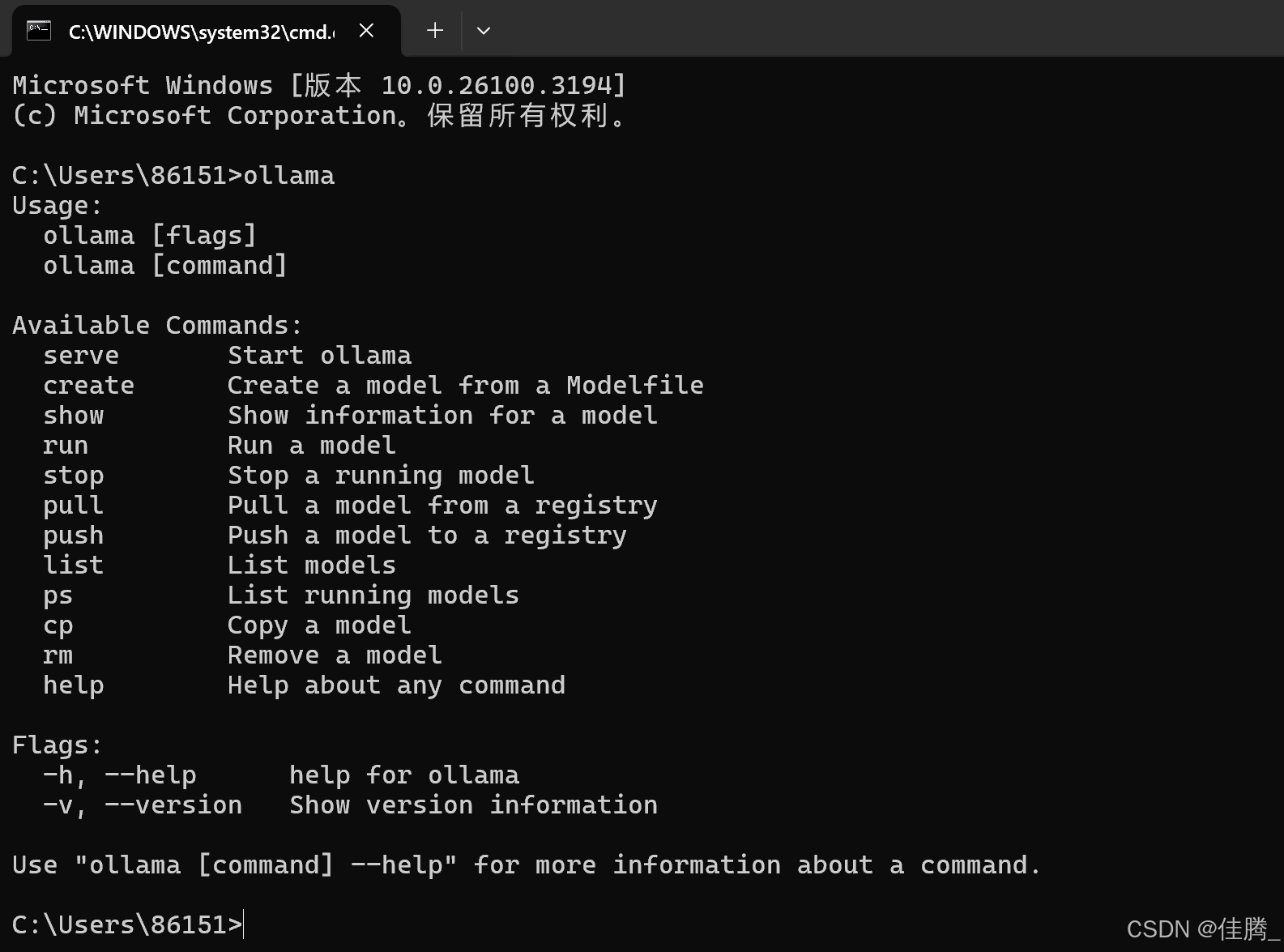

第四步:安装完成之后,打开cmd命令提示符,输入ollama,出现下面这个提示就算是安装成功了(如果提示找不到相关的命令,有可能是环境变量的问题,可以将ollama的安装目录添加到环境变量里面,注意上下顺序)

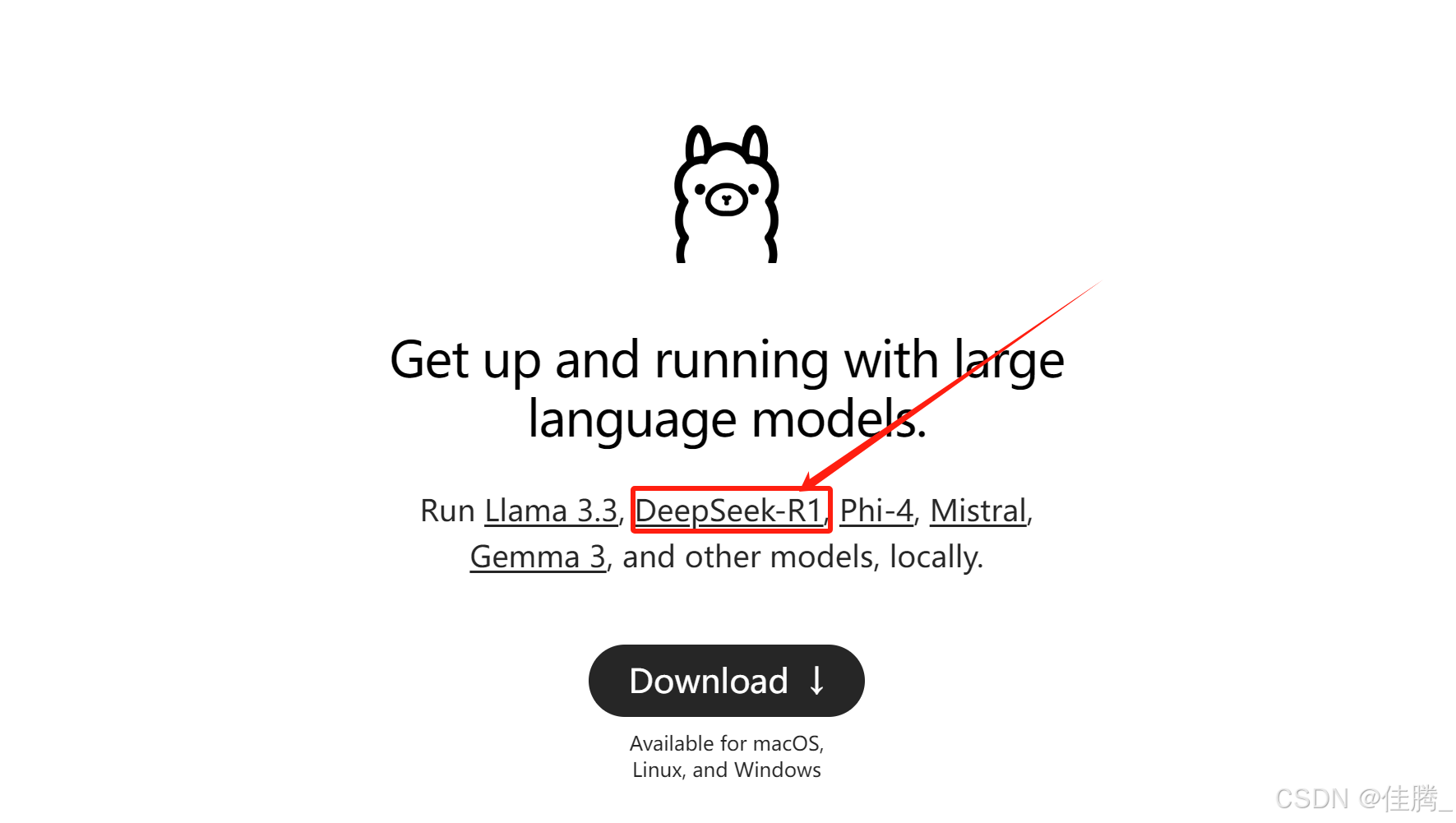

第五步:返回到ollama的官方网站的主页,点击这个DeepSeek-R1,进入

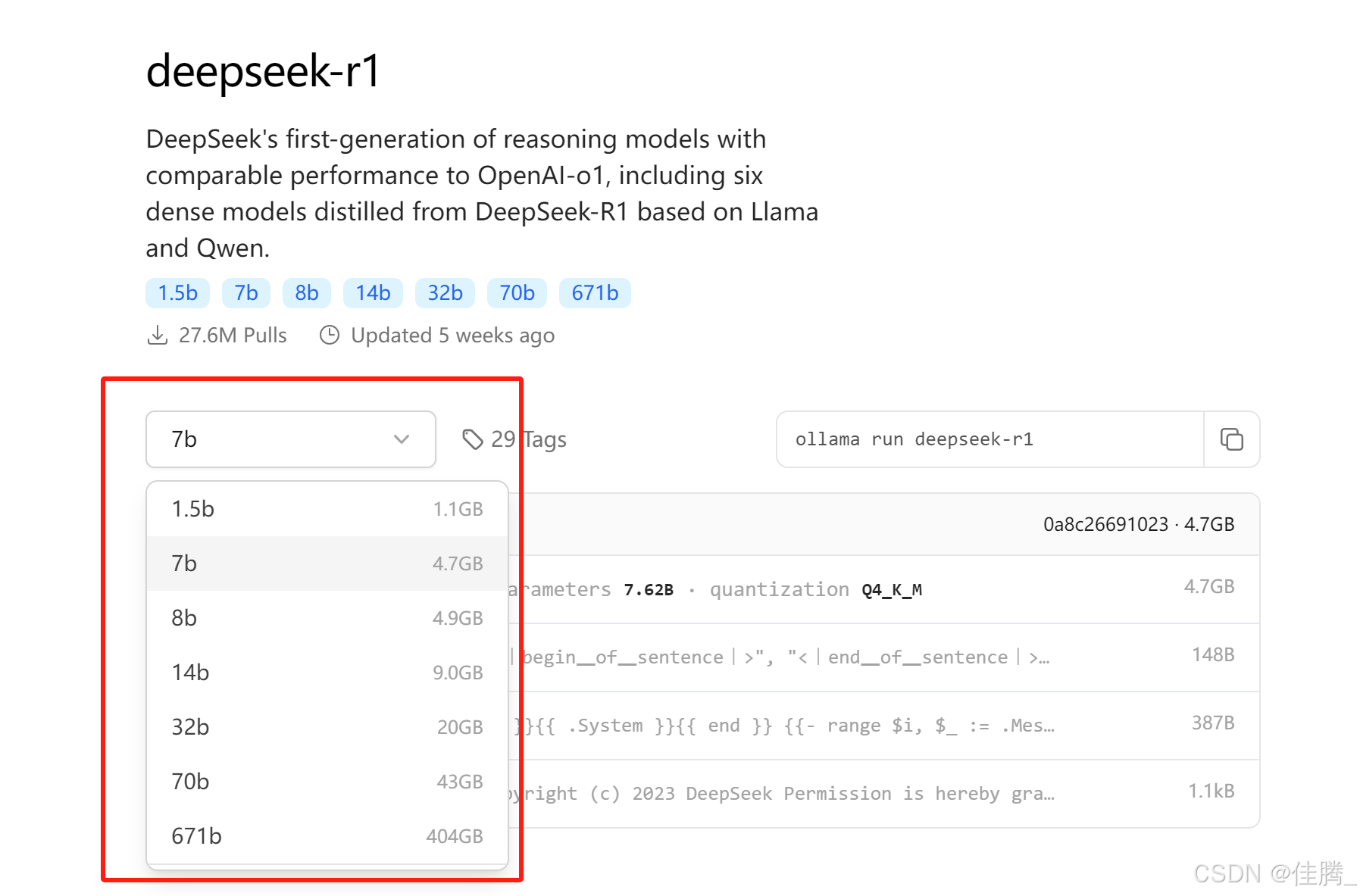

左边有不同性能的大模型,数值越大 即性能就越好,回答的准确率就越高,但所消耗的内存资源也是巨大的。一般来说,如果电脑有独立显卡 并且是8G的,可以选择7b/8b,这样的匹配度是最好的。(根据自己电脑的情况来定)

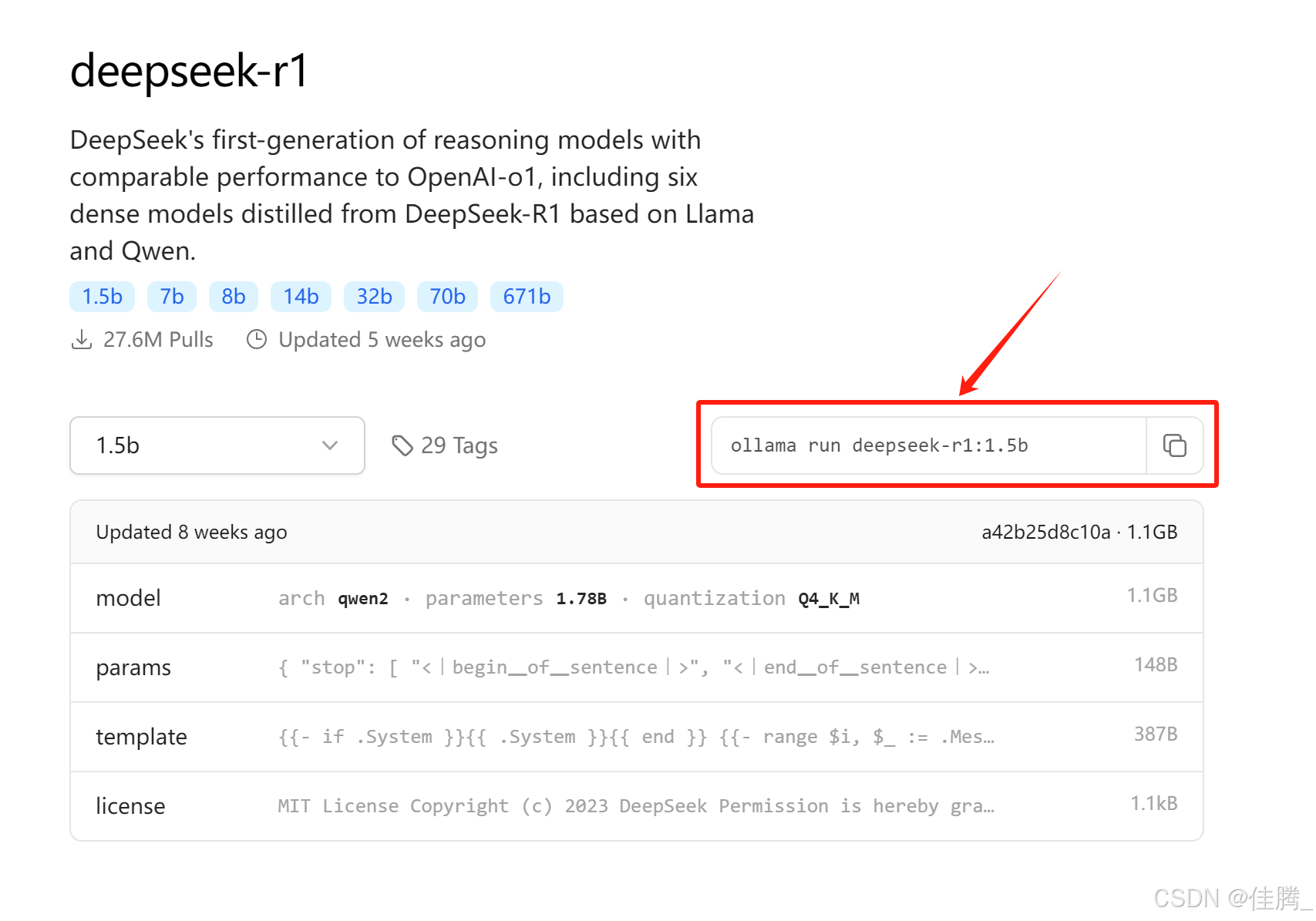

选择好模型之后,将右侧的命令复制到cmd命令提示符中,进行安装。安装完成后,就会出现在命令行下进行的人机交互的体验。

第六步:为了实现像官方deepseek那样图形化的交互体验,我们就会使用到第二个工具“Cherry Studio”。官方链接:Cherry Studio 官方网站 - 全能的AI助手。直接进行下载即可。

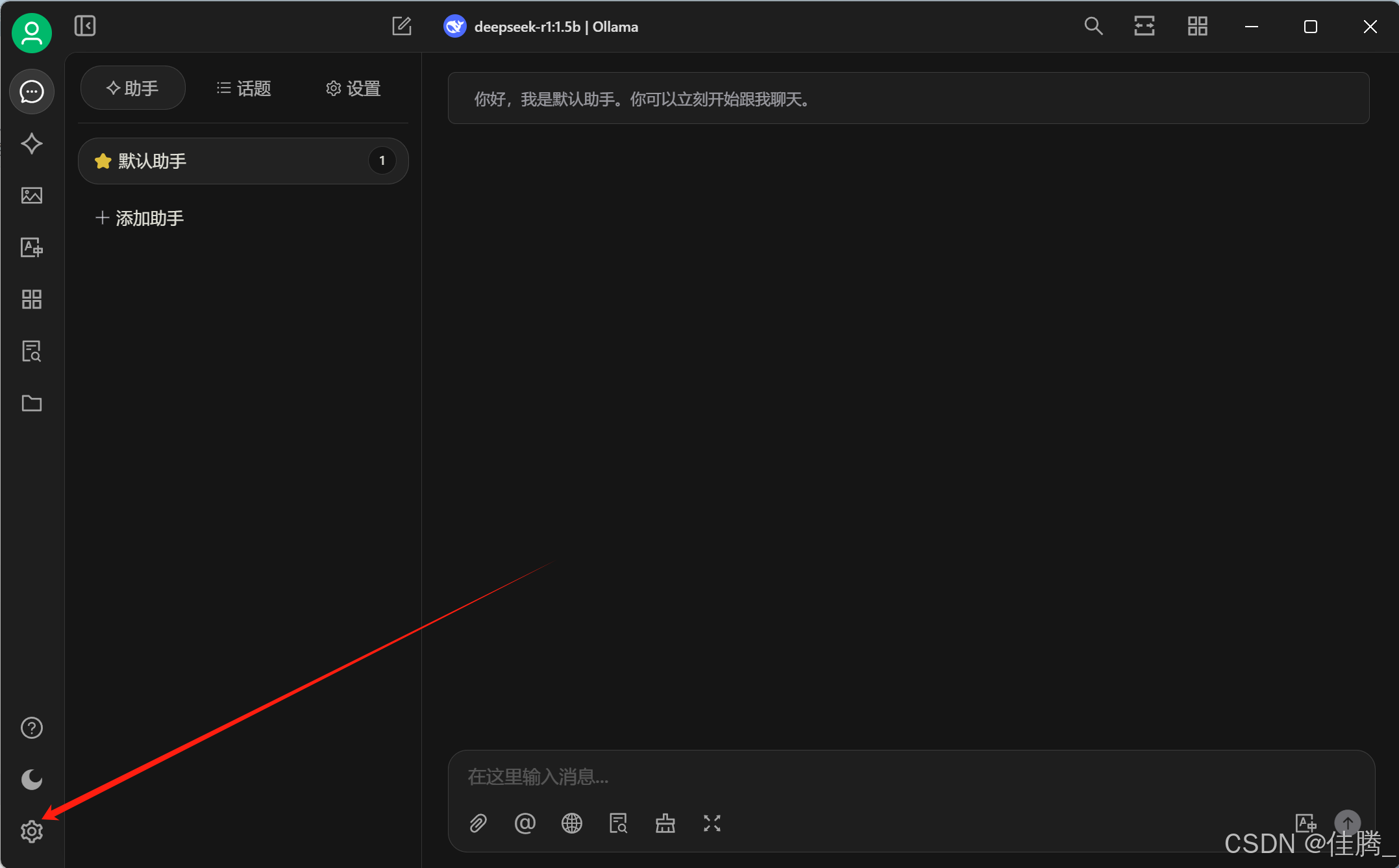

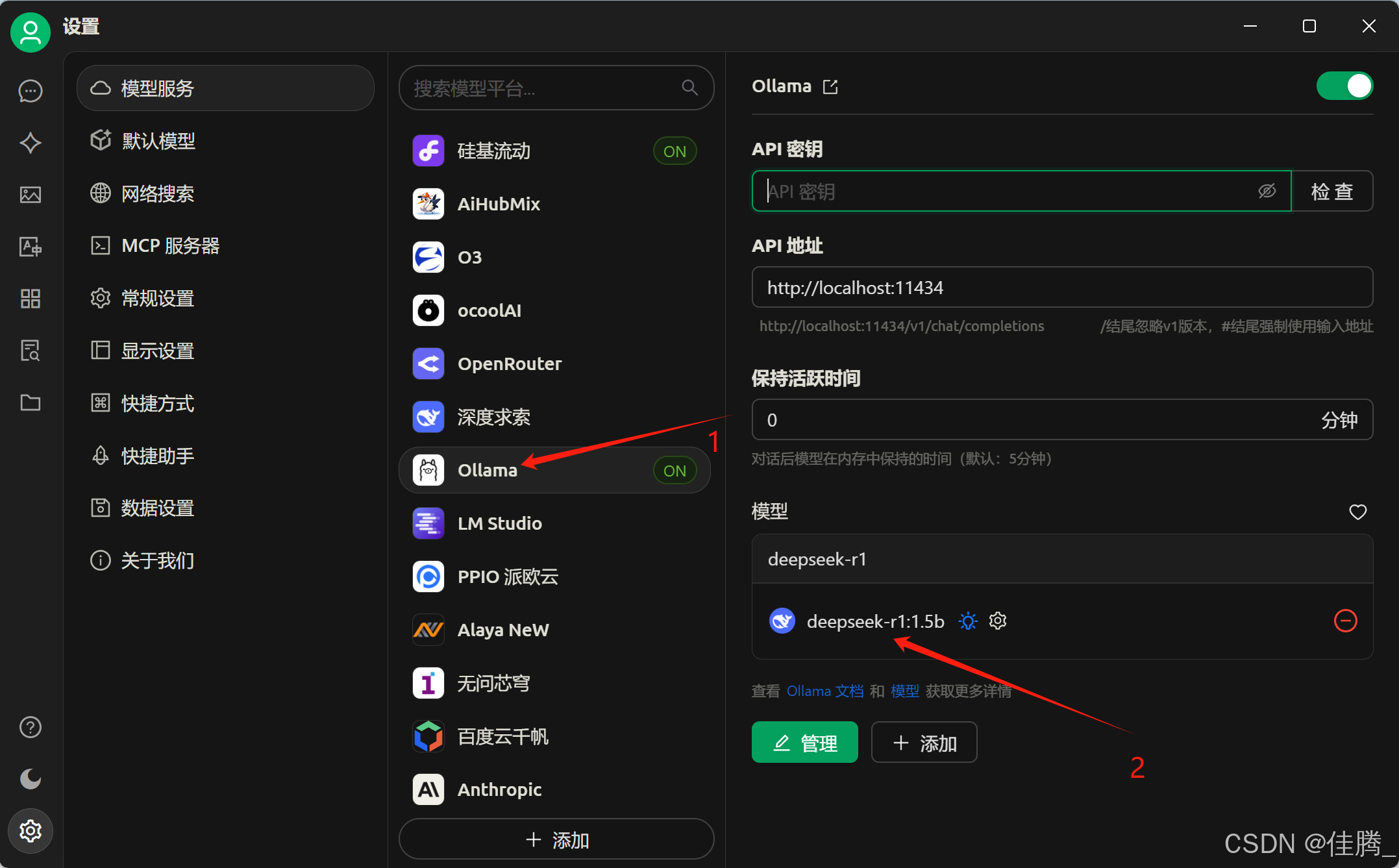

第七步:下载完成之后,点开左下角的设置,将刚刚安装的ollama相关的大模型版本进行一个导入。

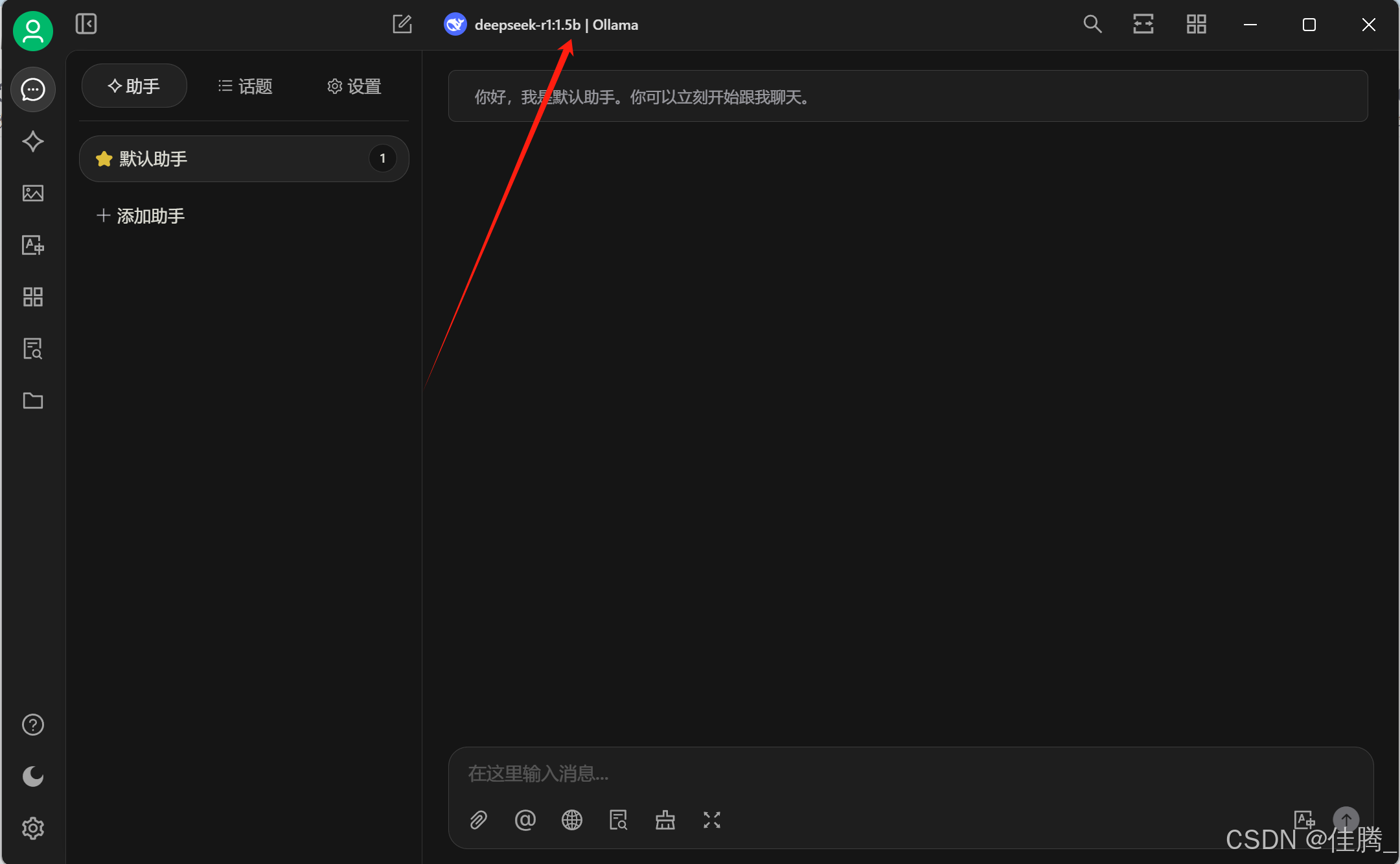

可以同时添加多个版本的大模型。在首页的上方可以随时随地的进行切换。

可以同时添加多个版本的大模型。在首页的上方可以随时随地的进行切换。

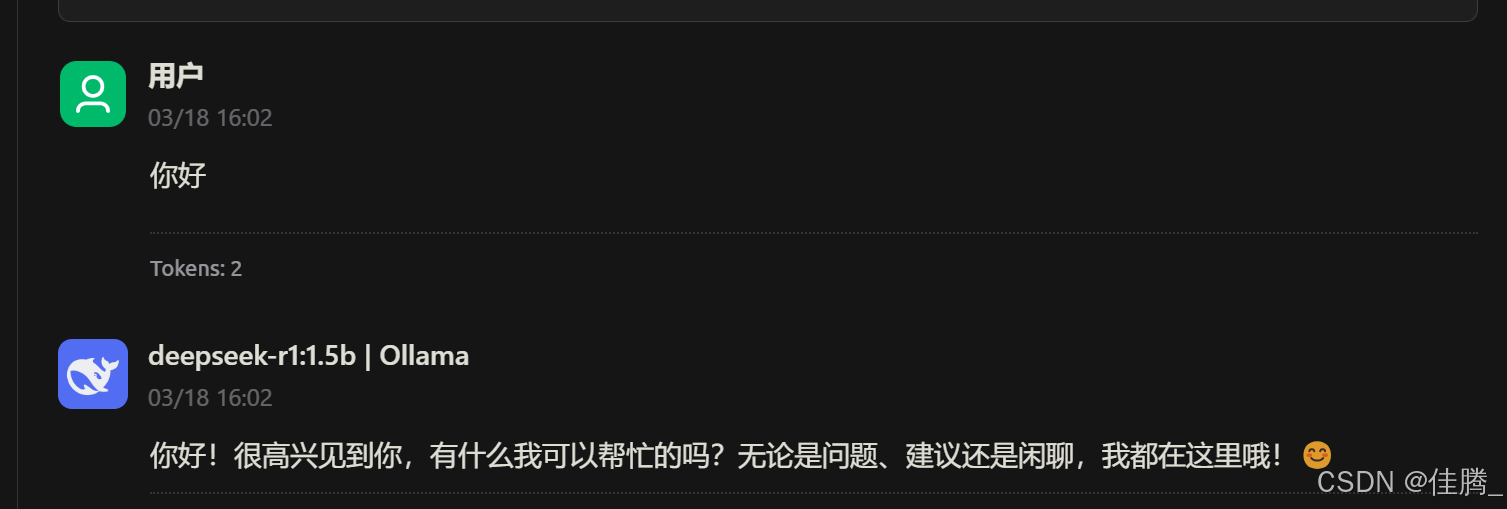

这时,就可以发送一个问答,来进行部署的测试咯。回答的速度还是非常快的。

以上操作,就是在本地搭建一个属于自己的deepseek。并且在没有网络的情况下,也能做到问答自如。

谢谢各位的观看与学习,有任何问题都可以及时跟小编私信哦。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)