轻量应用服务器也可以一键部署DeepSeek-R1啦

随着DeepSeek的横空出世,在春节期间,DeepSeek这把火几乎烧遍了全球,随处可见的公众号,小红书,技术博主等各种渠道都可以看到DeepSeek的身影,各种部署方案,体验视频,操作文档等也纷至沓来。那么什么是 DeepSeek呢?什么是DeepSeek-R1?DeepSeek-R1 是2025年1月20日正式发布,并同步开源模型权重。DeepSeek-R1 遵循 MIT License,允

轻量应用服务器也可以一键部署DeepSeek-R1啦

前言

随着DeepSeek的横空出世,在春节期间,DeepSeek这把火几乎烧遍了全球,随处可见的公众号,小红书,技术博主等各种渠道都可以看到DeepSeek的身影,各种部署方案,体验视频,操作文档等也纷至沓来。那么什么是 DeepSeek呢?什么是DeepSeek-R1?

什么是DeepSeek-R1

DeepSeek-R1 是2025年1月20日正式发布,并同步开源模型权重。

DeepSeek-R1 遵循 MIT License,允许用户通过蒸馏技术借助 R1 训练其他模型。

DeepSeek-R1 上线 API,对用户开放思维链输出,通过设置 model=‘deepseek-reasoner’ 即可调用。

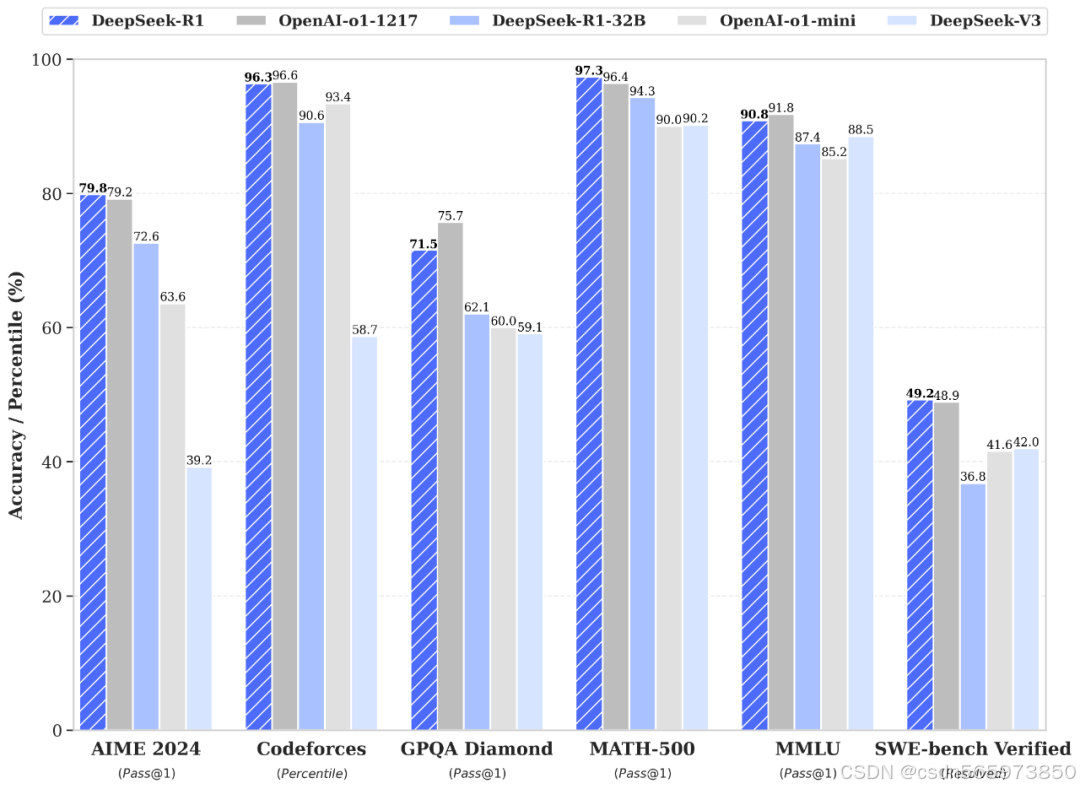

性能方面,DeepSeek-R1 在后训练阶段大规模使用了强化学习技术,在仅有极少标注数据的情况下,极大提升了模型推理能力。在数学、代码、自然语言推理等任务上,性能比肩 OpenAI o1 正式版。

这里大家看到了一个新名词【蒸馏技术】,那么什么是 蒸馏技术?

蒸馏技术

蒸馏技术,大白话理解可以这样说:你有一个问题,那么你会搜索这方面的资料,那么资料很多,你就需要从这一堆资料中把你关注问题的精华部分提炼出来,通过自己的语言进行重组,保留关键信息的同时更利于自身记忆分享。

那么在深度学习和人工智能领域,蒸馏技术就是说从大模型中提取核心知识或特征,通过一种更高效、精简的方式展现出来,通过提炼后的内容更利于大模型理解,从而提高计算效率或降低资源消耗。

在线体验

说了这么多,那么我们先去DeepSeek官网体验一下DeepSeek的模型推理究竟有多强,官网地址:https://www.deepseek.com/ 首次体验的话需要先注册账号,在官网首页直接点击【开始对话】跳转到 DeepSeek 登录页面,在登录页面输入手机号,验证码点击【登录】即可

登录成功后我们在DeepSeek在线体验页面,选中【深度思考(R1)】,同时输入经典数学问题,鸡兔同笼:有若干只鸡兔同在一个笼子里,从上面数,有35个头,从下面数,有94只脚。问笼中各有多少只鸡和兔?

点击发送后,DeepSeek R1 会对当前的数学问题进行详细的推理分析,这个推理分析的过程,需要用到一个推理模型deepseek-reasoner 是 DeepSeek 推出的推理模型。在输出最终回答之前,模型会先输出一段思维链内容,以提升最终答案的准确性。这个思维链内容正如我们下面展示的内容,不是最终的推理结果,而是一个推理的思考的过程。

嗯,今天老师布置了一个数学题,说是鸡兔同笼的问题。题目是说,笼子里有若干只鸡和兔,从上面数有35个头,从下面数有94只脚。然后问笼中各有多少只鸡和兔。一开始我看到这个问题的时候,有点紧张,因为这类问题好像需要用到代数,但具体怎么设方程呢?我得先冷静下来,仔细想一想。

首先,我记得鸡和兔都有一个头,所以头的数量其实就是它们的总数。题目里说有35个头,那也就是说鸡和兔的总数是35只。对吧?然后脚的总数是94只。因为鸡有两只脚,兔子有四只脚,所以脚的数量应该是鸡的数量乘以2加上兔子的数量乘以4,等于94。

不过,现在我需要找到鸡和兔子的数量,也就是两个未知数。这时候可能需要用代数的方法来解这个问题。不过,我记得有时候也可以用假设法,比如假设全部都是鸡,或者全部都是兔子,然后计算脚的数量,再和实际的比较,找出差异,进而得到答案。不过这里可能用代数更直接一些。

首先,设鸡的数量为x,兔子的数量为y。根据题目,我们知道x + y = 35,因为头的总数是35。然后脚的数量就是2x + 4y = 94。这样就有两个方程,两个未知数,可以解联立方程。

接下来,我需要解这两个方程。可能用代入法或者消元法。比如,从第一个方程x = 35 - y,然后把x代入第二个方程里。这样第二个方程就变成2*(35 - y) + 4y = 94。展开的话就是70 - 2y + 4y = 94,也就是70 + 2y = 94,然后2y = 94 -70 =24,所以y=12。然后x=35-12=23。所以鸡是23只,兔子12只?

不过,我是不是哪里算错了?让我再检查一遍。比如,假设鸡23,兔子12,总头数是23+12=35,对的。脚数的话,23*2=46,12*4=48,加起来46+48=94,没错。所以应该是对的。

不过,刚才用的是代数的方法,可能老师还希望用其他方法,比如假设法。比如假设所有都是鸡,那么35只鸡的话,脚数应该是35*2=70只,但实际是94只,少了94-70=24只脚。每只兔子比鸡多2只脚,所以需要把多少只鸡换成兔子才能补上24只脚呢?24/2=12,所以需要换12只鸡为兔子,也就是兔子12只,鸡35-12=23只,和之前的结果一样。这样看来两种方法都得到同样的答案,应该是正确的。

不过,我还是有点担心自己是不是哪里漏掉了。比如,是否有可能出现分数的情况?比如,如果脚数不是偶数或者无法整除的话,可能会有问题,但这里算出来的都是整数,所以没问题。而且实际数值代入后也符合,所以应该没问题。

总结一下,鸡有23只,兔子有12只。

那么整个的操作流程就是这样的,下面我准备了一个视频展示一下操作效果:【DeepSeek 鸡兔同笼推理视频】 https://www.bilibili.com/video/BV1qFAVewEmn/?share_source=copy_web&vd_source=bc8f8a81487b74186021d383c25648ad

异常情况

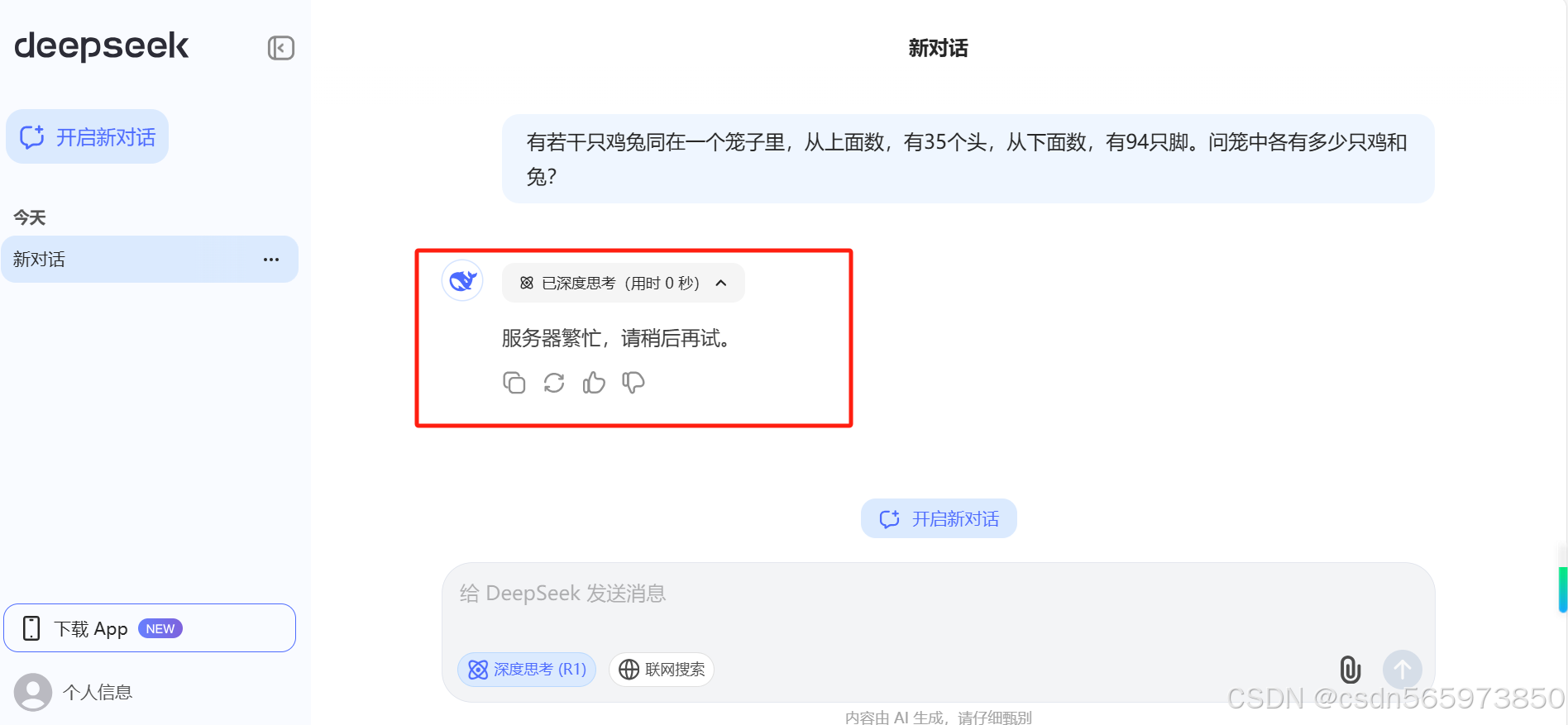

但是由于目前 DeepSeek的官方体验窗口总是会出现资源不够用的情况,可能会导致【服务器繁忙】而没有返回,比如这样的效果

或者是你点击官网首页的开始对话会直接提示Internet error等,遇到这种情况的话,等待或者过几分钟刷新页面时最好的选择,频繁的刷新并不会有任何改变哦。为了有一个更稳定的可以玩耍的DeepSeek R1 服务,何不自己来部署一个呢?

那么下面我们就来通过腾讯云轻量应用服务器提供的AI 镜像模板来自己搭建部署一个 DeepSeek R1 服务来体验吧!

部署DeepSeek R1

这里我们讲述的是通过轻量应用服务器来部署DeepSeek R1 服务,对于还没有轻量应用服务器的小伙伴,那么你首先需要购买轻量应用服务器。

开通服务

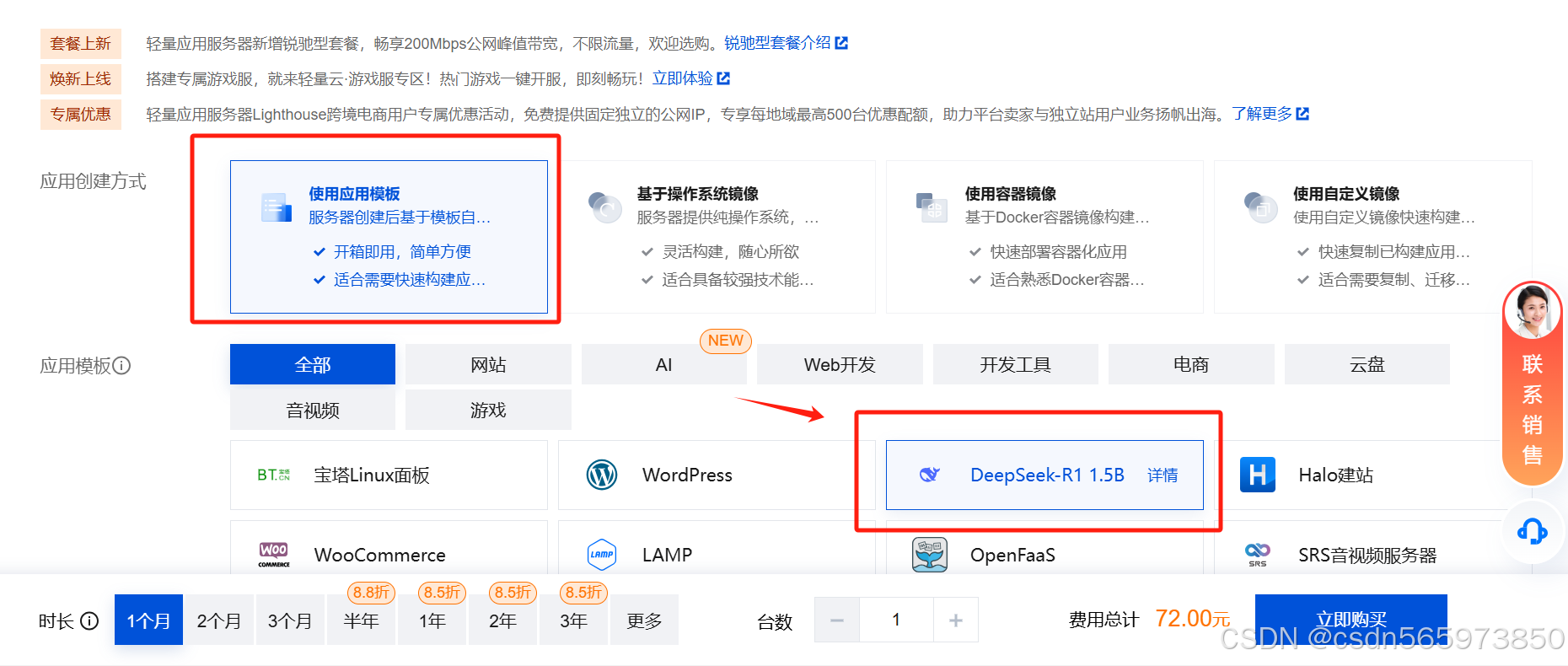

在使用轻量应用服务器搭建 DeepSeek R1 服务之前,如果你还没有购买轻量应用服务器,那么你可以登录腾讯云控制台:https://console.cloud.tencent.com/lighthouse/instance/index?rid=8 点击【新建】在轻量应用服务器新建页面 应用创建方式 选择【使用应用模板】,应用模板选择【DeepSeek-R1 1.5B】

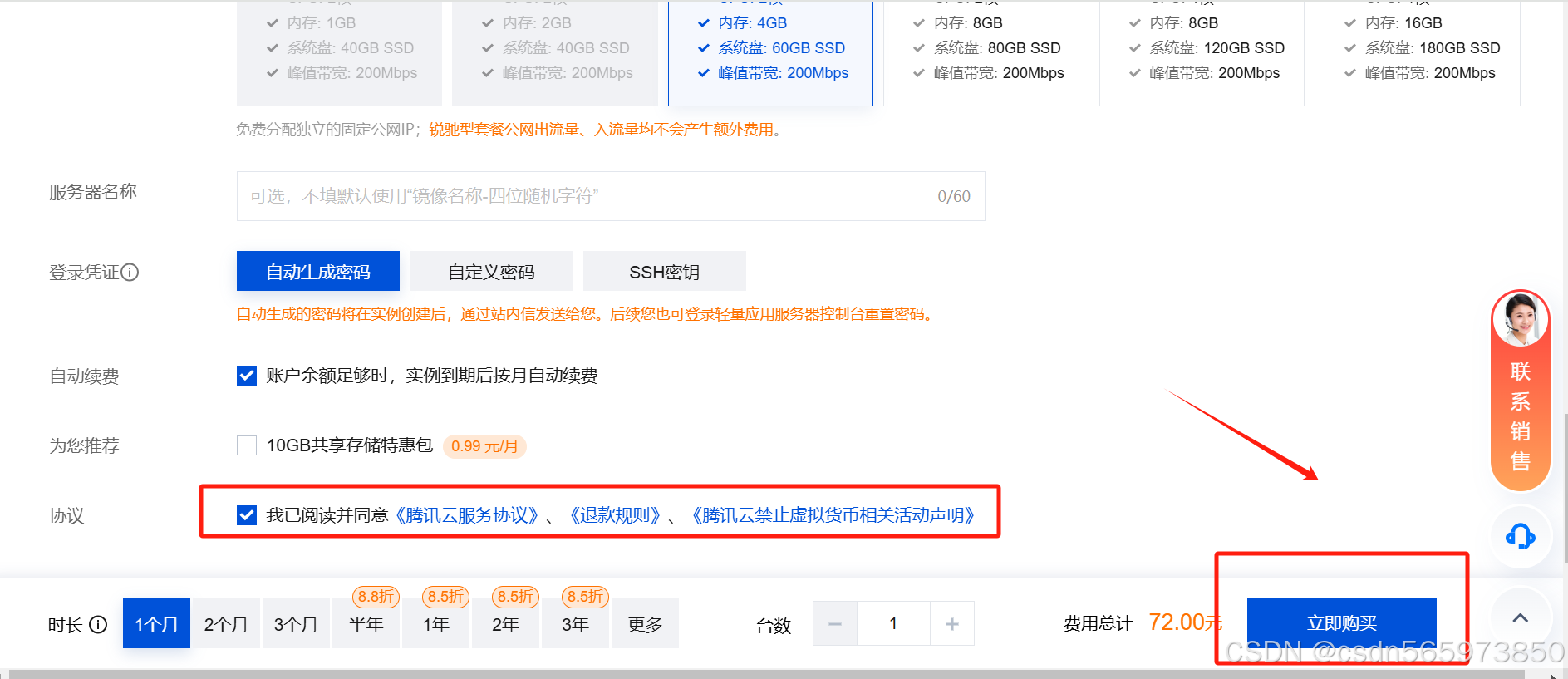

继续下拉,地域、可用区、套餐类型默认即可,这里可以看到 DeepSeek-R1 应用模板默认要求服务器内存至少 4GB 以上

继续往下,其他默认,勾选服务协议,点击【立即购买】完成轻量应用服务器的服务开通。这里的服务器名称、登录凭证可以在服务器创建之后再修改即可,这里不用操作

使用DeepSeek R1

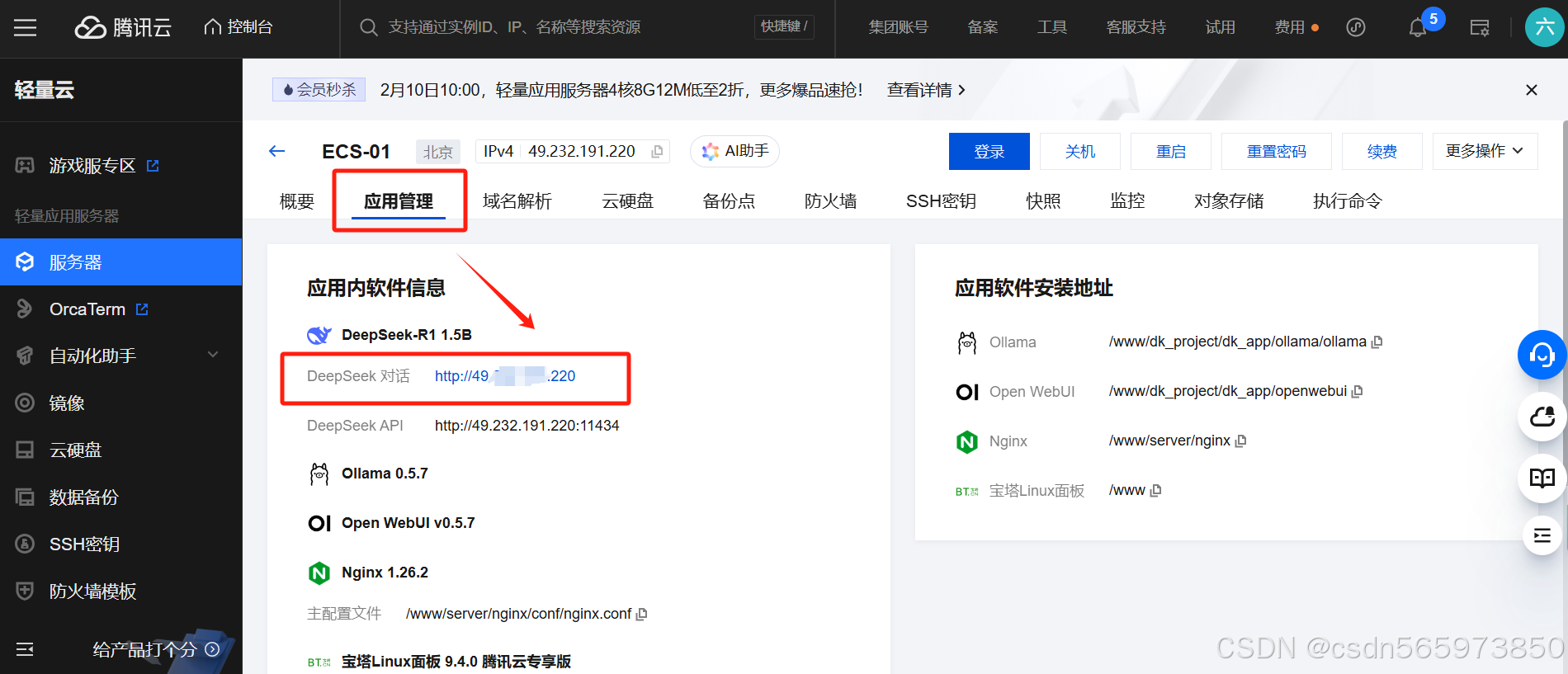

等待轻量应用服务器启动成功之后,可以在【服务器】列表页面点击服务器名称进入轻量应用服务器详情页,或者点击 【…],选择【查看详情】进入轻量应用服务器详情页

在轻量应用服务器详情页选择【应用管理】的tab ,点击DeepSeek 对话 后的访问地址

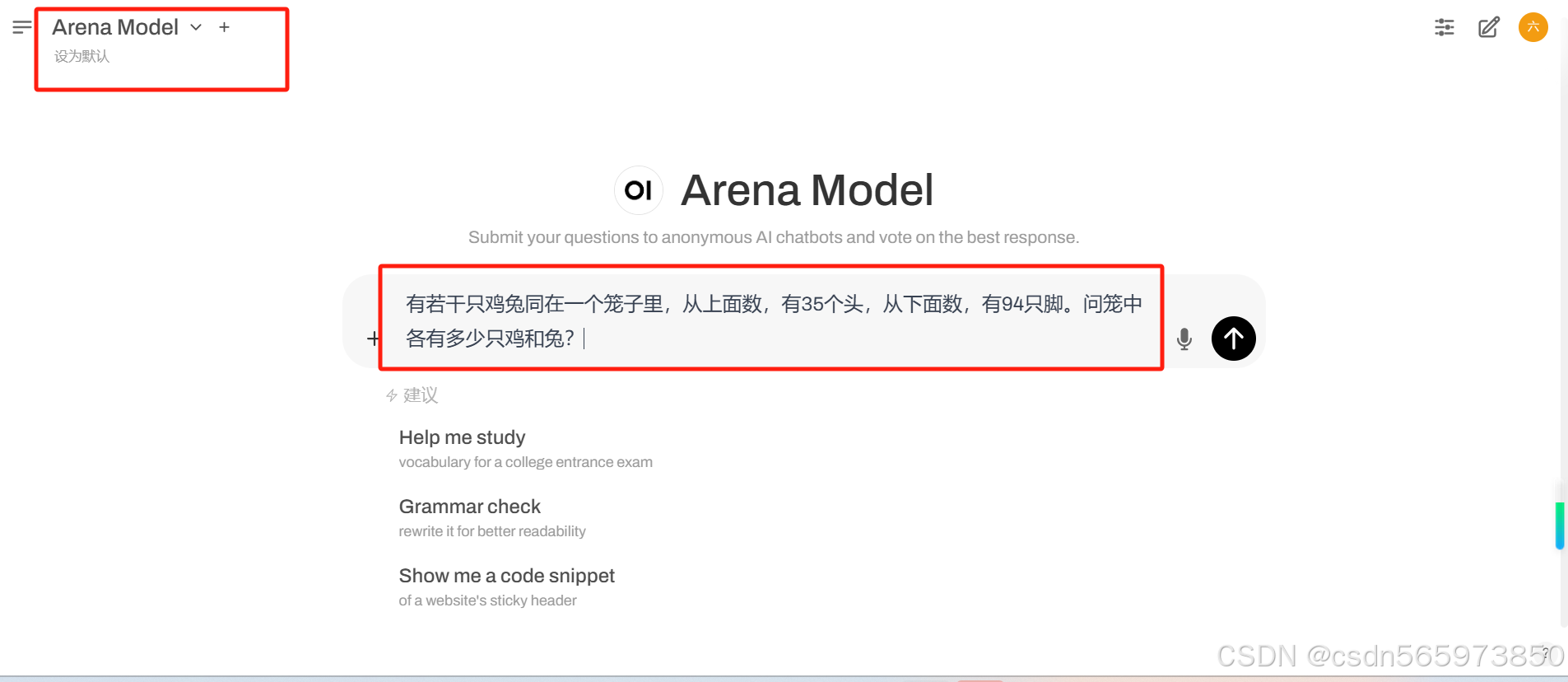

就可以进入我们自己通过轻量应用服务器部署的DeepSeek R1 服务了,服务页面默认选中是 deepseek-r1:1.5b 模型,在服务页面我们可以输入我们想要咨询的问题,比如:有若干只鸡兔同在一个笼子里,从上面数,有35个头,从下面数,有94只脚。问笼中各有多少只鸡和兔?

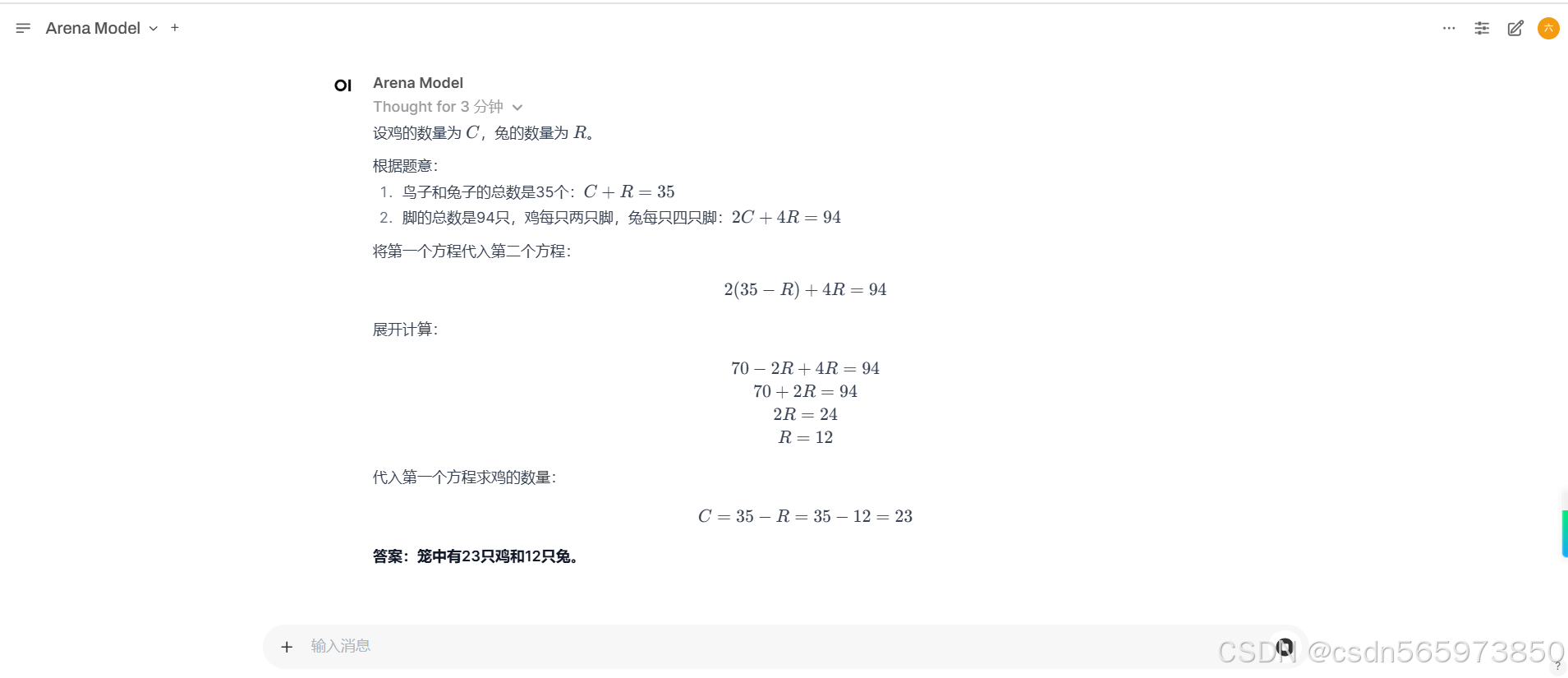

输入问题后等待DeepSeek R1 进行推理分析,这里等待的时间有点久,应该是因为轻量应用服务器计算能力的限制,理论上最好还是用HAI应用服务器部署大模型服务,效果会比较好。这里最后等待了3分钟之后,我们自己部署的 DeepSeek R1 给出了具体的推理分析结果

当然,如果你在购买了腾讯云轻量应用服务器启动成功之后,但是访问 DeepSeek 访问连接展示这样的页面,你也不用担心,这应该是服务还未加载完全,虽然服务器显示运行中,但是 DeepSeek 服务可能还没有完全启动,等待一会儿即可

切换模型Arena Model

这里我们也可以点击右上角的模型切换按钮切换为模型 Arena Model 尝试推理结果

切换模型后相同问题的执行结果

资源监控

在整个大模型分析推理过程中,我们也可以通过轻量应用服务器的控制台实时监控资源使用情况,包括CPU利用率、内存使用量、公网带宽使用、系统盘IO等资源使用情况

体验总结

最后到这里,关于使用腾讯云轻量应用服务器服务器部署DeepSeek R1 的操作就算圆满结束了,这里相比于本地部署来说,操作更简单,也不用你单独去寻找满足DeepSeek 内存及显卡条件的机器,而是可以直接通过轻量应用服务器内容的应用模板即可一键部署,操作上可以方便对于AI部署不熟悉或者不懂DeepSeek 的使用者,还是比较方便的。当然这里个人并不推荐使用轻量应用服务器来部署DeepSeek 服务,而是推荐大家使用HAI应用服务器来部署。推荐原因如下:

高性能应用服务(Hyper Application Inventor,HAI)是一款面向 AI 和科学计算的 GPU/NPU 应用服务产品,提供即插即用的强大算力和常见环境。它可以帮助中小企业和开发者快速部署语言模型(LLM)、AI 绘图、数据科学等高性能应用,原生集成配套的开发工具和组件,大大提升应用层的开发生产效率。

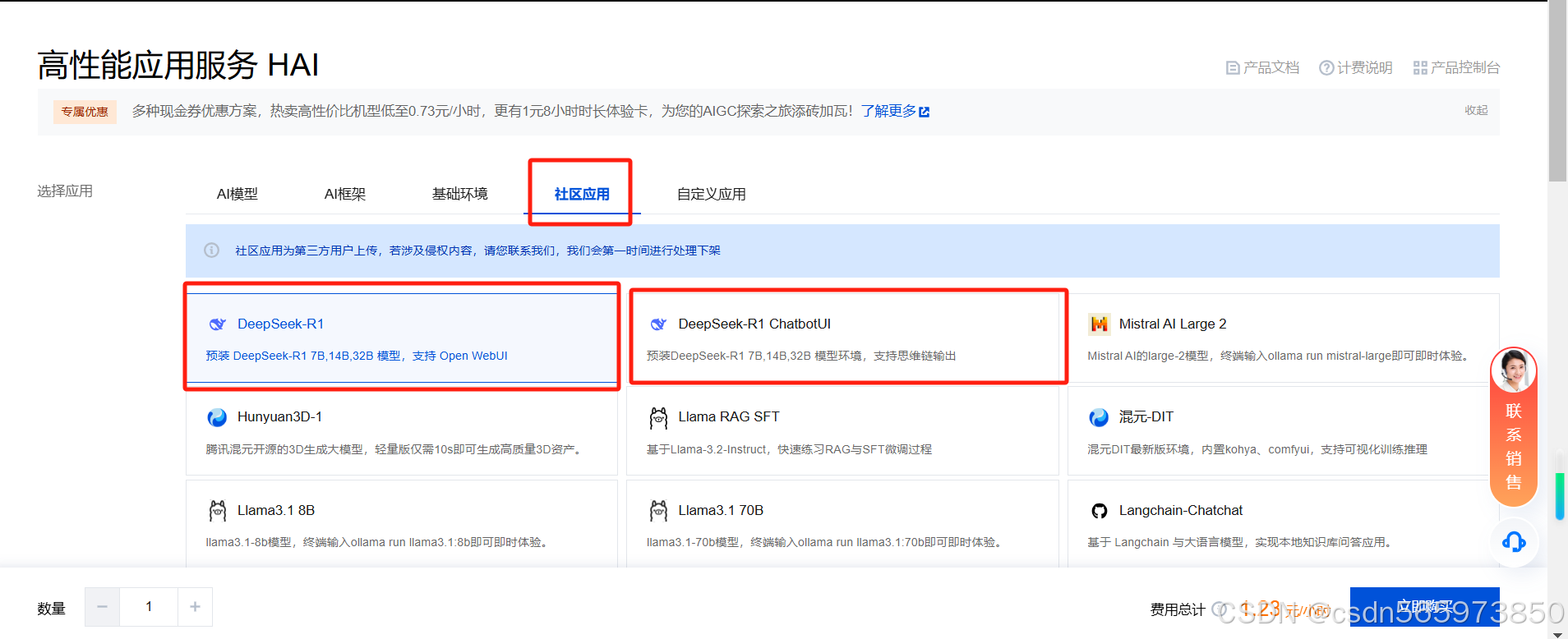

具体操作你可以在【新建】HAI应用服务器页面选择【社区应用】,选择DeepSeek R1 模板即可快速部署DeepSeek R1 服务

其他操作这里不再逐一描述,感兴趣的小伙伴快去HAI应用服务器界面操作吧。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)