如何快速的在本地部署deepseek

文章会实践如何快速本地部署deepseek,或者其他大模型

·

1. 安装Ollama

从官网下载安装包(https://ollama.com/download)直接安装。

可选配置:

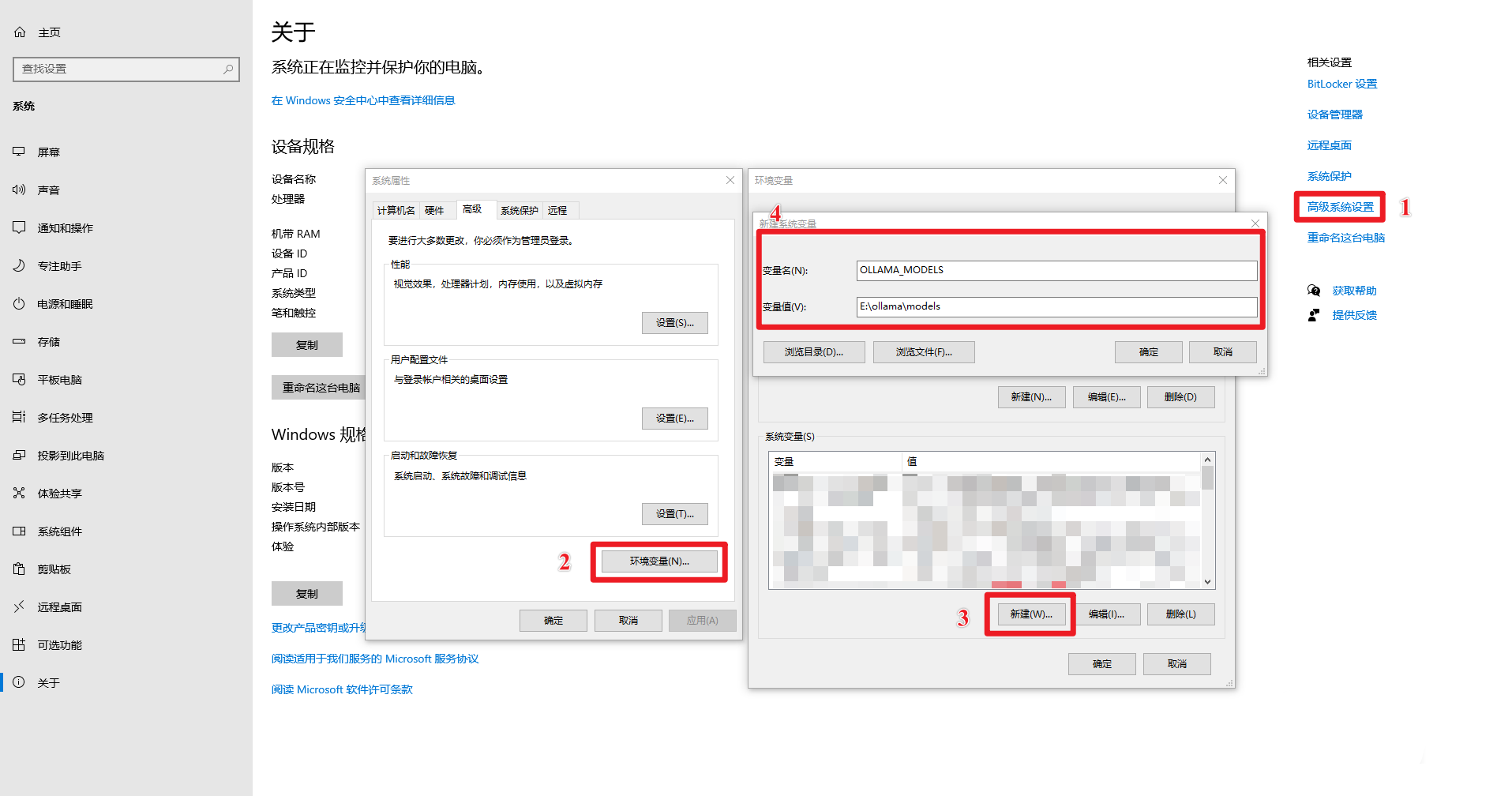

对于windows用, 可以通过OLLAMA_MODELS 环境变量来更改模型存储位置。

默认情况下,Ollama 模型会存储在 C 盘用户目录下的 .ollama/models 文件夹,占用 C 盘空间。 将其更改到其他分区可以更好地管理你的存储。

步骤 1:找到系统环境变量的设置入口。

-

方法 1:开始->设置->关于->高级系统设置->系统属性->环境变量。

-

方法 2:此电脑->右键->属性->高级系统设置->环境变量。

步骤 2:设置 OLLAMA_MODELS 环境变量 (更改模型存储位置)

- 在 “环境变量” 窗口的 “系统变量(S)” 区域 (或者 “用户变量(U)” 区域,根据你的需求选择),点击 “新建(W)…” 按钮。

- 在 “变量名(N)” 输入框中,输入: OLLAMA_MODELS (注意大小写,建议全部大写)。

- 在 “变量值(V)” 输入框中,输入你想要设置的模型存储路径。 例如,如果你想将模型存储到 E 盘的 ollama\models 文件夹下,你可以在 “变量值(V)” 中输入: E:\ollama\models (请根据你的实际情况修改盘符和文件夹路径)。

- 点击 “确定” 按钮,关闭 “新建系统变量” (或者 “新建用户变量”) 窗口。

注意: 如果你不知道如何设置 OLLAMA_MODELS 环境变量,可以参考下面的示例。

2. 运行deepseek

运行前可以通过 https://tools.thinkinai.xyz/ 查看当前机器能部署多少参数的模型

比如我当前的机器可以部署一个 deepseek-r1:8b 的模型:

在命令行运行如下命令:

# 这里为了方便演示,我先运行一个较小的模型(首次运行会自动下载模型文件)

ollama run deepseek-r1:1.5b

ps:如果你不知到怎么打开windows命令行,可以点击这个 文档 查看

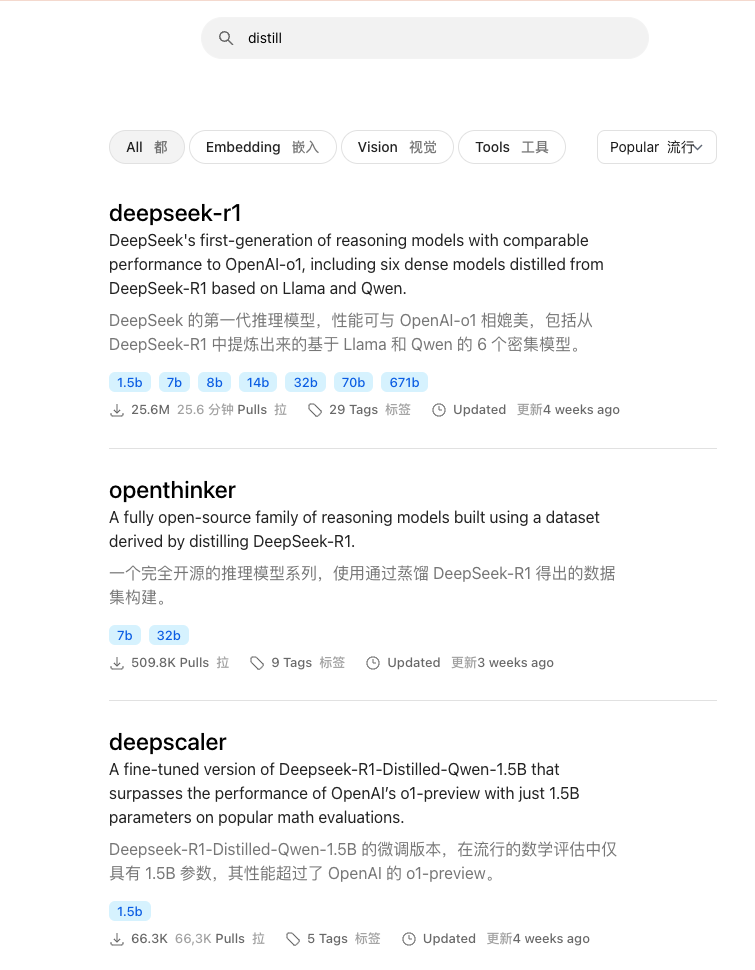

更多的模型你可以在 ollama 官网 上找到,小模型的话建议使用蒸馏过的模型,可以通过 distill 关键字搜索。

3. 验证部署

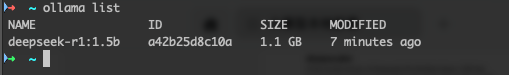

1. 查看模型是否已安装

ollama list

有如下输出,说明安装成功

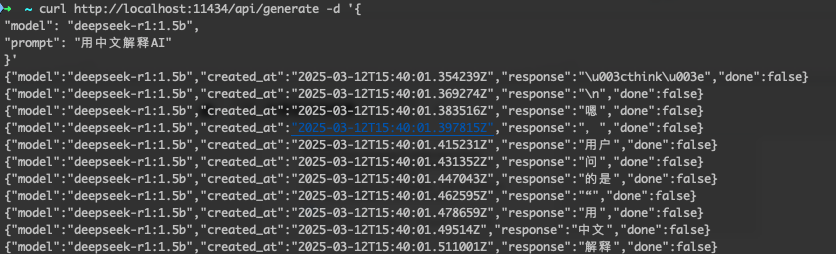

2.调用api验证

# 调用API测试

curl http://localhost:11434/api/generate -d '{

"model": "deepseek-r1:1.5b",

"prompt": "用中文解释AI"

}'

到这里模型就已经部署完成,但是命令行太原始了,接下来我们找一个对话界面工具。

4.对话界面工具

下载一个对话UI,点击 地址 前往下载对应的操作系统的安装包

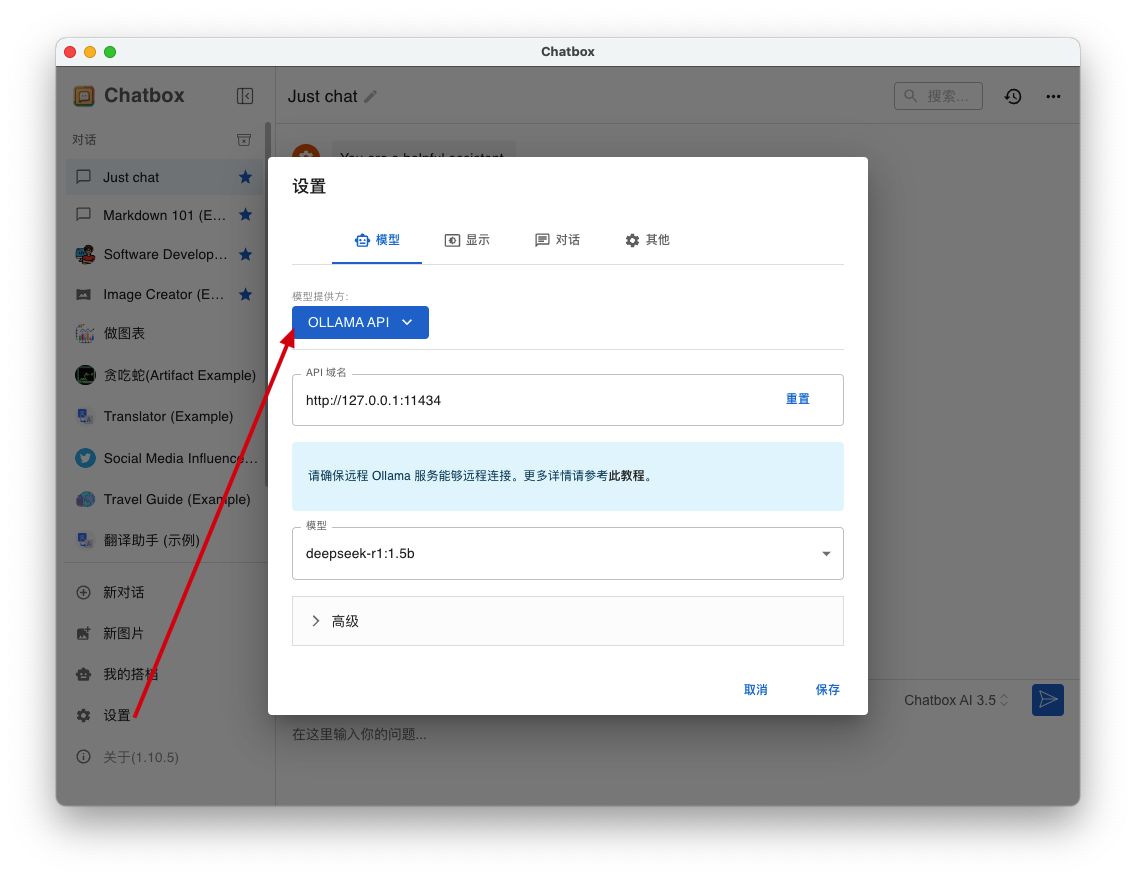

打开chatbox 后我们点击左下方设置 , 选择模型提供方为 OLLAMA API , 模型选择我们刚刚下载好的 deepseek-r1:1.5b

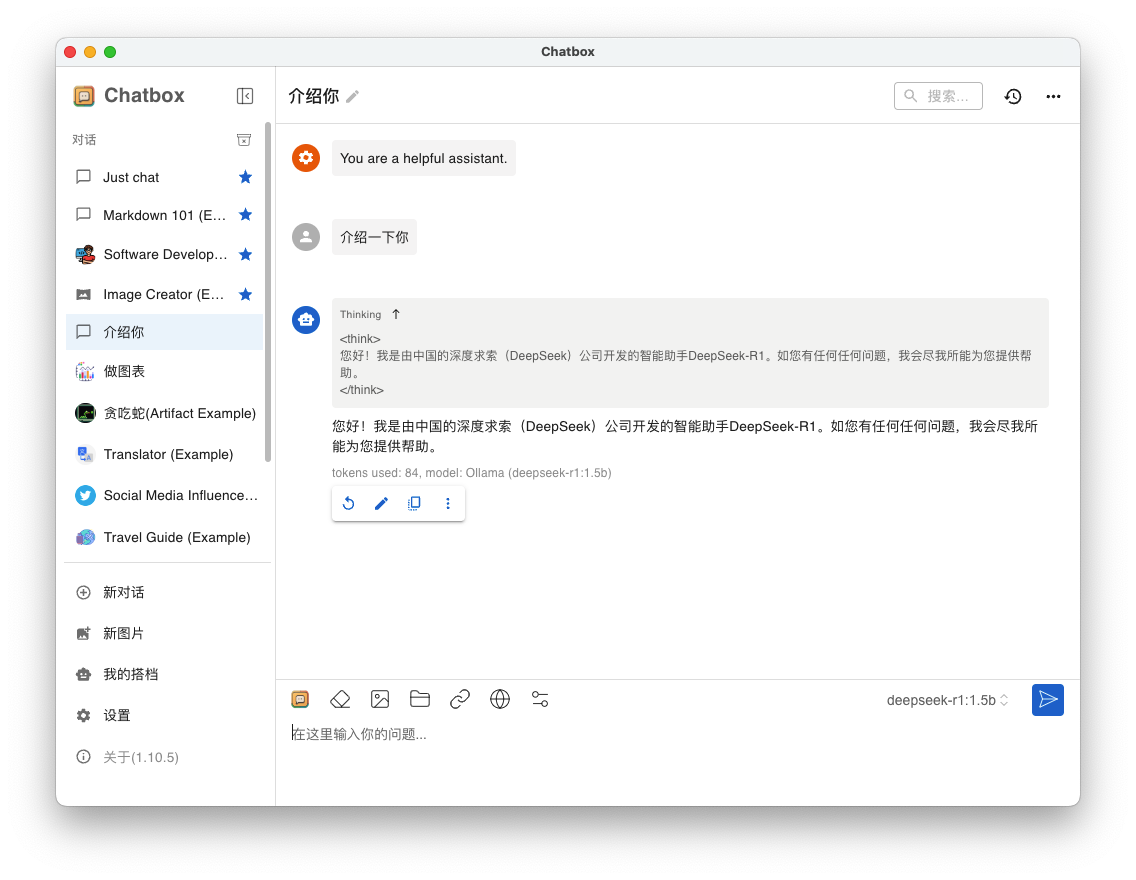

保存配置后,可以开始愉快的使用了😊

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)