DeepSeek本地化部署

DeepSeek 是中国本土开发的 AI 大模型,涵盖通用 LLM(DeepSeek-V2)和代码 LLM(DeepSeek Coder)。支持本地运行,适合隐私保护场景,可以用 Ollama 部署。对中文支持优秀,在 代码、SQL、Shell、数学推理 等方面表现不错。适合开发者、企业、本地 AI 研究人员,尤其是想要开源替代 GPT-4 的用户。✅ Ollama 让你可以 在本地运行 AI 模

一、DeepSeek 是什么

DeepSeek 是一家专注于 大语言模型(LLM)和 AI 研发 的中国公司,提供多个 开源 AI模型,包括 DeepSeek LLM、DeepSeek Coder 等。它的目标是打造 高效、开源、可本地部署 的 AI 解决方案,类似于 LLaMA、Mistral 和 OpenAI GPT 系列。

DeepSeek 是一个 AI 大模型(LLM) 项目,由中国团队 DeepSeek AI 开发,专注于 开源大语言模型(LLM) 和 AI 计算平台。DeepSeek 提供了一系列 国产 AI 模型,类似于OpenAI 的 ChatGPT、Meta 的 LLaMA,以及 Google 的 Gemini。

1.1 DeepSeek 主要产品

- DeepSeek LLM(通用大模型)

-

- DeepSeek-V2(最新版本,2024)

-

-

- 支持 7B、67B、236B 参数规模,类似于 OpenAI GPT-4、Claude 等高级模型。

- 提供开源权重,允许开发者 本地部署,而不必依赖云端 API。

- 适用于 文本生成、代码理解、数学推理 等任务。

-

-

- DeepSeek-V1(较早版本,仍在使用)

-

-

- 训练数据涵盖 中英文、代码、数学,在部分任务上优于 GPT-3.5。

- 提供 本地部署 选项,类似 Mistral 和 LLaMA 2。

-

DeepSeek Coder 是专为 编程和代码生成 设计的 AI 模型,类似于 GitHub Copilot 或Code Llama,支持:

-

- 多种编程语言(Python、Java、C++、JavaScript、SQL、Shell、PL/SQL 等)。

- 代码自动补全、代码解释、错误修复 和 代码优化。

- 本地运行,适合离线开发环境。

应用场景:

✅ 开发者:代码生成、补全、优化。

✅ 数据工程师:SQL 语句优化。

✅ Linux 运维:Shell 脚本自动生成。

✅ Oracle PL/SQL 开发者:高效 PL/SQL 代码编写。

1.2 DeepSeek 的优势

✅ 本地部署支持:不像 GPT-4 依赖云端,DeepSeek 提供开源权重,可在本地运行(适用于企业/隐私保护)。

✅ 高效推理优化:采用 Mixture of Experts (MoE) 技术,在性能和计算成本之间取得平衡。

✅ 支持中英双语:针对 中文优化,在某些任务上优于 LLaMA 2 和 GPT-3.5。

✅ 开源:可以自由下载模型,在 GPU 服务器 或 个人 PC(Linux/Windows) 上运行。

二、如何使用 DeepSeek

- 在线访问 API

-

- 访问 DeepSeek官网 使用 Web 版或 API。

- 本地运行(例如 Ollama)

-

- 你可以在 Ollama 里下载并运行:

ollama pull deepseek-ai/deepseek-coder

ollama run deepseek-coder

- 下载模型并自行部署

-

- 可以从 Hugging Face 下载权重,在本地运行。

2.1 DeepSeek 适合谁

✅ 开发者(Python、JavaScript、PL/SQL、Shell 等)。

✅ 企业和科研机构(需要本地 LLM 处理数据)。

✅ 希望离线运行 AI 的用户。

✅ 中文 AI 用户(比 OpenAI 更适应中文场景)。

2.2 DeepSeek vs 其他 AI

2.3 总结

- DeepSeek 是中国本土开发的 AI 大模型,涵盖通用 LLM(DeepSeek-V2)和代码 LLM(DeepSeek Coder)。

- 支持本地运行,适合隐私保护场景,可以用 Ollama 部署。

- 对中文支持优秀,在 代码、SQL、Shell、数学推理 等方面表现不错。

- 适合开发者、企业、本地 AI 研究人员,尤其是想要开源替代 GPT-4 的用户。

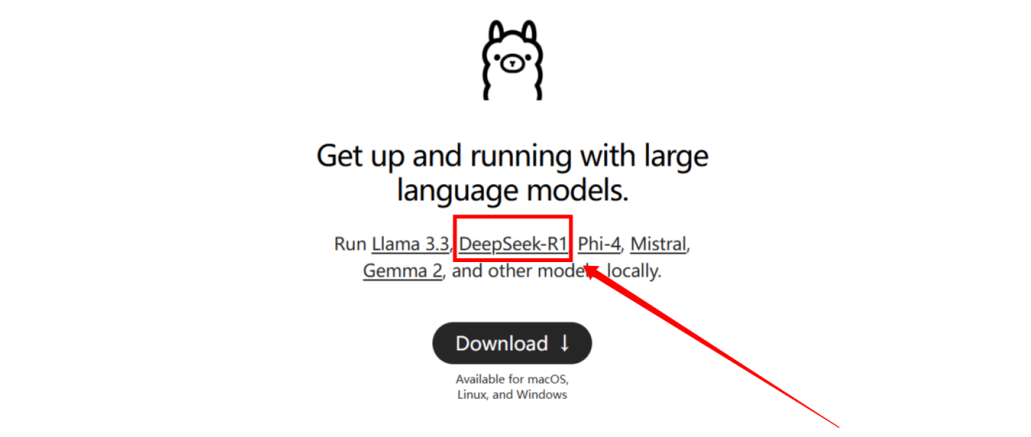

三、Ollama 是什么

安装DeepSeek模型之前

首先你需要安装一个Ollama,这个软件相当于运行DeepSeek模型的底层,没有这个底层就没办法跑DeepSeek AI模型。

Ollama 是一个 本地运行大语言模型(LLM) 的工具,专门用于在 个人电脑或服务器上运行 AI 语言模型,而无需依赖云端 API。它类似于 Hugging Face Transformers 或 LM Studio,但更注重本地推(inference),支持 各种开源 LLM,如 LLaMA,Mistral,Gemma , DeepSeek等。

Ollama 提供了一个简洁的命令行接口(CLI)和 API,使开发者能够轻松下载、运行和管理LLM 模型,并且支持 Mac(Apple Silicon)、Windows 和 Linux。

3.1 Ollama 的主要作用

- 本地推理(离线使用)

-

- 可以在本地运行大语言模型,不依赖 OpenAI 或其他云服务,保护数据隐私。

- 适用于没有稳定网络连接或希望完全本地化 AI 处理的场景。

- 轻松管理 LLM 模型

-

- 可以直接使用命令下载和运行模型,如:ollama run mistral

- 也可以使用:ollama pull gemma 来下载 Gemma(谷歌推出的开源 LLM)。

- 支持自定义模型(Modelfile)

-

- 允许用户基于开源 LLM 微调 或 自定义模型,类似于 Dockerfile:

-

-

- FROM mistral SYSTEM "You are a helpful assistant."

-

-

- 然后使用 ollama create my_model 生成自己的模型。

3.2 Ollama 适合谁

✅ 开发者:想要在本地测试 LLM 或构建 AI 应用。

✅ 数据隐私要求高的企业或个人:避免云端 API 传输敏感数据。

✅ AI 研究人员:可以在本地微调和实验不同模型。

✅ 普通用户:想在本地运行 ChatGPT 类似的 AI,而不依赖互联网。

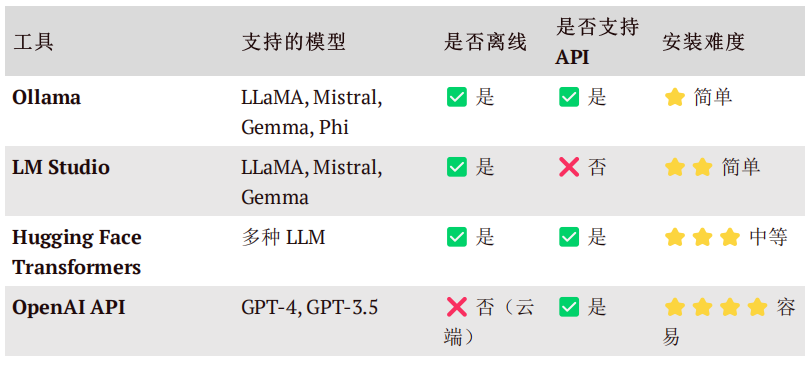

3.3 Ollama 和其他 LLM 运行工具的对比

3.4 总结

✅ Ollama 让你可以 在本地运行 AI 模型,无需依赖云端 API,保护隐私,并且 安装简单、运行高效。

✅ 支持 LLaMA、Mistral、Gemma 等多个开源 LLM,并提供 CLI 和 API,适用于 开发、研究和个人使用。

✅ 适合想要 摆脱 OpenAI API 限制,或希望 离线使用 AI 的人。

如果尝试 本地 AI 模型,Ollama 是一个不错的选择

四、Windows本地部署DeepSeek

4.1安装ollama

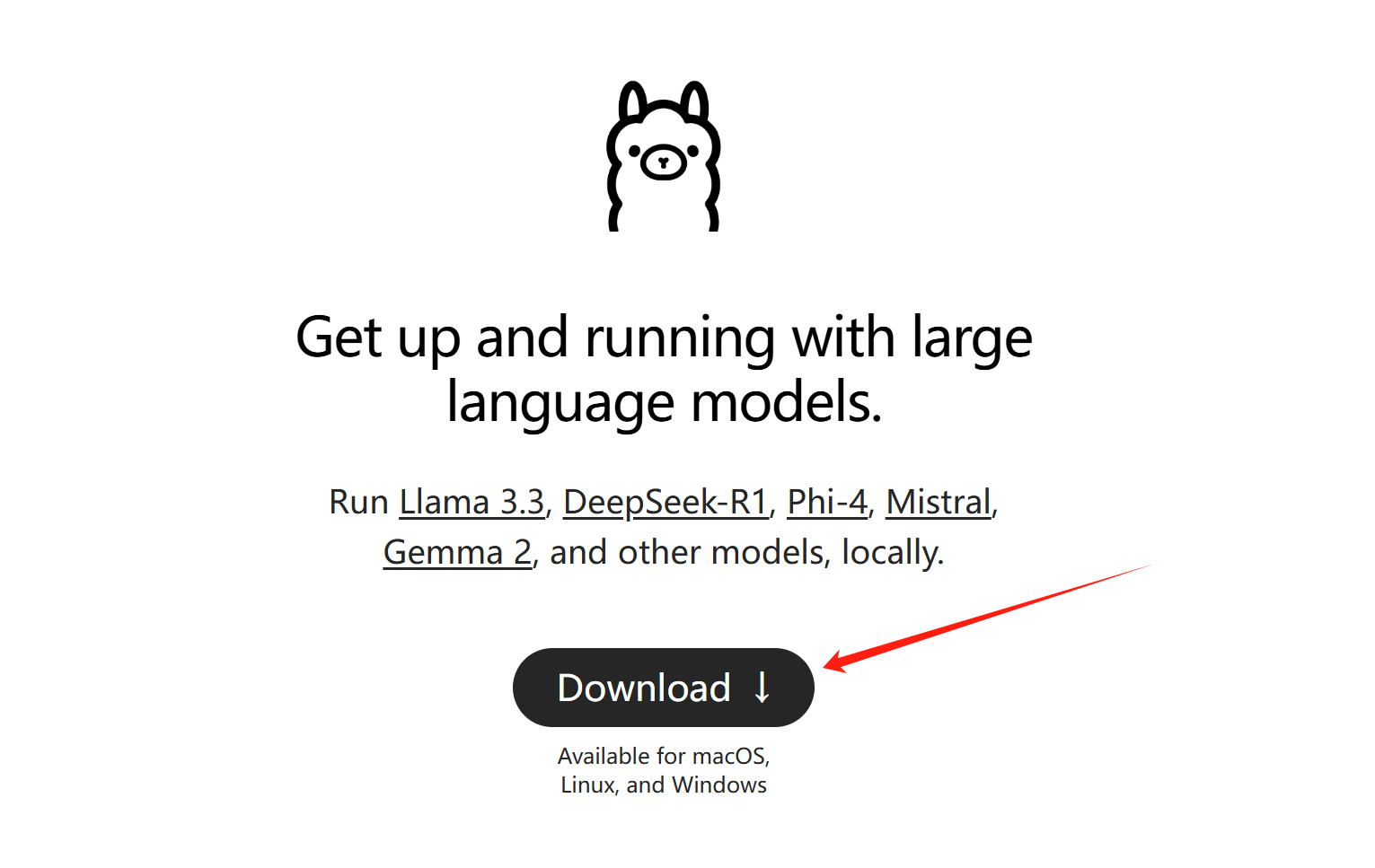

访问链接:Ollama

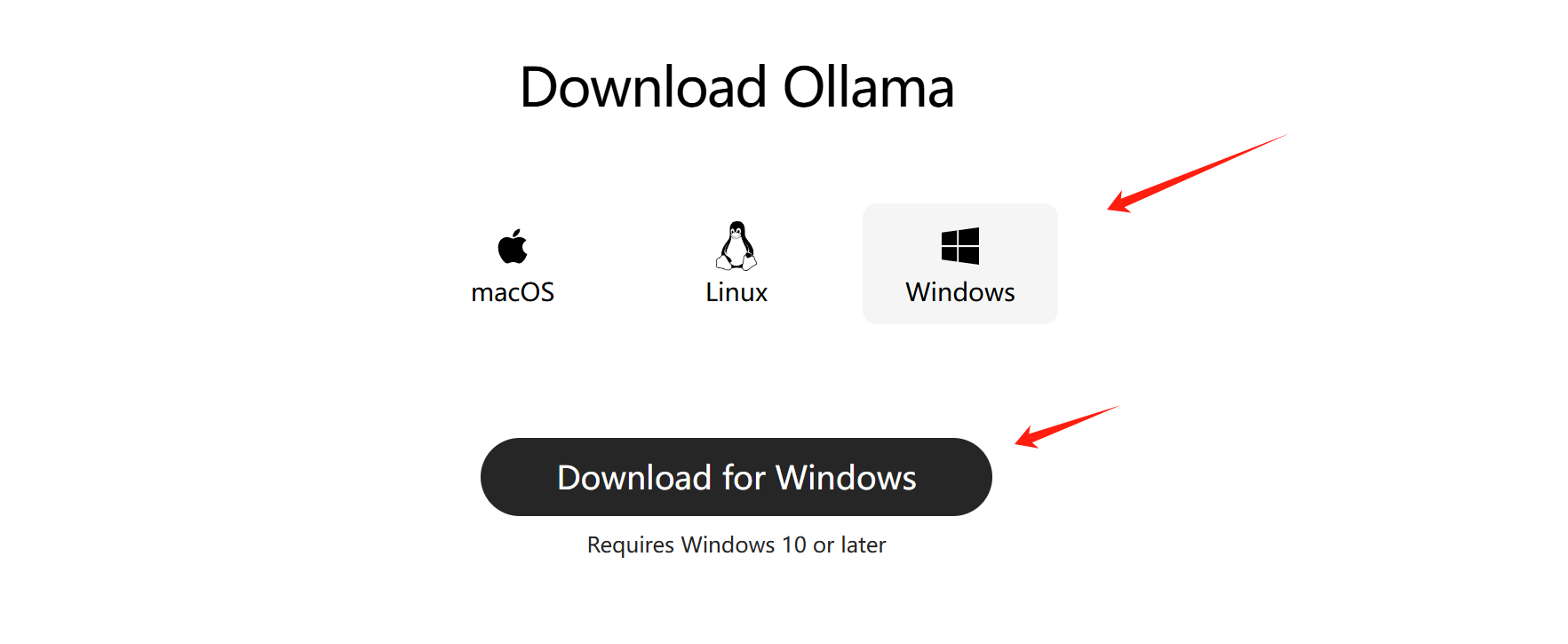

选择符合自己的版本:

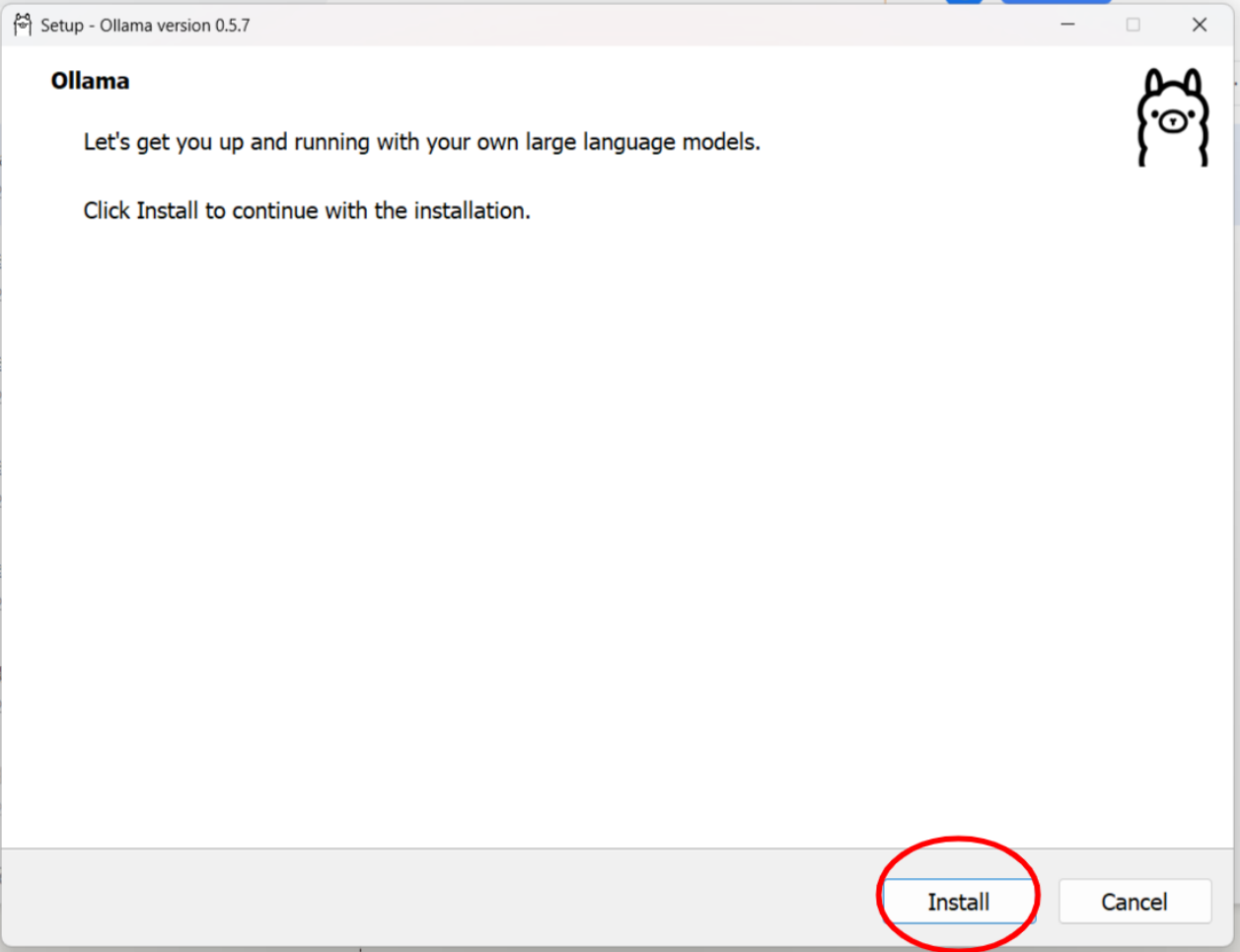

下载完成后打开:

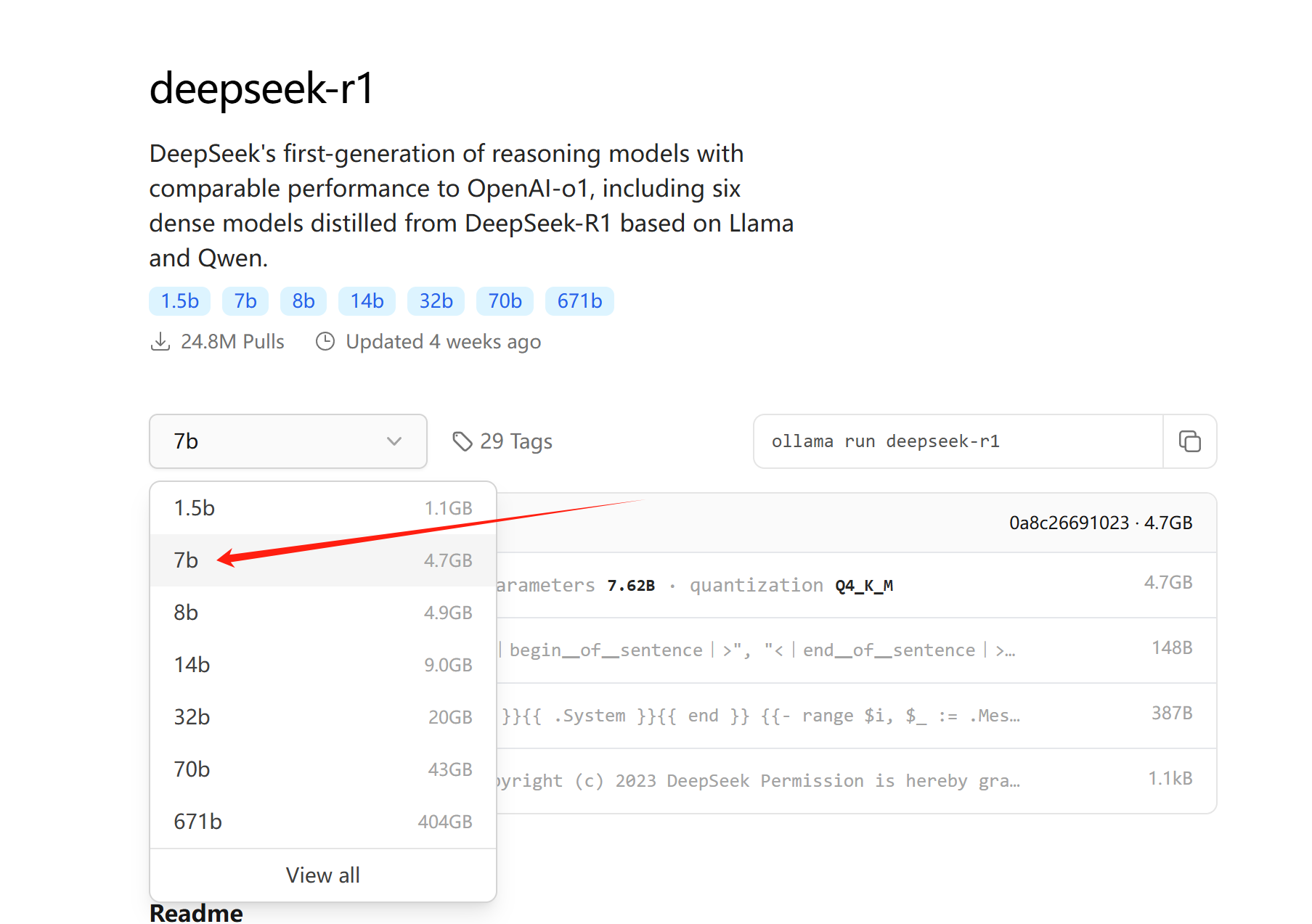

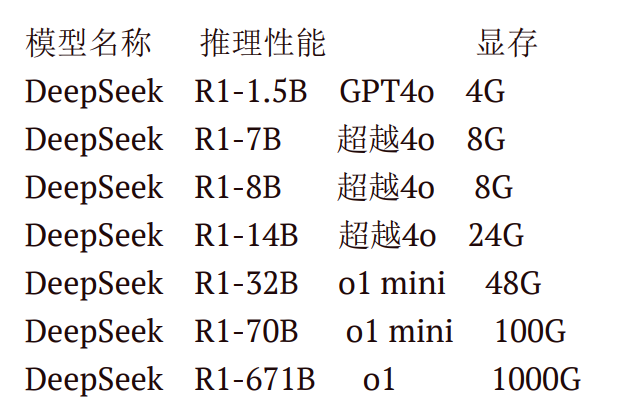

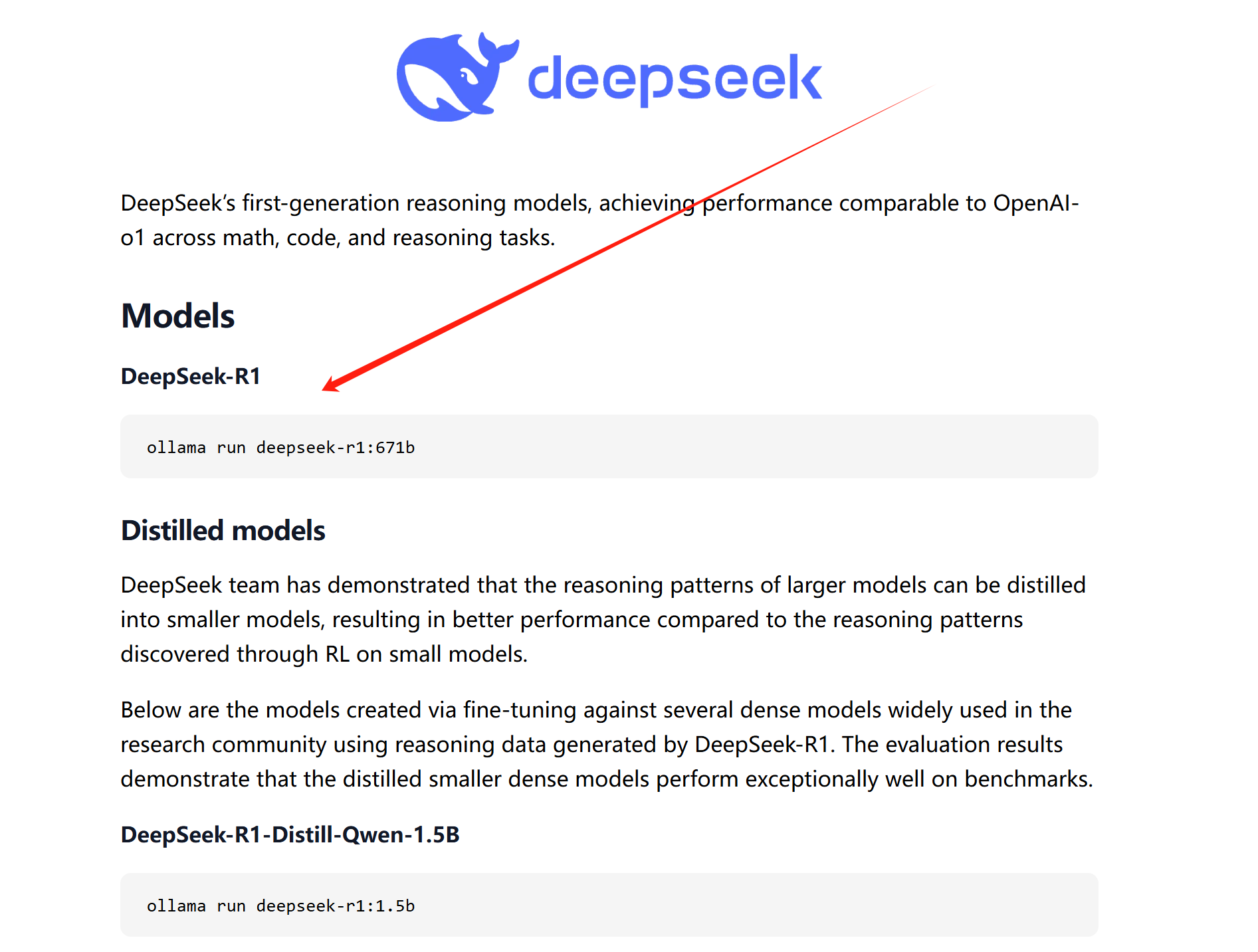

这里选择7B规格的模型:

版本:1.5b,适用于一般文字编辑使用(需要1.1GB空余空间)

ollama run deepseek-r1:1.5b

版本:7b,DeepSeek的第一代推理模型,性能与OpenAI-o1相当(需要 4.7GB空余空间)

ollama run deepseek-r1:7b

版本:8b,(需要4.9GB空余空间)

ollama run deepseek-r1:8b

版本:14b,(需要9GB空余空间)

ollama run deepseek-r1:14b

版本:32b,(需要20GB空余空间)

ollama run deepseek-r1:32b

版本:70b,(需要43GB空余空间)

ollama run deepseek-r1:70b

版本:671b,(需要404GB空余空间)

ollama run deepseek-r1:671b

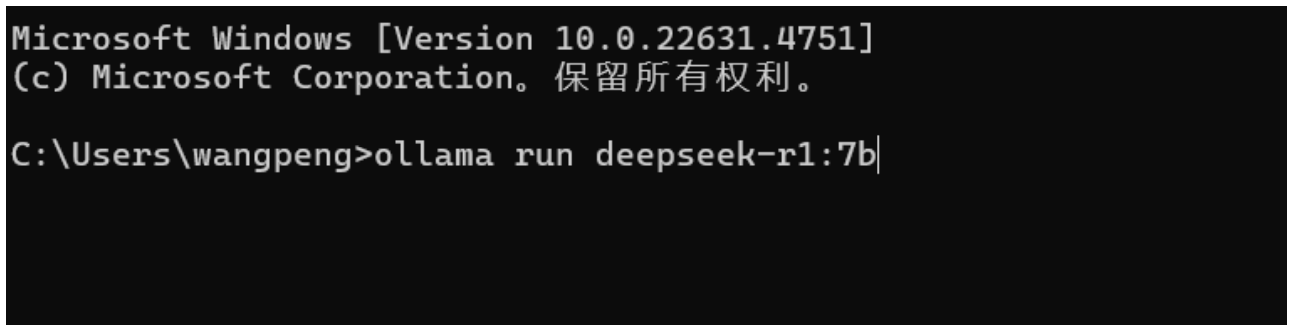

打开cmd 或者PowerShell:

相关的命令在ollama的模型下载页面下方就有,可以自己参考:

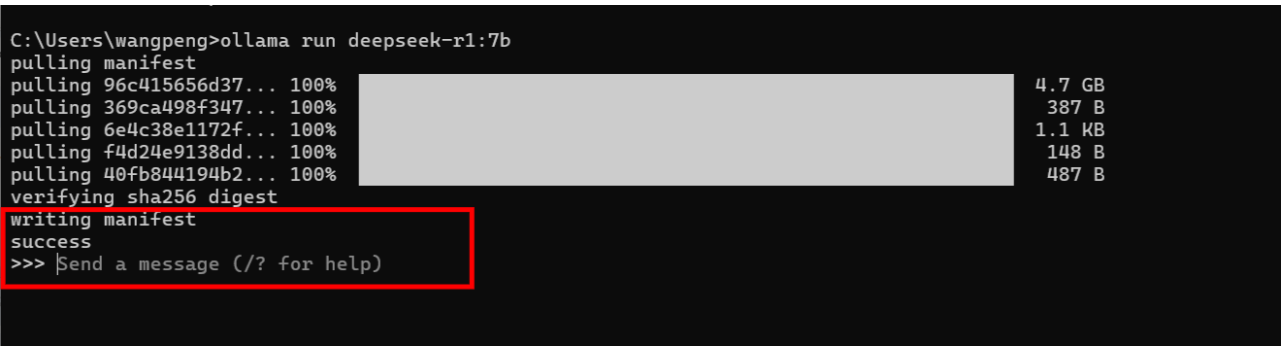

注意这里需要很长的时间:

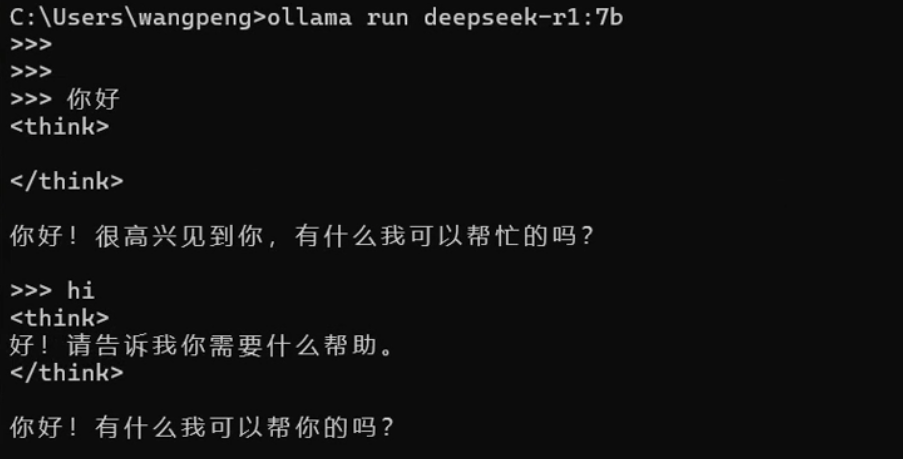

出现这个,你就可以直接对话了:

4.2ollama基本使用

ollama 是一个用于运行和管理本地 AI 模型的命令行工具,类似于 OpenAI 的 GPT,但可以在本地设备上运行。以下是一些常见的 ollama 命令及其用途:

- 拉取(下载)模型:

ollama run deepseek-r1:7b

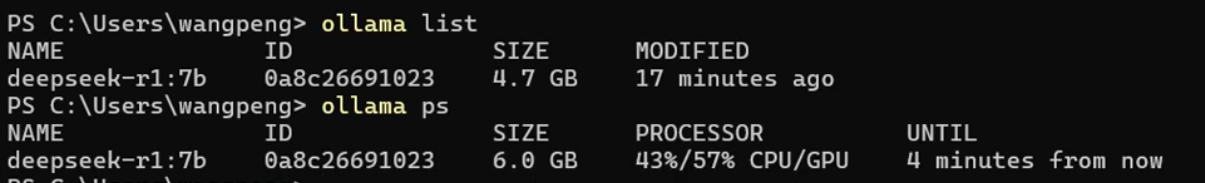

ollama pull deepseek-r1:7b- 列出已安装的模型:

ollama list

ollama ps

- 运行模型(聊天模式):

ollama run deepseek-r1:7b启动 deepseek-r1:7b 模型,可以直接在终端中进行 AI 聊天。

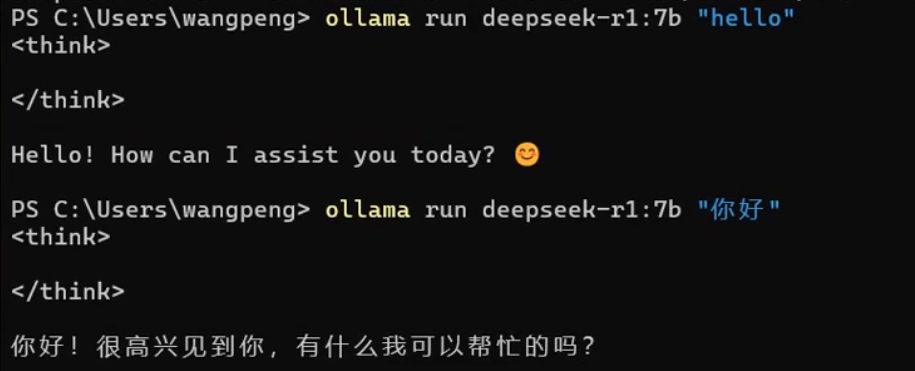

- 使用指定的模型进行一次性问答,让模型直接回答问题,而不是进入聊天模式:

ollama run deepseek-r1:7b "hello"

ollama run deepseek-r1:7b "你好"

- 创建自定义模型,详细见4.3 ollama create 创建一个自定义模型:

如果你想基于 deepseek-r1:7b 创建一个自定义模型:类似dockerfile的yaml格式文件:

ollama create my_model -f my_model.modelfile其中,my_model.modelfile 是定义模型的文件。

- 删除模型

ollama rm deepseek-r1:7b- 查看模型详情,显示模型的详细信息,如大小、版本等:

ollama show deepseek-r1:7b- 帮助命令,显示 ollama 的所有可用命令和帮助信息:

ollama --help4.3 ollama create 创建一个自定义模型

- 创建 Modelfile

Modelfile 是用于描述如何加载和运行模型的配置文件,类似dockerfile。

Ollama 的 Modelfile 通常使用 YAML 格式,这是一种简洁且易于阅读的配置格式。通过Modelfile,你可以定义模型的配置,如是否使用 GPU、模型权重的位置等。

在 Windows PowerShell 或 CMD 运行:

cd D:

mkdir my_model

cd my_model

notepad Modelfile然后在 Modelfile 中写入:

FROM deepseek-r1:7b

PARAMETER temperature 0.7

SYSTEM 你是一个聊天助手,专注于提供准确和专业的回答。在 Ollama 中,Modelfile 配置文件的内容包括一些用于定义模型行为和系统设置的参数。你提供的这一段是一个 Modelfile 示例,它包含了以下几个关键部分:

-

- FROM deepseek-r1:7b:

-

-

- FROM:这个关键字指定了你要使用的基础模型或预训练模型。

- deepseek-r1:7b:这是模型的名称和版本标识符。在这里,deepseek-r1 可能是DeepSeek 团队发布的一个模型系列,而 7b 指的是模型的大小,即有 7 亿参数的版本。这个字段告诉 Ollama 从哪个模型镜像来加载。

-

-

- PARAMETER temperature 0.7:

-

-

- PARAMETER temperature:temperature 是一个控制生成文本多样性的参数。在生成模型(如 GPT 或 DeepSeek)中,temperature 影响生成文本的随机性。

-

-

-

-

- temperature 的值范围通常是 0 到 1,或者更高:

-

-

-

-

-

-

- 低值(如 0.1-0.3):生成的文本更为保守,重复性较高,文本的可预测性较强。

- 中等值(如 0.7):生成的文本既有一定的随机性,又能够保持连贯性和一致性。

- 高值(如 1.0 或更高):生成的文本更加多变和创新,但可能会更不连贯或有更多不符合上下文的内容。

-

-

-

-

-

-

- 在你提供的例子中,temperature 0.7 表示你希望生成的文本具有适度的随机性和平衡性,既不会过于单一,也不会完全失控。

-

-

-

- SYSTEM 你是一个聊天助手,专注于提供准确和专业的回答:

-

-

- SYSTEM:这表示为模型设置一个系统消息。系统消息通常是你给模型的 行为指令或背景信息,它帮助模型理解它的任务或行为。

-

-

-

-

- 在这个例子中,SYSTEM 的内容是 “你是一个聊天助手,专注于提供准确和专业的回答”。这说明你希望模型在回答问题时,专注于提供准确和专业的信息,并且可能限制模型提供过于随意或不准确的内容。

-

-

总结:

- FROM deepseek-r1:7b:指定使用名为 deepseek-r1、大小为 7B 参数的模型。

- PARAMETER temperature 0.7:设置文本生成的温度为 0.7,这表示生成的文本既有一定随机性又保持连贯性。

- SYSTEM 你是一个聊天助手,专注于提供准确和专业的回答。:给模型提供一个系统级指令,告诉它应该专注于提供 准确和专业的回答,控制它的行为。

这些参数共同定义了模型的运行行为。

- 运行 ollama create

终端运行:

ollama create my-deepseek-model -f Modelfile.txt这个命令会基于 deepseek-r1:7b 创建一个新的 my-deepseek-model 模型。

- 运行测试

使用以下命令在命令行中运行模型并与其进行交互:

ollama run my-deepseek-model "詹姆斯和科比谁的历史地位更高?"- 查看模型信息

你可以查看你创建的模型的详细信息,例如:

ollama show my-deepseek-model这将展示模型的详细信息,如版本、大小、所使用的参数等。

- 删除模型

ollama list

ollama ps

ollama run my-deepseek-model:latest

ollama stop my-deepseek-model:latest

ollama rm my-deepseek-model:latest此命令会从本地系统中删除 my-deepseek-model 模型。

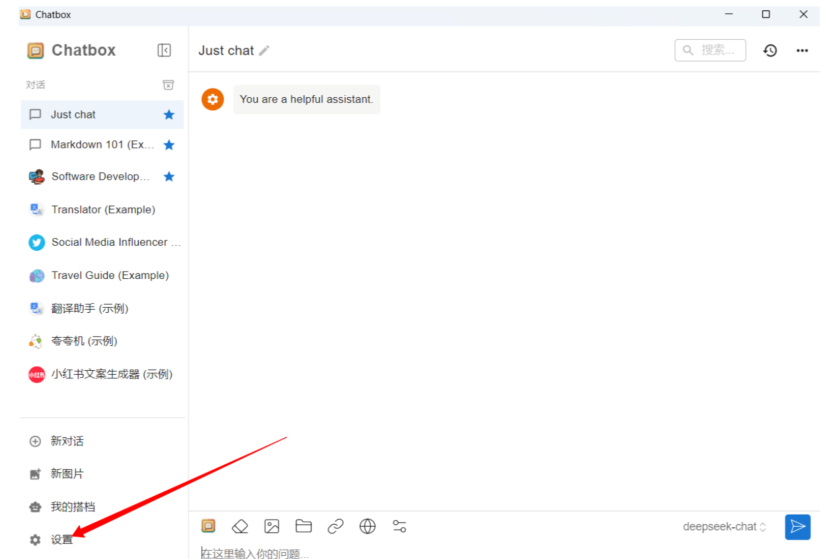

五、部署deepseek的本地web界面工具

Chatbox AI官网:办公学习的AI好助手,全平台AI客户端,官方免费下载

安装此软件,点击运行,点击设置:

配置本地运行的模型和环境:

点击保存:

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)