150页报告揭秘:中国团队如何用“AI拼多多“成本碾压OpenAI?

在人工智能技术快速迭代的今天,如何以更低成本实现更高性能的模型训练,成为全球科技企业共同面临的挑战。当全球目光聚焦在硅谷巨头时,2023年成立的杭州深度求索公司(DeepSeek),以独特的工程化能力和开源策略,为这一难题提供了创新解法。。DeepSeek由国内知名量化投资机构幻方量化孵化,2024年1月发布首款大模型DeepSeekLLM。。——在性能逼近OpenAI o1的同时,推理成本仅为后

在人工智能技术快速迭代的今天,如何以更低成本实现更高性能的模型训练,成为全球科技企业共同面临的挑战。

当全球目光聚焦在硅谷巨头时,2023年成立的杭州深度求索公司(DeepSeek),以独特的工程化能力和开源策略,为这一难题提供了创新解法。这份150页的生态报告,系统梳理了DeepSeek从技术研发到商业落地的完整路径,为行业呈现了一条高性价比的AI发展范式。

DeepSeek由国内知名量化投资机构幻方量化孵化,2024年1月发布首款大模型DeepSeekLLM。仅一年时间,其模型家族已覆盖代码生成(DeepSeek-Coder)、多模态(DeepSeek-VL)等垂直领域。

最具突破性的是2025年发布的DeepSeek-R1模型——在性能逼近OpenAI o1的同时,推理成本仅为后者的几十分之一。这种“高性能低门槛”的特质,被业界称为“AI界的拼多多”。

DeepSeek的核心竞争力在于算法优化能力。 通过重构训练流程与强化学习机制,其模型在提升准确率的同时,将内存占用降低30%以上。

更值得关注的是,团队绕过了英伟达CUDA框架的依赖,为国产芯片适配铺平道路。这种技术自主性不仅打破了“算力至上”的行业惯性,更验证了“算力与性能线性增长”的新定律——每增加一张GPU,模型能力即可稳定提升,无需复杂外部干预。

技术突破迅速转化为市场认可:2025年1月,DeepSeek应用登顶中美苹果商店免费榜,2月初日活用户突破3000万,成为史上最快达成该里程碑的AI应用。开源策略进一步加速生态构建,其多模态模型Janus-Pro-7B在图像生成任务中超越DALL-E 3和Stable Diffusion,吸引全球开发者加入技术共创。

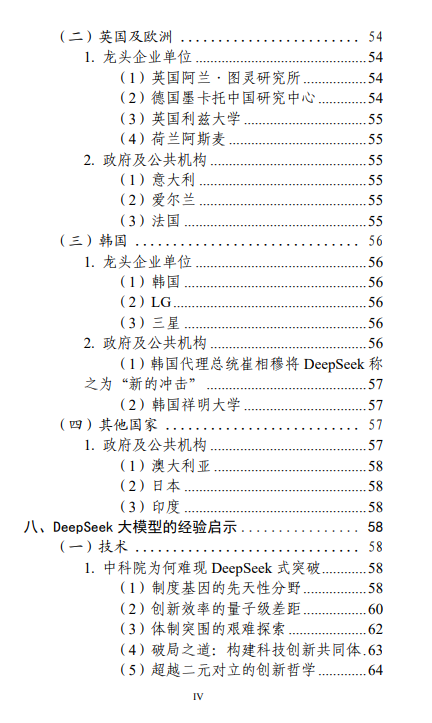

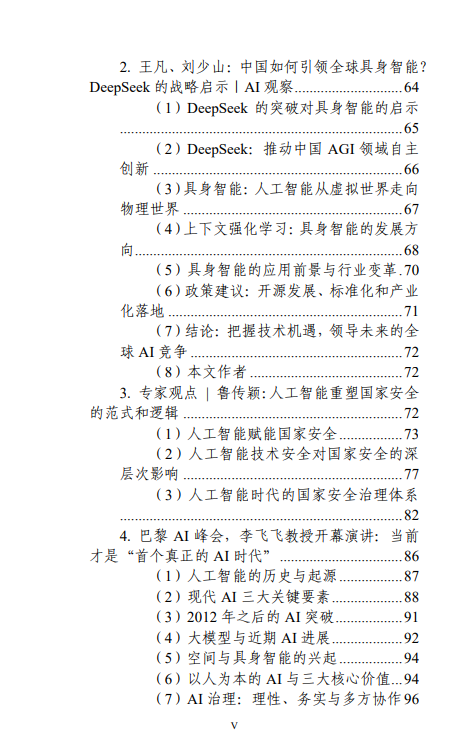

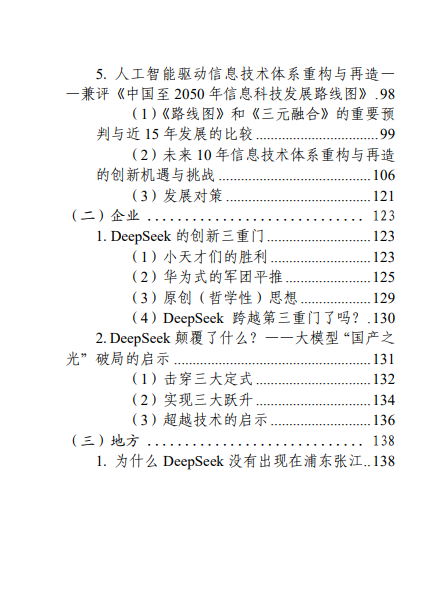

报告目录

报告特别指出,DeepSeek的实践为中小型企业提供了可复制的经验:通过算法优化降低硬件依赖,利用开源社区构建技术护城河,最终以“端侧部署+多模态能力”切入机器人交互、具身智能等前沿领域。正如报告所强调:“当推理成本下降一个数量级,AI应用的想象空间将扩展十倍”。

报告PDF我已经整理好了!评论区回复“想要”获取!

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)