生产环境H200部署DeepSeek 671B 满血版全流程实战(二):vLLM 安装详解

在上一篇文章,我们完成了H200服务器的系统初始化工作,包括驱动安装和CUDA环境配置,为DeepSeek 671B模型的部署奠定了基础。然而,面对单机8卡H200的141GB显存和NVLink高速互联的硬件资源,如何高效利用这些资源实现千亿参数大模型的推理加速,成为关键挑战。vLLM 作为一款高性能推理引擎,能够极大提升 DeepSeek 671B 模型在推理阶段的表现,使模型能够更快速、更准确

前言

在上一篇文章-生产环境H200部署DeepSeek 671B 满血版全流程实战(一):系统初始化,我们完成了H200服务器的系统初始化工作,包括驱动安装和CUDA环境配置,为DeepSeek 671B模型的部署奠定了基础。然而,面对单机8卡H200的141GB显存和NVLink高速互联的硬件资源,如何高效利用这些资源实现千亿参数大模型的推理加速,成为关键挑战。

vLLM 作为一款高性能推理引擎,能够极大提升 DeepSeek 671B 模型在推理阶段的表现,使模型能够更快速、更准确地生成结果,满足生产环境中对实时性和高吞吐量的严苛要求。在本文中,我们将深入探讨如何在 H200 环境中顺利安装并配置 vLLM。

一、安装vLLM

1. 创建虚拟环境

为避免依赖冲突,使用Conda创建独立环境:

conda create -n vllm python=3.10

conda activate vllm 2. 安装最新版vLLM

升级pip后直接安装vLLM:

pip install --upgrade pip

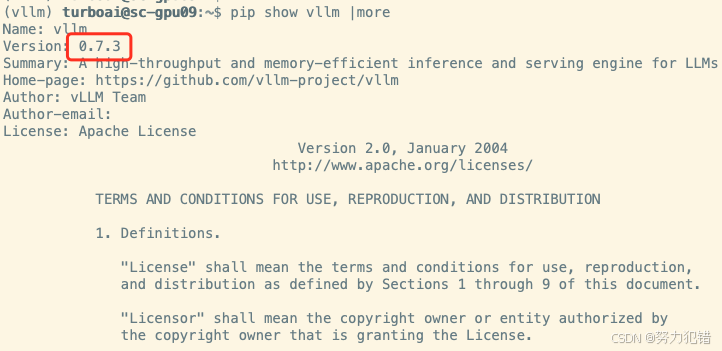

pip install vllm 验证安装是否成功:

pip show vllm

二、运行vLLM服务

1. 激活 vllm 环境,确保在 vllm 的 conda 环境中

conda activate vllm2. 启动 vLLM 服务: 使用 vllm serve 命令启动 vLLM 服务,并加载 DeepSeek 671B 模型。

vllm serve /data/DeepSeek-R1 --tensor-parallel-size 8 --max-model-len 16384 --port 8102 --trust-remote-code --served-model-name deepseek-r1 --enable-chunked-prefill --max-num-batched-tokens 2048 --gpu-memory-utilization 0.95参数说明:

- vllm serve /data/DeepSeek-R1: 启动vLLM服务并加载指定模型。

- --tensor-parallel-size 8: 表示使用 8 块 GPU 并行推理。

- --max-model-len 16384: 设置模型的最大上下文长度,可以根据 GPU 显存大小调整。

- --port 8102: 指定服务监听的端口号,可以根据需要修改。

- --served-model-name deepseek-r1: 在 API 请求中使用该名称来指定要使用的模型。

- --enable-chunked-prefill:启用分块预填充(Chunked Prefill)优化。

- --max-num-batched-tokens 2048:限制单次批处理的总token数量。

- --gpu-memory-utilization 0.95:设置vLLM可使用的显存比例。

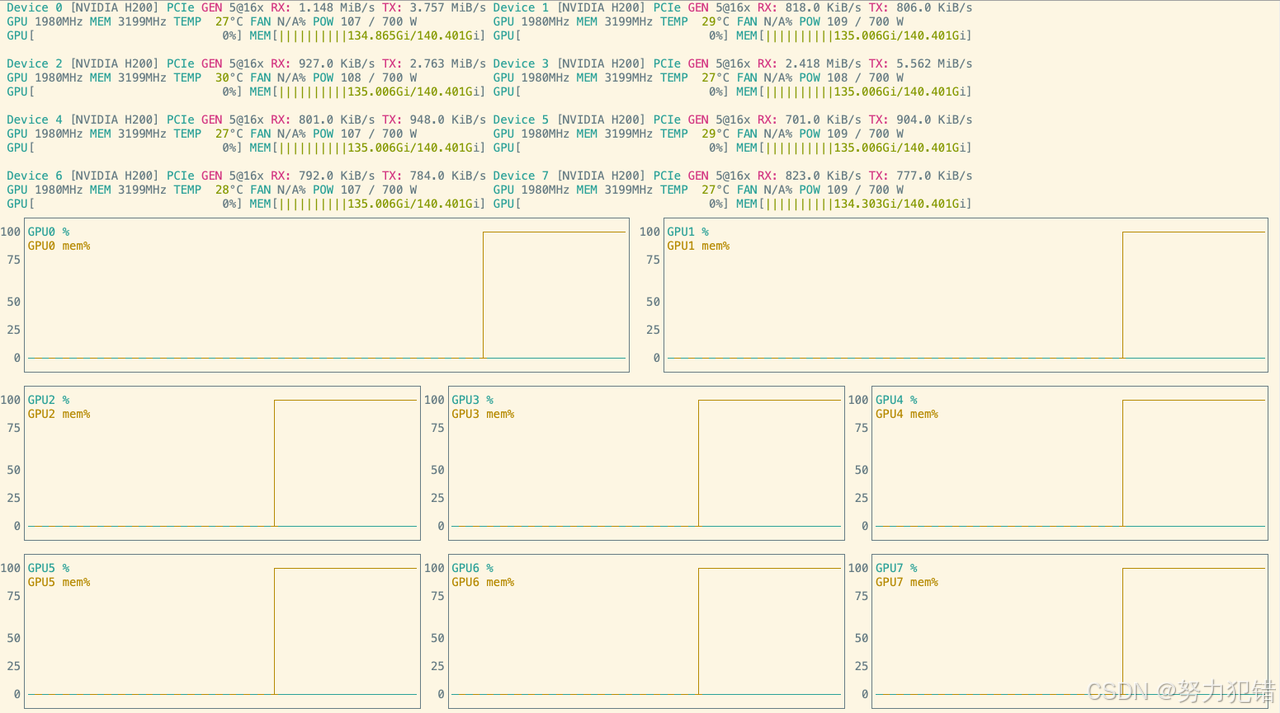

3. nvtop监控

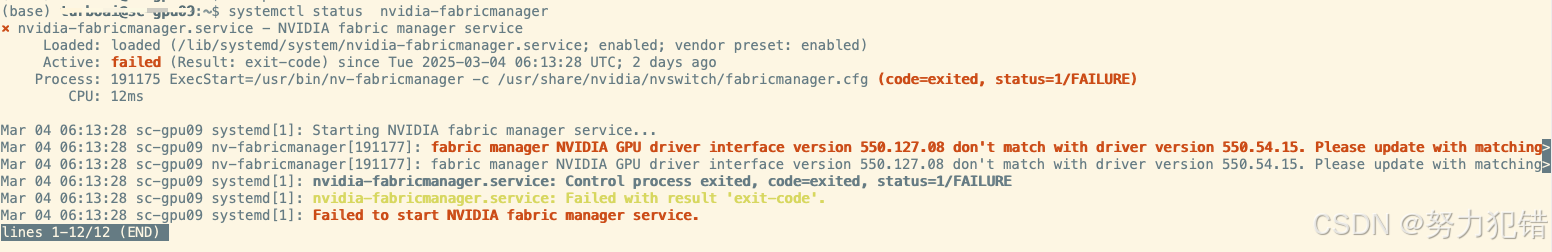

4. 注意:nvidia-fabricmanager软件包的版本与GPU 驱动版本必须完全一致(包括小版本号),否则vLLM启动时会卡住。

- 启动vLLM加载nccl后会卡住,运行systemctl status nvidia-fabricmanager,查看nvidia-fabricmanager错误日志。驱动与GPU版本不匹配有如下报错:

解决办法:-生产环境H200部署DeepSeek 671B 满血版全流程实战(一):系统初始化参考,重新安装nvidia-fabricmanager软件包。

三、验证服务可用性

通过API接口发送测试请求,确认服务正常运行:

curl -X POST "http://localhost:8102/v1/chat/completions" \

-H "Content-Type: application/json" \

-d '{

"model": "deepseek-r1",

"messages": [{"role": "user", "content": "写个100字的散文"}]

}'预期结果:返回模型生成的文本内容,表示服务部署成功。

四、vLLM服务管理脚本

为方便日常运维,可编写控制脚本实现服务的启动、停止和状态监控。

脚本功能如下:

- 启动服务:自动激活Conda环境并启动vLLM服务。

- 停止服务:优雅终止所有相关进程,避免残留。

- 状态检查:查看服务进程、GPU占用及端口监听情况。

#!/bin/bash

# DeepSeek-R1 671B 控制脚本,依据实际情况修改路径脚本

PID_FILE="/data/deepseek.pid"

CONDA_PATH="/home/turboai/miniconda3"

CONDA_ENV="vllm"

LOG_FILE="/data/deepseek.log"

SERVED_MODEL="/data/DeepSeek-R1"

PORT=8102

# 日志函数

log_message() {

echo "$(date '+%Y-%m-%d %H:%M:%S') - $1" >> "$LOG_FILE"

echo "$(date '+%Y-%m-%d %H:%M:%S') - $1"

}

# 检查服务是否运行

check_service() {

# 检查所有相关的vllm进程,包括主进程和子进程

if pgrep -f "python.*vllm.*--port $PORT" > /dev/null || \

pgrep -f "python.*-m.*vllm.*--port $PORT" > /dev/null || \

pgrep -f "multiprocessing.*vllm" > /dev/null || \

pgrep -f "python.*-c.*multiprocessing.*spawn_main" > /dev/null; then

return 0 # 服务正在运行

else

return 1 # 服务未运行

fi

}

# 获取服务PID

get_service_pid() {

# 获取主进程和所有子进程的PID

(pgrep -f "python.*vllm.*--port $PORT"

pgrep -f "python.*-m.*vllm.*--port $PORT"

pgrep -f "multiprocessing.*vllm"

pgrep -f "python.*-c.*multiprocessing.*spawn_main") 2>/dev/null || echo ""

}

# 获取所有相关进程的父进程

get_parent_pids() {

local child_pids=$(get_service_pid)

local parent_pids=""

for pid in $child_pids; do

# 获取父进程ID

local ppid=$(ps -o ppid= -p $pid 2>/dev/null)

if [ -n "$ppid" ]; then

parent_pids="$parent_pids $ppid"

fi

done

echo $parent_pids

}

stop() {

# 检查服务是否在运行

if ! check_service; then

log_message "DeepSeek服务未运行"

rm -f "$PID_FILE" 2>/dev/null

return 0

fi

log_message "正在停止DeepSeek服务..."

# 获取所有相关进程的PID(包括父进程)

PIDS=$(get_service_pid)

PARENT_PIDS=$(get_parent_pids)

ALL_PIDS="$PIDS $PARENT_PIDS"

# 先尝试正常终止所有进程

for PID in $ALL_PIDS; do

if kill -0 $PID 2>/dev/null; then

log_message "正在停止进程 PID: $PID"

kill $PID 2>/dev/null

fi

done

# 等待进程结束

TIMEOUT=30

while [ $TIMEOUT -gt 0 ] && check_service; do

sleep 1

TIMEOUT=$((TIMEOUT-1))

done

# 如果进程仍在运行,强制终止

if check_service; then

log_message "进程未响应,强制终止..."

# 重新获取进程列表,因为可能有些已经终止

PIDS=$(get_service_pid)

PARENT_PIDS=$(get_parent_pids)

ALL_PIDS="$PIDS $PARENT_PIDS"

for PID in $ALL_PIDS; do

if kill -0 $PID 2>/dev/null; then

log_message "强制终止进程 PID: $PID"

kill -9 $PID 2>/dev/null

fi

done

sleep 2

# 使用pkill作为最后的手段

pkill -9 -f "multiprocessing.*vllm" 2>/dev/null

pkill -9 -f "python.*-c.*multiprocessing.*spawn_main" 2>/dev/null

fi

# 最终检查

if check_service; then

log_message "错误: 无法停止所有DeepSeek服务进程"

return 1

else

rm -f "$PID_FILE" 2>/dev/null

log_message "DeepSeek服务已停止"

return 0

fi

}

# 初始化conda环境

init_conda() {

# 确保conda命令可用

if [ ! -f "$CONDA_PATH/etc/profile.d/conda.sh" ]; then

log_message "错误: Conda初始化脚本不存在: $CONDA_PATH/etc/profile.d/conda.sh"

return 1

fi

# 测试conda环境

if ! bash -c "source \"$CONDA_PATH/etc/profile.d/conda.sh\" && conda env list | grep -q \"$CONDA_ENV\""; then

log_message "错误: Conda环境 '$CONDA_ENV' 不存在"

return 1

fi

return 0

}

start() {

# 检查服务是否已在运行

if check_service; then

SERVICE_PID=$(get_service_pid)

log_message "DeepSeek服务已在运行 (PID: $SERVICE_PID)"

echo $SERVICE_PID > "$PID_FILE" # 更新PID文件

return 1

fi

# 检查conda环境

if ! init_conda; then

return 1

fi

log_message "正在启动DeepSeek服务..."

# 启动服务

bash -c "

source \"$CONDA_PATH/etc/profile.d/conda.sh\" &&

conda activate $CONDA_ENV &&

nohup vllm serve \"$SERVED_MODEL\" \

--tensor-parallel-size 8 \

--max-model-len 16384 \

--port $PORT \

--trust-remote-code \

--served-model-name deepseek-r1 \

--enable-chunked-prefill \

--max-num-batched-tokens 2048 \

--gpu-memory-utilization 0.95 >> \"$LOG_FILE\" 2>&1 &"

# 等待服务启动

sleep 5

# 检查服务是否成功启动

if check_service; then

SERVICE_PID=$(get_service_pid)

echo $SERVICE_PID > "$PID_FILE"

log_message "DeepSeek服务启动成功! PID: $SERVICE_PID"

log_message "服务端口: $PORT"

log_message "日志文件: $LOG_FILE"

else

log_message "错误: DeepSeek服务启动失败"

return 1

fi

}

restart() {

log_message "正在重启DeepSeek服务..."

stop

sleep 2

start

}

status() {

if check_service; then

SERVICE_PID=$(get_service_pid)

log_message "DeepSeek服务正在运行 (PID: $SERVICE_PID)"

# 更新PID文件

echo $SERVICE_PID > "$PID_FILE"

# 显示GPU使用情况

if command -v nvidia-smi &> /dev/null; then

log_message "GPU使用情况:"

nvidia-smi --query-compute-apps=pid,used_memory,gpu_uuid --format=csv | grep "$SERVICE_PID" || echo "未找到相关GPU进程"

fi

# 检查端口是否在监听

if command -v ss &> /dev/null; then

log_message "端口状态:"

ss -tulpn | grep ":$PORT " || echo "端口 $PORT 未在监听"

elif command -v netstat &> /dev/null; then

log_message "端口状态:"

netstat -tulpn 2>/dev/null | grep ":$PORT " || echo "端口 $PORT 未在监听"

fi

return 0

else

log_message "DeepSeek服务未运行"

rm -f "$PID_FILE" 2>/dev/null # 清理可能存在的PID文件

return 1

fi

}

# 根据参数执行相应操作

case "$1" in

start)

start

;;

stop)

stop

;;

restart)

restart

;;

status)

status

;;

*)

echo "用法: $0 {start|stop|restart|status}"

echo " start - 启动DeepSeek服务"

echo " stop - 停止DeepSeek服务"

echo " restart - 重启DeepSeek服务"

echo " status - 查看服务状态"

exit 1

esac

exit $?更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)