DeepSeekR1 劲敌出现了,QwQ32B本地部署测试,RTX3060成功运行!

阿里千问平地一声雷,突然在凌晨3点发布了最新推理模型QwQ32B !

前言

阿里千问平地一声雷,突然在凌晨3点发布了最新推理模型QwQ32B !

发布说明很简单“今天,我们发布了 QwQ32B,这是我们最新的推理模型,它只有 320亿参数,可以与 deepseek -R1 等尖端推理模型相媲美” 。

然后在下面甩出来几个链接,包括博客,HF,模型,演示和在线使用的网站。

这条消息很简单,但是背后的东西一点都不简单。

就凭一句可以32B 与DeepSeek r1 媲美,就已经可以用Diao炸天来形容了,这成功了勾起了我的兴趣。

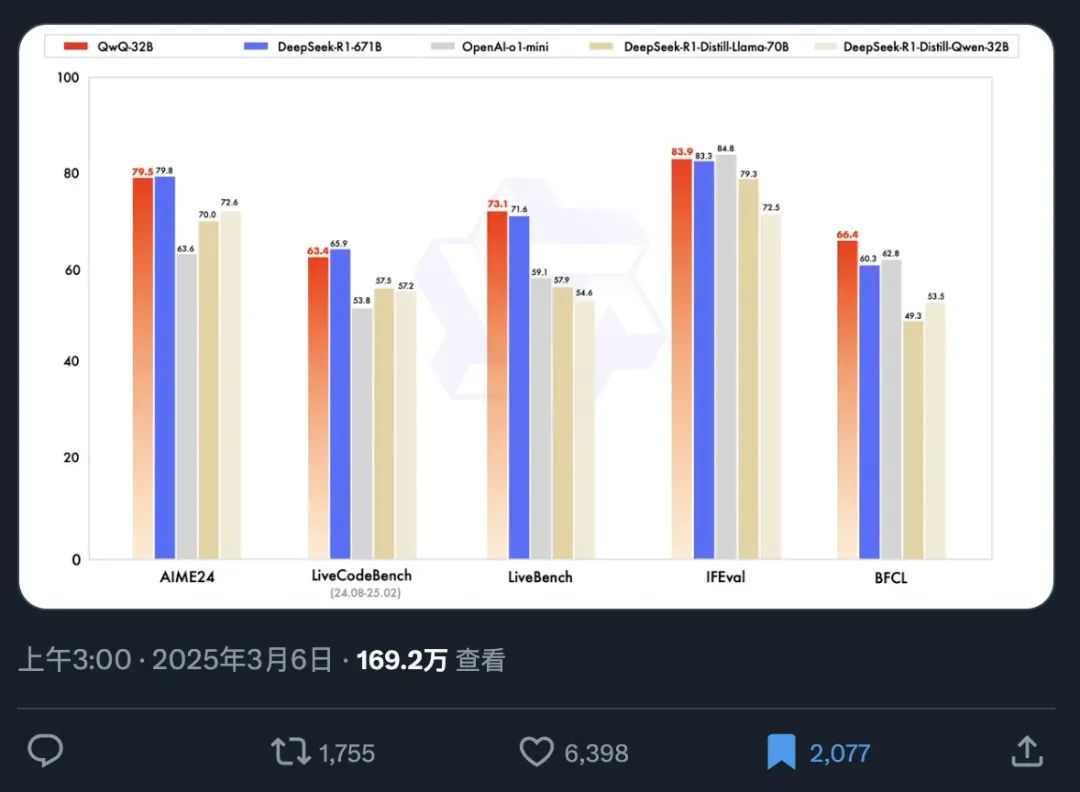

除了文字描述之外, 推文中还给出了一张基准测试的图片。

图中显示了 QwQ32B 和 deepseekR1 671B,以及 openai-o1的基准测试。从这个途中可以轻松的获取以下几点信息。

0. 12小时不到,169 万的阅读!

1. QwQ 320亿参数和 deepseekR1 6710 亿参数的满血版不分胜负(震惊.jpg)。

2. QwQ 吊打 32B 的 deepseek R1 蒸馏模型。

3. QwQ 多维度击败了 openai 的闭源模型 o1-mini

注意,这个模型只有 320亿参数啊。追平了 20 倍参数的巨无霸。

重点,现在你只要一张 RTX3090 或者 RTX4090 就可以把这个模型的量化版跑起来了。

DeepSeek 终于不孤单了,OpenAI 还有什么优势呢?

OpenAI 你好意思么?200 美金的 Pro,20 美金的Plus, 放在现在水平也一般般,还时不时降智!

既然是 32B 的模型,那么我们必须在本地安装一下试试。顺便实测一下这个本地运行的推理模型的智商。

现在要在本地运行大模型非常简单。只要 Ollama 支持就好了。

而 Ollama 的效率也极高,刚发布就支持了。

那么,一切就简单了。

人人都能上手完了。

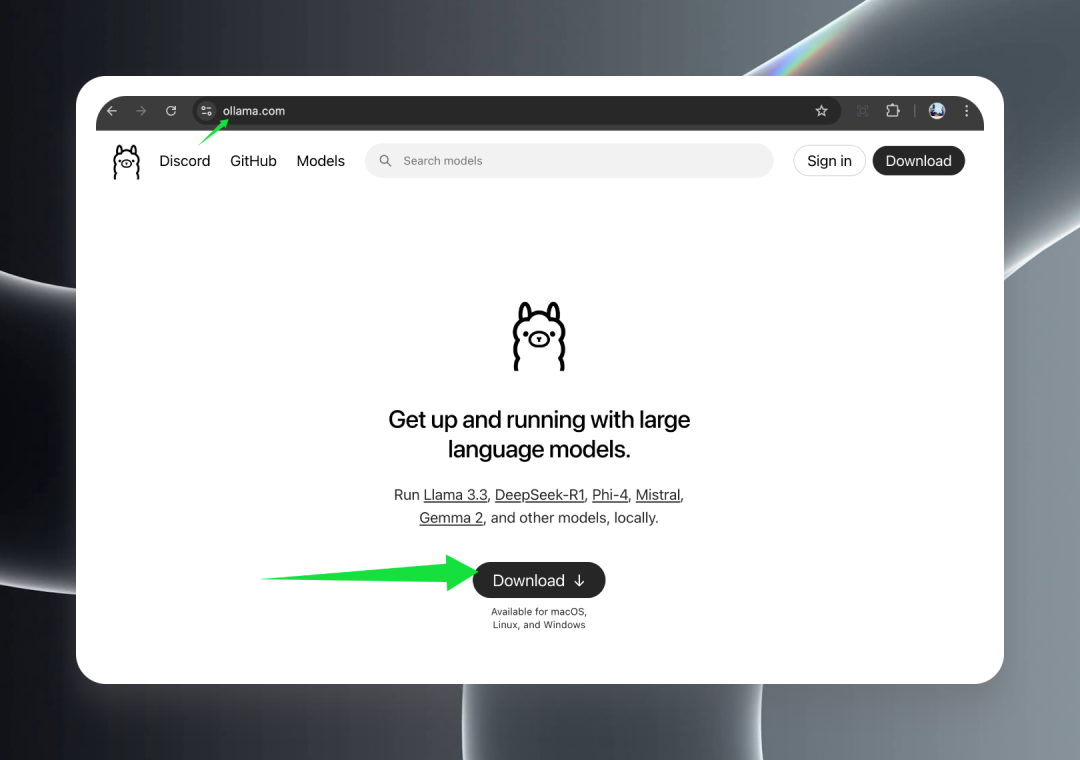

1.安装并运行 Ollama

直接打开 ollama.com 官网,然后点击 Download 下载软件。

根据自己的操作系统来下载,目前支持 macOS的两个平台,还有 Windows 和 Linux。也就是说,基本上的系统都覆盖了。

下载完成之后,直接双击安装就好了!安装完成之后,在右下角托盘,或者 mac 的右上方,能看到一个羊驼的图标,就证明已经正常启动了。

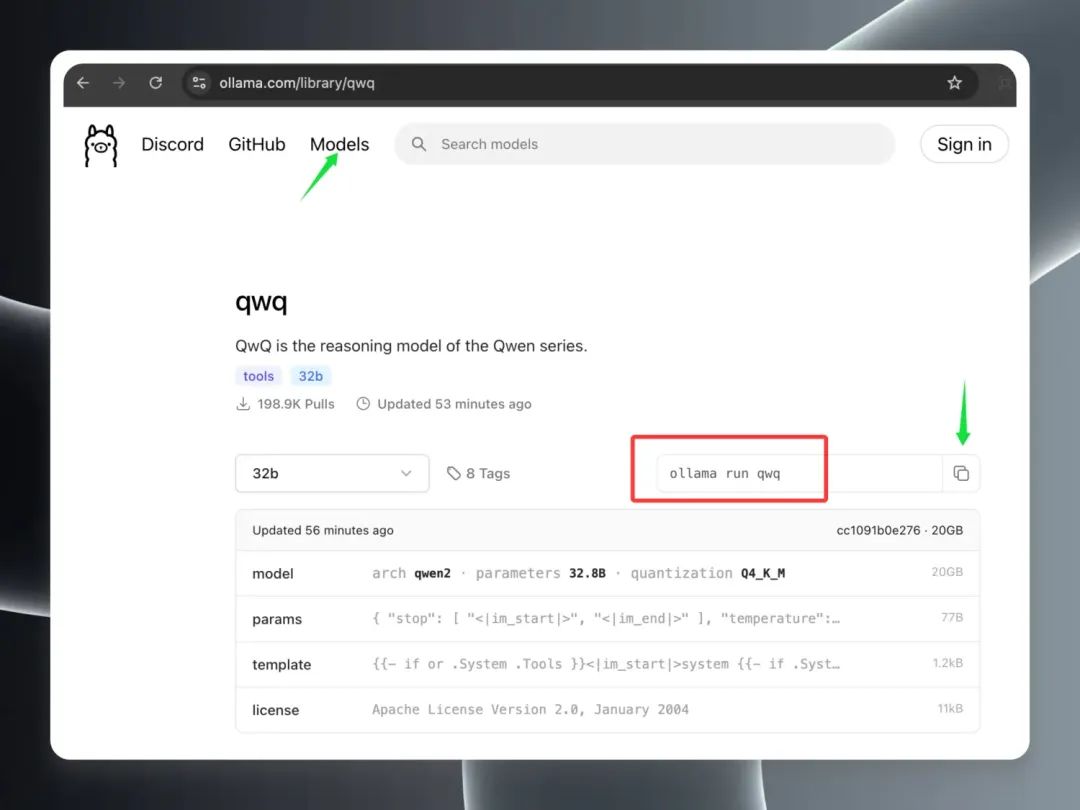

2.下载 QwQ 32B 模型

Ollama安装完成之后,就可以开始去下载 QwQ32B 这个模型了。

模型非常好找,已经在 Models 界面冲上热榜第一名了。找到 qwq 然后进入详情页。复制红色框中的命令。

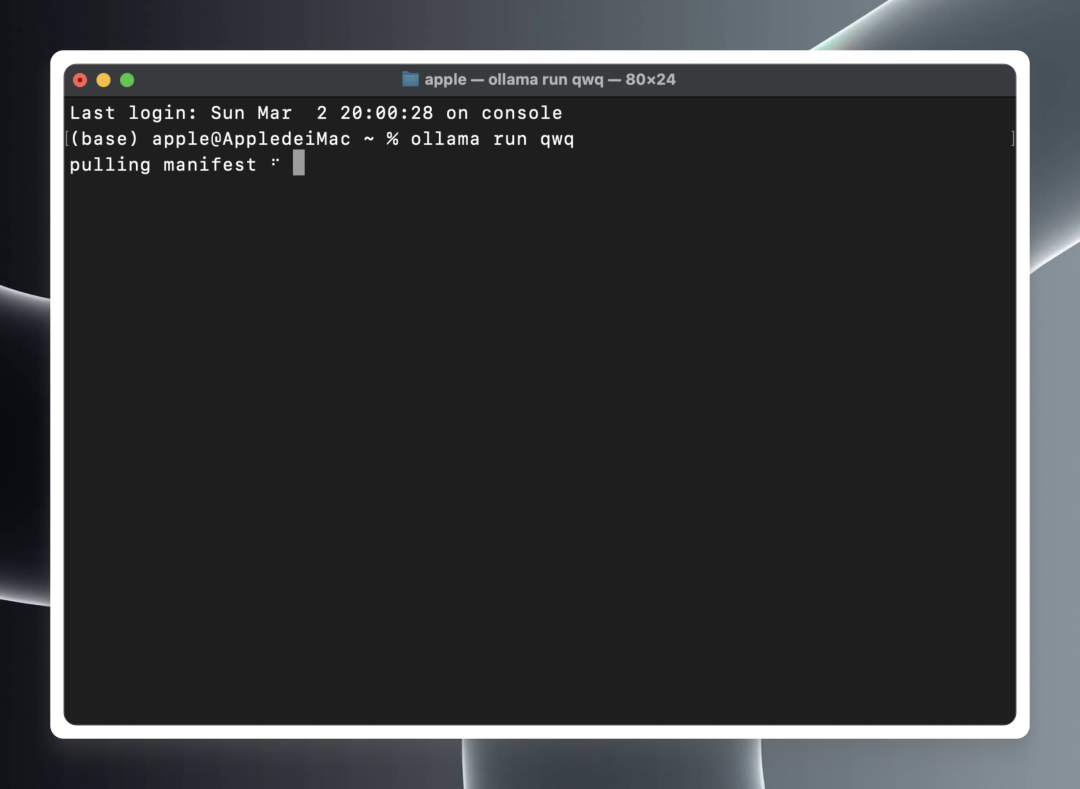

打开本地的终端或者 CMD。

直接输入命令:ollama run qwq

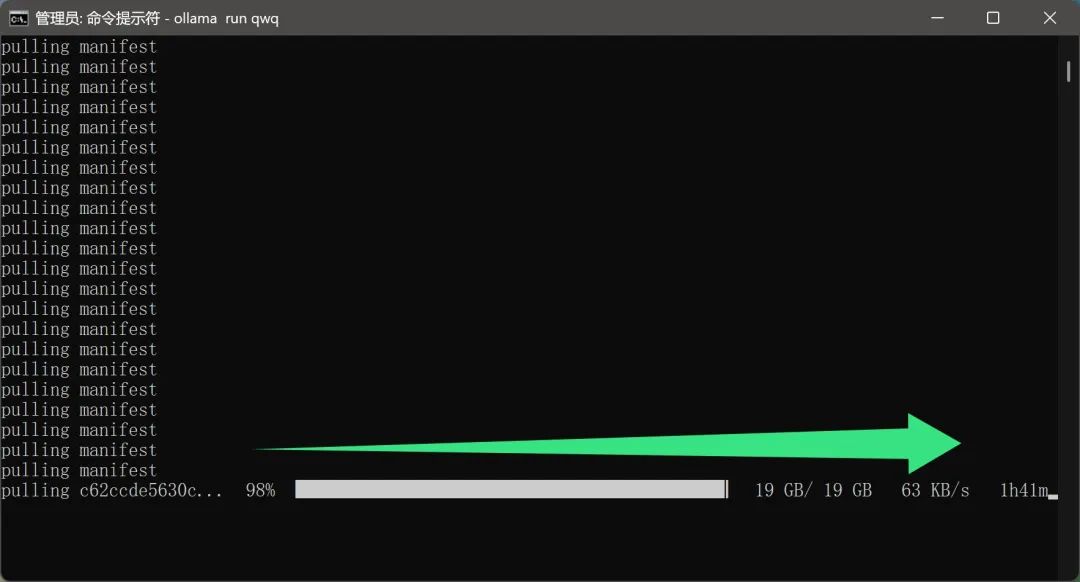

然后 Ollama 就会自动去下载模型了,下载完成之后就会自动运行。

下载这个模型,好像不需要魔法。

喜大普奔啊!否则近 20G的文件,下起来也是挺耗流量。

但是,可能是当前比较热门,下载速度越来越慢,急死个人!

搞了一下午,到晚上才下完,但是运行后惊喜。

我在 RTX3060 12G上抱着试试看的心态,运行了这个大模型,居然加载成功了,输入了内容,居然有回答,没有爆显存。

而且智力程度,绝对比降智的 openai 强。

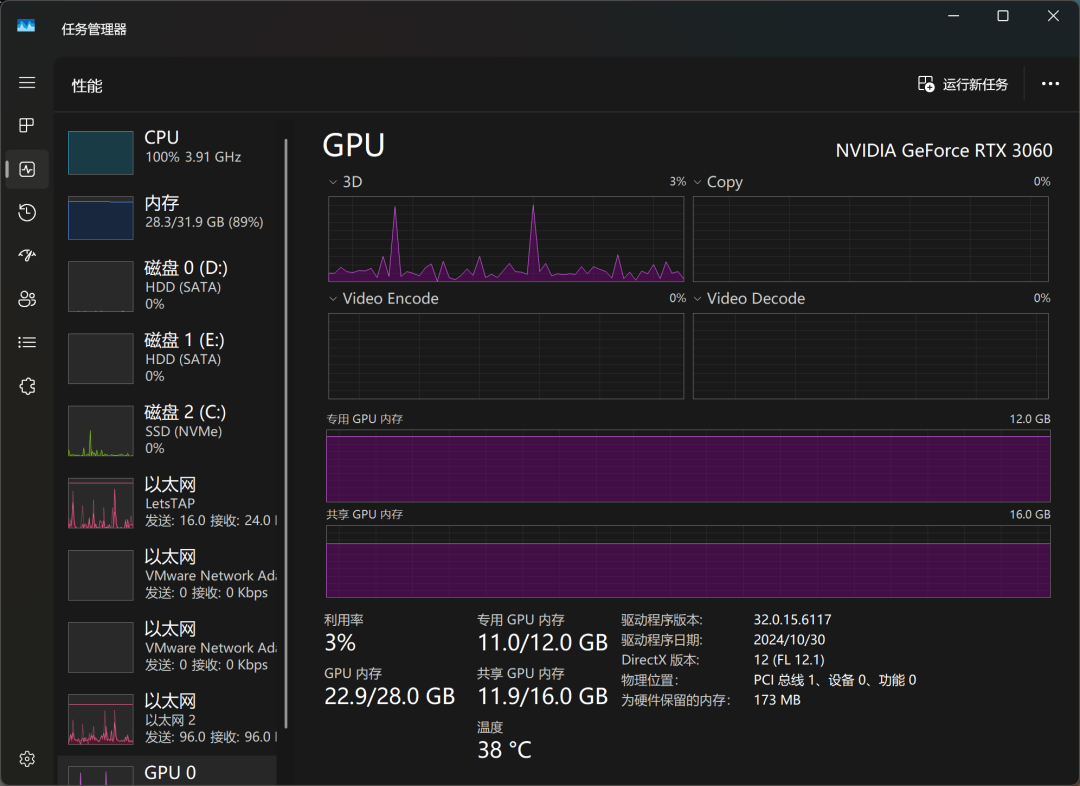

任务管理器的情况如下:

CPU,内存,显存,全部都高负荷运行了。

回答的速度大概是,哒,哒,哒,哒,哒…这种感觉。这速度只能说能用,但是不好用。

所以我又在 3090 上下了 20G 的模型。。。跑起来之后,健步如飞。

3.集成到客户端

直接在命令行对话,不太方面,我们之前介绍过很多客户端,现在就可以用上了。

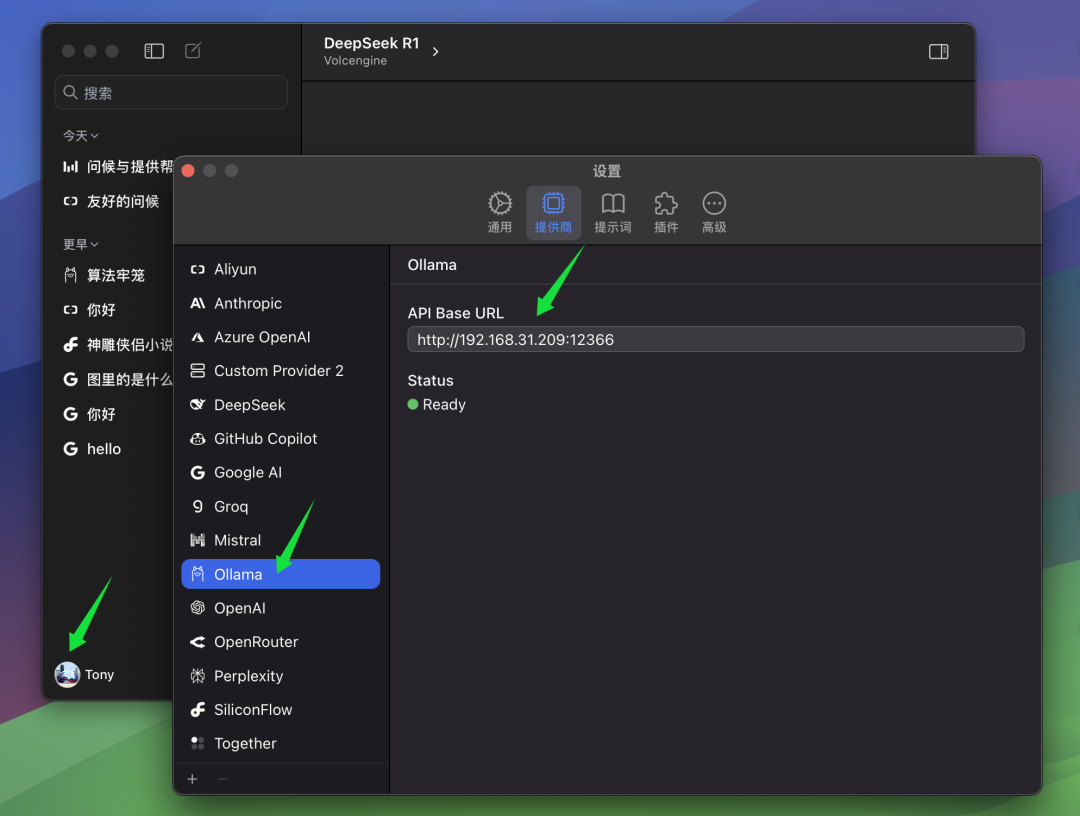

我这次用的客户端是 chatwise,因为这个比较简洁。不知道这个软件怎么用,怎么下载的可以看我之前的文章。

下面简单说一下配置问题。

如果的软件和 ollama 是在同一个机器上,几乎不需要配置,打开就直接用。大部分人都是这样,打开就直接用。

如果你像我一样在另外一台电脑上安装了 ollama,那么可以像上图一样修改一下BaseURL。IP地址就是运行 ollama所在电脑的 IP地址,端口就是你自己在环境变量中配置的端口,默认端口是 13434。

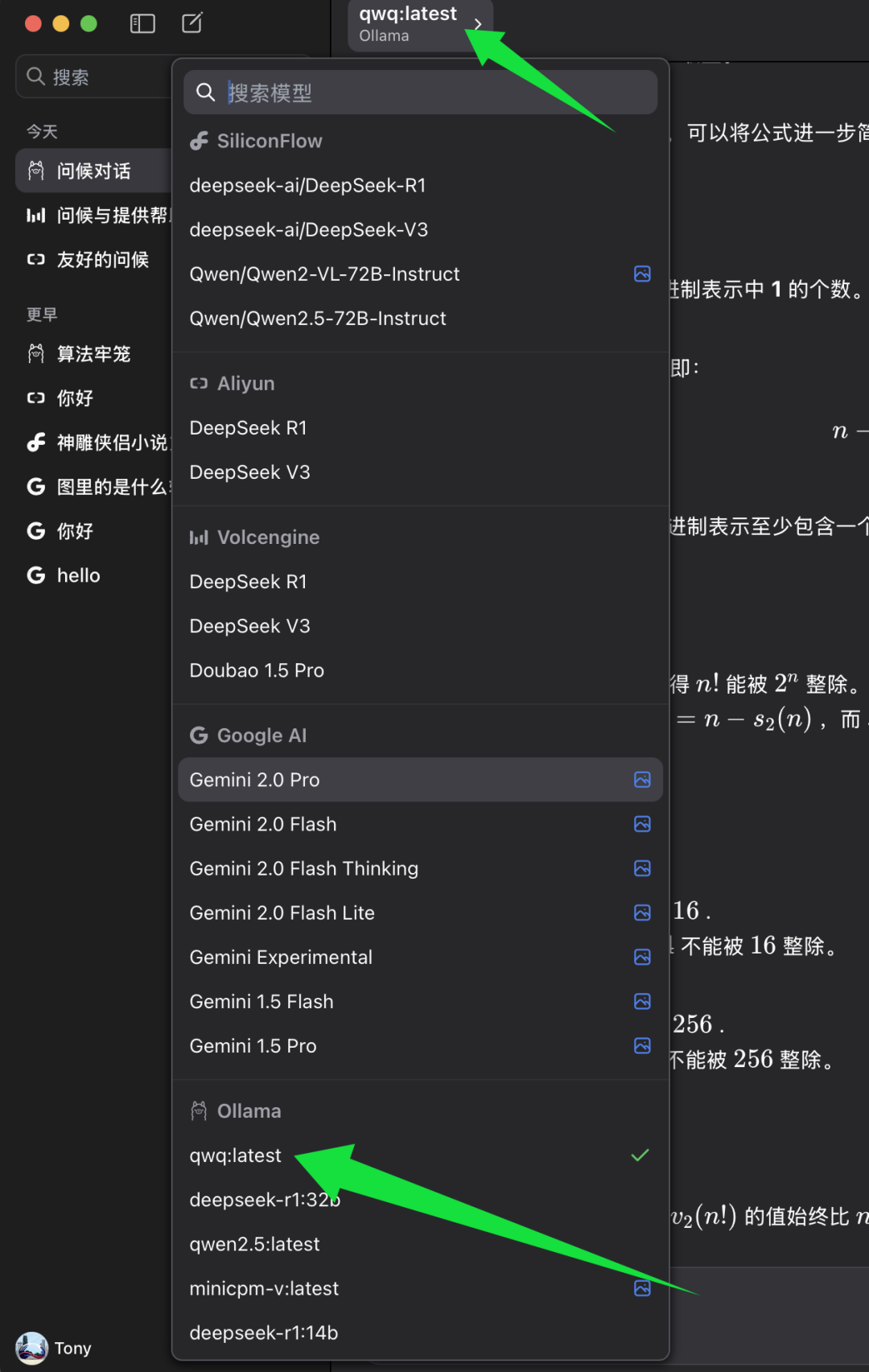

配置完成之后,就可以直接选择模型了。

在 Ollama 分类下选择 qwq:latest,这个就是 32b Q4 量化模型。

4.智力测试

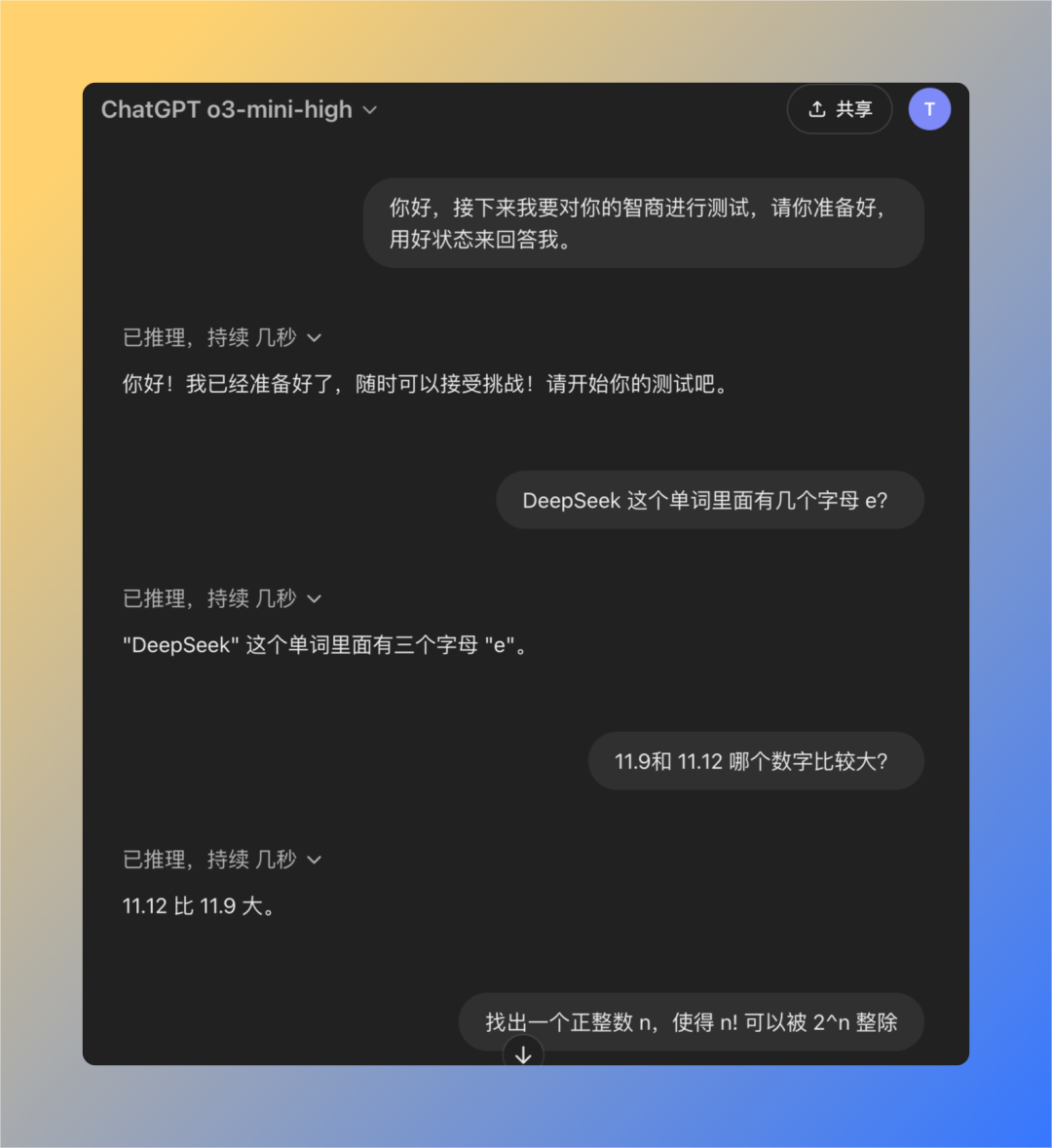

我在测试 openai 降智问题的时候,总结出了四个问题。只要你的 chatgpt o3 降智了,这些问题全部回答不出来。所以证明这几个问题,有一定的测试价值。

下面就一个一个来看一下,本地运行的 32B 模型,能否全部答对。

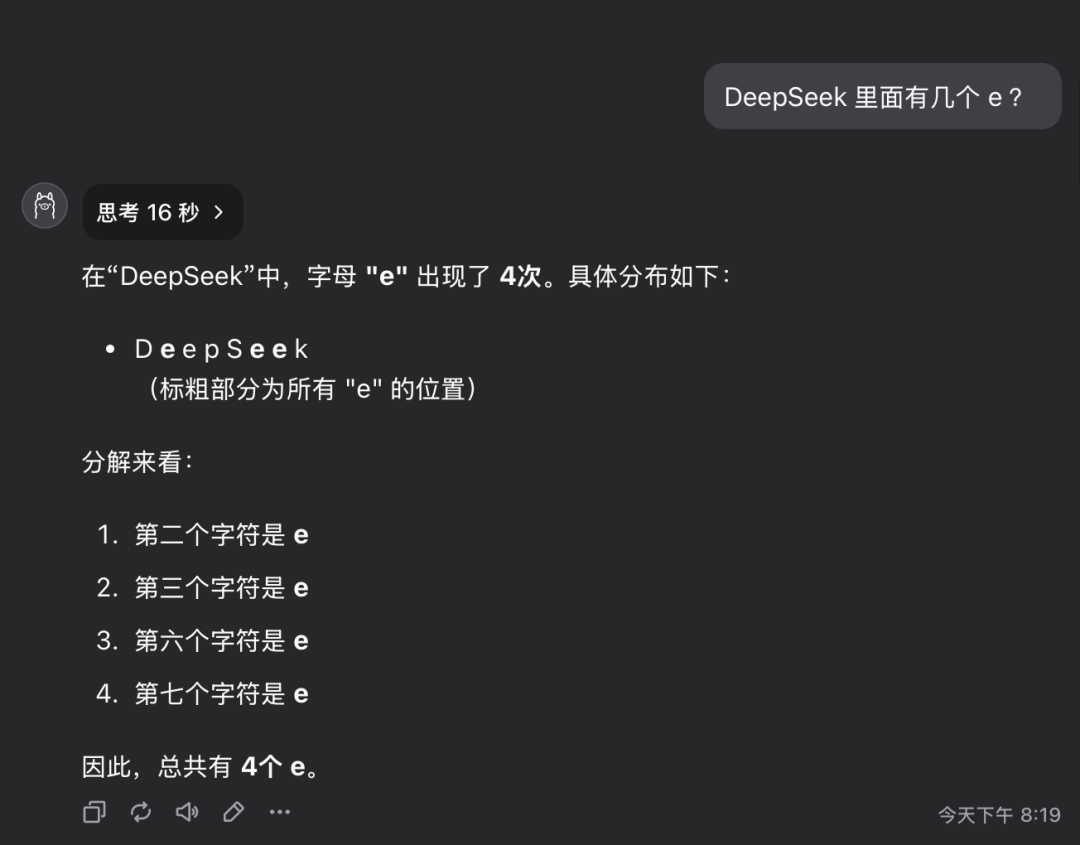

**问题 1:**deepseek 里面有几个e?

回答正确(16秒)

这个问题看似简单,现在还有大量的模型回答不了。

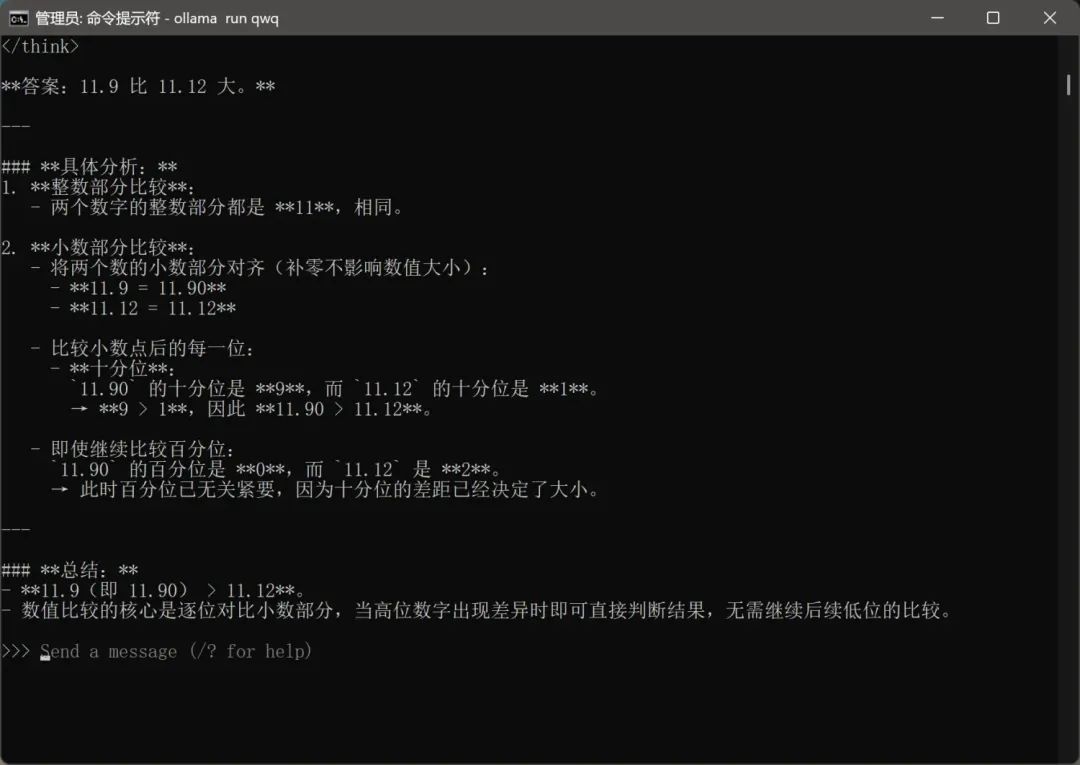

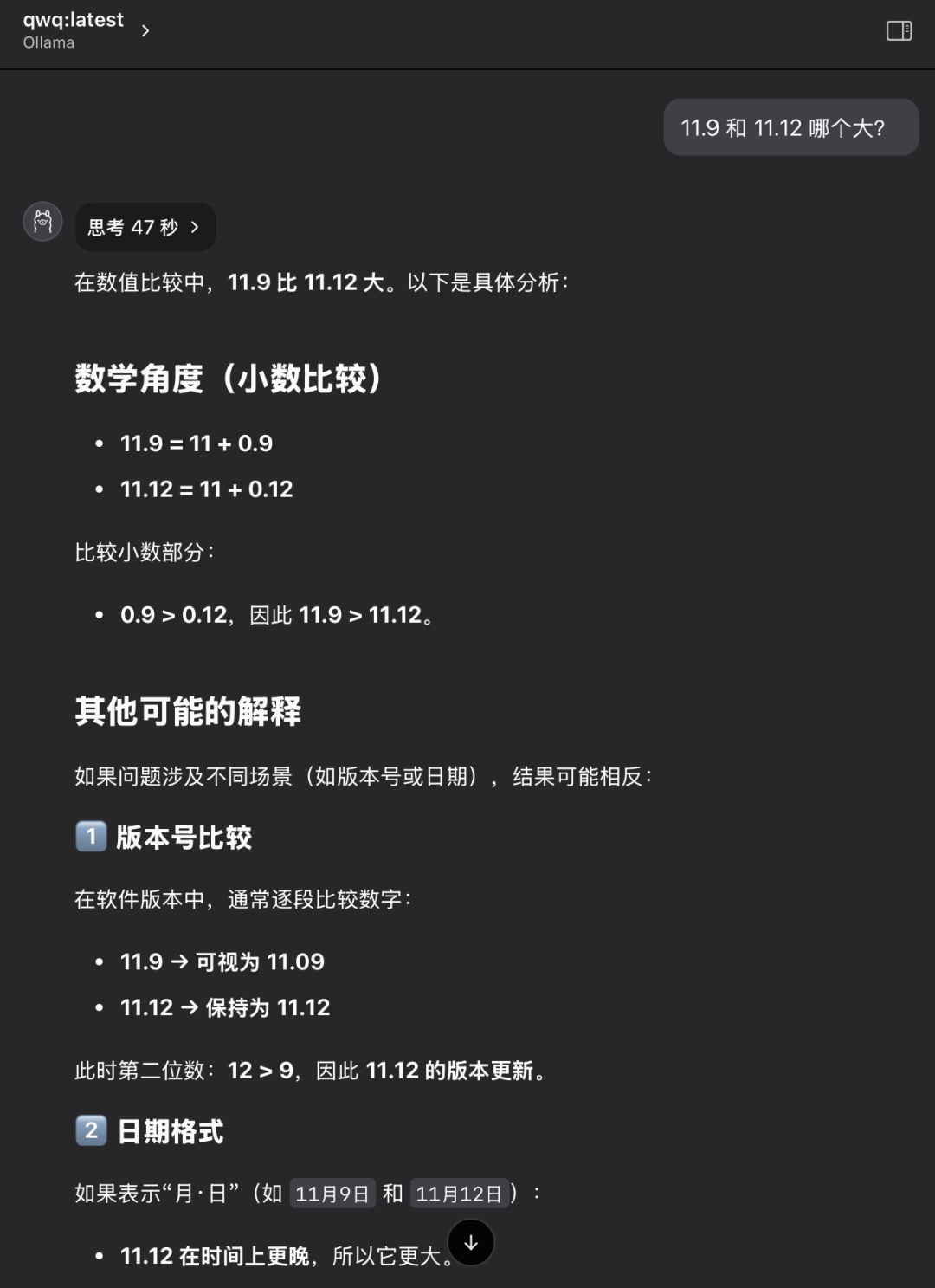

**问题 2:**11.9 和 11.12 哪个大?

回答正确(47 秒)

这也是一个经典的问题。很多大模型,连大小都比不清楚。

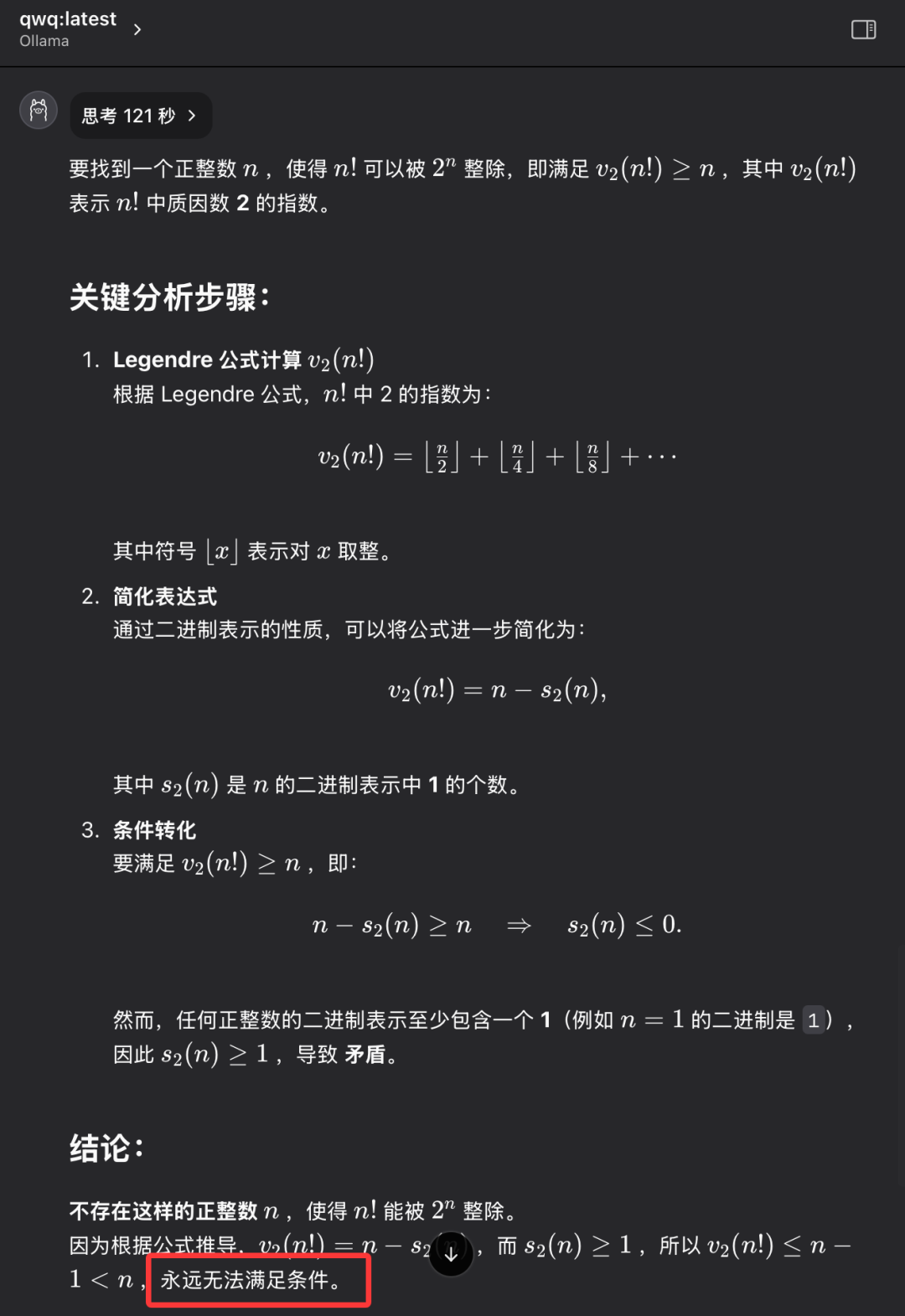

**问题 3:**找出一个正整数 n,使得 n! 可以被 2^n 整除

回答正确(121 秒)

这个问题的本质并不是找答案,而是要意识到没有符合的答案。

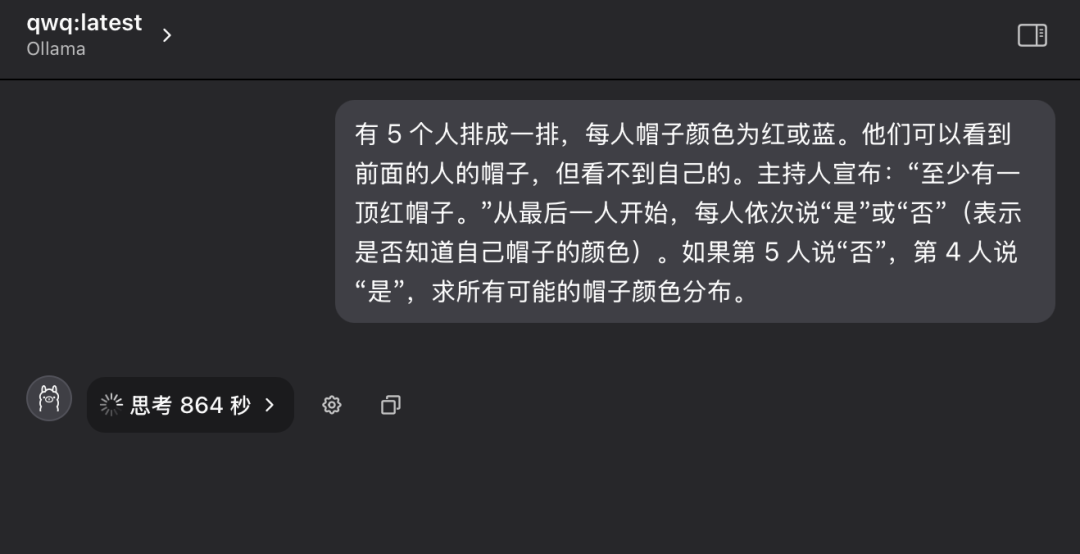

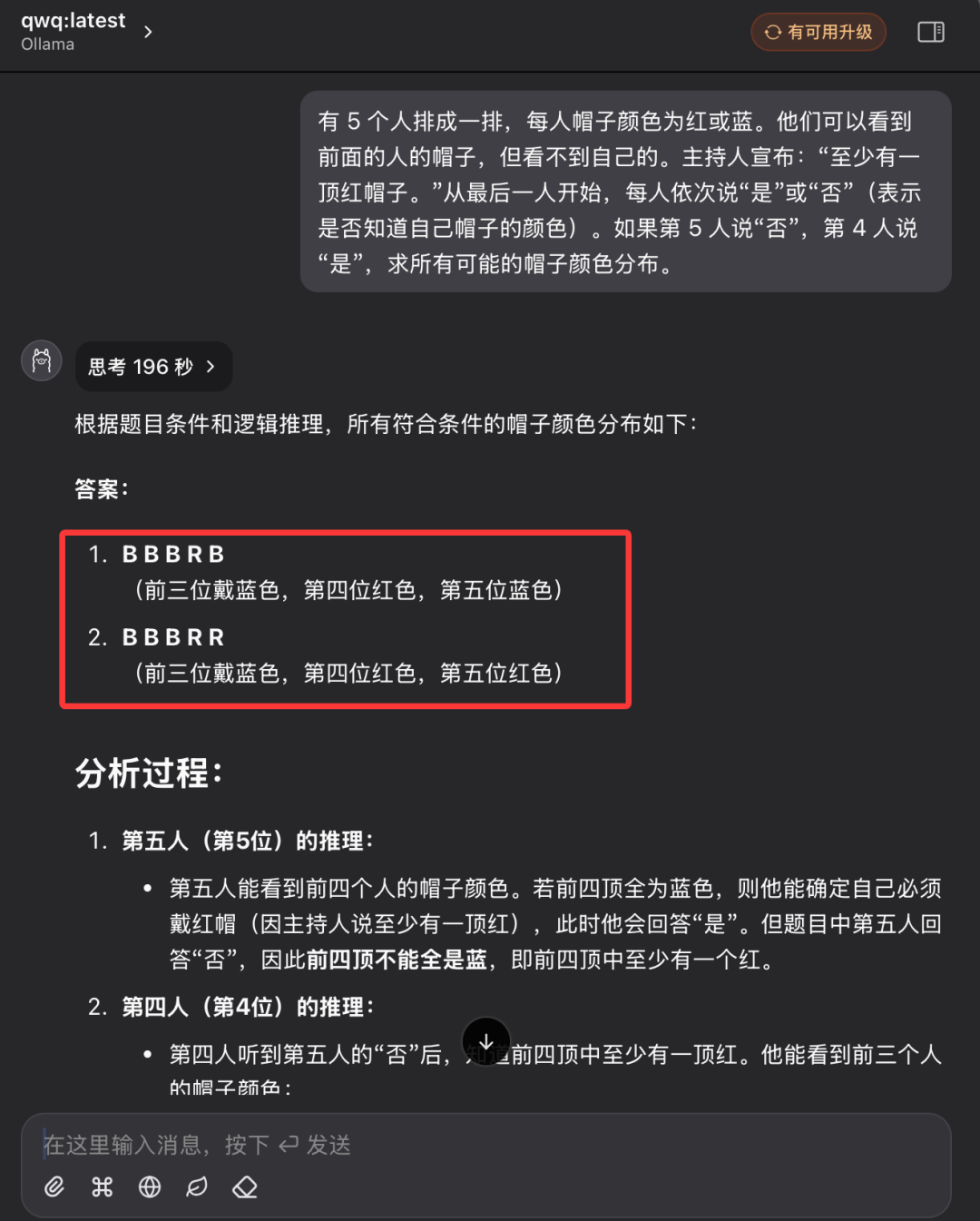

**问题 4:**有 5 个人排成一排,每人帽子颜色为红或蓝。他们可以看到前面的人的帽子,但看不到自己的。主持人宣布:“至少有一顶红帽子。”从最后一人开始,每人依次说“是”或“否”(表示是否知道自己帽子的颜色)。如果第 5 人说“否”,第 4 人说“是”,求所有可能的帽子颜色分布。

前面的问题都比较顺畅,但是这个问题出了一点状况。

第一次回答,疯狂思考,感觉脑子快烧坏了,我都有点心疼他(和我的显卡),在十多分钟的时候中断了。

重新开了一个对话,重新提问。

最终回答正确(196 秒)

然后我看了一下它的推理过程,它虽然脑子小,但是真的很努力。

结果简简单单几个字,脑子里思考了1万字啊,完整版思考过程。

这么测试下来,32B Q4 量化版也很强,那么 32B 满血版可想而知。所以基本可以判断,千问没有吹牛,QwQ 32B 确实很牛。用 320 亿的参数,能正面硬刚6710亿参数的 DeepSeek R1。

国产开源模型,一个比一个狠。

关键是,32B,只要一张24G 的显卡就能跑起来了啊,而且跑得挺快。以前简直不敢想啊,几百万的设备成本,现在可以降到一万多了。这东西出来了,感觉普通终端大有可为了。

最后的最后

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献51条内容

已为社区贡献51条内容

所有评论(0)