Deepseek本地部署

3、选择对应的模型来下载,1.5b、7b、8b、14b、32b、70b或671b,这里有很多版本可选,模型越大,要求电脑内存、显卡等的配置越高。通过以上三步,DeepSeek就部署在本地电脑上了,有些不方便公开的数据,比如实验数据,可以通过部署大模型到本地的方式进行处理,不用担心数据泄露。5、把复制的命令“ollama run deepseek-r1:7b”粘贴到终端命令窗口进行进行,出现下载等待

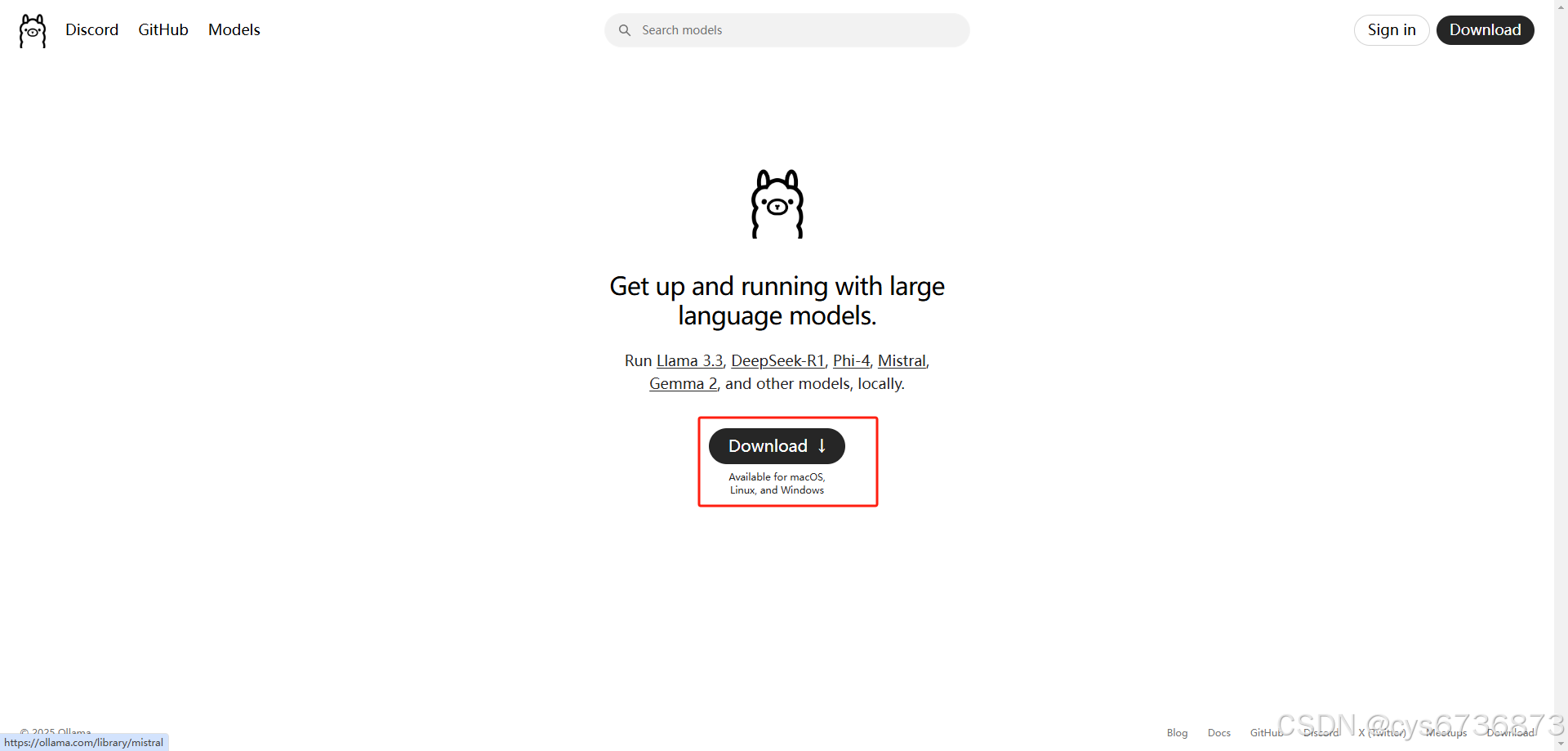

一、下载安装 Ollama

部署DeepSeek要用到Ollama,它支持多种大模型。

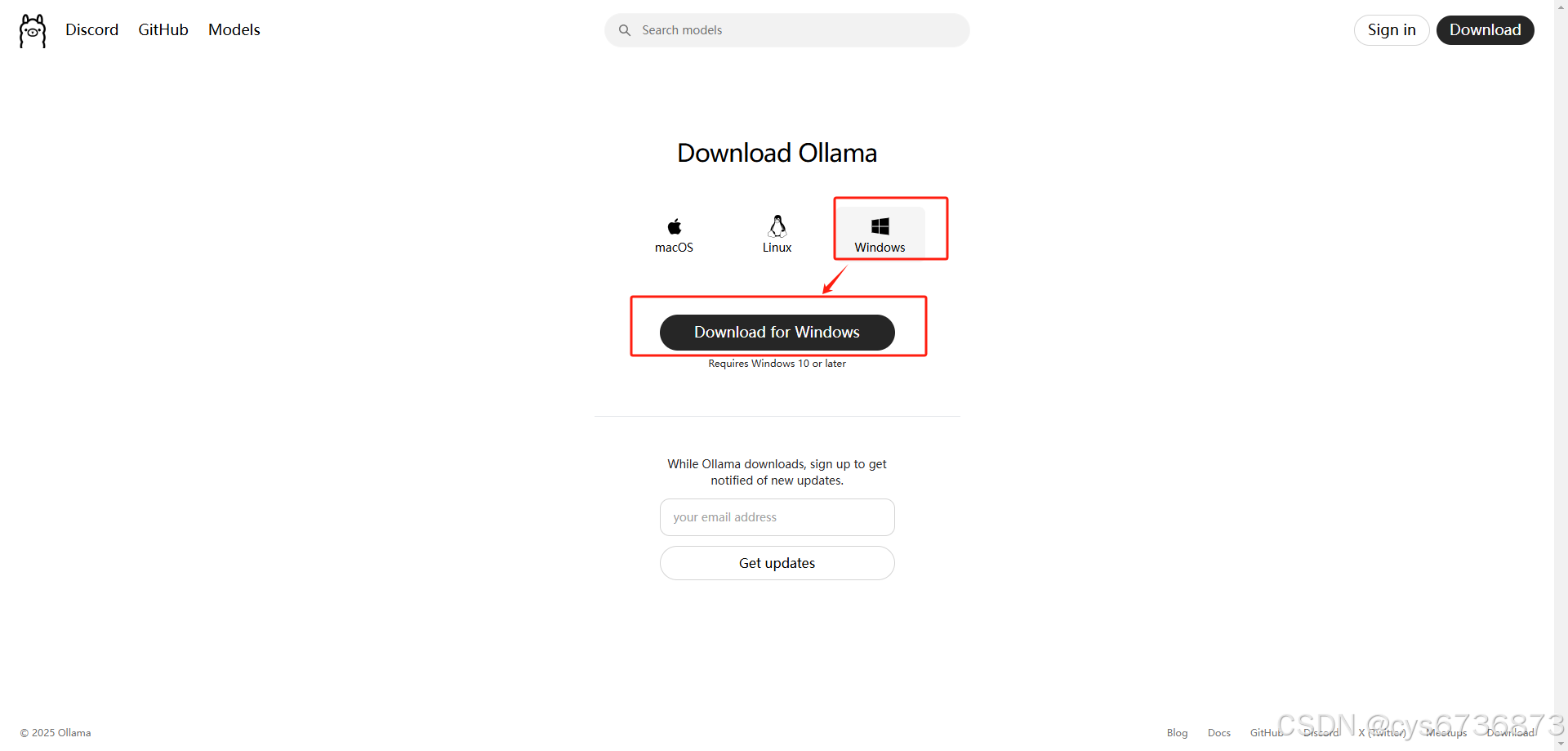

进入Ollama官网,选择对应的操作系统进行下载(注:使用国内网络可能比较慢或者掉线,建议用VPN)。本章节已windows10为例,下载完后根据安装提示进行安装操作。

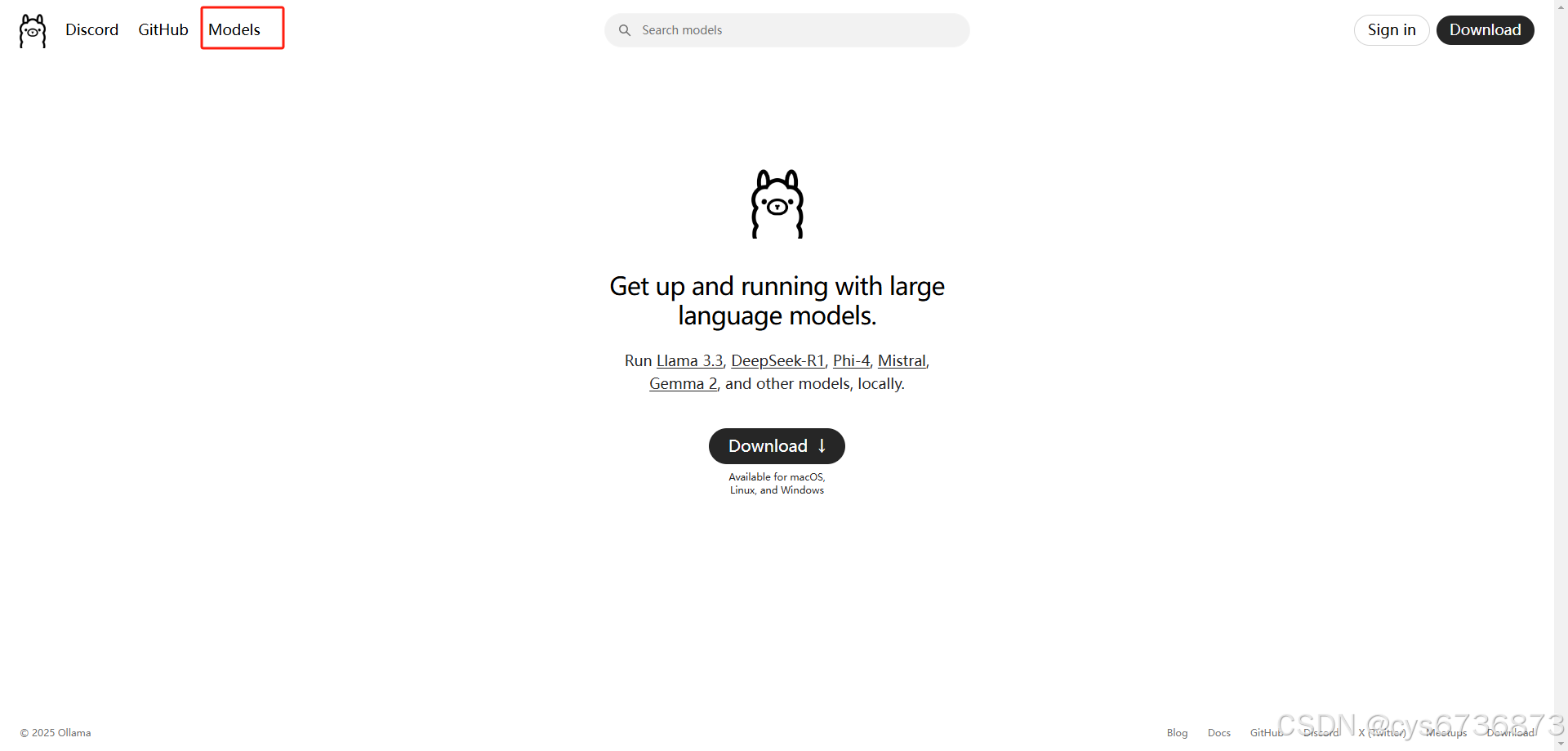

二、下载 DeepSeek-R1

1、再次进入Ollama官网,找到Models。

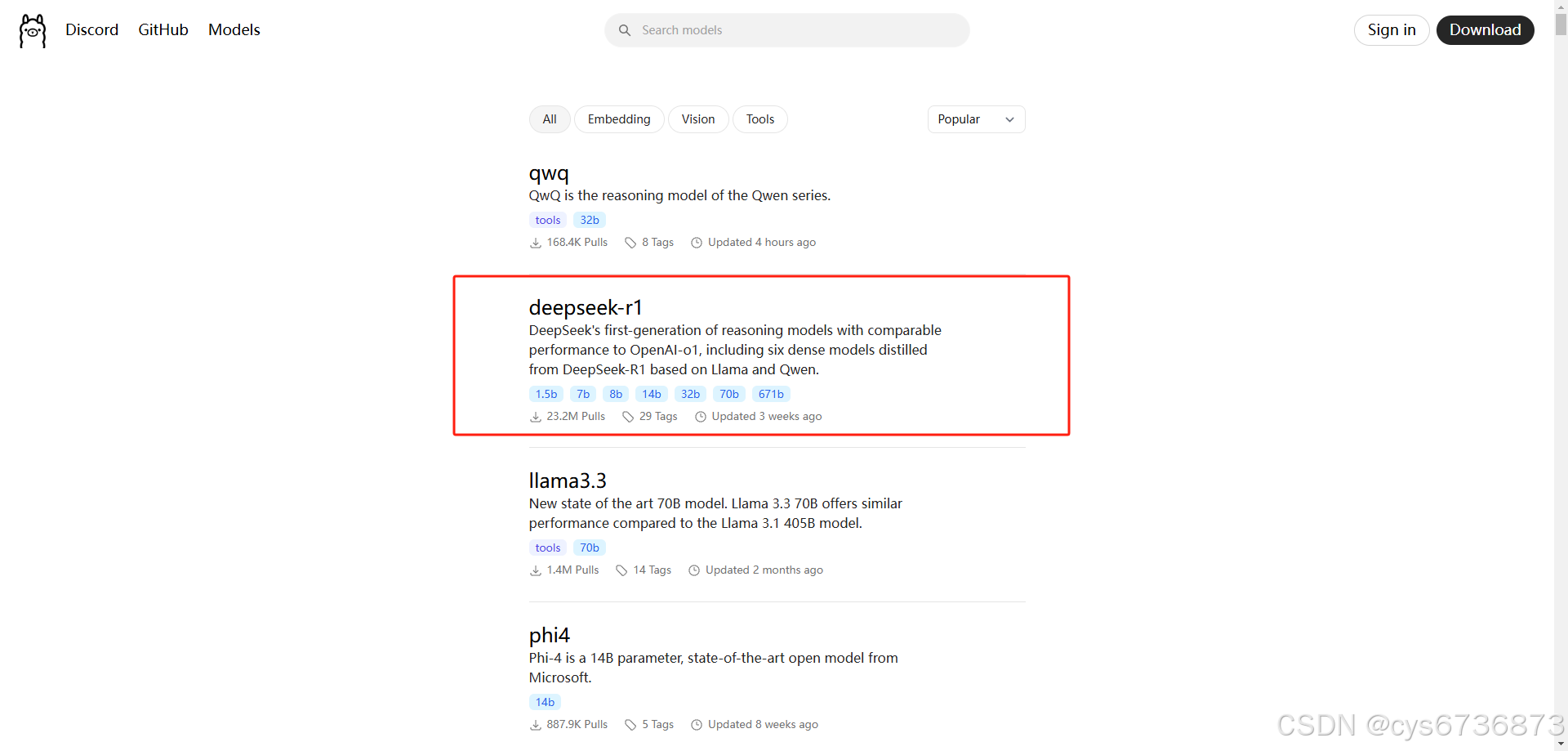

2、进入就可以看到deepseek-r1模型,如果没有,在搜索栏搜索即可。

3、选择对应的模型来下载,1.5b、7b、8b、14b、32b、70b或671b,这里有很多版本可选,模型越大,要求电脑内存、显卡等的配置越高。本章以7b模型为例,复制命令“ollama run deepseek-r1:7b”。

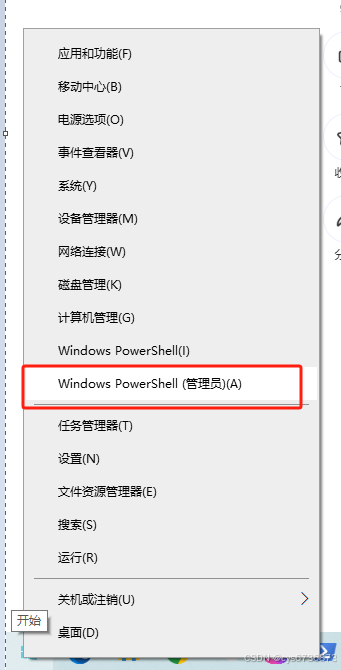

4、找到Windows【开始】菜单,鼠标右键点击【Windows PowerShell(管理员)(A)】打开终端命令窗口。

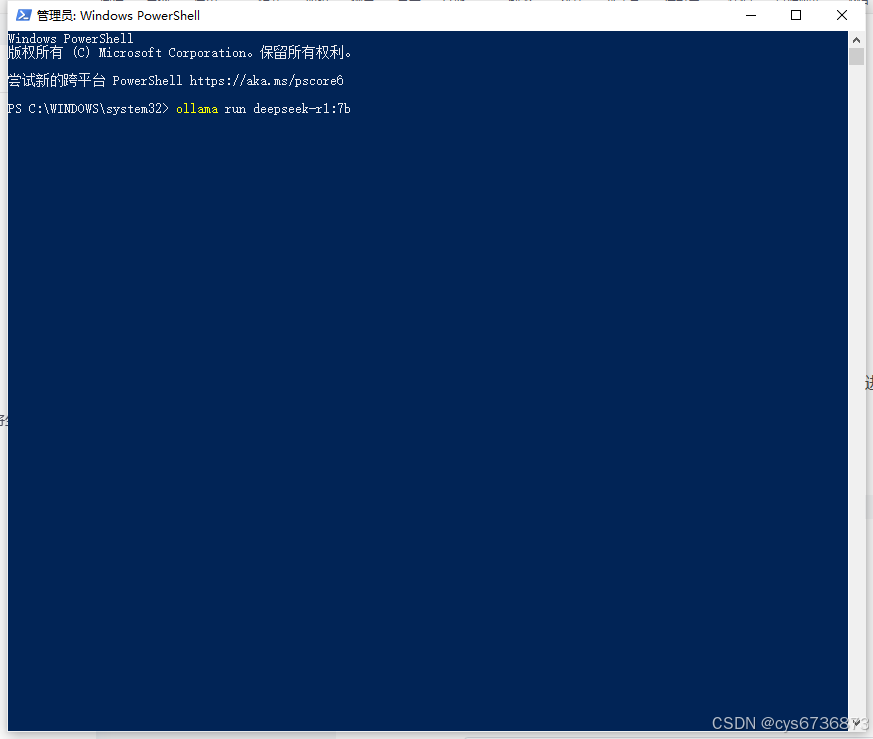

5、把复制的命令“ollama run deepseek-r1:7b”粘贴到终端命令窗口进行进行,出现下载等待窗口,等待下载完成。

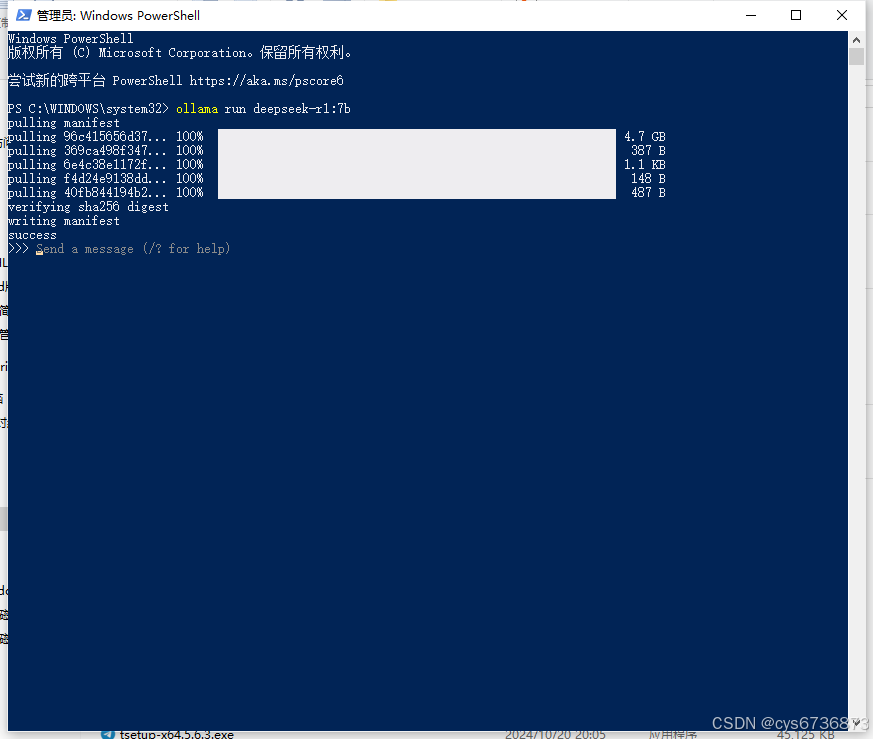

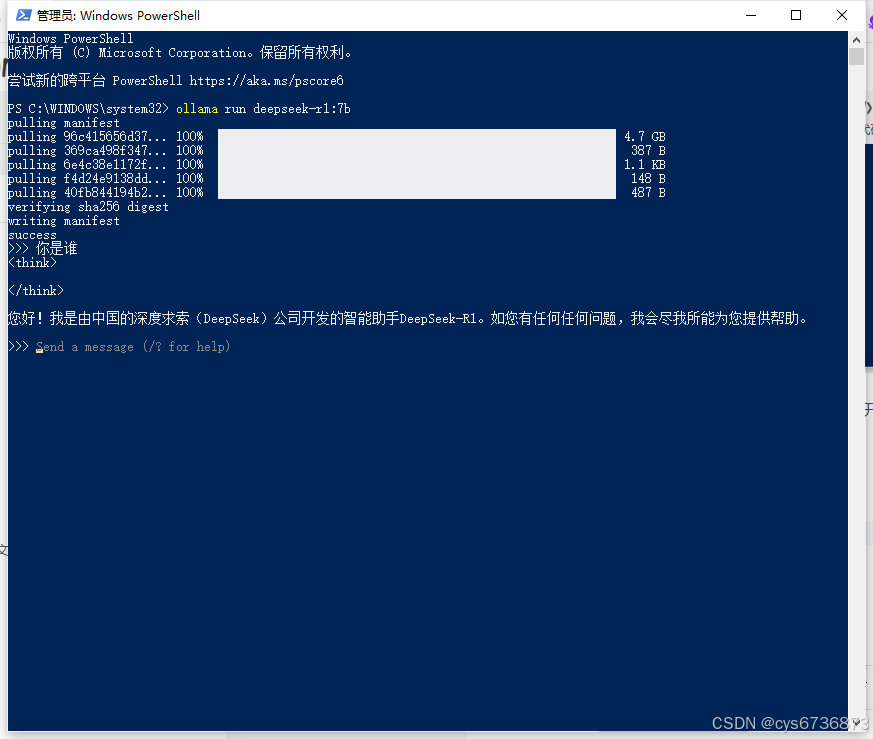

6、下载完成后稍微等待,看到success,即部署完成。

7、部署完成,send a message,输入内容即可开始对话。

三、Chatbox前端搭建

通过第二步的操作,已经部署好DeepSeek,但每次使用都要在终端管理员里操作,相当繁琐。这里可以借助Chatbox,实现网页或客户端操作。

1、下载安装Chatbox

进入Chatbox官网下载安装Chatbox客户端。

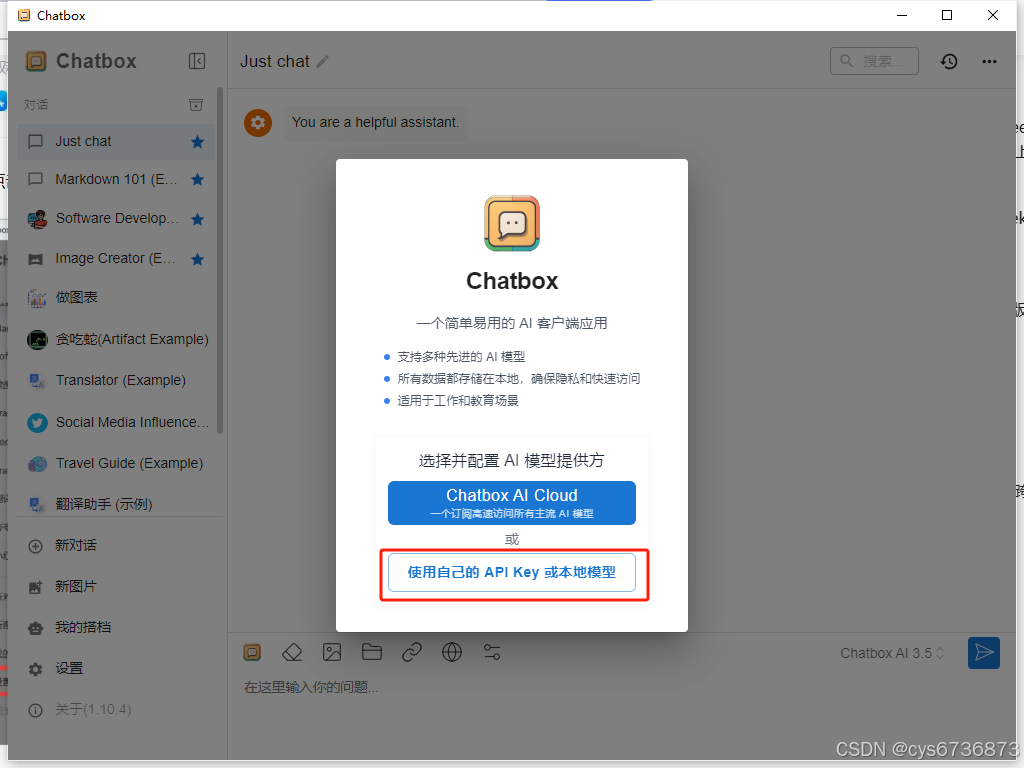

2、安装时,选择“本地模型”。

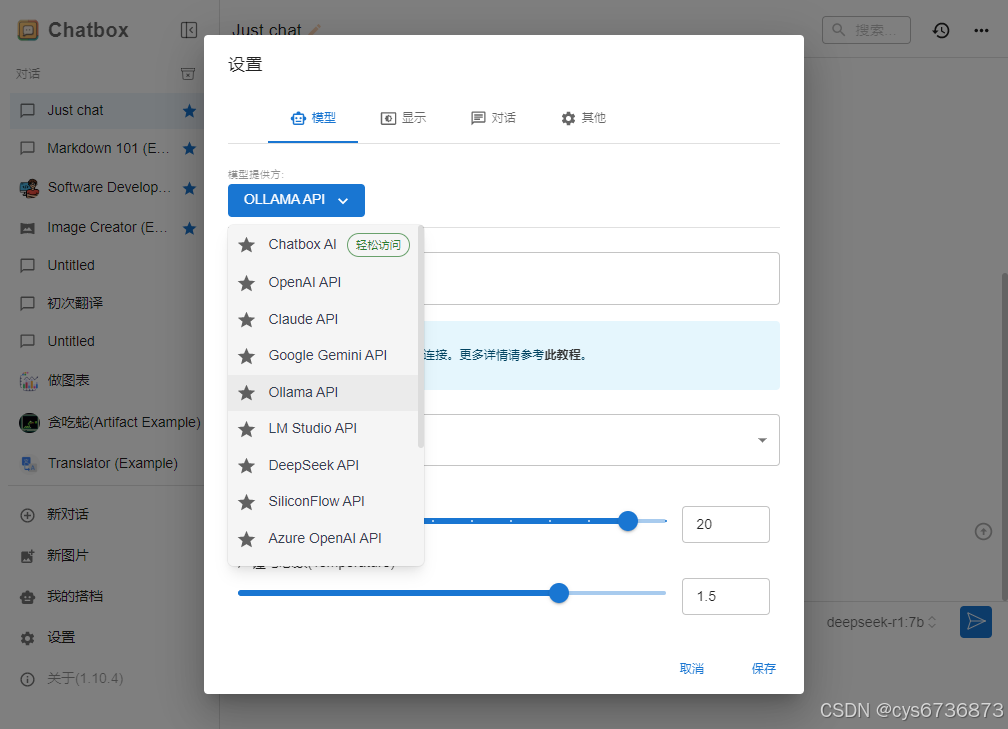

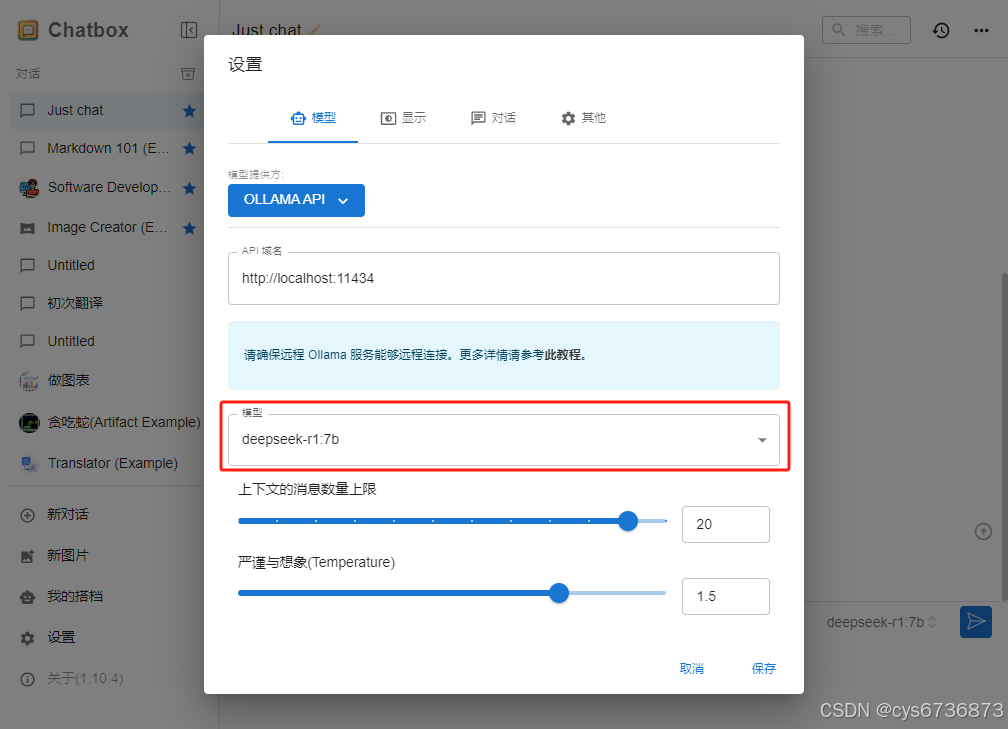

3、点击设置,选择Ollama API

4、选择安装好的deepseek r1模型,保存即可。

4、部署完成,就可以正常使用了。

通过以上三步,DeepSeek就部署在本地电脑上了,有些不方便公开的数据,比如实验数据,可以通过部署大模型到本地的方式进行处理,不用担心数据泄露。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)