Dify+Ollama+deepseek本地部署大模型完整教程

Dify+Ollama+deepseek本地部署大模型完整教程

Dify+Ollama+deepseek本地部署大模型完整教程

1. 安装前硬件要求

| 名称 | 参数 |

|---|---|

| 操作系统 | Windows 11(64位) |

| 处理器 | 至少2核,2GHz或更快 |

| 硬盘空间 | 至少60GB |

硬件越好,性能越高,处理越快。

2.安装WSL和Docker

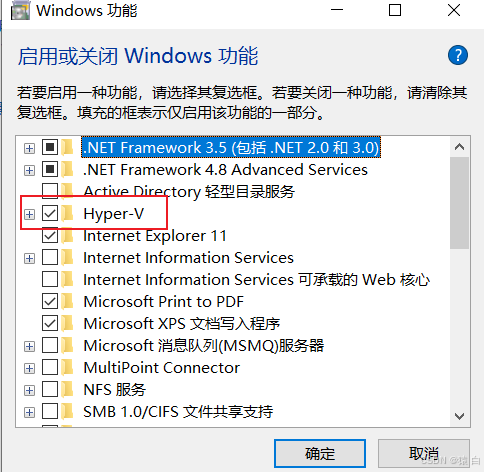

(1)开启Hyper-V,安装WSL

打开控制面板,找到对应的功能进行打开,操作如下图:

windows+R,输入cmd,命令行输入wsl --install,安装重启电脑。重启后输入wsl --status查看状态。

如果无报错,跳过更新;如果有报错,输入

wsl --update更新(若下载缓慢可终止 Ctrl + C,再使用wsl --update --web-download重新下载)。

最后输入wsl --status确认安装成功。

(2)安装Docker

Docker官网下载地址: Docker: Accelerated Container Application Development

下载与系统相对应的版本进行安装即可。

3.安装git

网址:https://github.com/git-for-windows/git/releases/download/v2.48.1.windows.1/Git-2.48.1-64-bit.exe

搜索:github文件加速下载,加速下载github文件

安装教程:【可以无脑下一步】windows安装git(全网最详细,保姆教程)

4.安装dify

配置docker镜像源,加速下载

增加docker镜像源:https://docker.1ms.run

{

"builder": {

"gc": {

"defaultKeepStorage": "20GB",

"enabled": true

}

},

"experimental": false,

"features": {

"buildkit": true

},

"registry-mirrors": [

"https://docker.1ms.run"

]

}

更改镜像源方式一:docker界面操作

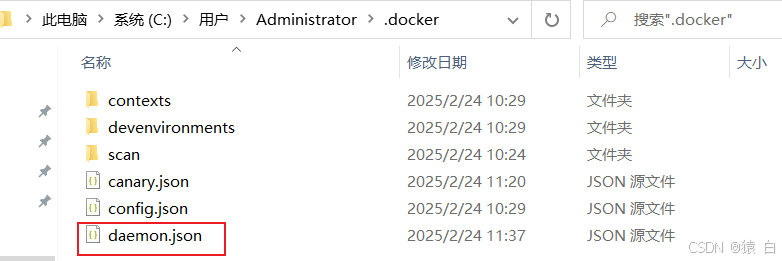

更改镜像源方式二:找到json文件进行编辑

方式一:使用git克隆

打开cmd,输入命令:

从指定的GitHub仓库中获取Dify的代码:

git clone https://github.com/langgenius/dify.git

操作,复制配置文件:

cd dify/docker

copy .env.example .env

cd是切换文件,相当于windows操作,进入到docker文件夹下。

cp是复制,复制示例配置文件,这一步就像是复制一份模板,后续可以根据自己的需求修改其中的参数,比如调整端口或密钥等。

一键启动服务:根据你安装的Docker Compose版本,选择相应的命令启动服务。如果是Docker Compose V2,在终端输入:

docker compose up -d

如果运行报错,运行V1版本代码:

docker-compose up -d

方式二:直接github下载压缩包

github下载地址:GitHub - langgenius/dify

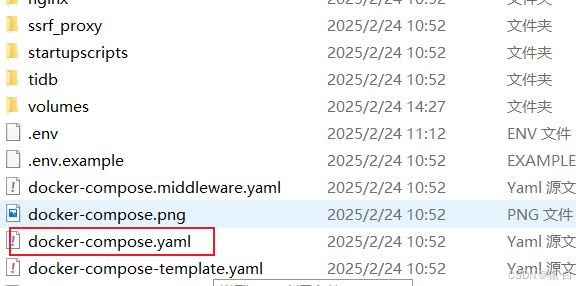

解压文件,先找到docker-compose.yaml文件所在的文件夹(通常在 dify 目录下的 docker 文件夹中)

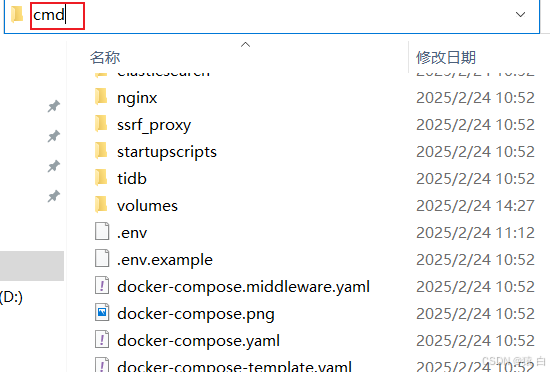

进入命令行模式:

一键启动服务:根据你安装的Docker Compose版本,选择相应的命令启动服务。如果是Docker Compose V2,在终端输入:

docker compose up -d

如果运行报错,运行V1版本代码:

docker-compose up -d

耐心等待下载

耐心等待下载完成:【下载不动可能是镜像源已失效】

问题处理(没报错跳过)

若出现端口冲突(例如 Error response from daemon: Ports are not available),可通过以下方法解决:

方法一:关闭占用 80 端口的服务。

方法二:修改 .env 文件中端口号,将 NGINX_PORT=80 和 EXPOSE_NGINX_PORT=80 改为 81。

安装是否成功

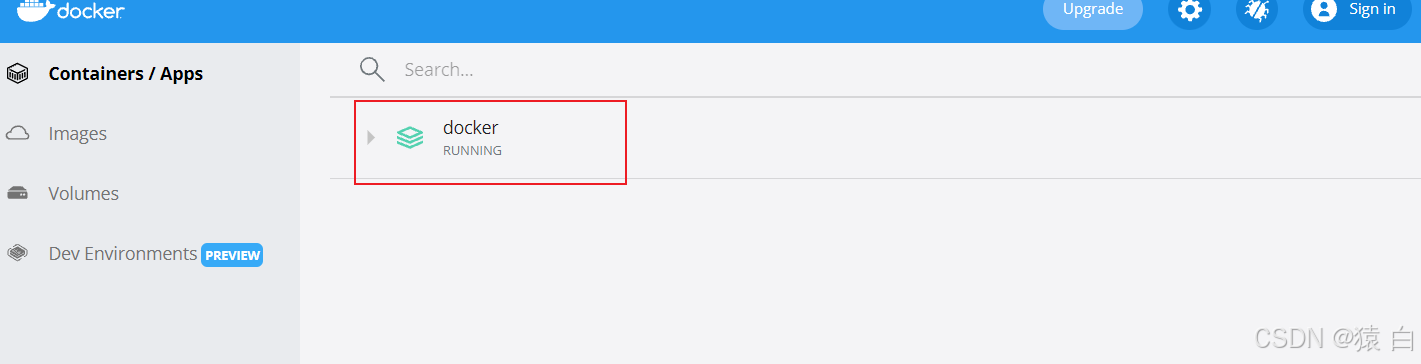

打开docker,看到运行的容器即可。

5. 登录Dify

在浏览器中打开:

http://localhost:80

或者

http://127.0.0.1:80

如果更改了端口,自行替换即可。

浏览器打开http://localhost/signin,进行注册登录

6. dify配置模型

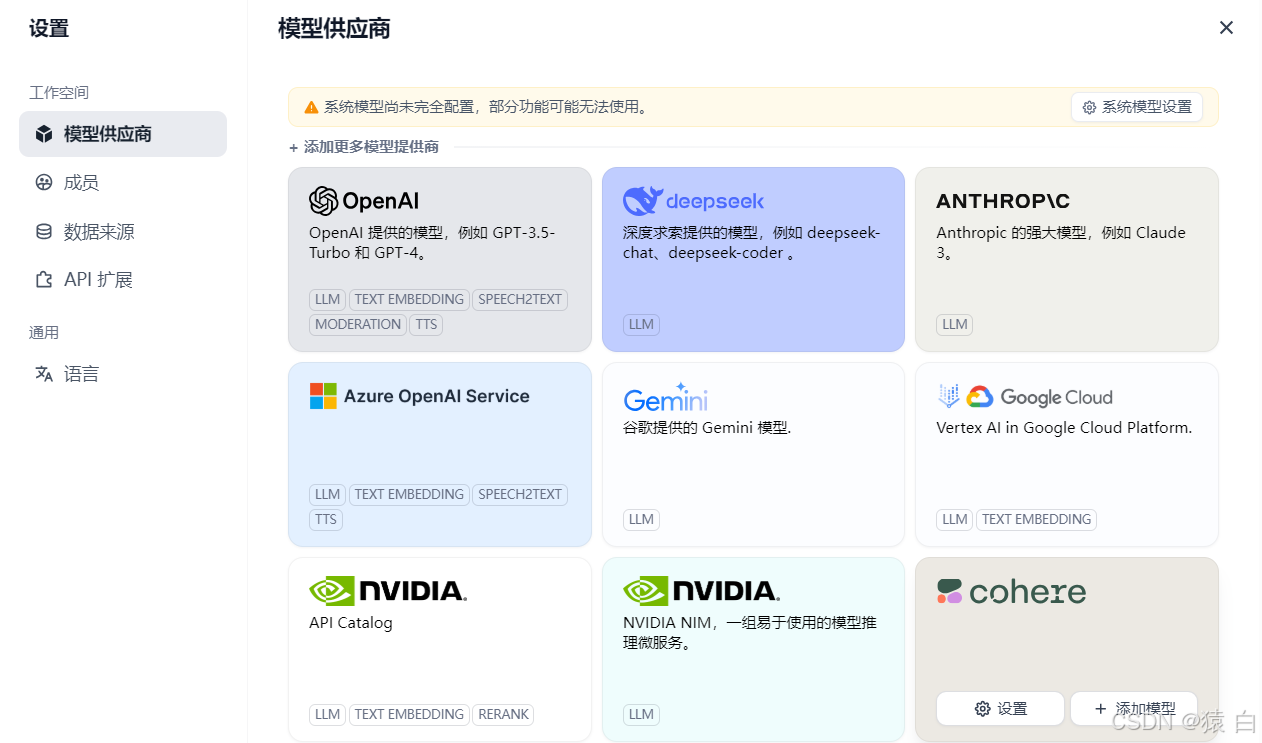

说明:Dify只是一个工具,AI模型需要配置API

Dify 是一个运行在本地的 Web UI,它允许我们便捷地访问和使用各种大语言模型,但是需要注意的是,下载 Dify 并不等同于下载了这些模型本身,如果希望使用这些大模型,依然需要入场券,也就是需要拿到相应的 API Key,这部分是需要自己额外付费。

右上角,个人信息下拉,选择设置,找到模型供应商:

以deepseek为例:

进入官网:DeepSeek 开放平台

参考文档: DeepSeek API Docs

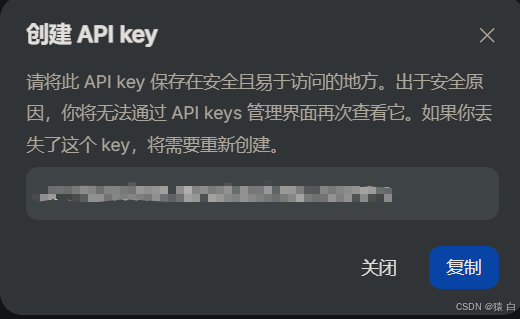

生成API key,方便调用:

记住api key,保存下来备用:

7.集成Ollama[本地化]

1. 下载安装包

官网地址:Ollama

github地址:https://github.com/ollama/ollama/

windows下载安装OllamaSetup.exe

mac下安装同理

linux安装采用命令行curl -fsSL https://ollama.com/install.sh | sh

2.安装验证

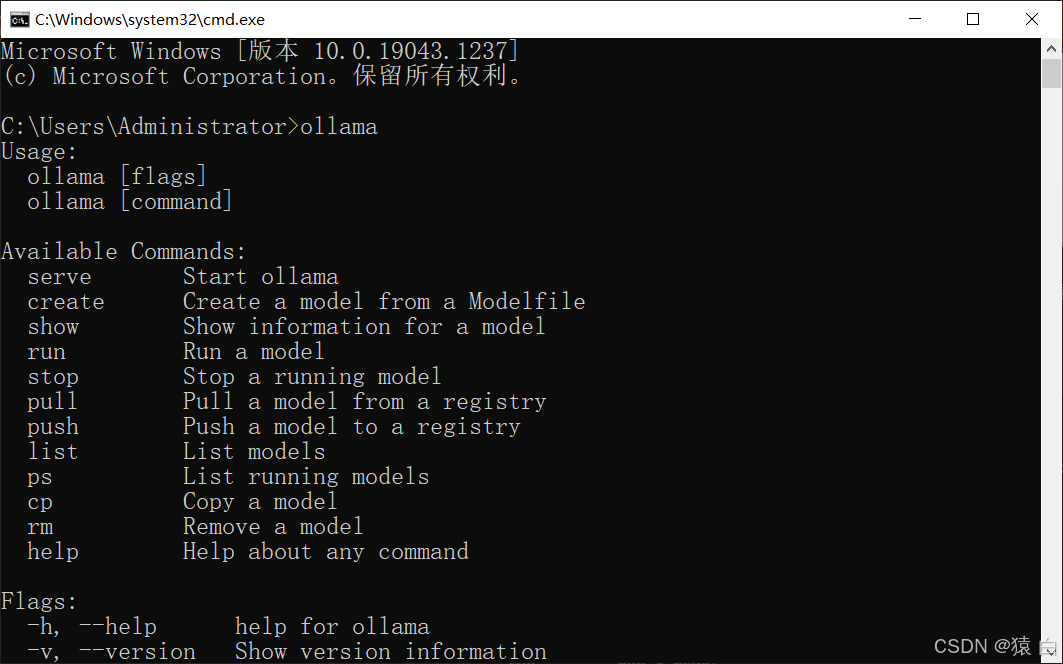

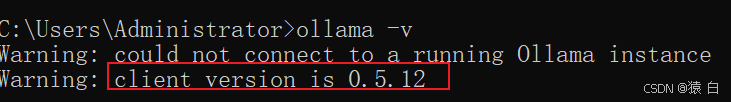

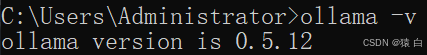

安装后验证是否安装完成,测试如下:cmd下,输入ollama,出现如图下的界面皆为安装成功。

或者输入ollama -v查看版本信息

出来版本信息即为安装成功

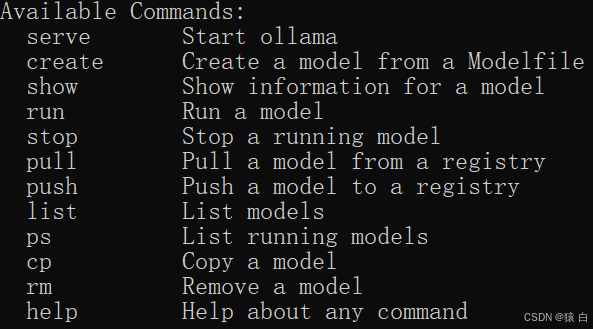

3.常用命令

ollama的常用命令如下:

ollama serve #启动ollama

ollama create #从模型文件创建模型

ollama show #显示模型信息

ollama run #运行模型

ollama pull #从注册表中拉取模型

ollama push #将模型推送到注册表

ollama list #列出模型

ollama cp #复制模型

ollama rm #删除模型

ollama help #获取有关任何命令的帮助信息

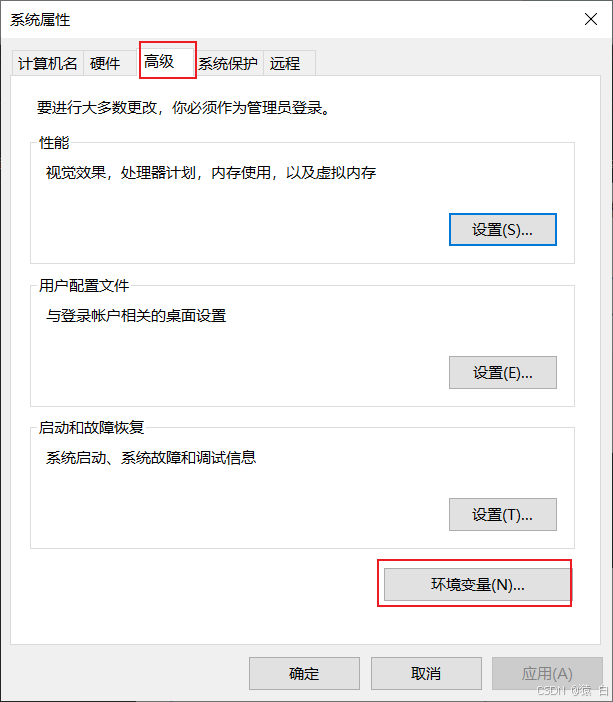

4. 更改ollama安装路径【默认C盘,可以跳过这步】

因为安装ollama的时候,默认安装到c盘,没有更改路径的选项,因此需要根据存储空间的大小自行选择是否更改。

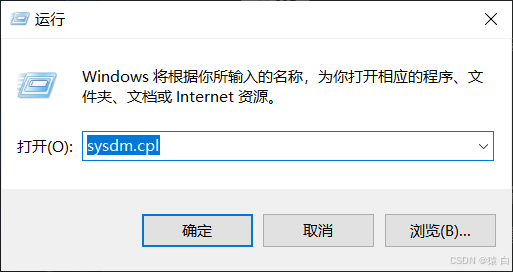

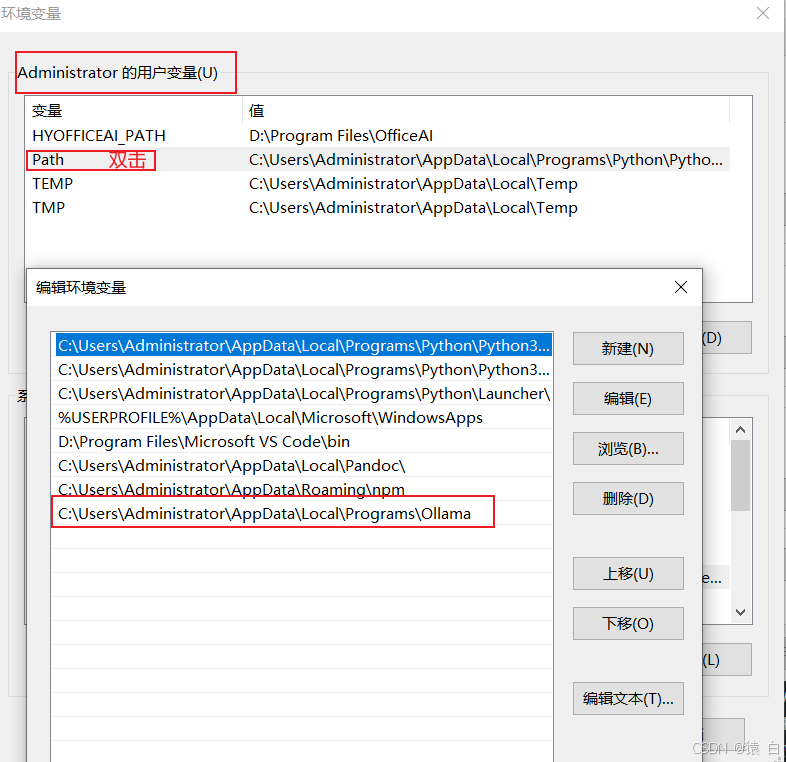

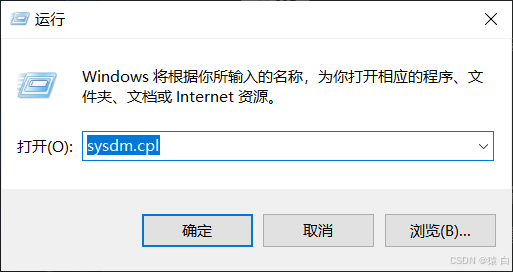

windows下,同时按下windows+R,输入sysdm.cpl

更改这里的路径,

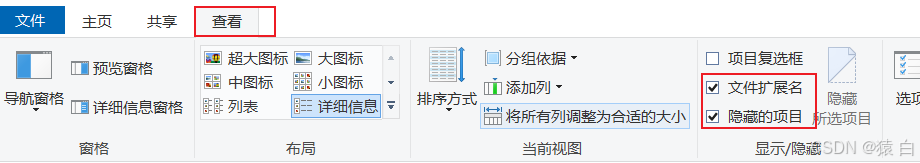

如果找不到appdata这个文件夹,可能隐藏了,状态栏选择

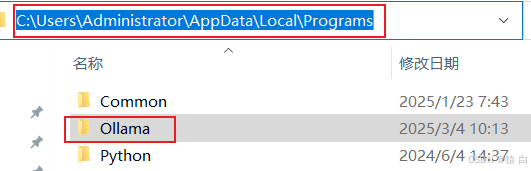

把这里的ollma文件夹全部剪切走,放在想要放的文件夹下,例如我的是:D:\Ollama\program_ollama\Ollama

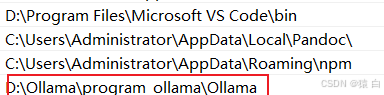

然后把这个地址替换掉path路径下的c盘路径

重启ollama,cmd命令行下测试ollama -v:

完成上述操作即为路径迁移成功!

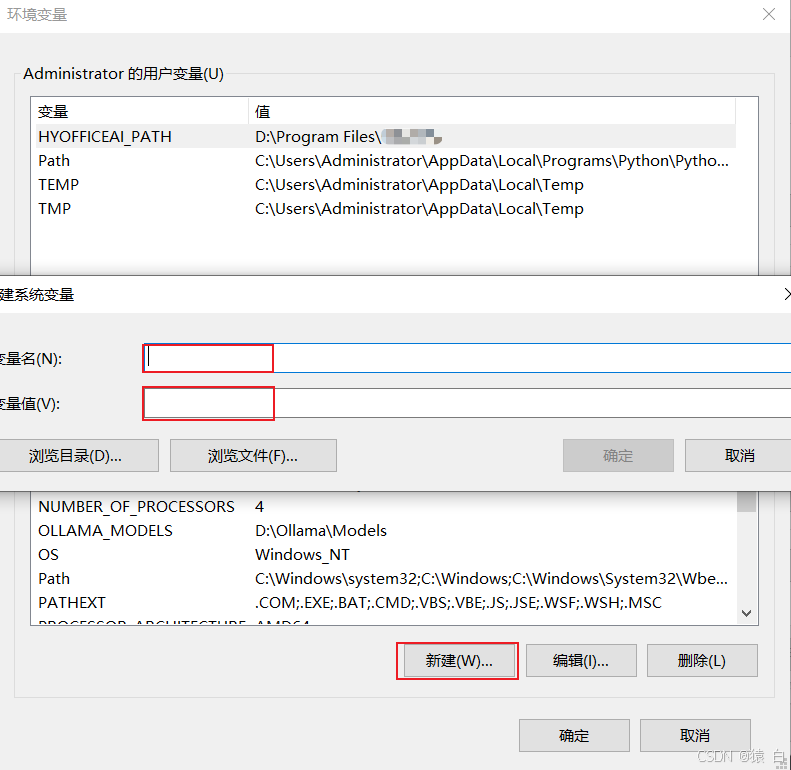

4.更改模型安装路径

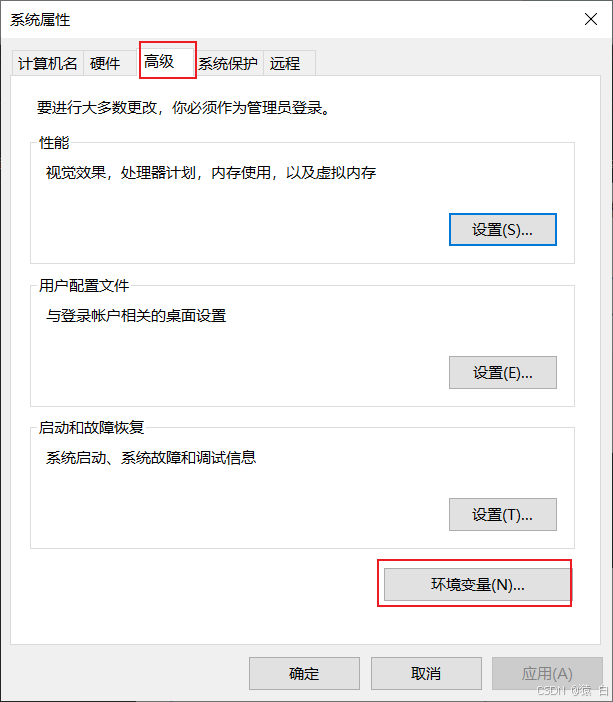

windows下,同时按下windows+R,输入sysdm.cpl

新建环境变量:

变量名:

OLLAMA_MODELS

变量值:大模型存放的地址,例如D:\ollama

操作完成,关闭页面,退出重新打开ollama使配置生效。

5.下载大模型【deepseek为例】

根据电脑性能选择合适的deepseek模型

| deepseek版本 | 模型大小 | cpu要求 | 内存要求 | 硬盘要求 | 显卡要求 | 应用场景推荐 |

|---|---|---|---|---|---|---|

| DeepSeek-R1-1.5b | 1.5-2G | 最低 4 核 | 8G+ | 5G+存储 | 非必要,推荐gtx1650以上 | 旧电脑,文本生成,聊天机器人,简单回复,物联网,小型设备 |

| DeepSeek-R1-7b | 4-5G | 最低8核+ | 16G+ | 8G+存储 | 推荐8G+显存,rtx3070/4060等 | 中小型企业使用开发测试,中等复杂文本处理任务,轻量级别对话系统 |

| DeepSeek-R1-8b | 4-5G | 最低10核+ | 16G+ | 10G存储 | 推荐8G+显存,rtx4070等 | 中小型企业用,对精度要求更高一点,轻量级任务处理 |

| DeepSeek-R1-14b | 15G+ | 最低12核+ | 32G+ | 20G存储 | 推荐16G+显存,rtx4090,a5000等 | 企业级复杂任务,长文本理解与生成,文章的写作等 |

| DeepSeek-R1-32b | 30G+ | 最低16核+ | 64G+ | 30G+存储 | 推荐24G+显存,A100,双卡4090等 | 高精度的专业化领域问题处理,多模态任务预处理等 |

| DeepSeek-R1-70b | 70G+ | 32核+,服务器级别 | 128G+ | 70G+存储 | 推荐80G+显存,A100多卡等 | 科研机构,大型企业,数据分析,高复杂任务生成,算法分析 |

| DeepSeek-R1-671b | 300G+ | 64核+,服务器级别 | 512G+ | 400+存储 | 1T+显存,A100/H100多卡 | |

| 国家级,超大规模企业,科研院所,人工智能研究,数据建模等 |

以1.5b为例:命令行运行ollama run deepseek-r1:1.5b,等待下载即可。

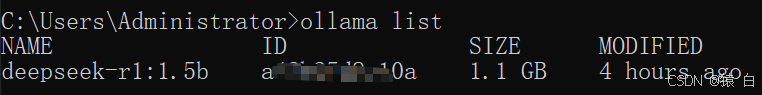

结束后查看库,ollama list

6.dify接入ollama

http://localhost/signin,打开dify,登录注册,点击头像,打开设置,找到模型供应商

。

模型名称选择你安装的大语言模型,例如deepseek-r1:1.5b,

基础URL默认是:http://host.docker.internal:11434/

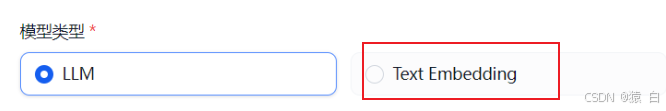

添加第二个,文本处理模型:

完成效果图:

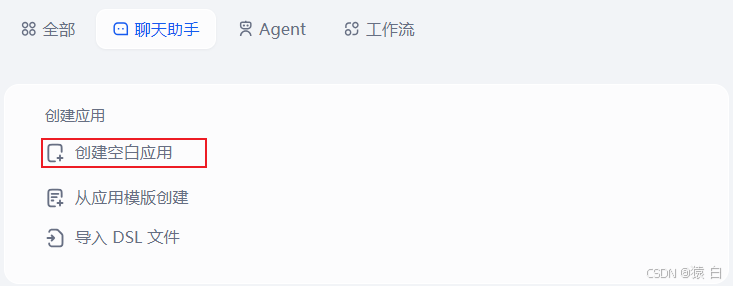

8.创建应用

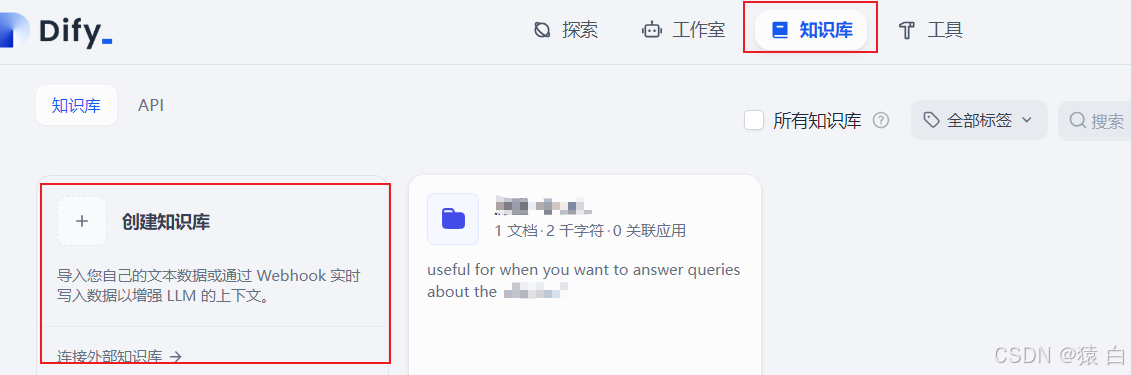

(1) 创建知识库

把自己整理的的文件当知识库上传。等待数据清洗完成即可。

(2)创建聊天助手

上下文选择已经上传的知识库。

(3)创建工作流

未完待续

文档参考:

Dify+DeepSeek-R1: 我的超强AI工作流,详细的部署与使用实录_dify deepseek

保姆教程篇:手把手教你从零开始本地部署Dify - 知乎

Docker 部署 Dify:轻松集成 Ollama 和 DeepSeek_dify docker 配置ollama-CSDN博客

通过Ollama本地部署DeepSeek R1以及简单使用的教程

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)