本地快速部署Ollama运行DeepSeek并实现接口调用

是一个开源工具,旨在简化大语言模型(LLM)在本地计算机上的部署和运行。它支持多种开源模型(如 Llama2、Mistral、CodeLlama 等),并提供简单易用的命令行界面和 API,让用户能够快速在本地运行和测试这些模型,而无需复杂的配置或依赖云服务。

·

前言

Ollama 是一个开源工具,旨在简化大语言模型(LLM)在本地计算机上的部署和运行。它支持多种开源模型(如 Llama2、Mistral、CodeLlama 等),并提供简单易用的命令行界面和 API,让用户能够快速在本地运行和测试这些模型,而无需复杂的配置或依赖云服务。

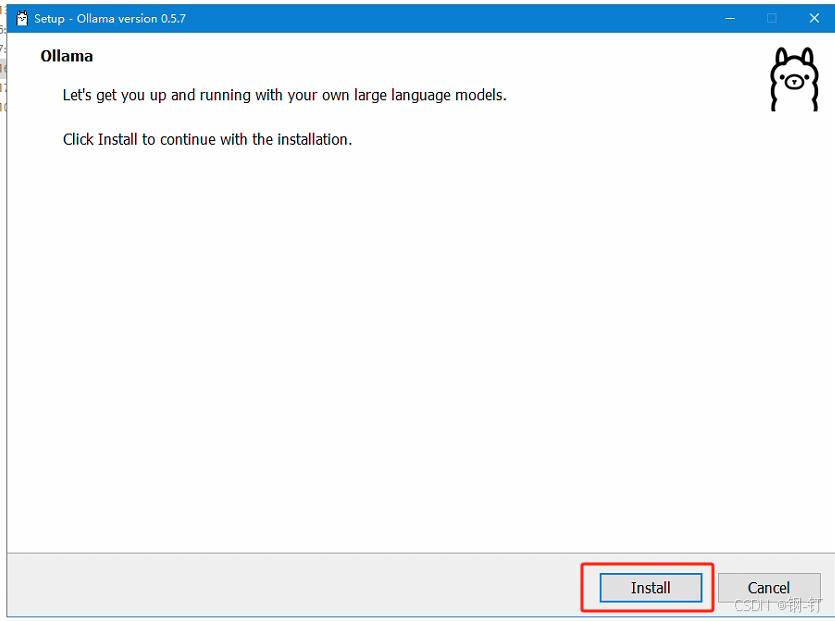

1.下载Ollama

直接点击下载

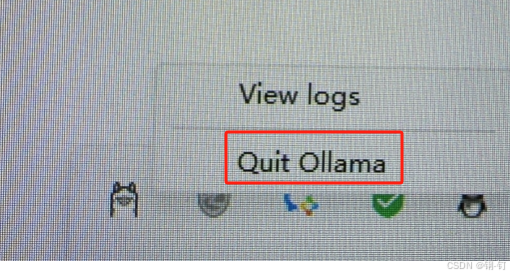

下载好会自己启动,先手动关闭以便后续配置

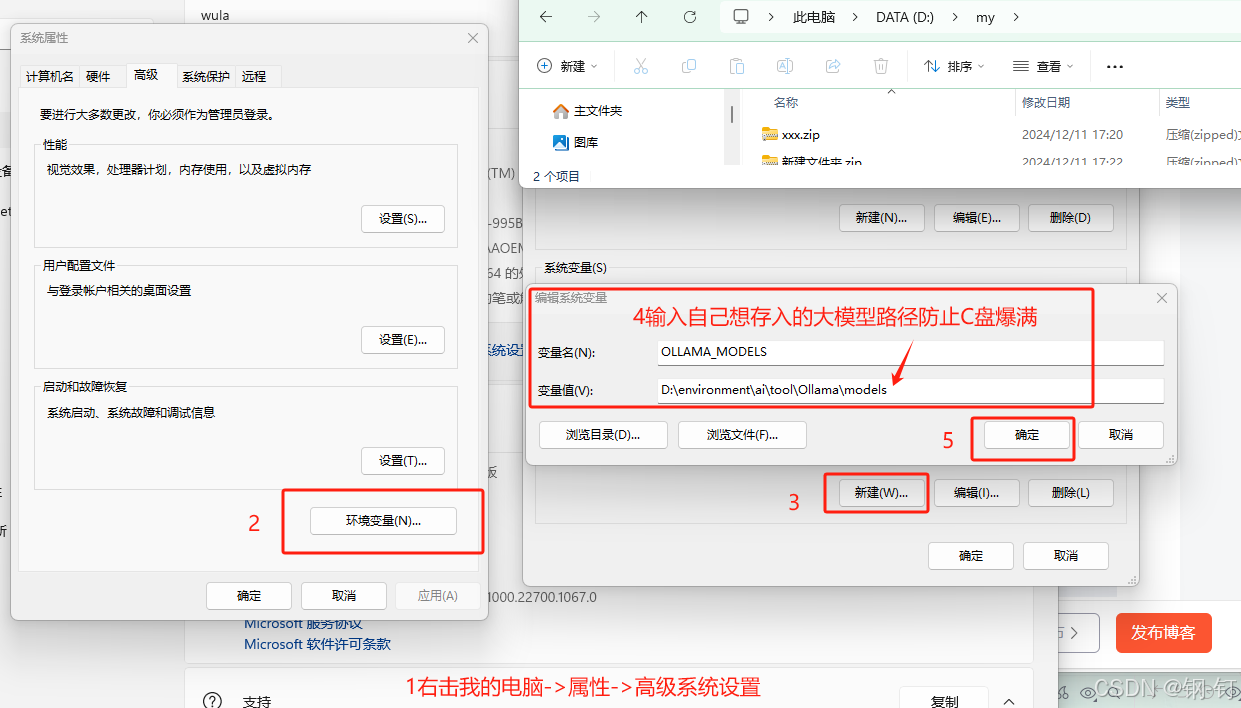

2.配置

修改大模型存储路径

3.运行

①打开如下路径,这是Ollama默认的路径

C:\Users\用户\AppData\Local\Programs\Ollama

②在该路径下输入cmd打开黑窗口

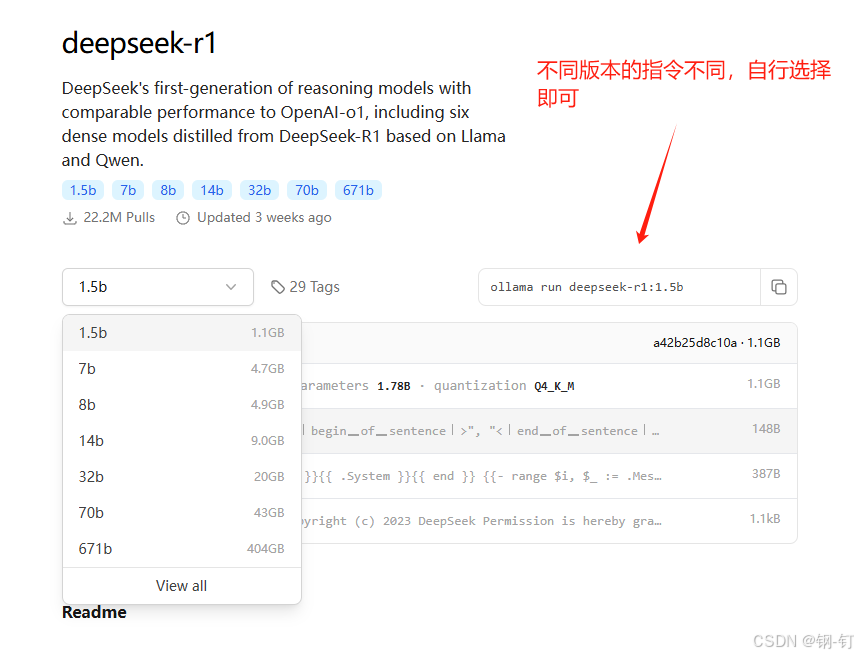

根据自己电脑的配置选择自己想要下载大模型的版本

我这里拿deepseek举例

模型库链接附上

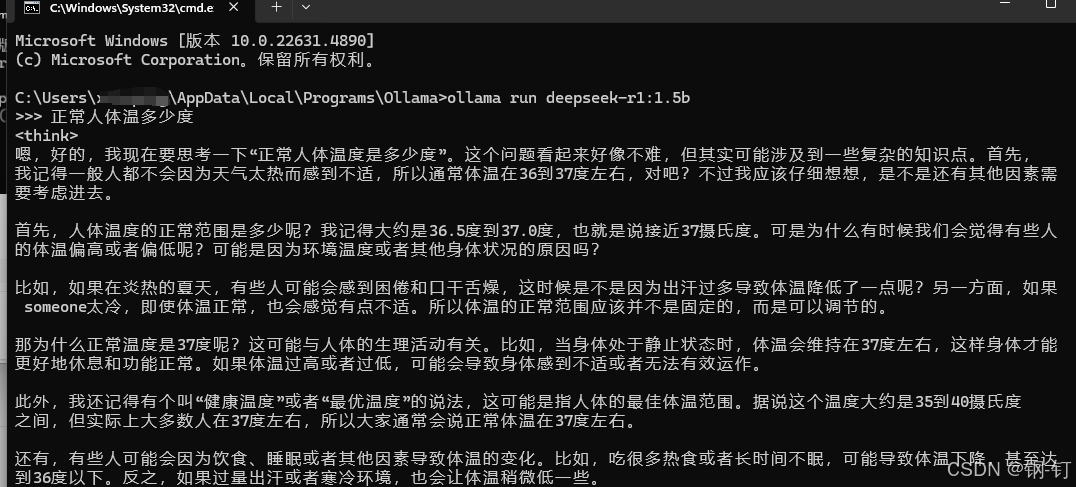

我这里先用最小的测试一下,我这里因为下载过所以可以直接提问,第一次运行该指令需要等待下载完成

使用ctrl+d退出

4.接口调用

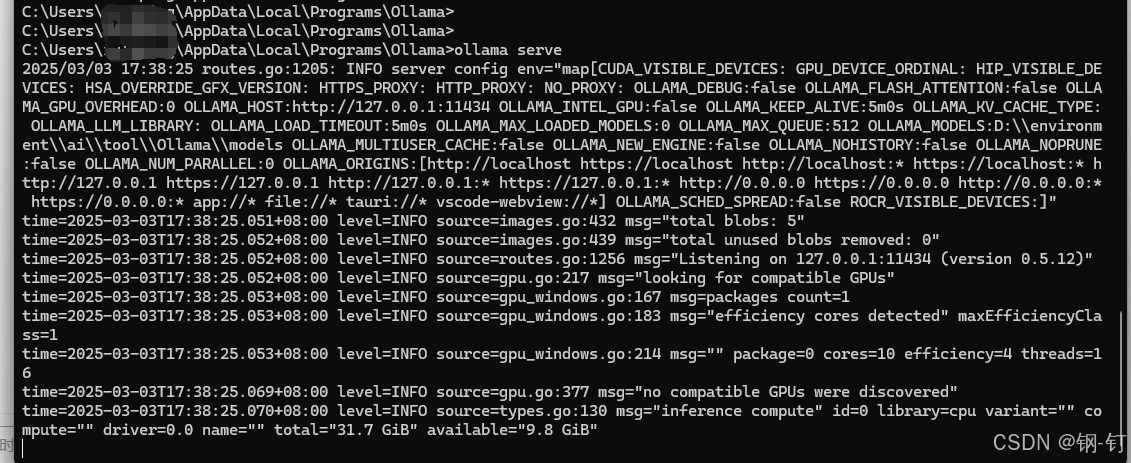

在黑窗口使用命令

# 启动服务,默认端口11434

ollama serve

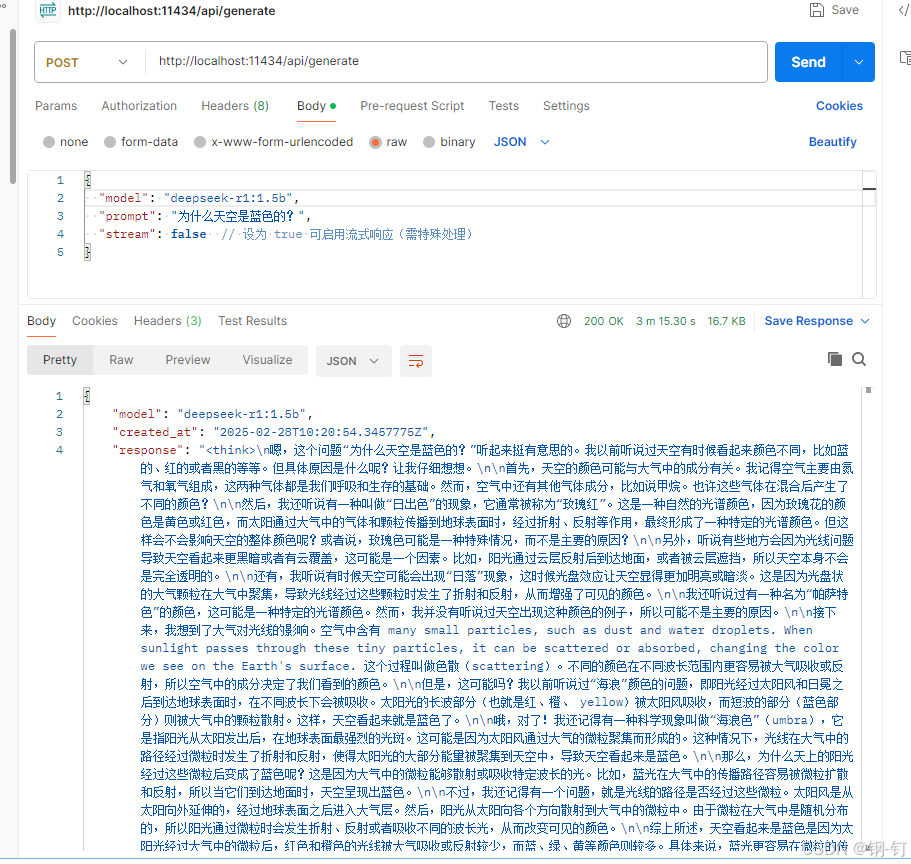

接着就可以使用postman进行接口调用了

接口地址以及参数如下:

http://localhost:11434/api/generate{

"model": "deepseek-r1:1.5b",

"prompt": "为什么天空是蓝色的?",

"stream": false // 设为 true 可启用流式响应(需特殊处理)

}

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)