太流批了,DeepSeek满血复活,非常实用

选择“OPENAI API”,依次填写API密钥、API域名、选择模型等,注意这里的是“32B”,填写的是“ollama run deepseek-r1:32b”,如果选择“7B”的模型,要填写“ollama run deepseek-r1:7b”如果不想安装ChatBox客户端,也可以选择浏览器插件,插件的安装是在扩展中心,打开【开发人员模式】,然后将插件压缩包直接拖入到扩展中心。此时,如果不要

最近有不少小伙伴询问DeepSeek的安装教程,因为网页版经常会遇到“服务器繁忙,请稍后再试”

今天给大家介绍一下DeepSeek的安装教程,希望对小伙伴有所帮助。

软件介绍

教程有点长,但其实并不复杂,希望大家耐心看完。

第一步:安装Ollama

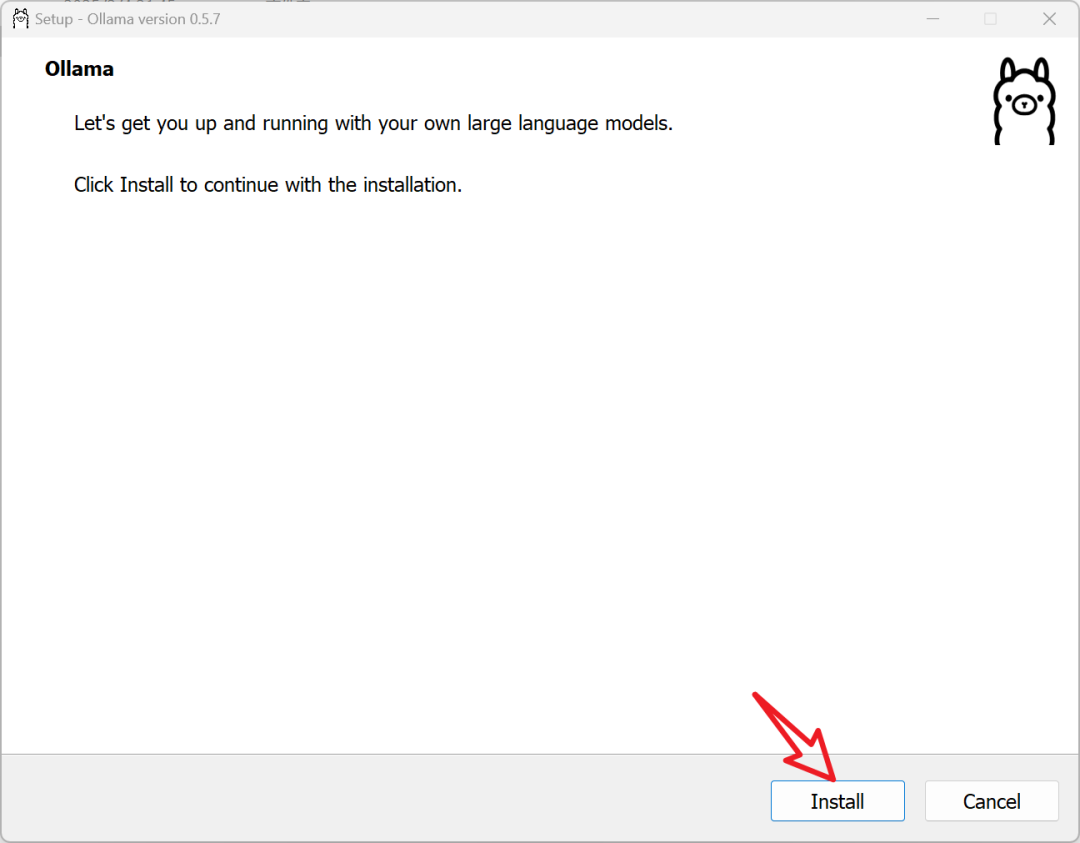

Ollama是一个支持大模型本地调用的工具,DeepSeek 的运行就是基于它。首先需要安装 Ollama,双击“windows-OllamaSetup.exe”

给大家提供的Ollama是Windows端,Mac端和Linux端可以自己去官网https://ollama.com/download下载。

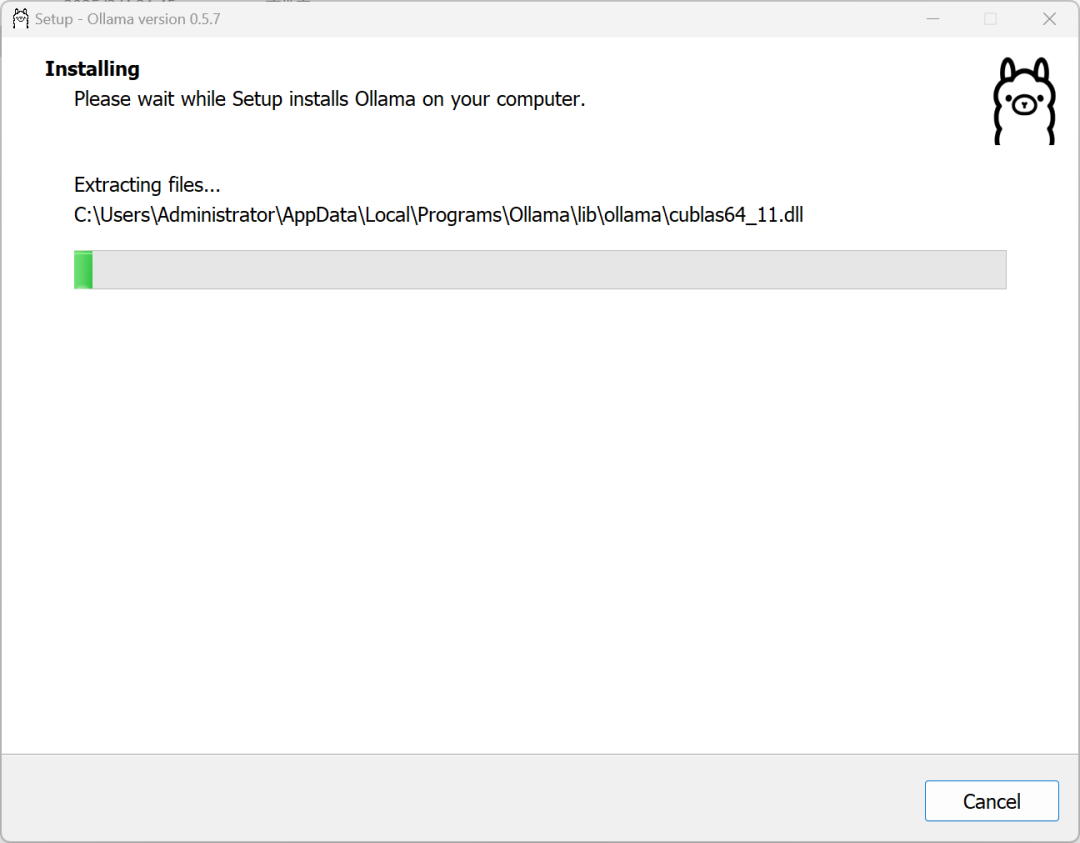

以Windows为例,其安装过程是全英文界面,点击【Install】后按照提示完成安装即可。

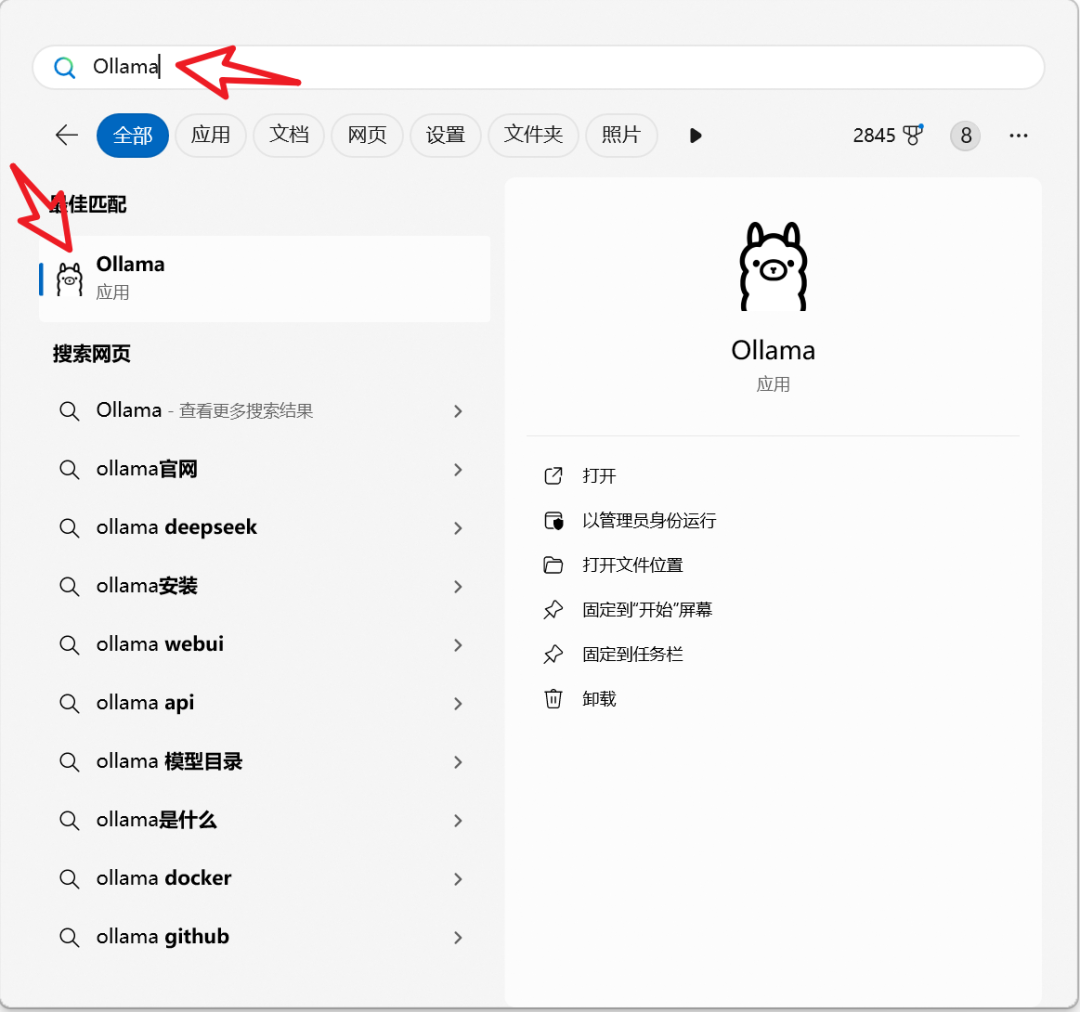

安装完成后,在开始菜单中输入“Ollama”点击软件即可启动。

第二步:安装DeepSeek模型

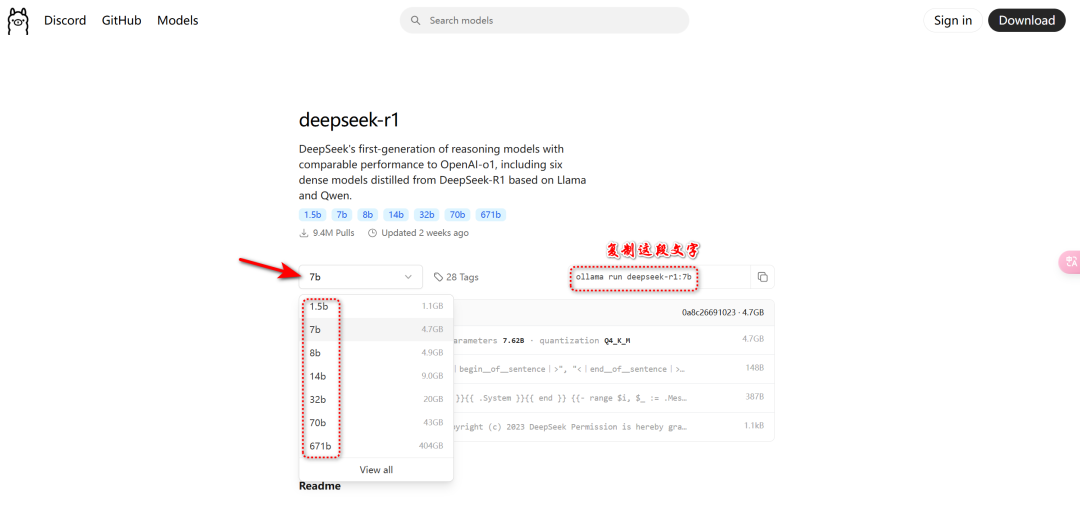

安装好Ollama后,就可以开始安装DeepSeek模型了。打开 [DeepSeek 模型页面]https://ollama.com/library/deepseek-r1,可以看到模型。

根据自己的电脑性能选择合适的模型:

・1.5B:入门级别,硬件配置“4GB内存+核显”即可运行;

・7B:进阶级别,“8GB内存+4GB显存”可运行;

・32B:高性能设备推荐,“32GB内存+12GB显存”

这里推荐大家使用7B,绝大部分电脑都能运行。如果选择7B,则复制命令“ollama run deepseek-r1:7b”

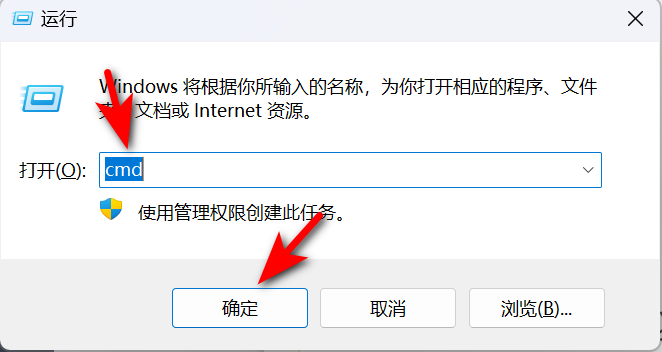

按下“Win键+R”,输入“cmd”打开命令行窗口。

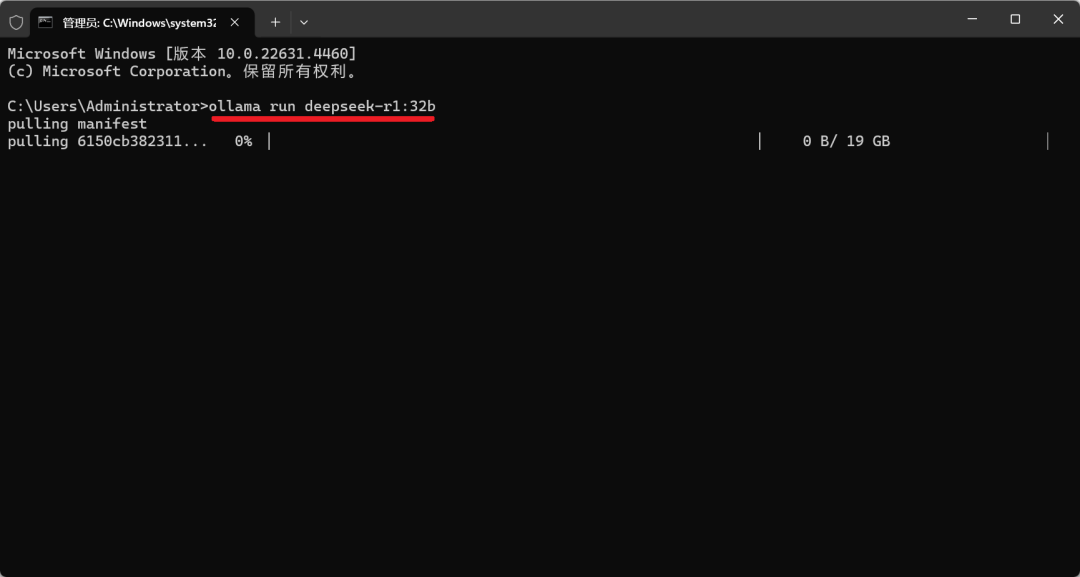

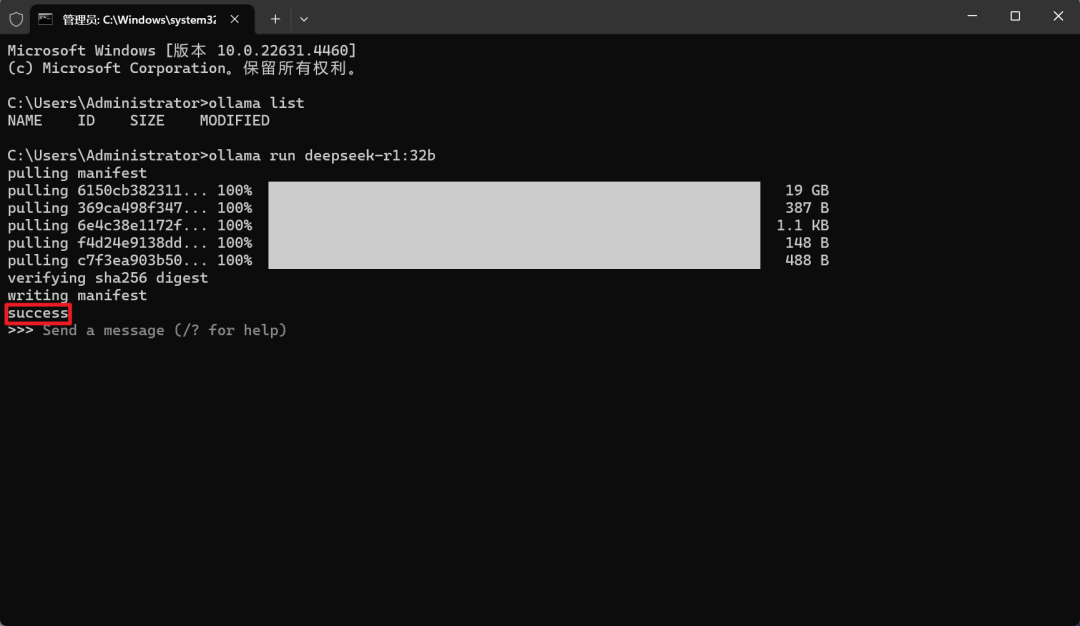

然后输入上面的那串文字“ollama run deepseek-r1:7b”,这里以 32B 为例,但其实 7B 更适合普通电脑。

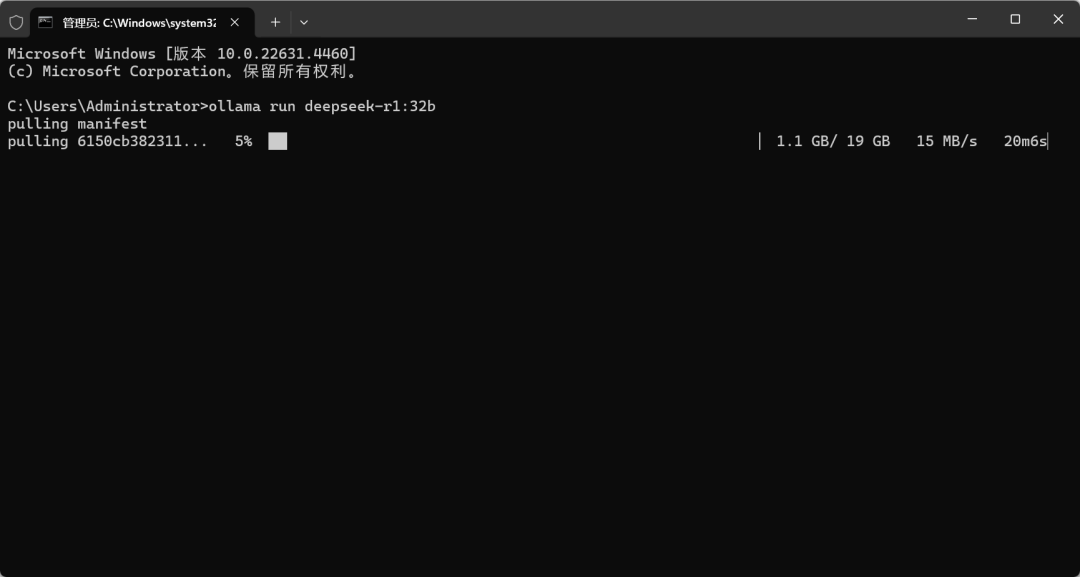

输入命令后,软件就开始下载大模型,这里选择的32B需要下载19G的模型(再强调,大家不要选择32B,一般性能的电脑用7B即可),下载的速度有点慢,耐心等待即可。

当看到“success”提示时,就表示安装成功了。

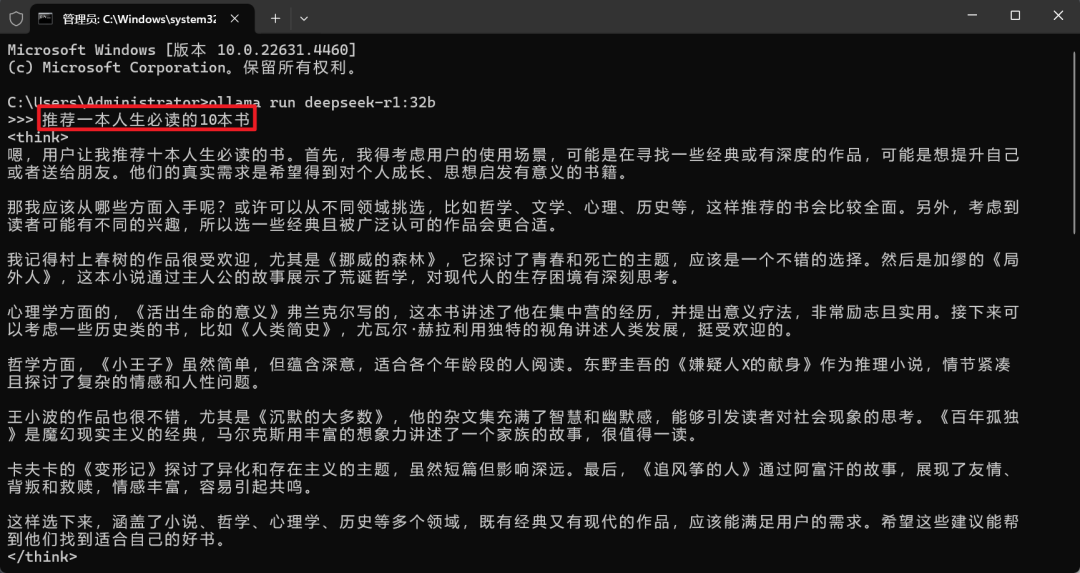

此时,如果不要UI运行,可以直接在命令行输入问题,DeepSeek就开始深度搜索,然后给出你想要的答案。

虽然操作略显繁琐,但完全不影响使用体验。如果不需要界面,到这里就完成了,下面的步骤可以跳过。

如果想要界面,就得往下安装了。

第三步:安装ChatBox

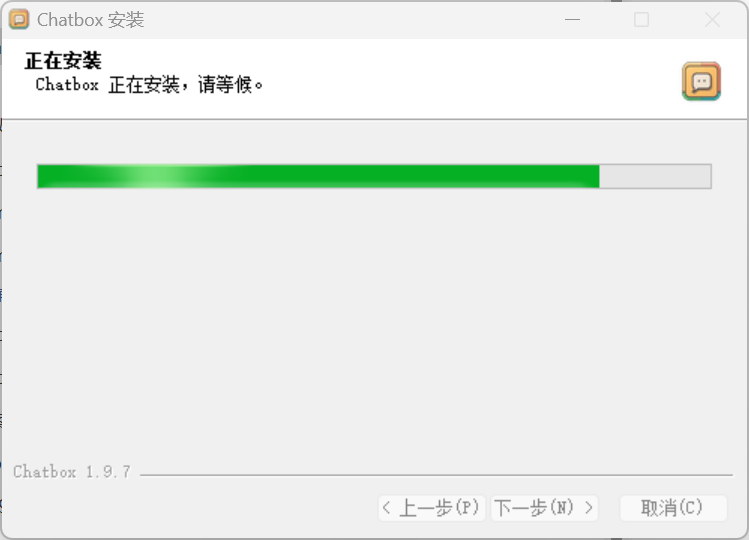

如果需要更友好的界面,可以安装 ChatBox。软件中有Windows 64位的客户端,直接默认安装即可。

如果想要Mac端、Linux端,可以去官网:https://www.chatboxai.app/zh#download下载。

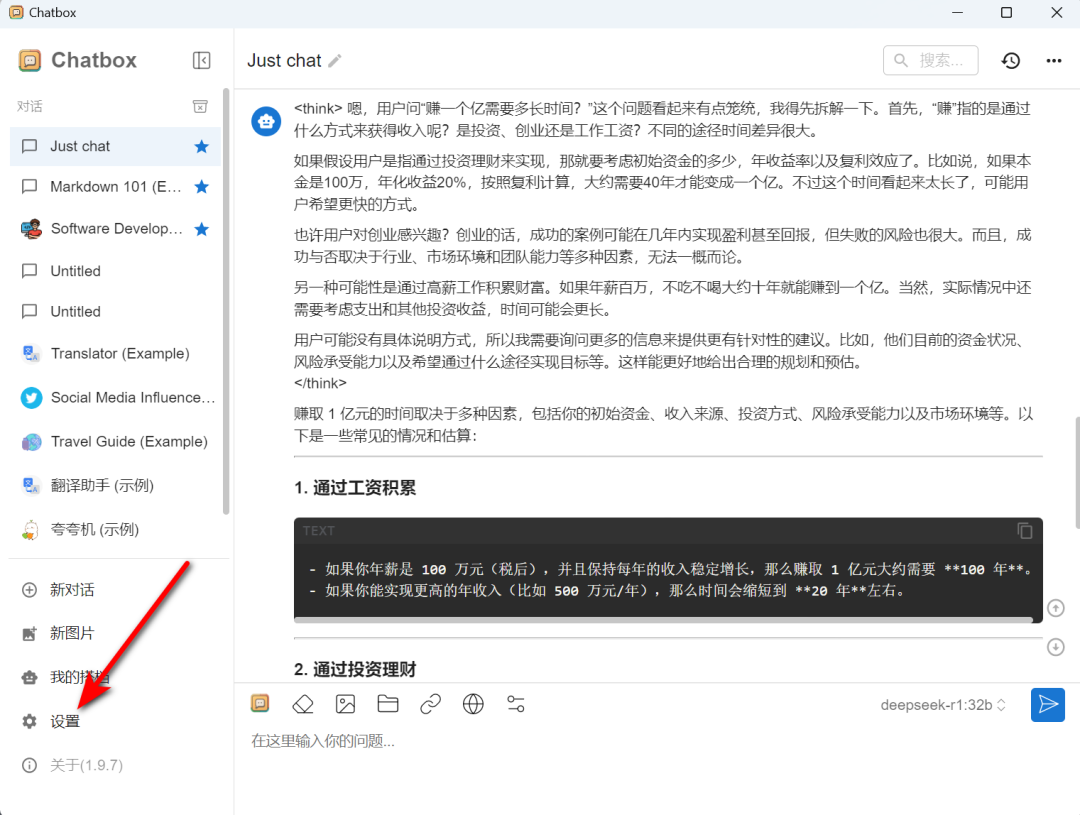

安装完成后,点击左侧的【设置】

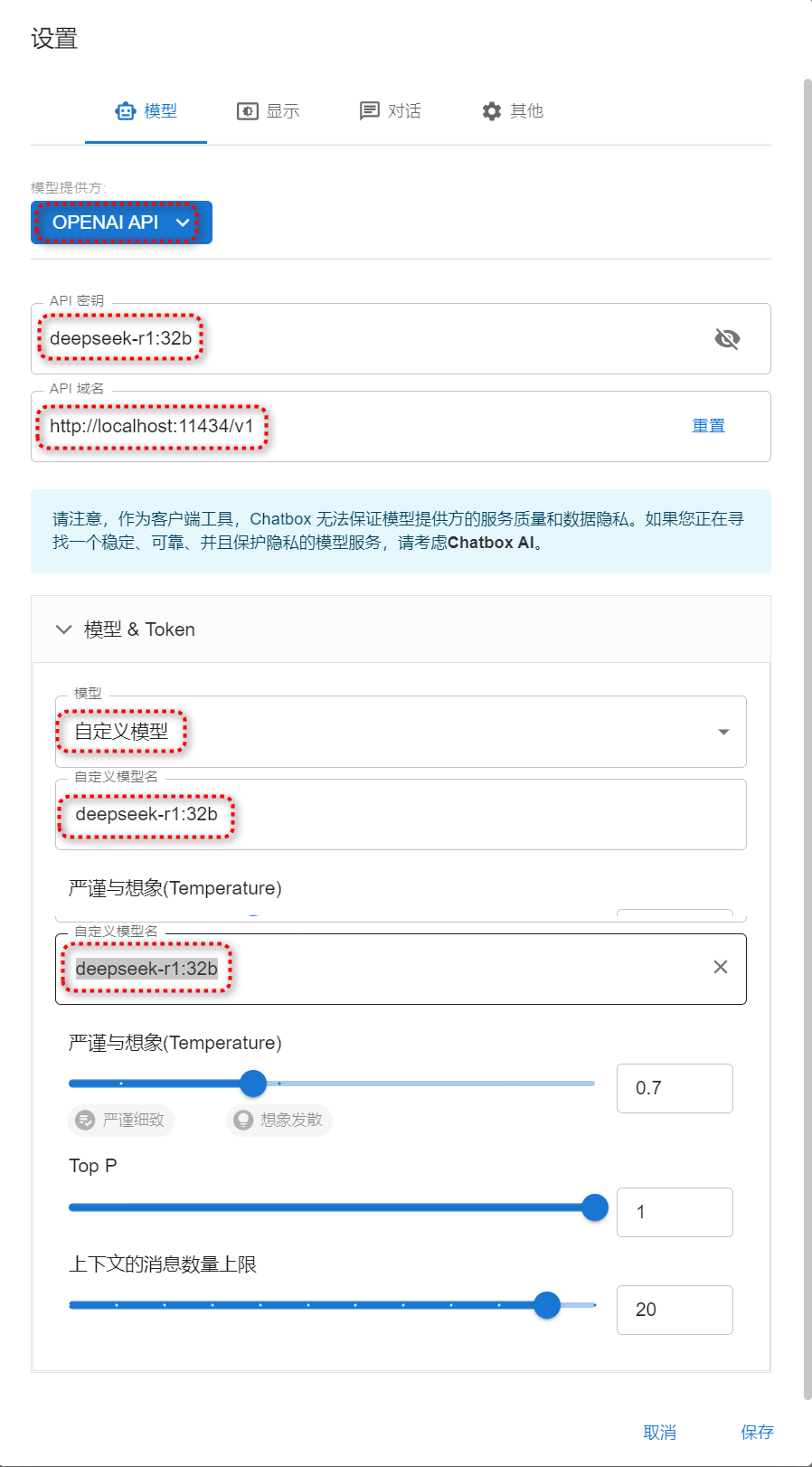

选择“OPENAI API”,依次填写API密钥、API域名、选择模型等,注意这里的是“32B”,填写的是“ollama run deepseek-r1:32b”,如果选择“7B”的模型,要填写“ollama run deepseek-r1:7b”

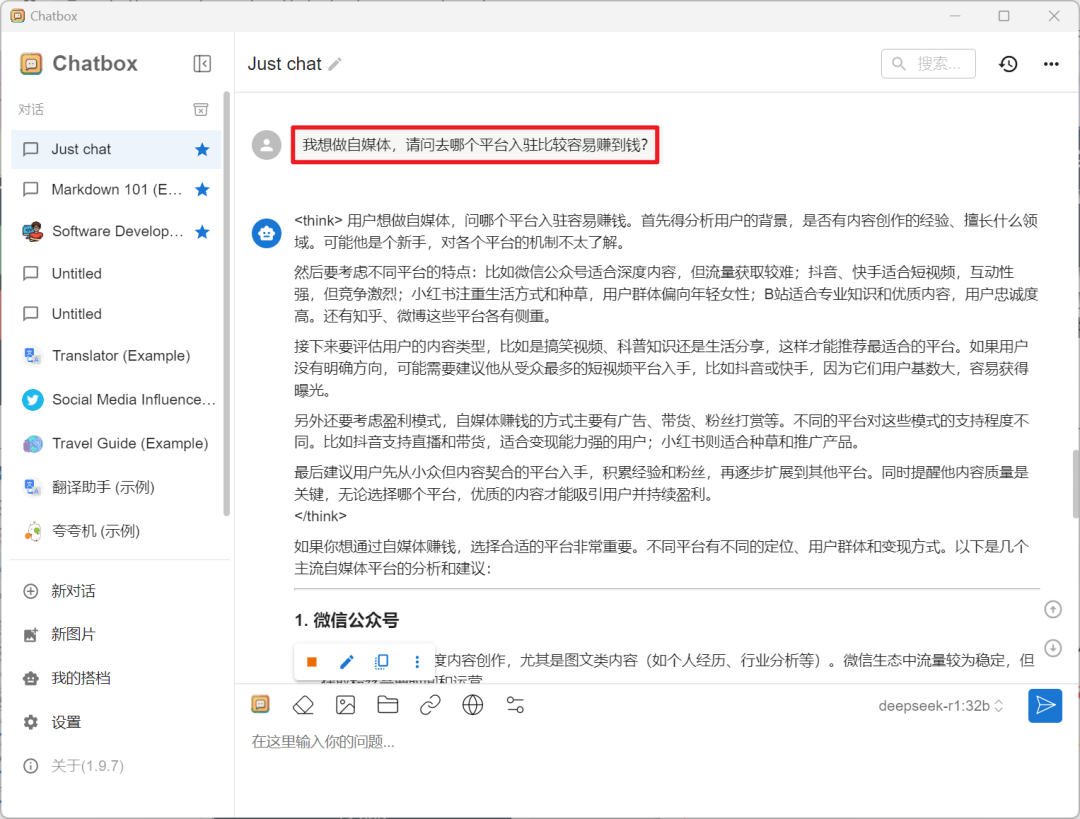

设置完成后点击【保存】,然后就可以调用DeepSeek进行对话了,输入问题后,软件就会给出想要的答案。

这种方式虽然对电脑配置有一定要求,但不会出现服务器繁忙的情况。

如果不要插件,那到第三步也就可以了,第四步不用安装了。

第四步:安装浏览器插件

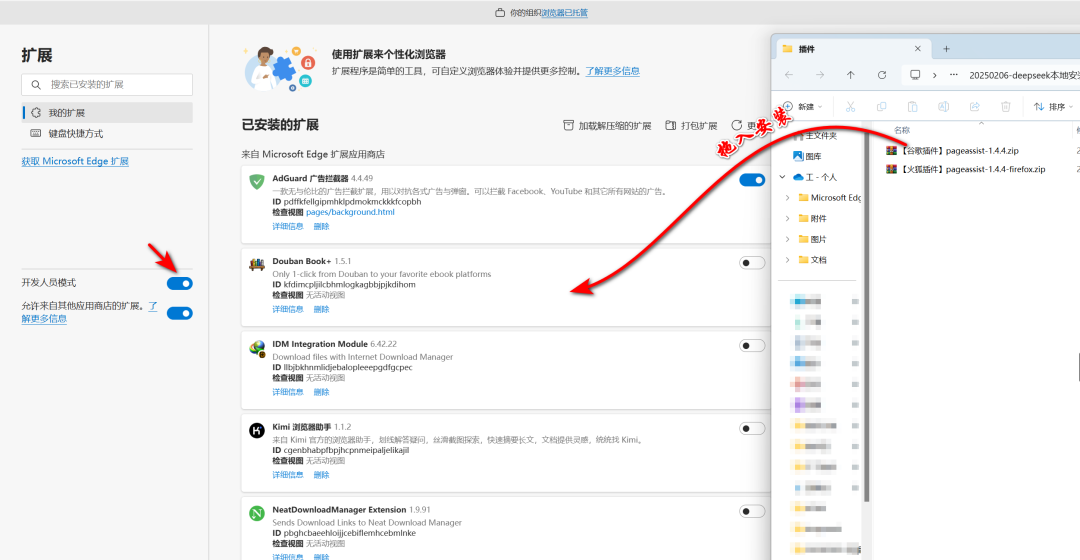

如果不想安装ChatBox客户端,也可以选择浏览器插件,插件的安装是在扩展中心,打开【开发人员模式】,然后将插件压缩包直接拖入到扩展中心。

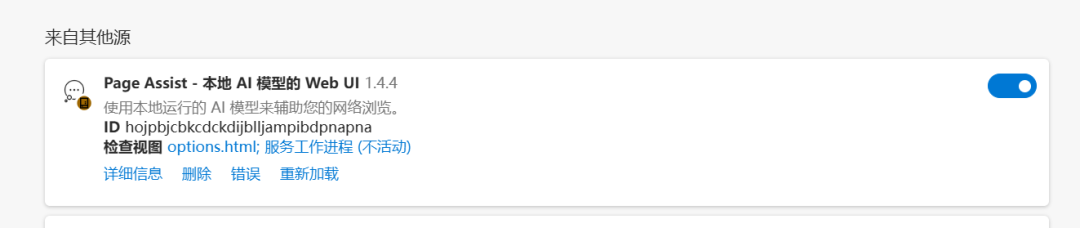

当插件中出现下面这个“Page Assist-本地AI模型的Web UI”时,表示插件安装成功。

之后在浏览器中点击插件图标,然后选择模型并输入问题,DeepSeek就会给出答案。

通过插件的方式也很方便,且不用安装第三步的ChatBox,还有界面可使用。

DeepSeek 的安装就介绍到这里,有需要的小伙伴可以下载收藏,非常值得一试哦。

链接:https://pan.quark.cn/s/5c76ae575584

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)