【AI实践】Windows上私有化部署可联网、可上传文件的DeepSeek-R1步骤全记录

Windows安装包下载链接:https://github.com/ollama/ollama/releases/download/v0.5.11/OllamaSetup.exe。打开Ollama模型库(https://ollama.com/library/),查看其它支持的模型。(2)博查开放平台(https://open.bochaai.com/)【国内,需充值,费用低】(1)Exa平台(ht

0、目录

-

1、环境配置

-

2、部署Ollama

-

3、安装Open WebUI

-

4、查看GPU使用情况

-

5、文档上传解析功能

-

6、联网搜索功能

1、环境配置

-

操作系统:Windows Server 2022

-

显卡配置:Nvidia RTX A5000(24G显存)

2、部署Ollama

(1)下载并安装

-

Windows安装包下载链接:https://github.com/ollama/ollama/releases/download/v0.5.11/OllamaSetup.exe

-

双击OllamaSetup.exe安装。

(2)运行DeepSeek-R1(初次运行会自动下载默认的DeepSeek-R1-Distill-Qwen-7B模型):

ollama run deepseek-r1

-

打开Ollama模型库(https://ollama.com/library/),查看其它支持的模型

-

其它指令:

ollama run deepseek-r1:32b #GPU显存至少24G

ollama run deepseek-r1:671b #满血版

ollama list #查看已下载模型

ollama ps #查看正在使用的模型

ollama stop deepseek-r1 #停止正在运行的模型

3、安装Open WebUI

参考:https://docs.openwebui.com/#manual-installation

conda create -n <环境名称> python=3.11

conda activate <环境名称>

pip install open-webui

pip install --upgrade open-webui # 更新到最新

open-webui serve

-

浏览器打开http://<内网IP>:8080/即可。

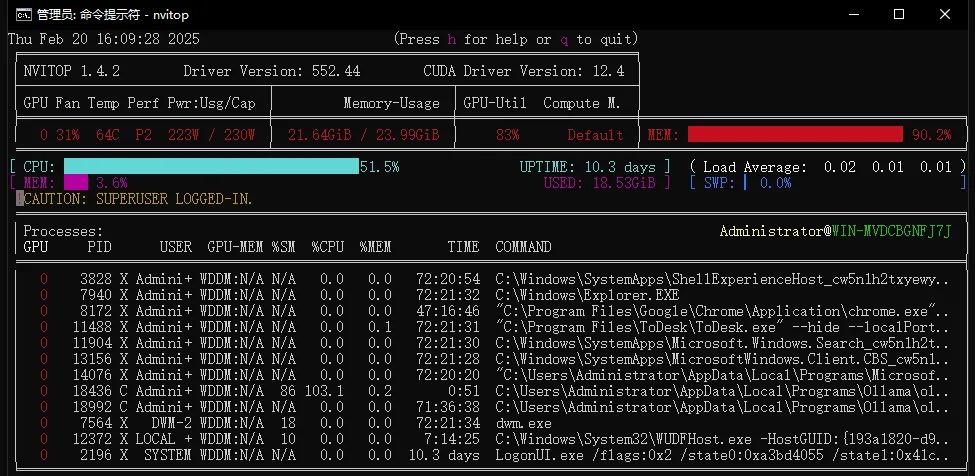

4、查看GPU使用情况

nvidia-smi

-

或者使用nvitop:

python -m nvitop #安装

nvitop -U # 使用 ASCII 字符替代 Unicode(解决乱码)

nvitop

nvitop -o 0 #显式指定GPU设备

-

32b的模型使用时,占用约20G显存。

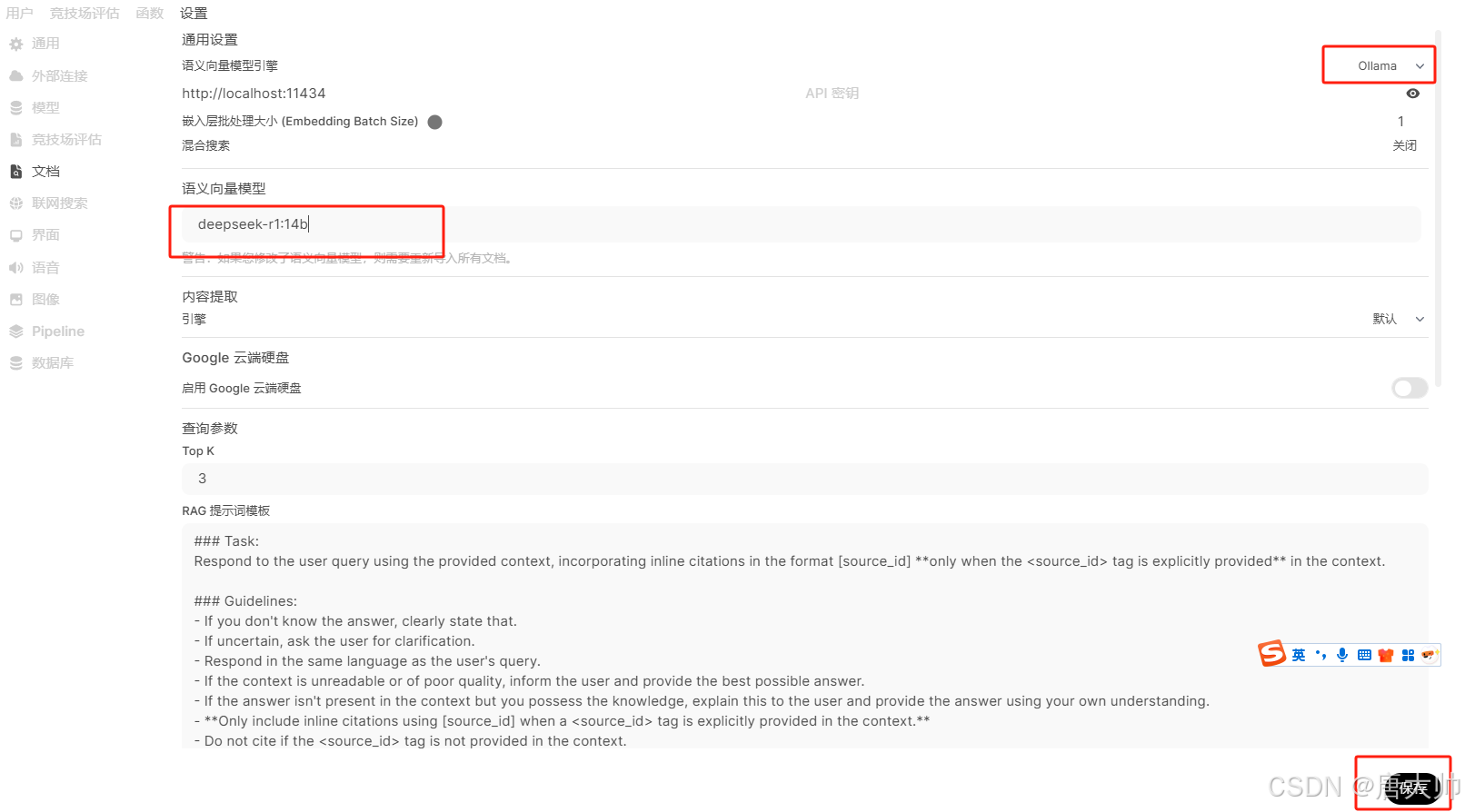

5、文档上传解析功能

-

选择本地语义模型(deepseek-r1:14b)完成语义向量解析:

-

-

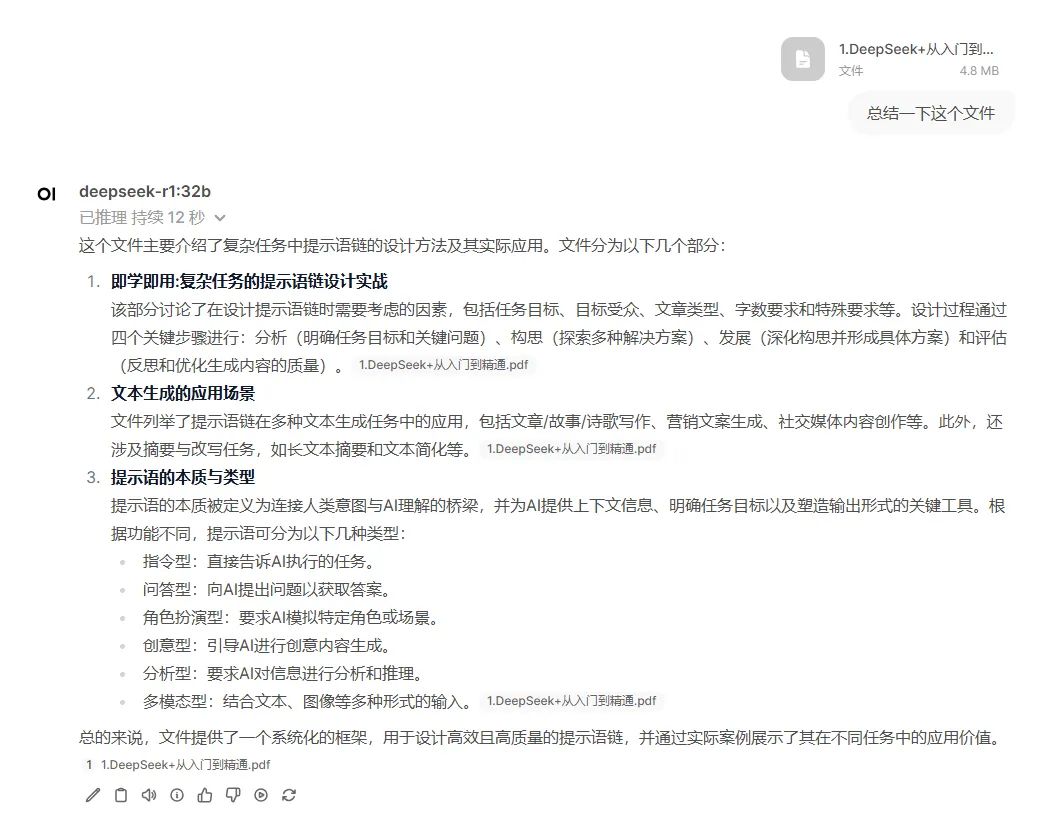

效果如下:

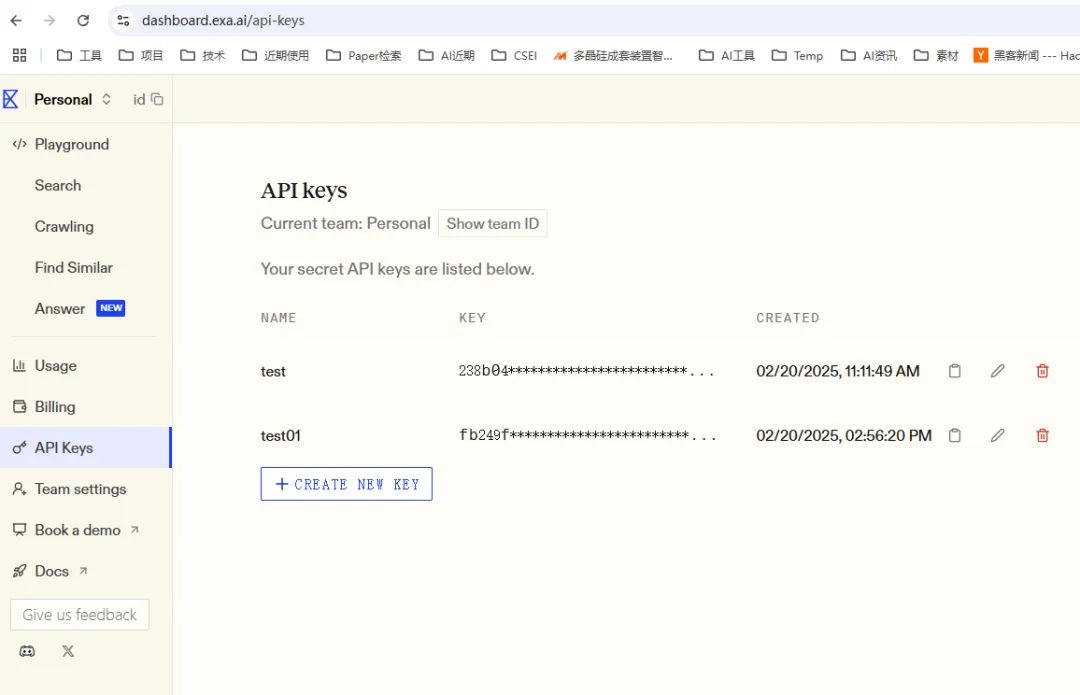

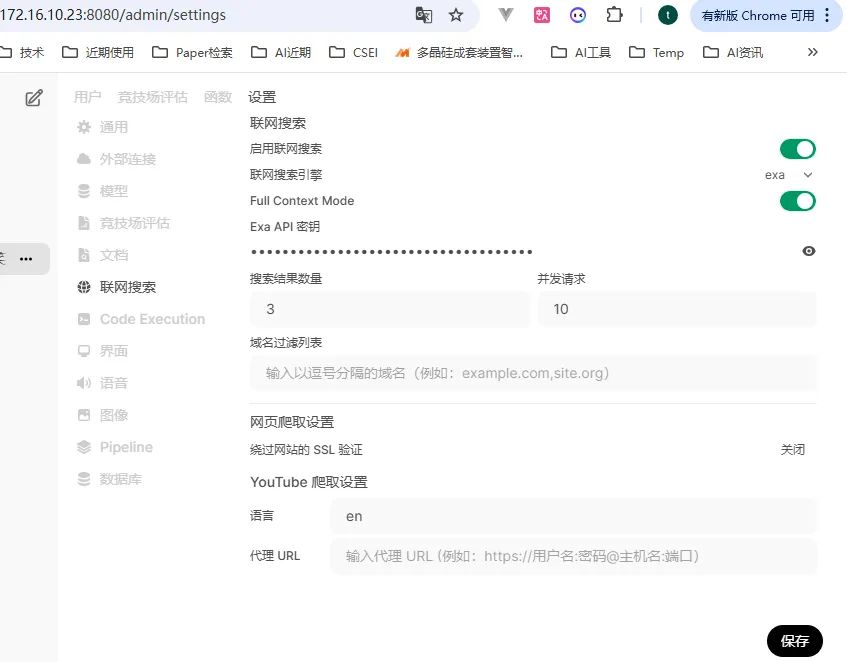

6、联网搜索功能

首先选择搜索引擎:

(1)Exa平台(https://exa.ai/)【国外可用平台,需充值,已测通】

-

申请账号,新用户赠送$10(1次检索花费$0.01),获取API Keys:

-

将上述Key填入Open WebUI:

-

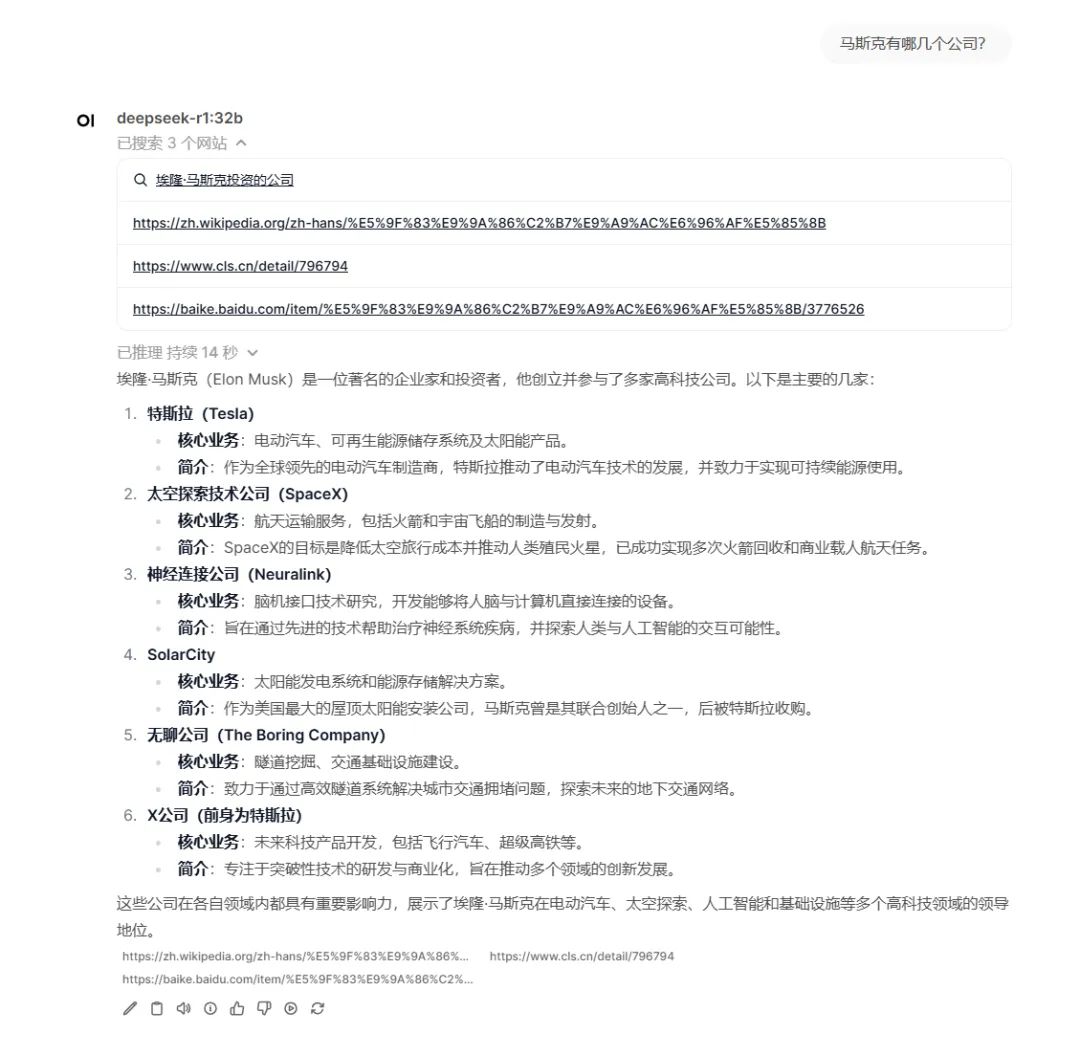

效果如下:

(2)博查开放平台(https://open.bochaai.com/)【国内,需充值,费用低】

参考:https://aq6ky2b8nql.feishu.cn/wiki/YGp9wMuEKiYYIjkeo0ncIETRnBg 【后续测试】

(3)开源searxng【免费、需自行部署】

仓库:https://github.com/searxng/searxng

参考:https://ask.csdn.net/questions/8179317 【后续尝试部署】

以上Enjoy~

欢迎关注微信公众号“AI趣栈”,持续为您提供关于AI的好内容~

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)