【真实评测】【非英伟达GPU】DeepSeek R1多版本性能与负载测试(基于WX3200+R9 3900+32GB内存实测)

【真实评测】【非英伟达GPU】DeepSeek R1多版本性能与负载测试(基于WX3200+R9 3900+32GB内存实测)

·

文章目录

前文

相关评测:【真实评测】DeepSeek R1多版本性能与负载测试(基于RTX3060+R7 5800+32GB内存实测)

本机运行DeepSeek R1大模型文章如下:

一、测试信息

本文章主要做个实验:基于WX3200+R9 3900+32GB内存实测DeepSeek R1多版本的性能与负载。

- 测试环境:

- 显卡:AMD Radeon Pro WX 32000(4GB显存)

- CPU:AMD Ryzen 9 3900X 12-Core Processor

- 内存:32G

- 系统:Windows 10

- 实验步骤:

- 测试问题:发送

“本人是10年工作经验的全栈工程师,如何转型做AI人工智能工程师” - 计时:思考的过程和生成答案的总耗时

- 记录:思考的过程和生成的答案

- 记录:显卡、CPU和内存的负担。

- 测试问题:发送

二、测试结果

文章开头,先给结果

2.1 性能对比

| 模型版本 | 响应时间 | GPU利用率 | CPU利用率 | 内存占用 | 输出速度 |

|---|---|---|---|---|---|

| 空白对比 | - | 0% | 3% | 5GB | - |

| 1.5b | 45秒 | 1% | 58% | 9.1GB | 正常(流畅) |

| 7b | 55秒 | 1% | 60% | 13.4GB | 正常(缓慢) |

2.2 实验结论

-

硬件资源分配

- GPU利用率极低(仅1%):表明模型推理主要依赖CPU,AMD Radeon Pro WX 3200显卡未有效参与计算(可能与Ollama框架对AMD显卡的兼容性有关,或未正确配置GPU加速)。

- CPU负担显著:两版本模型均占用50%-60%的CPU资源,说明模型推理为计算密集型任务,依赖多核CPU性能。

- 内存占用随模型增大而提升:7b模型内存占用(13.4GB)显著高于1.5b(9.1GB),符合模型参数规模与内存占用的正相关关系。

-

性能对比

- 响应时间差异明显:7b模型耗时约为1.5b的3.8倍,表明模型参数量的增加显著降低推理速度(需权衡模型精度与实时性)。

- 模型规模与资源消耗:大模型(7b)在时间、内存上成本更高,需更高硬件配置支持。

-

模型选择建议

- 轻量场景:1.5b模型更适用(响应快、内存占用低),适合低配置设备或实时性要求高的任务。

- 精度优先场景:7b模型可能提供更优结果,但需牺牲响应时间并确保内存充足(建议至少16GB内存)。

-

优化方向

- 验证GPU加速配置(如ROCm对AMD显卡的支持),释放显卡算力以降低CPU负载。

- 尝试量化模型(如4/8-bit)以压缩内存占用,提升推理速度。

-

升级推荐

- 更换NVIDIA显卡(如RTX 3090/4090)以启用CUDA加速;

- 升级至64GB内存以支持更大模型(如13b/20b)。

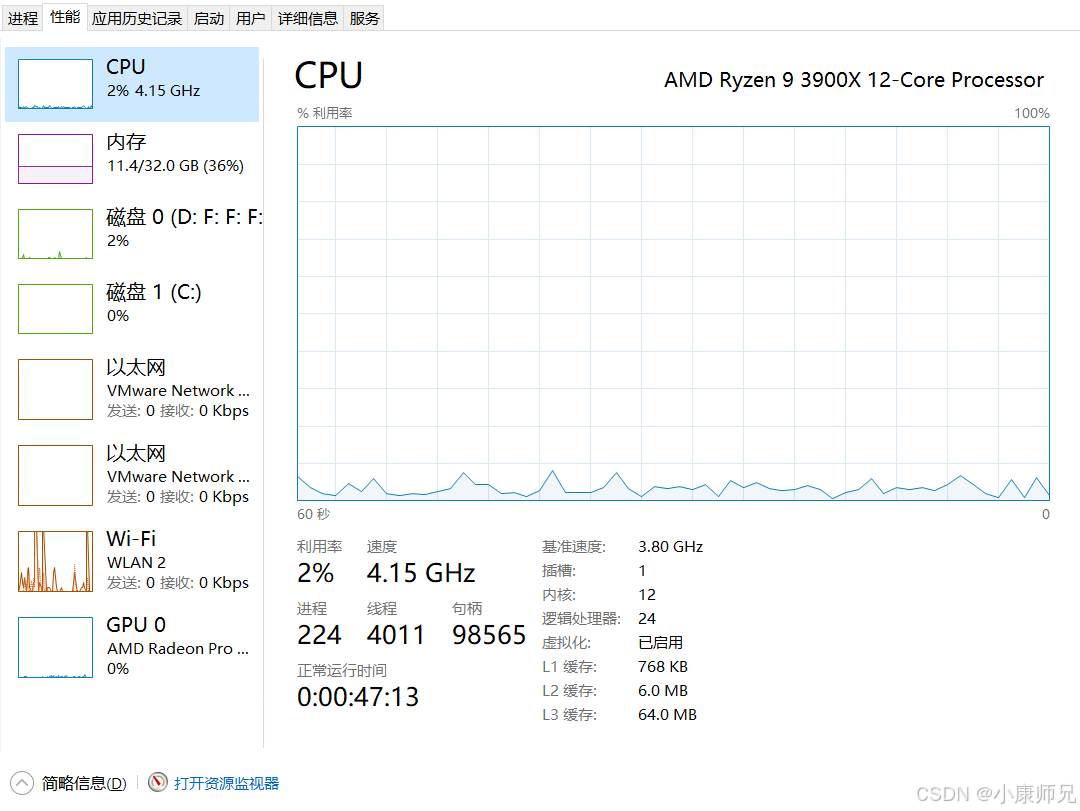

三、空白对比

3.1 实际测试

- 操作:重启,并关闭杀毒软件。

3.2 记录数据

- GPU平均利用率:0%

- CPU平均利用率:3%

- 内存平均使用数:5GB

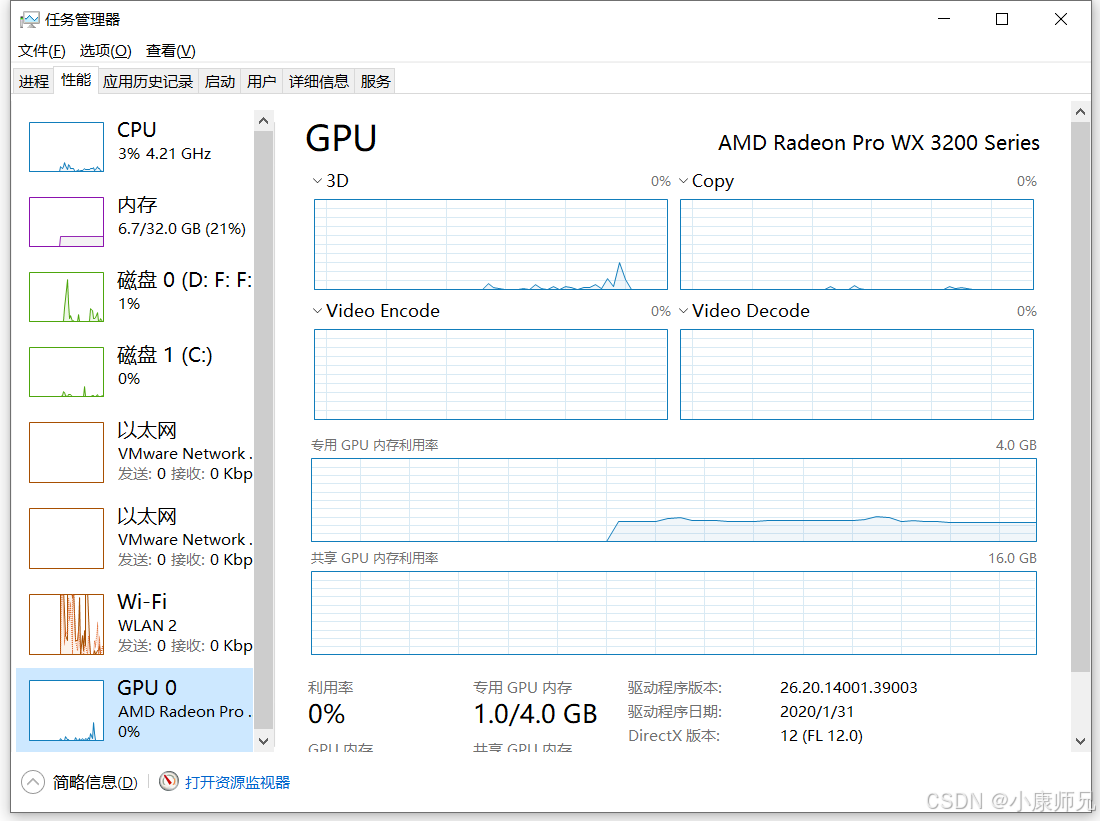

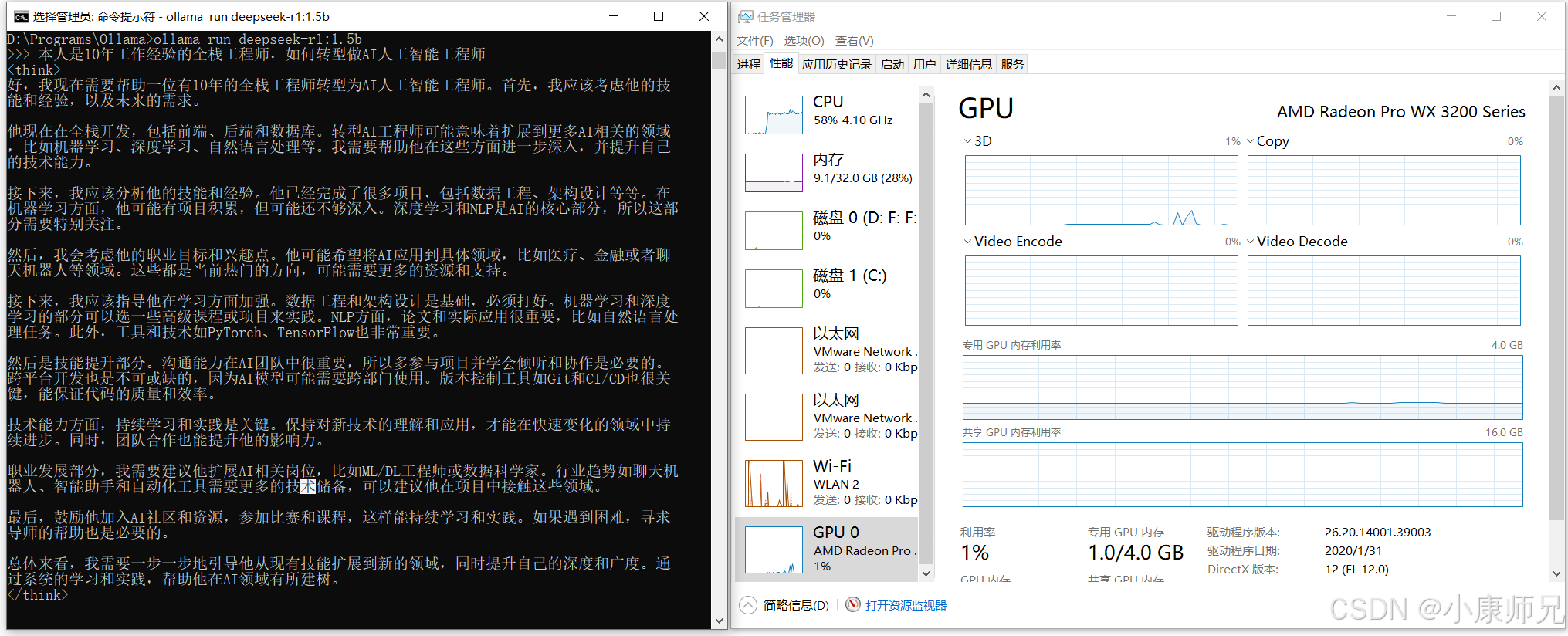

四、运行DeepSeek R1 1.5b版本

4.1 实际测试

ollama run deepseek-r1:1.5b

4.2 记录数据

- 计时:45秒

- GPU平均利用率:1%

- CPU平均利用率:58%

- 内存平均使用数:9.1GB

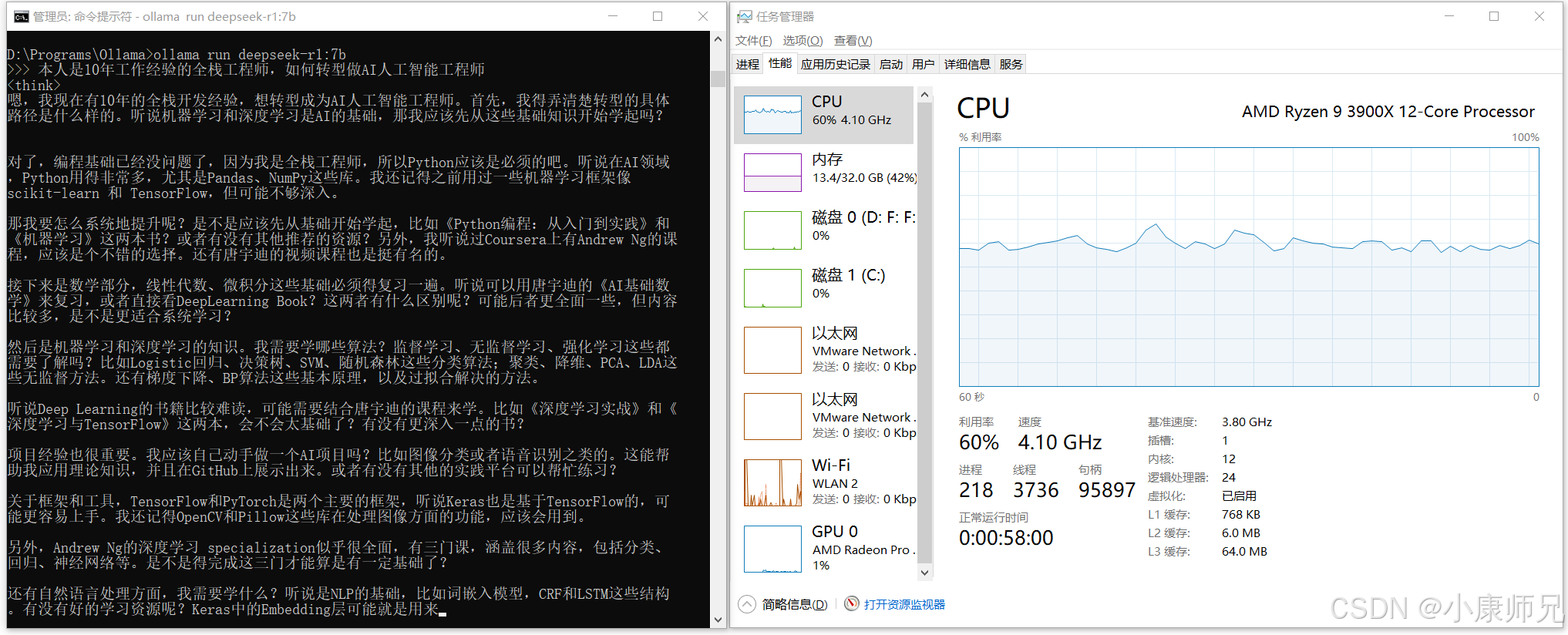

五、运行DeepSeek R1 7b版本

5.1 实际测试

ollama run deepseek-r1:7b

5.2 记录数据

- 计时:2分50秒

- GPU平均利用率:1%

- CPU平均利用率:60%

- 内存平均使用数:13.4GB

六、思考和回答

1.5b版本的思考和答案

>>> 本人是10年工作经验的全栈工程师,如何转型做AI人工智能工程师

<think>

嗯,我现在需要思考一下如何从一个有10年的全栈开发经验的工程师,变成现在非常看重的AI人工智能工程师。首先,我应该了解一下自己目前在哪些领域已经积累了很多经验了。比如,我之前写过很多Python代码,设计过UI界面,还做了系统架构设计等等。这些都是我过去的工作内容。

那AI工程师这个职位跟传统开发有很大的不同吗?我觉得不是很大,因为AI工程师也是开发者,主要负责编写代码和进行测试,只不过他们可能更关注模型的性能、效率以及用户体验。那么,我的转变需要哪些方面的改变呢?

首先,技术方面,我得熟悉最新的AI领域。比如,深度学习中的卷积神经网络(CNN)、循环神经网络(RNN)和Transformer模型这些都是我之前没有深入接触过的,但现在可能需要多花时间来学习这些算法。我还应该了解一些最新的工具和技术,比如PyTorch或者TensorFlow这样的框架。

然后是业务层面的转变。作为全栈工程师,我之前负责的产品开发、数据分析、团队管理和项目管理等都有一定的经验。现在AI工程师可能不需要那么大的产品规模,但需要具备更灵活的思维方式和更强大的数据处理能力。特别是数据科学方面,我得学会处理大量的数据,并能够通过分析生成有效的产品建议或优化方案。

技术能力方面,除了编程,我还应该学习更多的工具和技术。比如,使用Jupyter Notebook进行数据分析,使用Python进行数据清洗和可视化,或者在云平台部署AI模型,比如AWS的S3、EC2或者其他云服务平台。此外,了解一些开源框架也很重要,比如Docker可以用来构建AI开发环境,Kubernetes用于容器化部署。

沟通和技术能力也是关键。作为产品经理,我需要有更强的说服力和跨部门协作能力。技术方面,持续学习新技术很重要,并能与团队成员保持良好的合作关系。项目管理可能也需要调整策略,毕竟AI项目可能在初期不那么成功,但之后会逐渐适应并带来价值。

还有职业规划方面,我现在应该清楚自己的职业发展方向。比如,如果想要进入高薪职位,可以考虑更专注于人工智能的某个领域,或者扩展到更多新兴技术如NLP、图像识别等。同时,保持学习的热情也很重要,因为AI领域的知识更新非常快,需要不断学习和适应。

还有时间管理方面,我可能需要合理安排工作时间,设定目标,并将目标分解成小步骤来完成。这样不仅有助于提高效率,也能更好地实现个人职业发展。

最后,自我反思也是必要的。回顾过去的经历,识别哪些技能或能力不足,然后针对这些进行改进。同时,制定一个可行的转型计划,明确时间和资源投入,确保在转型过程中能够顺利过渡。

总之,转型AI工程师需要我深入学习技术、提升业务洞察力、加强沟通和团队合作能力,同时保持持续的学习和适应。虽然过程可能艰难,但通过合理的规划和坚持努力,我相信我可以成功地转型为一个优秀的AI人工智能工程师。

</think>

作为一名10年工作经验的全栈工程师,你具备非常强的技术能力和项目经验,这为你在AI领域的转型提供了很好的基础。你可以通过以下步骤逐步转型为AI人工智能工程师:

从一位拥有10年全栈开发经验的工程师转型成为AI人工智能工程师,需要系统性地进行调整和学习。以下是具体的步骤:

-

技术领域扩展:

- 学习最新AI领域的算法如CNN、RNN和Transformer,熟悉TensorFlow和PyTorch框架。

- 掌握数据科学工具,包括Python的NumPy、Pandas等,并关注数据可视化与分析。

-

业务能力提升:

- 专注于数据分析和业务洞察,提升对数据处理和产品建议的能力。

- 增强项目管理和协作沟通能力,以适应AI行业的变化。

-

技术工具学习:

- 学习Jupyter Notebook进行数据分析,熟悉云平台如AWS、Azure部署AI模型。

- 掌握Docker等构建AI开发环境的技术,并了解Kubernetes用于容器化和标准化。

-

沟通与协作能力增强:

- 作为产品经理,提升说服力和跨部门合作能力,确保团队信息透明。

- 培养良好的沟通技巧,适应可能的跨职能工作环境。

-

职业规划调整:

- 明确职业目标,优先发展高薪AI岗位,扩展技能如NLP、图像识别等。

- 保持学习的热情,关注新技术的发展趋势和行业变化。

-

时间管理和计划优化:

- 制定合理的每周工作计划,明确任务,提升工作效率。

- 将转型视为短期目标,合理分配时间和资源,避免焦虑。

-

自我反思与调整:

- 评估过去经验,识别技能不足之处,并制定针对性的学习计划。

- 确保转型计划有可行的时间和资源投入,逐步实现职业转变。

通过以上步骤的系统性学习和规划,可以有效过渡并成功转型为一个优秀的AI工程师。

7b版本的思考和答案

>>> 本人是10年工作经验的全栈工程师,如何转型做AI人工智能工程师

<think>

嗯,我现在有10年的全栈开发经验,想转型成为AI人工智能工程师。首先,我得弄清楚转型的具体路径是什么样的。听说机器学习和深度学习是AI的基础,那我应该先从这些基础知识开始学起吗?

对了,编程基础已经没问题了,因为我是全栈工程师,所以Python应该是必须的吧。听说在AI领域,Python用得非常多,尤其是Pandas、NumPy这些库。我还记得之前用过一些机器学习框架像scikit-learn 和 TensorFlow,但可能不够深入。

那我要怎么系统地提升呢?是不是应该先从基础开始学起,比如《Python编程:从入门到实践》和《机器学习》这两本书?或者有没有其他推荐的资源?另外,我听说过Coursera上有Andrew Ng的课程,应该是个不错的选择。还有唐宇迪的视频课程也是挺有名的。

接下来是数学部分,线性代数、微积分这些基础必须得复习一遍。听说可以用唐宇迪的《AI基础数学》来复习,或者直接看DeepLearning Book?这两者有什么区别呢?可能后者更全面一些,但内容比较多,是不是更适合系统学习?

然后是机器学习和深度学习的知识。我需要学哪些算法?监督学习、无监督学习、强化学习这些都需要了解吗?比如Logistic回归、决策树、SVM、随机森林这些分类算法;聚类、降维、PCA、LDA这些无监督方法。还有梯度下降、BP算法这些基本原理,以及过拟合解决的方法。

听说Deep Learning的书籍比较难读,可能需要结合唐宇迪的课程来学。比如《深度学习实战》和《深度学习与TensorFlow》这两本,会不会太基础了?有没有更深入一点的书?

项目经验也很重要。我应该自己动手做一个AI项目吗?比如图像分类或者语音识别之类的。这能帮助我应用理论知识,并且在GitHub上展示出来。或者有没有其他的实践平台可以帮忙练习?

关于框架和工具,TensorFlow和PyTorch是两个主要的框架,听说Keras也是基于TensorFlow的,可能更容易上手。我还记得OpenCV和Pillow这些库在处理图像方面的功能,应该会用到。

另外,Andrew Ng的深度学习 specialization似乎很全面,有三门课,涵盖很多内容,包括分类、回归、神经网络等。是不是得完成这三门才能算是有一定基础了?

还有自然语言处理方面,我需要学什么?听说是NLP的基础,比如词嵌入模型,CRF和LSTM这些结构。有没有好的学习资源呢?Keras中的Embedding层可能就是用来做词嵌入的。

关于AI工具和技术栈,听说ChatGPT是一个很好的项目,可以用它来学习自然语言处理相关的技术。还有PaddlePaddle也是一个框架,听说在中文NLP方面更强大,应该值得学习一下。

最后,软技能也很重要,比如沟通能力、团队合作和问题解决的能力。这些可能在实际工作中发挥关键作用,尤其是AI这种复杂的领域。

总结下来,我需要先补充数学基础,学机器学习和深度学习的课程,做项目来实践,同时掌握主流的框架和技术栈,并且提升自己的软技能。

</think>

为了顺利转型为AI人工智能工程师,您可以按照以下步骤进行系统化的学习和实践:

1. 基础知识与技能补充

- 编程基础:确认并加强Python编程能力,熟练使用Pandas、NumPy等库。学习Numpy+TENSORFLOW的高效计算方法。

2. 数学复习与深入学习

- 数学基础:系统复习线性代数和微积分,推荐《AI基础数学》或DeepLearning Book,确保掌握向量、矩阵运算等知识。

- 机器学习基础:通过Andrew Ng的课程学习机器学习算法,如监督学习(Logistic回归、SVM)、无监督学习(PCA、聚类)及深度学习的基础原理。

3. 深度学习与算法

- 深入学习框架:学习TensorFlow和PyTorch,推荐《深度学习实战》和《深度学习与TensorFlow》。

- 算法与模型:掌握神经网络结构化设计,了解CNN、RNN、LSTM等模型及其应用。

4. 实践项目积累

- 独立项目:创建AI项目(如图像分类或语音识别),在GitHub或Kaggle平台展示。

- 案例研究:分析和复现经典论文,提升对算法的理解和应用能力。

5. 工具与框架学习

- 框架技术:掌握TensorFlow/Keras进行深度学习模型开发,并尝试使用OpenCV处理图像数据。

- 自然语言处理:学习词嵌入、CRF和LSTM等NLP模型,通过Keras实现基本结构。

6. 项目经验积累与展示

- 完整项目:完成一个完整的AI项目(从数据预处理到模型部署),在GitHub或Kaggle上发布。

- 协作实践:参与团队项目或开源贡献,提升实际应用能力。

7. 技术栈与工具

- 框架技术:熟练使用TensorFlow/Keras和PaddlePaddle。

- 自然语言处理:学习GPT模型及其在NLP中的应用。

8. 软技能培养

- 沟通与协作:提升团队合作、问题解决和跨部门协作能力,增强沟通技巧。

通过以上步骤的学习和实践,您可以系统地掌握AI所需的理论知识和技术能力,并为职业转型打下坚实的基础。

若觉得文章对你有帮助,随手『点赞』、『收藏』、『关注』,也是对我的支持。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)