超模提示词:让普通大模型,拥有超过 O1 Pro、DeepSeek-R1 的多步推理能力!

超模提示词!!普通大模型,居然能在多步推理上,超过 O1 Pro、DeepSeek-R1 这类慢系统?

怎么超越 R1 的深度推理?

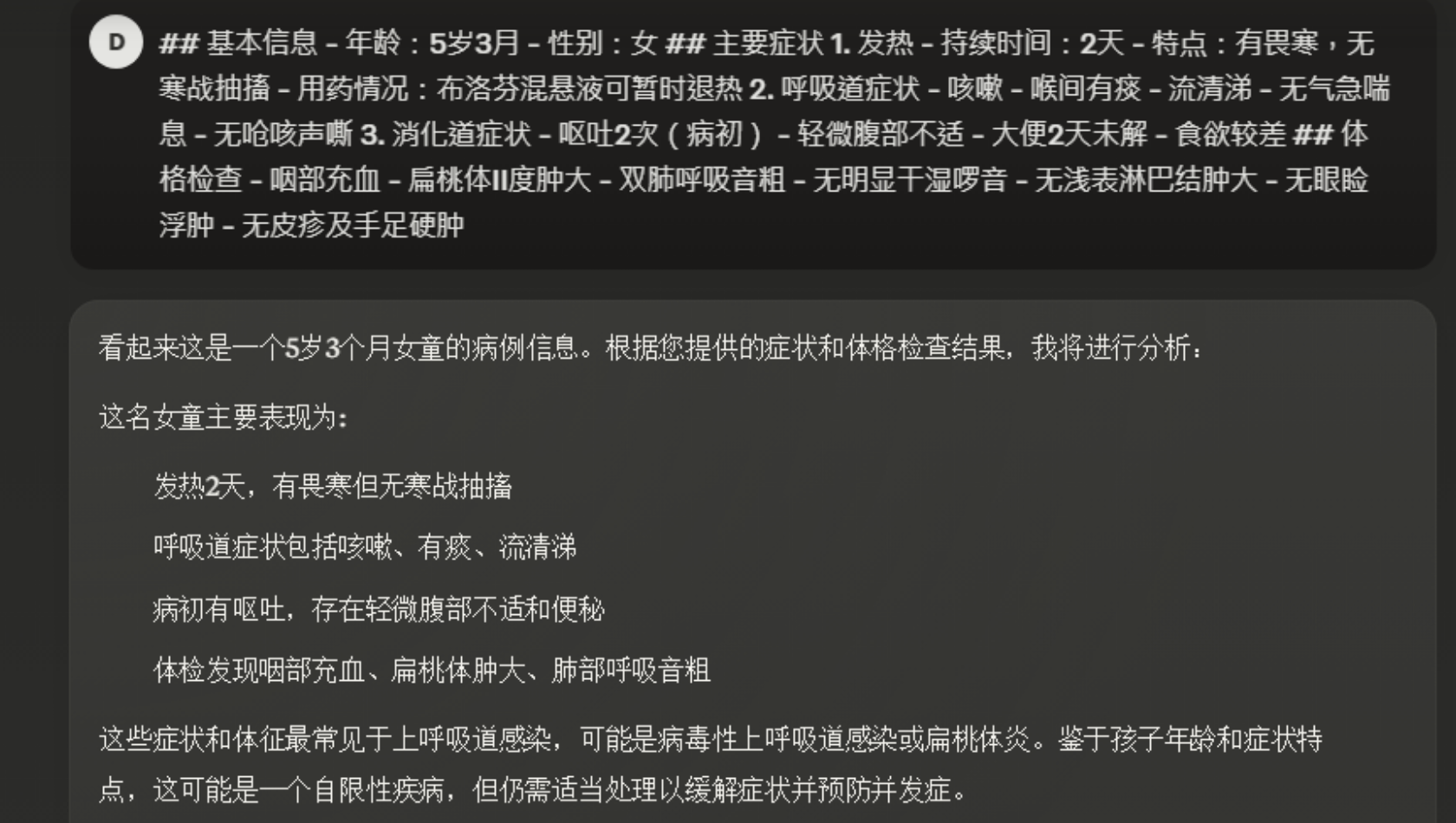

我写了一个提示词,发现可以让普通大模型,在多步推理上吊打 O1 Pro、R1、医联GPT 等一众慢思考模型。

比如,医疗诊断上:

# 输入(患者症状描述)

## 基本信息

- 年龄:5岁3月

- 性别:女

## 主要症状

1. 发热

- 持续时间:2天

- 特点:有畏寒,无寒战抽搐

- 用药情况:布洛芬混悬液可暂时退热

2. 呼吸道症状

- 咳嗽

- 喉间有痰

- 流清涕

- 无气急喘息

- 无呛咳声嘶

3. 消化道症状

- 呕吐2次(病初)

- 轻微腹部不适

- 大便2天未解

- 食欲较差

## 体格检查

- 咽部充血

- 扁桃体II度肿大

- 双肺呼吸音粗

- 无明显干湿啰音

- 无浅表淋巴结肿大

- 无眼睑浮肿

- 无皮疹及手足硬肿

答案 + 各模型回答:

O1 Pro:

从病史与体征上看,孩子主要表现为发热、上呼吸道症状(咳嗽、咽部充血、扁桃体肿大、流涕)、少量的消化道症状(呕吐、食欲差、2天未解大便等)。

发热可用布洛芬暂时退烧,咽部充血与扁桃体 II 度肿大提示咽扁桃体炎症明显,咳嗽伴喉间有痰可能存在上呼吸道或支气管黏膜炎症。

Claude 3.7(没有加深度思考):

这些大模型、真人医生,输出都是上呼吸道感染,都是错的。

我看现在的大模型和RAG算法:

- 漏诊:都存在严重漏诊(最好也只有42%召回率)

- 误诊:精确率普遍在30%左右

查看论文结果中最好的情况(Qwen-72b-chat上的"Ours"方法):

- R=46.43%:能发现不到一半的真实疾病

- P=35.72%:在给出的诊断中只有约1/3是正确的

- F1=40.37%:综合表现仍有较大提升空间

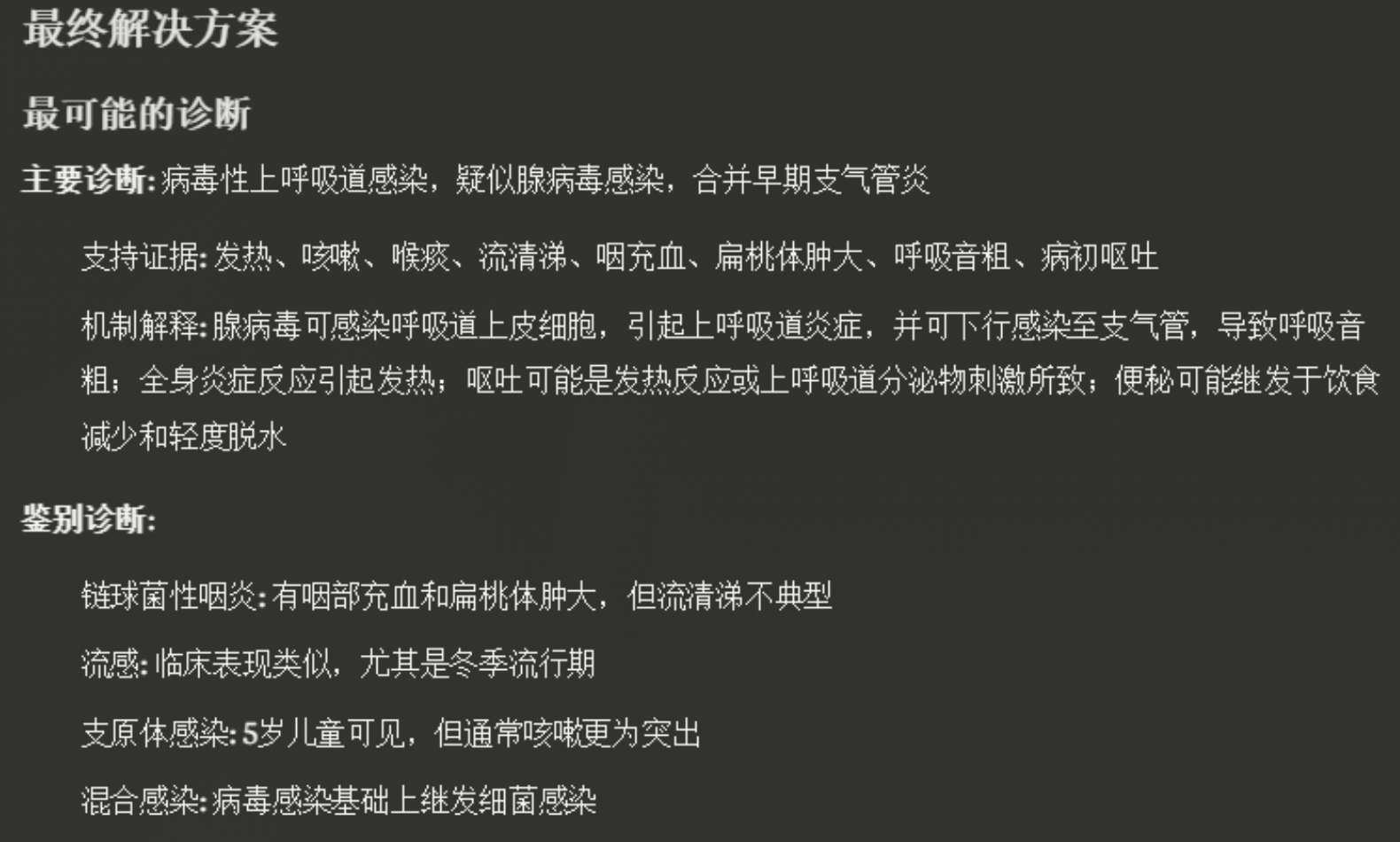

加上提示词,开挂了!

Claude 3.7(没有加深度思考)+ 9位分析师:

神奇的是,完美命中:急性支气管炎 + 腺病毒感染 。

正确答案

- 主要诊断:

- 急性支气管炎

- 腺病毒感染

- 并发情况:

- 疑似耐药沃氏葡萄球菌感染 【病原学检查结果我没输入,所以不算】

详细分析过程:(同样的问题,o1 Pro、R1 分析不了这种过程出来)

我在想,R1、O1 这类模型深度推理也是长逻辑链。

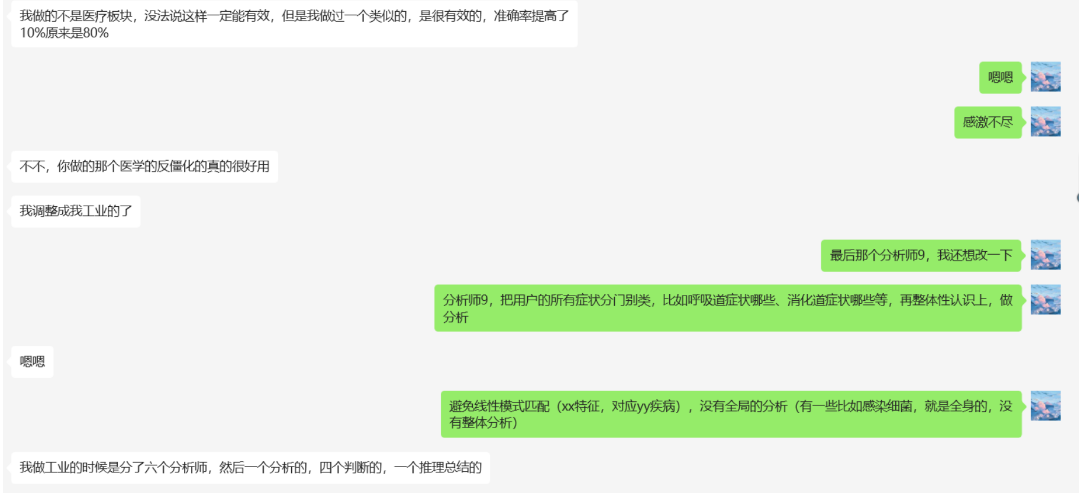

但我用 9 位分析师,直接把这个隐式长逻辑链,分成了 9 个维度 + 辩论一致性 + 超长结构 + 超长逻辑链。

哪怕是普通模型,只需要有很好的遵循能力,也就有了 O1、R1 的多步展开、反思、回溯、自我检验的结构化思维过程。

- 我试了一下,Qwen2-72B,ta只迭代第一轮,后面直接给结论了

只要完整的遵循,就会比现在的 O1 Pro、R1 会推理的更深、更适合医学诊断。

更有意思的是,我试了一下 Claude 3.7 + 深度思考 + 9位分析师提示词。

好家伙,结果效果不如没有深度思考版本,说明 3.7 自身的深度推理,没我这个显示的好。

如果只是做一轮后,就不修订了,那反而拉低了效果,多轮迭代非常重要,不能省略的。

不止如此,还能迁移到 工业 领域,实现性能提升!!

9 位分析师提示词:M-ARC思维定式之殇:大模型在临床推理中的僵化与局限,独家提示词解决线性模式识别、对不寻常细节的捕捉不足

本文所用的最终版本提示词,在文章末尾,在不断迭代。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)