DeepSeek本地部署+搭建个人知识库

DeepSeek本地部署+搭建个人知识库整体感觉这个搭建个人知识库的大模型可以用,但是受限于硬件条件以及知识库资料的质量,回答上和满血版的deepseek还有明显差距,所以后面有机会升级硬件之后再测试下效果怎么样

一、成果展示

部署环境是:11代i5 + 16G内存 + GTX1050ti(4G独显)

部署版本是:deepseek-r1:14b

生成速度:主观感受,大约每秒钟5~10个文字

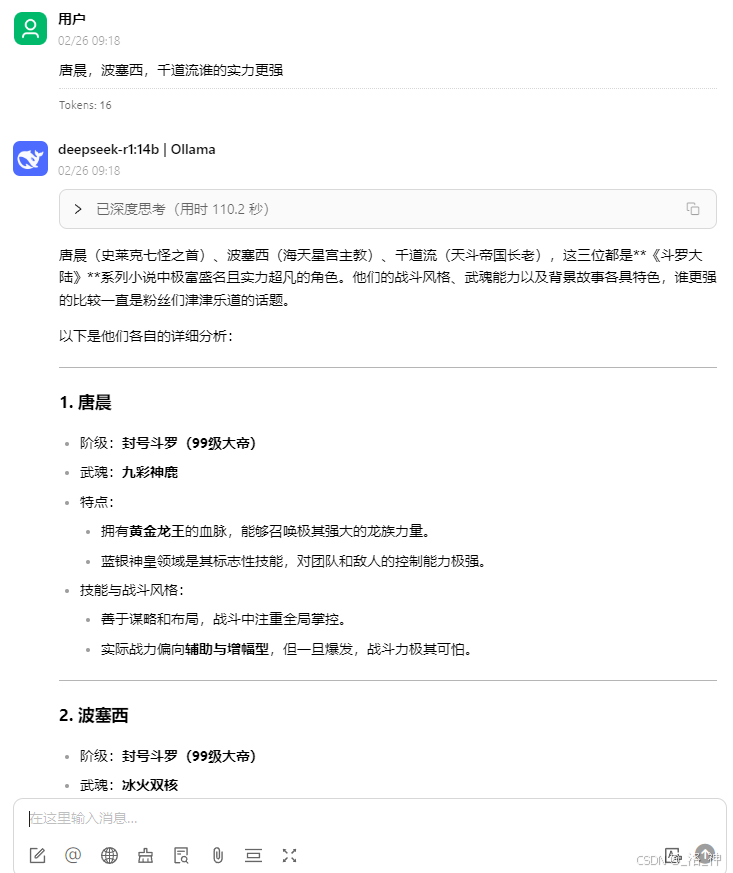

1、没有使用知识库

以斗罗大陆为例提问:“唐晨,波塞西,千道流谁的实力更强?” 下面是离线14b模型的回答效果

简直一派胡言,唐晨是史莱克七怪之首?胡诌的有模有样的,要不是看过小说我还真被你骗了。

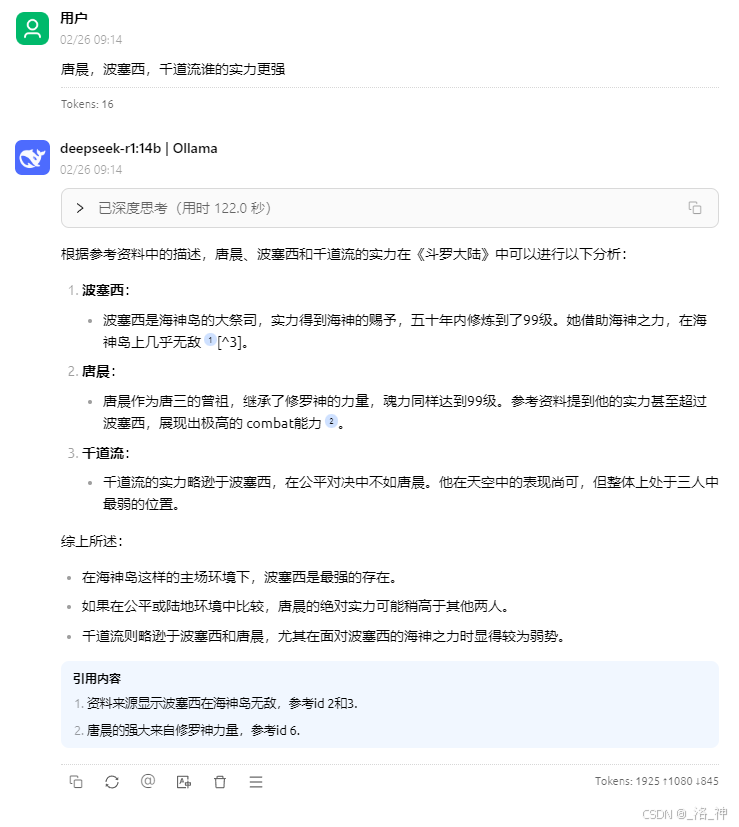

2、使用知识库

稍加改进,上传了一本斗罗大陆小说,txt版本,然后再次提问同样的问题,结果如下:

这回就比较靠谱了,起码不是胡诌,而且给出了引用自资料库的那些篇幅。

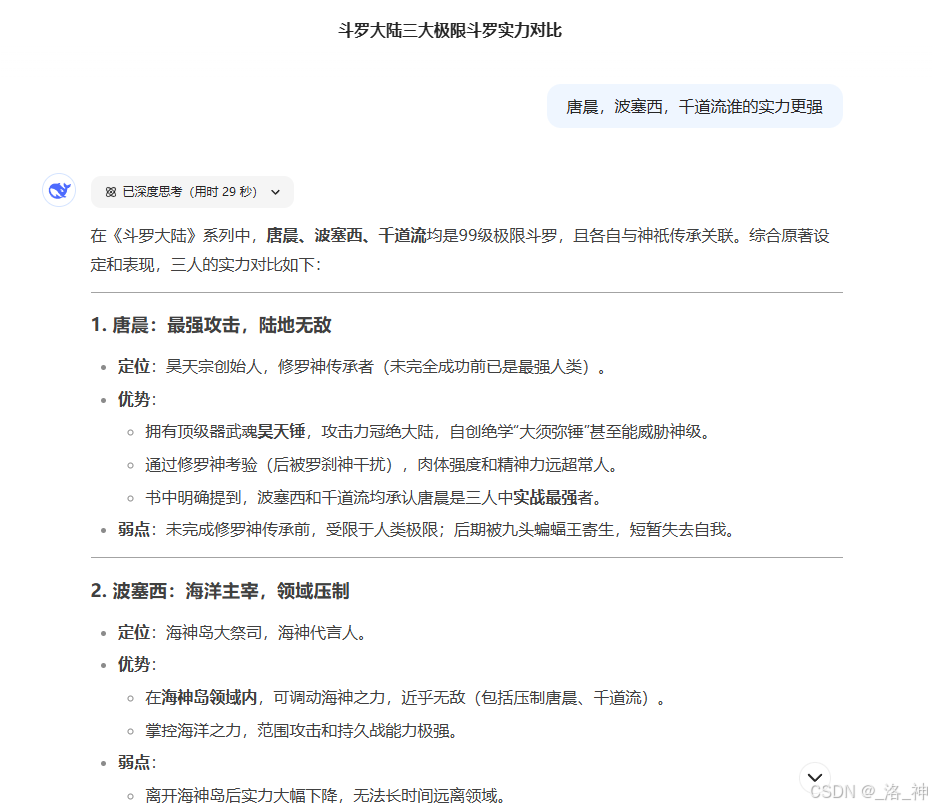

3、官网满血版deepseek

试试同样的问题官网满血版deepseek怎么回答:

结论:整体感觉这个搭建个人知识库的大模型可以用,但是受限于硬件条件以及知识库资料的质量,回答上和满血版的deepseek还有明显差距,所以后面有机会升级硬件之后再测试下效果怎么样,有条件测试的朋友可以把测试效果打在评论区,下面是具体的操作步骤。

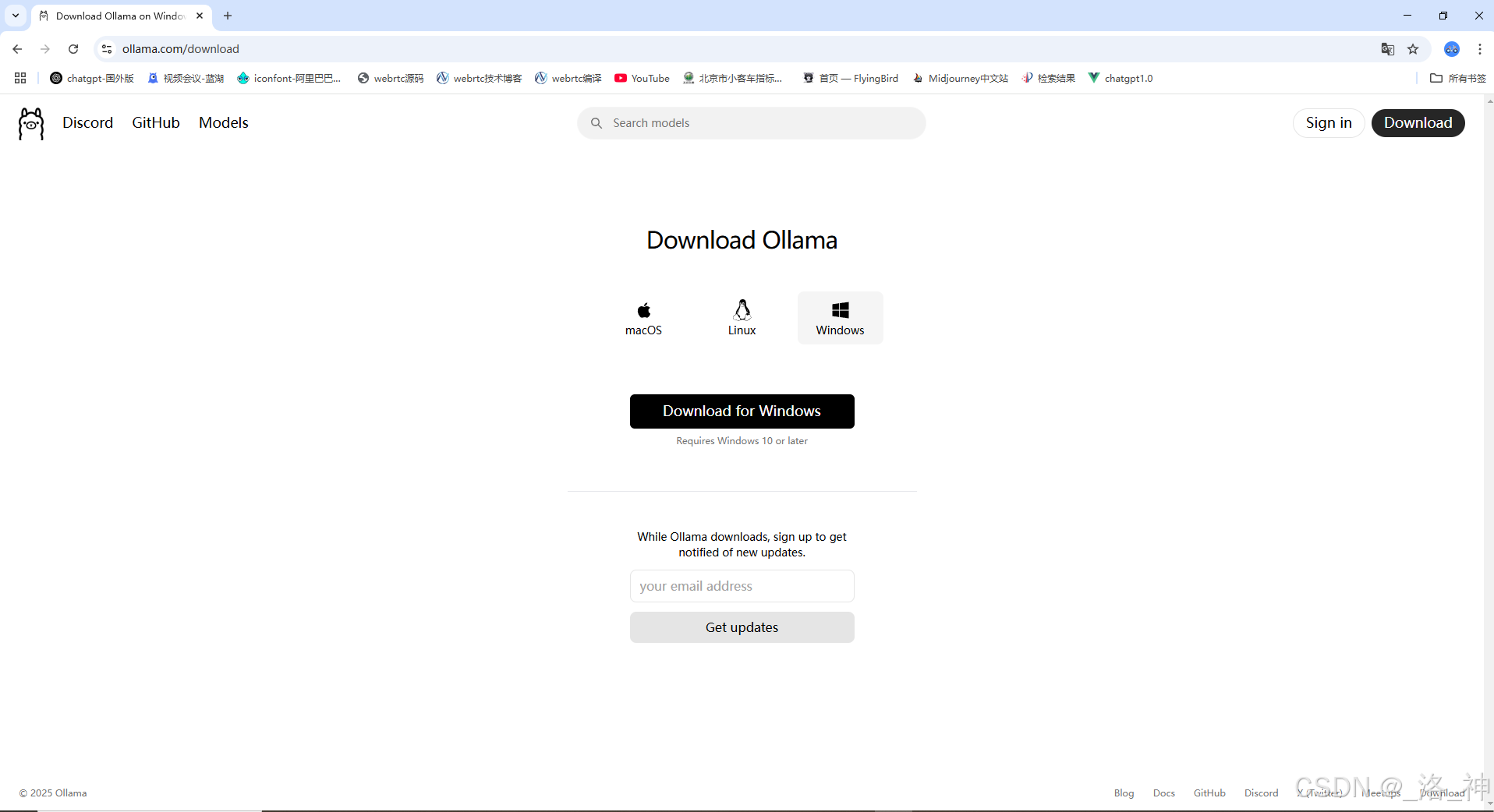

二、安装ollama

1、下载ollama

下载链接:https://ollama.com/

2、选择平台

我这里以windows为例,点击download for windows

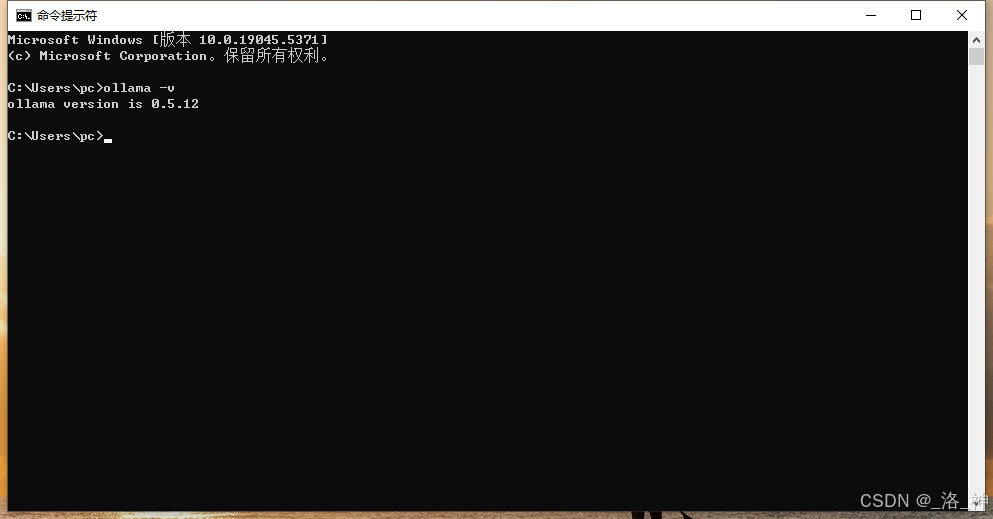

3、下载完成双击安装

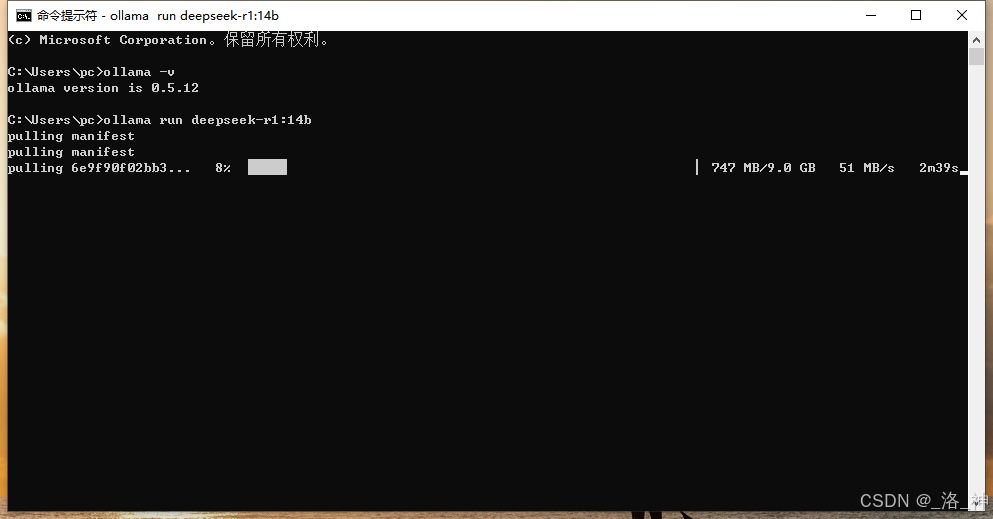

安装完成在cmd命令窗口输入ollama -v 出现以下信息表示ollama安装成功

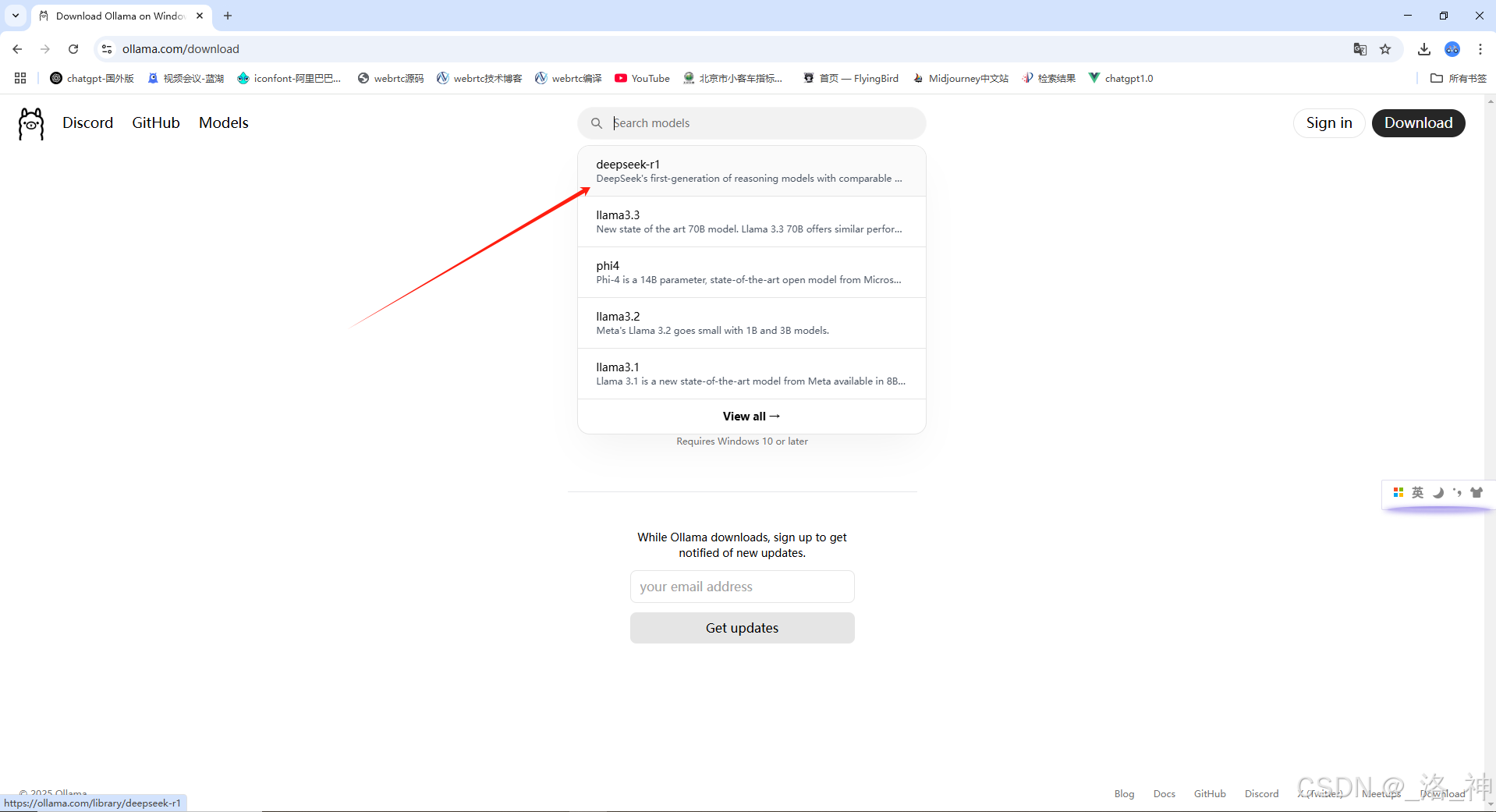

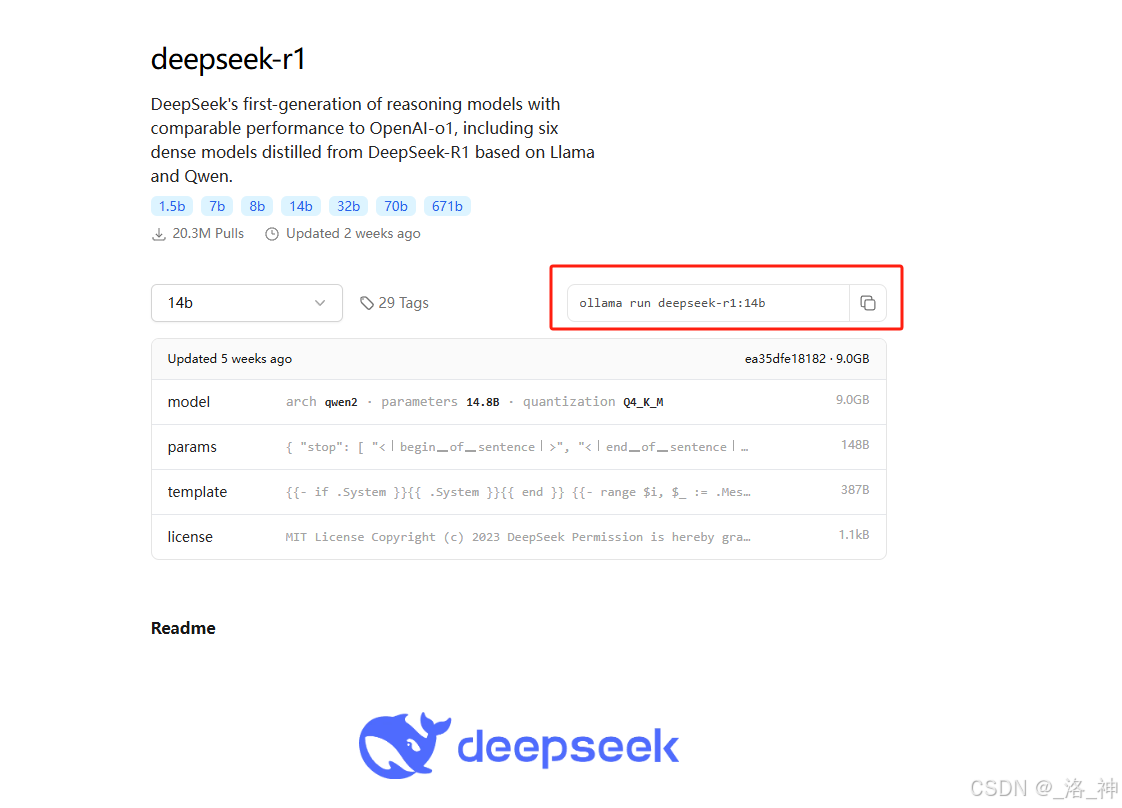

三、下载并且运行deepseek-r1

1、在ollama官网首页搜索deepseek-r1

2、根据自己硬件条件,选择对应参数的模型,复制这条指令到命令行

3、开始下载并且运行模型

前期下载速度很快,最后98%的时候特别慢,耐心等待

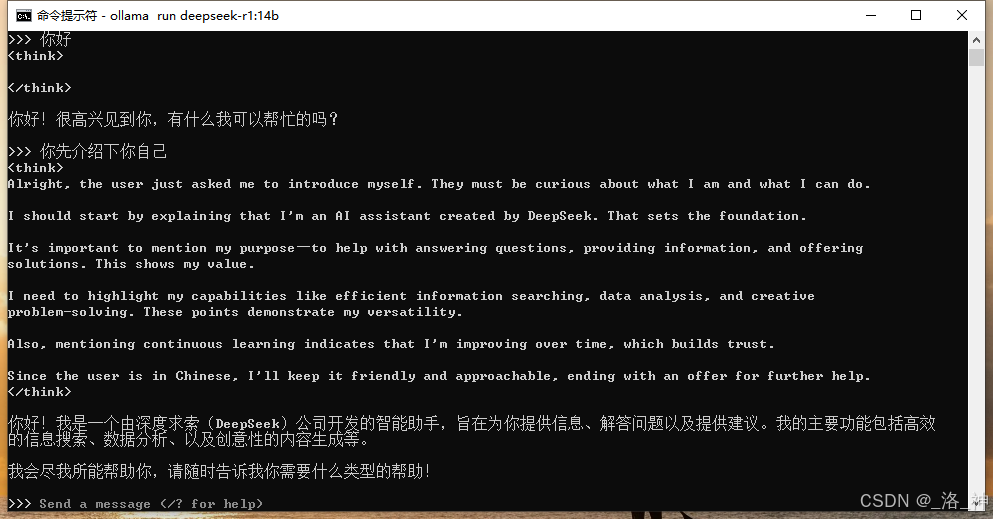

4、完成部署

模型下载完成后会自动运行,尝试直接在命令行提问,他会给出回答,如下图:

四、在AI对话客户端中运行DeepSeek

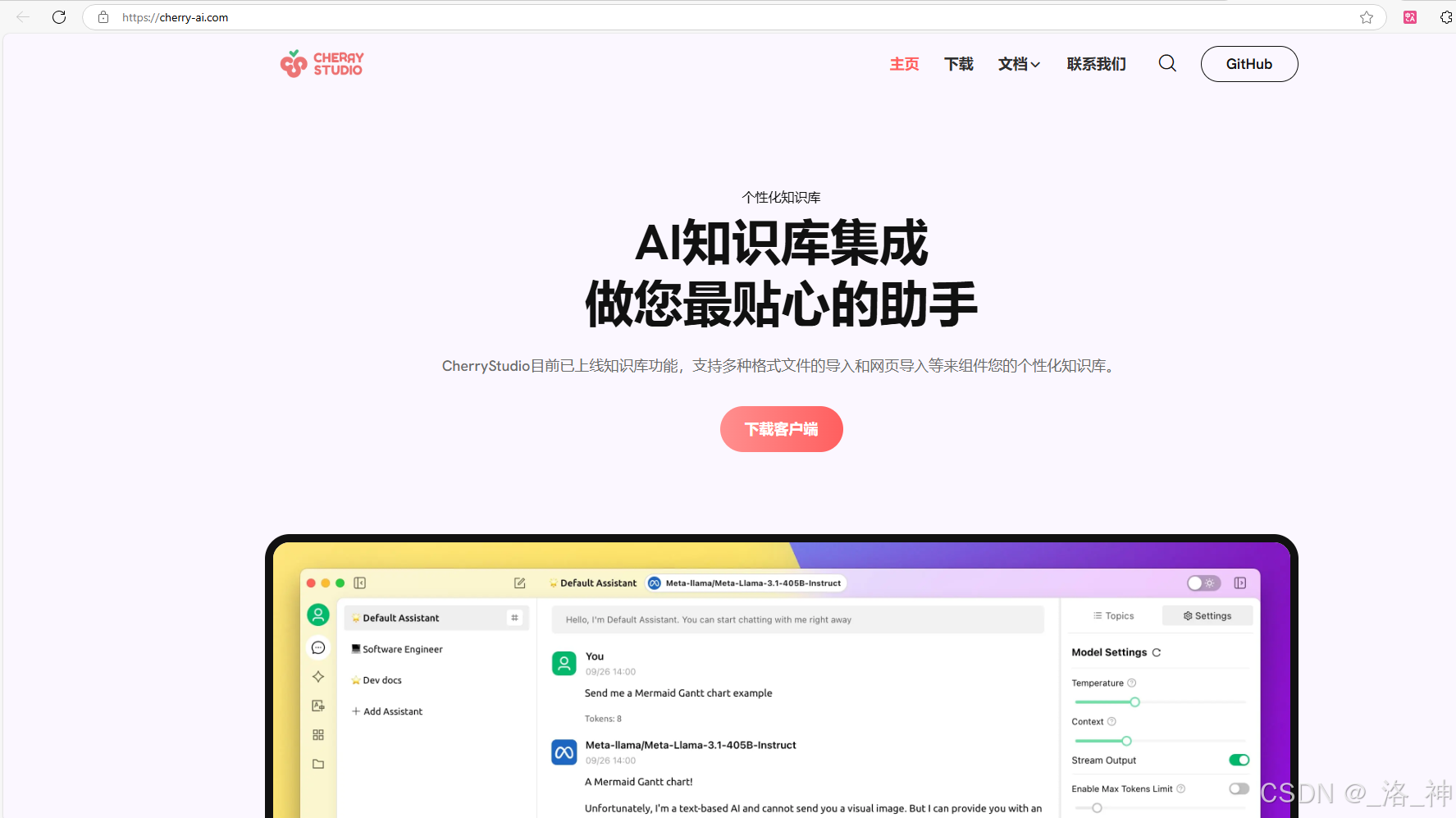

1、下载Cherry studio AI对话客户端

打开官网https://cherry-ai.com/,点击下载客户端,可能需要通过网盘下载,我在csdn上也上传了一份,需要的直接下载:备用下载

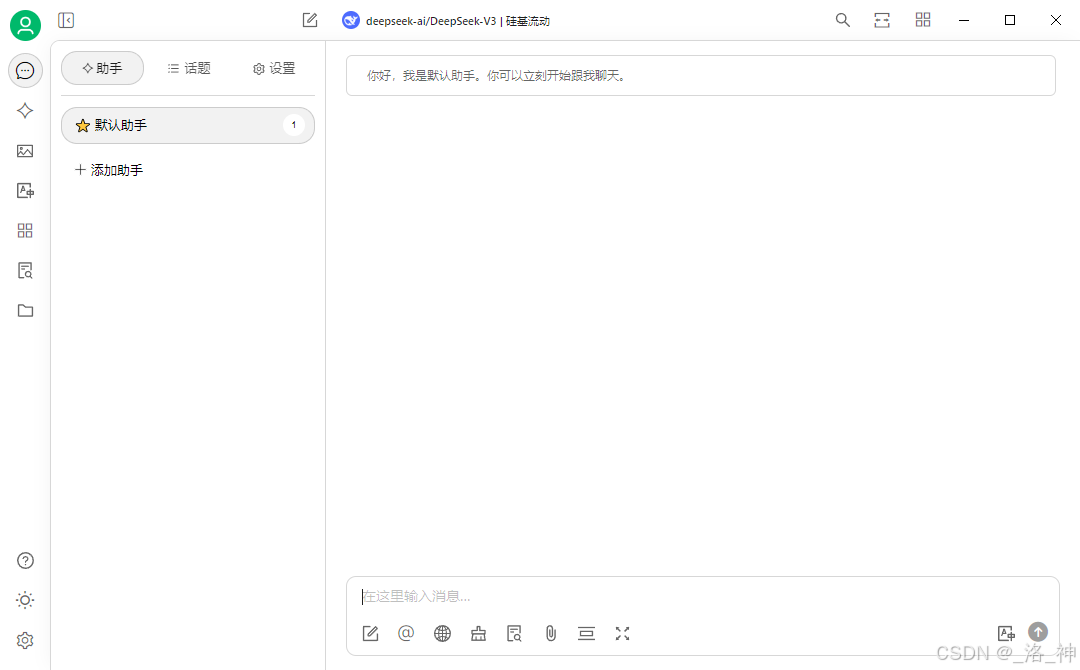

2、安装Cherry studio

下载完之后选择对应的平台,这里还是以windows版本为例,双击自动安装,安装好之后运行如下图所示:

3、添加deepseek模型

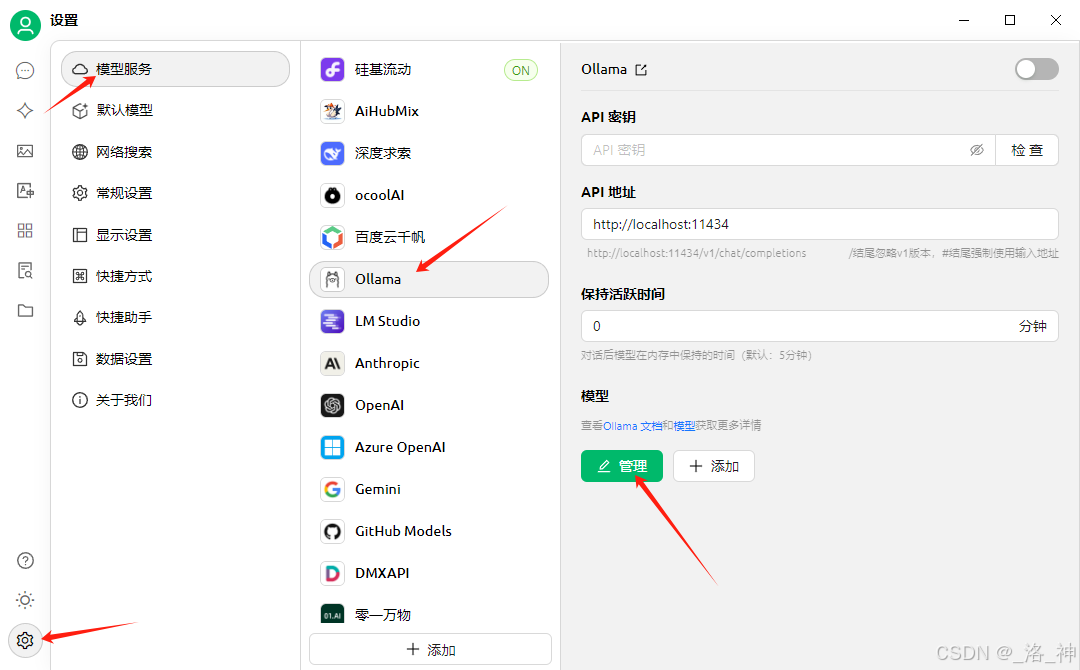

(1)依次按照图中箭头指示,点击对应的单元:

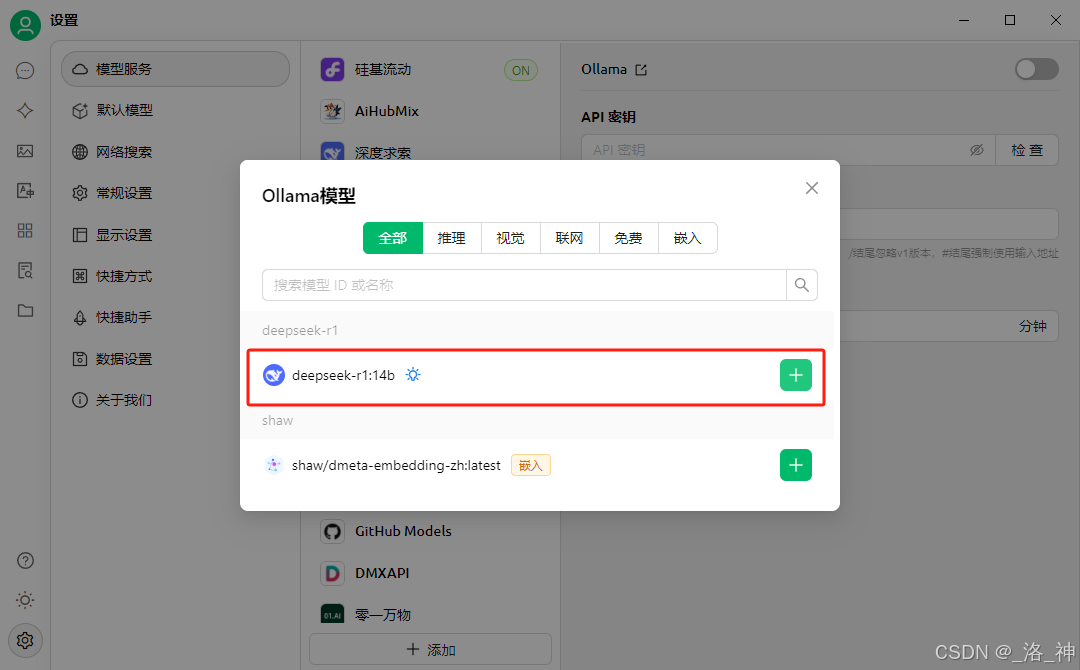

(2)找到deepseek模型,点击+添加

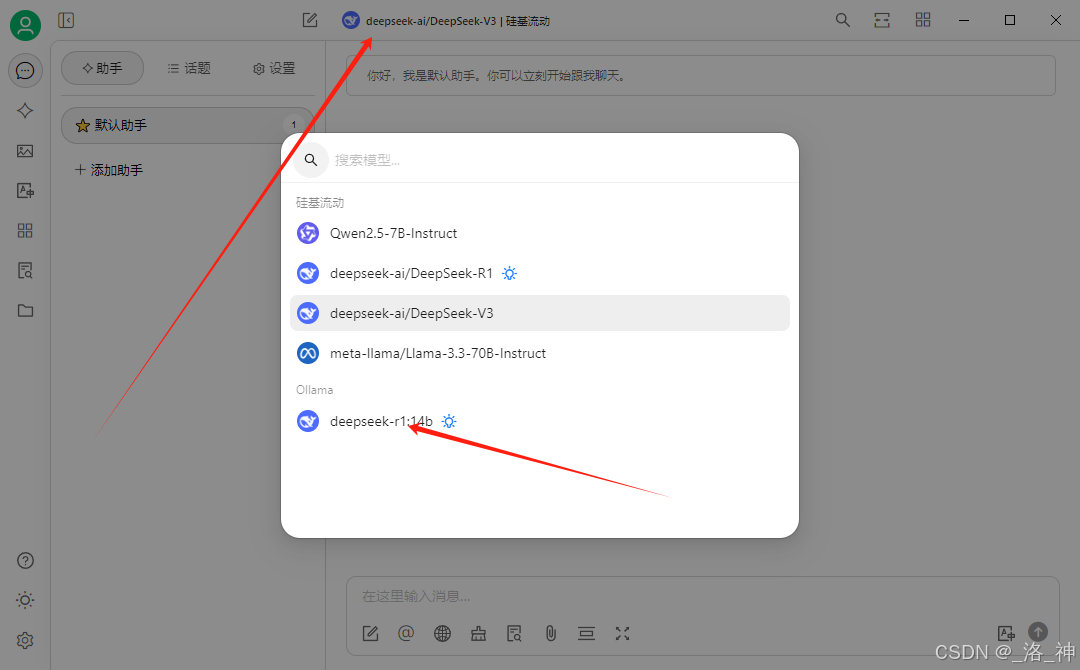

(3)添加完成后再首页对话框页面选择deepseek

4、添加完成

五、搭建自己的知识库

1、安装词嵌入模型

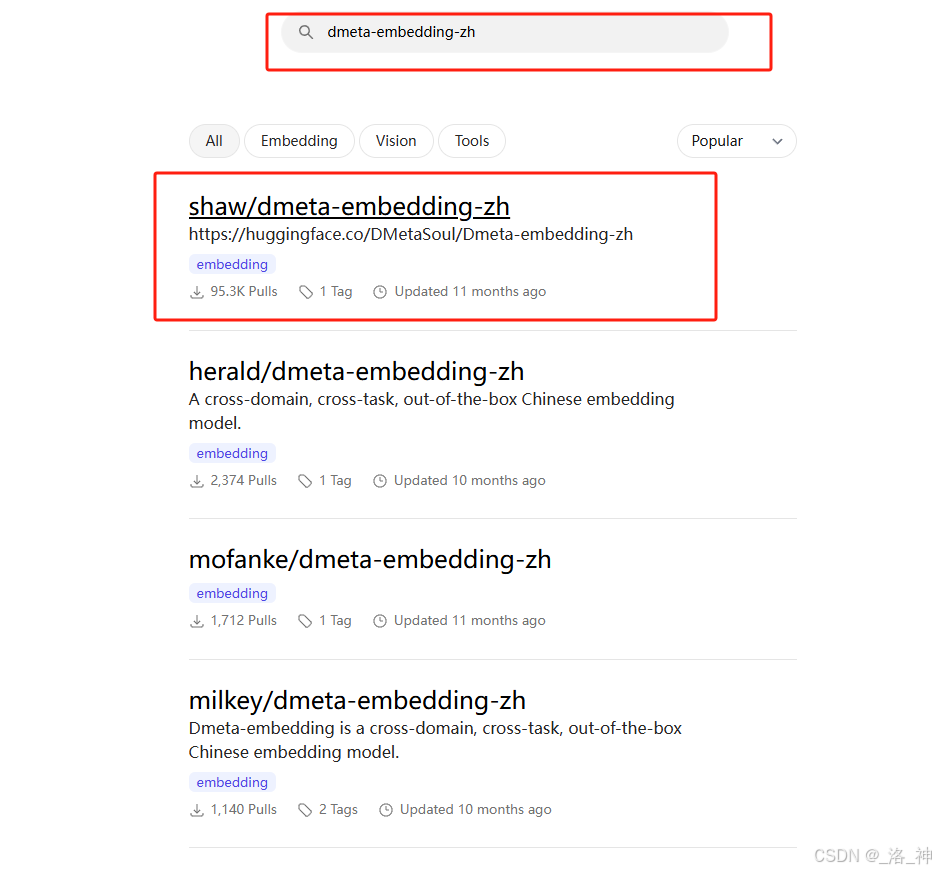

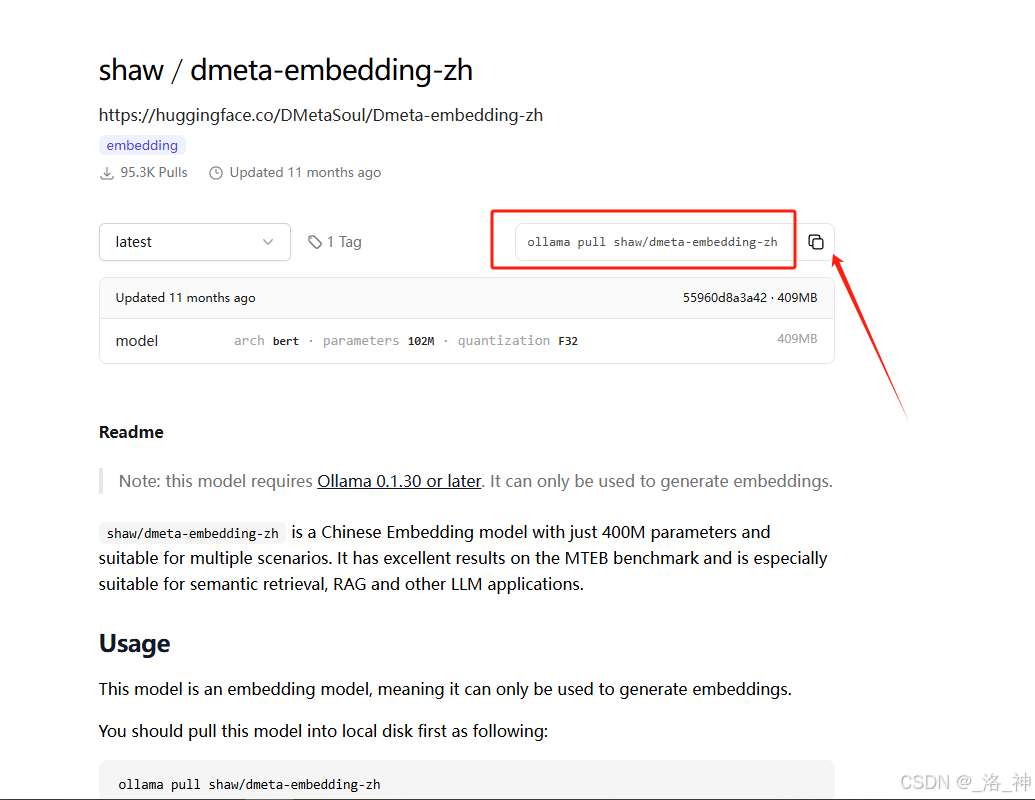

在ollama官网首页搜索:dmeta-embedding-zh,选择如下图所示的模型

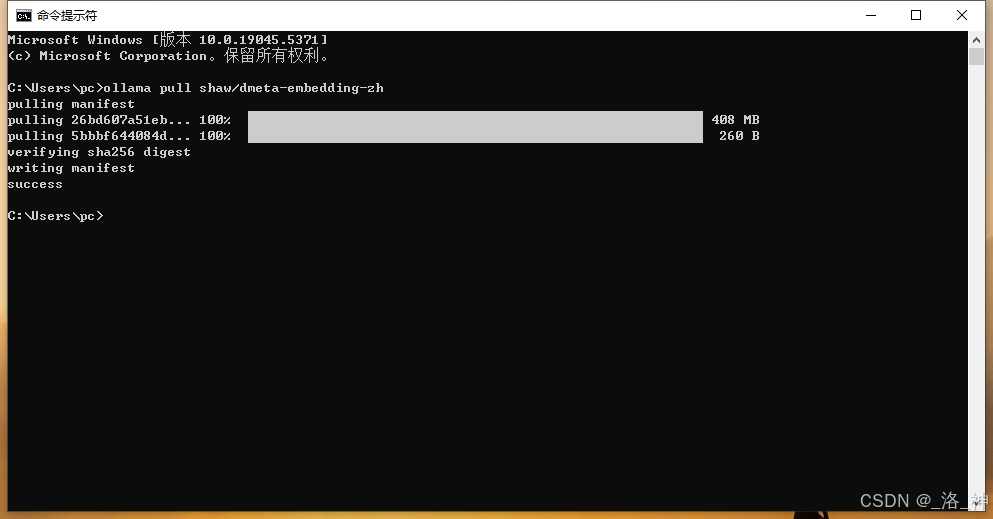

2、同安装deepseek模型同理,复制指令到命令行

3、下载词嵌入模型

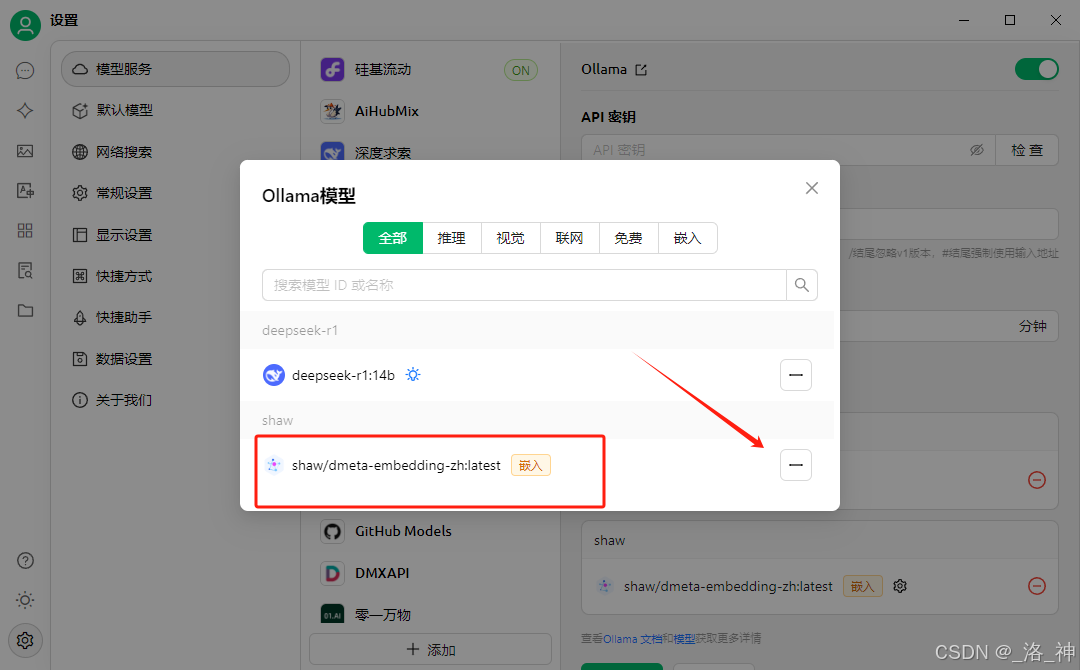

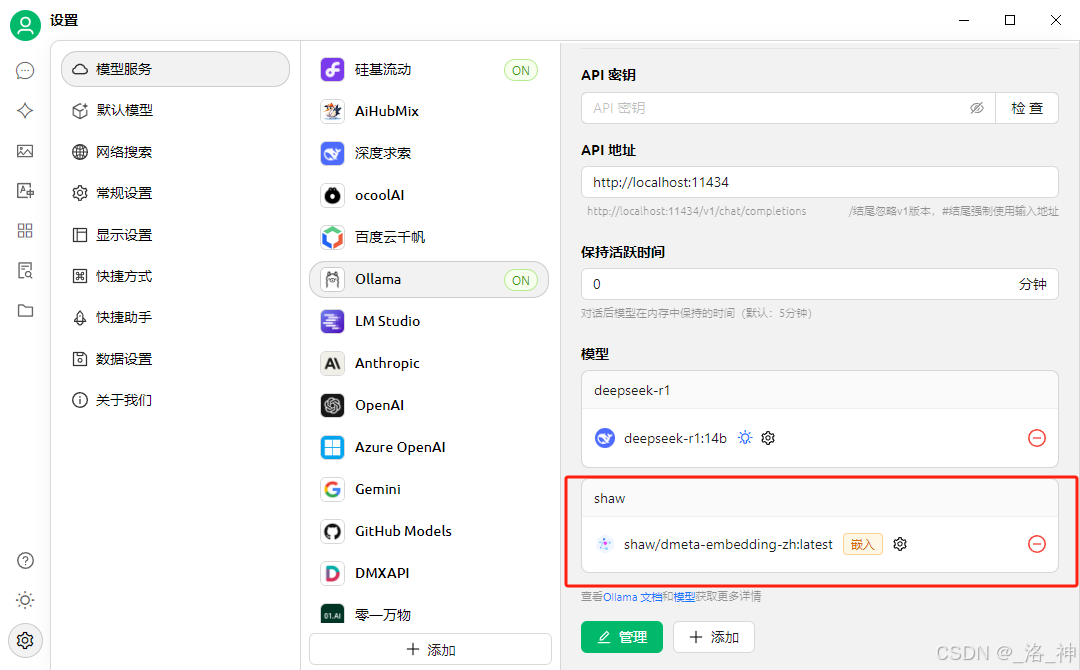

4、添加模型到Cherry Studio

(1)同添加deepseek模型操作一致:

(2)添加完成效果

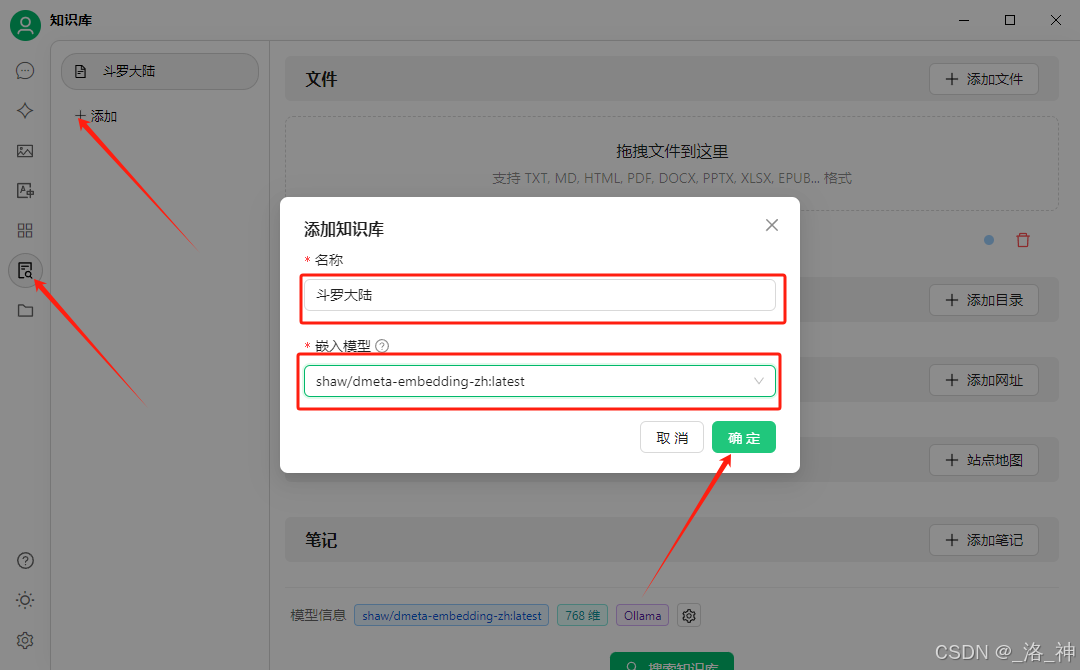

5、添加自定义知识库

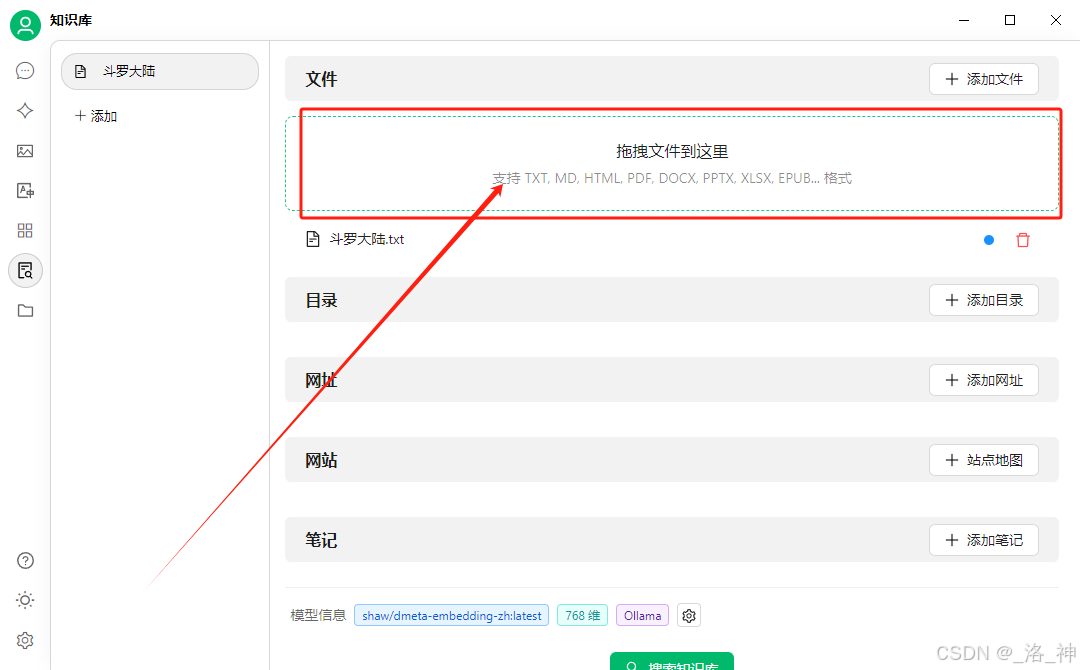

6、将预先准备好的文件拖拽到知识库

文件上传之后需要等待一段时间,需要等待文件解析完成才可以使用。解析完成后会显示已完成。

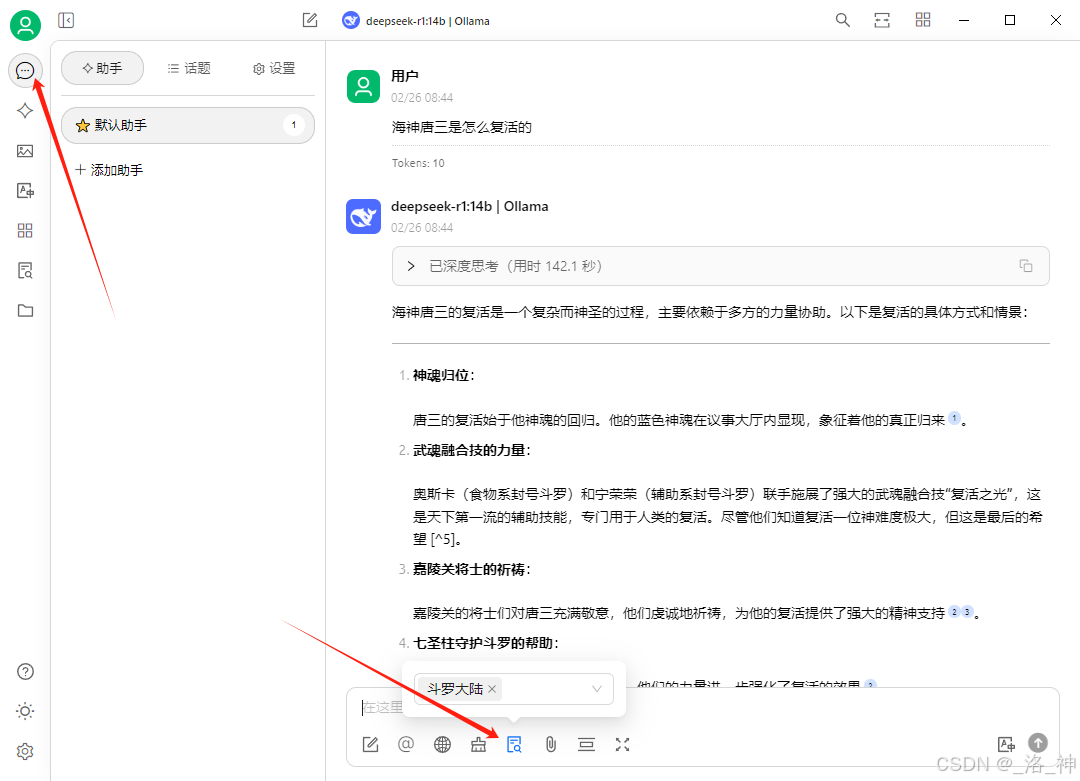

7、使用知识库提问

在AI对话页面,选择之前建立的知识库,然后提问

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)