DeepSeek大模型部署指南

DeepSeek是一款专注于大模型与AGI(人工智能通用智能)研究的高性能基座模型。它支持长文本处理、多模态理解、代码生成等多种复杂任务,并在权威评测中表现出接近GPT-4的水平。DeepSeek提供了开源模型,如DeepSeek-MoE和DeepSeek-V2,推动技术社区共享,并通过优化模型架构(如MoE稀疏架构)降低算力消耗。DeepSeek的应用场景非常广泛。在ToC端,智能助手DeepS

在当今人工智能快速发展的时代,大模型的应用越来越广泛。DeepSeek作为一款高性能的大模型,支持长文本、多模态、代码生成等复杂任务,已经在多个领域展现出强大的能力。本文将详细介绍DeepSeek大模型的部署流程,帮助读者在自己的环境中高效地使用这一先进工具。

一、DeepSeek大模型简介

DeepSeek是一款专注于大模型与AGI(人工智能通用智能)研究的高性能基座模型。它支持长文本处理、多模态理解、代码生成等多种复杂任务,并在权威评测中表现出接近GPT-4的水平。DeepSeek提供了开源模型,如DeepSeek-MoE和DeepSeek-V2,推动技术社区共享,并通过优化模型架构(如MoE稀疏架构)降低算力消耗。

DeepSeek的应用场景非常广泛。在ToC端,智能助手DeepSeek-R1支持自然对话、知识问答、逻辑推理等,类似ChatGPT,可以作为用户的智能助手。在ToB端,DeepSeek为企业提供API和行业解决方案,如金融、教育、医疗等领域的智能化工具。具体来说,金融领域可以应用智能投研和风险分析;教育领域可以实现个性化学习和自动批改;医疗领域则可以进行文献解析和辅助诊断建议。

DeepSeek还致力于开源贡献,发布免费可商用的模型,降低技术门槛。通过技术论文与社区协作,DeepSeek探索AGI前沿方向,如模型架构优化和对齐技术。DeepSeek在多模态理解、逻辑推理等复杂任务上表现突出,同时注重务实落地,聚焦解决实际问题,如企业降本增效和个人效率提升。

二、DeepSeek大模型部署前的准备

目录

在进行DeepSeek大模型的部署之前,需要做好以下准备工作:

-

硬件需求:

- 推荐配置:NVIDIA GPU(RTX 3090或更高)+ 32GB内存 + 50GB存储空间。

- 最低配置:CPU(支持AVX2指令集)+ 16GB内存 + 30GB存储空间。

-

软件环境:

- 需要安装Python环境。推荐使用conda来安装Python环境,因为它可以方便地管理不同的Python版本和包依赖。

- 需要使用Hugging Face Transformers库或提供的API端点进行模型推理。需要注意的是,访问Hugging Face可能需要科学上网。

三、DeepSeek大模型本地部署步骤

本地部署DeepSeek大模型可以通过多种方式实现,这里介绍一种常用的方法,借助Ollama这一开源的大模型服务工具。

1. 下载并安装Ollama

Ollama是一个开源的大模型服务工具,可以帮助我们在电脑本地部署各种大模型。首先,我们需要访问Ollama的官方网站(ollama.com),下载并安装Ollama客户端。

下载完成后,根据操作系统选择对应的版本进行安装。安装完成后,你会在系统的某个位置(可能是隐藏菜单)找到Ollama的专属图标。

2. 安装DeepSeek-R1大模型

接下来,我们需要安装DeepSeek-R1大模型。再次进入Ollama官网,找到Models界面,在其中查找DeepSeek-R1模型。Ollama官网提供了多个版本的DeepSeek-R1模型,模型名称中的“b”表示十亿参数,参数值越大,模型就能处理更复杂的任务。在选择模型时,需要结合电脑的实际硬件情况进行选择。普通电脑的话,选择7B或者1.5B版本的模型即可。

选择好模型版本后,点击右边的复制按钮,复制拉取模型的指令。然后回到Ollama软件的页面,粘贴指令并回车进行安装。安装过程中,Ollama会下载模型文件并将其解压到指定目录。

3. 对话测试

模型下载安装完毕后,就可以在Ollama软件上和DeepSeek-R1进行对话了。打开Ollama软件,你会看到一个对话界面。在对话界面中,你可以输入问题或指令,DeepSeek-R1会根据你的输入生成相应的回答或结果。

和其他大模型相比,DeepSeek-R1的一个显著特点是将思考过程列出,让人感觉十分清晰有条理,可信度更高。不过,Ollama这个交互页面的美观性和便捷性可能有所欠缺。如果你追求更美观和便捷的交互体验,可以考虑安装大模型客户端,如Cherry Studio。

4. 安装大模型客户端(可选)

Cherry Studio是一款功能强大的大模型客户端,支持多种大模型的部署和使用。你可以访问Cherry Studio的官方网站(cherry-ai.com),下载并安装对应系统版本的客户端。

安装完成后,打开Cherry Studio客户端。在客户端的设置中,选择Ollama并管理模型,选择已经安装的DeepSeek-R1模型。然后回到对话界面,选择r1模型,就可以开始和DeepSeek-R1进行对话了。

四、DeepSeek大模型部署后的应用

DeepSeek大模型部署完成后,可以在多个领域和场景中应用。以下是一些常见的应用场景:

-

智能助手:

- DeepSeek-R1可以作为智能助手,解答问题、辅助学习、生成内容(如文案、代码)、数据分析等。

- 学生可以使用DeepSeek-R1解析数学题、生成论文大纲;程序员可以通过代码生成功能快速开发模块。

-

效率工具:

- DeepSeek大模型可以帮助处理日常任务,如邮件撰写、信息总结等,提升个人生产力。

-

API服务:

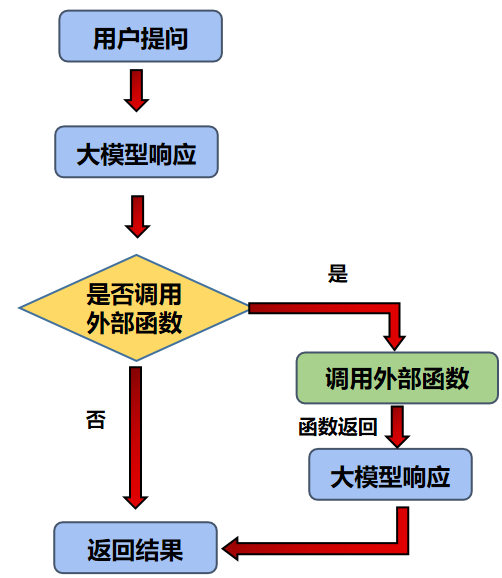

- 企业可以接入DeepSeek的API,将模型集成至企业系统(如客服、数据分析平台),实现智能化升级。

- 例如,可以构建智能客服系统,利用DeepSeek大模型进行用户咨询和投诉的处理;或者利用DeepSeek大模型分析市场数据,辅助企业决策。

-

行业解决方案:

- DeepSeek为金融、教育、医疗等行业提供智能化解决方案。

- 在金融领域,可以进行智能投研和风险分析;在教育领域,可以实现个性化学习和自动批改;在医疗领域,可以进行文献解析和辅助诊断建议。

五、DeepSeek大模型部署的注意事项

在部署DeepSeek大模型时,需要注意以下几点:

-

硬件资源:

- 确保硬件资源满足DeepSeek大模型的部署要求。如果硬件资源不足,可能会导致模型运行缓慢或无法正常运行。

-

软件环境:

- 确保软件环境配置正确。特别是Python环境和Hugging Face Transformers库的安装和配置,这是进行模型推理的基础。

-

网络访问:

- 如果需要使用Hugging Face Transformers库进行模型推理,可能需要科学上网。这是因为Hugging Face的服务器可能位于国外,国内用户访问时可能会受到网络限制。

-

模型选择:

- 在选择DeepSeek大模型时,需要结合实际应用场景和硬件资源进行选择。参数越大的模型处理任务的能力越强,但对硬件资源的要求也越高。

-

数据安全:

- 在本地部署DeepSeek大模型时,需要注意数据安全问题。确保模型和数据的安全存储和访问控制,防止数据泄露和滥用。

六、总结与展望

DeepSeek大模型的部署和应用是一个复杂而有趣的过程。通过本文的介绍,读者可以了解到DeepSeek大模型的基本特点、部署前的准备工作、本地部署步骤以及部署后的应用场景和注意事项。

未来,随着人工智能技术的不断发展和DeepSeek大模型的持续优化升级,我们可以期待DeepSeek在更多领域和场景中发挥更大的作用。同时,也希望更多的开发者能够参与到DeepSeek大模型的研究和应用中来,共同推动人工智能技术的发展和进步。

DeepSeek官方网址:DeepSeek。在这里,你可以了解更多关于DeepSeek大模型的信息和资源,与社区成员进行交流和分享,共同探索人工智能的未来之路。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)