【DeepSeek】本地部署,实现轻松办公!

最近,国产大模型越来越火爆,用户越来越多,再不进行实现本地部署,一直依赖网页使用,只会一直等待,或者错峰使用DeepSeek。如何更好的实现本地部署,来看本文章主要内容。

前言

最近,国产大模型越来越火爆,用户越来越多,再不进行实现本地部署,一直依赖网页使用,只会一直等待,或者错峰使用DeepSeek。如何更好的实现本地部署,来看本文章主要内容。

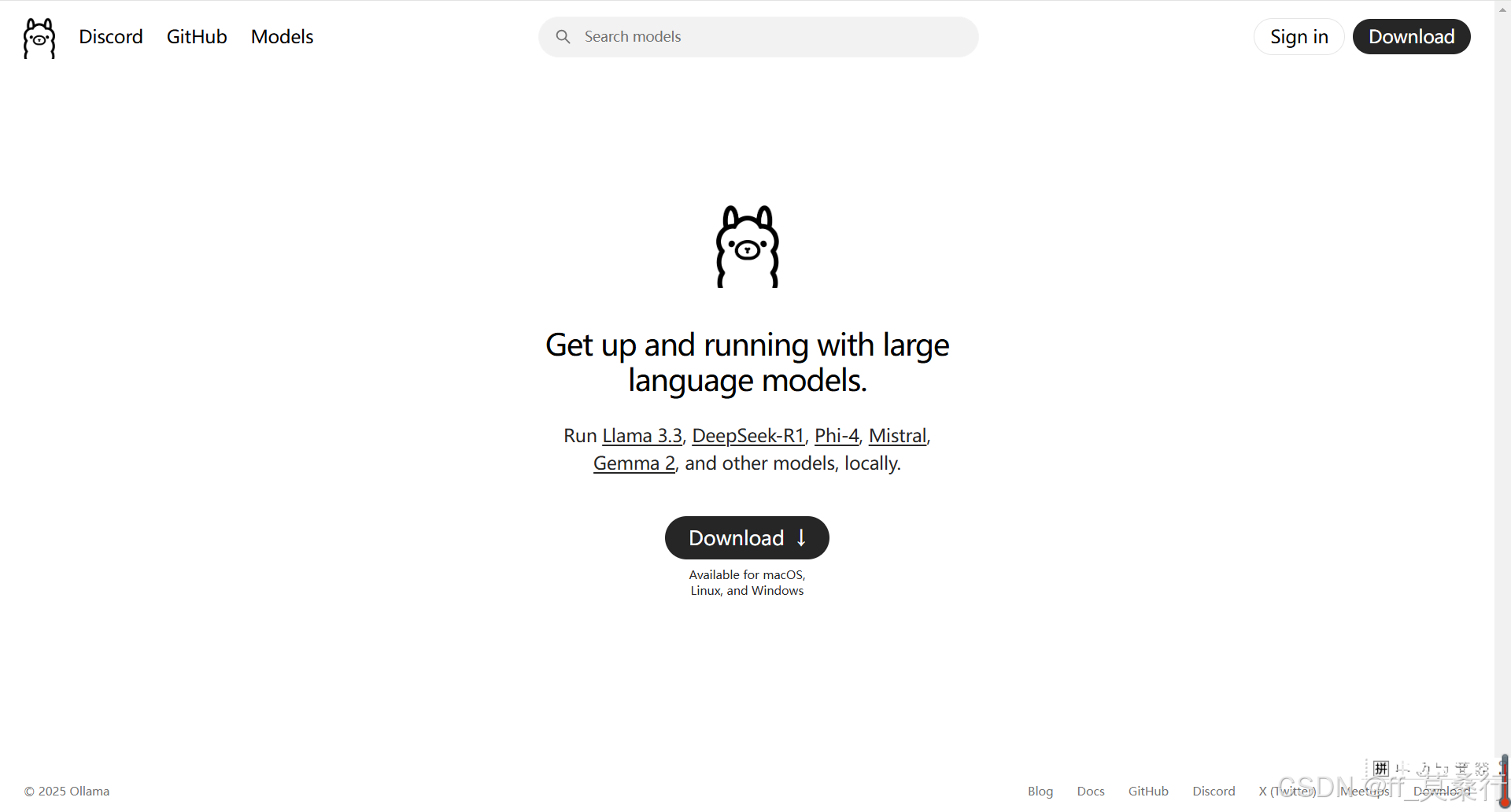

一、安装ollama

访问 Ollama官网 下载该工具,选择符合自己的电脑版本。以下示例windows 11。

下载完进行双击按照,存入C盘,然后进行命令行配置。

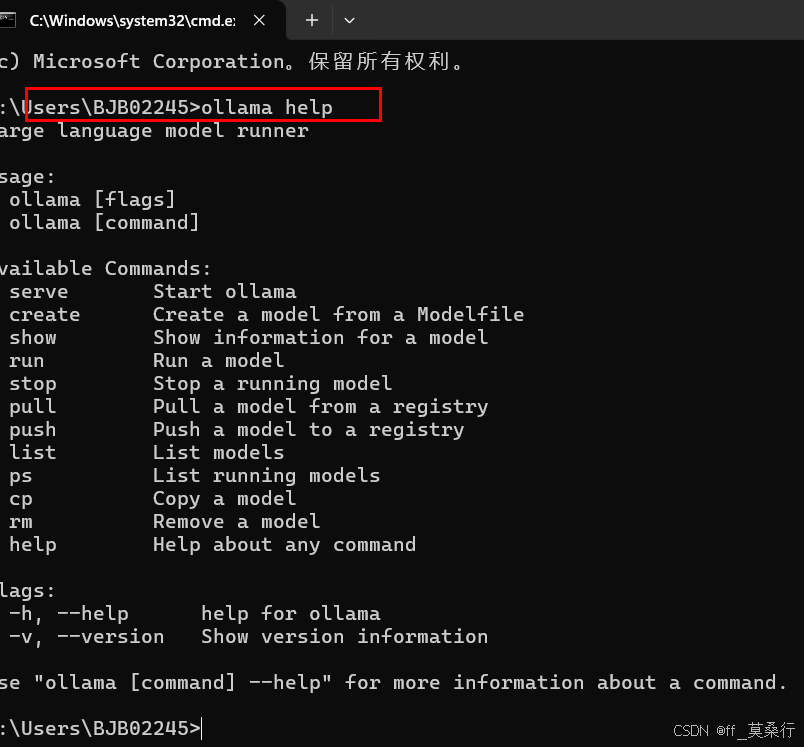

1、Win+R 输入cmd

2、输入ollama help

ollama help

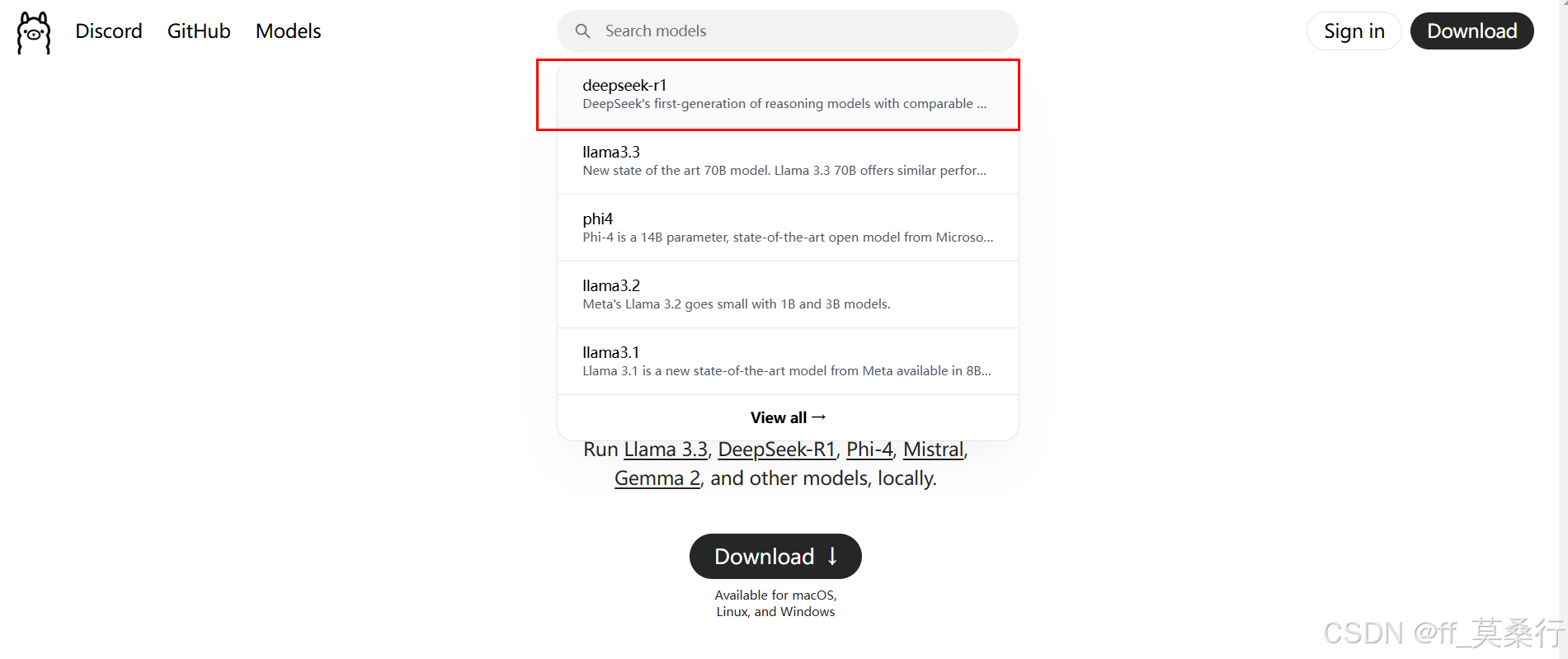

二、下载DeepSeek模型

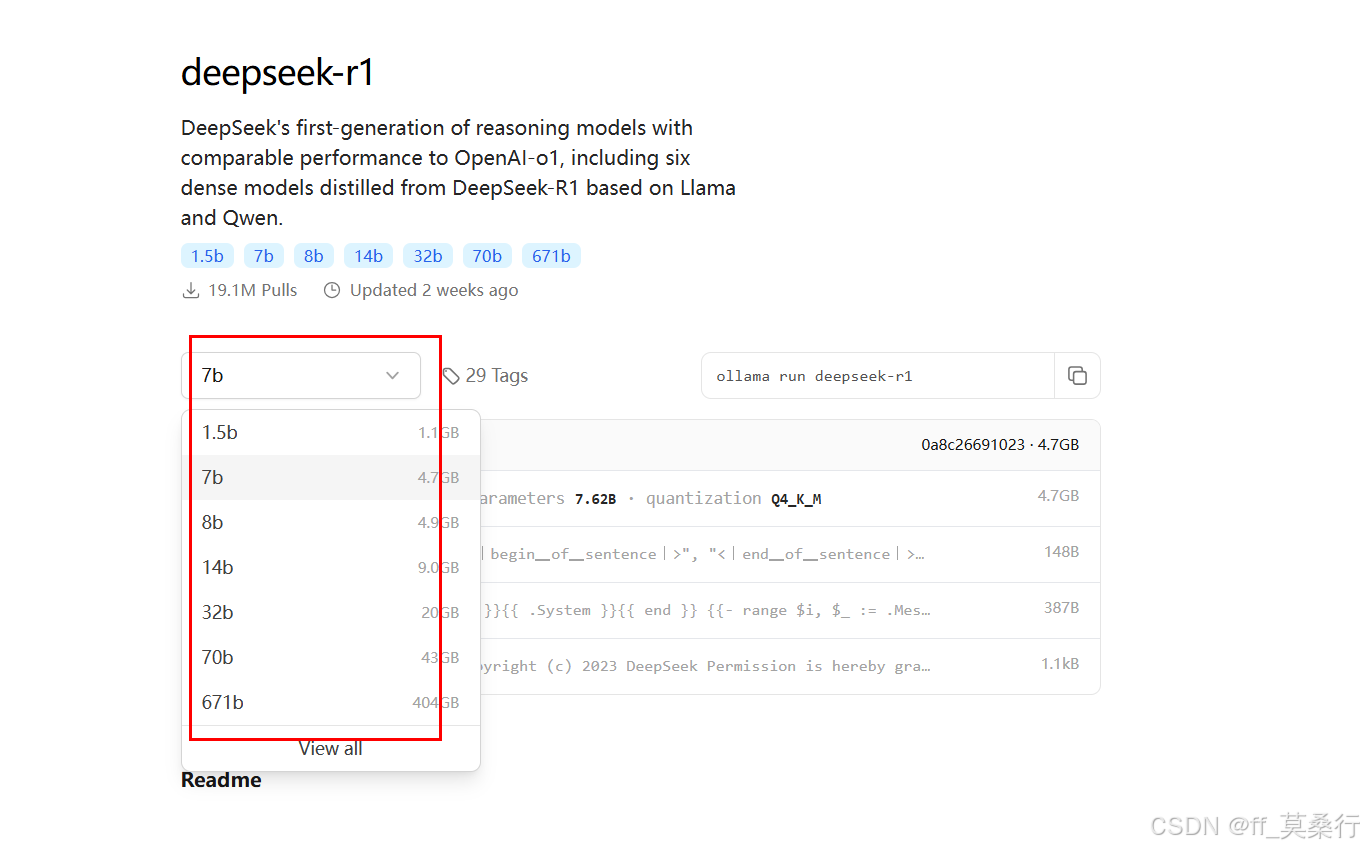

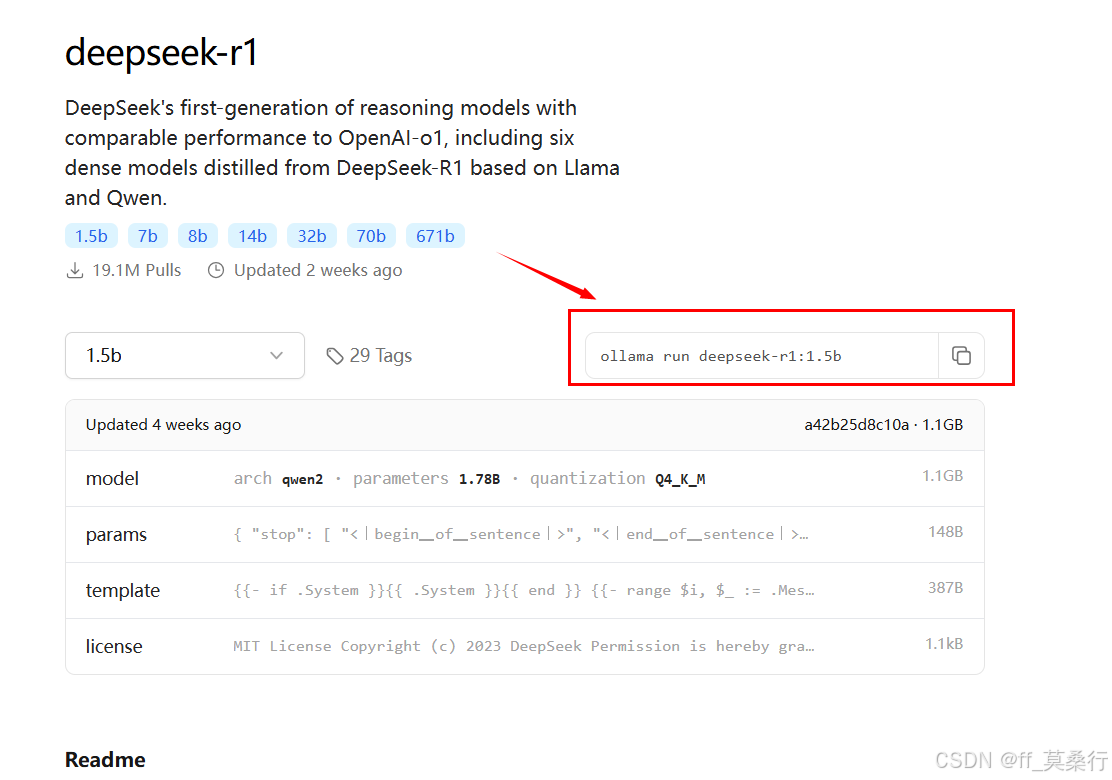

1、打开ollama 输入“deepseek-r1”

2、选择符合的参数

● 1.5B 表示该模型具有 15 亿个参数,适合轻量级任务或资源有限的设备使用。

● 671B 则代表该模型拥有 6710 亿个参数,模型规模和计算能力都极为强大,适合大规模数据处理和高精度任务,但对硬件要求也相应更高。

如何选择?

打开电脑“设备管理器”展开“显示适配器”类别,可以看到已安装的显卡型号。如果需要更详细的信息,可以右键点击显卡名称,选择“属性”查看详细信息;

选择好后,复制右边内容:

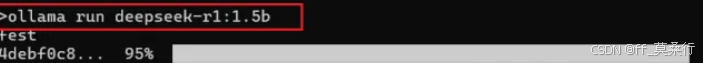

ollama run deepseek-r1:1.5b

3、复制到命令行中

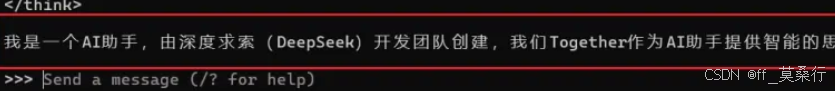

4、等待配置

这样的显示就表明成功部署了,就可以进行发信息推理啦!

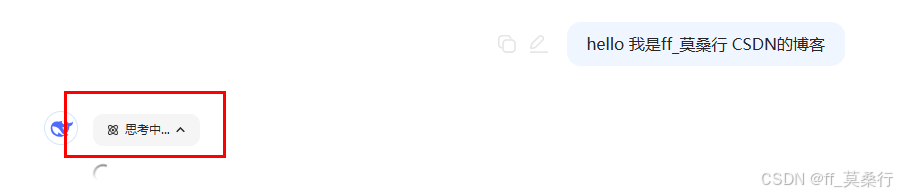

三、选择可视化工具Chatbox

1、下载,安装打开,选择API Key

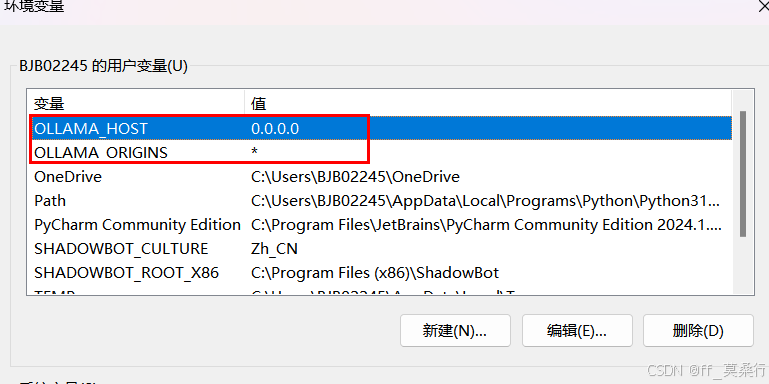

2、配置:在windows

打开环境变量,添加:

OLLAMA_HOST 0.0.0.0

OLLAMA_ORIGINS *

3、重启ollama,返回Chatbox设置界面,重新打开,选择模型为deepseek-r1:1.5b

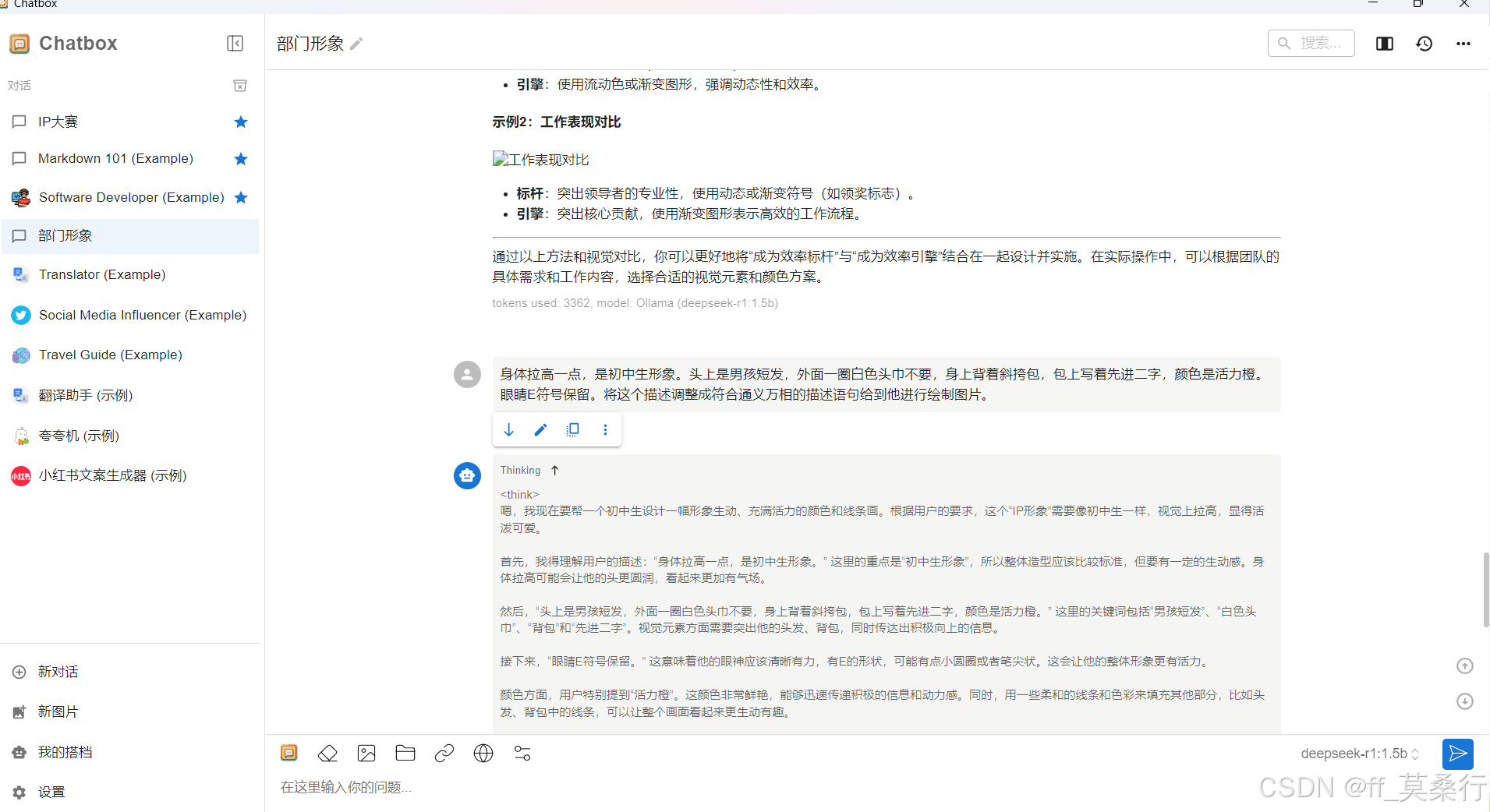

4、可以正常使用对话

小结

使用deepseek-r1模型,需要会使用本地部署,避免因服务器崩溃产生的麻烦,带来更顺畅的体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)