满足个性化需求,手把手教你微调DeepSeek大模型

监督微调(SFT)是在有标签的数据集上对预训练模型进行进一步训练的过程,使其能够专门用于特定任务,如客户支持、医疗问答或电商推荐。

1 引言

DeepSeek LLM性能强大,但要在特定场景发挥最大效能,微调是必不可少的。本文详细讲解如何用Hugging Face数据集和监督微调技术(SFT)对其微调,提供代码实操步骤;还会探讨损失函数、数据子集、低秩适应(LoRA)技术等要点。

实操可借助Google Colab平台:colab.research.google.com 。

2 监督微调(SFT)概述

监督微调(SFT)是在有标签的数据集上对预训练模型进行进一步训练的过程,使其能够专门用于特定任务,如客户支持、医疗问答或电商推荐。

2.1 微调原理

微调基于特定任务的有标签数据训练模型,其中:

-

输入(X):提供给模型的文本数据。

-

目标(Y):根据有标签数据得到的预期输出(例如,情感标签、聊天机器人回复或摘要文本)。

-

损失函数:衡量模型预测与预期输出的匹配程度。文本生成中最常用的损失函数是交叉熵损失。

例如,在IMDB情感数据集上进行微调时:

-

输入(X):像 “这部电影视觉效果很棒,但情节薄弱” 这样的电影评论。

-

目标(Y):正确的标签,比如 “正面” 或 “负面” 情感。

对于文本生成任务,输入可以是一个问题,目标则是模型生成的正确回复。

2.2 交叉熵损失:微调语言模型的 “校准器”

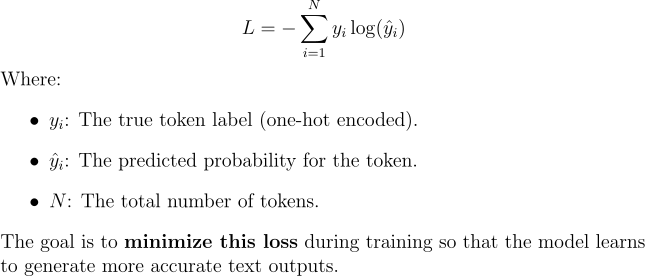

微调语言模型时,交叉熵损失用于衡量模型预测的标记分布与实际目标分布的差异:

训练旨在最小化该损失,让模型预测更贴近实际,进而生成更精准的文本输出,提升在各类文本任务中的性能。

3 选用数据子集的理由

在资源有限的硬件上对像DeepSeek LLM这样的大型语言模型进行微调时,若使用完整数据集(例如包含25,000个样本的IMDB数据集)进行训练,会出现训练时间长、GPU内存不足的问题。

为了缓解这些问题,我们:

-

选数据子集:挑500个样本训练、100个评估,减少数据量,降低硬件负担。

-

保证代表性:子集保留多样特征,维持模型性能。

小数据集能加快实验,同时有效展示微调概念。但生产环境下,想让模型性能更优,还是应该在更强大的基础设施上使用更大的数据集。

4 加载DeepSeek LLM

在微调之前,需要加载DeepSeek LLM并为训练做好准备。

4.1 安装所需库

首先,安装必要的依赖项:

pip install -U torch transformers datasets accelerate peft bitsandbytes

4.2 以4位量化加载模型

我们使用4位量化,使大型模型能够在有限的GPU内存下运行:

from transformers import AutoModelForCausalLM, AutoTokenizer, BitsAndBytesConfig from peft import LoraConfig, get_peft_model model_name = "deepseek-ai/deepseek-llm-7b-base" # 配置4位量化 bnb_config = BitsAndBytesConfig( load_in_4bit=True, bnb_4bit_compute_dtype=torch.float16 # 使用float16以加快计算速度 ) # 加载分词器和模型 tokenizer = AutoTokenizer.from_pretrained(model_name) model = AutoModelForCausalLM.from_pretrained( model_name, quantization_config=bnb_config, device_map="auto" ) # 应用LoRA进行高效内存微调 lora_config = LoraConfig( r=8, # 低秩适应大小 lora_alpha=32, target_modules=["q_proj", "v_proj"], # 将LoRA应用于注意力层 lora_dropout=0.05, bias="none" ) model = get_peft_model(model, lora_config) model.print_trainable_parameters() print("✅ DeepSeek LLM已加载LoRA并采用4位精度!")

5 使用Hugging Face数据集进行训练

进行微调需要高质量的数据集。Hugging Face提供了多种数据集的访问途径:

5.1 选择数据集

在这个示例中,我们使用IMDB数据集对DeepSeek LLM进行情感分类的微调:

from datasets import load_dataset # 加载数据集 dataset = load_dataset("imdb")

5.2 预处理数据集

将文本转换为模型可接受的分词输入:

def tokenize_function(examples): inputs = tokenizer( examples["text"], truncation=True, padding="max_length", max_length=512 ) inputs["labels"] = inputs["input_ids"].copy() return inputs tokenized_datasets = dataset.map(tokenize_function, batched=True) # 为加快实验速度,对数据集进行子集划分 small_train_dataset = tokenized_datasets["train"].shuffle(seed=42).select(range(500)) small_test_dataset = tokenized_datasets["test"].shuffle(seed=42).select(range(100)) # 打印一个分词后的样本条目 print("分词后的样本:") print(small_train_dataset[0])

6 LoRA(低秩适应):大模型微调内存优化 “神器”

大型语言模型微调时,内存利用是难题,LoRA(低秩适应)技术来 “救场”。LoRA 主要靠两手 “绝活”:

-

冻结模型大部分权重,让其在微调时 “按兵不动”;

-

在关键层(如注意力层)引入低秩可训练矩阵,精准优化模型。

这样能大幅削减可训练参数数量,且不影响模型性能。有了 LoRA,在资源受限的 Colab GPU 这类硬件上微调大模型也没问题,给开发者创造了更多可能。

LoRA的工作原理

1)将参数更新分解为低秩矩阵。

2)仅对分解后的矩阵(如注意力投影)应用更新。

3)与全量微调相比,可减少内存和计算成本。

7 代码讲解:微调DeepSeek LLM

7.1 设置训练参数

from transformers import TrainingArguments, Trainer training_args = TrainingArguments( output_dir="./results", evaluation_strategy="epoch", learning_rate=3e-4, # LoRA微调时使用较低的学习率 per_device_train_batch_size=1, # 为提高内存效率,减小批次大小 gradient_accumulation_steps=8, # 模拟更大的批次大小 num_train_epochs=0.5, weight_decay=0.01, save_strategy="epoch", logging_dir="./logs", logging_steps=50, fp16=True# 混合精度训练 )

7.2 初始化训练器

trainer = Trainer( model=model, args=training_args, train_dataset=small_train_dataset, eval_dataset=small_test_dataset, ) print("训练器已初始化!")

7.3 开始微调

print("开始微调...") trainer.train()

7.4 保存微调后的模型

trainer.save_model("./fine_tuned_deepseek") tokenizer.save_pretrained("./fine_tuned_deepseek") print("微调后的模型已成功保存!")

8 大模型训练与优化进阶之路

-

开展生产级训练:前期实验虽用数据子集完成了概念验证和基础微调,但要让模型在实际生产中泛化能力强、性能卓越,就必须用更大数据集。以智能客服模型为例,小规模数据难以应对用户多样问题,而大规模真实交互记录语料库,能帮模型学习更多,满足高并发、多场景需求。

-

探索高级LoRA配置:LoRA现有优势明显,但潜力还很大。后续可研究低秩矩阵维度组合,找到降本提效的最优解;也能结合其他优化技术,比如优化学习率,让模型更快收敛,为复杂任务和大规模模型微调打基础。

推荐书单

《大模型RAG实战:RAG原理、应用与系统构建》

内容简介这是一本全面讲解RAG技术原理、实战应用与系统构建的著作。作者结合自身丰富的实战经验,详细阐述了RAG的基础原理、核心组件、优缺点以及使用场景,同时探讨了RAG在大模型应用开发中的变革与潜力。书中不仅揭示了RAG技术背后的数学原理,还通过丰富的案例与代码实现,引导读者从理论走向实践,轻松掌握RAG系统的构建与优化。无论你是深度学习初学者,还是希望提升RAG应用技能的开发者,本书都将为你提供宝贵的参考与指导。通过阅读本书,你将掌握以下知识:?透彻理解RAG的召回和生成模块算法?高级RAG系统的技巧?RAG系统的各种训练方式方法?深入了解RAG的范式变迁?实战0基础搭建RAG系统?实战高级RAG系统微调与流程搭建

AI大模型学习路线

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

这是一份大模型从零基础到进阶的学习路线大纲全览,小伙伴们记得点个收藏!

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

100套AI大模型商业化落地方案

大模型全套视频教程

200本大模型PDF书籍

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

LLM面试题合集

大模型产品经理资源合集

大模型项目实战合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献158条内容

已为社区贡献158条内容

所有评论(0)