【全网必读】一文读懂deepseek及其本地部署

蓄锐行:我深耕于低空经济领域,同时对IOT技术有着深入的理解,而在AI的探索性研究上,我也已迈出坚实的步伐,虽起步不久,却满怀热情与憧憬。平日里,我热衷于撰写关于低空经济的文章,分享我的见解与思考。对于AI领域,我亦蓄势待发,计划逐步推出相关文章,与众人共探智能之奥秘。

近期,我身处深圳这座创新之城,正积极寻觅低空经济相关的职业机遇,渴望在这片热土上大展拳脚,施展我的才华与抱负。然而,至今仍未遇那识马的“伯乐”,但我并未因此气馁。我将继续坚持撰写博客,用文字记录我的探索与成长,直到那一天,那位能赏识我、与我并肩同行的“伯乐”出现。

前言

注:很多粉丝私信希望我可以出一篇通用的deepseek本地部署的文章,所以它来了!!!

DeepSeek,全称是杭州深度求索人工智能基础技术研究有限公司,是中国的一家创新型科技公司,成立于2023年7月17日,使用数据蒸馏技术 ,得到更为精炼、有用的数据,专注于开发先进的大语言模型(LLM)和相关技术,以下是软件管家对DeepSeek的详细介绍:

一、准备条件

1.首先,你需要有一台电脑,本文以Windows系统为例,需要注意系统Win10及以上。

2.其次,你需要有一个稳定的网络,后续会涉及到下载模型,根据模型选择不同可能会有较多的流量消耗。

二、安装ollama

Ollama是一个开源框架,专为简化大型语言模型(LLM)在本地机器上的部署和运行而设计。它通过将模型权重、配置和数据打包为Modelfile,优化了LLM的设置和配置过程,使得非专业用户也能方便地管理和运行这些模型。Ollama支持多种LLM,并提供跨平台支持,用户可以通过简单的命令行操作或API来启动和运行模型。它在文本生成、翻译、问答系统和代码生成等多个应用场景中具有广泛的应用价值。

2.1 下载ollama

A)方式1- -到本人网盘链接下载(国内网络即可,不卡顿)

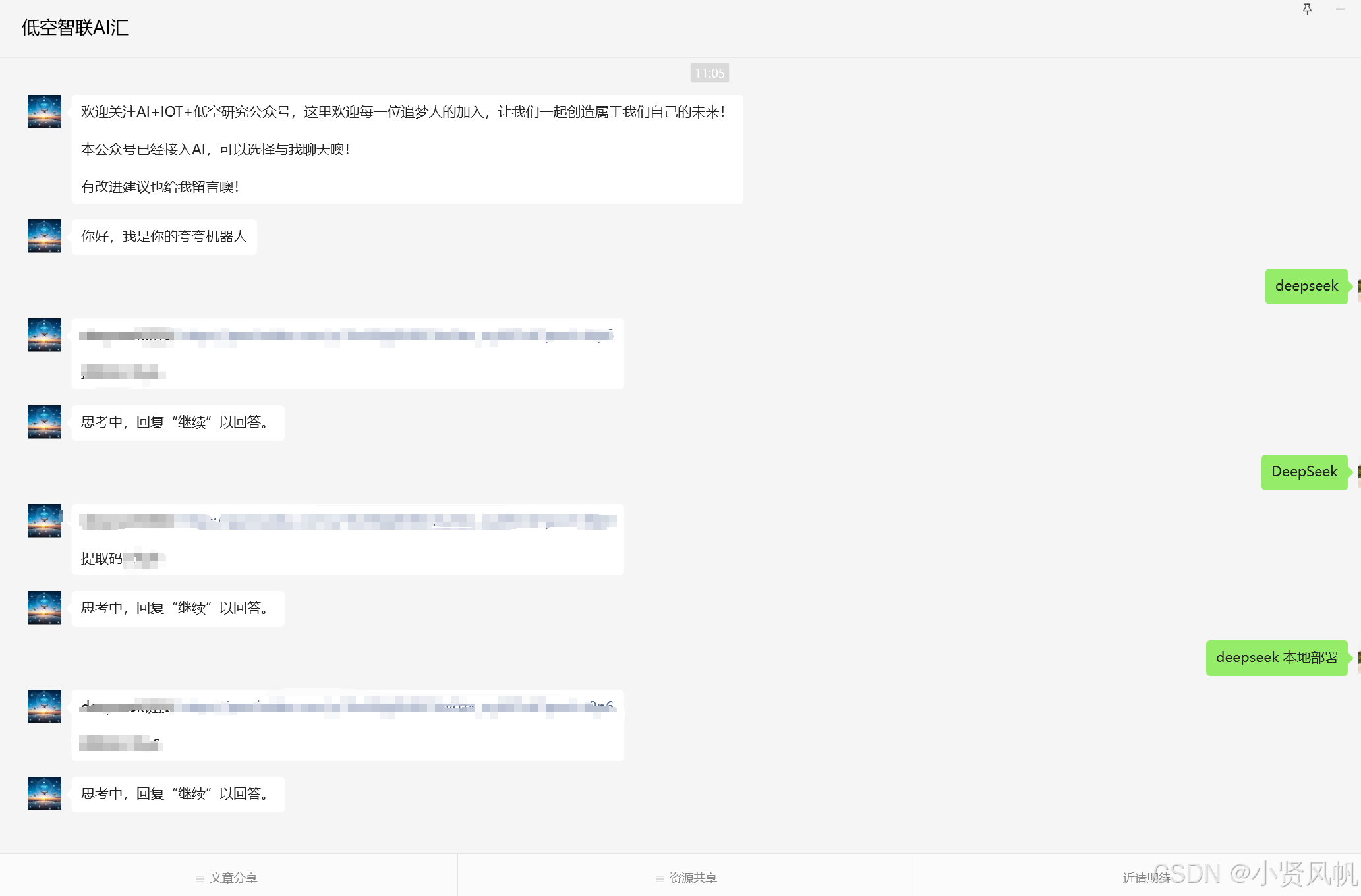

①请关注公众号:低空智联AI汇,发送关键字–deepseek

温馨提示:关注公众号的方式还有另外一个好处,后续会上新功能,欢迎大家体验

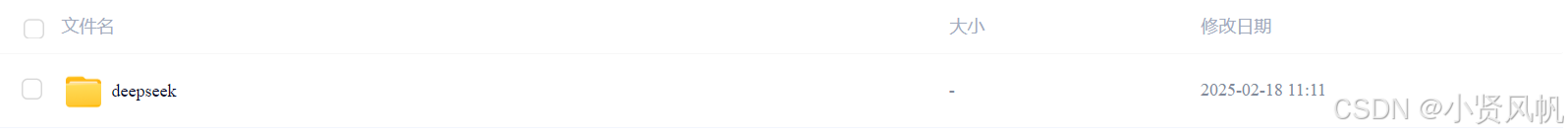

②点击打开链接,下载文件夹

B)方式2- -到官网下载(极其卡顿)

①首先上链接,ollama官网

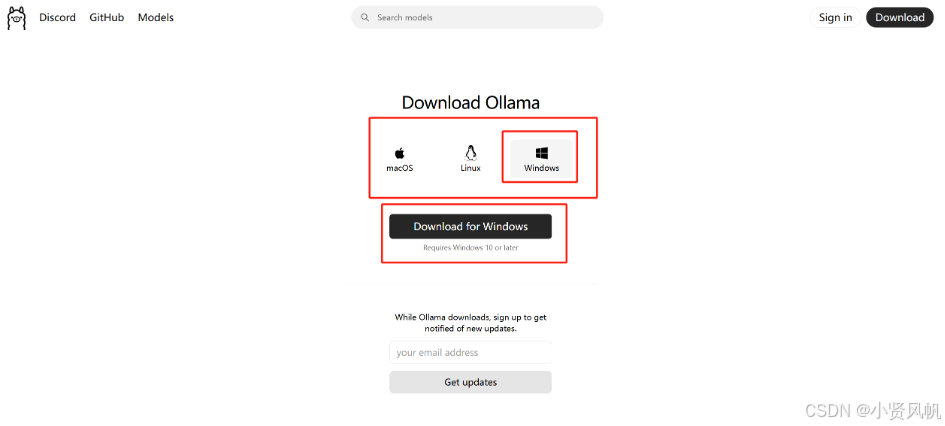

②先进入官网,点击图中的 Download 按钮。

③选择对应的系统版本,这里以Windows为例,选择后点击Download for Windows

按钮,就会在浏览器生成下载任务。

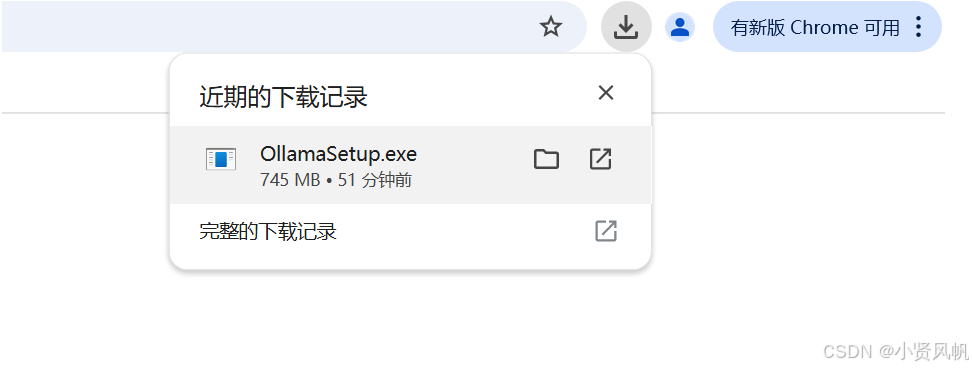

④正常情况会进入GitHub项目页,然后生成下载任务,等待下载即可

温馨提示:这里肯定有小伙伴要问了,我点了没反应或者跳转不成功怎么办。国内部分地方网络可能会被限制,所以我们有另外的解决方法,就是用上面方式1

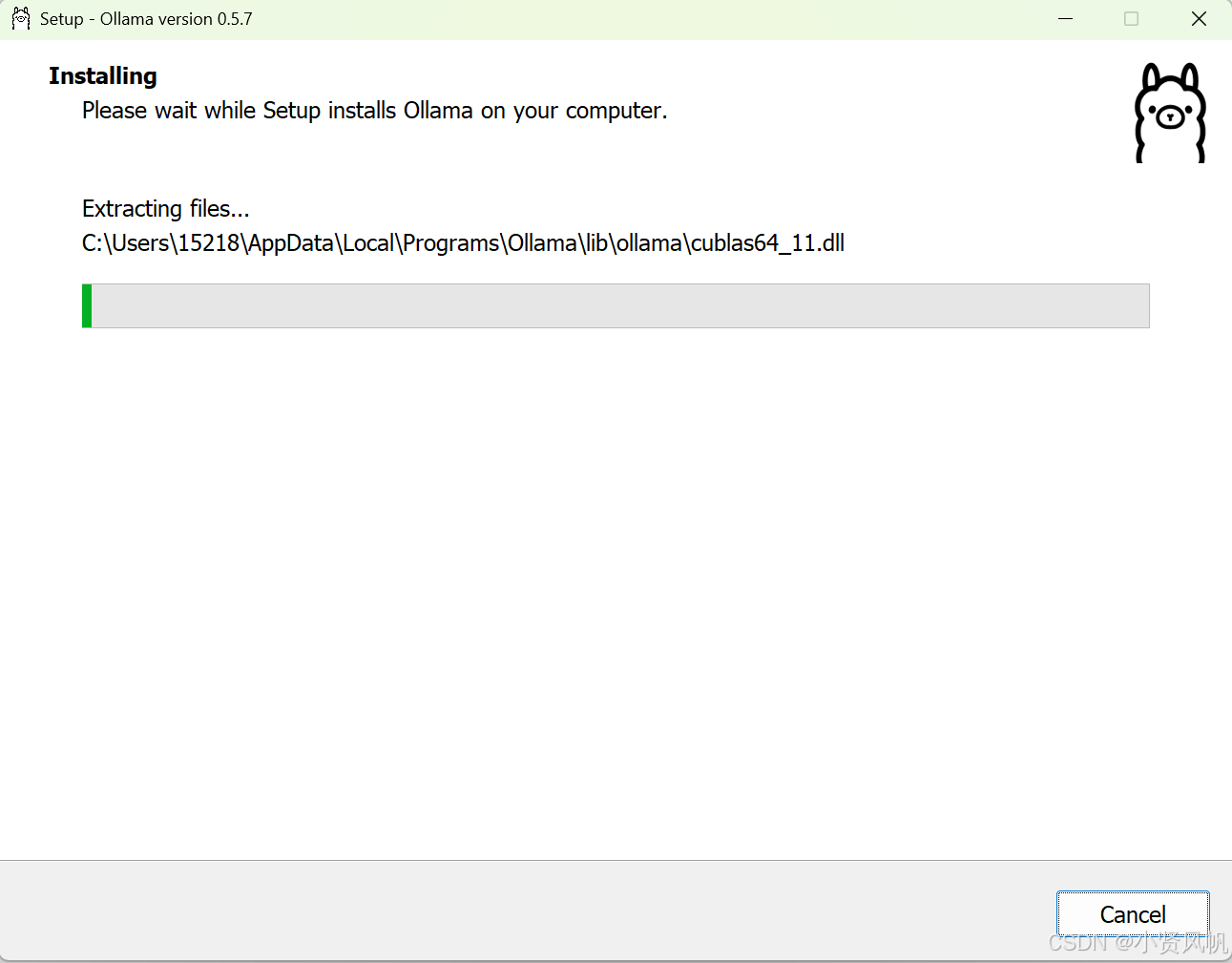

2.2 安装ollama

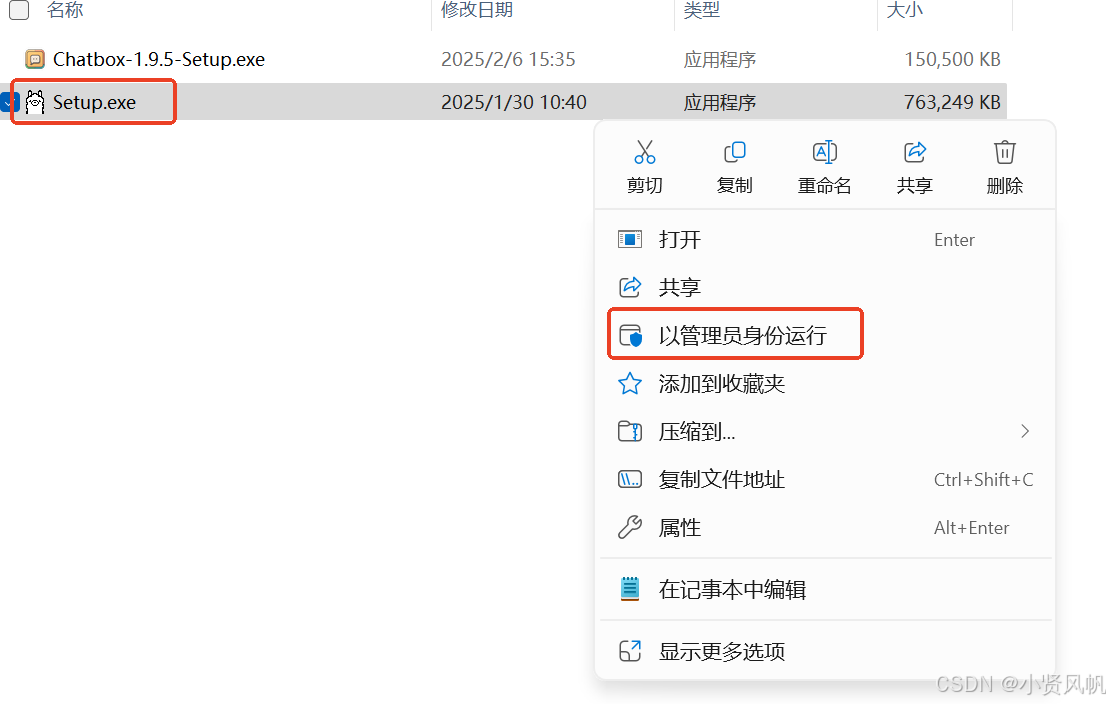

①鼠标选择Setup.exe,点击鼠标右键,选择终端管理员

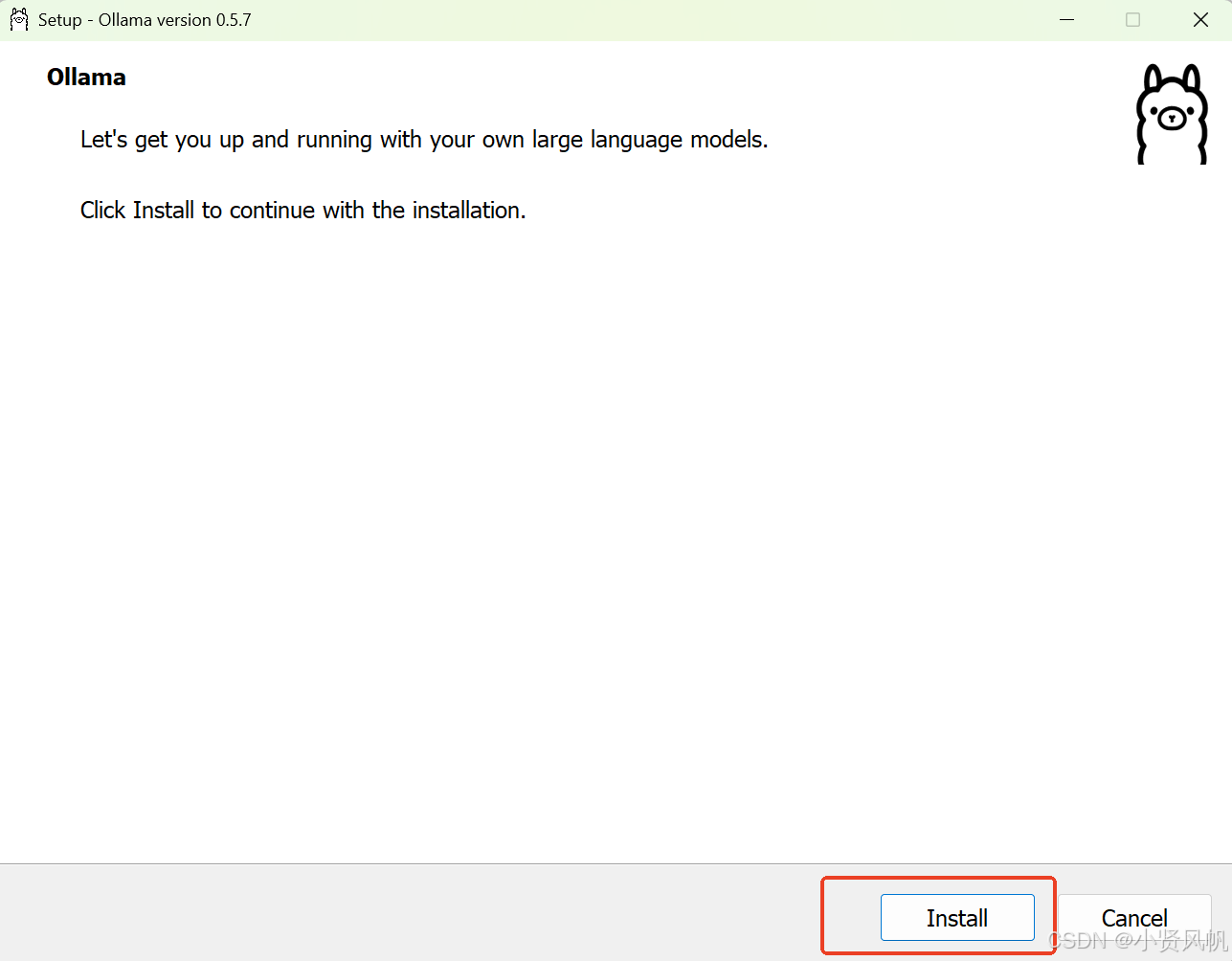

②鼠标选择install ③默认只能装C盘,请等待

③默认只能装C盘,请等待

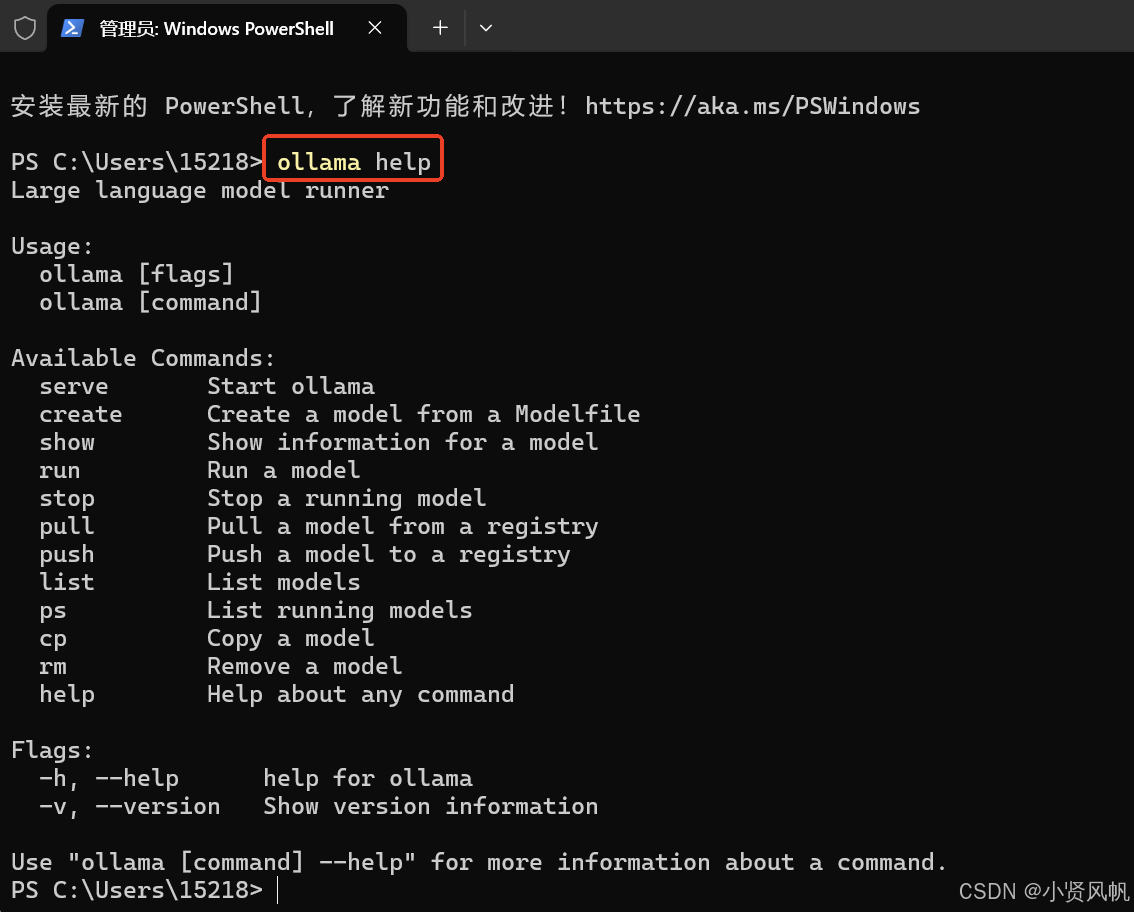

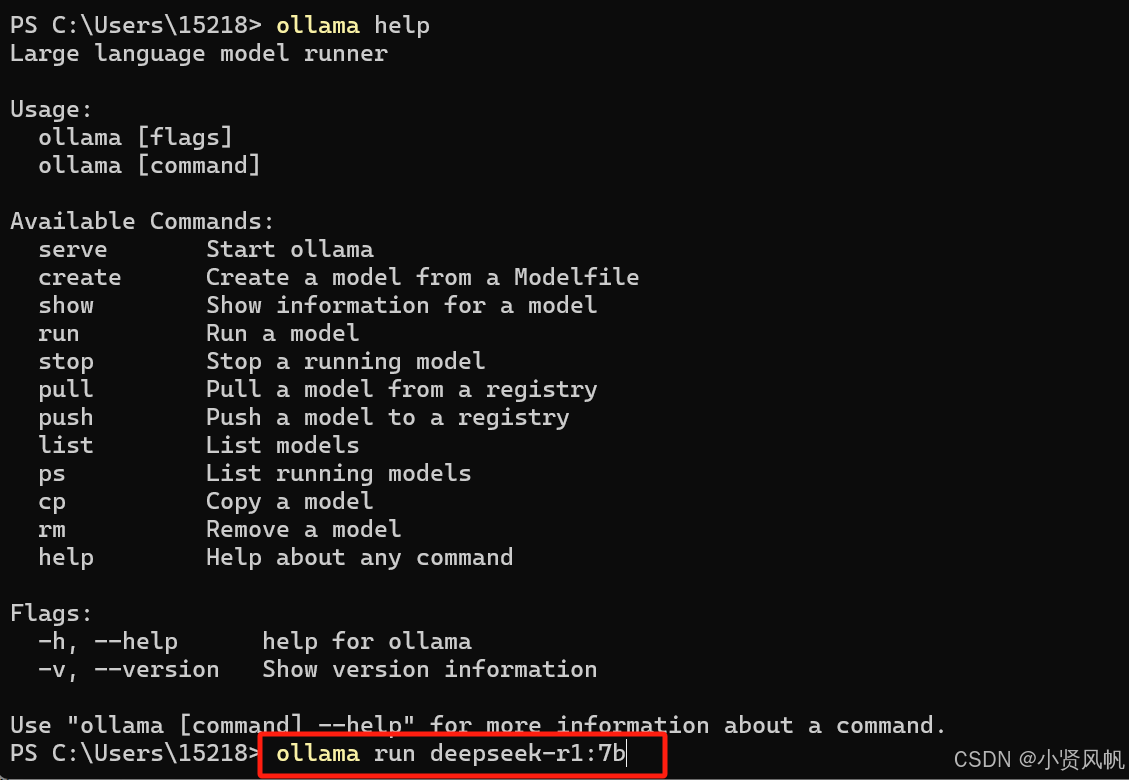

2.3 检查ollama安装是否完成

①鼠标选择window图标,点击鼠标右键,选择终端管理员

②在命令终端输入ollama help,查看ollama是否装好(如果没有,请去配置path,或者私信我)

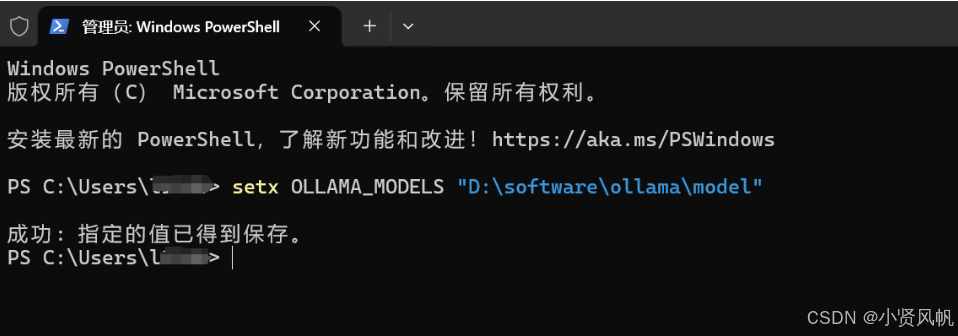

2.4 配置ollama模型存储位置(选择看)

前面提高模型安装位置一般默认C盘,其实也是可以改的。用以下指令就该即可,地址改成你配置的地址,配置完成后记得重启下ollama服务和终端

setx OLLAMA_MODELS "D:\software\ollama\model"

三、部署AI模型(Deepseek)

3.1 选择模型

①模型版本与电脑性能匹配

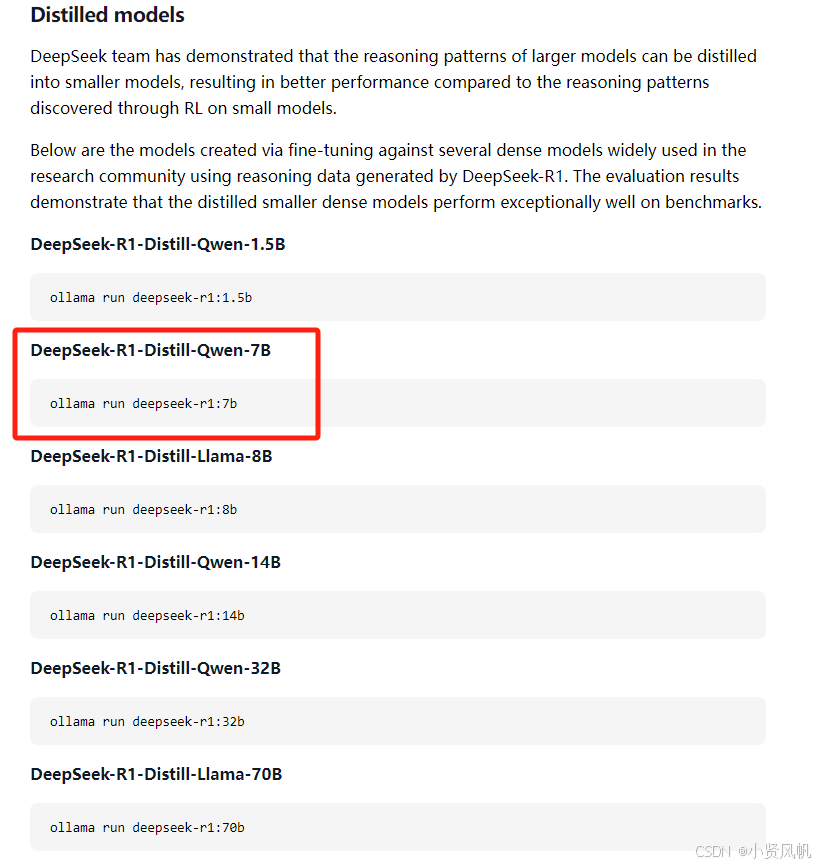

模型版本及部署命令:

模型版本:1.5b(需要1.1GB空余空间), 模型命令:【ollama run deepseek-r1:1.5b】

模型版本: 7b(需要4.7GB空余空间), 模型命令:【ollama run deepseek-r1:7b】

模型版本: 8b(需要4.9GB空余空间), 模型命令:【ollama run deepseek-r1:8b】

模型版本: 14b(需要9GB空余空间), 模型命令:【ollama run deepseek-r1:14b】

模型版本: 32b(需要20GB空余空间), 模型命令:【ollama run deepseek-r1:32b】

模型版本: 70b(需要43GB空余空间), 模型命令:【ollama run deepseek-r1:70b】

模型版本:6 71b(需要404GB空余空间),模型命令:【ollama run deepseek-r1:671b】

模型对应的配置说明:1.5B、7B、8B、14B、32B、70B是蒸馏后的小模型,671B是基础

大模型,它们的区别主要体现在参数规模、模型容量、性能表现、准确性、训练成本、推

理成本和不同使用场景:671B参数数量最多,模型容量极大,能够学习和记忆海量的知识

与信息,对各种复杂语言模式和语义关系的捕捉能力最强。如果电脑内存为4G,建议你使

用1.5B模型,内存16G,可以使用1.5B、7B、8B、14B等模型,以此类推。

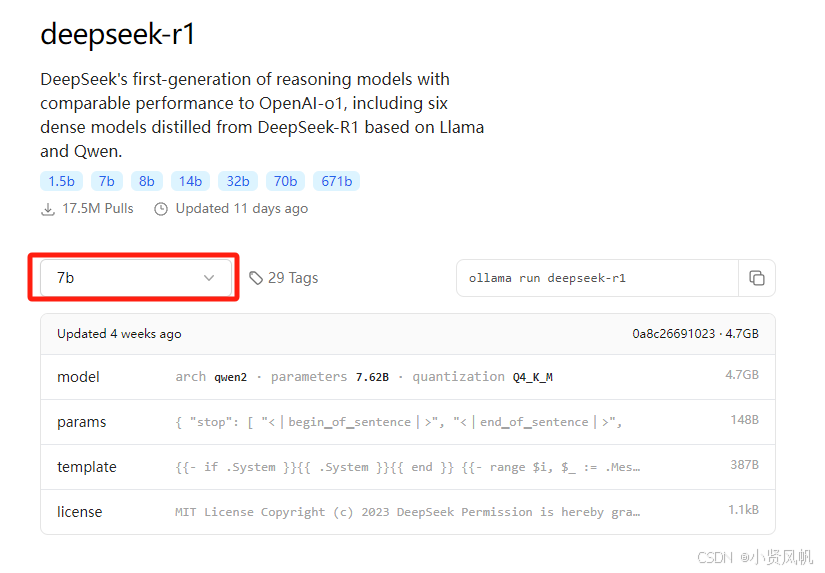

②打开ollama官网下载模型,本人装的是7b

选择模型版本(如:模型版本:1.5b,注意需要的空间和电脑配置),

点击右上角【Download】。

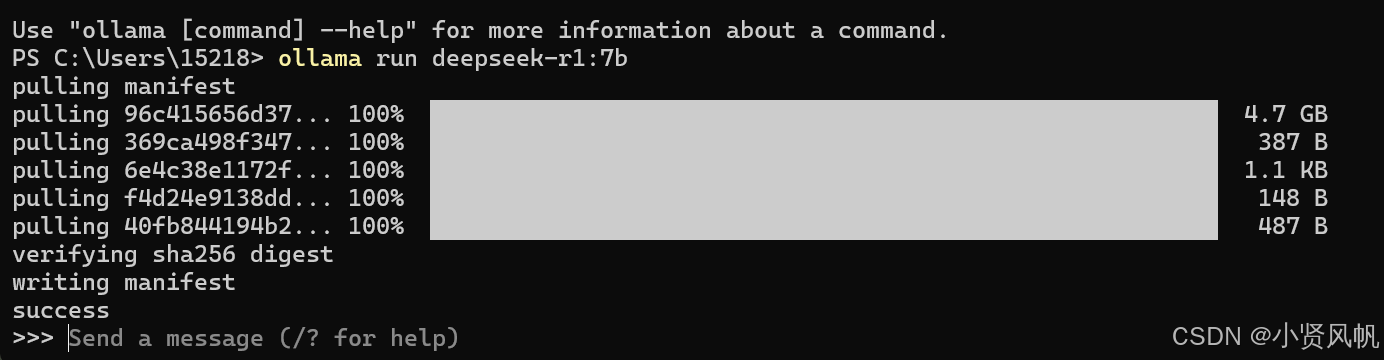

3.1 安装模型

①在命令终端输入ollama run deepseek-r1:7b

②等待下载完成即可

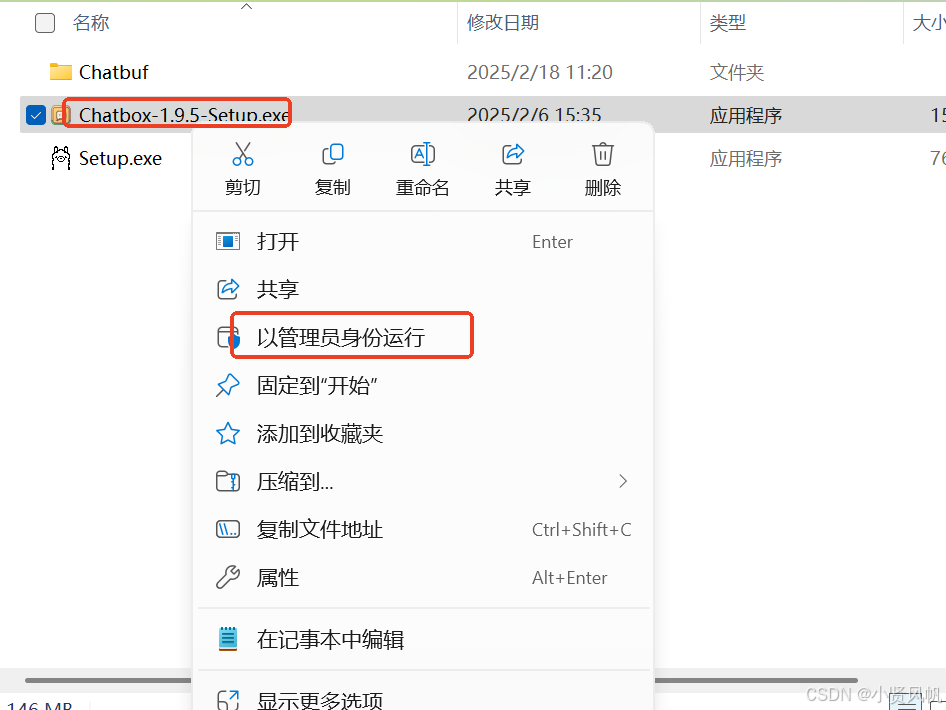

四、安装聊天软件盒子(Chatbox)

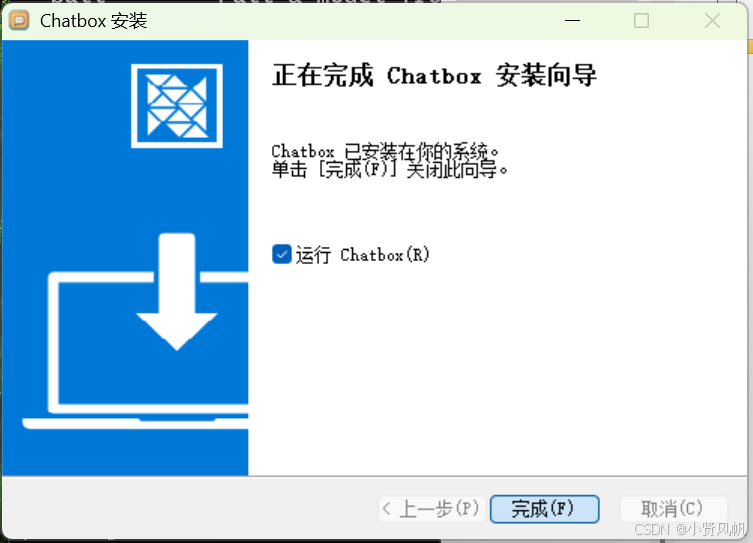

4.1 安装Chatbox

①选择Chat-1.9.5-Setup.exe,以管理身份运行

②等待安装完成

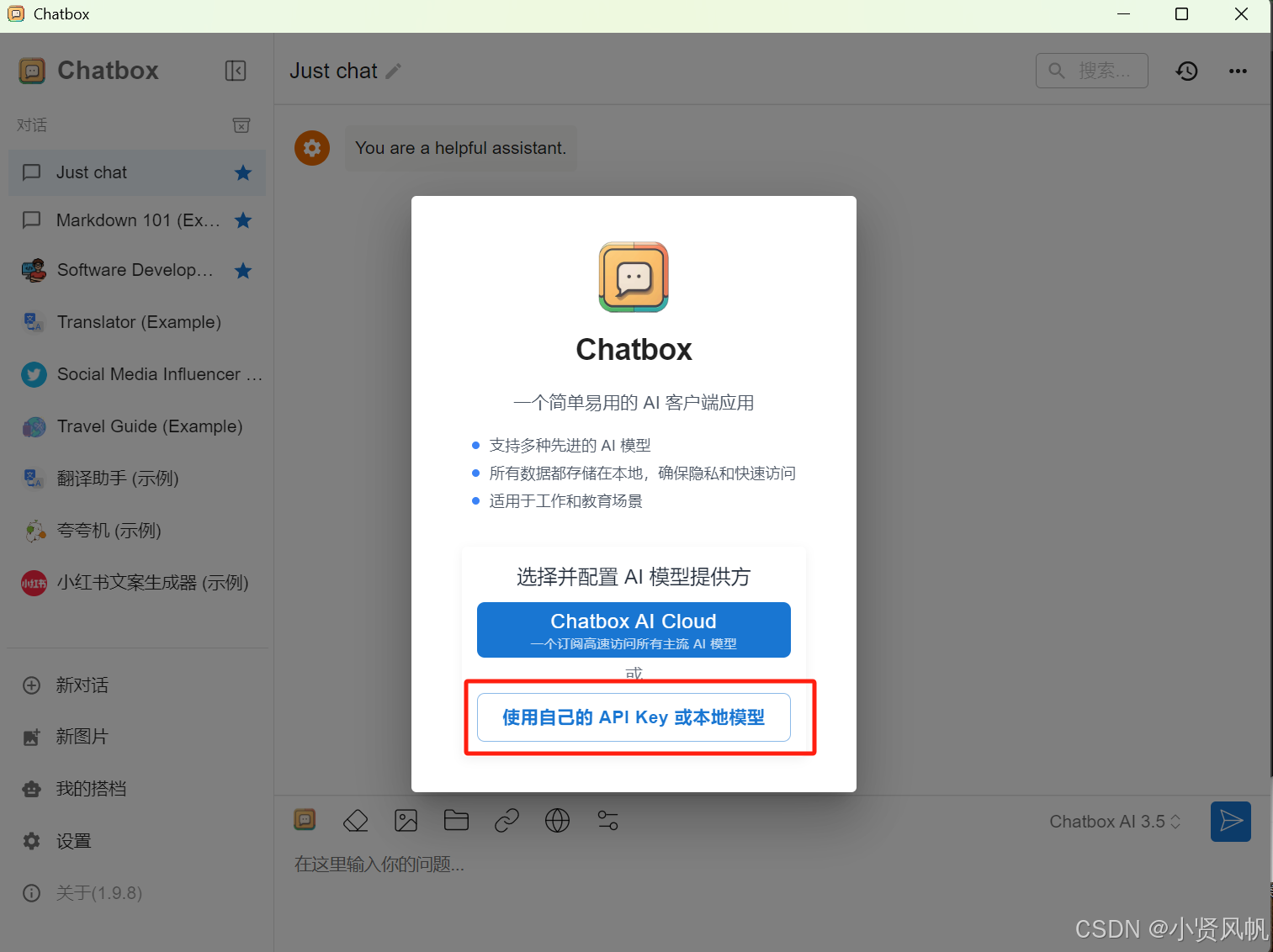

4.2 配置ChatBox

①以管理员身份打开Chatbox,点击使用自己的API Key或本地模型

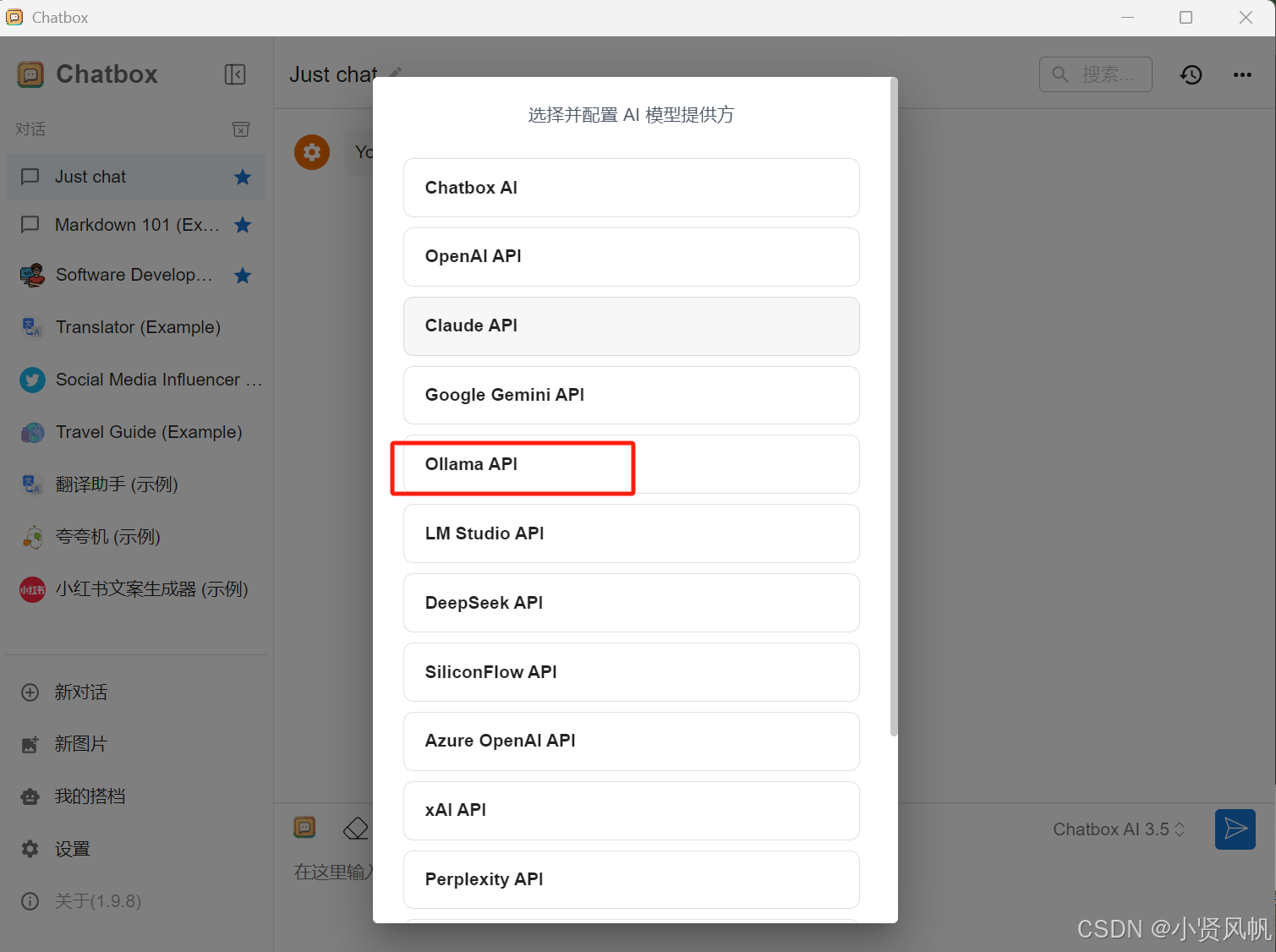

②选择Ollama API

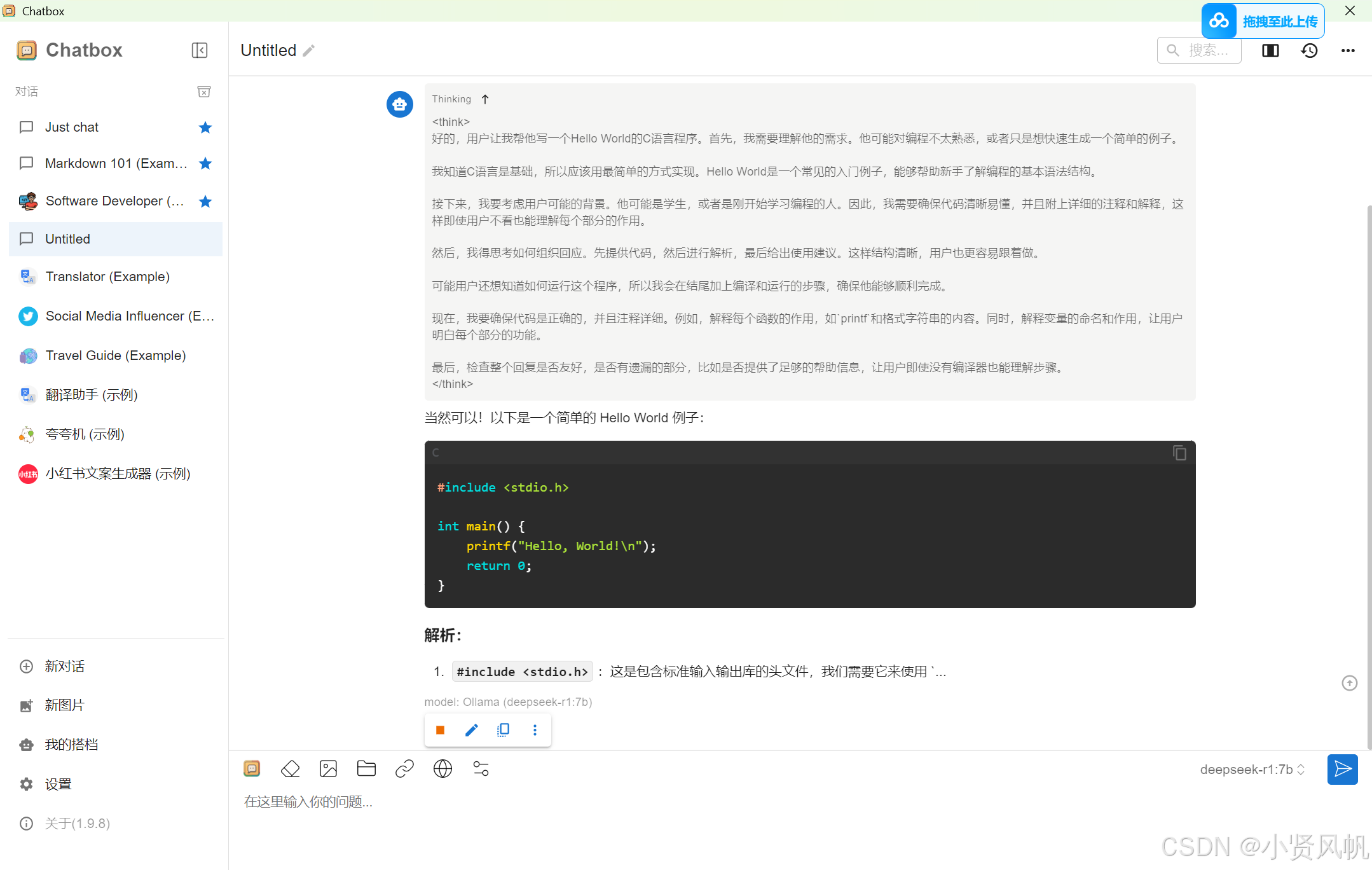

③选择模型

4.3 正常使用ChatBox

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)