DeepSeek + Ollama + AnythingLLM 本地部署,打造个人专属知识库

通过以上步骤,你可以在本地快速部署一个专属的知识库,利用 DeepSeek、Ollama 和 AnythingLLM 的强大功能,实现高效的知识管理和问答。无论是个人学习还是企业办公,这样的本地知识库都能为你带来极大的便利。如果你在部署过程中遇到任何问题,欢迎在评论区留言交流。希望这篇文章能帮助你迈出探索本地 AI 的第一步,开启无限可能!

一、为什么需要部署本地知识库

本来10分钟就能搞定的DeepSeek + Ollama + AnythingLLM 本地部署,由于Ollama服务器在国外,以及首次部署,自己也是一直在摸索中,硬是捣腾了2个小时。为了让其他人不走我的弯路,所以把完整的部署步骤和软件均记录一下,方便有共同需求的同学。废话不多说了,先上成果图。

我的本地知识库

在数字化时代,知识的管理和高效利用是提升个人和企业竞争力的关键。之前我有很多种管理个人知识的方法,但是最后发现数据量越来越大,需要的数据越来越难找,用起来效率非常低,最后都不了了之了。

1、浏览器收藏夹/知乎收藏夹/微信收藏

知乎收藏夹

2、微信/抖音转发至自己

抖音上给自己发的有用视频

3、网络知识库工具:印象笔记/有道笔记/语雀

网络知识库,还是好用过一段时间

初次之外,还有本地保存的文件,硬盘保存的文件,就看到占用的空间越来越大,从10G到100G到500G到1T,可是很多资料就像被埋的宝藏,自己什么时候埋的、埋在哪儿都忘记了。

所以,建立个人本地的小型AI知识库,尤其是涉及到保密的工作内容时,还是非常有必要的。

DeepSeek、Ollama 和 AnythingLLM 这三种工具的结合,为我们提供了一个强大的解决方案,可以在本地轻松部署一个专属的知识库。以下是一份详细的本地部署指南,帮助你快速上手。

二、为什么选择 DeepSeek + Ollama + AnythingLLM组合

选择 DeepSeek + Ollama + AnythingLLM 组合的主要原因在于其强大的功能互补性、高效性和安全性,能够满足用户在本地构建高效、安全且个性化的知识管理系统的需求。以下是具体选择理由:

1、数据安全与隐私保护

- 本地运行:Ollama 和 DeepSeek 支持本地化部署,所有数据和模型运行都在本地完成,无需上传到云端,从而有效降低数据泄露风险。

- 隐私保护:AnythingLLM 默认存储和运行在本地,进一步确保用户数据的隐私。

2、高性能与低延迟

- 高效推理:DeepSeek 模型在逻辑推理和复杂自然语言任务上表现出色,能够提供高质量的回答。

- 低延迟:本地运行显著减少了网络传输时间,适合对实时性要求较高的场景。

3. 强大的知识管理能力

- 多数据源整合:AnythingLLM 可以连接各种数据源,如本地文件、网页链接等,并将这些数据整合成一个可查询的知识图谱。

- 智能检索:通过向量检索技术,AnythingLLM 能够精准匹配用户查询,快速从知识库中提取相关信息。

4. 易用性与灵活性

- 简单部署:Ollama 提供了简单直观的命令行操作,用户可以轻松拉取、运行和管理模型。

- 多模型支持:AnythingLLM 支持多种主流模型(如 DeepSeek、OpenAI 等),用户可以根据需求灵活切换。

- 图形化界面:AnythingLLM 提供了友好的用户界面,方便用户进行配置和管理。

5. 成本效益

- 开源免费:Ollama 和 DeepSeek 均为开源工具,用户可以免费使用和定制。

- 低硬件要求:相比商业 LLM,Ollama 对硬件资源的要求较低,即使在普通笔记本电脑上也能流畅运行。

6. 技术创新与多模态支持

- 前沿技术:DeepSeek 采用了多项前沿技术,如混合专家模型(MoE)、多头潜在注意力(MLA)等,增强了模型处理复杂任务的能力。

- 多模态能力:DeepSeek 支持处理文本、图像等多种数据类型,适用于多种应用场景。

7. 高度可定制

- 定制化:用户可以根据需求对模型和数据进行个性化调试,满足特定业务需求。

- API 支持:AnythingLLM 提供了丰富的 RESTful API,方便与其他系统集成。

8. 社区支持

- 活跃社区:Ollama 拥有庞大且活跃的社区,用户可以轻松获取帮助、分享经验和参与模型开发。

所以,本地部署,采用DeepSeek + Ollama + AnythingLLM 组合能够充分发挥各组件的优势,为用户提供一个高效、安全且易于使用的本地知识管理系统,特别适合对数据隐私要求较高的用户和小团队。

三、部署步骤

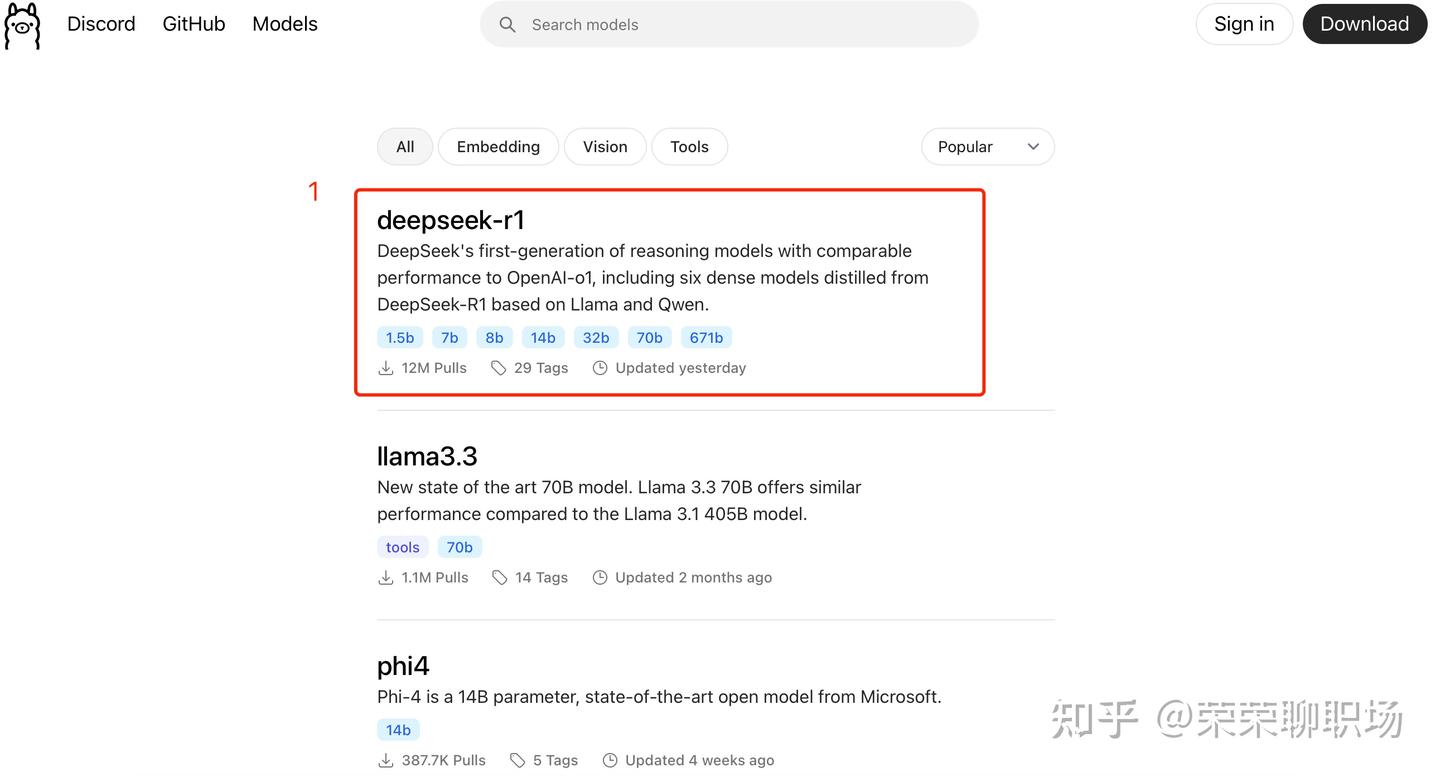

1、Ollama 本地化部署 DeepSeek R1

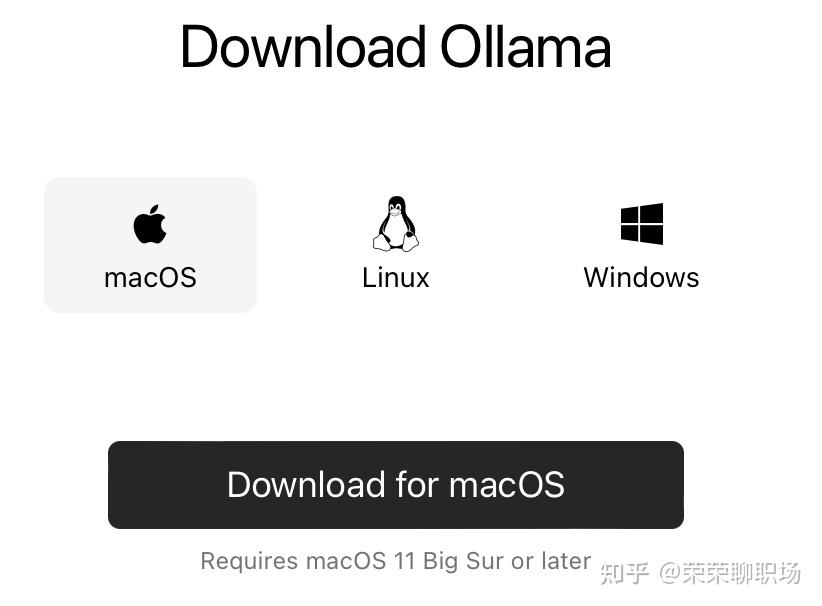

(1)下载 Ollama

- 访问 Ollama 官网:https://ollama.com/

根据你的操作系统(Windows、MacOS 或 Linux)选择对应的安装包进行下载。

若下载有问题,可私信我给大家网盘链接

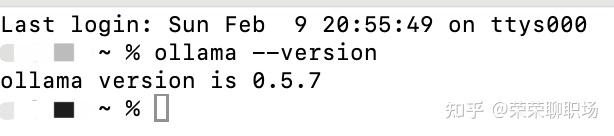

(2)安装 Ollama

- 下载完成后,运行安装程序,按照提示完成安装。

- Windows:直接安装.exe文件,一步一步安装完毕即可。

- Mac:将文件下载后,直接将Ollama程序拉到应有程序文件夹即可。

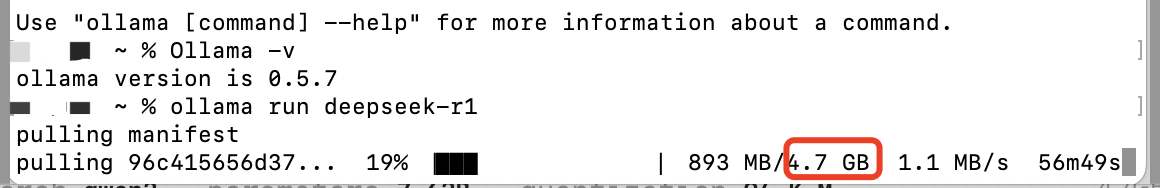

- 安装完成后,打开终端或命令提示符,输入以下命令来检查 Ollama 是否安装成功:ollama --version。如果显示版本信息,说明安装成功。

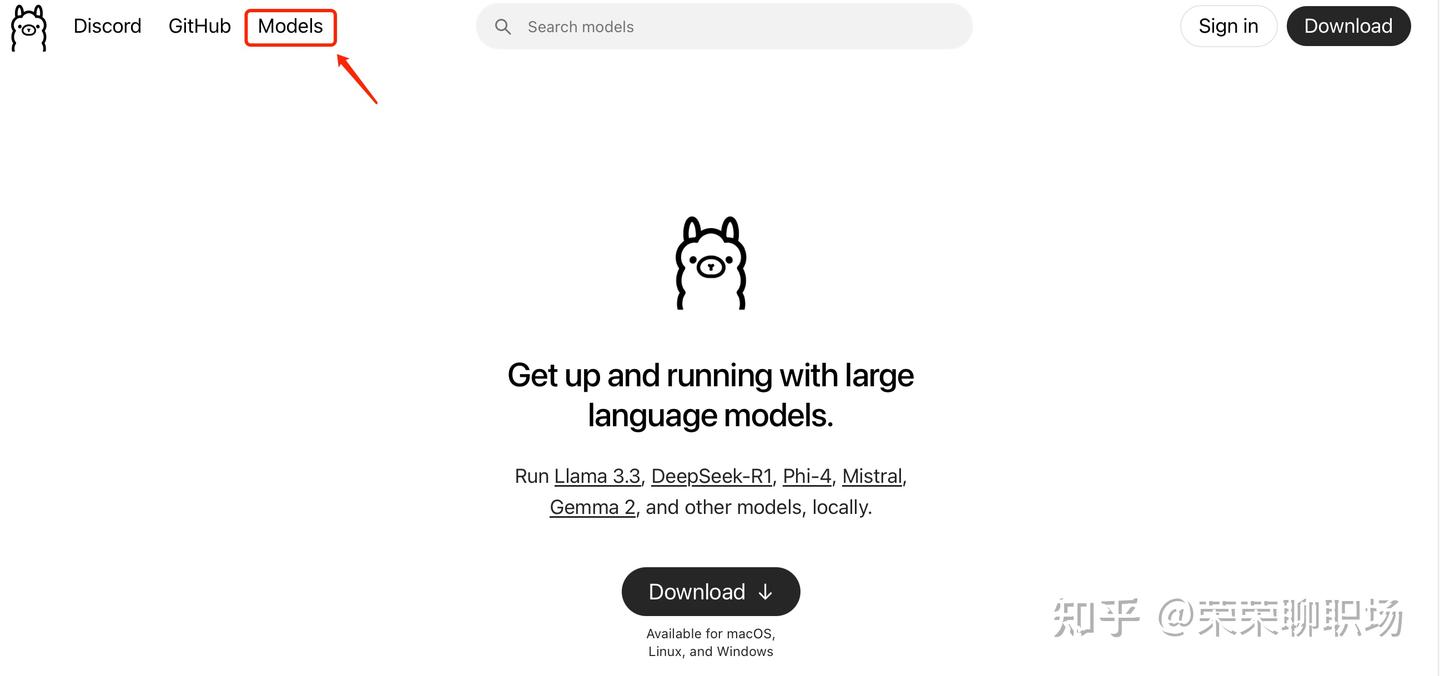

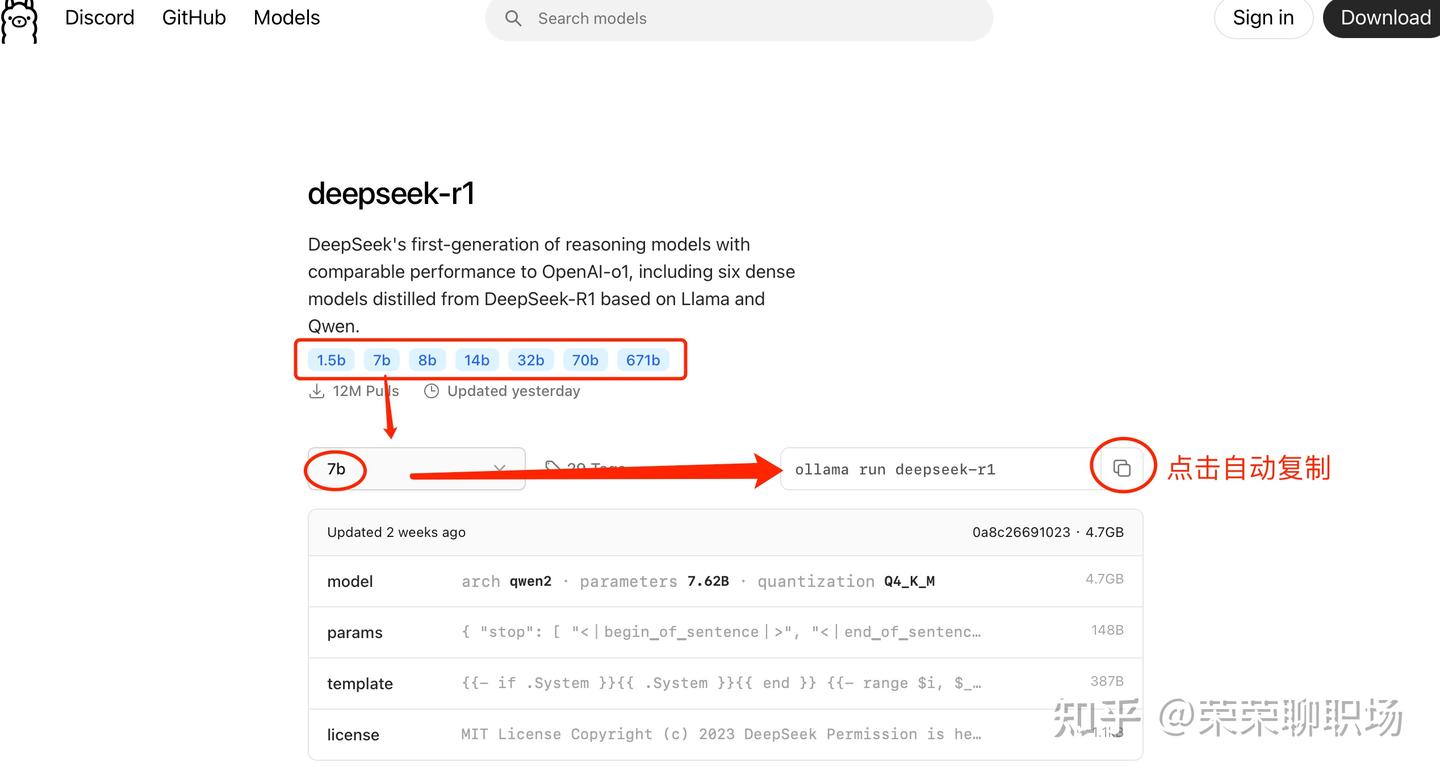

3、下载并运行 DeepSeek 模型

- 进入Ollama网站,选择需要的模型,此处我们选择7b 的DeepSeek R1 模型

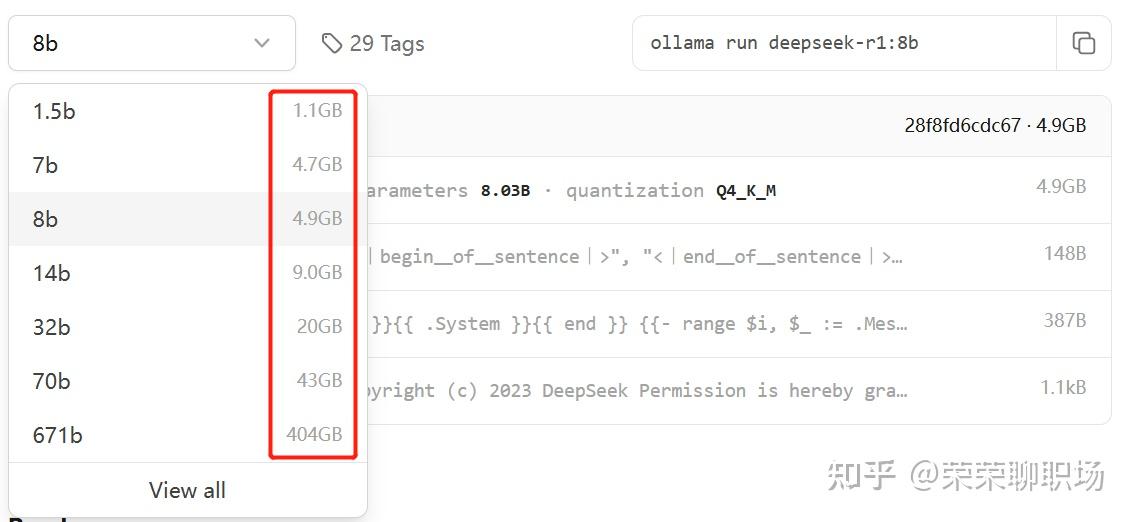

参数量对应的存储空间

不同参数量对应所需GPU的要求(推荐)

- 选择的模型参数量越大,模型越聪明,回答的问题越精准,但是需要的存储空间越大,越吃GPU。

7b的对应的4.7G

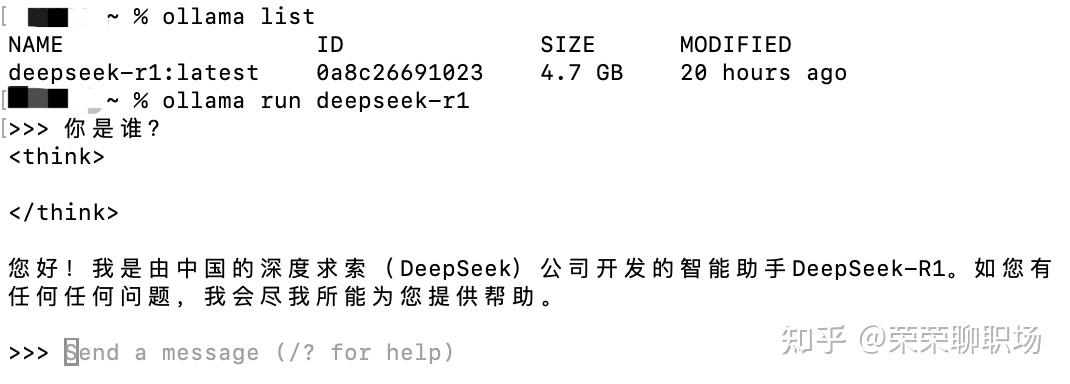

安装完后,就可以在终端开始问话了。

安装完成,测试OK

5、常用 Ollama 命令

列出本地可用的模型列表:ollama list

启动模型:ollama run model_name

查看模型信息:ollama show model_name

删除指定模型:ollama rm model_name

2、部署 AnythingLLM

(1)下载安装 AnythingLLM

- 访问 AnythingLLM 官网:https://anythingllm.com/desktop

- 根据你的操作系统选择对应的安装包进行下载。

- 安装完成后,打开软件,它会自动跳转到 AnythingLLM 界面。

(2)配置模型

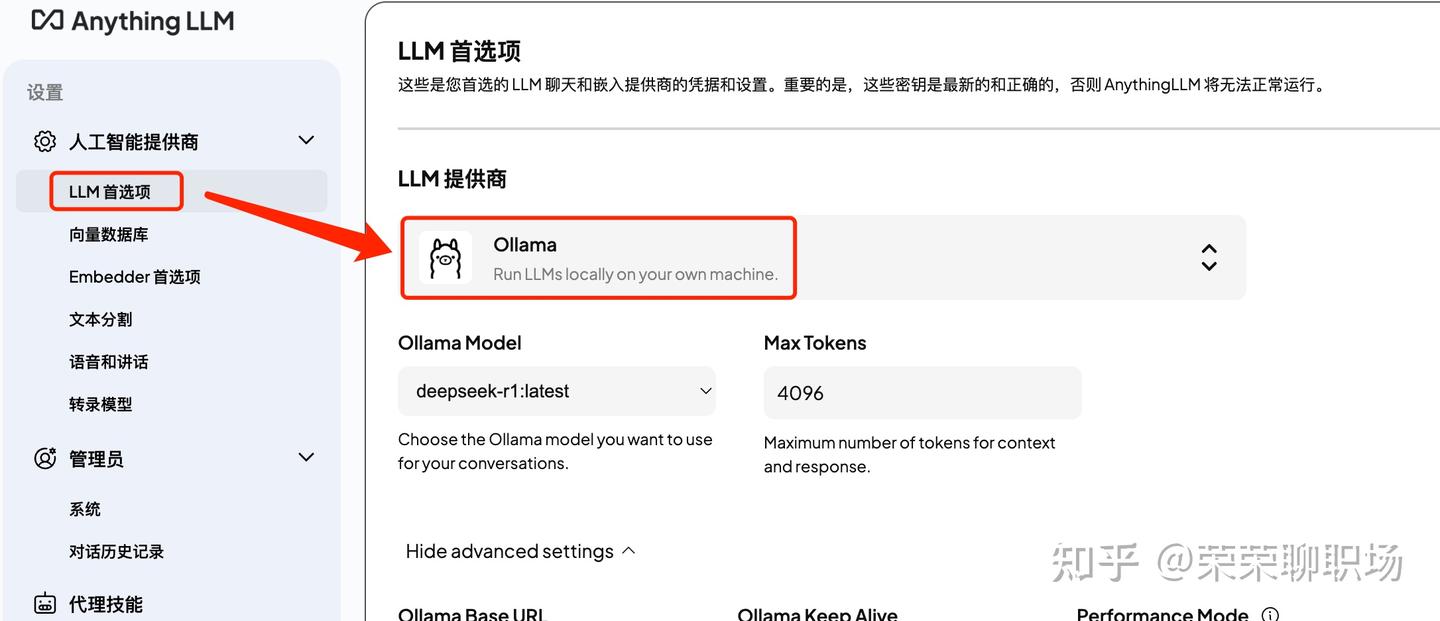

在 AnythingLLM 界面中,选择 Ollama 作为模型来源。

确保 Ollama 本地部署的模型正常运行,AnythingLLM 会自动检测到本地的 DeepSeek 模型。

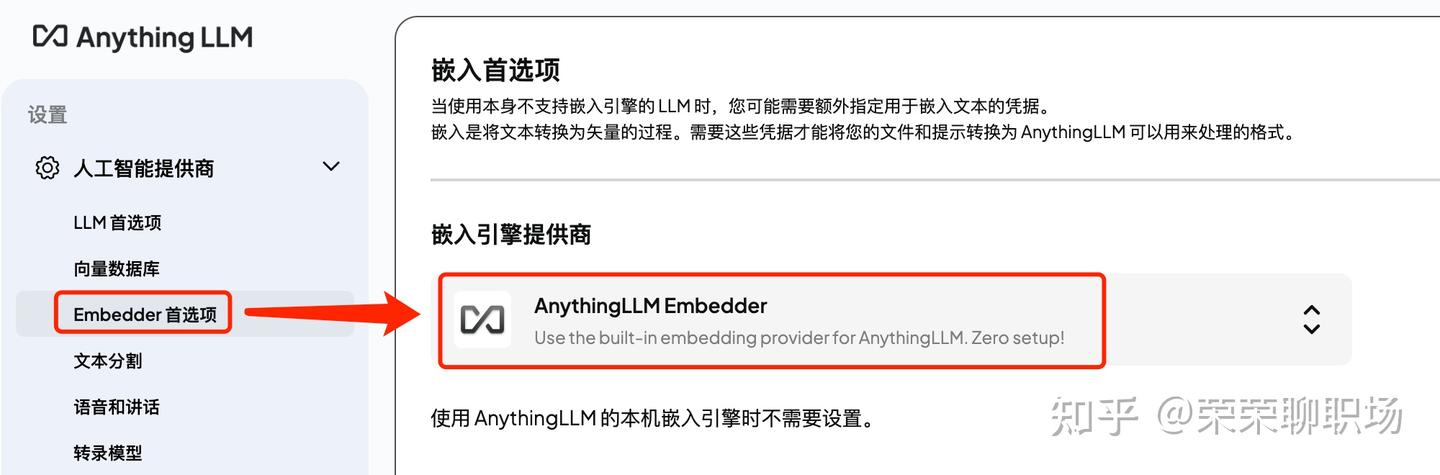

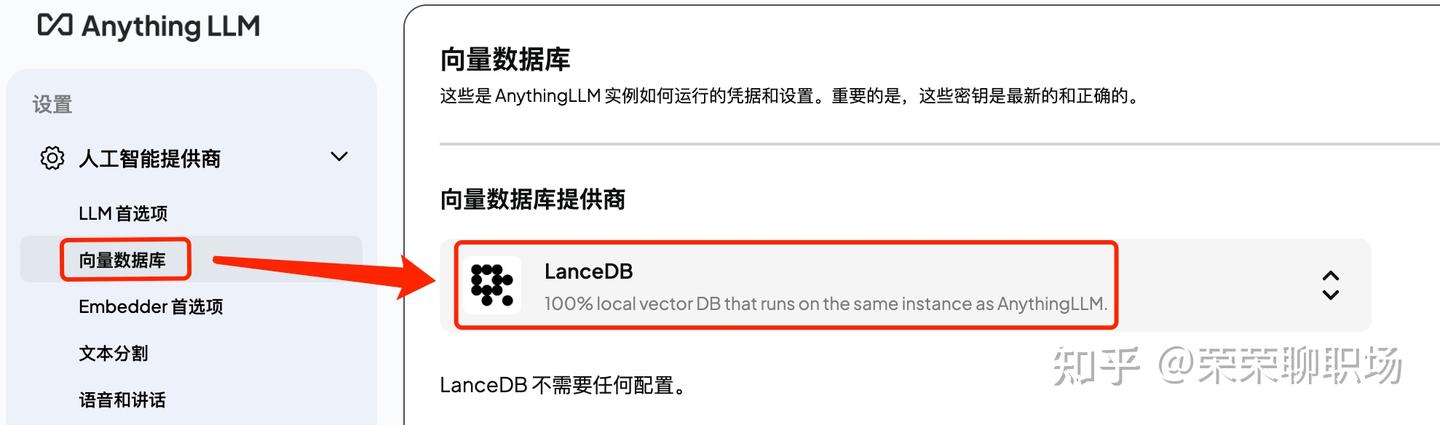

配置以下选项:

- LLM Selection(大语言模型选择):选择 Ollama。

- Embedding Preference(嵌入偏好):选择 AnythingLLM Embedder。

- Vector Database(向量数据库):选择 LanceDB。

3、创建知识库

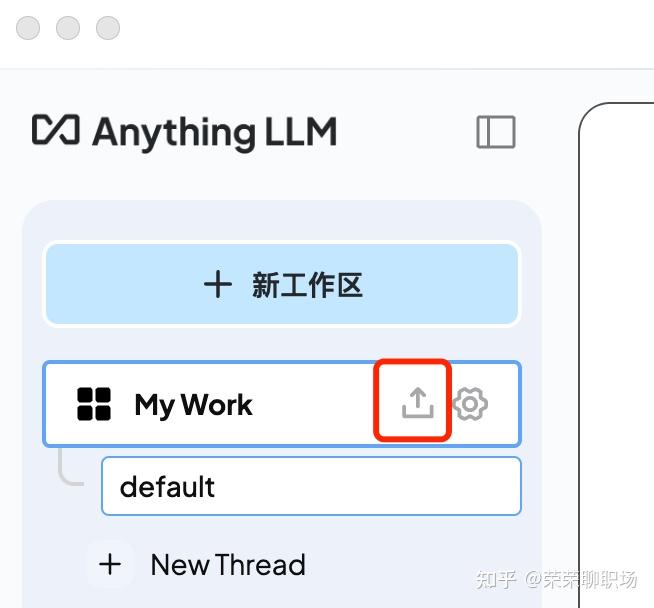

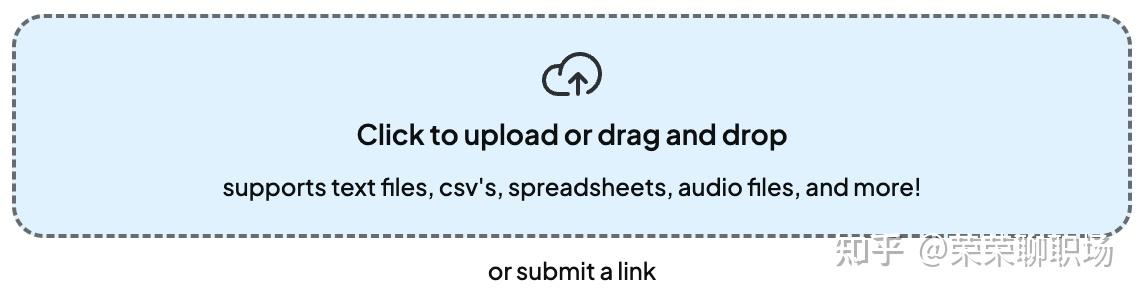

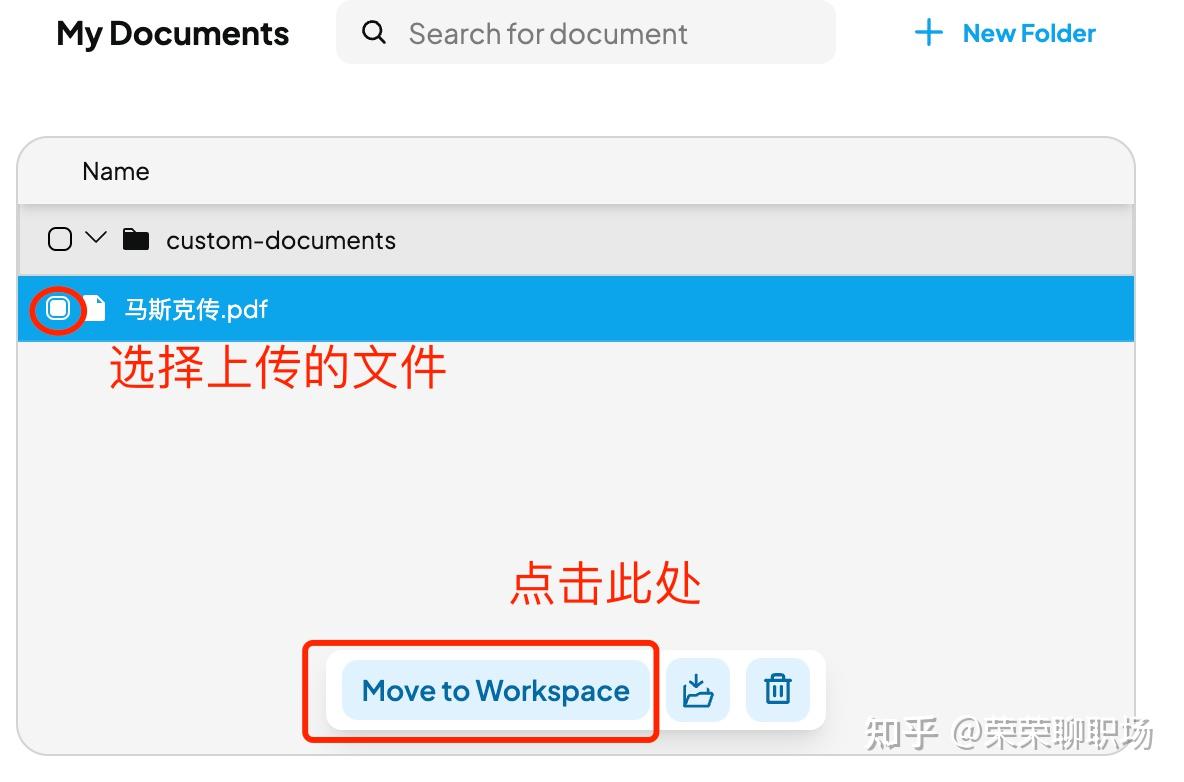

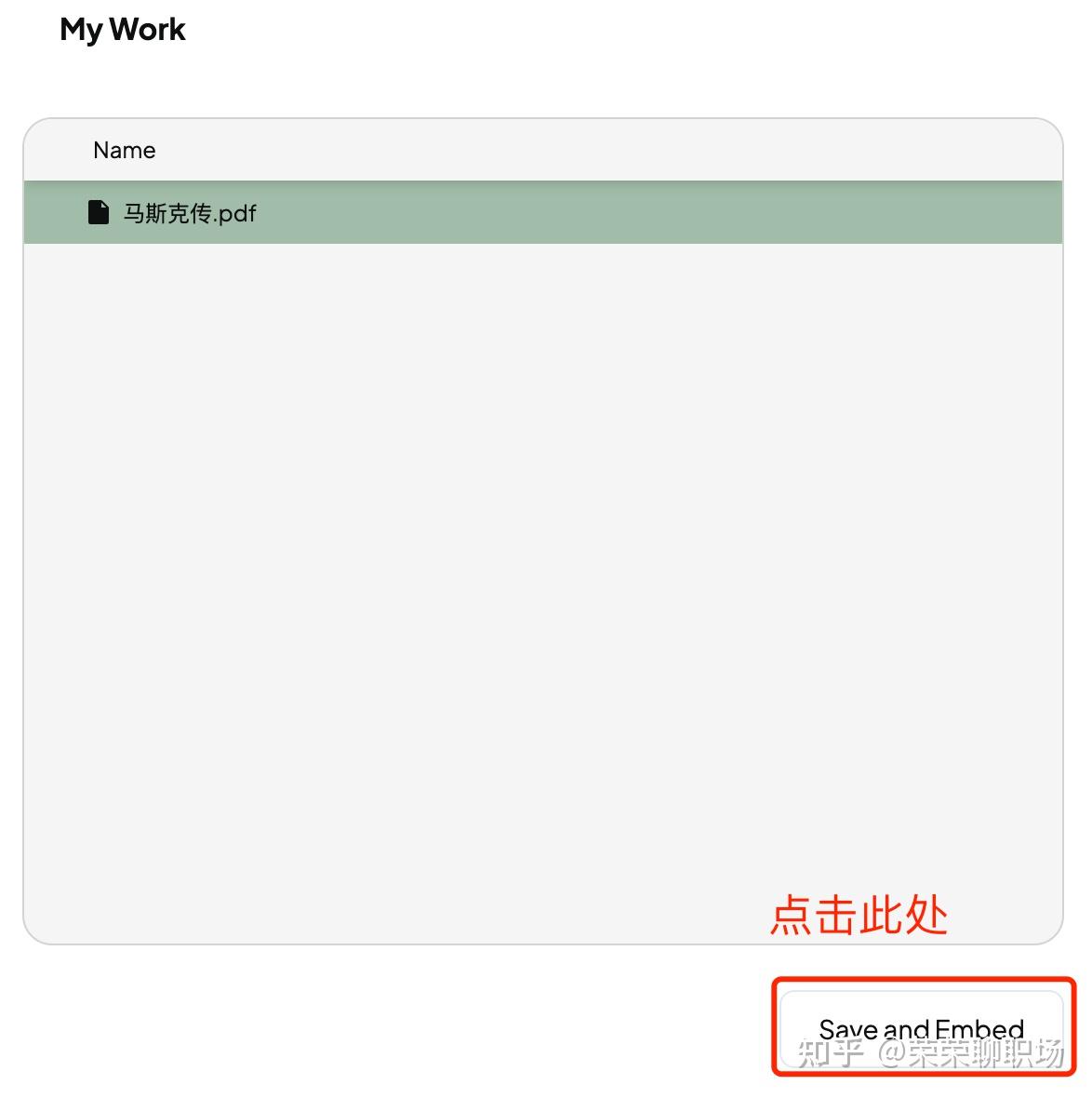

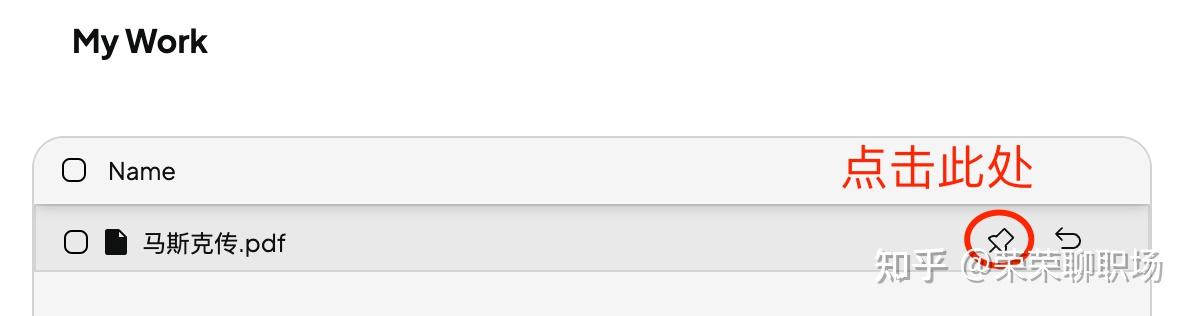

在左侧工作区找到上传按钮,上传你的文档(如 PDF、TXT、Excel 、DOCX(DOC文件不行)等),选中上传的文档,点击“移动到工作区”。

步骤1

步骤二

步骤三

步骤四 点击“Save and Embed”,对文档进行切分和词向量化

步骤五 点击图钉按钮,将这篇文档设置为当前对话的背景文档

测试成功,引用的《马斯克传》的内容

4、测试知识库,OK。

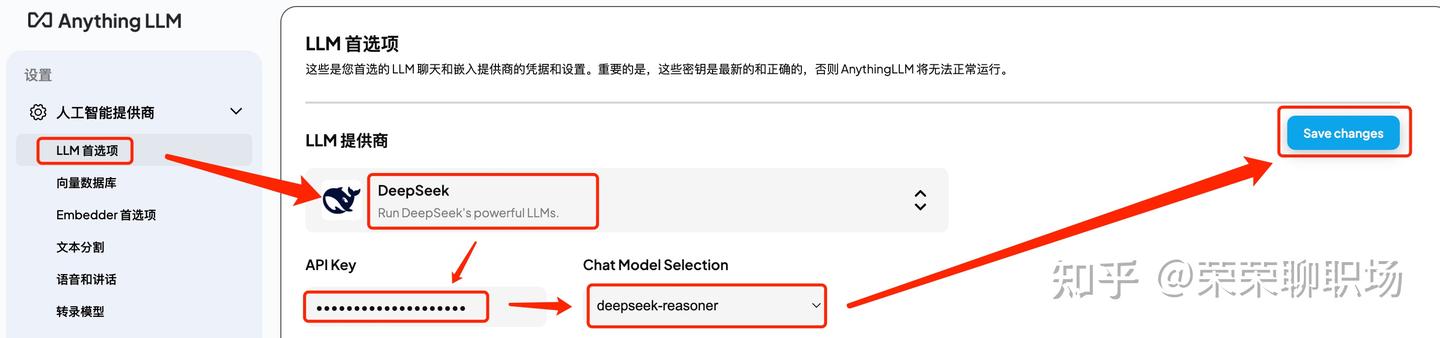

3、使用 DeepSeek 官方 API(可选)

如果你的本地硬件条件有限,也可以选择使用 DeepSeek 官方提供的 API 服务。

(1)获取 API Key:访问 DeepSeek 官网,注册账号并获取 API Key。

(2)配置 API

- 在 AnythingLLM 的工作区右侧点击“设置”,选择“聊天设置”。

- 更改 LLM 模型为 DeepSeek,输入你的 API Key,选择 DeepSeek R1 模型。

- 更新工作区后,就可以使用官方提供的大模型服务了。

四、总结

通过以上步骤,你可以在本地快速部署一个专属的知识库,利用 DeepSeek、Ollama 和 AnythingLLM 的强大功能,实现高效的知识管理和问答。无论是个人学习还是企业办公,这样的本地知识库都能为你带来极大的便利。

如果你在部署过程中遇到任何问题,欢迎在评论区留言交流。希望这篇文章能帮助你迈出探索本地 AI 的第一步,开启无限可能!

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)