ComfyUI用DEEPSEEK R1 自动翻译+扩写,FLUX文生图实在太爽了!5分钟搞定,安排!

🌹大家好呀!现在的AI技术一日千里,如果不及时学习,就有可能掉队!在探索道路上,我将与大家一起共同进步。**第一步:****为了确认****安装成功,**由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取。

🌹大家好呀!现在的AI技术一日千里,如果不及时学习,就有可能掉队!在探索道路上,我将与大家一起共同进步。

**第一步:**下载OLLAMA,进入官网选择windows版本下载并安装

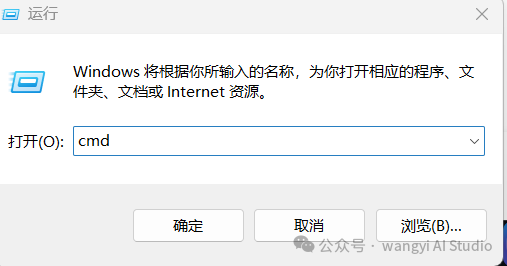

4、键盘按WIN+R,打开运行,输入CMD回车

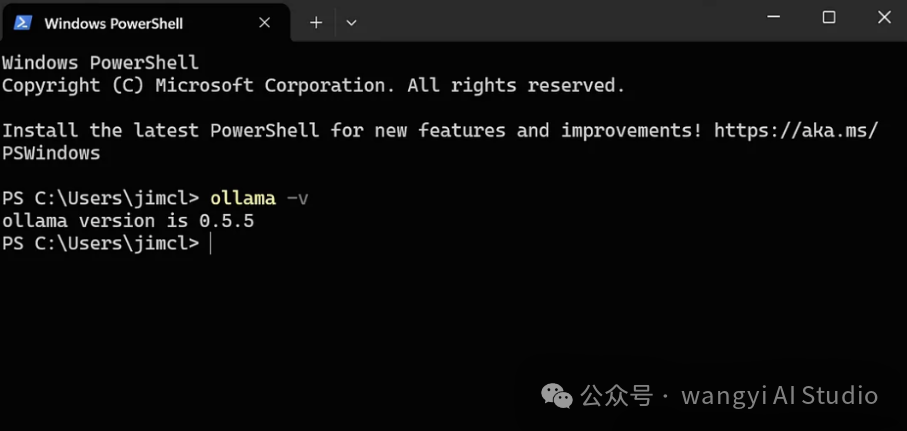

**为了确认****安装成功,**请打开终端并运行以下命令:ollama -v

出现这个就代表安装成功了,显示你已经安装了OLLAMA0.5.5版本!

安装完ollama后在后台中需要将ollama保持启动状态

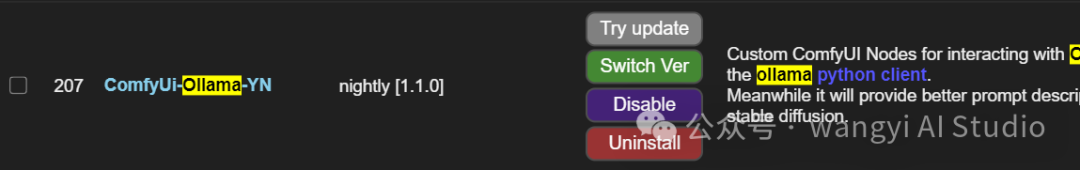

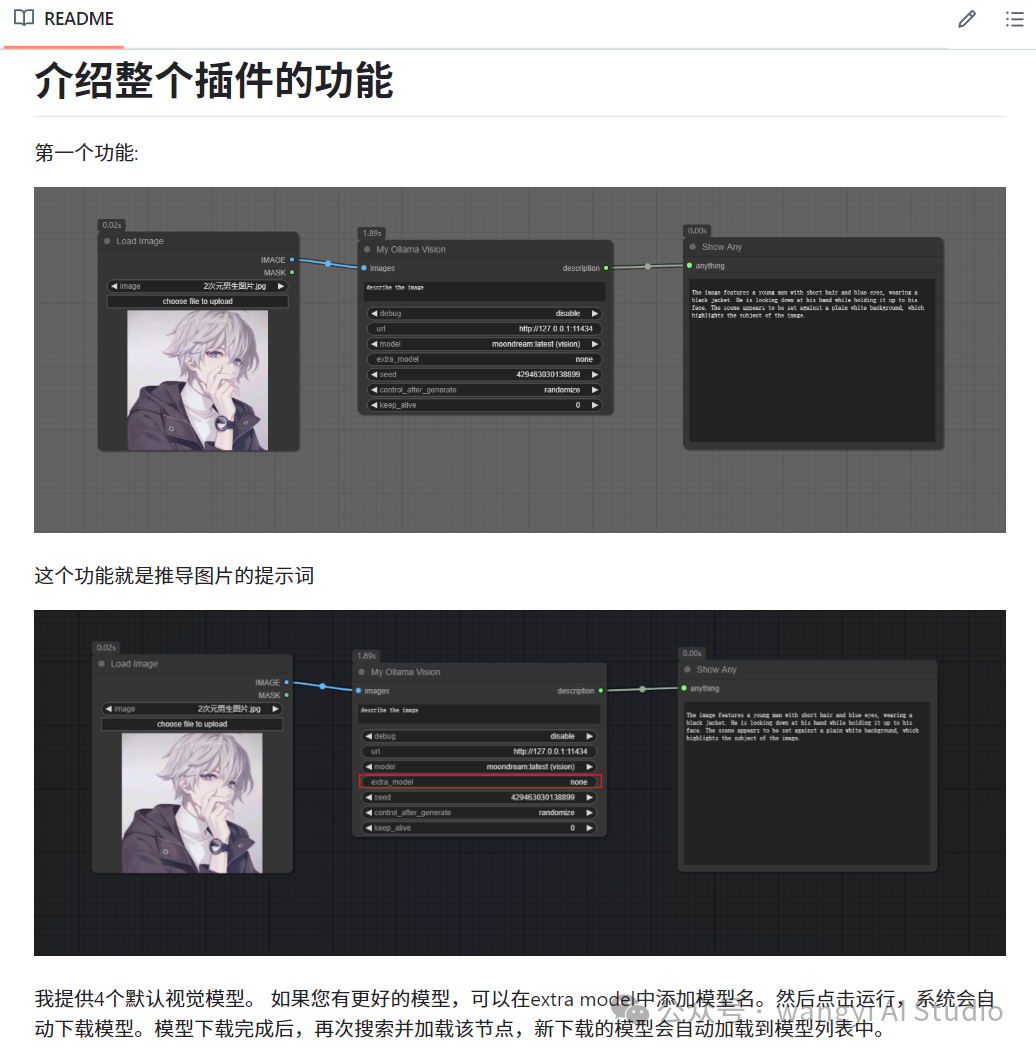

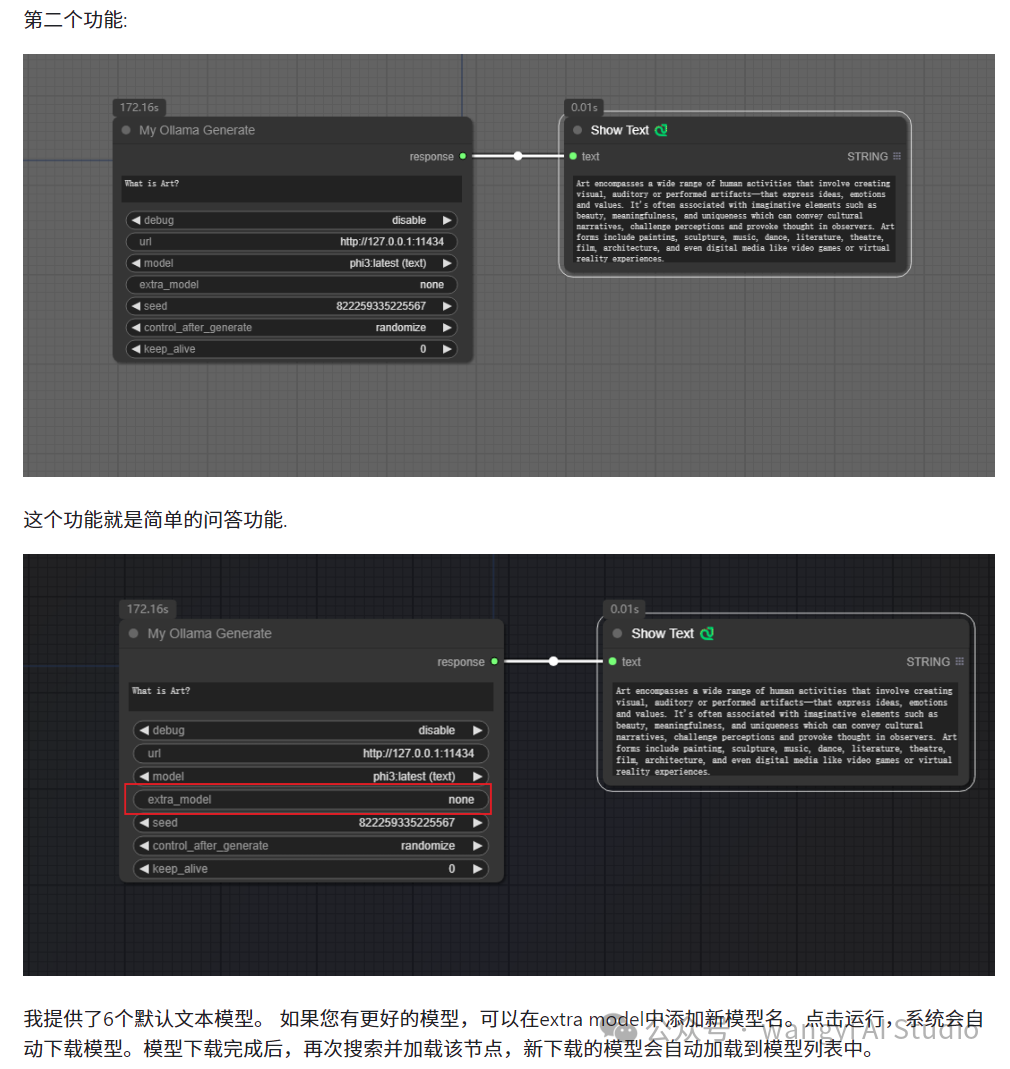

现在讲重要的在COMFYUI中安装OLLAMA-YN这个节点,地址:

https://github.com/wujm424606/ComfyUi-Ollama-YN

假定你是通过管理器或者手动安装的这个节点,按照作者的说明,我们下载了DEEPSEEK R1 默认是下载7B,如果你是4090可以下载32B的玩玩,但是对于翻译+扩写实在有些大材小用了,所以7B足矣!

以前,我们下载模型是通过调用cmd,然后输入如下命令完成下载

ollama run model_name

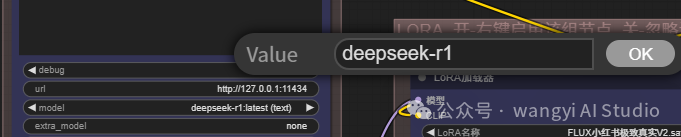

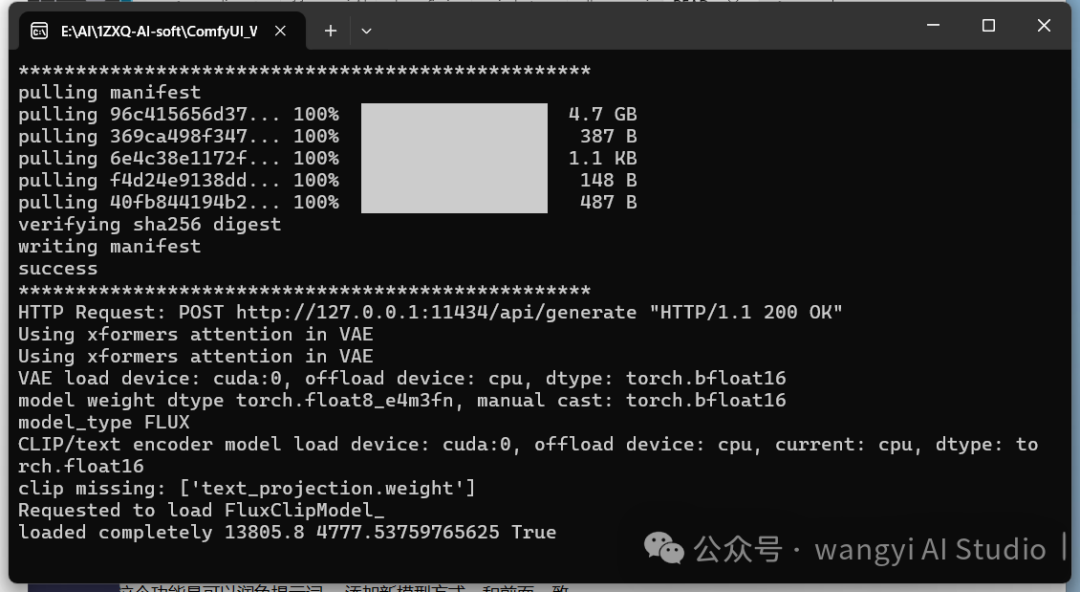

现在我们不需要在使用cmd下载了,直接在extra model输入要下载的模型名即可

点一下COMFYUI中的执行按钮,就会自动下载模型了

这样就是下载好了,接着发现一个问题,按作者的说明操作后,不论是重启还是刷新COMFYUI,都不会显示deepseek-r1,那就无法调用模型,没办法,我只好自己修改节点的源码,从而成功调出了deepseek-r1,修改好的节点和工作流,在文末提供下载!

现在直接输入中文让deepseek-r1帮写工作吧,需要注意的是,在COMFYUI中调用本地大模型,进行FLUX生图,需要高性能、大显存的显卡,显存小于16G和内存低于128G的,都需要在系统中设置40G的虚拟内存,不然出图速度极慢还会爆显存

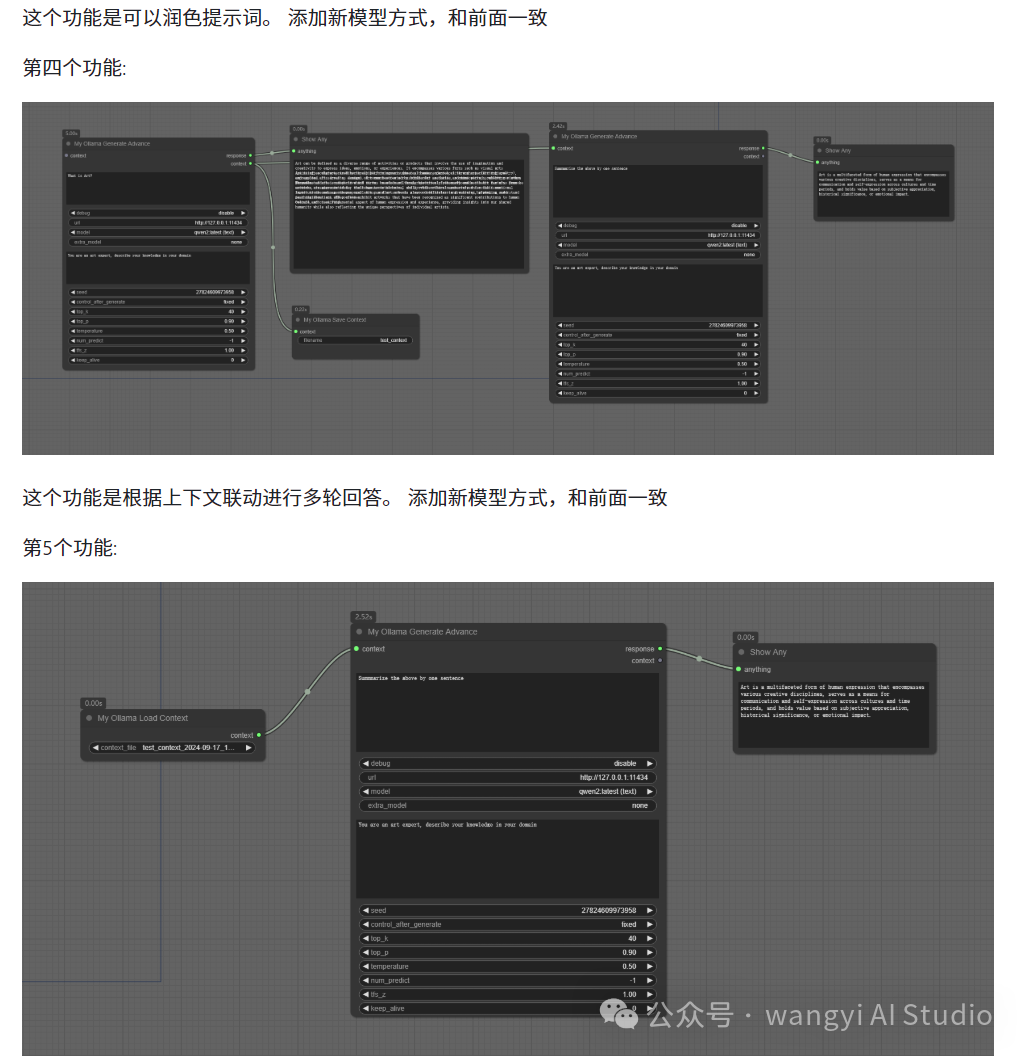

这个节点的功能还有很多,比如自动翻译、扩写、润色、增加删除模型、反推图片、简单对话等等!大家自行探索吧!

|

|

|

|---|---|---|

|

|

|

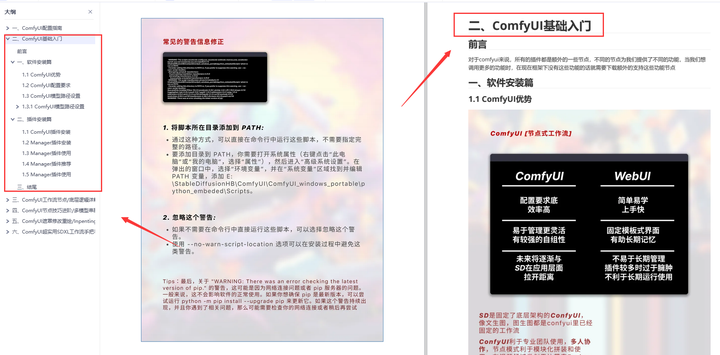

| 为了帮助大家更好地掌握 ComfyUI,我在去年花了几个月的时间,撰写并录制了一套ComfyUI的基础教程,共六篇。这套教程详细介绍了选择ComfyUI的理由、其优缺点、下载安装方法、模型与插件的安装、工作流节点和底层逻辑详解、遮罩修改重绘/Inpenting模块以及SDXL工作流手把手搭建。 |

由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取

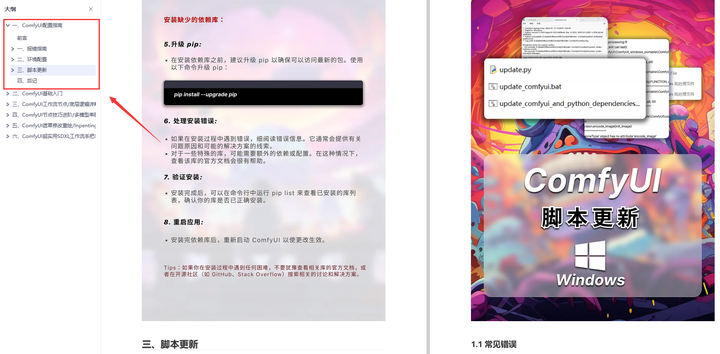

一、ComfyUI配置指南

- 报错指南

- 环境配置

- 脚本更新

- 后记

- …

二、ComfyUI基础入门

- 软件安装篇

- 插件安装篇

- …

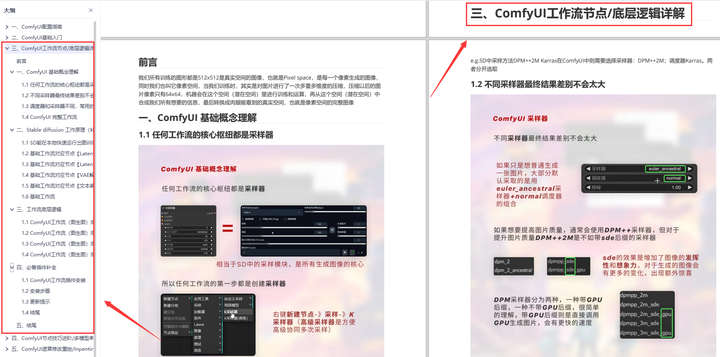

三、 ComfyUI工作流节点/底层逻辑详解

- ComfyUI 基础概念理解

- Stable diffusion 工作原理

- 工作流底层逻辑

- 必备插件补全

- …

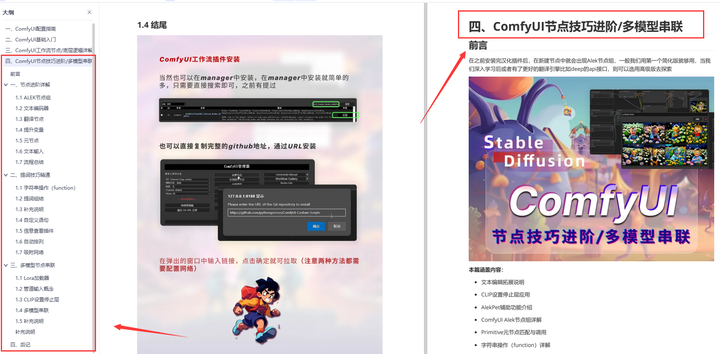

四、ComfyUI节点技巧进阶/多模型串联

- 节点进阶详解

- 提词技巧精通

- 多模型节点串联

- …

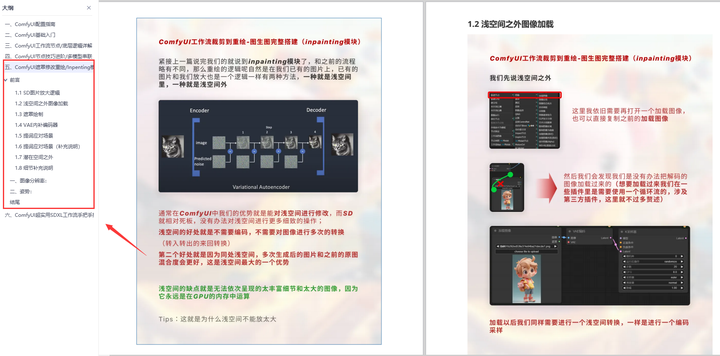

五、ComfyUI遮罩修改重绘/Inpenting模块详解

- 图像分辨率

- 姿势

- …

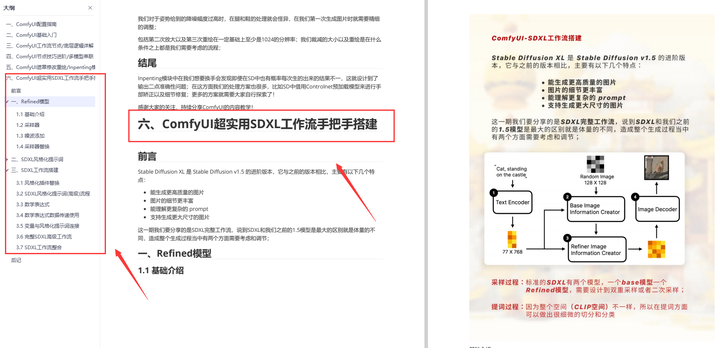

六、ComfyUI超实用SDXL工作流手把手搭建

- Refined模型

- SDXL风格化提示词

- SDXL工作流搭建

- …

由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)