Kylin-Desktop-V10-SP1麒麟系统知识10——本地部署Deepseek

麒麟Kylin-Desktop-V10-SP1系统 本地部署Deepseek 的详细操作步骤 (特别说明:因为本次实验环境为虚拟机,硬件配置低,所以本次实验以部署 DeepSeek -R1 1.5b 为例;其余版本部署方法是将本实验中命令参数为1.5b修改为对应的 版本号即可)

提示:学习麒麟Kylin-Desktop-V10-SP1系统 本地部署Deepseek 的详细操作步骤 (特别说明:因为本次实验环境为虚拟机,硬件配置低,所以本次实验以部署 DeepSeek -R1 1.5b 为例;其余版本部署方法是将本实验中命令参数为1.5b修改为对应的 版本号即可)

一、关于Deepseek

1、Deepseek的简介

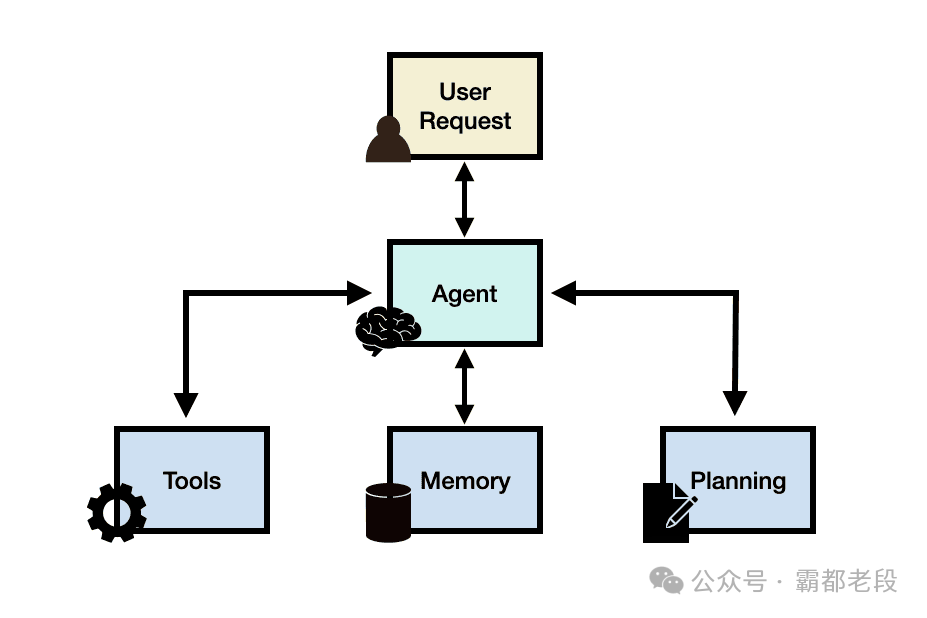

DeepSeek(中文名:深度求索):是一款由国内人工智能公司研发的人工智能模型,拥有强大的自然语言处理能力,能够理解并回答问题,还能辅助写代码、整理资料和解决复杂的数学问题

2、本地部署Deepseek的优缺点

2.1 主要优点

① 离线使用:无需依赖网络连接,随时随地都能调用AI能力,特别是在网络不稳定或无网络的环境下依然可以使用

② 数据安全:将模型部署在本地可以确保数据不会离开本地设备,降低了数据泄露的风险,适合有严格数据合规要求的场景,如金融、政务等

2.2 主要缺点

① 硬件要求高:高版本(671b)需要高性能的GPU和足够的内存来支持模型的运行

② 资源占用:本地部署会占用本地的计算资源和存储空间,对于资源有限的设备可能不太适用。

③ 模型更新滞后:模型更新需要手动操作,可能会比云服务更新滞后,可能无法及时获得最新的功能

二、本地部署的详细步骤

1、前期准备

1.1 成功安装麒麟系统

说明:本次实验的安装的系统是:Kylin-Desktop-V10-SP1

1.2 需要连接互联网

说明:首次部署需要连接互联网

2、大模型服务工具

2.1 下载Ollama

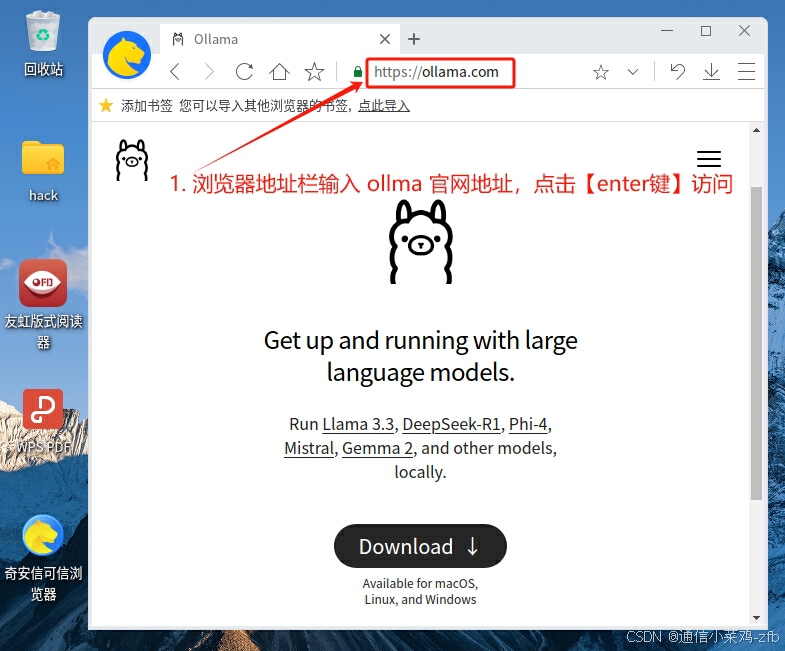

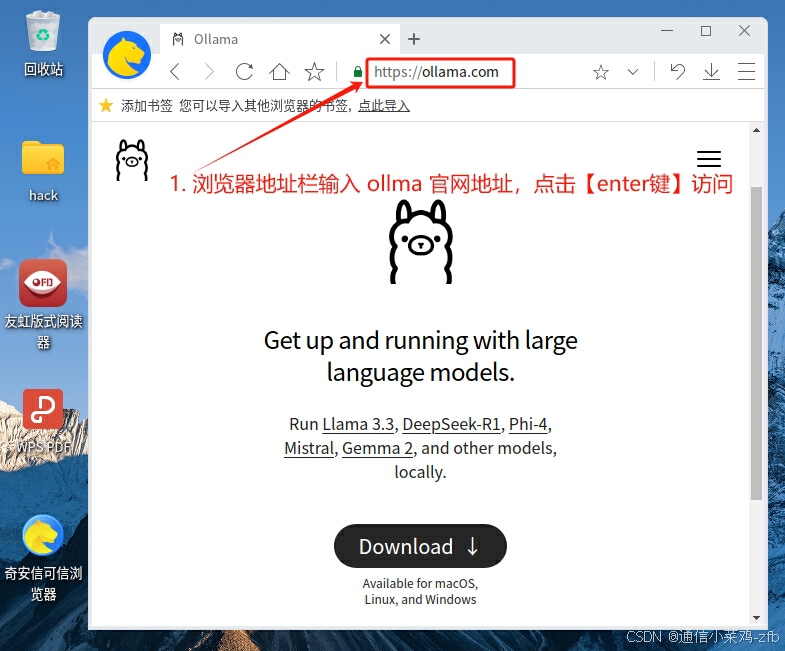

1.访问

【Ollama官网】

ollma官网地址:https://ollama.com/

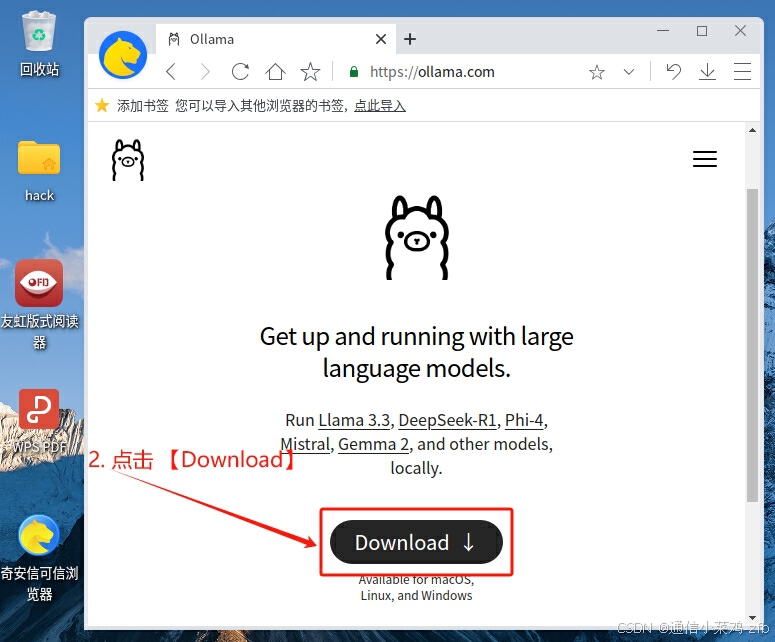

2.点击

【Download】

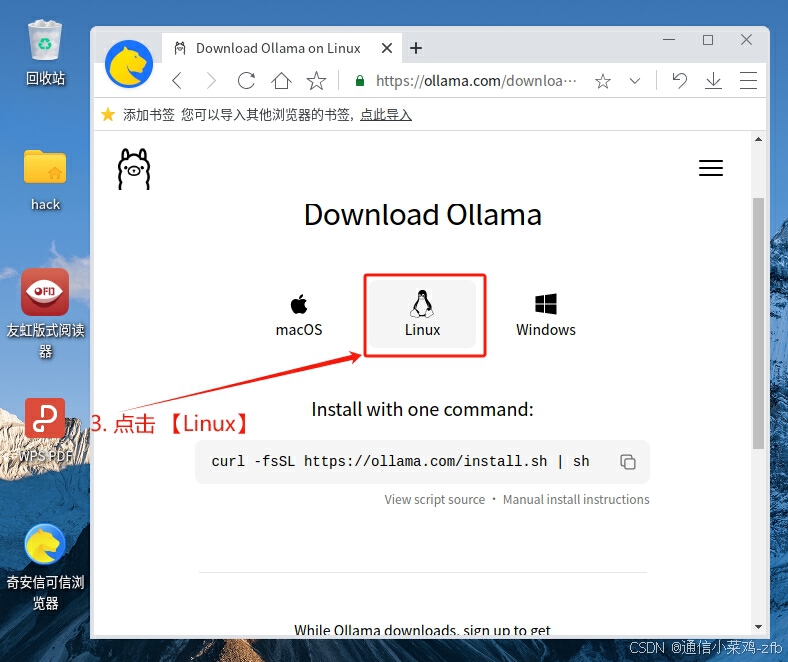

3.点击

【Linux】

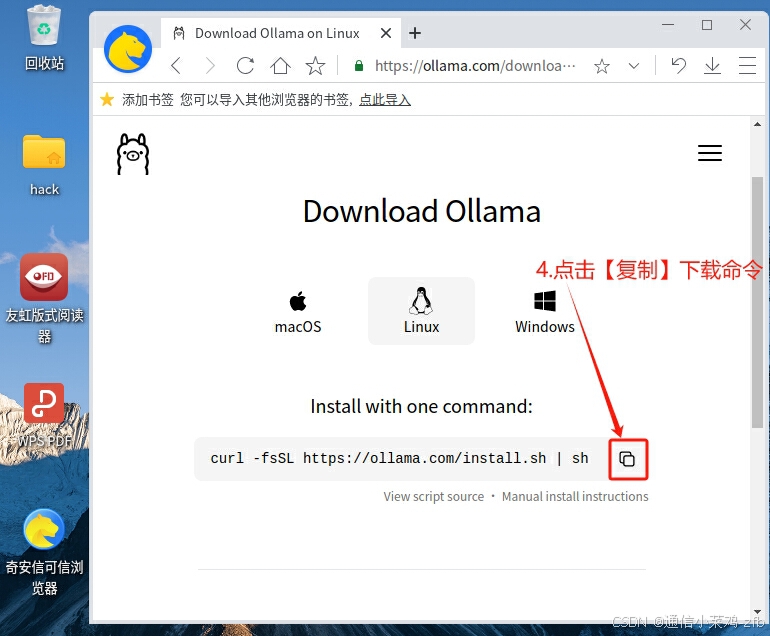

4.点击

【复制】下载命令

5.在桌面点击

【鼠标右键】,选中并点击【打开终端】

6.在打开的终端中,点击

【鼠标右键】,选中并点击【粘贴】

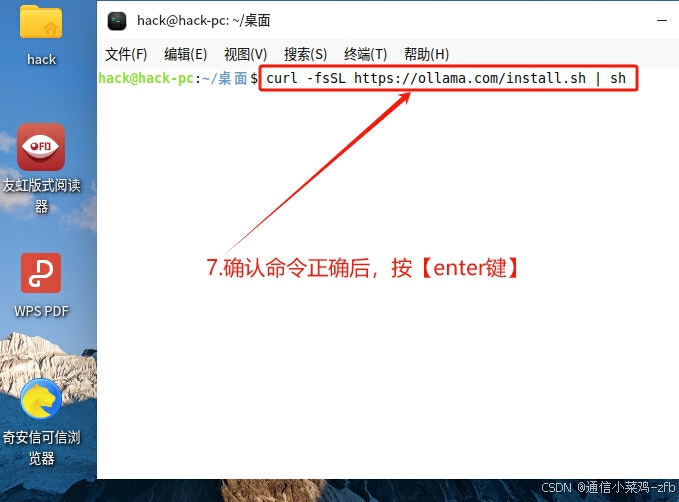

7.确认命令正确后,按

【enter键】

curl -fsSL https://ollama.com/install.sh | sh

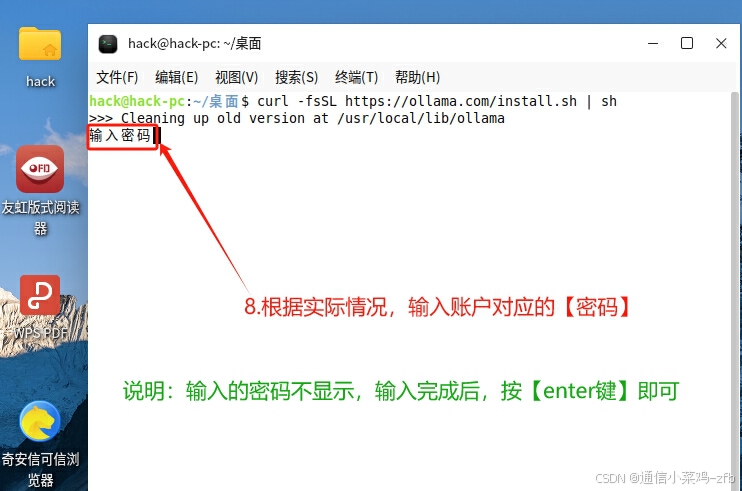

8.根据实际情况,输入账户对应的

【密码】

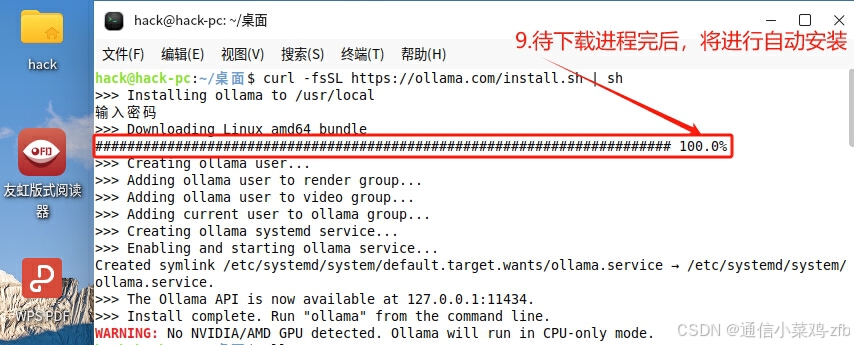

9.待下载进程完成后,将进行自动安装

10.通过输入

【ollama -v】查看ollma版本号,确认安装成功

ollama -v

2.2 下载Deepseek模型

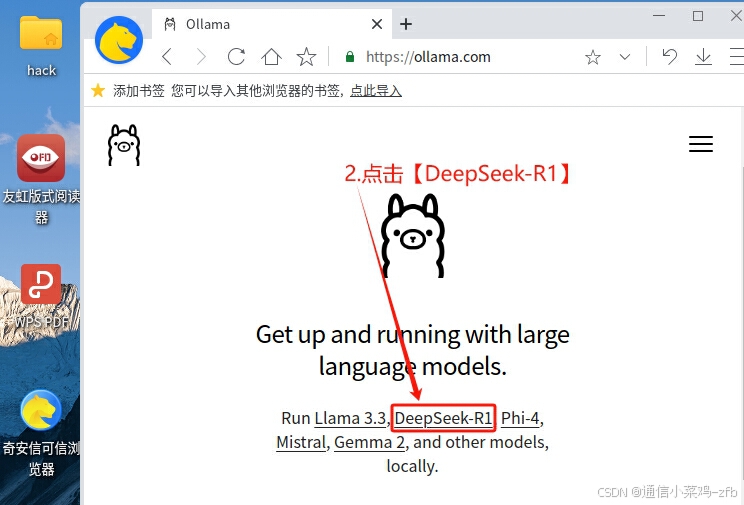

1.访问

【Ollama官网】

ollma官网地址:https://ollama.com/

2.点击

【DeepSeek-R1】

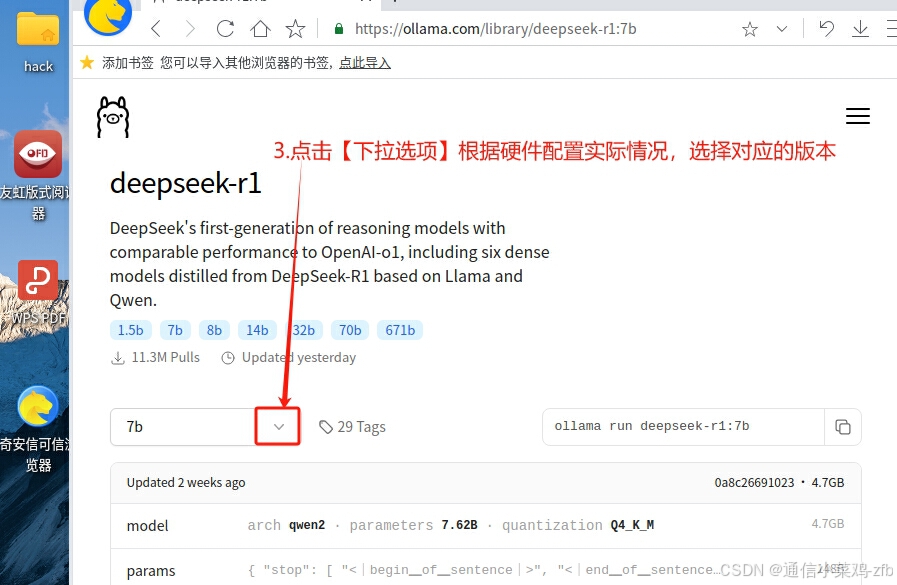

3.点击

【下拉选项】根据硬件配置实际情况,选择对应的版本

4.选择对应的

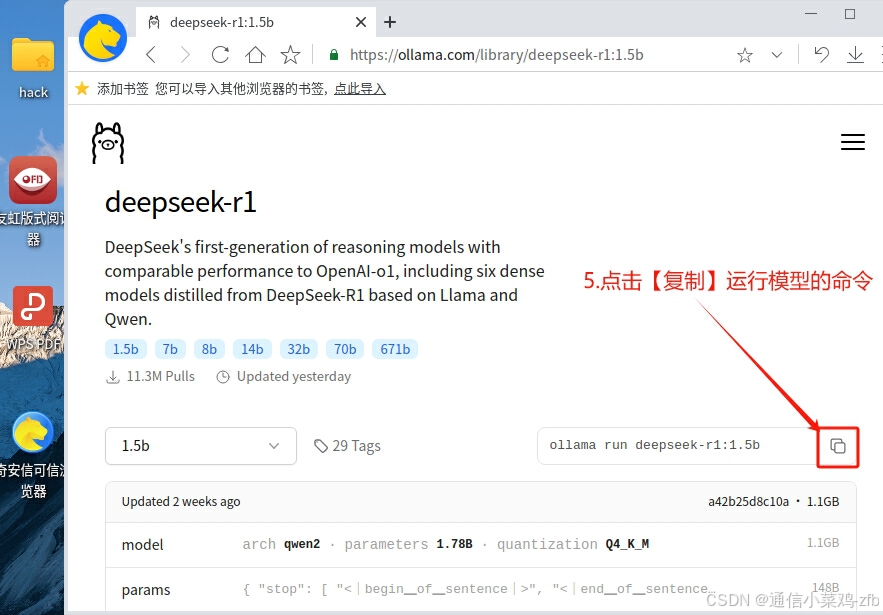

【版本】(说明:此实验选用 1.5b 版本为例)

5.点击

【复制】运行模型的命令

6.在桌面点击

【鼠标右键】,选中并点击【打开终端】

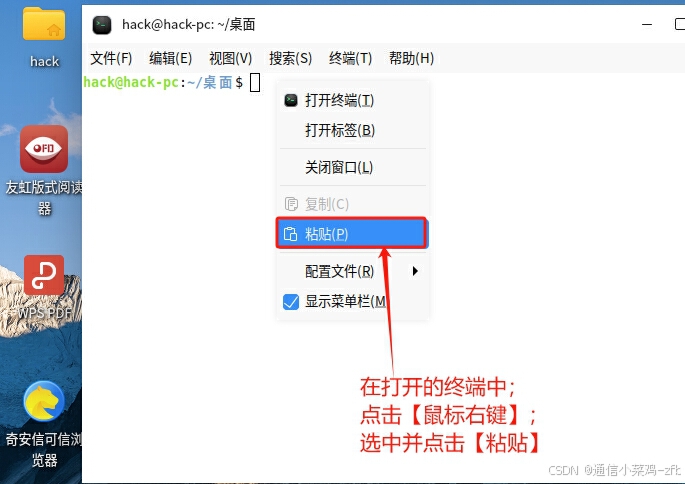

7.在打开的终端中,点击

【鼠标右键】,选中并点击【粘贴】

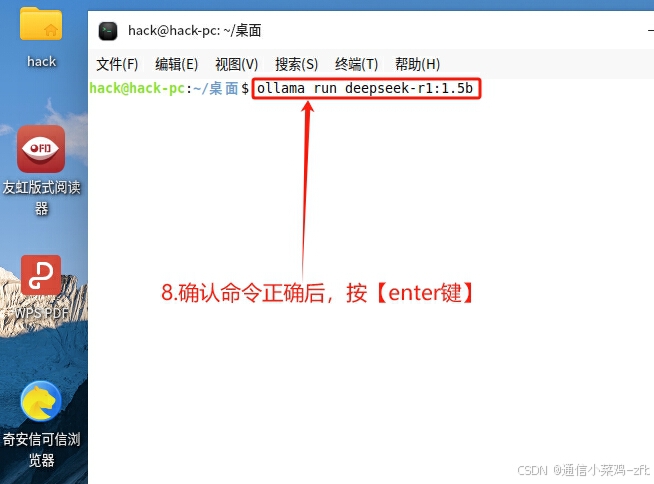

8.确认命令正确后,按

【enter键】

ollama run deepseek-r1:1.5b

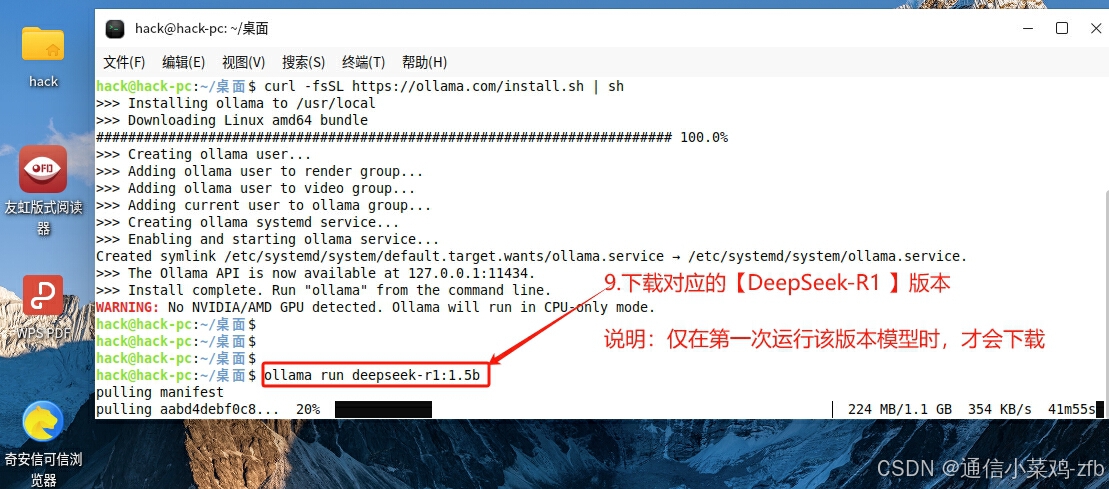

9.下载对应的

【DeepSeek-R1 】版本(说明:仅在第一次运行该版本模型时,才会下载)

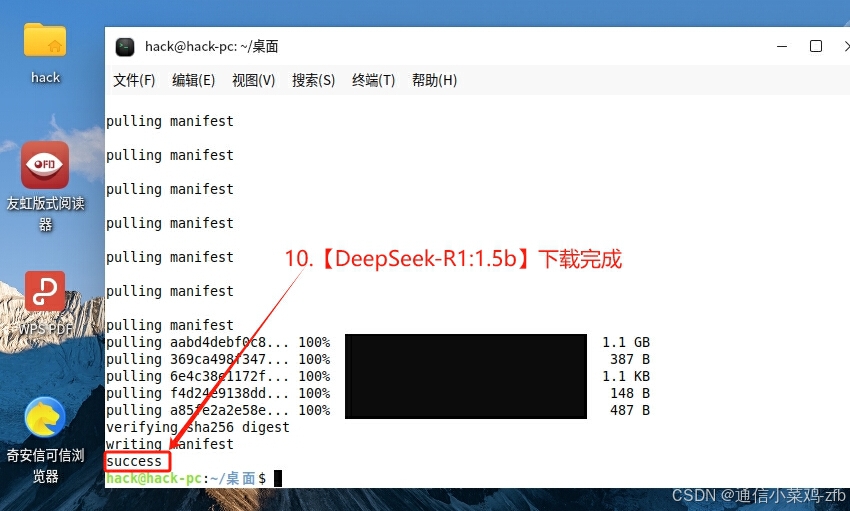

10.

【DeepSeek-R1:1.5b】下载完成

3、Deepseek的简单使用

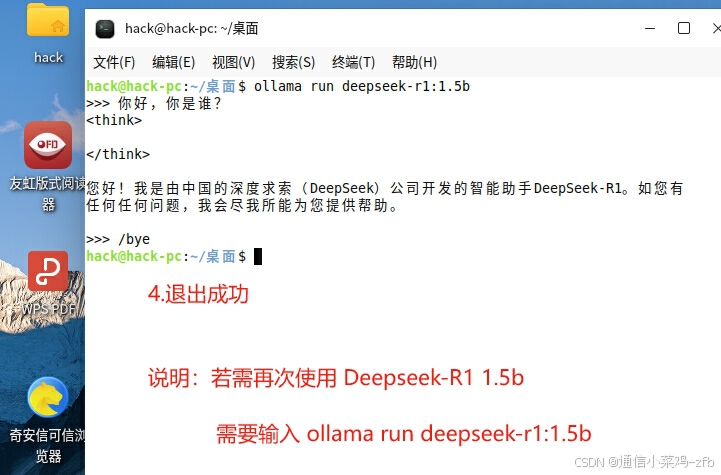

1.输入

【ollama run deepseek-r1:1.5b】命令,运行1.5b版本模型

ollama run deepseek-r1:1.5b

2.按需输入

【变量】(说明:此处以 “你好,你是谁?” 为例)

3.使用完后,输入

【/bye】退出

4.退出成功 (说明:若需再次使用 Deepseek-R1 1.5b 需要输入 ollama run deepseek-r1:1.5b )

三、说明

个人笔记,仅供参考

更多分享内容,关注微信公众号 【通信小菜鸡】 …

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)