DeepSeek发布R1模型,“知识蒸馏”技术爆火!

其也迎来了“又一春”!非常推荐想发论文的伙伴不要错过。一方面,其通过特定的蒸馏算法,能够把大且复杂模型中的知识传递给小模型,在保持准确率的同时,减少计算成本。在模型规模越大发庞大的现在,自然成为了华为等大厂的刚需。在自动驾驶、边缘计算等场景中,更是离不开,论文落地价值Max!另一方面,其创新空间很广阔,好出创新点。像是多模态蒸馏、动态蒸馏、对抗蒸馏、频域蒸馏等方向,都还在蓬勃发展期。为让大家能够紧

随着DeepSeek的爆火,验证了知识蒸馏的有用性,其也迎来了“又一春”!非常推荐想发论文的伙伴不要错过。

一方面,其通过特定的蒸馏算法,能够把大且复杂模型中的知识传递给小模型,在保持准确率的同时,减少计算成本。在模型规模越大发庞大的现在,自然成为了华为等大厂的刚需。在自动驾驶、边缘计算等场景中,更是离不开,论文落地价值Max!

另一方面,其创新空间很广阔,好出创新点。像是多模态蒸馏、动态蒸馏、对抗蒸馏、频域蒸馏等方向,都还在蓬勃发展期。

为让大家能够紧跟领域前沿,找到更多灵感启发,早点发出自己的顶会,我给大家准备了10种创新思路和源码!

论文原文+开源代码需要的同学看文末

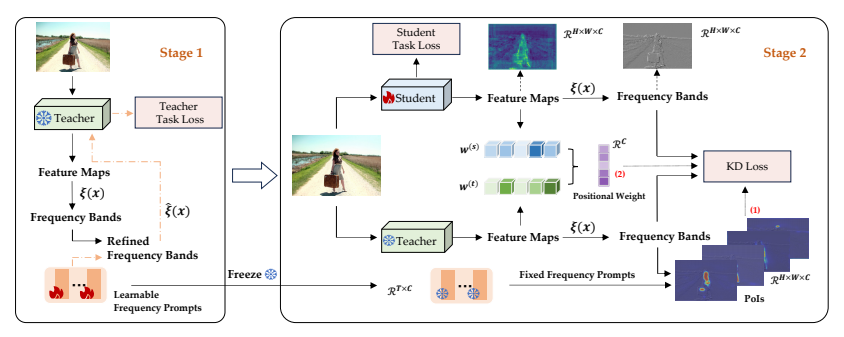

论文:FreeKD: Knowledge Distillation via Semantic Frequency Prompt

内容

该论文提出了一种名为 FreeKD 的知识蒸馏方法,通过频域信号进行知识迁移。该方法引入了“频率提示”(Frequency Prompt)来定位频域中有价值的像素,并结合位置感知关系损失函数,增强了学生模型对密集预测任务的敏感性,提升了学生模型的性能和鲁棒性,并在大规模视觉模型上展现出良好的泛化能力。

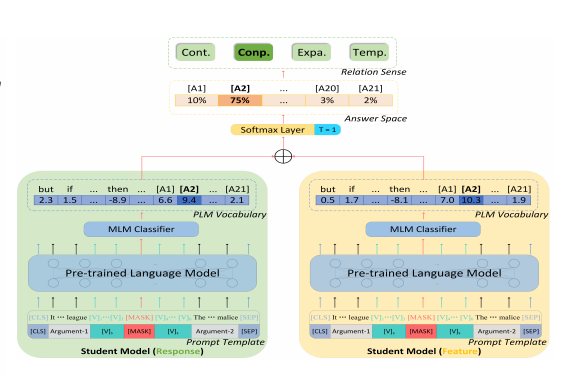

论文:Adaptive Prompt Learning with Distilled Connective Knowledge for Implicit Discourse Relation Recognition

内容

该论文提出了一种名为 AdaptPrompt 的新型隐含话语关系识别(IDRR)方法,结合了连续提示学习和连接词知识蒸馏。该方法通过设计可调优的虚拟标记来形成连续提示模板,自动在嵌入空间中搜索最优模板,同时利用回答-关系映射规则生成虚拟答案空间,减少人工设计模板和答案的工作量。

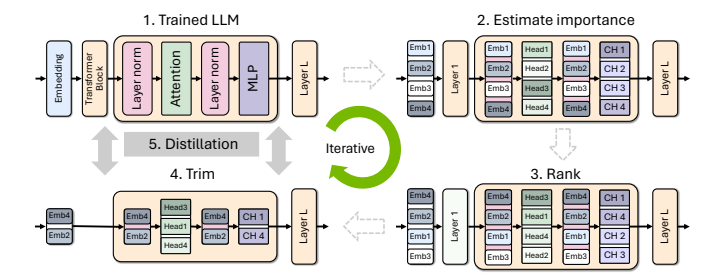

论文:Compact Language Models via Pruning and Knowledge Distillation

内容

该论文提出了一种通过剪枝和知识蒸馏压缩大型语言模型(LLMs)的方法,旨在减少从头开始训练多个不同规模模型的高昂计算成本,通过实证研究,结合深度、宽度、注意力和MLP剪枝以及基于知识蒸馏的再训练,开发了一套LLMs压缩的最佳实践方法。

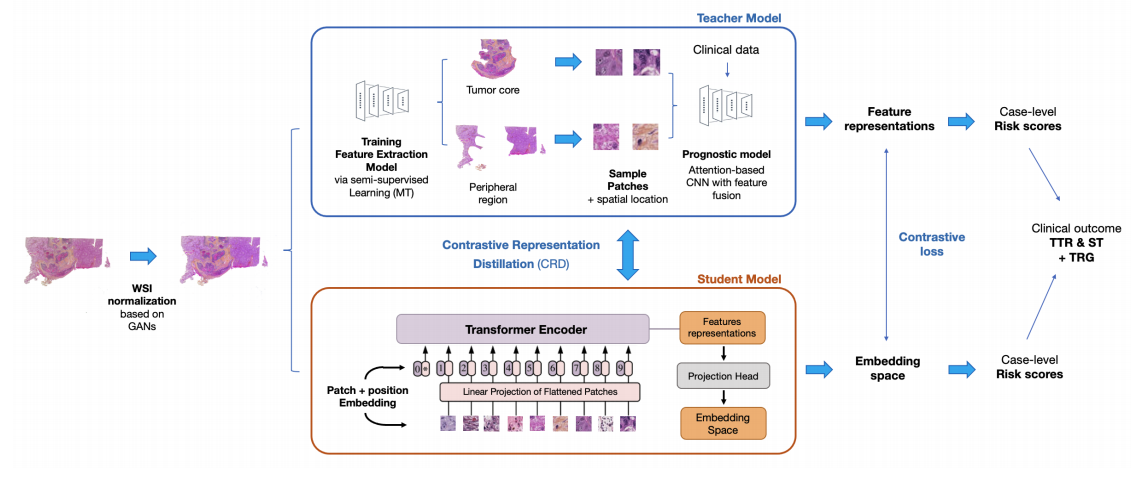

论文:Semi-supervised ViT knowledge distillation network with style transfer normalization for colorectal liver metastases survival prediction

内容

该论文提出了一种用于结直肠癌肝转移(CLM)患者预后预测的半监督学习方法,结合了基于生成对抗网络(GAN)的幻灯片归一化、视觉变换器(ViT)知识蒸馏和注意力机制,通过GAN对H&E和HPS染色的组织学幻灯片进行归一化处理,以减少染色差异;然后利用半监督学习对组织进行分类,并提取与预后相关的特征;最后通过知识蒸馏将特征传递给ViT模型以进行生存预测。

关注下方《人工智能学起来》

回复“蒸馏创新”获取全部论文+开源代码

码字不易,欢迎大家点赞评论收藏

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)