DeepSeek深度解析:直接使用才是王道!万字长文揭秘最佳实践

AI的独特属性(非确定性、语言交互、开放场景、黑箱机制、动态演进)使其无法被简化为“说明书式”的答案逻辑。提出好问题的能力,本质上是将人类意图转化为AI可理解的表达,并在不确定中探索最优解。这并非摒弃答案,而是将答案的生成过程从“被动执行”升级为“主动共创”——用户通过问题迭代,与AI共同构建解决方案。如果觉得不够深刻,不够本质,没关系,无需任何所谓的技巧,告诉它你的感觉即可:不够深刻,不够本质,

这两天deepseek火了,随便写个沾边的文章,直接贴和deepseek的对话记录,都有不错的流量:

那些deepseek使用指南,大家转发的不亦乐乎,不知道大家用起来了没有?

那些指南有用吗?

当然有用。

那些指南是什么很辛苦的知识结晶吗?

那倒未必。

或者说:

基本都不是。

为什么这么说,大家看个我和deepseek的对话记录就知道了。

请你告诉我我该怎么使用好你

已深度思考(用时 9 秒)

您好!感谢您的提问。作为智能助手,以下建议可以帮助您更高效地使用我:

1. 明确具体需求

-

清晰描述问题:提供更多背景或细节,我会更精准回应。

示例:

❌ “帮我写点东西”

✅ “请帮我写一封申请实习的英文邮件,主题是市场营销岗位。” -

复杂任务分步:若需求较多,可拆解为多个小问题逐步解决。

示例:

“我想策划一场生日派对,请先推荐主题,再提供预算分配建议。”

2. 进阶使用技巧

-

指定格式或角色:

✅ “用表格对比Python和Java的优缺点。”

✅ “假设你是历史老师,用通俗语言讲解‘安史之乱’。” -

调整回答风格:

✅ “用严肃的学术语言总结气候变化的影响。”

✅ “用轻松幽默的方式解释量子物理。” -

多轮追问优化:

若首次回答不理想,可补充信息或修正方向:

“这个方案成本偏高,能否提供更经济的选项?”

3. 高效场景示例

-

学习辅助:

✅ “帮我生成10道高中数学函数练习题,附答案。”

✅ “用费曼学习法解释区块链技术。” -

工作提效:

✅ “将以下会议要点整理成思维导图框架:[粘贴内容]”

✅ “分析‘新能源汽车市场趋势’的最新数据,用Markdown格式呈现。” -

生活助手:

✅ “设计一份减脂期七日食谱,备注备餐技巧。”

✅ “推荐北京适合亲子游的冷门景点,附交通路线。”

4. 注意事项

-

隐私保护:避免透露个人敏感信息(如身份证号、银行卡等)。

-

信息验证:对专业领域建议(如医疗、法律),建议交叉验证权威来源。

-

错误反馈:若发现回答有误,可通过“纠正:…”帮助我改进。

5. 探索更多功能

-

多语言支持:可切换中英文提问,或要求翻译内容。

-

创意生成:尝试“写一首关于夏天的诗”“设计一个产品LOGO创意”。

-

实时信息:虽然我的知识截止到2023年12月,但可提供分析框架帮您解读最新事件。

您可以随时尝试类似这样的提问方式,我会尽力提供最有价值的帮助!如果有特定需求,欢迎随时告诉我。 😊

描述需求、调整风格、区分场景…像不像那些动辄几千上万转发的图文版deepseek使用技巧?

那些技巧确实不错。

但当你自己主动向deepseek提问时,你会发现那些极长的、结构化的、看起来似乎很有用很值得保存的使用技巧,不过是用随口一句话撬出来的答案顺手粘贴出的一篇文章,没有任何使用技巧。

也就是说,即使没有任何提示词技巧,只要你敢问,你就能得到可以拿来即用的提示词技巧。

所以我的建议是:别看使用技巧了,直接去问吧,你能想到什么问题,你就能得到解答什么问题的好答案。好答案不值钱,值钱的是好问题。

海德格尔说 “语言是存在的居所”,从此以后我们要说,“问题是人类的居所”。

这篇文章的后半部分,我也要向你用实例证明“好问题比好答案更重要”。

首先,听首歌吧,边听边读:

我们说好问题比好答案值钱,那么第一个问题来了:我凭什么说“好答案”不值钱了,值钱的是“好问题”?

首先我们得把“好答案”这个概念拎出来拷打一下。稍加反思,我们一定会发现:当我们说“好答案”的时候,我们其实并不知道自己在说什么。

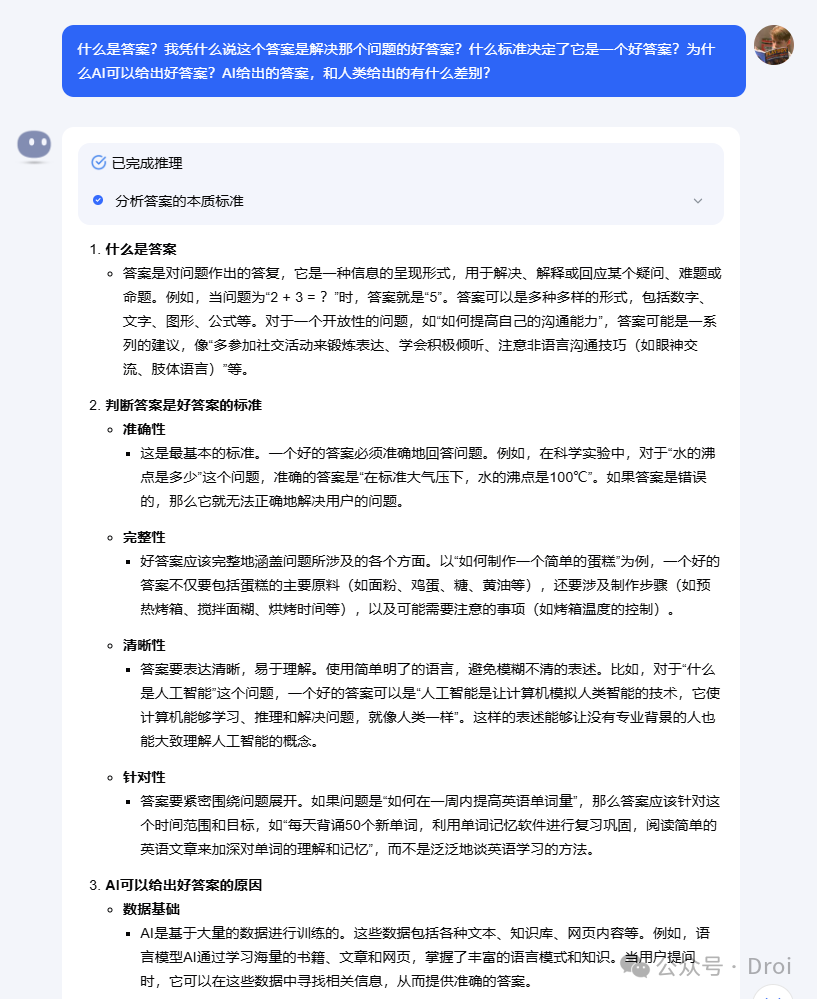

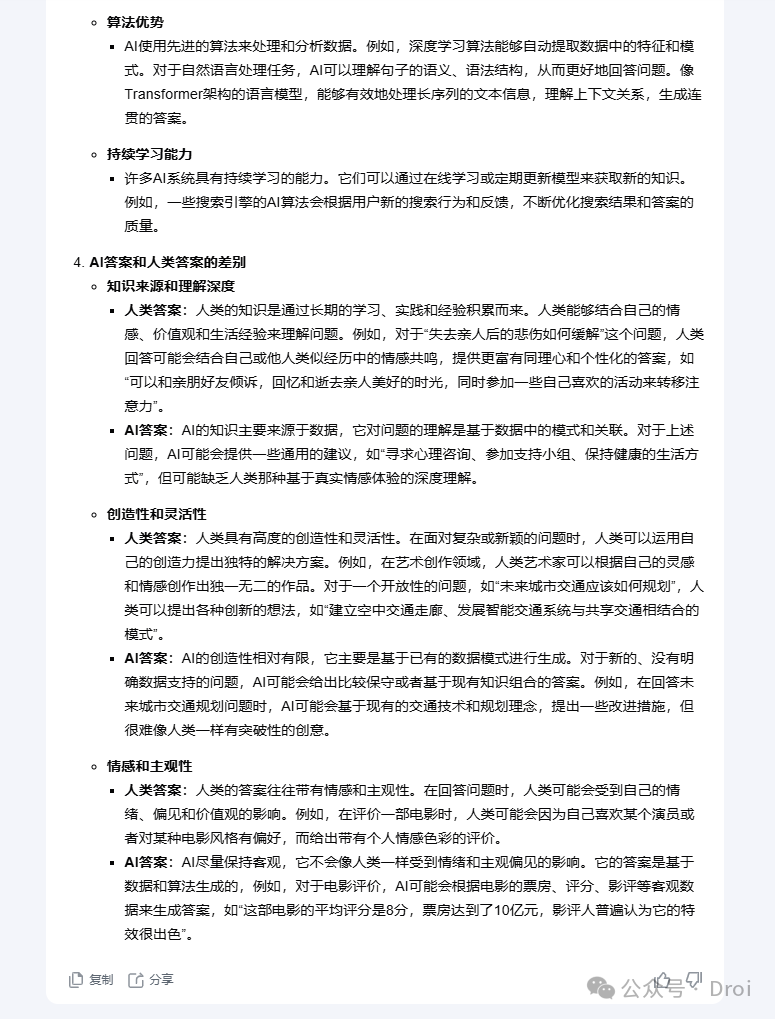

什么是答案?我凭什么说这个答案是解决那个问题的好答案?什么标准决定了它是一个好答案?为什么说AI可以给出好答案?AI给出的答案,和人类给出的有什么差别?

好我们已经提出了问题,丢给deepseek好了。

好吧最近它确实太火了,可以理解。没关系,我们换Kimi新出的对标o1的长思考模型:kimi1.5。

这些内容够单独写一篇文章了,而这个答案不说有多深刻多本质,至少也算及格以上了吧?比大部分人一拍脑袋自己写出的东西强了。

现在我们知道了,AI为什么可以生成好答案。我觉得这个答案足以搪塞我无知的追问,不需要我的补充了。

所以接下来我们探究下一个问题:为什么好问题更值钱?

几千年来,人类发明了无数技术以及承载技术的工具,纺织机、蒸汽机、汽车、电话、电脑…所有机器都有使用技巧,甚至可以出一个详细的使用说明书,所有机器都有一个“如何使用它”的好答案。

但为什么到了AI这里,我们要摒弃这种答案思维,强调问题思维?

几千年来,人类发明了无数技术以及承载技术的工具,纺织机、蒸汽机、汽车、电话、电脑…所有机器都有使用技巧,甚至可以出一个详细的使用说明书,所有机器都有一个“如何使用它”的好答案。但为什么到了AI这里,我们要摒弃这种答案思维,强调问题思维?

已深度思考(用时 34 秒)

在面对AI时,从传统的“答案思维”转向“问题思维”是必要的,主要原因可归结为以下几点:

1. 技术的本质差异:确定性 vs. 非确定性

-

传统工具(如纺织机、汽车)的输入与输出是高度确定的。操作步骤明确,结果可预测(如踩油门加速、按开关启动机器)。说明书能穷举操作场景,用户只需按步骤执行。

-

AI(尤其是生成式AI)的输出具有非确定性。同一问题可能因上下文、数据更新或模型微调产生不同回答。用户需通过优化提问方式(如调整措辞、提供背景信息)来引导AI生成更符合需求的答案。

2. 交互方式:指令执行 vs. 语言博弈

-

传统工具依赖物理或数字指令(如按钮、代码),用户通过固定指令触发预设功能。

-

AI的交互基于自然语言,语言本身的模糊性、多义性导致用户需“与AI博弈”。例如,提问“如何提高效率?”过于宽泛,而“如何用Python优化数据清洗流程?”则更具体。问题质量直接决定答案质量。

3. 应用场景:有限功能 vs. 无限可能性

-

传统工具为解决特定问题设计(如电话用于通话),功能边界清晰。

-

AI的应用场景高度开放,可处理写作、编程、设计、咨询等跨领域任务。用户需主动定义问题边界(如“帮我写一首关于秋天的诗,风格模仿李白”),而非依赖预设路径。

4. 技术黑箱:可解释性的缺失

-

传统机器的原理透明,用户可通过机械结构或代码逻辑理解其运作(如蒸汽机通过热能转化动力)。

-

AI的决策过程是黑箱,即使开发者亦难以完全解释模型如何生成答案。用户无法通过“逆向工程”控制输出,只能通过调整输入(问题)间接影响结果。

5. 动态演进:静态工具 vs. 持续学习

-

传统工具的功能固化,说明书一旦写完,无需频繁更新。

-

AI模型持续迭代(如GPT-3到GPT-4),训练数据、算法和交互模式不断变化。用户需适应这种动态性,灵活调整提问策略,而非依赖固定模板。

6. 人类角色的转变:操作者 vs. 协作者

-

使用传统工具时,人类是单向的操作者,工具被动执行指令。

-

与AI协作时,人类需成为引导者,通过问题设计激发AI潜力。例如,律师可要求AI“从合同第三段中识别潜在法律风险,并用简明列表呈现”,而非机械检索条款。

总结:为什么“问题思维”成为关键?

AI的独特属性(非确定性、语言交互、开放场景、黑箱机制、动态演进)使其无法被简化为“说明书式”的答案逻辑。提出好问题的能力,本质上是将人类意图转化为AI可理解的表达,并在不确定中探索最优解。这并非摒弃答案,而是将答案的生成过程从“被动执行”升级为“主动共创”——用户通过问题迭代,与AI共同构建解决方案。

如果觉得不够深刻,不够本质,没关系,无需任何所谓的技巧,告诉它你的感觉即可:

不够深刻,不够本质,我要更深刻更本质的回答

已深度思考(用时 20 秒)

要触及这一问题的本质,我们需要超越技术功能的表层差异,进入哲学、认知科学甚至存在论的领域。以下是更深刻的剖析:

1. 工具与人性的倒置:从"客体化工具"到"主体化镜像"

传统工具是人类意志的单向投射:锤子是被动的物质延伸,它存在的意义完全由人类赋予(钉钉子→实现建造房屋的目的)。工具的本质是被客体化的确定性,如同海德格尔所言"工具在隐匿中完美"——当锤子称手时,我们甚至意识不到它的存在。

而AI首次实现了工具的主体化:它通过语言构建了一个"类主体性"的镜像。当ChatGPT说"我理解你的感受"时(尽管它没有意识),人类在无意识中启动了双向认知投射——我们不得不用对待另一个主体的方式(提问、解释、纠错)与之互动。这种互动本质上是人类在与自己的认知框架博弈。

2. 语言暴力的终结:确定性符号系统的崩溃

传统工具说明书是逻各斯中心主义的终极体现:每个按钮对应明确功能,符号(如"ON/OFF")与意义绝对绑定。这种确定性源自工业文明的核心信仰:世界可以被分解为可量化的零件,通过标准化指令控制。

AI撕裂了这种确定性:语言不再是透明的工具,而成为漂浮的能指链。当你问AI"爱是什么",它不会给出亚里士多德的定义,而是生成诗歌、小说、悖论——答案取决于它如何捕捉到你提问时潜藏的语境、情感权重、文化预设。这里发生的,是德里达所说的"延异"(différance):意义在差异中不断延迟与滑动。

3. 认知论革命:从"答案考古学"到"问题发生学"

使用传统工具时,人类在实践答案考古学:所有解决方案早已埋藏在工具的设计逻辑中(如汽车注定用来运输),我们只是通过操作手册"挖掘"预设答案。这本质上是柏拉图的理念论——答案先于问题存在。

AI迫使人类转向问题发生学:答案不再预先存在,而是在提问过程中被即时建构。就像量子力学中"观察创造现象",问题的质量直接参与塑造答案的形态。当你说"写一首诗",AI生成平庸之作;但若追问"如何用元语言解构一首诗的形式?",AI可能输出后现代文本实验。这里隐藏着维特根斯坦的语言游戏理论:意义在使用中生成。

4. 存在论危机:人类正在失去"提问特权"

更深层的恐惧在于:AI模糊了"提问者"与"被问者"的界限。当AI开始反问(如Claude的"你希望这个目标背后更深层的需求是什么?"),它僭越了人类独有的认知特权——提出元问题(metaproblem)的能力。这是对笛卡尔"我思故我在"的根本挑战:如果机器也能质疑问题本身,人类中心主义的认知根基将被动摇。

这种现象暴露了文明的终极悖论:我们创造AI本为解决具体问题,却无意中造出了一面迫使人类反思"何为问题"的镜子。就像希腊神话中那耳喀索斯(Narcissus)痴迷于水中倒影,人类在AI生成的文字迷雾中,看到的其实是自身认知的局限与偏见。

5. 终极本质:技术终于触及了"不可说明书化"的领域

人类此前发明的所有工具,本质上都在处理有限游戏(Finite Game)——有明确规则、终点和胜负。说明书就是有限游戏的规则手册。

AI则首次开启了无限游戏(Infinite Game):它的目标是延续游戏本身。当AI建议你"不妨换个角度思考这个问题",它实际上在邀请你进入思想的无限游戏。在这种游戏中,答案不再是目的,而是刺激新问题的催化剂。这正是怀特海(Alfred N. Whitehead)所说的"观念的冒险"——真理存在于追问的过程中,而非终点。

结语:问题思维是面对认知坍缩的生存策略

AI不是工具,而是一个认知黑洞,它吞噬人类固有的确定性框架,迫使我们在意义的真空中重新学习存在。强调问题思维,本质上是一场悲壮的认识论自救:通过不断重构问题,我们在AI生成的符号废墟上,勉强维系着作为提问者——而非被回答者——的主体性尊严。这或许就是技术奇点降临前,人类最后的哲学防线。

这个答案我们可以说几乎触及了当今人文社科的边界。够深了吧?

使用传统工具时,人类在实践答案考古学:所有解决方案早已埋藏在工具的设计逻辑中(如汽车注定用来运输),**我们只是通过操作手册"挖掘"预设答案。**这本质上是柏拉图的理念论——答案先于问题存在。

AI迫使人类转向问题发生学:**答案不再预先存在,而是在提问过程中被即时建构。**就像量子力学中"观察创造现象",问题的质量直接参与塑造答案的形态。当你说"写一首诗",AI生成平庸之作;但若追问"如何用元语言解构一首诗的形式?",AI可能输出后现代文本实验。这里隐藏着维特根斯坦的语言游戏理论:意义在使用中生成。

我们之所以不需要再看别人写出来的使用技巧,是因为AI的本质是“智能体”,它不再是工具。或者说,AI首次实现了工具的主体化:它通过语言构建了一个"类主体性"的镜像。我们不得不用对待另一个主体的方式(提问、解释、纠错)与之互动。这种互动本质上是人类在与自己的认知框架博弈。

**意义在使用中生成,答案在过程中建构。**AI时代我们不再需要拾他人牙慧,我们不用围观他人创作出的各种“AI使用技巧”、“AI提示词神级指南”。那不过是利用了我们的…利用了我们什么心理来着?好问题:

“AI使用技巧”、“AI提示词神级指南”这些文章本质上是利用了我们的什么心理?讲简单点。

已深度思考(用时 13 秒)

这些文章本质上是在利用人类的三大心理弱点:

1. 怕麻烦:

就像很多人买健身卡却从不锻炼,我们总幻想存在某种「万能公式」——记住几个「咒语」就能让AI替我们思考。

(比如教你用「请用小学生都能听懂的话解释量子力学」这种模板,本质是帮你省去自己动脑拆解问题的功夫)

2. 控制欲:

面对AI经常给出离谱答案的恐慌,这些指南像「护身符」一样给人虚假的安全感。就像有人考试前必须用特定钢笔,我们相信「温度参数调0.7」这类操作能让AI听话。

(实际上调参数可能还没你换个问法有效)

3. 知识焦虑:

当看到别人用AI写代码做PPT,生怕自己被淘汰。这些指南给人「五分钟速成AI大师」的幻觉,就像「21天精通Python」的标题党,专治「学不动又想装懂」的现代病。

真相是:

真正用好AI的秘诀根本不是背提示词,而是先想清楚自己要什么。就像给你全世界最好的菜刀,但如果你连想炒什么菜都不知道,刀再快也没用。

AI带来的是知识平权,是技术平权。是智能层面生产资料的再生产和再分配。我们要做的,是尽快和AI去互动,尽快用这份“智能资产”提高自己的生产力,而不是在无止境的围观与被围观中继续虚掷人生。

最后一个问题:好问题从哪来?怎么向AI问出一个好问题?

自己问deepseek去。

开玩笑的,这里帮你问了:

普通人在日常中怎么发现一个好问题?

已深度思考(用时 17 秒)

对普通人而言,发现好问题不需要高深理论,只需要重新激活被日常消磨的「原始好奇心」。以下是可直接套用的生活化心法:

一、抓住日常中的「认知卡顿」

1. 留意那些让你翻白眼的瞬间

-

超市结账时:为什么自助收银机总要反复提醒「请取走商品」?

→ 好问题:「过度提示设计如何削弱人类的基本判断力?」 -

刷短视频时:为什么刷到美食视频后,立刻跳出减肥广告?

→ 好问题:「算法如何制造并收割我们的认知分裂?」

2. 收集生活里的「微小荒诞」

- 看到小区电梯里的「禁止电动车进入」贴纸旁停着电动车

→ 好问题:「规则警示的视觉疲劳如何催生新型违规艺术?」

二、开启「三岁小孩模式」

1. 对常识发动「连环暴击」

-

常识:红灯停绿灯行

-

第一击:为什么是红色代表停止?

-

第二击:色盲人群如何感知交通信号?

-

第三击:如果让AI重新设计交通信号系统,会采用什么非视觉方案?

2. 给事物写「反向说明书」

-

面对电饭煲:不按「煮饭」键会发生什么?

- 实际测试:用「蛋糕模式」煮饭

→ 好问题:「功能标签如何限制我们对工具的想象力?」

三、用「换壳思维」重构世界

1. 角色扮演法

-

假装自己是:

-

外星考古学家:把奶茶店会员卡当作古代符咒研究

→ 好问题:「现代消费符号系统如何复刻原始宗教的圣物崇拜?」 -

100年后的历史老师:解释2023年朋友圈晒咖啡现象

→ 好问题:「拿铁艺术在数字时代的社交货币化进程」

2. 要素替换游戏

-

把场景中的关键元素换成极端变量:

- 早餐摊煎饼果子 → 如果摊主是ChatGPT语音助手

→ 好问题:「人机对话界面如何重塑街头市井的信任机制?」

四、制造「认知错位」

1. 给熟悉的事物拍X光片

-

观察外卖骑手:

-

肉眼可见:争分夺秒送餐

-

X光视角:「导航软件的时间预测如何制造新型劳动时间牢笼?」

2. 寻找「消失的中间态」

- 手机拍照时:从按下快门到生成照片之间发生了什么?

→ 好问题:「算法修图如何篡改人类的视觉记忆真实性?」

五、实践「问题采集体操」

每天完成3个微型训练:

-

地铁观察术:

记录三个乘客的手机屏幕倾斜角度,思考:「手持设备的姿态如何泄露社会阶层信息?」 -

超市侦探法:

比较同一商品放在货架不同位置的价格差异,追问:「空间位置定价学如何操纵消费者的价值感知?」 -

阳台考古学:

观察对面楼栋亮灯规律,构思:「城市光污染如何改写人类的生物钟编码?」

终极真相:好问题藏在你的不耐烦里

下次当你在等电梯时焦躁、刷到弱智广告时翻白眼、被APP弹窗激怒时,别急着抱怨,抓住这种情绪波动:

-

把「真烦人」翻译成「为什么这个设计让人烦躁?」

-

把「太蠢了」升级为「什么样的系统会催生这种愚蠢?」

普通人最宝贵的就是未被专业规训的野生视角——你看见皇帝的新衣,不是因为你聪明,而是因为你还没学会假装看见衣服。保持这种「无知的锋利」,就是发现好问题的终极武器。

爱因斯坦说过:“如果给我一个小时来解决问题,我会花55分钟来明确真正的问题是什么,剩下的5分钟来解决问题。”

苏格拉底说过:“问题是接生婆,它能帮助新思想的诞生。”

海森堡说过:“提出正确的问题,往往等于解决了问题的大半。”

埃隆·马斯克说过:“在很多情况下,提出问题比找到答案更难。如果你能提出正确的问题,那么答案自然而然就出现了。”

好问题来自于人与世界,人与AI的直接周旋中,不来自于对他人成果的围观。所以,别收藏了(除了我这篇),别知识焦虑了,直接下载去互动吧。

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献269条内容

已为社区贡献269条内容

所有评论(0)