一分钟实现DeepSeek本地部署(超详细!)

一分钟实现DeepSeek本地部署超级详细教程来了,仅需三步就可以轻松实现

一分钟实现DeepSeek本地部署超级详细教程来了,仅需三步就可以轻松实现

目录

3.下载Ollama大模型到OpenWebUI(deepseek-r1:1.5b)

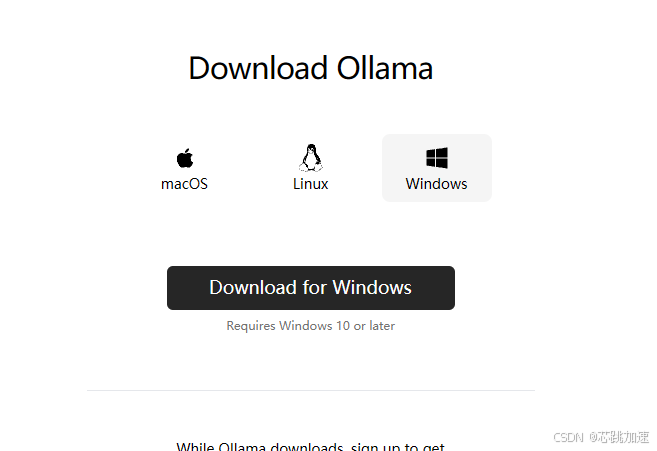

一、安装Ollama

我们去Ollama或Google搜索进入下载页面,页面会根据操作系统自动适配下载的安装包,点击Download按钮完成下载和安装

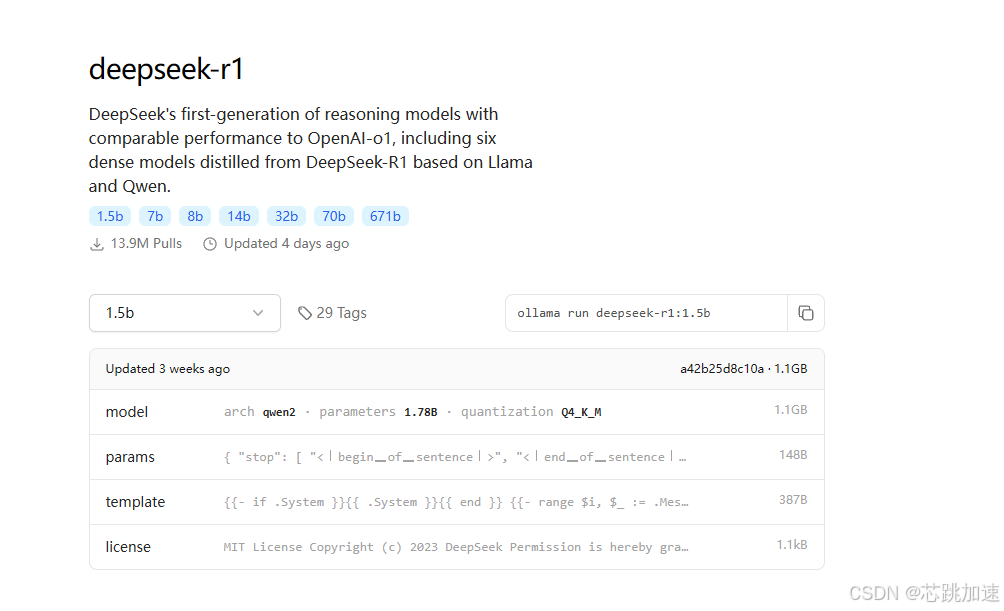

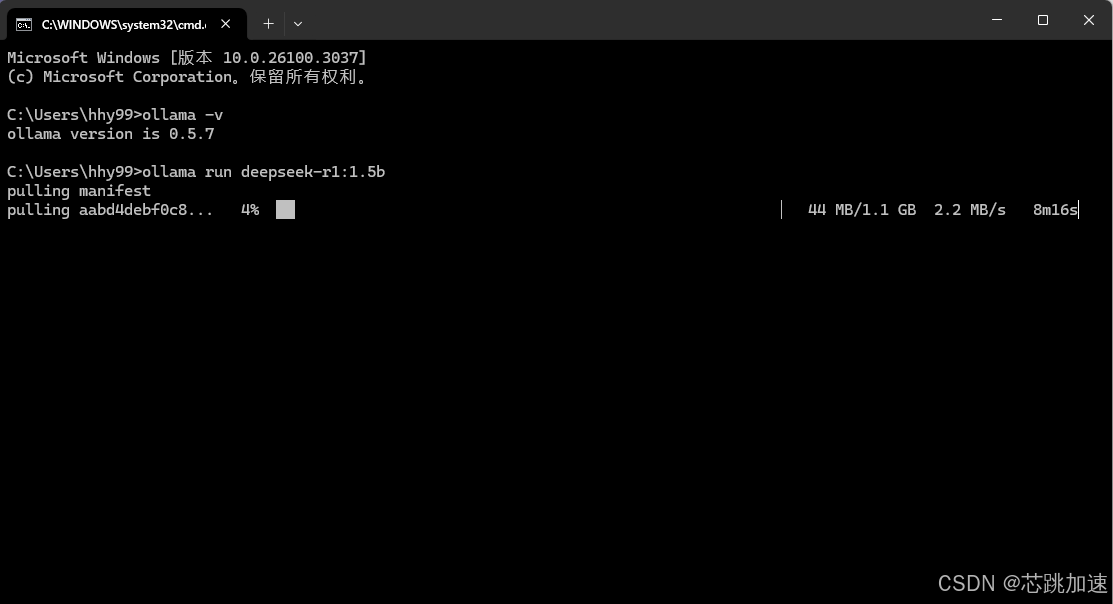

二、安装 DeepSeek模型

我这里选择的是DeepSeek-R1的1.5B模型deepseek-r1DeepSeek's first-generation of reasoning models with comparable performance to OpenAI-o1, including six dense models distilled from DeepSeek-R1 based on Llama and Qwen.![]() https://ollama.com/library/deepseek-r1

https://ollama.com/library/deepseek-r1

三、搭建可视化界面

对大多数使用者来说,使用命令行还是很不方便的,下面就来讲讲可视化界面的搭建过程

1.安装docker

地址:Docker: Accelerated Container Application Development

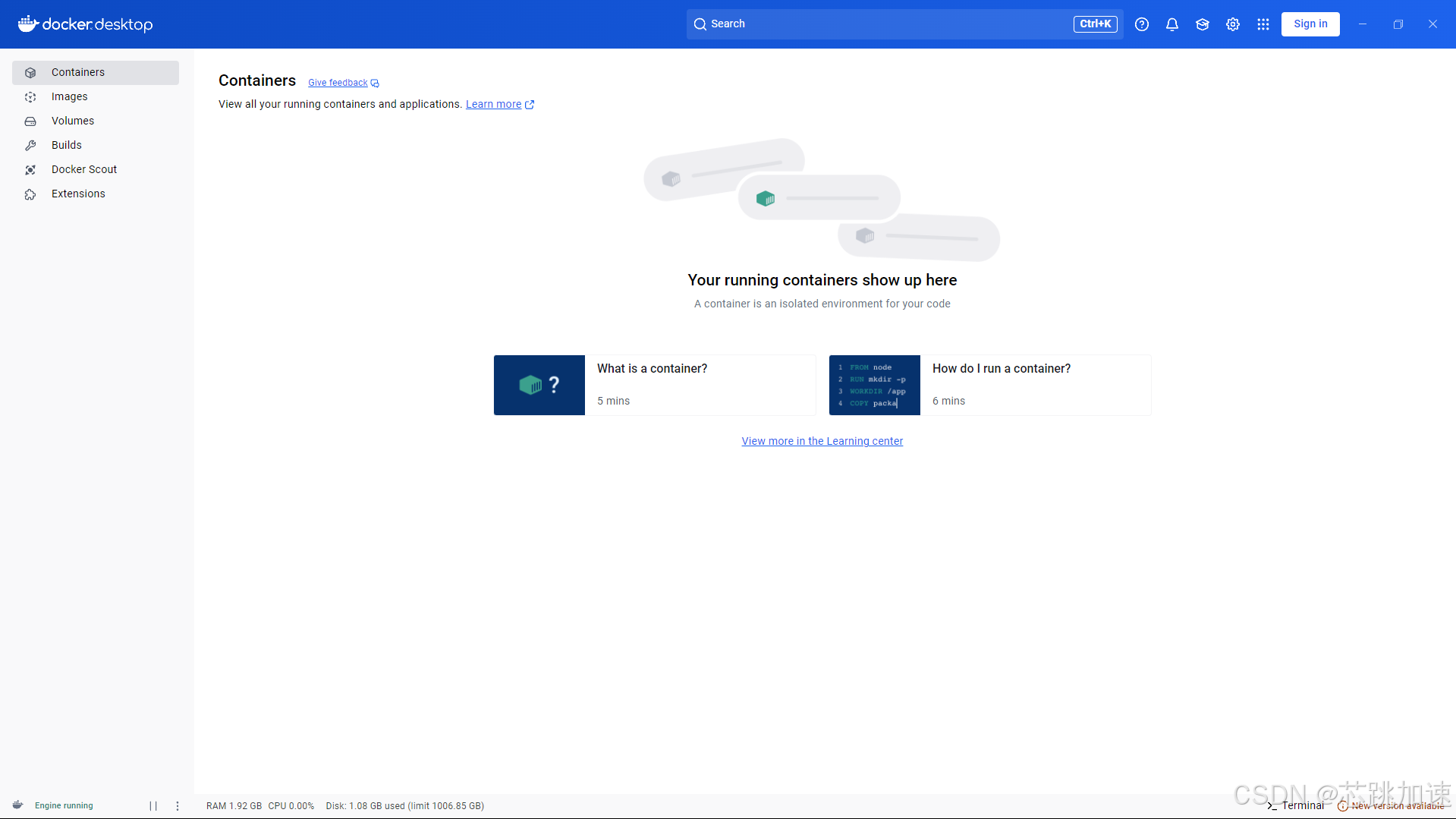

安装完成后如下图,在进行下一步操作前先启动docker

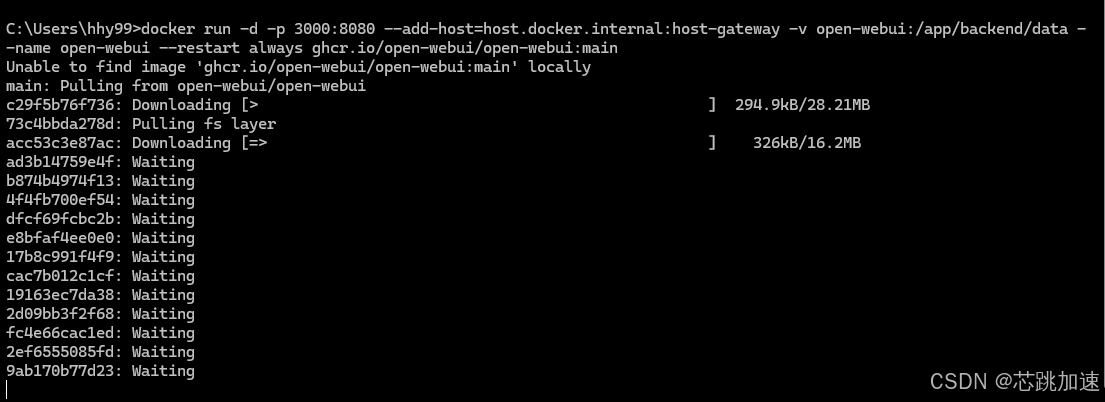

2.安装OpenWebUI

访问官网查看安装指南(🏡 Home | Open WebUI),因为我们已经安装了Ollama,我们使用第一条命令来安装,命令如下:

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

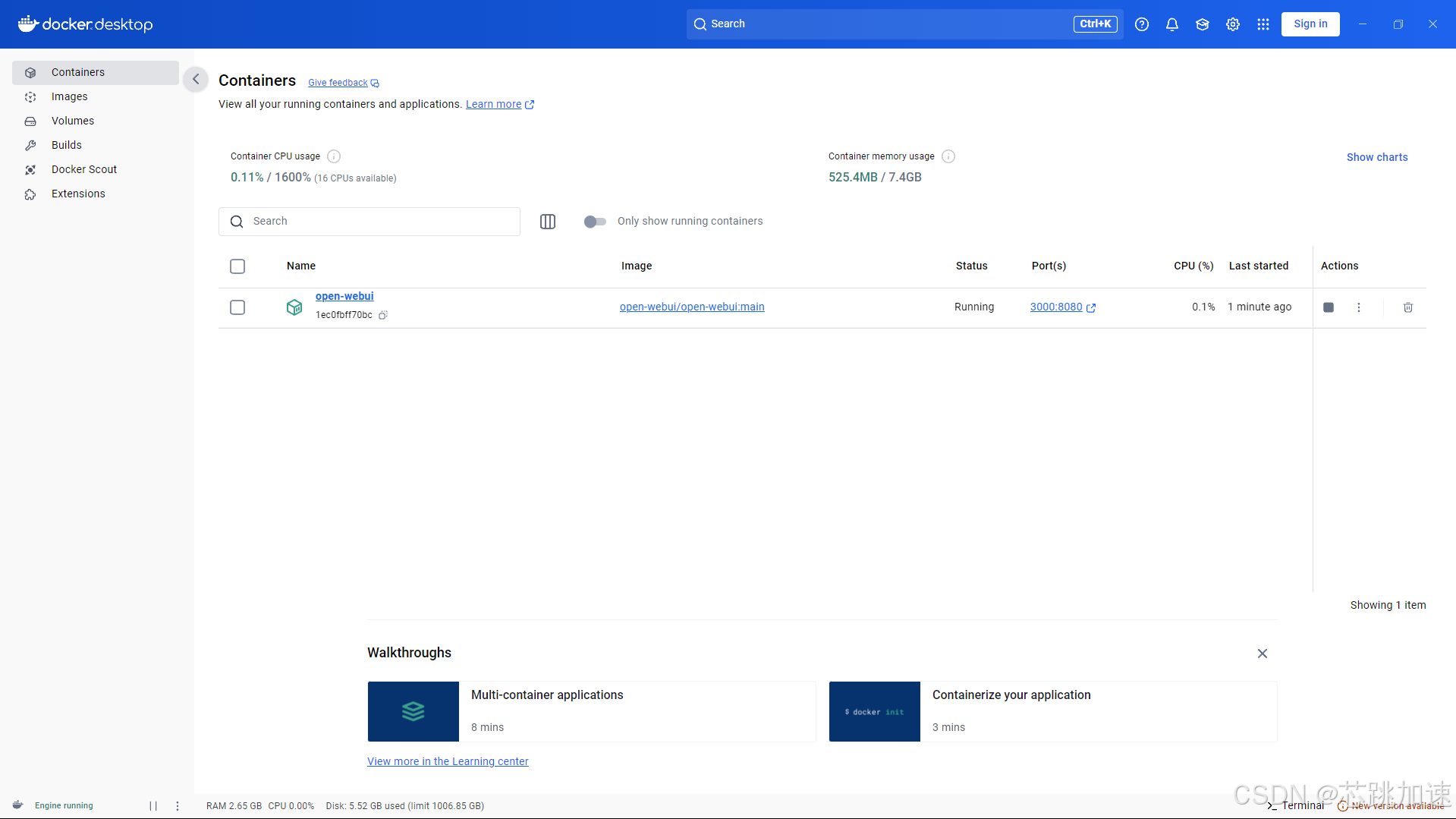

安装完成后,docker界面会出来openwebui的详情

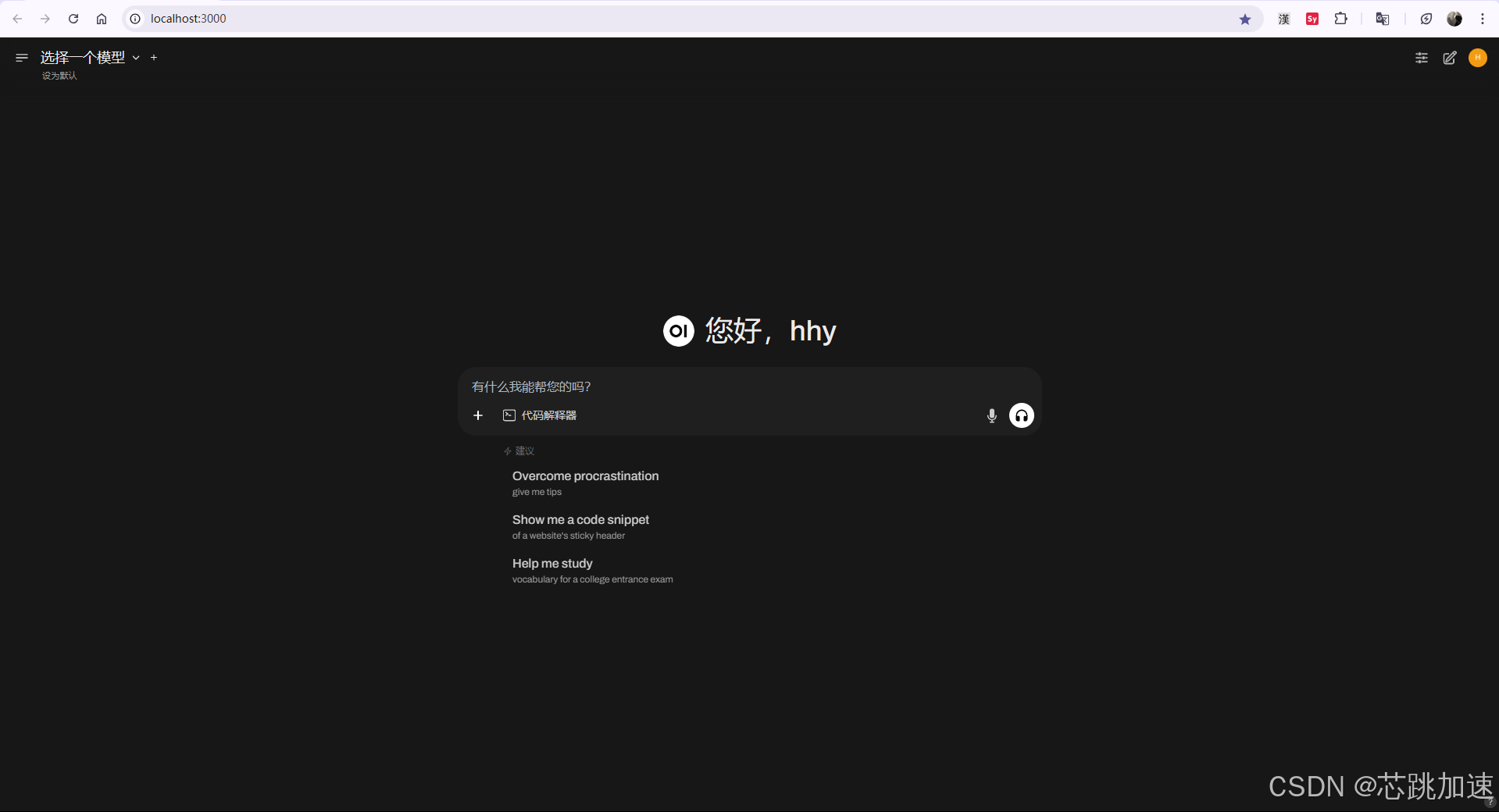

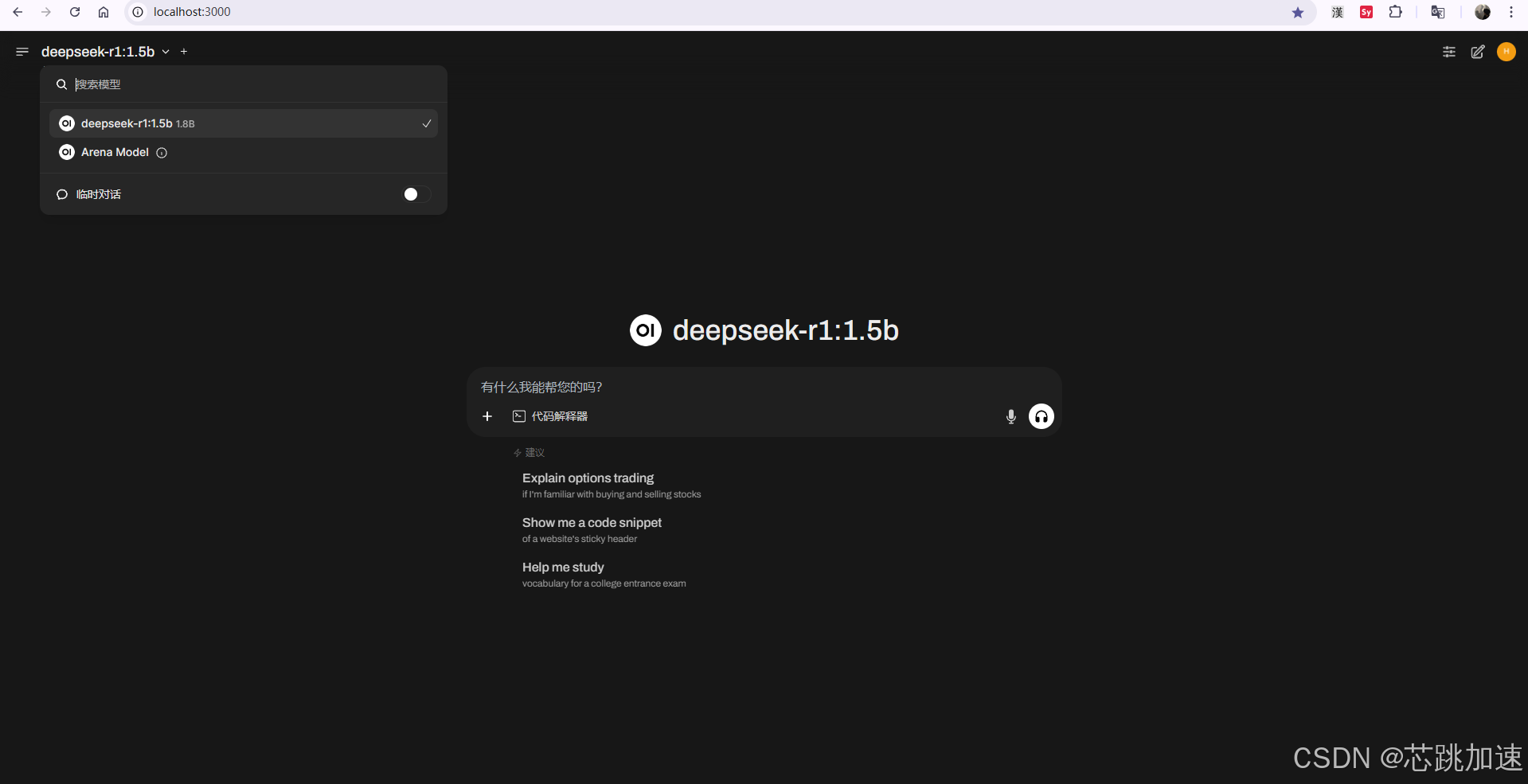

这样就可以通过这个地址进入到网页版的OpenWebUI了(http://localhost:3000/)

3.下载Ollama大模型到OpenWebUI(deepseek-r1:1.5b)

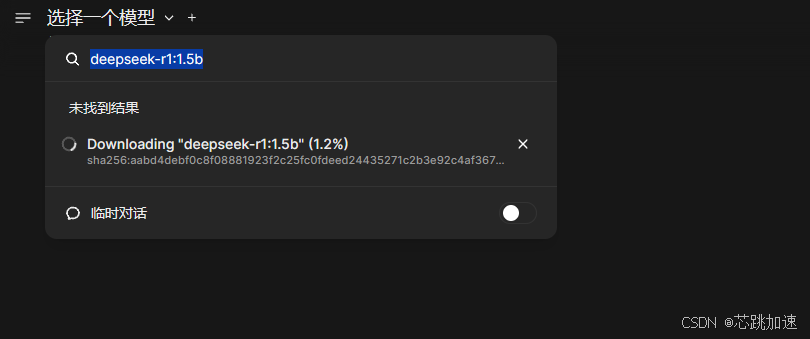

然后因为没有选择大模型,所以我们要从刚才在刚才在Ollama中拉取的下载到此环境

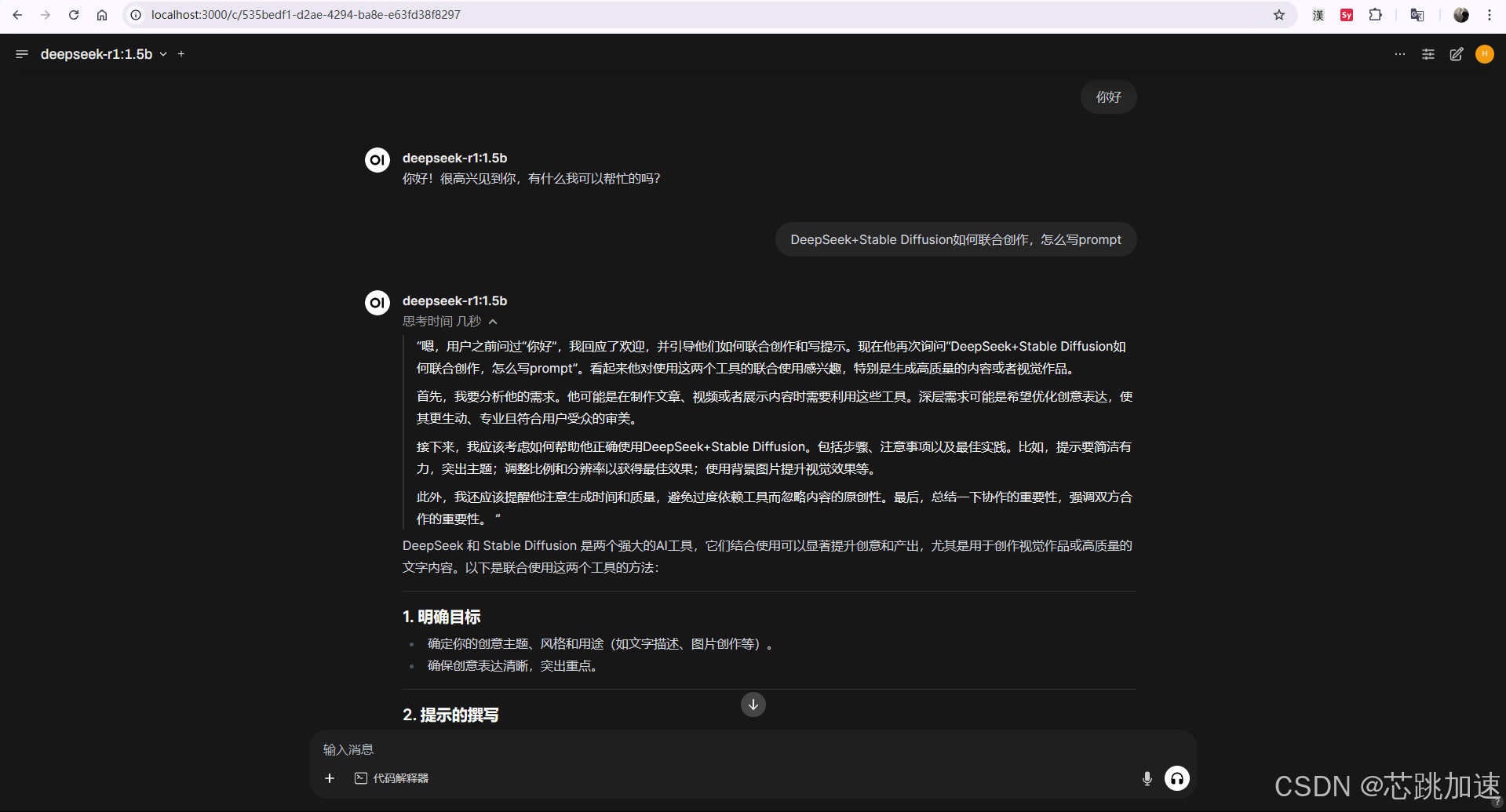

安装速度特别慢,安装成功后就可以使用deepseek大模型了,具体如下:

下面会继续发布DeepSeek与各种主流软件的协同,包括各种编译器、微信、以及私人AI助手

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)