一分钟搞定DeepSeek R1安装【基于windows11私有化部署】

DeepSeek-R1 是由中国人工智能公司 DeepSeek 推出的一款开源推理模型。基于Ollama可在个人电脑上快速部署deepseek-r1 模型。

Ollama简介

Ollama 是一个开源的本地化大语言模型(LLM)运行平台,旨在让用户无需复杂配置即可在个人电脑上快速部署和交互式使用各类开源大模型(如 Meta 的 Llama 3、Mistral、Phi 等)。以下是其核心特点解析:

一、Ollama 的核心价值

-

简化本地模型运行

-

无需云端依赖,直接在本地计算机(支持 macOS/Linux/Windows)运行大模型。

-

通过命令行或 API 一键调用模型,降低技术门槛。

-

-

模型管理便捷

-

内置模型库支持快速下载、更新和删除模型(如

ollama pull llama3)。 -

支持多版本管理,可灵活切换不同参数规模的模型(如 7B、13B 等)。

-

-

隐私与安全

-

数据完全本地处理,避免敏感信息上传云端,满足隐私合规需求。

-

适合医疗、金融等对数据保密性要求高的场景。

-

二、Ollama 的典型使用场景

| 场景 | 示例 |

|---|---|

| 个人学习 | 本地测试模型效果、学习 Prompt 工程技巧。 |

| 离线开发 | 无网络环境下调试模型、构建原型(如智能客服、文档生成工具)。 |

| 企业私有化部署 | 内部知识库问答、代码助手等,避免数据外泄。 |

| 科研实验 | 快速对比不同模型性能,定制微调参数。 |

三、Ollama 的优势与限制

优势

-

开箱即用:安装简单,无需配置 Python/CUDA 环境。

-

轻量化:支持量化模型(如 4-bit 压缩),降低硬件需求。

-

多模态扩展:部分模型支持图文交互(如 LLaVA)。

限制

-

硬件依赖:大模型需较高内存/显存,低配设备可能卡顿。

-

模型范围:仅支持部分开源模型(如不支持 GPT-4 等闭源模型)。

安装Ollama

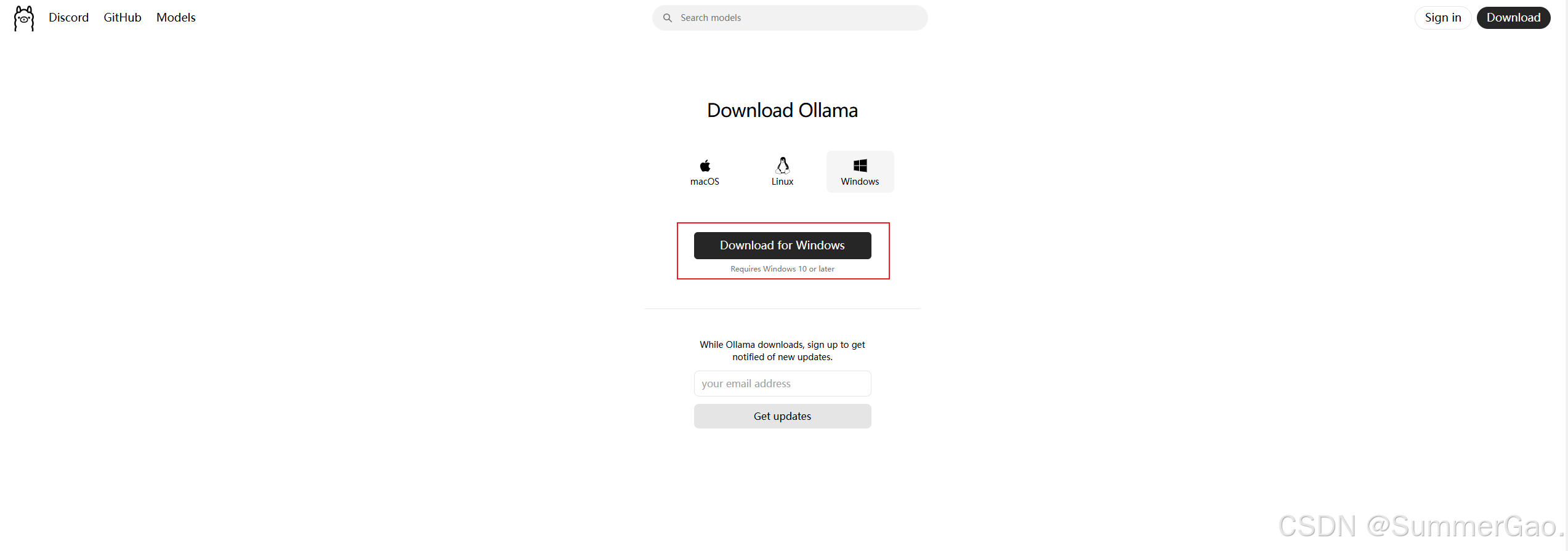

基于Windows图形化安装

访问 Ollama 官网下载页 下载 .exe 文件。

下载完成后,双击安装程序,按提示完成安装。

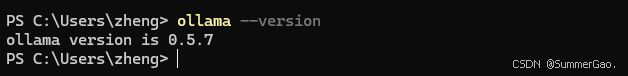

安装后,在 PowerShell 或 CMD 中验证

ollama --version

Ollama模型文件的默认存储位置

在Windows系统中,Ollama下载的模型文件默认存放在用户文件夹下的特定目录中。具体来说,默认路径通常为C:\Users\<用户名>\.ollama\models。这里,<用户名>指的是当前Windows系统的登录用户名。

更改Ollama模型文件的存储路径

由于默认存储路径通常在C盘,而C盘空间有限,用户可能希望将模型文件保存在其他盘符或目录下。为此,可以通过设置环境变量OLLAMA_MODELS来更改模型的下载路径。

步骤一:打开系统属性

首先,右键点击Windows桌面上的“此电脑”或“计算机”图标,选择“属性”以打开系统属性窗口。

步骤二:进入环境变量设置

在系统属性窗口中,点击左侧的“高级系统设置”按钮。在弹出的“系统属性”窗口中,切换到“高级”选项卡,然后点击“环境变量”按钮。

步骤三:新建或修改环境变量

在“环境变量”窗口中,可以在“系统变量”或“用户变量”部分找到或新建一个名为 OLLAMA_MODELS 的环境变量。如果已存在该变量,则直接选中并点击“编辑”按钮;如果不存在,则点击“新建”按钮来创建一个新的环境变量。

步骤四:设置新的存储路径

在“编辑环境变量”或“新建环境变量”窗口中,输入变量名OLLAMA_MODELS,并在“变量值”文本框中输入希望保存模型文件的新目录路径。例如,如果希望将模型文件保存在D盘的OllamaModels目录下,则输入D:\OllamaModels。

步骤五:重启Ollama

设置完环境变量后,需要重启Ollama以应用更改。可以通过任务管理器结束Ollama的进程,然后重新运行Ollama来实现重启。

注意事项

- 在设置新的存储路径时,请确保所选目录具有足够的存储空间,并且具有读写权限。

- 如果在更改存储路径后仍然遇到模型下载到默认路径的问题,请检查环境变量设置是否正确,并确保已重启Ollama。

- 为了避免混淆,建议不要将模型文件保存在系统盘(如C盘)的根目录或重要系统文件夹下。

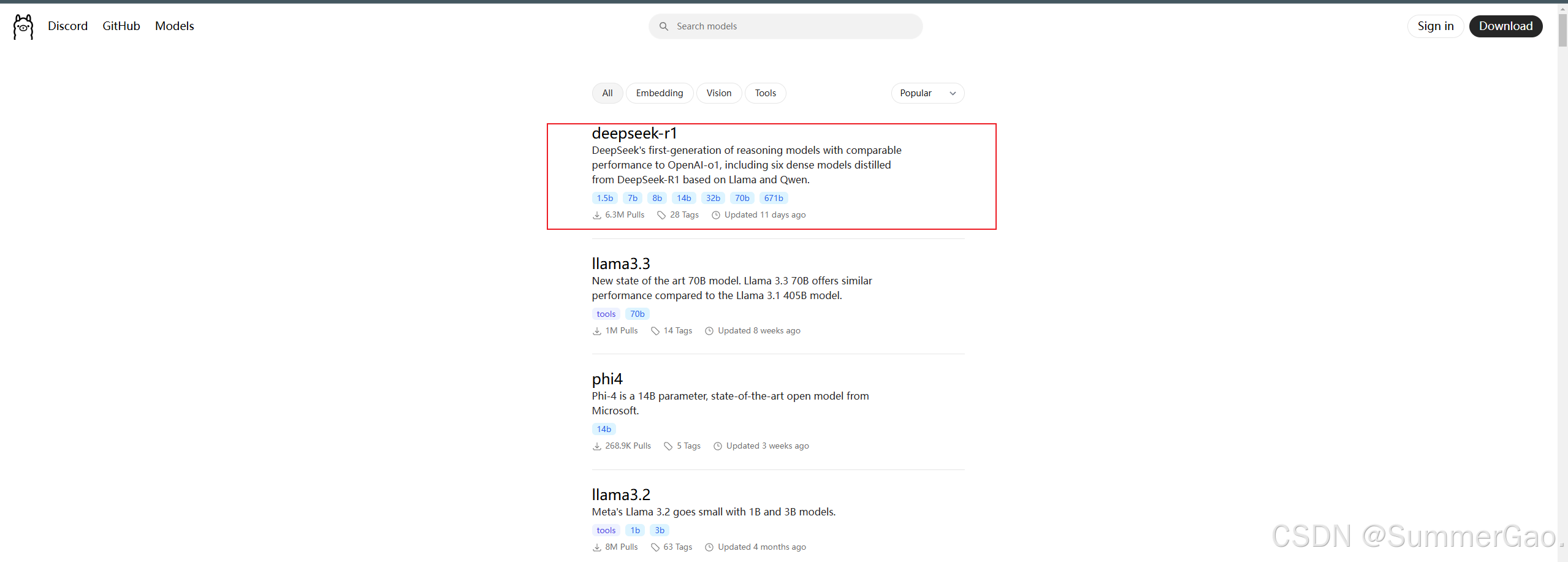

安装 deepseek-r1

访问 ollama 官网并搜索deepseek-r1模型

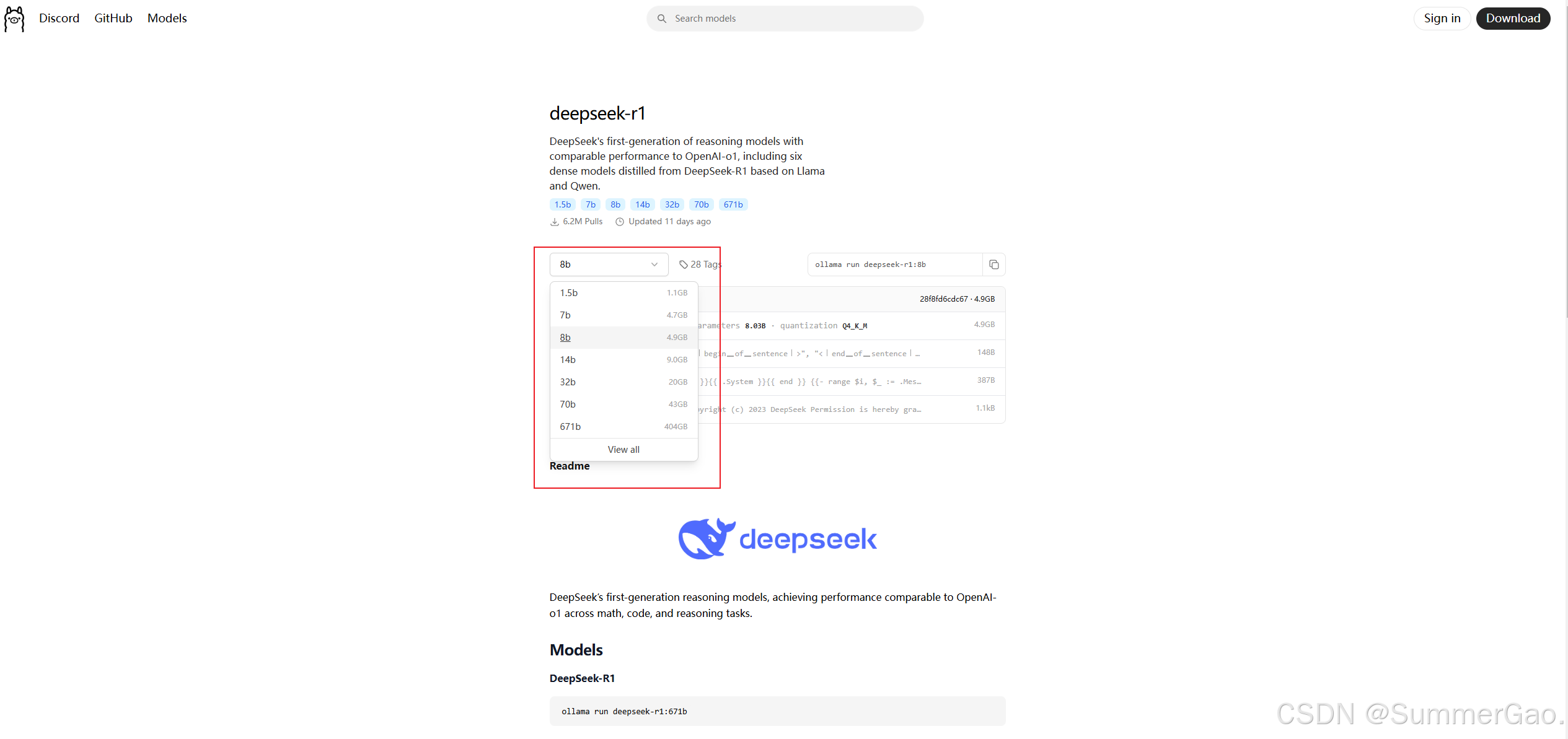

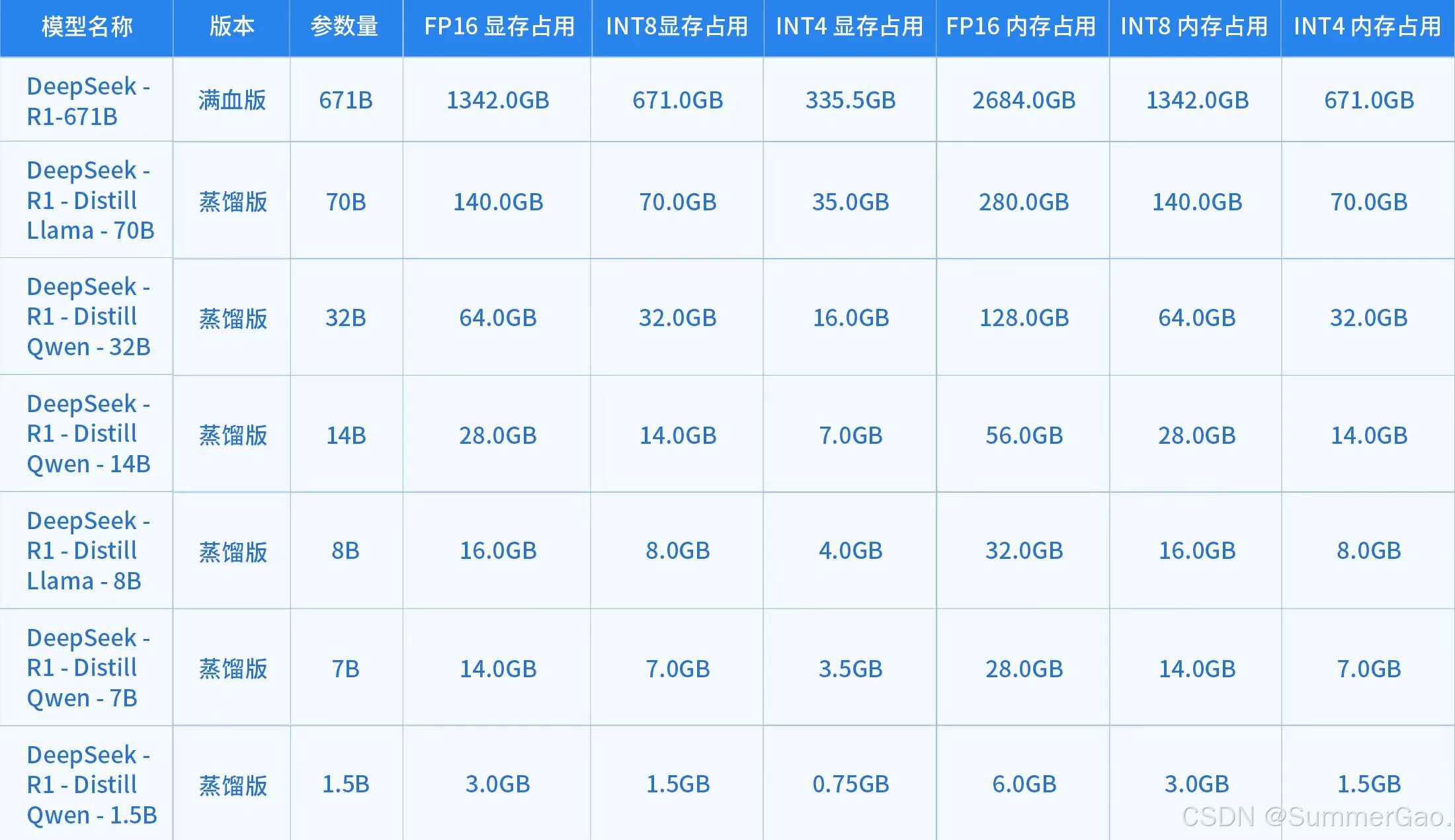

DeepSeek-R1系列涵盖了从轻量1.5B 到超大规模 671B 参数的不同层次模型。参数规模越大,对硬件的要求则越高,显存需求也呈指数级增长。1.5B - 14B 参数的版本适用于个人轻量任务,32B - 70B参数的版本面向企业级复杂任务,671B参数的满血版本则为大规模研究专用。

- 小型模型(如 1.5B - 8B):一般情况下,对显卡要求不高,甚至仅使用CPU也可推理;若要使用显卡,推荐16GB 显存的版本,可处理文本摘要、翻译等中等复杂度的自然语言处理任务。

- 中型模型(如 14B - 32B):14B 模型推荐使用28GB显存的显卡;32B模型则至少需要64GB显存的显卡,适用于多模态任务预处理等高精度专业领域。

- 大型模型(如 70B - 671B):70B 模型需多卡并行;671B 模型则需多节点分布式部署,适用于超大规模研究或通用人工智能探索。

根据自己电脑的配置情况选择合适的模型,数字越大代表性能越强,对电脑要求也越高,这里推荐选择8B版本,具有80亿参数,可以满足日常使用,电脑配置要求低一些。

全尺寸模型的显存与内存占用估算

安装模型

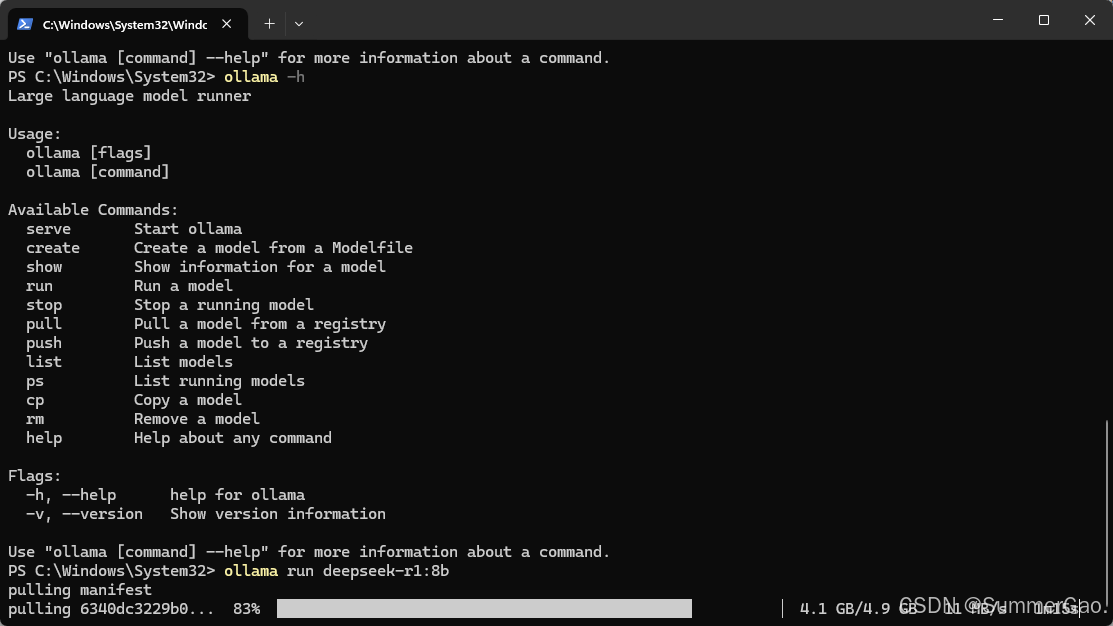

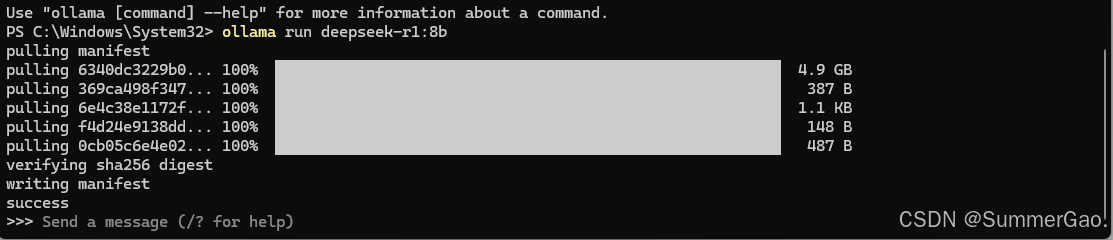

打开命令行窗口并输入:

ollama run deepseek-r1:8b

验证模型

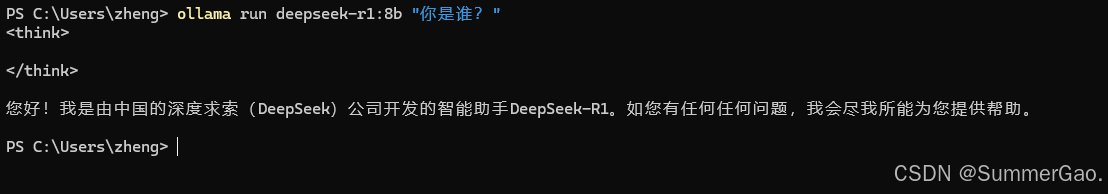

ollama run deepseek-r1:8b "你是谁?"

安装图形化聊天界面

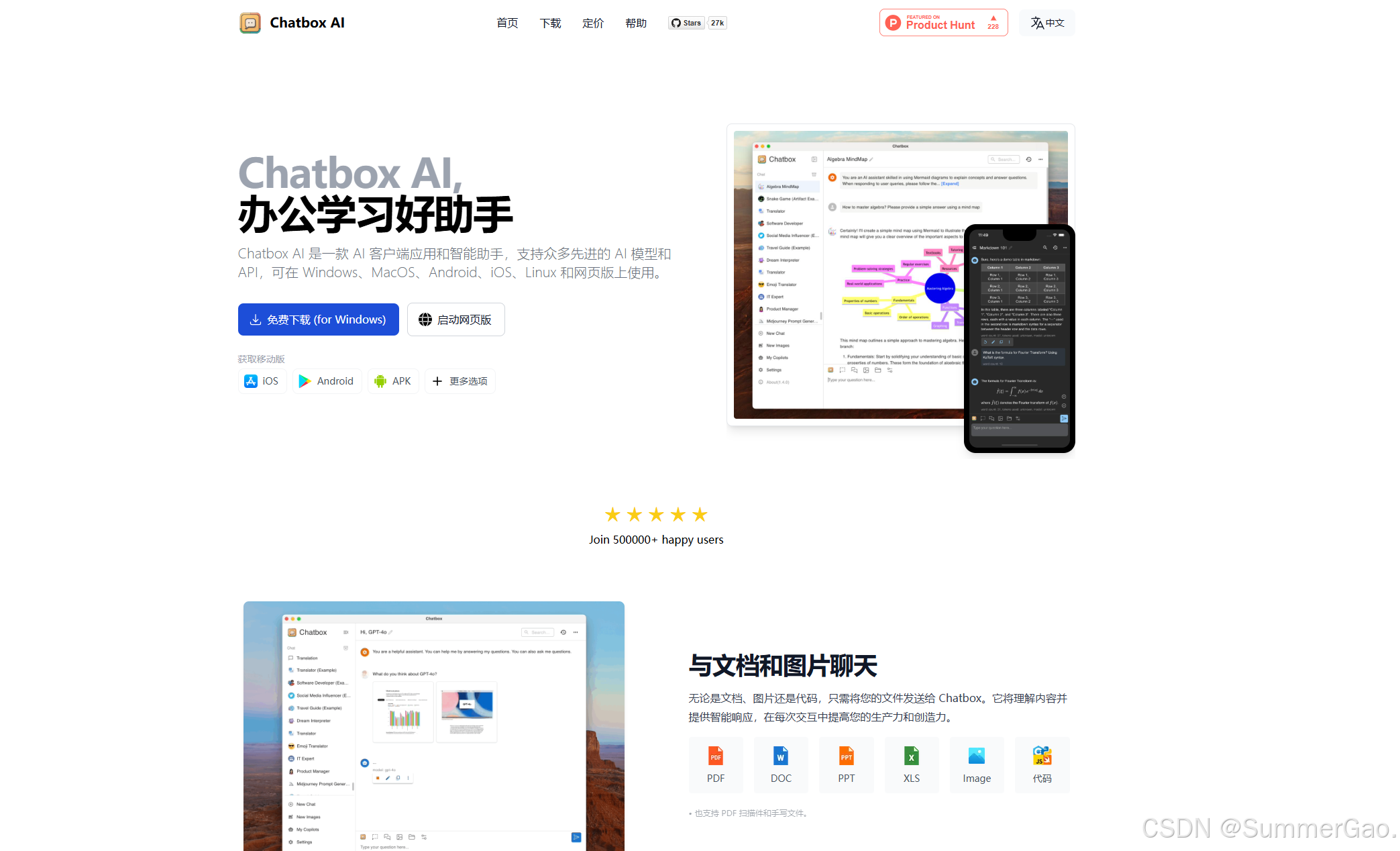

Chatbox AI官网:办公学习的AI好助手,全平台AI客户端,官方免费下载

安装及配置方法可参考如下教程:

祝大家2025财源广进!

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)