DeepSeek-V2:优势与局限性

DeepSeek-V2:优势与局限性DeepSeek-V2项目地址: https://gitcode.com/hf_mirrors/ai-gitcode/DeepSeek-V2...

DeepSeek-V2:优势与局限性

DeepSeek-V2

在当今的AI领域,了解和评估模型的性能和适用性至关重要。本文将深入探讨DeepSeek-V2模型的主要优势、适用场景、局限性以及应对策略,帮助读者全面了解这一强大的语言模型。

模型的主要优势

性能指标

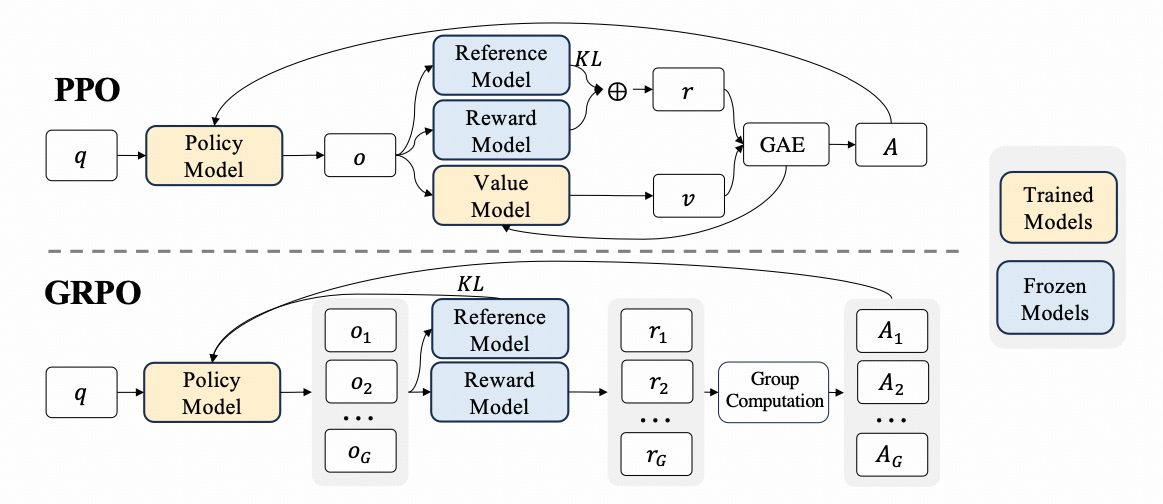

DeepSeek-V2是一款基于Mixture-of-Experts(MoE)架构的语言模型,拥有2360亿个参数,其中210亿参数在每次推理时被激活。与前代模型DeepSeek 67B相比,DeepSeek-V2在多个标准基准测试中表现出色,尤其是在中文和代码相关的任务中,性能显著提升。例如,在C-Eval和CMMLU中文基准测试中,DeepSeek-V2分别达到了81.7%和84.0%的准确率,远超其他同类模型。

功能特性

DeepSeek-V2不仅在性能上有所突破,还具备高效的推理能力。通过优化训练和推理过程,DeepSeek-V2在保持高性能的同时,节省了42.5%的训练成本,并将KV缓存减少了93.3%。此外,模型的最大生成吞吐量提升了5.76倍,使其在实际应用中更加高效。

使用便捷性

DeepSeek-V2提供了多种下载和使用方式,用户可以通过Hugging Face轻松获取模型。为了进一步提升模型的运行效率,DeepSeek-V2还提供了专门的vllm解决方案,优化了GPU上的运行性能。

适用场景

行业应用

DeepSeek-V2在多个行业中展现出广泛的应用潜力。例如,在教育领域,它可以用于自动生成教学内容和答疑;在医疗领域,它可以辅助医生进行病历分析和诊断建议;在金融领域,它可以用于市场分析和风险评估。

任务类型

DeepSeek-V2适用于多种任务类型,包括文本生成、代码生成、数学问题求解等。特别是在代码生成方面,DeepSeek-V2在LiveCodeBench基准测试中表现优异,能够有效应对复杂的编程挑战。

模型的局限性

技术瓶颈

尽管DeepSeek-V2在性能上表现出色,但其Mixture-of-Experts架构在某些情况下可能会导致推理速度较慢,尤其是在处理长上下文时。此外,模型的训练和推理过程对计算资源的要求较高,可能不适合资源有限的用户。

资源要求

DeepSeek-V2的训练和推理需要大量的计算资源,包括高性能的GPU和大量的内存。对于中小型企业和个人开发者来说,这可能是一个较大的挑战。

可能的问题

在使用DeepSeek-V2时,用户可能会遇到模型输出不稳定或不符合预期的情况。这可能是由于模型的复杂性和训练数据的多样性导致的。

应对策略

规避方法

为了规避模型的一些局限性,用户可以尝试优化输入数据,减少不必要的复杂性,或者使用模型的简化版本进行初步测试。此外,合理设置模型的超参数也可以提高模型的稳定性和输出质量。

补充工具或模型

对于资源有限的用户,可以考虑使用其他轻量级模型作为补充,或者利用云计算平台提供的按需计算资源来运行DeepSeek-V2。此外,结合其他工具和模型,如数据预处理工具和后处理模块,也可以进一步提升模型的整体性能。

结论

DeepSeek-V2作为一款强大的语言模型,在性能和功能上具有显著优势,适用于多种行业和任务类型。然而,用户在使用过程中也需要注意其技术瓶颈和资源要求,并采取相应的应对策略。通过合理使用和优化,DeepSeek-V2可以为用户带来巨大的价值和便利。

希望本文能够帮助读者全面了解DeepSeek-V2模型的优势与局限性,并为实际应用提供有价值的参考。

DeepSeek-V2

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)