DeepSeek R1大火的背后,聊聊推理大模型的核心-思维链

DeepSeek作为一款专注于推理能力的大模型,R1的推出标志着大模型技术从“生成”向“理解”和“推理”迈出了重要一步。而在这背后,“思维链”(Chain-of-Thought, CoT)的出镜率也飙升。它不仅是R1模型的核心技术之一,更是推动大模型实现复杂推理能力的关键。

DeepSeek作为一款专注于推理能力的大模型,R1的推出标志着大模型技术从“生成”向“理解”和“推理”迈出了重要一步。而在这背后,“思维链”(Chain-of-Thought, CoT)的出镜率也飙升。它不仅是R1模型的核心技术之一,更是推动大模型实现复杂推理能力的关键。

一、从生成到推理

大模型的发展经历了从“生成”到“理解”再到“推理”的进化过程。早期的模型(如GPT-2)更注重文本生成能力,能够根据输入生成连贯的文本,但在逻辑推理和问题解决方面表现有限。随着技术的进步,模型逐渐具备了更强的语义理解能力(如GPT-3),能够更好地理解上下文并生成更准确的回答。然而,真正的突破在于推理能力的提升,思维链是实现这一目标的核心技术。

思维链的概念最初由谷歌大脑的高级研究员 Jason Wei 提出,并在 2022 年 1 月发表的论文「Chain-of-Thought Prompting Elicits Reasoning in Large Language Models」中进行了详细阐述,旨在通过显式地展示模型的推理过程,提升其在复杂任务中的表现。

简单来说,思维链就是让模型像人类一样,将问题分解为多个步骤,逐步推导出答案。这种“分步思考”的方式不仅提高了模型的准确性,还使其具备了更强的可解释性。

二、思维链:推理大模型的核心

思维链的核心原理是 “分而治之” 策略。当面对复杂难题时,模型摒弃直接生成答案的简单做法,而是有条不紊地通过一系列中间步骤进行逻辑推导。以数学问题为例,模型会首先梳理已知条件,随后依序推导出未知量,最终得出准确答案。

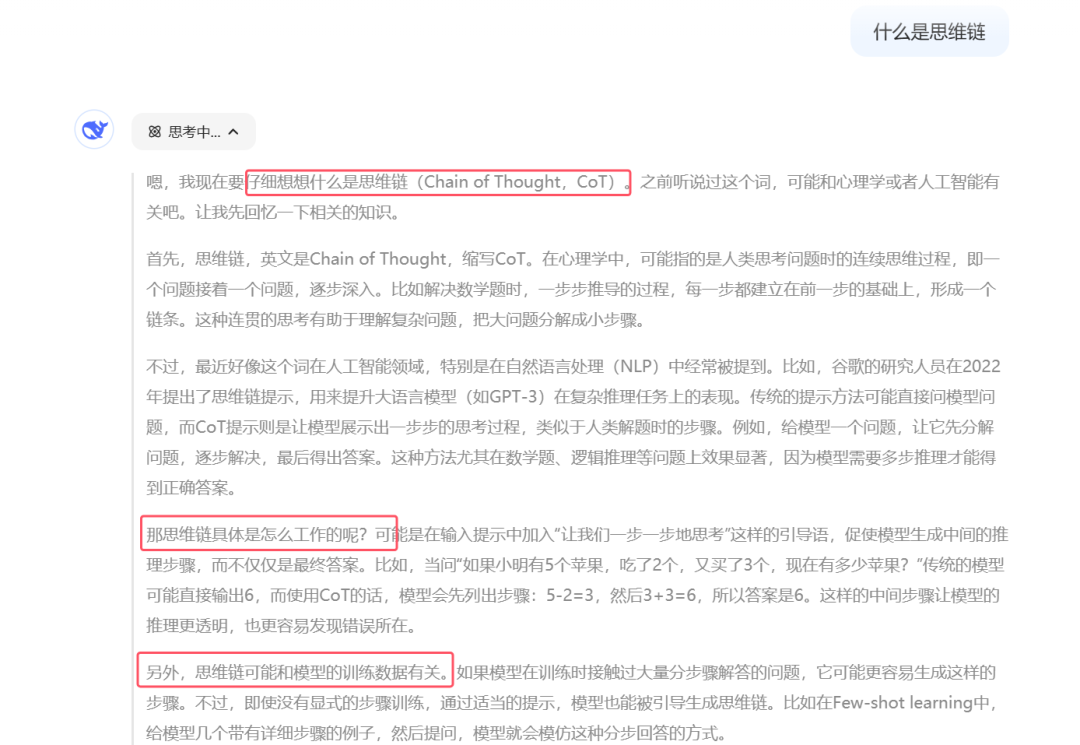

如下图中求解 “若小明有 5 个苹果,吃了 2 个后又买了 3 个,此时小明有几个苹果?” 这一问题,传统模型可能直接输出结果 6,而借助思维链技术的模型则会详细列出步骤:先计算 5 - 2 = 3,再得出 3 + 3 = 6,清晰展示整个推理流程,这使得模型的推理过程更加透明,便于发现潜在错误。

以DeepSeek R1为例,它在处理逻辑推理、数学计算和复杂问答任务时,能够显式地展示其推理过程。例如,当被问到“如果A比B大,B比C大,那么A和C谁更大?”时,R1会先列出已知条件(A > B, B > C),然后通过逻辑推导得出结论(A > C)。这种分步推理的方式不仅让模型的回答更加准确,还让用户能够清晰地理解模型的思考过程。

三、思维链的应用场景

思维链技术的应用场景非常广泛,涵盖了从教育到医疗、从金融到法律等多个领域。

以下是几个典型的应用案例:

教育领域:在智能辅导系统中,思维链可以帮助学生理解复杂问题的解决过程。例如,在数学辅导中,模型可以逐步展示解题步骤,帮助学生掌握解题思路。

医疗领域:在医疗诊断中,思维链可以帮助医生分析患者的症状和检查结果,逐步推导出可能的诊断结果。例如,模型可以根据患者的症状(如发热、咳嗽)和检查结果(如白细胞计数升高),逐步推导出可能的疾病(如肺炎)。

金融领域:在风险评估和投资决策中,思维链可以帮助分析师逐步推导出潜在的风险和收益。例如,模型可以根据市场数据(如股票价格、经济指标)逐步推导出投资建议。

法律领域:在法律咨询中,思维链可以帮助律师分析案件事实和法律条文,逐步推导出法律意见。例如,模型可以根据案件事实(如合同条款、双方行为)和法律条文逐步推导出法律责任。

四、应用技术原理

- 分步提示设计:

-

在编写大模型应用时,通过特定格式的提示(Prompt)要求模型展示思考过程

-

使用关键词如"Let’s think step by step"触发逐步推理

-

支持零样本(Zero-shot)和少样本(Few-shot)两种模式

- 中间状态生成:

-

模型生成中间推理步骤作为文本

-

每个步骤作为后续推理的上下文基础

-

通过自回归方式逐步生成内容

- 结果提取:

-

从生成的文本中解析最终答案

-

通常以

Therefore, the answer is等关键词标识结论

示例1:使用(零样本CoT)

from openai import OpenAI

client = OpenAI(api_key="api_key", base_url="https://dashscope.aliyuncs.com/compatible-mode/v1")

def chain_of_thought(question):

prompt = f"""

Q: {question}

A: 让我们一步一步地思考这个问题。

"""

response = client.chat.completions.create(

model="qwen-plus",

messages=[{"role": "user", "content": prompt}],

temperature=0.7,

max_tokens=500

)

return response.choices[0].message.content

# 测试数学问题

result = chain_of_thought("如果一辆车在2小时内行驶了120公里,那么它的平均速度是多少公里/小时?")

print(result)

代码结果

- 已知条件:

- 车辆在2小时内行驶了120公里。

- 问题要求:

- 求车辆的平均速度(单位:公里/小时)。

- 公式:

- 平均速度 = 总路程 ÷ 总时间

- 代入数据:

-

总路程 = 120公里

-

总时间 = 2小时

- 计算:

- 平均速度 = 120公里 ÷ 2小时 = 60公里/小时

因此,这辆车的平均速度是 60公里/小时。

示例2 少样本(Few-shot)CoT

few_shot_prompt = """

Q: 动物园有 15 只狮子和 20 只老虎。如果将 3 只狮子转移到另一个动物园,还剩下多少只大型猫科动物?

A: 最初有 15 只狮子 + 20 只老虎 = 35 只大型猫科动物。转移 3 只狮子后,35 - 3 = 32。因此,答案是 32。

Q: 书店有 80 本书。他们在周一卖了 25 本,在周二卖了 30 本。还剩下多少本书?

A: 让我们一步一步思考。

"""

def few_shot_cot(question):

full_prompt = few_shot_prompt + f"Q: {question}\nA: Let's think step by step."

response = client.chat.completions.create(

model="qwen-plus",

messages=[{"role": "user", "content": full_prompt}],

temperature=0.5

)

return response.choices[0].message.content

result = few_shot_cot("动物园有 15 只狮子和 20 只老虎。如果将 3 只狮子转移到另一个动物园,还剩下多少只大型猫科动物?")

代码结果

- 初始数量:

-

狮子的数量:15 只

-

老虎的数量:20 只

- 总数量:

- 总的大型猫科动物数量 = 狮子数量 + 老虎数量 = 15 + 20 = 35 只

- 转移狮子:

- 转移的狮子数量:3 只

- 剩余数量:

-

剩余的狮子数量 = 初始狮子数量 - 转移的狮子数量 = 15 - 3 = 12 只

-

剩余的老虎数量保持不变,仍然是 20 只

- 新的总数量:

- 新的总大型猫科动物数量 = 剩余的狮子数量 + 剩余的老虎数量 = 12 + 20 = 32 只

因此,答案是 32 只大型猫科动物。

五、关键要素解析

- 提示工程:

-

使用明确的步骤指示词

-

保持问题与推理的格式一致性

-

示例选择需具有代表性

- 温度参数:

-

较低温度(0.2-0.5)适合确定性推理

-

较高温度(0.7-1.0)促进创造性思考

-

结果解析:

def extract_answer(response): if "answer is" in response: return response.split("answer is")[-1].strip() return response

技术优势

-

提升复杂问题解决能力(数学题准确率提升40%+)

-

增强结果可解释性

-

支持多步骤逻辑验证

-

降低幻觉(Hallucination)概率

实际应用中需根据具体任务调整提示模板和模型参数,对于数学计算等任务,可结合程序验证(Python代码执行)确保结果准确性。

虽然上面的代码示例看似简单,但实际上推理大模型的实现远不止表面代码展示的那么简单。这些示例仅展示了如何使用现有模型进行推理,而真正的复杂性隐藏在模型训练、优化和工程化落地的全过程中。以下是模型层次深入分析:

六、背后的实际复杂性

1. 模型训练成本

-

数据需求:需要清洗TB级的高质量文本数据(例如LLaMA训练用了1.4T token)

-

计算资源:训练175B参数的GPT-3需约3640 PetaFLOP/s-day(约460万美元电费)

-

分布式训练:需掌握模型并行、流水线并行技术(如Megatron-LM框架)

# 实际训练代码的复杂性示例(Megatron-LM片段)

from megatron.core import tensor_parallel

from megatron.initialize import initialize_megatron

def main():

args = parse_args()

initialize_megatron(args)

model = tensor_parallel.VirtualPipelineModel(...) # 复杂的并行化模型结构

2. 推理优化挑战

-

显存管理:加载7B参数模型需约28GB显存(FP32精度)

-

速度优化:

-

KV Cache优化(如vLLM的PagedAttention)

-

动态批处理(Continuous batching)

-

量化技术:将FP32转为INT8/INT4(需处理精度损失)

# 真实推理优化的冰山一角(伪代码)

model = load_model("llama-7b")

quantized_model = apply_awq_quantization(model) # 激活感知量化

engine = build_tensorrt_engine(quantized_model) # 引擎编译

3. 算法核心难题

-

长程依赖处理:Transformer的注意力复杂度O(n²)问题

-

知识一致性:避免事实性错误(如RAG增强技术)

-

安全防护:对抗Prompt注入攻击的防御机制

七、从Demo到生产

| 指标 | Demo示例 | 生产级实现 |

|---|---|---|

| 响应速度 | 2-10秒/请求 | <500毫秒/请求 |

| 并发能力 | 单请求 | 1000+ QPS |

| 显存占用 | 完整加载 | 量化+卸载优化 |

| 错误率 | 依赖模型原始能力 | 有后处理校验层 |

八、实现高质量CoT的关键技术

1. 进阶提示工程

-

自洽性验证(Self-Consistency):

def generate_with_sc(model, prompt, n=5): outputs = [model.generate(prompt) for _ in range(n)] return majority_vote(outputs) # 选择最一致的答案 -

思维树(Tree of Thought):

class ToTController: def explore_steps(self, current_state): # 生成多个可能推理路径 return beam_search(current_state, width=3)

2. 混合架构设计

# 结合符号推理的混合架构

def hybrid_reasoning(question):

if needs_calculation(question):

# 生成Python代码并执行

code = llm.generate(f"为问题写计算代码: {question}")

result = execute_sandboxed(code) # 安全沙箱

return format_result(result)

else:

return pure_cot(question)

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献268条内容

已为社区贡献268条内容

所有评论(0)