本地部署DeepSeek(简单但不简陋)有点幽默,超详细教程!

教你如何本地部署deep seek简易方案

·

大家好,初三繁忙,停更许久~

聊聊DeepSeek(有点无聊)

一、Deepseek:中国AI的破局者

1.1 诞生背景

- 2018年AI寒冬后的技术觉醒:全球大模型竞赛背景下,中国科研团队突破算力困境

- 深度求索(DeepSeek)公司的创立历程:由中科院计算所团队孵化,专注认知智能研究

- 开源战略的制定:2022年发布首个开源版本,构建中文AI生态的里程碑

1.2 命名哲学

- "深度"与"探索"的双重内涵:既指深度学习技术,又象征对AGI的不懈追求

- 中文语义的国际化表达:Seek既代表探索,又与"思考"谐音,体现东方智慧

1.3 发展脉络

- V1.0(2020):基于Transformer的初代模型,专注中文NLP任务

- V2.5(2022):多模态突破,参数量突破百亿级

- V7系列(2023):MoE架构创新,推理效率提升300%

二、从数据到智能

2.1 数据熔炉

- 万亿token级训练语料构成:40%中文高质量数据+35%英文科学文献+25%代码数据

- 独创的Data-Centric清洗流程:基于知识图谱的语义去重技术

- 动态课程学习策略:模拟人类认知过程的渐进式训练方案

2.2 架构演进

- 混合专家系统(MoE)的定制化改进:动态路由算法优化

- 3D并行训练体系:结合流水线/数据/张量并行的分布式方案

- 硬件适配创新:国产算力平台的定制化算子库开发

2.3 训练艺术

- 三阶段训练法:通用预训练→领域微调→人类反馈强化学习

- 能耗控制突破:通过梯度累积策略降低30%显存消耗

- 持续学习机制:在线增量训练保持模型活力

三、技术优势的多维解析

3.1 性能优势

- 中文理解能力:在CLUE基准测试中超越GPT-3.5 15个百分点

- 长文本处理:支持32k tokens上下文,代码生成准确率92.7%

- 推理效率:FP16精度下单卡每秒生成78个token

3.2 工程创新

- 动态量化压缩技术:8bit量化精度损失<0.3%

- 自适应批处理系统:吞吐量提升4倍

- 模块化设计:支持灵活的功能组件插拔

3.3 生态建设

- 开源协议创新:商业友好型Apache 2.0+附加条款

- 工具链全家桶:从训练框架到部署SDK的完整支持

- 社区驱动开发:300+开发者贡献的插件市场

本地部署

下载Ollama

图标是个羊驼,那我就暂且这么称呼吧~网站链接请单击--->羊驼网站https://ollama.com/

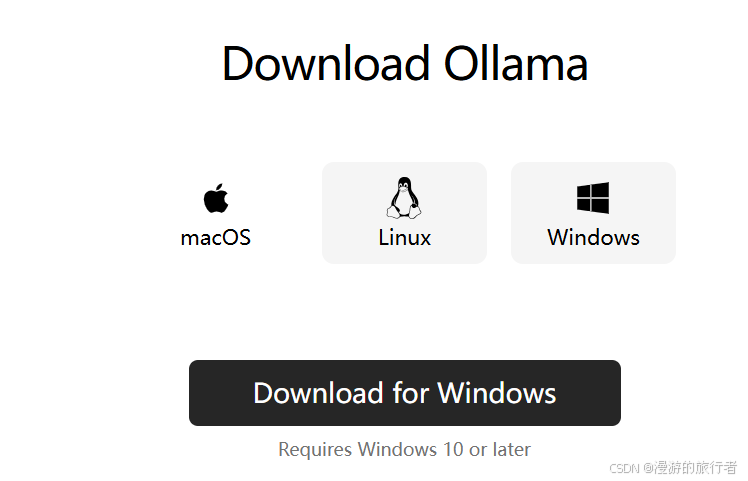

点击那个引人注目的download,似乎下载挺费时间的,可以尝试迅雷或者其他方式

那么继续, 多可爱啊小羊驼

多可爱啊小羊驼

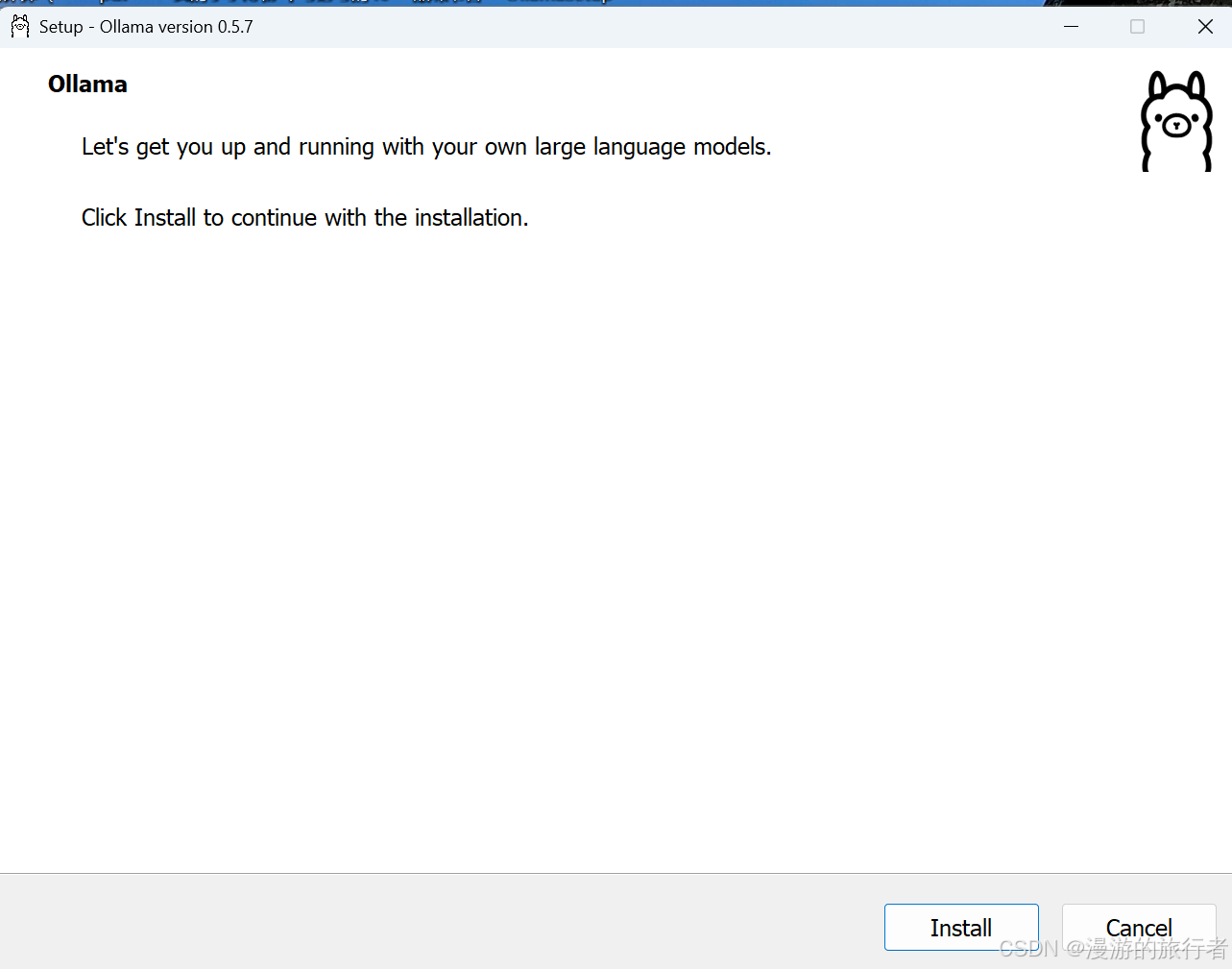

就说关于下载这种东西也不必多说吧, 我正在安装中,说真的,这玩意好可爱

我正在安装中,说真的,这玩意好可爱

继续!

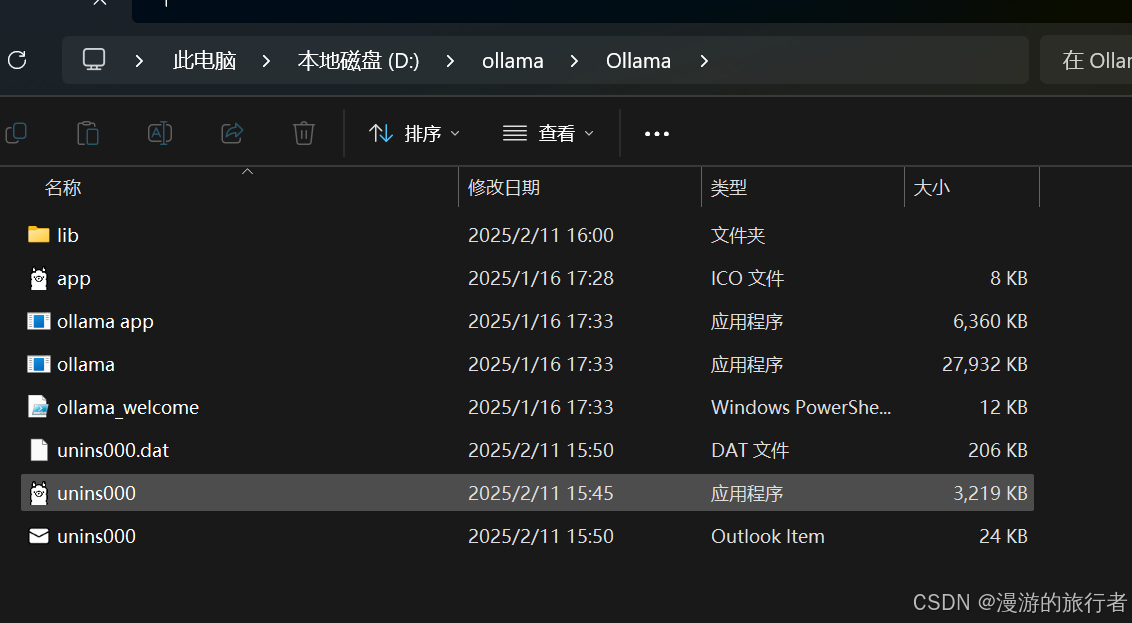

把模型移到D盘(C盘空间过大随意)

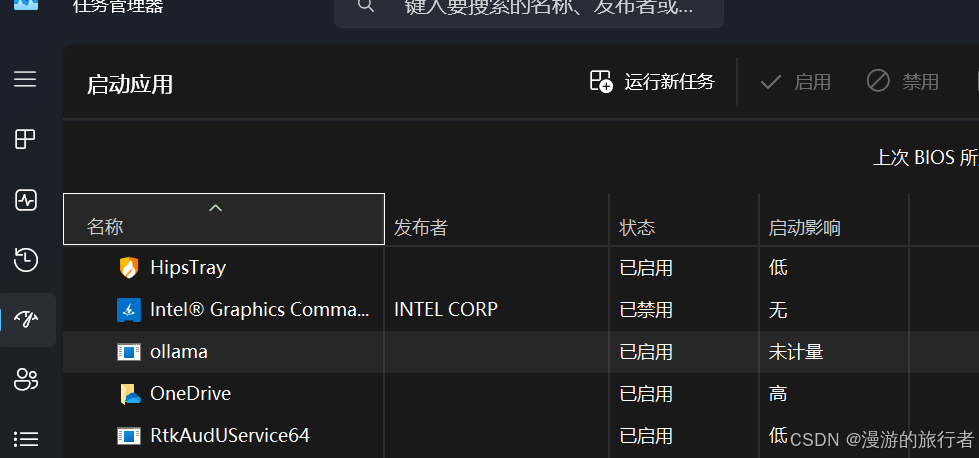

进入Windows启动项,可以选择右键单击任务栏,选择任务管理器

选择启动项,右键单击ollama

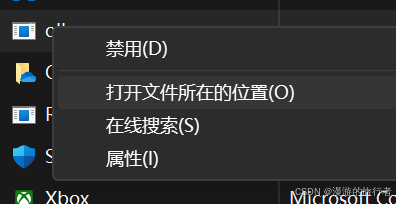

打开文件所在位置

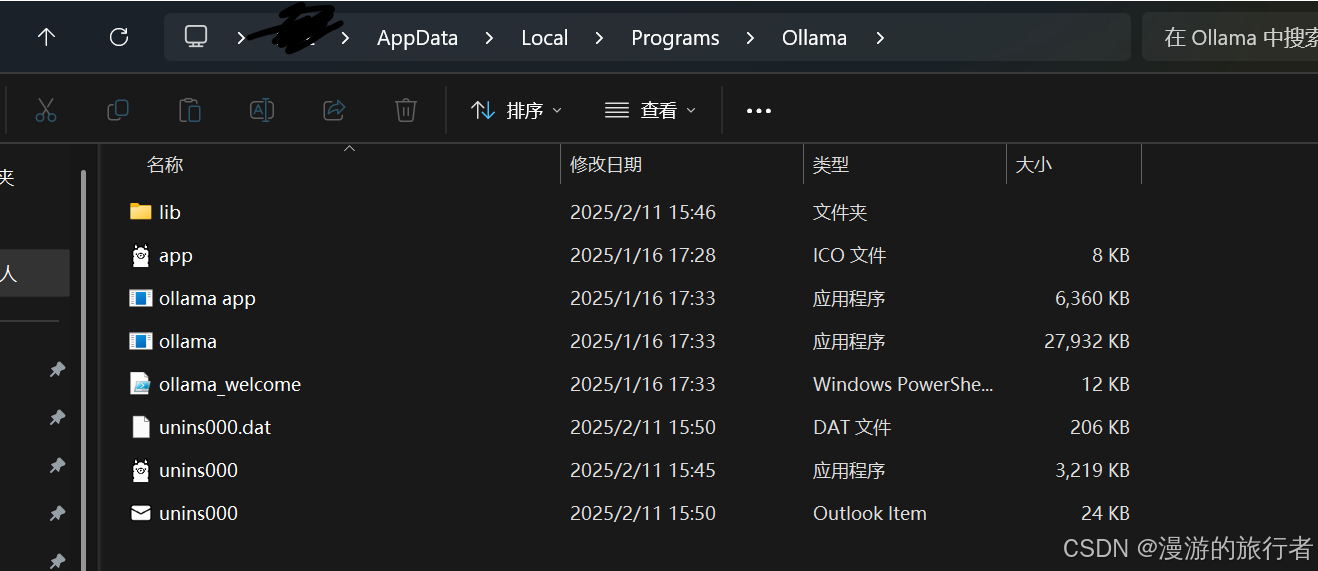

然后点击左上角小箭头进入上一级目录

然后给文件复制弄到D盘

如此,你是现需要新建一个文件夹,再把这个拖拽过去

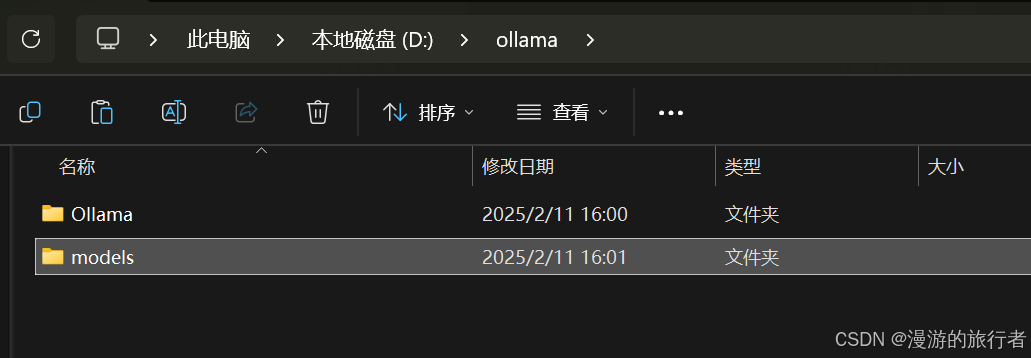

在在同级目录里新建一个models文件夹

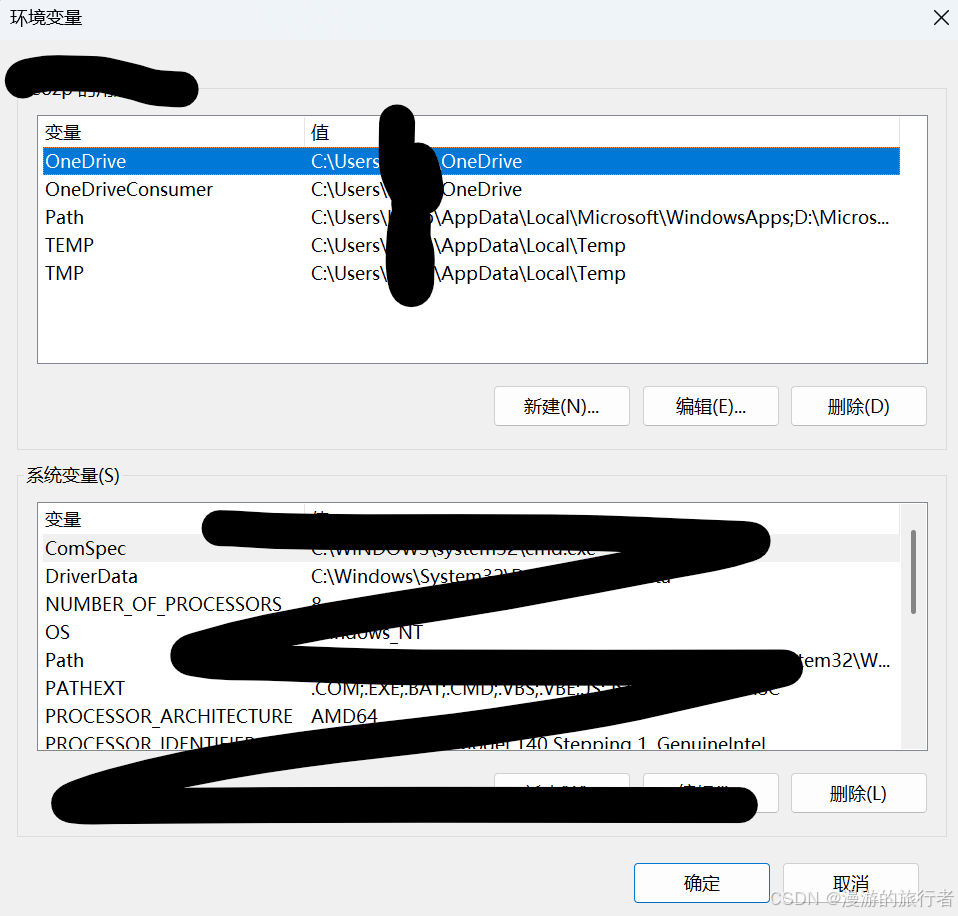

修改系统环境配置

按一下键盘上的小Windows图标

在上面搜索高级系统设置点进去,但当然了,从设置这个软件里进去也可以

选择环境变量

反正就是到这个界面,选择上面那个新建

变量名:OLLAMA_MODELS

路径选择你放置的位置

别忘了点确定哈

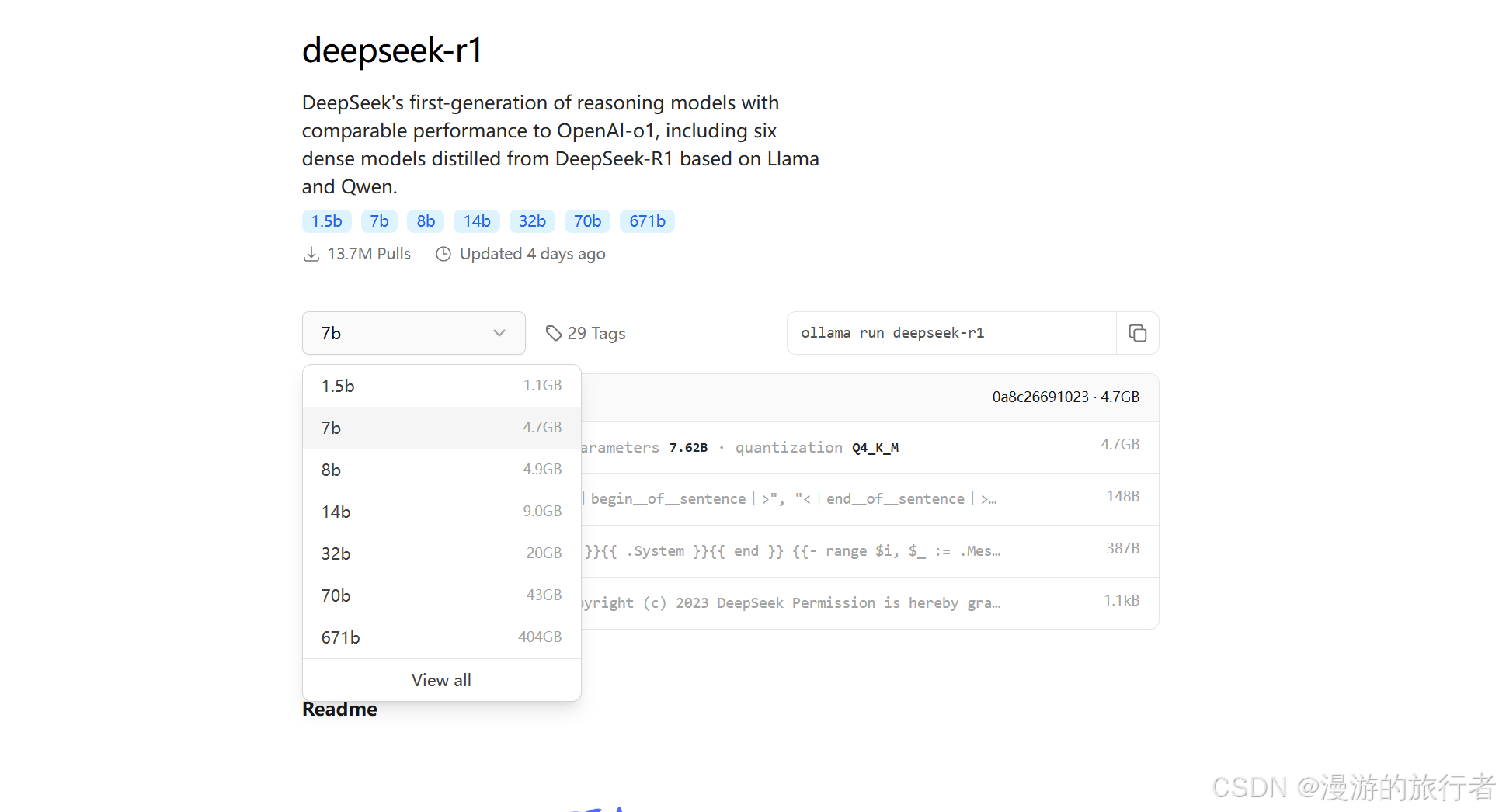

下载deepseek-R1模型参数包

回到羊驼网站主页,点击那个deep seek

、

、

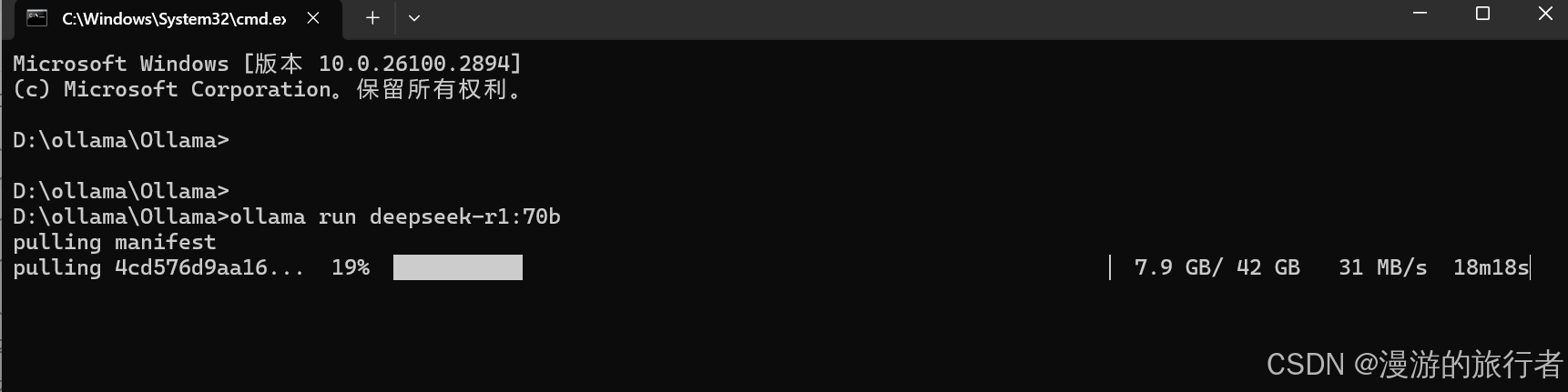

看没看到那个下拉列表,数值越大,大模型越精准,越可靠~

本人虽然是挺破的电脑,但实测8b勉强还行

复制一下8b右侧那个东西ollama run deepseek-r1:8b

进行最终步骤安装

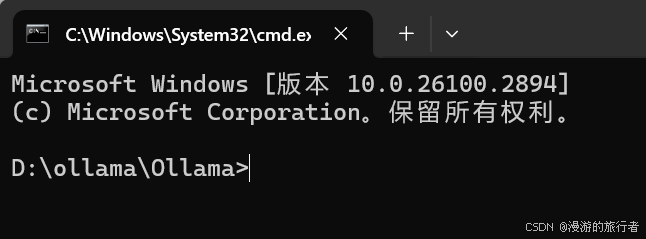

再度打开之前那个羊驼目录

点击上面那个此电脑...一堆东西,输入cmd

回车键,然后粘贴上去,这还行,不算太慢

就可以正常使用了

搭建web UI

打开powershell

先输入

powershell -ExecutionPolicy ByPass -c "irm https://astral.sh/uv/install.ps1 | iex"(未完待续)

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)